面向车载激光扫描点云快速分类的点云特征图像生成方法

2010-09-07杨必胜李清泉毛庆洲

杨必胜,魏 征,李清泉,毛庆洲

1.武汉大学测绘遥感信息工程国家重点实验室,湖北武汉430079;2.武汉大学时空数据智能获取技术与应用教育部工程研究中心,湖北武汉430079

面向车载激光扫描点云快速分类的点云特征图像生成方法

杨必胜1,2,魏 征1,2,李清泉1,2,毛庆洲1,2

1.武汉大学测绘遥感信息工程国家重点实验室,湖北武汉430079;2.武汉大学时空数据智能获取技术与应用教育部工程研究中心,湖北武汉430079

以车载激光点云数据为研究对象,提出一种适合于其快速分类与目标提取的点云特征图像生成方法。首先将扫描区域进行平面规则格网投影,通过分析格网内部点云的空间分布特征(平面距离、高程差异、点密集程度等)确定激光扫描点的定权,从而生成车载激光扫描点云的特征图像。利用生成的点云特征图像,可采用阈值分割、轮廓提取与跟踪等手段提取图像分割的建筑物目标的边界,从而确定边界内部点云数据,实现目标分类与提取。本文以Optech公司的车载激光扫描数据为试验对象,验证本文提出方法的可行性和实用性。

车载激光扫描;数据分类;目标提取;图像分割

1 引 言

三维扫描技术起源于20世纪80年代,在获取空间信息方面提供了一种全新的技术手段,使传统的单点采集数据变为连续自动获取数据,且激光扫描仪能够直接获取被测目标表面点云的三维空间坐标,具有采样密度高、点云分布密集等特点,其已被广泛地运用于文物保护、三维重建、数字地面模型生产、城市规划等领域。

机载激光扫描数据在DEM生成、建筑物顶部重建等方面的处理技术已相对成熟[1-6]。但机载激光扫描只能获取地物的顶部数据,缺乏立面的细节信息(如建筑物墙面)。近年来,以车辆为搭载平台,集成 GPS、INS、激光扫描仪、CCD相机等多种传感器,在传感器同步控制的基础上实现道路以及道路两侧建筑物、树木等地物的表面数据的快速获取已成为国际上研究的热点。国际摄影测量与遥感协会已开设多个专题组从事这方面的研究与讨论。国内外的研究机构与公司也相继推出了一些车载激光扫描系统,如:日本东京大学空间信息科学中心研制的VLMS[7-8],3D Laser Mapping和 IGI公司合资开发的 StreetMapper系统[9],加拿大Optech公司的Lynx系统[10]。

与机载激光扫描点云数据相比,车载激光扫描点云数据中存在大量 Z平面上的点云数据,如垂直于地面的一些竖直面上的点云数据。因而针对机载激光扫描数据处理的一些滤波分类算法,如基于TIN的方法不能满足车载激光扫描数据的需求[2]。一些学者针对车载激光扫描点云数据的特点提出了相应的分类算法。文献[8,11]根据每个断面扫描点的点位空间分布特征对扫描点进行分类,可以将建筑物、道路和树木等初步分离。文献[12]通过分析断面直方图以及点云在 Z轴、Y轴方向投影来实现目标分类。但此类方法需要扫描数据的断面信息,因而难以处理散乱的点云。李必军等[13-14]通过投影点密度和阈值分割的方式实现建筑物边界几何特征的提取。这种方法对于平坦地区的单个对象的处理比较有效。然而,对于大范围的车载激光扫描数据而言,由于受到地形起伏和多目标的影响,上述方法难以奏效,而且效率较低。

针对上述问题,本文提出一种面向车载激光扫描数据快速分类的点云特征图像生成方法。该方法将扫描区域进行平面规则格网投影,通过分析格网内部点云的空间分布特征(平面距离、高程差异、点密集程度等)生成扫描区域的点云特征图像。进而结合图像处理的方法对点云特征图像进行分割和特征提取,从而实现点云数据的快速分类,为进一步的高精度三维重建提供可靠的数据源。

2 车载点云的特征图像生成

由于车载激光扫描获取的点云数据量大,难以直接对点云的几何数据进行分类和特征提取。针对机载激光扫描数据,文献[15]采用距离图像进行分类、目标提取,但简单的距离图像并不能满足车载近距离且包含丰富立面信息的点云分类要求。文献[16]和文献[17]分别将激光点云的反射强度图像和CCD相机获取的地面图像与点云数据融合进行分类和特征提取。但多数情况下系统获取的只有点云数据,在缺少影像数据辅助的情况下从点云数据中提取几何特征仍是一个首要的技术问题。受上述方法的启发,笔者提出一种利用散乱点云几何数据生成能够反映不同目标几何属性的特征图像生成方法,从而可以利用影像分割、轮廓提取与几何分析相结合的方法对散乱的点云数据进行分类和特征提取。

2.1 点云特征图像的生成算法

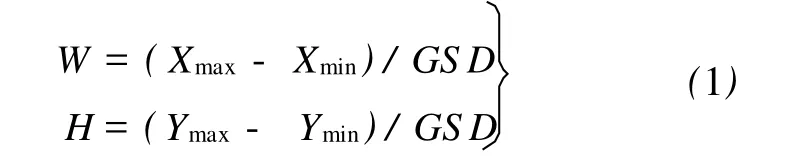

假设扫描区域的最大最小 X YZ坐标分别为:Xmin、Ymin、Zmin、Xmax、Ymax、Zmax,将整个点云区域投影到 XOY平面,并将其分成W×H的格网,格网间隔为GSD,如图1,则有

对于上述W×H的格网而言,一旦通过分析格网内部点云的分布特征(平面距离、高程差异、点密集程度等)确定了每个最小单元的属性(灰度)即可生成一幅能反映整个扫描区域点云分布特征的图像。

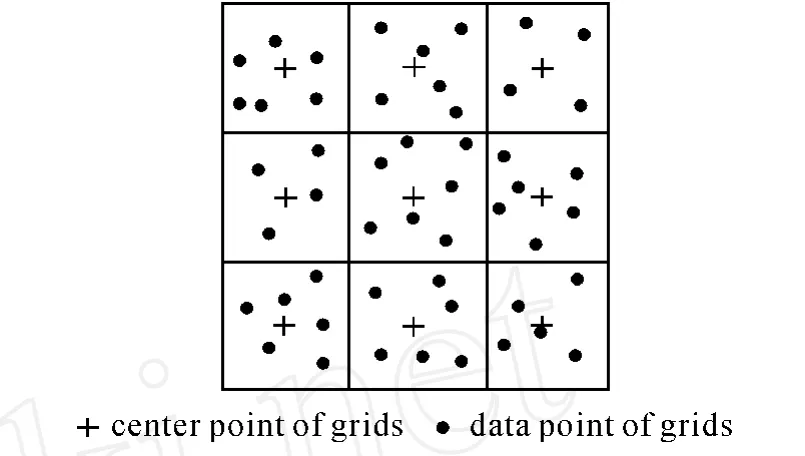

图1 格网示意图Fig.1 Sketch map of grids and data points

假设落在第(i,j)个格网中的激光扫描点个数为 nij,格网(i,j)的中心点为(,,0),利用 nij个扫描点的三维坐标加权计算格网(i,j)的特征值 Fij,然后将其归化到0~255之间形成格网(i,j)所代表的特征灰度 Gij。显然,每个最小单元格内的特征值受落在该单元格内的扫描点的个数、空间分布形式(即平面距离、高程差异等)决定。扫描点距离格网中心点越远则其权值越小;扫描点的高程值越大则其权值越大。

根据以上描述,需要确定落在单元格(i,j)内每个点(如:第 k个点,0 根据上述定义的扫描点的权值公式,通过设定不同的α、β值,可以计算出格网(i,j)的特征值,其描述为 最后将格网特征值 Fij归化到0~255灰度空间即可得到格网对应的点云特征图像的像素值Gij。 根据点云特征图像的生成方法可知,点云特征图像反映了散乱激光扫描点云的空间分布规律与地物的几何特征,因此,可以充分利用图像处理的一些方法,如阈值分割等,对点云特征图像进行分割和特征提取,从而实现点云数据的分类以及目标提取。 进行阈值分割后的图像中蕴含了大量的几何地物,如建筑物、树木等。对分割后的二值图像进行轮廓提取以及边界跟踪,从而实现建筑物和树木轮廓区域的边界特征提取。一旦在点云特征图像中找到几何目标的边界,即可根据点云特征图像与几何数据间的映射关系,实现几何目标扫描数据的边界提取。 本试验采用Optech公司的激光扫描系统L YNX Mobile Mapper(该系统由2个激光扫描仪、2个CCD相机、Applanix POS LV 420系统以及操作软件平台构成,扫描仪视场角360°,每秒获取100 000个扫描点数据)采集的居民区扫描数据,其扫描范围大致为400 m×350 m,扫描点的密度大致为0.01~0.05 m,共8 139 716个数据点。 为了分析格网采样间距以及α、β值对特征图像生成结果的影响,分别采用0.5 m、0.25 m的格网采样间隔进行试验,并对两种不同采样间隔下的α、β值分别进行调整,最后各自生成5组不同α、β值的点云特征图像。对不同采样间隔下的5种图像进行差值相关性分析,即可定量分析不同的α、β值对点云特征图像生成的影响,从而确定最佳的α、β值保证生成的图像能最优地体现不同地物目标的特性,进而为点云的快速分类奠定基础。同时,对基于本文算法提取建筑物的结果与投影点密度(DoPP)算法提取的结果进行了比较。 根据式(1)可知,点云特征图像的生成需要特征图像的分辨率,即格网的大小。由于扫描点云的密度在0.01~0.05 m之间,同时为了保证落入格网内部的点数不至于太少(>10),确定格网采样间距采用0.25 m和0.5 m两种进行试验。针对不同的采样间隔将α值分别设为0.0、0.2、0.5、0.8、1.0,相应的β值分别为1.0、0.8、0.5、0.2、0.0,从而生成两种采样间隔下各5幅图像。从生成的特征图像(为了显示不同图像的优劣,对生成的图像局部显示)(图2(a)中左列图像 GSD为0.5 m,右列GSD为0.25 m,自上向下α依次为0.0、0.2、0.5、0.8、1.0;图2(b)为选取的5幅图像中的一幅)中可以看出,两种采样间隔下没有点数据的格网像素灰度均为0(采用背景色蓝色表示),包含道路数据的格网像素灰度较低,而包含建筑物和树木以及电线数据的格网像素灰度较高,且图像较好地保持了建筑物、树木等的边界特征以及建筑物部分顶面信息,而且可以看出格网分辨率较高时(GSD较小)不同地物类型间的边界差异较明显。 显然,在点密集程度满足要求的条件下,格网间距越小,生成的图像分辨率就越高,细节表现得也越明显。另外,在(α=0.0,β=1.0)的条件下生成的图像因算法的特点很好地表现了电力线等细节,在(α=1.0,β=0.0)的条件下生成的图像却抑制了电力线目标。因此,可以根据不同α、β值生成的图像效果有针对性地选择合适的α、β值来进行特定目标的提取(如电力线)。α、β值的选取依赖于感兴趣的目标特征,在需要提取电力线或者建筑物顶面数据的时候,可以选择α相对较小,β值相对较大的参数设置,这样有助于体现格网内部电力线或者建筑物顶面数据量少但高程相对较高的特征。 图2 本文算法得到的点云特征图像Fig.2 Feature image generated by the proposed algorithm 针对以上不同格网间隔生成的各5种图像(图2),通过统计同一格网间隔下任意两种图像之间灰度变化的像素总数Nchanged以及这些像素的灰度变化率之和∑ratio来计算不同α、β条件下生成的特征图像之间的相关系数ρ(1-ρ=∑ratio/ Nchanged)。图3(a)、图3(b)分别为0.5 m、0.25 m格网间隔的5幅图像之间的相关差异(1-ρ)。图中横轴1、2、3、4、5分别代表(α=0,β=1)、(α=0.2,β =0.8)、(α=0.5,β=0.5)、(α=0.8,β=0.2)、(α= 1,β=0)5种α、β值生成的图像,纵轴为相关差异系数值(1-ρ)。根据式(3),图2(a)第一行的左右两幅图像(不同GSD)因其α=0,可以理解成只考虑高程差异生成的点云特征图像,而图2(a)最后一行的左右两幅图像因其β=0可以理解成只考虑平面距离而生成的点云特征图像。 图3中各个图例的折线图代表各个图像与图像1~5之间的相关差异,其中星号标识表示图像1与2、2与3、3与4、4与5之间的相关差异。通过星号标识的走向可以得知,在格网间隔一定时相邻图像之间的差异呈递减趋势,说明随着α值的增大,生成的图像之间的差异越小,相关性越大,即在权值计算过程中占主导地位的是高程差异因素而非平面距离因素。另外,比较图3(a)和图3(b)的数据可知,格网间距较小时,相邻两个图像之间的变化差异也较小,同时任一图像与其他图像之间的差异在同样α、β条件下也较小。这说明,在一定条件下(点云密集程度满足要求)格网间距越小,本算法生成的图像受α、β的影响也越小。从图3的折线图中可以得知,α=0.2、β=0.8代表的图像2与其他α、β值代表的图像1(α=0,β=1)、3(α=0.5,β =0.5)、4(α=0.8,β=0.2)、5(α=1,β=0)之间的相关差异对比其他图例来说更加稳定,考虑到生成图像对细节的表达(电力线),α=0.2、β=0.8是总体上相对较优的一种参数设置。 图3 不同图像之间的相关差异系数Fig.3 Mutual correlation difference for 5 images with differentGSD 本文采用Ostu阈值分析法对特征图像首先进行二值分割(计算类间方差自动分析阈值),分离出地面与非地面(建筑物和树木),然后对分割图像进行轮廓提取、跟踪得到每个非地面目标的轮廓边界,利用该边界反算提取对应格网中的点云数据,从而实现目标提取。试验采用0.5 m格网间距且α=0.2、β=0.8生成的点云特征图像进行建筑物提取,其结果如图4(a)。采用投影点密度(DoPP)算法(0.5 m格网间距,阈值 T=300)进行建筑物提取的结果如图4(b)。 图4 本文算法与DoPP算法结果比较图Fig.4 Comparison between the proposed algorithm(a)and the DoPP algorithm(b) 对试验区域的53个目标(50个建筑物,3个树木目标)进行提取,从图4中可以看出,相对于DoPP算法,尽管DoPP算法计算简单,耗时短,但本文算法提取的建筑物信息更加完整,包含了顶面信息以及部分窗户的扫描数据,因此提取的建筑物数据能更好地用于建筑物框架提取以及立面细节(窗户、门)建模。此外,DoPP算法更适用于包含单个建筑物的点云数据,对于大范围多目标的建筑物提取,其阈值将难以设定。 表1 本文方法的处理效率Tab.1 Time performance of the proposed approach 本文提出的方法在处理数据时(不考虑数据读入所需的时间),主要耗时在点云特征图像的生成以及目标点云数据的提取上,而图像处理部分的耗时可以忽略不计。本文在CPU频率1.24 GHz,内存768 MB的XP系统下对上述数据(8 139 716个点)进行试验得到如表1中的数据。从表中可以看到,特征图像生成耗费的时间不到14 s,一个目标的提取仅耗费平均2 s的时间,表明本文提出的方法能较大程度提高数据分类和目标提取的效率。图5为提取的树木之一。 图5 本文算法提取的树木Fig.5 Extracted tree by the proposed algorithm 本文以车载激光散乱点云数据为研究对象,提出一种适合于其快速分类与目标提取的点云特征图像生成方法。首先将扫描区域进行平面规则格网投影,通过分析格网内部点云的空间分布特征(平面距离、高程差异、点密集程度等)确定激光扫描点的定权,从而生成车载激光扫描点云的特征图像。利用生成的点云特征图像,可采用阈值分割、轮廓提取与跟踪等手段提取图像分割的建筑物目标的边界,从而确定边界内部点云数据,实现目标分类与提取。本文提出的方法将三维散乱点云数据的处理转化为二维图像进行处理,避免了大量的几何计算,而且可以充分借鉴图像处理的一些方法,很大程度上提高了数据处理的效率,从而能够实现散乱点云的快速分类。 对Optech公司的扫描数据进行试验的结果表明,因顾及了格网内部点云之间的平面距离和高程差异,本文的方法较之DoPP算法更能有效地提取完整的建筑物信息(包括顶面和立面窗户数据),为后续的目标建模提供可靠的数据源。不同格网间隔以及不同α、β值的试验表明,生成的特征图像能从灰度上很好地体现地面数据和非地面数据,同时由于考虑了格网内部最低点高程与最高点高程以及区域的最低最高点高程之间的差异,使得地形起伏对算法结果的影响相对于仅考虑绝对高程的情况有所降低,因而本文算法在一定程度上不受地形起伏的影响,这为下一步的阈值分割和目标分类做了很好的数据准备。对不同参数产生的图像的相关性分析表明,高程差异因素始终是算法中权值计算的主导,而非平面距离以及格网内点数,这也证实了基于DoPP方法提取特征的不足。同时,不同的参数设置会使得生成的特征图像对同一目标产生突出表达或者抑制表达的效果,这也证实了本文算法应用于大范围扫描场景点云数据的快速分类和目标提取的可行性和实用性。例如,电力线的提取可以采用较小格网采样间隔以及较小的α值生成的图像进行处理,而建筑物和树木的提取则可采用较大的α值生成的图像进行处理。 [1] KRAUS K,PFEIFER N.Determination of Terrain Models in Wooded Areas with Airborne Laser Scanner Data[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 1998,53(4):193-203. [2] AXELSSON P.DEM Generation from Laser Scanner Data Using Adaptive TIN Models[C]∥International Archives of the Photogrammetry,Remote Sensing and Spatial Information Sciences.33(B4),Amsterdam:ISPRS,2000:110-117. [3] SITHOLE G,VOSSELMAN G.Experimental Comparison of Filter Algorithms for Bare-earth Extraction from Airborne Laser Scanning Point Clouds[J].ISPRSJournal of Photogrammetry and Remote Sensing,2004,59(1-2):85-101. [4] MAAS H G,VOSSELMAN G.Two Algorithms for Extracting Building Models from Raw Laser Altimetry Data[J]. ISPRS Journal of Photogrammetry and Remote Sensing, 1999,54(2-3):153-163. [5] HAALA N,BRENNER C.Extraction of Buildings and Trees in Urban Environments[J].ISPRSJournal of Photogrammetry and Remote Sensing,1999,54(2-3):130-137. [6] OVERBYJ,BODUM L,KJ EMS E,et al.Automatic 3D Building Reconstruction from Airborne Laser Scanning and Cadastral Data Using Hough Transform[C]∥International Archives of the Photogrammetry,Remote Sensing and Spatial Information Sciences,35(B3).Istanbul:ISPRS,2004: 296-301. [7] ZHAO H,SHIBASAKI R.Updating Digital Geographic Database Using Vehicle-borne Laser Scanners and Line Cameras[C]∥International Archives of Photogrammetry, Remote Sensing and Spatial Information Sciences,35(B3). Istanbul:ISPRS,2004:111-119. [8] MANANDHAR D,SHIBASAKI R.Auto-extraction of Urban Features from Vehicle-borne Laser Data[C]∥International Archives ofPhotogrammetry,Remote Sensing and Spatial Information Sciences,34(4).Ottawa:ISPRS,2002. [9] STREETMAPPER.Street Mapper:Mobile Laser Mapping [EB/OL].[2009-05-23].http:∥www.streetmapper.net. [10] LYNX.LYNX Mobile Mapper[EB/OL].[2009-10-16]. http:∥www.optech.ca/press_L YNX_release.htm. [11] MANANDHAR D,SHIBASAKI R.Vehicle-borne Laser Mapping System(VLMS)for 3-D GIS[C]∥Geoscience and Remote Sensing Symposium.Sydney:IEEE,2001: 2073-2075. [12] ABUHADROUS I,AMMOUN S,NASHASHIBI F,et al.Digitizing and 3D Modeling of Urban Environments and Roads Using Vehicle-borne Laser Scanner System[C]∥IEEE/RSJ InternationalConferenceon Intelligent Robots and Systems.Sendai:IEEE,2004,76-81. [13] LI Bijun,FANG Zhixiang,REN Juan.Extraction of Building’s Feature from Laser Scanning Data[J]. Geomatics and Information Science of Wuhan University, 2003,28(1):65-70.(李必军,方志祥,任娟.从激光扫描数据中进行建筑物特征提取研究[J].武汉大学学报:信息科学版,2003,28(1):65-70.) [14] LI B J,LI Q Q,SHI W Z,et al.Feature Extraction and Modeling of Urban Building from Vehicle-borne Laser Scanning Data[C]∥International Archives of the Photogrammetry,Remote Sensing and SpatialInformation Sciences,35(B3).Istanbul:ISPRS,2004:934-939. [15] BROVELLI M A,CANNATA M.Digital Terrain Model Reconstruction in Urban Areas from Airborne Laser Scanning Data:the Method and the Example of the Town of Pavia (Northern Italy)[J].Computers&Geosciences,2004, 30(4):325-331. [16] UMEDA K,IKUSHIMA K,ARAI T.3D Shape Recognition by Distributed Sensing of Range Images and Intensity Images [C]∥Proceedings of the 1997 IEEE International Conference on Robotics and Automation.Albuquerque:IEEE, 1997:149-154. [17] BECKER S,HAALA N.Combined Feature Extraction for Facade Reconstruction[C]∥Proceedings of the ISPRS Workshop‘Laser Scanning 2007 and Silvi Laser 2007’. Espoo:ISPRS,2007:44-49. [18] OSTU N.A Threshold Selection Method from Gray Level Histogram[J].IEEE Trans on Systems,Man and Cybernetics,1979(1):62-66. (责任编辑:丛树平) A Classification-oriented Method of Feature Image Generation for Vehicle-borne Laser Scanning Point Clouds Y ANGBisheng1,2,WEI Zheng1,2,LI Qingquan1,2,MAO Qingzhou1,2 An efficient method of feature image generation of point clouds to automatically classify dense point clouds into different categories is proposed,such as terrain points,building points.The method first uses planar projection to sort points into different grids,then calculates the weights and feature values of grids according to the distribution of laser scanning points,and finally generates the feature image of point clouds.Thus,the proposed method adopts contour extraction and tracing means to extract the boundaries and point clouds of man-made objects(e.g.buildings and trees)in 3D based on the image generated.Experiments show that the proposed method provides a promising solution for classifying and extracting man-made objects from vehicle-borne laser scanning point clouds. vehicle-borne laser scanning;data classification;object extraction;image segmentation YANG Bisheng(1974—),male,PhD, professor,PhD supervisor,majorsin LiDAR data processing and 3D modeling,multi-resolution representation and progressive transmission of spatial data, spatial-temporal data analysis. E-mail:bshyang@whu.edu.cn 1001-1595(2010)05-0540-06 P208 A 国家自然科学基金(40871185);教育部新世纪优秀人才支持项目(NCET-07-0643);对地观测技术国家测绘局重点实验室经费;测绘遥感信息工程国家重点实验室专项科研经费 2009-10-19 2010-03-17 杨必胜(1974—),男,教授,博士生导师,研究方向为激光雷达数据处理与三维重建,空间数据多尺度表达与网络渐进传输,时空分析。

2.2 基于点云特征图像的车载点云分类与目标提取

3 试验结果

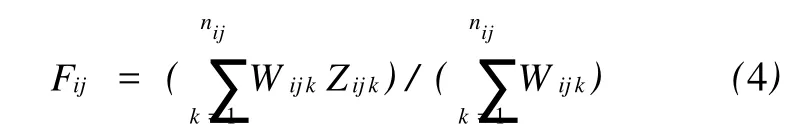

3.1 点云特征图像生成

3.2 点云特征图像相关性分析

3.3 基于本文方法与投影密度法的目标提取效果比较

3.4 效率分析

4 结论与展望

1.State Key Laboratory of Information Engineering in Surveying,Mapping and Remote Sensing,Wuhan University,Wuhan 430079, China;2.Engineering Research Center for Spatio-temporal Data Smart Acquisition and Application,Ministry of Education of China,Wuhan University,Wuhan 430079,China