人工智能融入教育活动的制度准则

2025-02-20惠文婕宣小红

摘 要:人工智能在教育领域的深度融合不仅带来组织行为直接发生变化的一阶效应,也带来教育领域数据资源积累、数据资源使用以及数据形塑教育活动主体的二阶效应。其中二阶效应的影响将会非常深远。因此,要确保人工智能融入教育活动,最大限度地有利于教育的发展,需要从“载体—理型—目的”层面思考机器与人的教育活动的关系,规定基于机器人法则的教育载体之人工智能的开发伦理准则,建立基于正义论的教育理型的算法设计与使用准则,制定基于教育目的之人的全面发展的人工智能共享准则,实现教育对技术的规制、引领与超越。

关键词:人工智能;制度准则;机器人法则;算法分配;人的全面发展

作者简介:惠文婕,中国人民大学教育学院博士后、讲师(北京 100872);宣小红,中国人民大学书报资料中心编审 (通讯作者:2733883261@qq.com" 北京 100872)

基金项目:全国教育科学规划2021年度国家青年项目“人工智能时代高等职业教育人才培养效率及其影响因素研究”(项目编号:CJA210258)

中图分类号:G420" "文献标识码:A" "文章编号:1009-458x(2025)2-0092-16

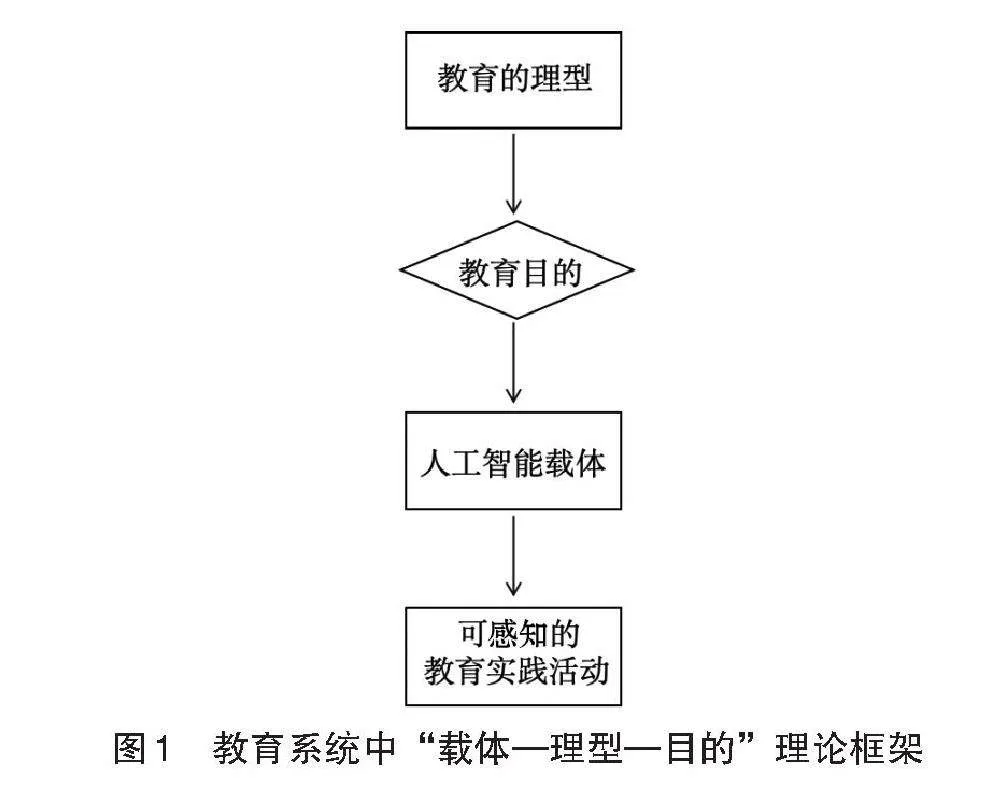

新一轮科学技术革命的发展引起了教育学界的探讨与争鸣。尤其是人工智能、云计算和脑科学等一系列新兴科学技术的发展,使教育界重新思考教育活动变革。新时代技术在教育领域中的深入运用在本体意义上开始动摇我们原有的对教育的理解、判断和追求(唐汉卫, 2018),最为突出的是当前教育主体如何看待新兴技术,并与之建立真正服务于教育理想与价值的人机关系,即人工智能融入教育活动的制度准则。本文试图建立“载体—理型—目的”的理论框架,从普遍性原则探讨人工智能融入教育活动的制度准则,以期为促进人工智能与教育的良性融合提供些许启示。

一、问题提出

(一)人工智能融入教育的伦理困境与现状

教育迈入数字化阶段最显著的特点之一就是教育领域中以算法技术为核心的人工智能的使用。人工智能与教育领域的深度融合,首先带来组织行为直接发生变化的一阶效应,即教育活动领域中教育主体、教育教学过程、教育评价等要素的直接变化;其次带来数据资源积累、数据资源使用以及数据形塑教育活动主体的二阶效应(Leonardi, 2021)。其中二阶效应的影响将会非常深远,带来诸多实践困境。如教育主体面临复杂的伦理困惑;技术层面面临决策伦理问责、算法伦理和数据伦理等问题;社会层面引发新的社会不公平(邓国民 amp; 李梅, 2020)。当前,科技领域对人工智能伦理准则的讨论已达成基本共识(陈小平, 2019);金融领域亦呼吁对人工智能向善的引导(钱斌, 2024);教育领域有关人工智能伦理的讨论也在借鉴与比较中逐步形成一些伦理内涵与建构原则(杜静 等, 2019),深入分析了人工智能与教育融合创新中存在的内在伦理秩序和外在伦理规约的伦理内涵(谢娟, 2023),在同时遵循技术伦理与教育伦理的理念下梳理了教育人工智能伦理原则的四个向度(赵磊磊 等, 2021),提出了教育人工智能的伦理框架(胡小勇 等, 2022)和治理体系(王佑镁 等, 2023),依据教育人工智能应用场景与伦理风险来源提出了教育数据风险、机器算法风险、技术本体风险和教育应用风险的分类框架(王佑镁 等, 2024),对如何保障教师与学生在人工智能技术冲击下的教育权和主体地位进行了伦理策略探讨(周东, 2024; 杨九诠, 2024)。

总体来看,目前建立教育领域人工智能伦理框架和原则的方法有横向比较借鉴、基于教育实践经验总结和从哲学视角出发探讨三种方法。其中横向比较借鉴包括参考国际标准和指南、参考法律法规和技术伦理准则,并依据教育领域的伦理特色进行建构。这种方法可以快速建立起一套可行的教育领域人工智能伦理框架,并进行适应性调整,但忽略了教育领域的独特之处,无法完全涵盖教育领域的特殊情境和面临的伦理挑战。基于教育实践经验总结包括实证调查、专家讨论和共识建立等方式。这种方法可以对教育过程中的实践问题进行针对性解决,但可能缺乏理论支持,不能形成系统的谋划与规制,其可行性容易受到技术快速迭代的影响。从哲学视角出发能够为教育领域人工智能伦理框架的探讨提供深入的理论支持,通过深入考虑教育领域中的价值观念、人的本质等问题,提供更为灵活和可塑的思维方式,使得伦理框架更具有普适性、全面性和灵活性,但也存在抽象性和理论脱离实践的问题。

综上,当前对人工智能融入教育活动的制度准则的研究尚未达成共识,在应然层面还未有充分的哲学讨论。面对新生事物及其带来的未知改变与挑战,我们需要从普遍性的规律和原则视角进行探讨。柏拉图(Plato)的理型论,目前被称为普遍性问题的解决方案。因此,为了掌握以数字技术为基本要素的教育活动主导权,本文将以“建构一个什么样的未来教育”为思考起点,坚持教育自身的精神与规律,借鉴柏拉图自然哲学观点中的概念,从“载体—理型—目的”层面思考机器与人的教育活动的关系,制定最为基础的伦理框架和准则,对其进行最基本的规范引导。本文中准则的概念是指被参与者内化的东西:指引参与者行为的是他们自己对应该做什么的认识,是他们对他人的社会义务,是对共同价值的承诺(W·理查德·斯科特 amp; 杰拉尔德·F.戴维斯, 2011, p.295)。

(二)人工智能融入教育活动带来新的伦理诉求

人工智能的一阶效应贯穿在教育的各个活动过程中,需要基于教育自身建立智能机器在教育领域中开发的伦理原则。首先,人工智能带来教育主体边界与内涵的改变,打破了现代科学赖以建立的主客二分、人与非人的二元论世界观(刘复兴, 2019)。机器人教师、虚拟教师、虚拟学生,甚至赛博格将逐渐成为教育主体的重要组成部分。其次,人工智能带来教育教学过程的丰富与多元化。在虚拟教育活动中,线上教育的迅速发展催生了网校教育、大规模开放在线课程(Massive Open Online Course, MOOC)、直播和知识付费等多种教育方式和教学平台,催生了一对一直播讲解、录播、视频会议等多种在线教学模式。在传统的线下教育活动中,学校建设了新的校园网络环境、班级多媒体教室、网络数字中心等基础环境装备。课堂教学引进了包含电脑、大屏显示设备、书写设备、扩音系统、摄像系统、录课系统等实现资源融通共享的数字教学设备。教学评价采用了智能批改、智能组卷、题库卷库、学情报告分析、错题本和基于语音识别、人机交互等人工智能技术的学业测评和教学反馈。在学校管理中采用了信息技术以实现教育管理的现代化(林松柏, 2023, p.65)。不同的人工智能产品在教育领域的应用,虽然取得了明显的成效,但技术过热、技术商业化和技术崇拜主义也带来教育主体的被驱逐感,引发了学者们对技术在教育过程中使用的合理性和伦理性的呼吁:人工智能技术的使用需要我们基于教育自身的需求进行引导与规制。

人工智能的二阶效应集中在数字资源的积累、数字资源的使用和数据形塑教育活动主体三个维度,其关键在于算法技术的发展与人的发展,因此需要从人、技术与教育的关系角度建立算法的设计与使用准则和人工智能的共享准则。数字资源的积累包含线上教育活动的网络痕迹和线下教育活动的信息搜集,涉及产生数据的主体被动性以及数据收集的合理性、合法性。数字资源的使用涉及知识生产和教学评价中的个体权力、公共权力和智能机器权力的边界划分以及相应的伦理道德风险。数据形塑教育活动主体则表现为主体时空观念的改变。时间观念不像农业时代那样习惯于面向过去的经验,也不像工业社会那样注重眼前和现在,而是更强调面向未来和如何预测未来。空间方面,教与学的空间同时被分割成不同包含关系的子空间,由此引发教师职业的内涵转变与身份认同危机(张优良 amp; 尚俊杰, 2019),学生学习方式向自适应学习方式转变,师生关系变得灵活、自由与民主。与此同时,教育主体将面临信息时代网虫、信息茧房、算法霸权以及被置于数字全景监狱的风险(方正, 2021)。

可见,在享受人工智能为教育教学带来智能化、便利性和高效率的同时,如何规避技术滥用、数据泄密、侵犯个人隐私等伦理风险,已成为当前学术界的重要议题。这不仅是技术本身的问题,更牵涉人、技术与教育三者之间的复杂关系。因此,必须从更加系统的角度审视技术在教育中的角色。本文将从柏拉图提出的“载体”(Receptacle)和“理型”(Forms)概念出发,构建“载体—理型—目的”的理论框架,对不同角色的技术运用提出相应的、最基本的伦理准则,以探索技术融入教育活动领域的边界问题。

二、“载体—理型—目的”的框架分析

载体和理型是柏拉图提出的两个重要概念。他在《蒂迈欧篇》反复强调有三种存在:载体、理型和可感事物。关于这三者之间的关系,他将载体比作母亲,理型比作父亲,可感事物则是他们的后代。本文所使用的载体和理型的概念源自柏拉图的自然哲学,但又有所不同。

(一)承载者——载体

柏拉图认为载体指称的是事物的材料来源,其本身没有任何性质,作为万物的原始材料(本来状态)并不需要划分为各个层次的质料,它永恒单一,颇有原子论的意味。载体本身就是接收器。它虽然无形无性,不可感觉,但可以接受任何形式而生成可感物体。“……事物进入它时是拥有形式的。它是承受一切形式的铸造材料,由它所承受的各种形式所改变、所表现,并因此在不同时候看上去不一样。这样进进出出的事物乃是不朽存在的摹本;其中的压模过程是令人惊奇且言之不尽的。”(柏拉图, 2005, p.109)柏拉图的宇宙生成论将世界分为理念世界和感官世界。载体是理念世界和感官世界的中介和工具——人类思维所能达到的最高层次的认知工具或媒介。在物质世界的生成过程中,当理念世界中的理型“照”在载体上,载体便“接受”了理型的摹本。这个摹本和作为原材料的空间合为一体而产生出可感事物。载体是理型的“接受”者。

载体在科学技术上指某些能传递能量或承载其他物质的物质,泛指一切能够承载其他事物的事物(字词语辞书编研组, 2016, p.1592)。辞海中解释载体为承载知识或信息的物质形体(陈至立, 2022, p.2828)。从“载”字的源流来看,其有“承受”的意思,载体为装运、承运之意(谷衍奎, 2023, p.1080)。可见,从广义上说,举凡概念、思想的沟通的形式以及沟通中所使用的工具,皆可称之为载体。载体是一种具有交流、运载功能的工具,与上述柏拉图更具抽象性质的载体概念相比,它是更加具象化的一个实体概念。

(二)实在的存在——理型

柏拉图说:“存在着理型,不生不灭;既不容纳他物于自身,也不会进入他物中:不可见不可感觉,只能为思想所把握。”(柏拉图, 2005, p.36)由此可以看出理型是理性的对象,理型是本原,是“不朽存在”。理型虽然不容纳也不进入其他事物,但它通过自己的摹本压印在载体上面生成可感知物体,也就是人类可感知的万事万物。理型具有几个特点。一是本质与属性。理型代表了理念世界中的本质或形式,是超越感官世界的普遍性和永恒性的存在。每一个物体在感官世界中都有自己的属性和特征,这些属性和特征是由理型决定和塑造的。二是普遍性与不变性。理型是普遍的,存在于一切同类事物之中。如美、善、真等理型适用于所有美丽的事物、善良的行为和真实的言语。此外,理型是不变的,不受时间和空间的限制,永远保持不变。三是理型是理性的对象。柏拉图认为理型不是通过感官经验获得的,而是通过思维和理性的把握。四是为事物提供形式、结构的来源。理型为万物提供了形式和结构的模板,是万物的原型和范例。感官世界中的一切事物都是理型的参照物或“影子”,通过柏拉图的“塑造”过程,理型在物质世界中呈现出各种形态。五是理型的多元性。尽管存在多种理型,但这并不意味着每一个理型都是独立存在的。相反,理型之间存在一种有序关系,它们相互联系、相互作用,共同构成了理念世界的完整结构。

(三)从载体和理型到目的论

本文中载体和理型的概念是对上述载体和理型概念的迁移与应用。这两个概念及其关系为我们看待当前人工智能技术提供了新的视野。

首先,人工智能技术可以被看作一般概念的载体。一方面,技术满足柏拉图载体概念中“载体不能承接载体”这一内涵。亚里士多德(Aristotle)指出,自然(physis)和技术在本体论上是不同的,因为自然的事物有一个内在的生成和运动原则,以及一个内在的目的论的最终原因,而技术是由一个外部原因和一个外部目的(目标或目的)塑造的。自然的事物都有自己的目的和自我复制,而技术却没有。从这个层面讲,技术符合柏拉图说的载体不能承接载体本身。另一方面,技术可以揭示并产生可感知事物,是人类认识世界的工具或媒介。海德格尔(Heidegger, M.)认为技术具有一种“解放”或“揭示”世界的功能,技术是座架,它可以将一切事物都视为可利用资源的框架或架构(吴国盛, 2022, pp.292-306)。目前众多高新技术的发展共同组成了人类思维所能达到的最高层次的认知工具或媒介。此外,技术可以作为接受者。技术是人类认识世界并改变世界的手段,是人类实现欲望目的的重要途径。如果说理型存在于人的思想与目的中,那么这一理型通过“照射”在技术系统上,就可以创造出符合人类期望的可感知事物。可以说,将人工智能定义在载体类别中,就从属性上确定了人工智能是人类主动对其进行使用来创造人类福祉的一种手段和工具,从而防止陷入“技术决定论”和技术遮蔽的陷阱之中,这也包含了人类对这一载体使用或不使用的自主选择权。

其次,人工智能技术日益成为教育领域的重要载体。人工智能技术在教育数字化转型中日益充当载体的角色,它不仅是传递信息的媒介,更是教育理型的接受者和转化者。它本身并没有固定的教育价值观或理念,却能够接受不同的教育理念、模式和目标,并通过技术加以实现,将抽象的教育理型通过智能化的系统转化为可感知的学习体验、互动环境和教学过程。同时,人工智能技术具备高度的可塑性和适应性,能够承载具有不同价值的教育理型,按照不同的教育体系、文化背景和教学场景进行调整和适应。可以说,人工智能会从本质上改变教育活动中的主体关系,成为人获取知识的重要媒介。虽然当前对人工智能没有普遍的定义,但其本质是关于知识的学科——怎样表示知识以及怎样获得知识并使用知识的科学。人工智能在教育中的应用正是对这一思想的实践,它使知识的获取方式发生了深刻变化,影响了教育主体之间的关系。如当前清华大学的本科教学开始训练并引入人工智能助教:教学助理负责收集整理师生在课堂中的数据信息,将这些数据信息喂养给人工智能助教,对其进行训练。这样的人工智能助教如果训练得当,不仅可以帮助教师在课堂上更高效地传递知识,还能通过数据分析提供个性化的学习反馈,增强学生的自主学习能力。这种转变让人工智能成为教育过程中不可或缺的知识媒介,并可能会成为学习者高效获取知识的第一载体。

再次,柏拉图的理型概念是一般事物的普遍概念。具体在教育中,教育理型指的是教育活动中超越现实实践的理想状态或终极目标。教育理型既不同于现实中的具体教育行为或制度,也不是特定历史或文化背景下的教育模式,而是教育的永恒本质与核心价值,是教育作为自身存在的“不朽存在”。教育理型追求的是知识、德性、公正与终极意义的统一,它不受历史、文化、社会等因素的影响。

最后,目的是人类理型与载体结合的主动性动力。柏拉图的理念论是一种外在的有神目的论。在柏拉图的哲学体系中,理型是每一种事物的完美、永恒的本质,而载体则是理型在感官世界中的具体表现和实现。柏拉图认为,理型虽然超然独立于具体事物,但它赋予了这些事物一种内在的方向性和目的。这个“目的”是一种驱动的力量,是让理型在载体中得以显现的主动性动力。柏拉图的理论虽然带有抽象的神学色彩,但他试图说明我们做出价值判断的能力(撒穆尔·伊诺克·斯通普夫 amp; 詹姆斯·菲泽, 2005, p.56)。正是人类存在的一种对目的或价值的觉知,才赋予了人类理性的活动,而理性是一种追求目的并对目的进行权衡的能力。另外,舍勒(Scheler, M.)指出技术的根基在于种种无目的的欲望(吴国盛, 2022, p.9),这一论断揭示了技术起源的无目的论,亦符合柏拉图对载体无性的定义。这种观点表明理型与载体相结合的无目的性。但这种无目的的状态并非永久存在。随着人类文明的进步,人类开始将自己的理型(即理性化的目标、价值和理念)赋予技术,并引导其发展。通过赋予技术明确的目的性,人类实现了理型与载体的有机结合。在现代技术中,理型与载体的结合并不是混乱无序的,而是为了实现某种统一性或终极目标,如对理性、正义、智慧等理念的终极目标的实现。在教育系统中,正是通过对教育理型的引入,才能将符合教育发展规律的秩序带进人工智能的载体世界。

综上所述,如果将教育看作一个具有自主性的有机系统,那么教育系统可以看成三个层面的结合过程:以技术系统作为载体,以教育理型与之结合,实现教育系统的目的(这种教育目的带有一定的价值判断),生成未来实践层面的、可感知的教育活动(如图1所示)。由此,我们可以建立起“载体—理型—目的”的理论框架,这一框架可以用于人工智能伦理讨论的分类与范畴划定,划定当前学术界对人工智能带来的伦理问题的担忧与讨论是处于哪个层面。

三、建立载体、理型和目的层面的人类教育活动制度准则

教育作为一项以人为中心的活动,其制度准则不仅是对教育过程的规范,更是对教育理念和目的的体现。因此,从普遍性原则探讨人工智能融入教育活动的制度准则,需要以“载体—理型—目的”理论框架为基础,从教育活动的基本要素出发,明确技术应用的道德与价值边界,凸显技术在教育活动中的工具性与价值承载性。

(一)基于机器人法则规定教育载体之人工智能的开发伦理准则

人工智能在教育领域中的深入运用逐渐成为一种不可阻挡的趋势,也是未来教育高质量发展的内在需求,其在教育领域中的应用核心是借助大量的教育活动数据与不同的算法技术。由此产生一个不可忽略的严重担忧:在大多数情况下,人工智能产品是按照人工智能决策者和开发者的立场设计的。若我们把关乎教育领域的重要活动和原则放权或委派给人工智能决策者或开发者,就会将教育活动乃至社会置于极大的风险之下。因此,要确保人工智能等新技术融入教育,最大限度地有利于教育的发展,就需要我们努力确保引进教育技术的方式一开始就能赢得教育共同体的信任和信心,能够为教育领域争取最大的利益,并主动阻止任何潜在的、意想不到的后果。

教育领域中人工智能的开发必须遵循教育主体“人”的最高地位。1942年,艾萨克·阿西莫夫(Asimov, I.)在《我,机器人》(I, robot)一书中,首次提出著名的“机器人学三大法则”。其中,第一定律:机器人不得伤害人类个体,或者目睹人类个体将遭受危险而袖手不管;第二定律:机器人必须服从人给予它的命令,当该命令与第一定律冲突时例外;第三定律:机器人在不违反第一、第二定律的情况下要尽可能保护自己的生存。(Asimov, 2004, p.27)在阿西莫夫创作一系列机器人短篇科幻小说并提出“机器人学三大法则”时,世界上还没有机器人,但随着第一台工业机器人的诞生,人们开始重新审视这些看似科幻的技术法则,对这些法则的模糊性和漏洞进行探讨与补充,形成了多种基于三大法则的规则集。如机器人不能伤害人类的感知能力,或者不作为让人类的感知能力受到伤害;机器人必须时刻确认其作为机器人的身份;机器人必须能够向公众识别自己(“对称识别”); 机器人必须能够向公众解释其决策过程(“算法透明度”); 所有被赋予类似人类理性和良知的机器人都应该以兄弟情谊的精神对待彼此。可见,在所有机器人的法则或规则中,都强调对人主体性的最高维护。因此,我们可以借鉴这一原则的理念,规定教育领域中人工智能的开发伦理准则。

第零原则:教育界的人工智能开发与应用必须以机器人学原则集为基础。机器人哲学以及伦理学是未来智能机器发展的基石。即使在机器智能还未达到人类智能时代的现在,也需要考虑这一原则。如需要我们共同以科学理性的方式考虑“引进的众多教育技术(如AR)是否会伤害人的感知能力”这一命题,需要大量教育研究者进行基础研究并予以数据集支撑,以此来训练智能教育机器明白这一规则的意思。现有研究发现,把一些简单的心理搜索转包给谷歌可能会降低我们大脑可靠存储和回忆记忆的能力(Sparrow et al., 2011);由于我们人类皮质容量所能提供的群体规模限制大约为150人,因此频繁连接社交媒体和虚拟现实环境可能会使得我们的大脑皮质过度劳累,从而引发焦虑以及注意力、认知甚至记忆障碍(Nicolelis, 2017);互联网对我们的注意力、记忆过程和社会认知等方面产生了快速和持续的改变,对人类的大脑结构和功能产生了影响(Firth et al., 2020)。未来,我们需要更多这样的研究来训练智能教育机器人。此外,人工智能在机器学习过程中必须遵循“对人类有益”原则,并需要生成解释机器学习的学习过程记录。“对人类有益”目前虽是一个模糊的定义,但随着人类认知水平的提升以及多元教育研究的数据集喂养,人工智能机器将会有足够高的智慧对是否对人类有益进行短期与长期的综合判断,并将这一结果予以呈现。

第一原则:教育界的人工智能开发与应用必须遵循以人为中心的原则。随着强人工智能的到来,我们必须更加重申与彰显人的主体地位,以防技术异化人类的品格。人工智能将为制定和实现教育目的带来全新的算法决策过程。如果认可在足够细致的数据粒度下,宇宙是可以计算的,或者说至少人类的符号世界是可以计算的。那么,教育目的的制定就可以依据算法的方式,进行计算模拟,以人类未来发展能力为因变量,逐步加入政治、经济、科技、文化和社会等自变量,求得人类未来能力的发展维度与边界以及相应的实现路径集合。对集合结果的产生和选择,必须遵循以人为中心的原则。这里的“以人为中心”包含“人类个体”以及“人类整体”原则,内涵这样一种假设与理念:存在一种算法路径,可通过以“人类个体为中心”实现“人类整体”的利益。二者之间的统一与冲突,在于人们对人类整体利益的追求方向与途径,未来的算法智慧有望提供更加理性客观的图景。

第二原则:在教育公平与效率之间,人工智能的开发与应用必须以人类公平为优先考虑原则。公平与效率是教育的两大永恒话题。算法时代的人工智能带来教育公平的内涵转变:不仅包括人与人之间的教育公平,也包括人与机器之间、机器与机器之间的教育公平。因此,需要我们建立基于人机关系的新的教育公平与效率观念。在未来人类发展的无限可能中,公平与效率之间的最优解是否存在还有待于人类进一步的探索,但二者处于动态发展的过程中是毋庸置疑的。教育具有公益属性,是调节社会差距的主要途径,在公平与效率向最优解动态演化的过程中,需要在兼顾公平与效率的前提下,遵循公平优先原则,并坚持透明性原则,使结果具有可理解性。与此同时,随着机器自我学习能力的提升,我们必须警惕机器教师、机器学生对人类教育主体带来的公平损益。这些现象在其他行业领域已经出现。2022年11月,美国加州联邦法院一项针对人工智能编程辅助工具GitHub Copilot提起的新诉讼(DeGeurin, 2022),挑战了支撑过去30年来一些最重要人工智能进步的基本原则。Copilot是微软公司开发的一种托管数亿个软件项目代码的智能编程助手,可以在程序员工作时自动编写工作代码,提升编程人员的工作效率,但它偶尔会从公共代码存储库的数百万行中复制可识别的代码片段且不提供署名,这不仅可能构成侵犯版权问题,也违反了微软公司自身的服务条款和隐私法。这一案件的有趣点在于:人类程序员也在工作中研究、学习和复制彼此的代码,但他们并不认为人工智能做同样的事是公平的。更甚至于在视觉艺术创作领域,从人类先前作品中训练出来的“人工智能助手”,可以产生优胜于人类自身学习的作品,但这些作品能否和人类作品一起参与竞赛还备受争论。可以预见,在不久的将来,我们必将面对从人工智能机器(也称智能体)这一维度带来的公平与效率的抉择问题。

第三原则:教育界的人工智能开发与应用必须明确其功能仅仅是教育与学习的工具。随着人工智能的发展和人与智能机器的结合,智能机器必将成为教育主体和教育对象的一部分。如何区分智能机器的教育者和学习者与人的教育者和学习者,就成为必须面对的话题。因此,从技术为人类服务的原则出发,人工智能是为人类知识创新提供方法和途径的工具,不可超越人的主体地位。2024年7月,欧盟(European Union, 2024)推出了《人工智能法》,这为欧盟所有行业的人工智能监管和负责任发展奠定了基础,其中规定在教育领域不允许进行情绪判断,这或许可以为我们提供些许借鉴。

第四原则:教育界的人工智能开发与应用必须为人类的灵魂留有栖息之地。教育具有保守性,需要延续和传递多样性的文化与文明。我们必须承认,人对科技发展具有不同的适应性,在科技发展中,个体与科技之间的冲突必然存在,这种冲突的调适需要一定的发展过程。因此,教育技术的开发与应用必须为人类的精神提供人文庇护,给个体提供无差异的选择空间。无差异的选择空间是这样一个空间,在这个空间内,技术与教育的融合程度或者方式是不同的,但受教育的个体从中得到的效用程度却是相同的。以目前存在的多种教育空间为例,在元宇宙技术发展下,诸事物的呈现方式和感知有了多种途径。在呈现方面,物理的/物质的实体存在,既可实体呈现,也可虚拟化、增强化呈现;表征的/想象的意识存在,既可由个体想象,也可通过虚拟空间的模拟和创造进行呈现;甚至人类独有的移情之能力,也可以通过信息/信号的模拟进行物理传输。在感知方面,通过肉身化意识感知世界(埃德蒙德·胡塞尔, 2018, p.20)和通过技术化模拟感知世界的方式并存。因此,算法时代教育活动的空间改变必须基于不同教育主体的需求,在时间维度的约束下进行灵活的组合,创建以人为中心的、保护个体差异的无差别教育空间。

第五原则:教育界的人工智能产品在自己设计新算法的过程中,必须遵循以上原则。这一原则是人工智能产品学习过程中的内置原则,即所谓的机器人繁殖原则:在机器制造机器的过程中,首先需要遵循这一原则,将这五条原则内置于任何一个新智能技术产品中。

需要说明的是,如果我们对这五条原则中对应的概念形成共识,并进行数据标记,那么这五条原则在理论和程序上是可以设计与实现的,可以生成固定的最基础的代码,嵌入每一个在教育领域使用的人工智能产品中,以保证未来生产的每一个人工智能机器对教育系统是有益的。

(二)基于正义论的教育理型建立算法的设计与使用准则

“善”是柏拉图理念世界的顶点(黑格尔, 2013, p.165)。正义是在人类社会中实现善的一种方式。正义促使个体和社会达到一种内在的和谐和完美状态,与善相契合。教育作为塑造灵魂的过程,以培养智慧与美德为目标,是实现正义的重要手段之一。因此,正义可视为教育的理型。从正义论视角探讨算法技术的设计与使用准则,有助于将技术实践与追求社会善相结合。

算法时代的到来,为教育与人的发展创造了无限的机遇,需要倡导建立新的教育发展观。目前学者(曹培杰, 2018)认为从“工业化教育”向“智能型教育”转变可能有三重境界:赋能教育,最大限度地提升“标准化教育”的运行效率;创新教育,促进“标准化教育”向“个性化教育”转型;重塑教育,推动教育从“去标准化”阶段迈向“去制度化”阶段。在将技术引进教育的过程中,不能回避潜在的伦理和价值风险,必须回答人的禁锢和自由、人的真实和虚拟、人的同质化和个性化、学校的存在和灭亡、社会竞争的加剧和减缓、教育布局的公平和效率、教育的价值和意义七对命题。这七对命题都与正义有着密切的关系:个体的自由、公平的对待、平等的机会、竞争的公平、资源分配的公平和人类享有价值与意义的权利。

回答这七对命题的关键就在于如何用数据喂养机器,如何利用与评价算法技术的使用。技术革命深刻改变着社会发展,评价技术的发展之善在于其是否满足并有利于人类社会基石的发展。在正义论中,罗尔斯(Rawls, J. B.)把正义观的规定视为社会发展的基石,认为正义是社会体制的第一美德,并提出了如何评判正义的基本原则。因此,从这一视角出发,探讨人工智能的使用准则或许可以带来技术“善”的使用。在算法时代,数据成为社会的主要生产资料,加工数据的能力成为获取权力的新途径。智能可穿戴设备、高端生命医药工程等技术福利该如何在社会上进行分配,也将成为重要的政治命题。“大数据算法很可能导致数字独裁,也就是所有权力都集中在一小群精英手中,而大多数人只不过是被剥削,还面临更糟糕的局面:如草芥般无足轻重。”(尤瓦尔·赫拉利, 2018, p.77)因此,在科技日益更新的情境下,教育需要重申人文关怀理念,重申社会正义之平等原则。在教育领域应用的任何技术,都必须考虑公平原则,制定基于正义论的算法的设计与使用准则,以防产生马太效应。

第一原则是个体接受教育的平等自由原则。算法时代的教育发展应该确保每一个教育主体享有尽可能多的教育自由,这一自由的唯一约束条件是任何成员的教育自由不得侵犯其他成员的教育自由。与功利主义的道德理论不同,罗尔斯的正义论建立在充分尊重每一个个体的自由之上,这与我们的教育价值追求具有内在的一致性。大数据、云计算乃至算法时代的众多智能技术在教育领域中的应用,都必须建立在充分尊重每一个个体的自由之上。教育领域中的平等自由权利大致有基本人权与自由的发展权利、平等接受教育的权利(义务教育、终身教育)、教育过程中平等对待的权利。在秩序良好的教育制度里,这些权利都是平等的。在算法时代,由于教育活动形态的改变,这些权利必然会受到技术显性或隐性的影响,从而造成技术对个体权力的损益。因此,对任何一种技术的引进,我们可以基于博弈论在虚拟的教育活动状态下进行模拟演化,以尽可能掌握这一技术对个体现有教育权利的影响变化,从而为技术的采用提供依据。这一方法可以借助《自私的基因》(理查德·道金斯, 2012, pp.229-258)一书中作者所介绍的对“好人有好报”这一结论的验证方法①:将个体现有的自由权进行赋值;引进一种技术,依据这项技术对不同个体的自由权影响程度进行赋值;设置博弈模型;输入计算机进行博弈演化,从而分析结果。

第二原则是资源分配的机会均等原则。未来,在教育领域中,资源的分配将通过国家、市场和算法分配的相互作用来实现,其分配原则需要更加强调公平、客观、机会平等、消除贫困和享受自由。解决分配正义是罗尔斯对社会和经济不平等开出的方剂,这一方剂的本质是在不损害任何个体现有利益的基础上实现总体利益最大化,在分配资源的过程中强调个体的机会平等(随机分配)。在算法时代,算法不公正的争论焦点是社会正义的灵魂,即分配和承认。当前分配正义的实现机制是通过市场和国家的相互作用来实现,但随着全样本数据的积累、算力与算法的提升,算法分配将与市场和国家一起决定我们获得重要社会物品的途径,成为一种新的、重要的分配正义机制(杰米·萨斯坎德, 2022, pp.217-223)。在适当的要求下,算法可以克服人类决策的模糊性,产生新的透明形式,从而有机会发现在其他情况下无法发现的规则歧视。在正确的保障措施下,算法可以成为促进公平的潜在积极力量(Kleinberg et al., 2018)。已有国外学者(Barsotti amp; Koçer, 2024)结合罗尔斯观点的实质元素与直观解释,建构了从定性到定量的模型,提出了从罗尔斯原则派生出的克服当前算法偏差的最大最小公平解决方案。可见,让算法参与分配并不是一件坏事,其核心在于如何精心地设计算法,以消除教育决策者的私心和偏见,且不增加弱势群体对权力获得的困难。如果想要通过算法分配实现正义的分配与承认,就必须在算法设计的最初就警惕算法基于数据的不公正、基于显性/隐性规则的不公正,将基于共识的正义的规则植入初始代码中。

(三)基于人的自由全面发展目的制定人工智能共享准则

目的是人类发明和创造技术的动力。教育系统对技术的积极引入,是为了实现教育系统自身的目的。在我国,人的全面发展是马克思主义的基本原理之一,也是我国教育方针的理论基石,是我国教育系统的应然目的。目前,从马克思主义的视角出发,学者普遍认为人工智能拓展了人的发展向度,为人类解放和走向“自由人的联合体”提供了可能性(吴海江 amp; 武亚运, 2019),技术与教育的融合将统一于人的全面自由的发展。因此,可以从这个目的出发,制定人工智能的共享准则。

第一原则是坚持教育界人工智能的公有制,这是人工智能发展逻辑服从人的自由全面发展逻辑的根本保障。马克思认为技术的本质就是人的本质力量对象化的产物,是人类征服和改造自然的劳动手段,是一种生产力。技术在整个人类社会发展与历史进步中充当着“革命力量”,发挥着“历史的有力的杠杆”作用。技术导致的一切不道德的技术异化现象都源自技术的资本主义应用,其根源是生产资料的私有制(乔瑞金, 2006)。如果使技术不再成为资本增值的手段,使全社会的人成为全部生产资料的主人,使技术的逻辑服从于人的自由与发展的逻辑,就可以达到人和自然界之间、人和人之间的矛盾的真正解决。从这一技术哲学观念出发,未来人工智能的发展将向着造就全社会高度发达的生产力、为人的自由全面发展提供发展空间、推动资本主义世界历史向共产主义世界历史转变的方向迈进(刘旭雯, 2019)。教育作为准公共物品,需要建立对人工智能技术的公有制式开发,使技术脱离资本的驱动,确保人工智能技术发展有利于人类每个个体的发展。

第二原则是坚持教育界人工智能的民主式开发,这是教育促进人自由而全面发展的根本前提。人工智能的发展引发人类对社会的多重想象与警惕。在人工智能带来新的经济范式下,劳动主体、劳动内涵、劳动分工、劳动生产率、劳动的社会功能都将发生深刻变化,并通过生产系统载体变革,催生促进人的全面发展的劳动机遇。这种变化为技术革命中过剩人口向“完整的人”过渡提供了条件,服务于人的全面发展的新兴行业将逐渐兴起,劳动由生存手段向发展手段转变越来越明显,教育与生产深度融合将是新的生产力条件下“劳动方式—人的发展”这一哲学纽带的新模式(张新春 amp; 董长瑞, 2019)。与此同时,技术变革的指数级加速使社会生产关系深受考验,新技术的广泛应用虽在短期内能对生产力的发展达到可视化的预期效果,但从长期来看,新时代社会矛盾、技术异化、职业转换、社会关系异化等都在挑战“个人全面发展”的实践逻辑(张学敏 amp; 周杰, 2020)。我们必须注意到在教育领域中人的主观范畴,人的全面发展是否能够实现,取决于全社会不同主体的观念之间的动态博弈过程。需要明确的是,个体自由是全面发展的基石,没有个体的自由,就不会有人与社会的全面发展。基于此,我们需要重申批判哲学的一个观点:我们可以将技术提交给更民主的设计和开发过程来驯服它。在积极推进智能化的过程中,充分利用大数据和人工智能给人类带来的自由、自主、自治,开放程序的快捷、便利、共享和共赢。将人从自然的束缚、制度的束缚、社会的束缚、人自身的束缚当中解放出来,促进人自由而全面的发展。

四、结语:教育对技术的规制、引领与超越

自2012年以来,随着算法技术的层出不穷,人工智能的应用开始全面覆盖日常生活、科学研究、社会治理、商业创新和国家安全等经济社会的关键领域,在医疗、金融、安防、交通、物流、教育等多个方面,以空前的广度和深度推动社会发展。人工智能的成功彰显了算法的重要性和算法的威力,并将在未来继续产生越来越大的影响,塑造人们的工作和生活。我们已经将世界建构在了机器学习和算法之上,现在能做的就是如何更好地理解和管理算法技术,以开放包容的姿态迎接新技术对教育领域带来的机遇和挑战。

一是需要我们教育工作者积极学习、研究新的技术,在教育实践活动中开展教育实证研究,从上述人工智能开发的伦理准则、算法的设计与使用准则、人的全面发展准则出发,评价所用技术对教育工作带来的影响,汇集众多的教育实践经验与数据,通过民主方式共同在此基础上构建教育领域中的制度遵循原则。

二是需要教育领域更加承担起“哲学工程师”的培养重担。创造算法时代的责任永远应该落在人类的肩上。在这个时代里,代码是机会的引擎,而非不公正的引擎。我们有责任不遗余力地“教导”机器区分正义与非正义。监控和防止算法不公的工作不能留给单一的某个群体。但不得不承认,软件工程师将越来越多地成为数字生活世界的社会工程师,他们的个体偏见将会有意或无意地影响算法的公正与否。因此,教育必须承担起培养符合社会发展正义观的“哲学工程师”的责任。

三是需要教育更加承担起控制或规范技术在社会中应用的时代责任。技术决定论者和实体论者都认为技术具有其内在的发展规律,技术可以按照效率和进步的要求来塑造社会,一旦人类社会走向技术发展的道路,社会就有可能发展成为一个效率和权力的社会。正是基于这样的担忧,我们更需要时刻清楚人类、教育和机器的边界关系,设计更加合适的制度来控制技术。我们可以将技术提交给更民主的设计和开发过程来驯服它。我们应该致力于改善民主,从而能够彻底实现人类对技术的控制。

参考文献

W.理查德·斯科特, amp; 杰拉尔德·F·戴维斯. (2011). 组织理论:理性、自然与开放系统的视角(高俊山 译). 中国人民大学出版社.

埃德蒙德·胡塞尔. (2018). 《共主观性的现象学》(第一卷)(1905-1920)(倪梁康 主编). 商务印书馆.

柏拉图. (2005). 蒂迈欧篇(谢文郁 译). 上海人民出版社.

曹培杰. (2018). 智慧教育:人工智能时代的教育变革. 教育研究(8), 121-128.

陈小平. (2019). 人工智能伦理体系:基础架构与关键问题. 智能系统学报(4), 605-610.

陈至立. (2022). 辞海(第七版)(缩印本). 上海辞书出版社.

邓国民, amp; 李梅.(2020). 教育人工智能伦理问题与伦理原则探讨. 电化教育研究(6), 39-45.

杜静, 黄荣怀, 李政璇, 周伟, amp; 田阳. (2019). 智能教育时代下人工智能伦理的内涵与建构原则. 电化教育研究(7), 21-29.

方正. (2021). “数字规训”与“精神突围”:算法时代的主体遮蔽与价值守卫. 云南社会科学(1), 150-157.

谷衍奎. (2023). 汉字源流大字典. 商务印书馆.

黑格尔. (2013). 《哲学史讲演录》(第二卷)(贺麟, amp; 王太庆 译). 上海人民出版社.

胡小勇, 黄婕, 林梓柔, amp; 黄漫婷. (2022). 教育人工智能伦理:内涵框架、认知现状与风险规避. 现代远程教育研究(2), 21-28, 36.

杰米·萨斯坎德. (2022). 算法的力量:人类如何共同生存(李大白 译). 北京日报出版社.

理查德·道金斯. (2012). 自私的基因(卢允中, 张岱云, 陈复加, amp; 罗小舟 译). 中信出版社.

林松柏. (2023). 基于能力范式的教学改革理论创新和实践. 科学出版社.

刘复兴. (2019). 论教育与机器的关系. 教育研究(11), 28-38.

刘旭雯. (2019). 人工智能视域下的分工与人的全面发展——对马克思分工理论的思考. 社会主义研究(4), 25-31.

钱斌. (2024). 推动金融领域人工智能向善的思考. 新金融(8), 8-11.

乔瑞金. (2006). 马克思技术哲学思想精要. 哲学堂(0), 1-19.

撒穆尔·伊诺克·斯通普夫, amp; 詹姆斯·菲泽. (2005). 西方哲学史(第九版)(邓晓芒, amp; 匡宏 等 译). 北京联合出版公司.

唐汉卫. (2018). 人工智能时代教育将如何存在. 教育研究(11), 18-24.

王佑镁, 房斯萌, amp; 柳晨晨. (2024). 风险社会视角下教育人工智能伦理风险分类框架研究. 现代远距离教育(3), 28-37.

王佑镁, 王旦, 梁炜怡, amp; 柳晨晨. (2023). 敏捷治理:教育人工智能伦理治理新模式. 电化教育研究(7), 21-28.

吴国盛. (2022). 技术哲学经典文本. 清华大学出版社.

吴海江, amp; 武亚运.(2019). 人工智能与人的发展——基于马克思人学理论的考察. 学术界(3), 75-81, 237.

谢娟. (2023). 人工智能与教育融合创新之伦理内涵及实现路径. 中国远程教育(2), 1-8.

杨九诠. (2024). 想象的困境:生成式人工智能世代的价值教育. 中国远程教育(2), 12-23.

尤瓦尔·赫拉利. (2018). 今日简史:人类命运大议题(林俊宏 译). 中信出版社.

张新春, amp; 董长瑞. (2019). 人工智能技术条件下“人的全面发展”向何处去——兼论新技术下劳动的一般特征. 经济学家(1), 43-52.

张学敏, amp; 周杰. (2020). 技术变革下“个人全面发展”的教育选择——新时代马克思核心教育思想再认识. 清华大学教育研究(6), 7-17.

张优良, amp; 尚俊杰. (2019). 人工智能时代的教师角色再造. 清华大学教育研究(4), 39-45.

赵磊磊, 张黎, amp; 代蕊华. (2021). 教育人工智能伦理:基本向度与风险消解. 现代远距离教育(5), 73-80.

字词语辞书编研组(编). (2016). 新编现代汉语词典. 湖南教育出版社.

周东. (2024). 人工智能时代教师的身份镜像:困境与建构. 中国远程教育(4), 81-93.

Asimov, I. (2004). I, robot(Vol. 1). Spectra.

Barsotti, F., amp; Koçer, R. G. (2024). MinMax fairness: From Rawlsian Theory of Justice to solution for algorithmic bias. AI and Society, 39(3), 961-974.

DeGeurin, M. (2022, November 23). ‘A Brave New World of Software Piracy’: Lawsuit takes aim at scrapping methods underpinning modern artificial intelligence. GIZMODO. https://gizmodo.com/ai-microsoft-dall-e-

1849816871

European Union. (2024, July 12). Artificial Intelligence Act. Official Journal of the European Union. https://eur-lex.europa.eu/legal-content/EN/TXT/PDF/?uri=OJ:L_202401689

Firth, J., Torous, J., Stubbs, B., Firth, J. A., Steiner, G. Z., Smith, L., Alvarez-Jimenez, M., Gleeson, J., Vancampfort, D., Armitage, C. J., amp; Sarris, J. (2020). The “online brain”: How the Internet may be changing our cognition. Bulgarian Journal of Psychiatry, 5(2), 58-61.

Kleinberg, J., Ludwig, J., Mullainathan, S., amp; Sunstein, C. R. (2018). Discrimination in the age of algorithms. Journal of Legal Analysis(10), 1-62.

Leonardi, P. M. (2021). COVID‐19 and the new technologies of organizing: Digital exhaust, digital footprints, and artificial intelligence in the wake of remote work. Journal of Management Studies, 58(1), 247-251.

Nicolelis, M. A. L. (2017). Are we at risk of becoming biological digital machines? Nature Human Behaviour, 1(8), 1-2.

Sparrow, B., Liu, J., amp; Wegner, D. M. (2011). Google effects on memory: Cognitive consequences of having information at our fingertips. Science, 333(6043), 776-778.

Institutional Guidelines for Integrating Artificial Intelligence into Educational Activities: Framework Analysis based on “Receptacle-Forms-Telos”

Hui Wenjie and Xuan Xiaohong

Abstract: The deep integration of artificial intelligence in the field of education not only brings about the first-order effects of direct changes in organizational behavior, but also brings the second-order effects of the accumulation and use of data resources in the field of education and data shaping of the subject of educational activities. The impact of the second-order effects can be very profound. Therefore, in order to ensure the integration of artificial intelligence into educational activities and maximize the development of education, the relationship between machine and human in educational activities should be thought about from the perspective of “Receptacle-Forms-Telos”. This entails establishing ethical guidelines for the development of artificial intelligence as an educational “Receptacle” based on the Three Laws of Robotics, formulating design and usage norms for algorithms grounded in the theory of justice as the educational “Form”, and devising shared principles for artificial intelligence based on the educational “Telos” of holistic human development. These efforts aim to regulate, guide, and transcend technology through the lens of education.

Keywords: artificial intelligence; institutional guidelines; Three Laws of Robotics; algorithm allocation; holistic human development

Authors: Hui Wenjie, lecturer and postdoctoral fellow at the School of Education, Renmin University of China (Beijing 100872); Xuan Xiaohong, senior editor at the Information Center for Social Science, RCC (Corresponding Author: 2733883261@qq.com Beijing 100872)

责任编辑 刘 莉