融合注意力机制的GAN病虫害图像超分辨率重建

2024-10-09费加杰杨毅曾晏林蔺瑶贺壹婷黎强张圣笛

摘要:收集咖啡和柑橘病虫害样本图片,利用TensorFlow深度学习框架,在原始SRGAN(Super-resolution generative adversarial networks)的超分辨率重建网络里加入了注意力模块,对重建图像视觉质量和峰值信噪比(PSNR)、结构化相似性(SSIM)指标进行分析。结果表明,设计的模型和原始SRGAN模型对比之后峰值信噪比提高了2.23,结构相似性提高了7%。在细节纹理方面可以获得更好的视觉效果,重建后的图像识别准确率提高了约4.42个百分点。因此,设计的模型可以对小样本性质的植物病虫害样本进行扩充。

关键词:超分辨率重建;注意力机制;病虫害;峰值信噪比(PSNR);结构化相似性(SSIM)

中图分类号:TP391.41;S432 文献标识码:A

文章编号:0439-8114(2024)09-0204-06

DOI:10.14088/j.cnki.issn0439-8114.2024.09.034 开放科学(资源服务)标识码(OSID):

Super-resolution reconstruction of GAN pest and disease images fused with attention mechanisms

FEI Jia-jie,YANG Yi, ZENG Yan-lin,LIN Yao,HE Yi-ting, LI Qiang,ZHANG Sheng-di

(School of Big Data,Yunnan Agricultural University, Kunming 650500,China)

Abstract: The sample pictures of coffee and citrus pests and diseases were collected, and an attention module was added to the super-resolution reconstruction network of the original SRGAN by using TensorFlow deep learning framework. The visual quality, peak signal-to-noise ratio and structured similarity index of the reconstructed image were analyzed. The results showed that the peak signal-to-noise ratio of the designed model was improved by 2.23, and the structural similarity was enhanced by 7%, after comparing with the original SRGAN mode. Better visuals could be obtained in terms of detail texture, and the accuracy of the reconstructed image classification was improved by about 4.42 percentage points. Therefore, the model designed could be used for the expansion of samples of plant pests and diseases with small sample properties.

Key words: super-resolution reconstruction; attention mechanism; pests and diseases; peak signal-to-noise ratio (PSNR); structural similarity(SSIM)

图像超分辨率重建(Images super-resolution reconstruction,ISRR)是指将低分辨率模糊图像优化为具有丰富细节的高分辨率图像的过程[1]。现如今,深度学习的算法在图像超分辨率领域的研究越来越多,相对于传统超分辨算法在性能上有了较大的提升。本研究的目的是为了通过建立融合注意力机制的SRGAN病虫害图像超分辨率重建模型,实现病虫害样本扩充,使之产生大量可供深度学习模型训练使用的农作物样本数据。在病虫害图像小样本扩充上面,有明显的效果和应用价值。

图像的超分辨率研究在很多年前就已经开始,2015年Dong等[2]提出SRCNN(Super-resolution convolutional neural network),SRCNN训练了全卷积神经网络,并提升了图像超分辨率的重建指标。2016年,Dong等[3]又提出了FSRCNN(Fast super-resolution convolutional neural network)模型,该模型加入了反卷积层,将重建效果进一步提升。Shi等[4]通过在网络末端添加输出特征图的通道从而把图像进行放大。Kim等[5]在重建图像中将卷积核缩小,能够有效地提升图像重建的效果。同年,Kim等[6]提出了新的网络模型DRCN(Deeply-recursive convolutional network),减少神经网络的参数量。2014年,Goodfellow等[7]首次提出生成对抗网络(Generative adversarial networks,GAN),通过对抗训练来评估生成模型。2017年Ledig等[8]提出了SRGAN能将一个低分辨率模糊图像优化为具有丰富细节的高分辨率图像。但是,这些算法的参数量会比较大,需要大量的资源来计算和提取网络特征,并且难以达到理想的效果。其次,进行超分辨率恢复后的图像无法保留图像的某些底层信息,比如图像太平滑,不包含详细的纹理信息,图像不够逼真等。

因此本研究旨在开发一种融合注意力机制的生成对抗网络超分辨率重建算法。近年来,越来越多的人将注意力机制[9]用到图像超分辨率领域,Zhang等[10]在超分辨率重建模型中加入深度残差通道注意力网络RCAN。2018年,Liu等[11]提出了将注意力生成网络作为特征选择器来恢复图像的高频细节、增强高频特征和抑制平滑区域中的噪声。本研究在SRGAN的基础上,引入了注意力机制,实现了图像质量更高的超分辨率结果,同时也实现了病虫害小样本的生成。本研究探索出一种适用于病虫害小样本生成的图像的方法,为病虫害小样本扩充的研究提供一些新思路。

1 相关技术介绍

1.1 生成对抗网络训练

生成对抗网络由两部分组成,一是生成网络,它的作用就是经过训练之后生成与数据集中的真实数据相似的数据,二是判别网络,判别网络是为了判别真实数据和生成数据的差异性[12]。在经过多轮的训练之后,样本已达到了纳什平衡,判别网络已经无法精确判断出样本是真是假,即判别器会输出50%的正确率和50%的错误率。生成对抗网络结构如图1所示。图中G表示生成器,D表示判别器。生成对抗网络的训练过程是首先需要固定G,然后再训练D。固定G即仅用到G的前馈过程得到输出,而不进行其反向传播过程,然后需要固定D去训练G。将随机噪声z输入G,得到伪造数据G(z)。再将G(z)作为输入送进D,得到D给出的概率数值D(G(z))。

在这一过程中,判别概率和真实标签之间会产生误差,为了减小误差,生成对抗网络中通常会采用交叉熵代价函数作为损失函数,如式(1)。

[C=-1nn[y ln a+(1-y)ln (1-a)]] (1)

式中,C为输入数据;n表示所有数据的数量;y表示C的期望输出;[a]表示数据的实际输出。当期望输出y与实际输出[a]越接近,代价函数越接近0。

在生成对抗网络中,整体的价值函数V(D,G)定义如式(2)。

[minDmaxGV(D,G)=Ex~Pdata(x)[log D(x)]+Bz-pz(z)log (1-D(G(z)))] (2)

同样的,该函数中的G、D分别代表生成器和判别器。[Pdata(x)]表示x的数据分布,E(·)表示需要计算的期望,[z-pz(z)]是输入的噪声分布,这里采用标准正态分布[pz(z)=n(0,1)]。可以看出,函数V(D,G)与神经网络中的交叉嫡代价函数C形式上是一样的。

1.2 样本扩充

1.2.1 传统样本扩充 卷积神经网络在图像识别领域有着优异的表现,但要有大规模数据集支撑的测试才能得到相对较好的训练结果。虽然现在可公开使用的数据集越来越多,但针对某些领域,仍然无法在有限的时间和成本内获取足够的带标签训练样本。小样本数据集规模无法支持深层次的网络模型进行训练。传统图像识别领域和深度学习都存在着样本不均衡、样本多样性不足、样本质量差等问题。尤其是在深度学习领域,样本匮乏和数据不均衡导致无法得到最佳的识别效果。基于这种现状,样本扩充的提出便提供了一种解决思路,传统的样本扩充方法有物理扩充方法[13]、变分自编码器扩充方法[14]、bootstrap扩充方法[15]、网络爬虫[16]等。

1.2.2 生成对抗94f09c6322f9587e5c94adffafeb99b0网络扩充 与传统学习方法不同,生成对抗是一种生成学习的算法[17],它在数据生成能力方面具有很大优势,使其在数据生成中得到广泛的研究和应用。在深度学习中,小样本问题制约了其自身的发展,扩充小样本数据能够提高分类准确率。

在生成对抗网络训练时,向生成器里输入噪声图像,通过训练噪声图像后生成网络生成一个图像。理论上来说,在这种连续不断的对抗训练过程中,这些生成的图像,可以无限接近于真实图像的数据分布,这些真实的图像数据可以达到扩充数据集的目的。

1.3 注意力机制

早在1980年,Treisman等[18]就提出了一种模拟人脑注意力的机制,经过多年的发展和演化变成了现在深度学习领域注意力机制。注意力机制的优点是可以直接建立输入与输出之间的关系,增加并行化的能力,增强计算机或模型的运算能力。注意力机制还克服了比如计算效率低下、系统性能与输入长度负相关、输入顺序不合理以及系统不能精确提取特征等一些传统神经网络中的局限。

本研究采用的注意力模块CBAM(Convolutional block attention module)是2018年Woo等[19]提出来的,它巧妙地将通道注意力和空间注意力结合了起来。CBAM是一种轻量型注意力模块,它沿着空间维度和通道维度来推断注意力图,将注意力图与输入特征图相乘以便于优化特征。CBAM模块示意图如图2所示。

2 基于SRGAN的病虫害图像超分辨率重建

2.1 数据集

由于目前的病虫害样本数据集较少,对于生成对抗网络模型有局限性,针对自然场景下单幅图像的超分辨率重建问题,为客观全面地评估模型重建的能力,本研究使用了DIV2K和Set14两种公开数据集,其中DIV2K作为训练集,Set14作为测试集。在经过使用公开数据集将模型训练得足够稳定后,再使用数码相机从云南长木咖啡种植基地和云南省褚氏农业种植基地拍照得到咖啡多种病害和柑橘多种病害样本,并从数据集中按照设定好的比例取出一部分作为测试集,不再做任何改变,其他的作为训练集。图3是数据集中部分图像。

2.2 图像超分辨率生成对抗网络模型

SRGAN为了提高超分辨率图像的真实感和视觉感受将自然图像放大了4倍,并且在损失函数部分结合了感知损失和对抗损失。SRGAN生成的图像自然逼真,细节丰富,视觉质量好。

2.2.1 生成网络 生成器中由多个残差块组成,每个残差块由两个卷积层、两个批归一化层,激活函数ReLU和最后的注意力模块组成。在卷积核获取输入图像时,可以利用注意力模块提取全局特征信息,同时利用超分辨率图像特征提取和修改的能力,可以获得多种不同尺寸的图像特征信息,改进的SRGAN生成网络的整体结构如图4所示。

2.2.2 判别网络 判别器由多个卷积层组合而成,使用多个卷积层是为了添加网络层数从而将提取更多的特征个数。判别器使用LeakyReLU作为网络的激活函数,同时使用全连接预测该图像为SR图像还是真实HR图像,输出层使用sigmoid激活函数来计算概率。SRGAN判别网络结构如图5所示。

2.3 损失函数

SRGAN 采用的是对抗损失[lSRG]和内容损失[lSRVGG];其中内容损失和对抗损失的加权和为式(3)。

[lSR=lSRVGG+10-3lSRG] (3)

内容损失:本研究使用了19层VGG网络的ReLU激活函数来计算VGG loss, 它是生成网络生成的图像和真实的高分辨率图像传到VGG19网络中的一部分提取特征,再根据提取出来的特征计算均方根误差。内容损失的损失函数如式(4)所示,式中的i和j分别指第i层最大池化前的第j个卷积层。[lSRVGG]?是一个指标,表示 VGG 模型在超分辨率重建任务上的性能。[1Wi,jHi,j]表示对整个图像进行平均,??[x=1Wy=1H(?)]分别是对图像宽度和高度方向上像素点的求和操作,[(?(IHR)x,y-?(GθG(ILR))x,y)2]是计算每个像素点之间的差异。

[lSRVGG=1Wi,jHi,jx=1Wy=1H(?(IHR)x,y-?(GθG(ILR))x,y)2] (4)

对抗损失:对抗损失采用的是生成对抗网络的常用对抗损失函数,采用该对抗损失函数是为了让判别器判别错误。对抗损失如式(5)所示。[lSRG]?是一个指标,表示生成器G 在超分辨率重建任务上的损失。[n=1N(?)]分别是对N个样本进行求和操作,(-l[ogDθD] [(GθG(ILR))])是计算生成器G的输出与判别器D 输出之间的关系。因此,对于每一个输入的低分辨率图像[ILR],生成器G 需要生成对应的超分辨率图像[GθG(ILR)]。然后,将这个生成的超分辨率图像作为输入传递给判别器D,判断其是否为真实的高分辨率图像。最后,计算判别器D的输出概率值,并将其取负数并取对数,得到最终的损失值。通过最小化这个损失函数,可以优化生成器G的参数,使得它能够更好地生成高质量的超分辨率图像。

[lSRG=n=1N(-log DθD(GθG(ILR)))] (5)

3 结果与分析

由于人类的视觉观察无法客观地对试验结果进行分析,所以本研究从两个方面对试验结果进行客观分析,一是图像重建的视觉质量分析,二是图像质量评价指标分析。

3.1 重建图像视觉质量分析

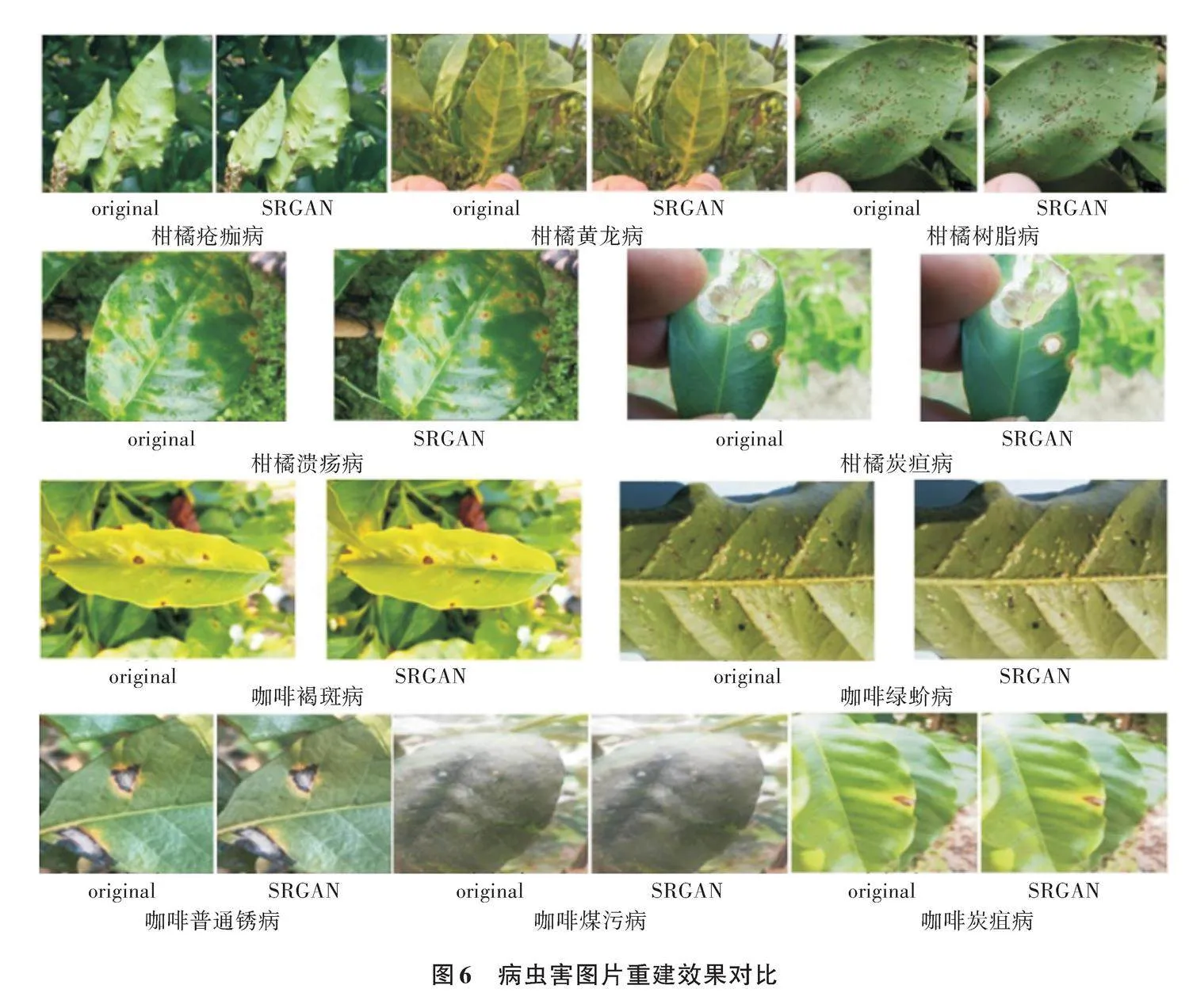

经过与训练后得出的超分辨率图像进行对比,可以看出重建以后的图像细节更加完整,边缘轮廓尖锐、清晰,图像的视觉效果也较好。从整体重建效果来看,如图6所示,SRGAN恢复了一些病虫害叶片的轮廓,使得病虫害图片的分辨率变得更高,一些图像的纹路和清晰度也有所提升,整体在视觉效果上保真度更高。

3.2 图像质量评价指标分析

普通人通过人眼主观评价标准并不准确,因此本研究使用全参考的图像质量评价指标PSNR和SSIM[20]对图像超分辨率重建结果进行客观评价。其中PSNR只关心像素之间的差异,在真实场景中具有较好的效果,应用也最为广泛。SSIM分别对图像的亮度、对比度进行比较,更加符合视觉感知,SSIM的取值范围为[0,1],且取值越大越好。表1和表2是选取Set14数据集中的baboon、monarch和pepper数据与植物病虫害数据集重建结果展现的两个客观评价指标。

3.3 扩充样本分类识别分析

本研究设计的模型对样本数较少的病虫害数据集进行扩充,以期达到理想的效果并能应用于实际。为了进一步验证本研究的模型对病虫害样本进行扩充后是否能提高深度学习网络模型图像识别的准确率,进行试验及对比后结果如表3所示,整个病虫害样本的识别准确率都有了明显的提升,准确率最高的可达97.28%,最低也达88.48%。相比较原始SRGAN,本研究模型的识别准确率平均提升了4.42个百分点。

4 小结

本研究在原始的SRGAN上融入了CBAM注意力机制模块,注意力模块通过增强高频细节特征以及高频细节的位置,从而将重建的效果进一步提升。在生成器网络中,使用了残差密集块基本结构单元。试验结果表明,从视觉效果来看,植物病虫害图像重建后能够获得更多自然和逼真的纹理。本研究设计的模型确实具有较好的超分辨率重建效果,根据PSNR和SSIM结果来看,峰值信噪比平均提高了2.23,结构相似性平均提高了7%。本研究的模型在咖啡和柑橘病虫害图像上重建的效果也较好,在扩充样本后的病虫害样本识别准确率最高的可达97.28%,最高的提高了5.6个百分点。

参考文献:

[1] 康士伟,孙水发,陈晓军,等.单帧图像超分辨率重建的深度神经网络综述[J].信息通信,2019(3):24-27.

[2] DONG C, LOY C C, HE K, et al. Image super-resolution using deep convolutional networks[J]. IEEE transactions on pattern analysis and machine intelligence, 2015, 38(2): 295-307.

[3] DONG C, LOY C C, TANG X O. Accelerating the super-resolution convolutional neural network[A]. European conference on computer vision[C]. Springer, Cham, 2016.391-407.

[4] SHI W, CABALLERO J, HUSZáR F, et al. Real-time single image and video super-resolution using an efficient sub-pixel convolutional neural network[A]. Proceedings of the IEEE conference on computer vision and pattern recognition[C]. 2016.1874-1883.

[5] KIM J, LEE J K, LEE K M. Accurate image super-resolution using very deep convolutional networks[A]. Proceedings of the IEEE conference on computer vision and pattern recognition[C]. 2016.1646-1654.

[6] KIM J,LEE J K,LEE K M. Deeply-recursive convolutional network for image super-resolution[A].Proceedings of the IEEE conference on computer vision and pattern recognition[C]. 2016.1637-1645.

[7] GOODFELLOW I J, POUGET-ABADIE J, MIRZA M, et al. Generative adversarial nets[A]. Proceedings of the 27th international conference on neural information processing systems[C]. 2014.2672-2680.

[8] LEDIG C, THEIS L, HUSZáR F, et al. Photo-realistic single image super-resolution using a generative adversarial network[A]. Proceedings of the IEEE conference on computer vision and pattern recognition[C]. 2017. 4681-4690.

[9] VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[A]. Proceedings of the 31st international conference on neural information processing systems[C], 2017.6000-6010.

[10] ZHANG Y L, LI K P, LI K, et al. Image super-resolution using very deep residual channel attention networks[A].Proceedings of the European conference on computer vision (ECCV)[C]. 2018.286-301.

[11] LIU Y, WANG Y C, LI N, et al. An attention-based approach for single image super resolution[A]. 2018 24Th international conference on pattern recognition (ICPR)[C]. IEEE, 2018. 2777-2784.

[12] 梁俊杰,韦舰晶,蒋正锋.生成对抗网络GAN综述[J].计算机科学与探索,2020,14(1):1-17.

[13] 秦铁鑫.基于数据扩充的小样本学习算法研究[D].南京:南京大学,2021.

[14] 王俊杰,焦 柯,彭子祥,等.基于变分自编码器潜变量语义提炼的样本生成方法[J].计算机系统应用,2022,31(3):255-261.

[15] 李会鹏,贺 国,明廷锋.Bootstrap方法在机电设备振动状态阈值设定中的应用[J].舰船科学技术,2012,34(5):70-73,77.

[16] 杨天乐,钱寅森,武 威,等.基于Python爬虫和特征匹配的水稻病害图像智能采集[J].河南农业科学,2020,49(12):159-163.

[17] 俞 彬.基于生成对抗网络的图像类别不平衡问题数据扩充方法[D].广州:华南理工大学,2018.

[18] TREISMAN A M, GELADE G. A feature-integration theory of attention[J]. Cognitive psychology, 1980, 12(1): 97-136.

[19] WOO S, PARK J, LEE J Y, et al. Cbam: Convolutional block attention module[A]. Proceedings of the European conference on computer vision (ECCV)[C]. 2018. 3-19.

[20] 佟雨兵,张其善,祁云平.基于PSNR与SSIM联合的图像质量评价模型[J].中国图象图形学报,2006(12):1758-1763.

收稿日期:2023-02-13

基金项目:云南省重大科技专项(A3032021043002)

作者简介:费加杰(1995-),男,贵州六盘水人,在读硕士研究生,研究方向为图形图像处理,(电话)18184899528(电子信箱)354099126@qq.com;通信作者,杨 毅(1966-),男,云南昆明人,硕士生导师,主要从事深度学习、植物病虫害防治、图形图像处理方面研究,(电话)13888222963(电子信箱)1617213828@qq.com。

费加杰,杨 毅,曾晏林,等. 融合注意力机制的GAN病虫害图像超分辨率重建[J]. 湖北农业科学,2024,63(9):204-209.