基于改进UNet的人像语义分割算法

2024-09-15赵子轩李超茹慧英马伯宁

摘要:针对传统卷积神经网络进行人像分割任务时由于图像的复杂性及目标区域的多样性,导致图像在边缘区域分割不完全和图像上下文特征信息利用不充分的问题,采用改进的UNet网络,该网络采用LeWin Transformer Block代替普通的卷积模块,该模块能将卷积神经网络的局部信息关联能力和Transformer的全局信息捕捉能力相结合。用于增强网络获取不同尺度特征的能力。同时在跳跃连接部分引入卷积注意力机制(CBAM),对编码器得到的各层次特征依据其重要性实现不同程度的加权,加强网络对图像细节特征的学习。

关键词:语义分割;UNet;Transformer;卷积注意力机制

中图分类号:TP3 文献标识码:A

文章编号:1009-3044(2024)24-0014-03

开放科学(资源服务)标识码(OSID)

0 引言

人像语义分割是将输入的人像图像分割成不同的语义区域的过程,是计算机视觉领域中的一项关键任务。人像分割可以用于人脸识别中,人像分割可以帮助提取出人脸区域,从而更准确地识别人脸,同时还可以用于自动驾驶和智能交通以及医学影像分析、图像编辑和后期处理等,整体来说人像分割技术不仅可以提升图像处理和计算机视觉应用的效果和性能,还可以推动多个领域的科技进步,为人类生活和产业发展带来更多便利性和可能性。

在人像语义分割领域,已经有许多前人做出了重要的研究成果。传统的方法主要依赖于手工设计的特征提取和基于图像分割技术的规则,这些方法往往需要大量的人工标注数据和复杂的特征工程,且在处理复杂场景和人像细节时表现不佳。随着人工智能技术的不断发展,卷积神经网络在图像分割中取得了很大成功。UNet[1]作为一种经典的语义分割网络同时也属于卷积神经网络,在许多领域取得了显著的成果。然而,传统的UNet网络在处理人像时存在着一些问题,如边缘模糊、细节损失等。刘祥[2]等人 将UNet中传统的CBR下采样模块替换为ResNet50,同时将CA注意力机制和hardswish激活函数引入UNet,以提高图像特征的提取能力,增强图像分割效果,徐旺旺[3]等人在UNet结构上采用了Swin架构来代替分割任务中的下采样和上采样过程,实现局部和全局特征的交互。利用Transformer来获取更多的全局信息和不同层次特征来取代短连接,实现多尺度特征融合,从而精准分割,顾天君[4]等人在特征提取模块中,将传统卷积变为深度可分离卷积,减少了网络特征提取模块的参数量以及计算量,并引入残差学习模块解决网络退化问题,提高计算效率与分割精度,然而在人像语义分割任务中,仍存在分割不完全等问题。

针对前人研究不足以及存在的问题,提出了一种改进的UNet网络模型,通过引入LeWin Transformer Block模块和在跳跃连接部分引入卷积注意力机制,提升模型在人像语义分割任务上的性能。

1 网络模型及改进

1.1 UNet网络模型

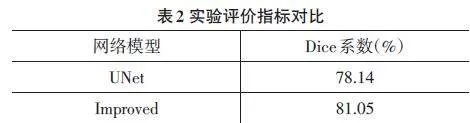

UNet网络采用编码器-解码器的结构,由两部分组成,如图1所示。编码器负责将输入图像逐渐降低分辨率,提取图像的高层语义特征;解码器则将低分辨率的特征逐渐上采样,并与编码器的特征进行融合,最终输出与输入图像相同分辨率的分割结果。编码器由多个卷积层和池化层组成,其中卷积层用于提取图像的特征,而池化层用于降低图像的分辨率。编码器使得网络能够机制,将编码器中的低级特征与解码器中的高级特征进行融合,更好地保留图像的细节信息。

跳跃连接在UNet网络中起到了关键作用。跳跃连接是将编码器中同一分辨率下的特征图与解码器中对应分辨率下的特征图进行拼接的操作。跳跃连接较好地捕捉到不同尺度的特征信息。解码器与编码器结构相反,采用逐步上采样的操作,通过反卷积层逐步恢复分辨率,同时借助跳跃连接和特征融合,这样可以使解码器更好地还原原始图像的细节,并提高分割结果的准确性。通过跳跃连接,网络可以跳过较低级的特征提取层,直接使用高级特征进行预测,从而提高网络的性能。

1.2 UNet算法改进

为了弥补传统卷积存在的不足,在UNet的基础上加以改进来实现人像分割,改进后的整体网络结构如图2所示。改进后的UNet网络保存了原有的U形网络结构,将网络编码器、解码器部分的传统卷积模块替换为Lewin Transformer模块[5],同时在跳跃连接操作中添加卷积注意力机制来对编码器得到的各层次特征依据其重要性实现不同程度的加权,加强网络模型对图像细节特征的学习。

具体实现流程为,输入图像先进行patch partition,每个patch大小为4×4,输入维度为H/4[×]W/4[×]48,经过linear embedding和两个Lewin Transformer block后特征图尺寸为H/4[×]W/4[×]C,然后通过patch merging进行下采样,再经过两个Lewin Transformer block后特征图尺寸变为H/8[×]W/8[×]2C,最后再进行一次同样的下采样操作完成编码器的操作。编码器每次按照2倍来缩小patch的数量,然后按照3倍来扩大特征维度的数量。然后是解码器部分,解码器主要由patch expanding来实现上采样,作为一个完全对称的网络结构,解码器也是每次扩大2倍进行上采样,核心模块由Lewin Transformer block和patch expanding组成。最后是跳跃连接。跳跃连接是UNet的特色,改进的模型在跳跃连接过程中添加卷积注意力机制,提高模型对细节特征的提取能力。

1.2.1 Lewin Transformer 模块

图像分割中使用transformer有两个问题。第一是经典的transformer模型可以计算所有token之间的全局自注意力,计算复杂度是token数量的二次方,所以在图像分割这种高分辨率的任务中会带来巨大的计算成本,不适合直接使用;第二是因为局部上下文信息在图像分割中也比较重要,然而先前的研究表明trnasformer在获取局部信息存在局限性。而locally-enhanced window (LeWin) Transformer block,结构如图3所示,既利用了自注意力机制捕获长程信息,也加入了卷积层捕获局部信息。对于输入特征图 ,通过W-MSA和LeFF两种结构对其进行处理,既降低了模型的计算复杂度,同时也可捕获更多的特征信息。

W-MSA: non-overlapping Window-based Multi-head Self-Attention ,窗口之间不重叠,如图4所示。

[ΩMSA=4hwC2+2(hw)2C]

[ΩW-MSA=4hwC2+2MhwC]

W-MSA不同于标准Transformer的全局自注意力,在非重叠局部窗口执行自注意力,这种方式可以有效降低计算量。给定2D输入特征[X∈RC×H×W],先将X拆分为大小为M[×]M的非重叠块并得到每个窗口的平展与转置特征[Xi∈RM2×C]。接下来,在每个窗口上执行自注意力。由于Window内部的patch数量远小于图片patch数量,并且Window数量是保持不变的,W-MSA的计算复杂度和图像尺寸呈线性关系,从而大大降低了模型的计算复杂度。

LeFF即Locally-enhanced Feed-Forward Network (LeFF) ,标准Transformer中的前馈网络具有非常有限的局部上下文信息捕获能力。考虑近邻像素对于图像分割的重要性,在前馈网络中添加了一个深度卷积以捕获局部上下文信息,如图5所示。首先采用线性投影层提升每个词的维度;然后将词reshape为2D特征并采用3[×]3卷积捕获局部信息;其次将上述特征平展并通过另一个线性层收缩维度以匹配输入通道。

2 实验与分析

2.1实验数据集

本文采用数据集为P3M10k人像数据集,该数据集包含10 421张通过面部模糊处理的匿名高分辨率肖像图像及其对应的高质量的 alpha 遮罩标注图片。其中训练集中有9 421张图像,测试集中有500张图像。

2.2实验环境及参数设置

本实验所进行的实验环境如表1所示。

2.3 实验结果及分析

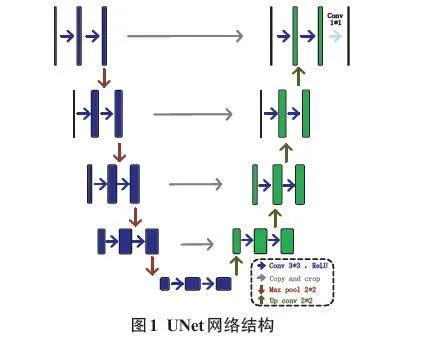

改进后的算法与原UNet算法评价指标对比如表2所示。对于分割过程中的评价标准采用Dice相似系数,Dice系数是一种集合相似度度量指标,通常用于计算两个样本的相似度,值的范围0~1,分割结果最好时值为1,最差时值为0。改进后的网络在人像分割任务中dice系数为81.05%,提升2.91个百分点。因此改进后的算法可以更好地分割出人像信息。

3 结束语

为满足在复杂场景中的人像分割任务要求,提出一种改进UNet的人像语义分割算法,算法中,采用LeWin Transformer Block代替普通的卷积模块,同时在跳跃连接部分引入卷积注意力机制(CBAM),加强网络对图像细节特征的学习。实验结果表明,所提改进算法在复杂场景的人像分割任务中,表现出良好的fe66243e5973ff49146f74b85f194290性能,检测精度高,鲁棒性及泛化能力强,证明所提算法的有效性及优越性[6-8]。

参考文献:

[1] RONNEBERGER O,FISCHER P,BROX T.U-net:convolutional networks for biomedical image segmentation[M]//Lecture Notes in Computer Science.Cham:Springer International Publishing,2015:234-241.

[2] 刘祥,田敏,梁金艳.基于RCH-UNet的新疆密植棉花图像快速分割及产量预测[J].农业工程学报,2024,40(7):230-239.

[3] 徐旺旺,许良凤,李博凯,等.TransAS-UNet:融合Swin Transformer和UNet的乳腺癌区域分割[J].中国图象图形学报,2024,29(3):741-754.

[4] 顾天君,孙阳光,林虎.基于轻量级UNet的复杂背景字符语义分割网络[J].中南民族大学学报(自然科学版),2024,43(2):273-279.

[5] WANG Z D,CUN X D,BAO J M,et al.Uformer:a general U-shaped transformer for image restoration[C]//2022 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR).June 18-24,2022.New Orleans,LA,USA.IEEE,2022:17683-17693.

[6] GONG Q Y,ZHAO X,BI C Y,et al.Maximum entropy multi-threshold image segmentation based on improved particle swarm optimization[J].Journal of Physics:Conference Series,2020,1678(1):012098.

[7] MEHIDI I,BELKHIAT D E C,JABRI D.Automatic brain tumor segmentation using multi-OTSU thresholding and morphological reconstruction[M]//Lecture Notes in Networks and Systems.Cham:Springer International Publishing,2021:289-300.

[8] KASS M,WITKIN A,TERZOPOULOS D.Snakes:Active contour models[J].International Journal of Computer Vision,1988,1(4):321-331.

【通联编辑:朱宝贵】