算法审计本质论

2024-08-09郑石桥

【摘要】以经典审计理论为基础, 提出算法审计本质的一个理论框架。从内涵来说, 算法审计是以系统方法对经管责任履行中的算法进行独立检查并将结果传达给利益相关者的算法治理制度安排。从外延来说, 算法审计有多种分类方法, 可分为基于规则和基于机器学习的算法审计, 也可分为不同审计主体实施的算法审计, 还可以根据人工智能系统的生命周期进行分类。从相关概念的关系来说, 算法审计是人工智能系统审计的组成部分。

【关键词】人工智能系统;算法审计;审计本质;经典审计理论

【中图分类号】 F239.44 【文献标识码】A 【文章编号】1004-0994(2024)15-0073-5

一、 引言

随着人工智能(AI)的快速发展, 算法正以前所未有的速度嵌入人们的经济社会生活中, 公共部门和私营部门业务营运中使用算法的场景已经非常广泛。算法的广泛运用有效地提高了工作的效率效果, 为人们生活带来了极大的便利。但与此同时也带来了一系列的问题, 如算法黑箱、 算法偏见、 算法歧视等, 引起了社会的广泛关注。为了应对这些问题, 各国都在推动建构算法治理体系, 算法问责、 算法公开、 算法赋权、 算法监管都是算法治理体系的组成部分(汤志伟等,2023), 算法审计也是其中的重要组成部分。然而, 算法审计要真正在算法治理中发挥作用, 就必须建构科学的算法审计制度, 而理论自信是制度自信的基础, 正确地认知算法审计的各个基础性问题是科学建构算法审计制度的基础, 本文聚焦算法审计的基础性问题之一——算法审计本质。

现有文献中, 对于算法审计本质的认知主要有三种观点, 其中技术审查观、 影响评估观与经典审计没有直接关联, 但在技术方法上与经典审计有相互借鉴之处, 而经济监督观试图将算法审计作为经典审计的成员, 但并未从学理上贯通审计逻辑。本文以经典审计理论为基础, 提出算法审计本质的一个理论框架, 以深化人们对算法审计本质的认知, 并为建构和优化算法审计制度提供理论参考。

二、 文献综述

“审计”具有多种含义, 能够表示多类事项的集合, 因此它是一个具有概括性的词(umbrella term), 也正是因此, 学者们对算法审计本质存在不同的认知, 主要有三种观点, 本文分别称之为技术审查观、 影响评估观和经济监督观。

(一) 技术审查观

技术审查观是从技术角度来认知算法审计, 认为算法审计是检查算法系统与规范标准之间的差异(张涛,2024)。由于这些规范标准通常是政府或行业组织颁布的算法要求, 技术审查观强调对算法是否符合这些规范标准进行检查, 从这个意义上来说, 算法审计也就是算法合规审计。上述对于算法审计本质的认知, 在不同文献中有不同的表述方法。Raji等(2020)认为, 算法审计是审查复杂流程的工具, 通常用于确定这些流程是否符合公司政策、 行业标准或法规。国际标准化组织制定的管理体系标准将“审计”(audit)界定为一种系统的、 独立的、 有文件记录的获取证据并对证据进行客观评价的过程(Aragona,2021)。张旭(2022)认为, 算法审计是由监管部门、 第三方机构或企业自身对算法的流程、 要素进行合规性审查。张永忠和张宝山(2022)认为, 算法审计是针对被审计单位的算法模型、 数据及有关技术活动的合规性、 风险性进行的审计。英国数字监管合作论坛提出, 算法审计是审查算法处理系统(从简单的统计模型到更先进的机器学习)的一系列方法(DRCF,2022)。王兆毓(2023)认为, 算法审计是对算法设计、 训练、 验证过程的合法性评估。Khoa Lam等(2023)认为: 审计标准是一组可验证或可观察的条件, 必须同时满足这些条件, 算法系统才能被视为符合给定的标准或法律; 算法审计为审计对象遵守法律或其他标准提供保证, 有时也被称为合规审计。

(二) 影响评估观

影响评估观认为, 算法审计是指评估算法系统对个人、 组织及社会可能产生的负面影响(张涛,2024), 对此不同的文献有不同的表述方法。Sandvig等(2014)认为, 算法审计是一种审查算法的种族、 阶级、 性别歧视以及与社会规范交互关系的方法; 师文和陈昌凤(2022)认为, 算法审计是一种系统性审查算法结果偏向的方法, 常被用于检测算法的阶级、 种族、 性别歧视; 沈艳(2022)认为, 算法审计指收集有关算法在特定应用场景中使用时的表现数据, 然后使用这些数据来评估算法是否对人们的某些利益(或权利)产生了负面影响, 从而评估算法本身好坏的过程; 师文和陈昌凤(2023)认为, 算法审计是对算法的运行逻辑进行检查, 常被用于测量黑箱算法中存在的系统性偏向; 徐明华和魏子瑶(2023)认为, 算法审计是从伦理视角出发, 测试机器算法是否存在盲点或偏见的操作流程; Abeba Birhane等(2024)将人工智能审计定义为对这些人工智能系统的任何评估, 其独立于人工智能开发过程, 以问责为目的而实施。

(三) 经济监督观

技术审查观、 影响评估观是现有文献关于算法审计本质的主流观点, 也有个别文献认为, 算法审计是“审计机构依据法律、 法规和政策规定, 对政府部门、 企事业单位等模型算法的管理运用情况、 产生的影响、 存在的风险等进行的审计监督”, 算法审计“更偏重于经济监督以及模型算法带来的风险, 与行政监督和司法监督等监督形式有所区别” (王玉凤,2023)。算法审计是一种具体的审计类型, 其制度内涵受到审计一般理论的影响(张涛,2024)。本文将算法审计本质的这种认知称为经济监督观。

(四) 简要评述

上述三类观点中, 技术审查观下的算法审计是站在政府角度对算法进行的检查, 目的是保障算法相对人的合法利益不受侵害, 遵守的基本原则是谦抑原则, 也就是最低程度干预, 只有在必不可少的情形下才干预。在这种观点中, 算法审计的实质是政府以法规为基础的算法规制工具, 食品安全审计、 药品安全审计、 航空安全审计等都是类似的技术性规制工具(Raji等,2020;Khoa Lam等,2023)。因此, 技术审查观中的审计与经典审计没有直接关联, 只是借用了“audit”的审核、 审查的含义, 但其在技术方法上与经典审计有相互借鉴之处。

影响评估观源于针对算法影响的社会科学研究, 主要是借鉴审计研究(audit studies)方法, 这里的“audit”与经典意义上的审计有很大区别, 是在“审核、 审查”的意义上使用“audit”。“审计研究”(audit studies)就是审核、 审查性研究, 最早兴起于20世纪60年代, 主要用于审查人员招聘、 房屋申请等不透明决策过程中潜在的种族偏见、 性别偏见等问题(Gaddis,2018;张超,2021;徐明华和魏子瑶,2023)。在算法审计方面, 最早是Sandvig等(2014)将这种审核、 审查性研究方法用于谷歌广告推送算法的偏见检测, 结果发现广告推送算法的决策逻辑可能存在种族偏见。后来, 不少研究文献将这种方法用于算法偏见检测, 发现许多算法中存在偏向(Lambrecht和Tucker,2019)。因此, 严格意义上来说, 影响评估观中的算法审计只是一种社会科学的研究方法, 与经典意义上的审计并无直接关联, 但其在技术方法上也与经典审计有相互借鉴之处。

经济监督观将算法审计作为经济监督的一种手段, 区别于针对算法的行政监督和司法监督等, 试图将算法审计作为经典审计的成员, 但是现有文献的阐述中并未从学理上贯通审计逻辑。

三、 理论框架

本文的目的是以经典审计理论为基础, 提出算法审计本质的一个理论框架, 为此需要按顺序阐释以下问题: 算法审计的内涵、 算法审计的外延以及算法审计与相关概念的辨析。

(一) 算法审计的内涵

在经典审计理论看来, 算法审计也是审计, 因此必须以审计一般的本质为基础来认知算法审计本质。当然, 学者们对审计一般的本质有不同的观点, 本文认同的观点是, “审计是以系统方法从行为、 信息和制度三个角度独立鉴证经管责任履行情况并将结果传达给利益相关者的制度安排”(郑石桥,2021)。据此, 本文提出算法审计的本质: 算法审计是以系统方法对经管责任履行中的算法进行独立检查并将结果传达给利益相关者的算法治理制度安排。这一表述有五个方面的核心内涵: 算法审计是对经管责任履行情况的审计; 算法审计从算法维度来开展对经管责任履行情况的审计; 算法审计需要采用系统方法独立地进行检查; 算法审计需要将审计结果传递给利益相关者; 算法审计是算法治理体系的组成部分。下文分别阐述这五个核心内涵。

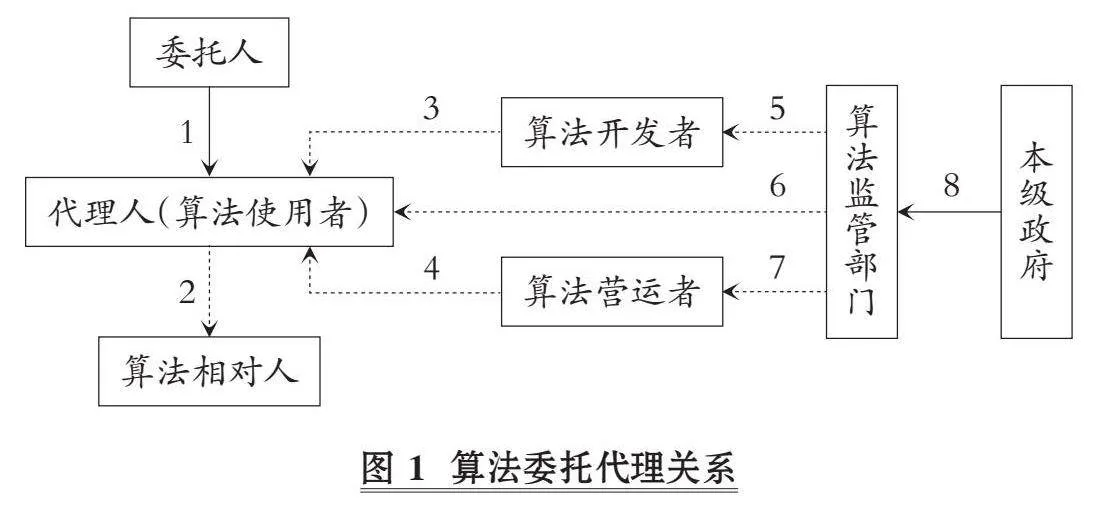

1. 算法审计是对经管责任履行情况的审计。经典审计理论认为: 在资源类委托代理关系中, 代理人对委托人承担了最大善意使用所接受的资源来履行所要求职责的责任(这种责任通常被称为经管责任或受托责任), 但是由于信息不对称、 合约不完备、 激励不相容和环境不确定等因素, 代理人可能出现代理问题和次优问题, 因此需要建立针对代理问题和次优问题的治理机制, 而审计是治理机制的组成部分之一, 其主要的工作方式是基于审计固有功能, 以系统方法从特定的维度来检查代理人的经管责任履行情况。在广泛使用人工智能的时代(由于算法是核心要素, 也可称之为算法时代), 上述基本态势并未改变, 算法相关的委托代理关系基本情况如图1所示。

图1中基本的关系仍然是委托人和代理人的关系(关系1), 其他关系都是在此基础上产生的。在关系1中, 委托人提供资源给代理人, 并确定代理人使用这些资源需要履行的职责, 代理人对委托人承担了经管责任, 这种关系中同样存在信息不对称、 合约不完备、 激励不相容和环境不确定等因素, 因此同样需要审计来检查代理人的经管责任履行情况。但是, 在算法时代, 代理人在履行其经管责任时广泛使用了算法, 导致对代理人的经管责任履行情况进行检查无法回避算法, 算法的状况对代理人经管责任履行情况有着重要影响。因此, 必须对算法本身进行审计, 但是审计算法是服务于检查代理人经管责任履行情况的, 从终极意义来说, 即使是算法时代的算法审计, 也属于经管责任履行情况审计。

图1中关系8是本级政府将算法监管的职责交付特定的政府部门, 形成本级政府与算法监管部门的委托代理关系。这种关系中存在信息不对称、 合约不完备、 激励不相容和环境不确定等因素, 其性质是资源类委托代理关系, 其特殊之处在于, 这个政府部门的法定职责是算法监管, 如果本级政府审计机关对算法监管部门进行审计, 其审计内容同样是该部门经管责任履行情况, 只是经管责任的内容中包括算法监管责任。

2. 算法审计从算法维度来开展对经管责任履行情况的审计。根据经典审计理论, 对经管责任履行情况的审计可以从履行经管责任的经济信息、 经济行为和经济制度三个角度展开, 也就是说, 经济责任履行情况可以落实到三类审计主题, 可以审计履行经管责任的经济信息, 也可以审计履行经管责任的经济行为, 还可以审计履行经管责任的经济制度(郑石桥和郑卓如,2015)。图1的关系1中代理人在经管责任履行过程中采用的算法规定了代理人履行经管责任时对有关事项的处理逻辑过程和方法, 因此属于经济制度类审计主题。具体来说, 若代理人依据人工智能系统履行经管责任, 审计代理人履行经管责任的情况就无法回避对人工智能系统的审计, 而算法是人工智能系统的灵魂, 因此人工智能系统审计的核心内容是算法审计。图1的关系8中算法监管是政府监管部门的法定职责, 对该部门进行审计时, 既可以审计其履行算法职责的相关法规制度, 也可以审计其算法监管的相关行为, 还可以审计其算法监管相关信息, 但是, 无论如何, 三者都是围绕算法展开的。

3. 算法审计需要采用系统方法独立地进行检查。算法审计是审计人员对代理人履行经管责任中运用的算法进行检查, 这种检查具有两个特点: 一是独立性。审计人员不能是算法开发者、 算法营运者, 也不能是算法使用者, 并且在经济上、 组织上、 人际关系上与算法开发者、 算法营运者和算法使用者不存在会影响其不偏不倚的因素。若失去独立性, 审计人员做出的算法审计结论就会失去价值。二是采用系统方法。算法审计要核实算法的真实情况, 在此基础上, 将算法的真实情况与既定标准相比较, 确定二者的相符程度, 因此需要基于系统方法才能得出正确的审计结论, 这种系统方法主要体现在算法审计准则中。由于算法审计准则是最佳审计实务与审计逻辑相结合的产物, 算法审计采用的系统方法也就是当下最科学的方法。

4. 算法审计需要将审计结果传递给利益相关者。根据经典审计理论, 审计作为一种人类社会的制度创造, 其价值在于能够促进代理人更好地履行其承担的经管责任, 而实现这种价值的路径是发现代理人履行经管责任中的代理问题和次优问题, 并推动这些审计结果得到应用, 因此, 审计结果应用是审计价值创造的关键环节之一(郑石桥,2021)。算法审计也是如此, 其价值在于让算法赋能代理人更好地履行经管责任, 为此, 也需要寻找算法中存在的代理问题和次优问题, 其审计结果就是所发现的算法中存在的各类代理问题和次优问题。但是, 如果这些审计结果不能得到有效的运用, 算法审计的价值就无从实现。因此, 审计人员必须通过一定的方式将算法审计结果传递给委托人、 代理人及其他利益相关者, 让这些利益相关者在各自的决策中运用审计结果, 从而使算法越来越完善, 进而为代理人更好地履行其承担的经管责任奠定基础。

5. 算法审计是算法治理体系的组成部分。算法能够赋能代理人更好地履行其承担的经管责任, 但也可能出现一些负面的问题, 算法黑箱、 算法歧视、 算法霸权、 算法合谋、 信息茧房等都是可能出现的伦理性问题, 此外, 也有可能出现违反国家有关规定的合法性问题, 还有可能出现不能有效解决问题的效率效果性问题。这些问题的出现都会对代理人良好地履行其承担的经管责任产生负面影响, 因此, 委托人及代理人和政府监管部门会推动建构针对算法代理问题和次优问题的治理体系, 这个体系通常被称为算法治理体系。这一体系中的算法治理机制有多种, 算法审计以审计固有功能在算法治理中发挥作用, 成为算法治理体系的重要组成部分(付冉冉,2023;刘建业,2023;陈雄燊,2023)。既然如此, 算法审计就必须与其他算法治理机制相协调, 以算法治理体系为背景来建构算法审计制度, 而不是特立独行, 其既要与其他算法治理机制协同, 又要明确自己的独特定位, 避免与其他算法治理机制重复。

上文阐述了算法审计本质的核心内涵, 由于这些核心内涵贯通了经典审计理论中的审计本质理论, 本文将这种算法审计本质观点称为经典审计观。那么, 这种观点与现有文献中的三种观点是什么关系呢?

在技术审查观中, 算法审计是政府以法规为基础的算法规制工具, 主要检查算法是否符合政府及行业组织颁布的算法法律法规, 与经典审计没有直接关联, 但其在技术方法上也要求核实算法的真实情况, 在此基础上判断该算法与相关算法法律法规是否相符, 这种方法类似于算法审计中的系统方法。因此, 从方法论的角度来看, 技术审查观与经典审计观具有一致性。但是, 技术审查观并不强调其审核的算法一定是代理人履行其经管责任中的算法, 只要影响公众利益的算法, 政府有关部门都可以对其进行监管, 所以经典审计观认知的算法审计是对算法的所有权监督, 而技术审查观认知的算法审计是对算法的行政权监督, 二者在监督需求、 监督主体、 监督客体和监督内容方面存在差异(这些差异将在算法审计基本理论研究系列论文的其他相关文章中阐述, 这里不展开讨论)。为了区分两种不同性质的算法监督, 本文建议将基于技术审查观的算法审计称为算法合法性检查。

在影响评估观中, 算法审计就是对算法中各种偏向的检测, 关注算法中存在的伦理性问题, 既不是所有权监督, 也不是行政权监督, 是一种社会科学的研究方法, 与经典审计并无直接关联。但是, 如果代理人履行其经管责任的算法中存在伦理性问题, 对代理人良好地履行其经管责任形成负面影响, 通常也会将这些内容包括在经典意义的算法审计中, 并且在方法上也借鉴社会科学的审核性研究方法。

经济监督观试图将算法审计作为经典审计的成员, 但是, 现有文献的阐述中并未从学理上贯通审计逻辑。本文提出的算法审计本质强调的是对代理人履行其经管责任中所采用的算法进行独立检查, 其实质就是经济监督观, 但本文是根据经典审计理论来解释算法审计本质的, 从学理上较为系统地阐释了算法审计本质, 所以称为经典审计观。

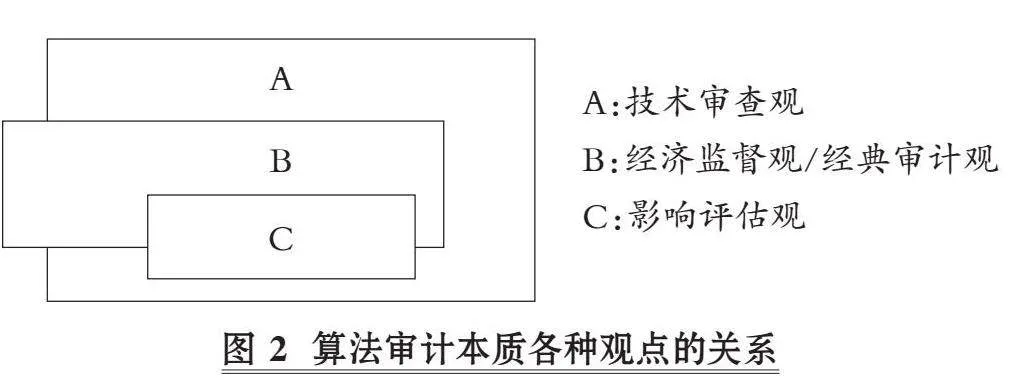

总体来说, 技术审查观、 影响评估观、 经济监督观和经典审计观的关系如图2所示。

图2中, 方框A是技术审查观, 一些不存在资源类委托代理关系但使用算法的情景仍然需要开展算法合法性检查, 但其不属于经济监督观/经典审计观的算法审计范围(方框B), 因此方框A大于方框B。但是, 经典审计观的要求高于技术审查观, 因此方框B也可能在方框A之外。方框C是影响评估观的算法审计范围, 它与经济监督观/经典审计观的算法审计范围有交叉, 对于一些不存在资源类委托代理关系但使用算法的情景也可能开展伦理性审查, 此时就可能超出了经济监督观/经典审计观的算法审计范围。

(二) 算法审计的外延

下文对算法审计的外延进行分析, 以深化对算法审计本质的认知。

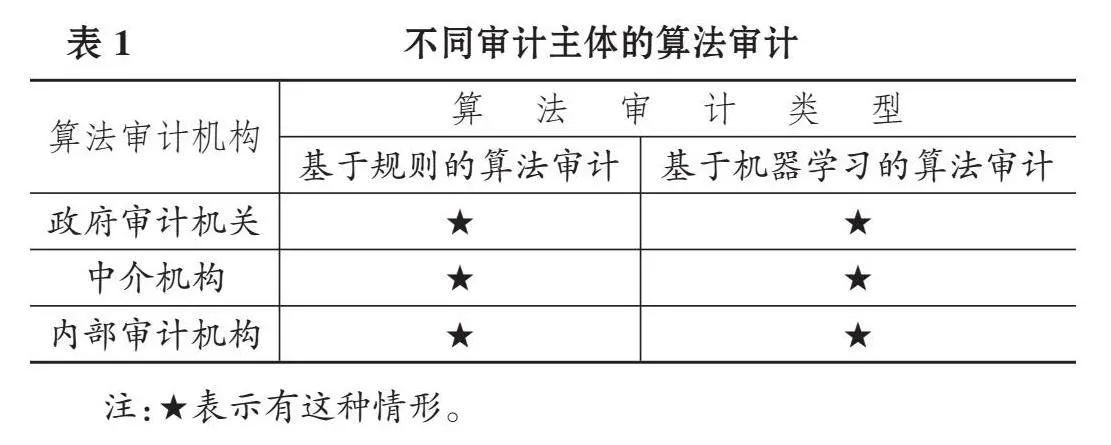

首先, 算法审计可以分为基于规则的算法审计和基于机器学习的算法审计。算法是解决问题的一系列步骤或规则, 它可以被计算机执行以达到预期的结果, 在人工智能中, 算法扮演着核心角色(丁晓东,2020)。但是, 算法有不同的类型, 其复杂性存在较大的差异。基于规则的算法是按软件程序中设定的规则来完成任务, 并且永远保持不变, 而基于机器学习的算法侧重于模拟和模仿人类的认知过程(Lambauer,2021;Aragona,2021;Beckstrom,2022)。正是因为这两类算法的上述差异, 针对它们的审计内容及方法也存在差异, 进而形成两个相对独立的算法审计领域。

其次, 从审计主体来说, 政府审计机关、 内部审计机构和中介机构都可以开展基于规则的算法审计和基于机器学习的算法审计, 其基本状况如表1所示。不同审计主体的审计范围各有不同, 政府审计机关主要对公共资源委托代理关系中的代理人履行其经管责任中的算法进行审计, 内部审计机构主要对内部资源委托代理关系中的代理人履行其经管责任中的算法进行审计, 而中介机构则是接受委托, 对特定的资源类委托代理关系中的代理人履行其经管责任中的算法进行审计。

最后, 人工智能系统有自己的生命周期, 通常来说, 人工智能系统的生命周期包括模型开发、 模型训练、 模型部署和模型评估, 这些阶段都需要对人工智能中的算法进行审计。

(三) 算法审计与相关概念的辨析

为了进一步深化对算法审计本质的认知, 下文辨析了人工智能系统审计、 智能审计与算法审计的关系。

人工智能系统是指利用计算机和机器来模仿、 延伸和扩展人的智能, 以实现自动化、 自适应、 自学习等能力的技术或系统, 从某种意义上来说, 人工智能系统是高级的信息系统。资源类委托代理关系中的代理人在履行其经管责任时如果使用了人工智能系统, 则这个系统会决定其责任履行情况, 因此也需要对这个人工智能系统进行审计。这一项审计侧重于评估人工智能系统本身, 以确保它们按预期工作, 没有偏见或歧视, 并符合道德和法律标准(葛典怡,2023)。算法是人工智能系统的灵魂, 算法审计是人工智能系统审计的核心内容, 由于算法不同于人工智能系统中的其他要素, 算法审计成为相对独立的模块, 需要形成自己的审计理论与方法, 也就是算法审计理论与方法。

智能审计不是对智能的审计, 而是一种利用人工智能技术, 结合机器学习和自然语言处理等技术, 为审计取证提供支持的新型审计技术, 它能够有效识别潜在的审计风险、 及时发现异常状况, 并提供相应的解决方案。智能审计发展到一定水平就可以称为智慧审计。很显然, 智能审计强调的是审计本身的智能化, 并不是对智能系统的审计, 也不一定涉及所审计财务及业务活动中的算法。当然, 智能审计本身需要有算法, 这是在实施审计的过程中所使用的算法, 并不是对算法是否存在缺陷的审计。

四、 结论

算法在提高工作效率效果, 并为人们生活带来极大便利的同时, 也带来了一系列的问题, 为此, 需要建构算法治理体系, 而算法审计是其重要组成部分。要科学地建构算法审计制度, 就必须正确地认知算法审计的各个基础性问题。本文聚焦算法审计本质, 以经典审计理论为基础, 提出算法审计本质的一个理论框架。

从内涵来说, 算法审计是以系统方法对经管责任履行中的算法进行独立检查并将结果传达给利益相关者的算法治理制度安排, 有五个方面的核心内涵: 算法审计是对经管责任履行情况的审计; 算法审计从算法维度来开展对经管责任履行情况的审计; 算法审计需要采用系统方法独立地进行检查; 算法审计需要将审计结果传递给利益相关者; 算法审计是算法治理体系的组成部分。从外延来说, 算法有多种分类方法。根据所审计的算法不同, 算法审计分为基于规则的算法审计和基于机器学习的算法审计; 政府审计机关、 内部审计机构和中介机构都可以开展基于规则的算法审计和基于机器学习的算法审计; 人工智能系统有自己的生命周期, 在其生命周期的各个阶段都有可能开展算法审计。从相关概念的关系来说, 算法审计是人工智能系统审计的组成部分, 不同于智能审计。

【 主 要 参 考 文 献 】

陈雄燊.人工智能伦理风险及其治理——基于算法审计制度的路径[ J].自然辩证法研究,2023(10):138 ~ 141.

丁晓东.论算法的法律规制[ J].中国社会科学,2020(12):138 ~ 159.

付冉冉.大数据时代算法审计构想[ J].网络安全与数据治理,2023(2):48 ~ 52.

葛典怡.人工智能审计的研究热点与发展趋势——基于CiteSpace的知识图谱分析[ J].运筹与模糊学,2023(6):6112 ~ 6118.

刘建业.论我国算法审计的法治化建构[ J].河南财经政法大学学报,2023(3):14 ~ 23.

师文,陈昌凤.国内主流搜索引擎的算法审计研究[ J].新闻大学,2022(10):84 ~ 100+122 ~ 123.

师文,陈昌凤.平台算法的“主流化”偏向与“个性化”特质研究——基于计算实验的算法审计[ J].新闻记者,2023(11):3 ~ 14.

汤志伟,方錄,韩啸等.基于委托代理视角的算法治理问题研究[ J].情报杂志,2023(7):170 ~ 177.

王玉凤.模型算法审计:理论内涵、国际经验与审计框架[ J].审计研究,2023(3):11 ~ 18.

王兆毓.生成式人工智能视阈下算法审计的制度构建与路径创新[ J].网络安全与数据治理,2023(8):6 ~ 12.

徐明华,魏子瑶.算法伦理的治理新范式:算法审计的兴起、发展与未来[ J].当代传播,2023(1):80 ~ 86.

张超.资讯类推荐算法的算法审计路径、伦理与可审计机制[ J].中国出版,2021(7):31 ~ 35.

张涛.通过算法审计规制自动化决策[ J].中外法学,2024(1):261 ~ 279.

张旭.基于人权标准的算法治理新思路:企业算法合规义务[ J].人权研究,2022(2):88 ~ 104.

张永忠,张宝山.算法规制的路径创新:论我国算法审计制度的构建[ J].电子政务,2022(10):48 ~ 61.

郑石桥.审计基础理论[M].北京:中国人民大学出版社,2021.

郑石桥,郑卓如.基于审计主题的审计学科体系创新研究[ J].会计研究,2015(9):81 ~ 87.

Abeba Birhane, Ryan Steed, Victor Ojewale, et al.. AI auditing:The broken bus on the road to AI accountability[EB/OL]. https://arxiv.org/pdf/2401. 14462.pdf,2024-01-25.

Aragona B.. Algorithm audit: Why, what, and how?[EB/OL]. https:/doi.org/10.4324/9781003080381,2021-08-02.

Beckstrom J. R.. Auditing machine learning algorithms:A white paper for public auditors[EB/OL]. http://intosaijournal.org/auditing-machine-learning-algorithms/,2022-06-20.

DRCF. Auditing algorithms: The existing role of regulators and future outlook[EB/OL]. https//www.gov.uk/government/publications/findings-from-the-drcf-algorithmic-processing-workstream-spring-2022,2022-09-23.

Gaddis S.. Audit studies:Behind the scenes with theory,method,and nuance[M]. Los Angeles:Springer,2018.

Khoa Lam, Benjamin Lange, Borhane B. H., et al.. A framework for assurance audits of algorithmic systems[EB/OL]. https://arxiv.org/pdf/2401.14908.pdf,2023-01-26.

Lambauer D.. How to audit artificial intelligence models[EB/OL]. https://www.nao.org.uk/insights/how-to-audit-artificial-intelligence-models/,2021-06-01.

Lambrecht A., Tucker C.. Algorithmic bias? An empirical study of apparent gender-based discrimination in the display of STEM career ads[ J]. Management Science,2019(7):2966 ~ 2981.

Raji I. D., Smart A., White R. N., et al.. Closing the AI accountability gap: Defining an end-to-end framework for internal algorithmic auditing[EB/OL]. https://arxiv.org/abs/2001.00973,2020-01-03.

Sandvig C., Hamilton K., Karahalios K., et al.. Auditing algorithms: Research methods for detecting discrimination on internet platforms[A]. The International Communication Assciation,2014.