面向分布式复杂数据样本的联邦语义分割方法综述

2024-07-31董成荣姚俊萍李晓军苏逸周志杰

摘 要:语义分割在医学图像分析、战场态势感知等领域起着重要作用,但单一客户端通常无法为模型提供足够数量与多样性的训练数据,因此从复杂多变的分布式数据中训练语义分割模型是有必要的。为了不泄露数据隐私和保护数据安全,应用联邦学习在多客户端协同训练语义分割模型成为领域研究热点。在联邦语义分割定义基础上,围绕分布式复杂数据样本的数据异质性、标签缺失两个关键特征,开展联邦语义分割的问题描述、技术路径、典型模型实例等综述分析,评估不同方法的适用性及特点,梳理当前应用成果,提出针对该问题的潜在研究机会。研究为开展面向分布式复杂数据样本的联邦语义分割方法及相关研究提供借鉴和参考。

关键词:语义分割;联邦学习;协同训练;数据异质性;标签缺失

中图分类号:TP391 文献标志码:A文章编号:1001-3695(2024)06-002-1610-08

doi: 10.19734/j.issn.1001-3695.2023.09.0420

Survey on federated semantic segmentation methods for distributed complex data samples

Abstract:

Semantic segmentation plays a crucial role in various fields such as medical image analysis and battlefield situatio-nal awareness. However, a single client often cannot provide a sufficient quantity and diversity of training data for the model. Therefore, it is necessary to train semantic segmentation models from distributed data, which exhibits complex and diverse characteristics. To prevent data privacy breaches and safeguard data security, the application of federated learning in the collaborative training of semantic segmentation models across multiple clients has become a hot research topic in the field. Buil-ding upon the definition of federated semantic segmentation, this paper conducted a comprehensive analysis around the key characteristics of data heterogeneity and label deficiency in distributed complex data samples. The study encompassed a review of issues, methods, and exemplary model instances in federated semantic segmentation, evaluating the applicability and cha-racteristics of different methods, summarizing current application outcomes. The paper also proposed potential research opportunities to address the issues of data heterogeneity and label deficiency. The research provides insights and references for the development of federated semantic segmentation methods and related studies tailored for distributed complex data samples.

Key words:semantic segmentation; federated learning; collaborative training; data heterogeneity; label deficiency

0 引言

语义分割是计算机视觉领域的一项基础任务[1~3],它为所处理的图像或者视频帧的每一个像素分配一个对应的语义标签,被广泛应用于自动驾驶[4~6]、行人再识别[7]、机器人导航[8,9]及医学图像分析[10~12]等下游应用。训练一个高性能的语义分割模型需要大量的有标签数据,但工程实践中,由于数据产生于多个客户端,且存在隐私保护、安全保密、通信带宽等方面的约束,医学图像、军事训练影像等数据样本往往是分布式存储的。此外,应用领域中的数据特点及数据标注困难、成本投入限制等原因又导致了分布式存储的数据普遍存在数据分布不平衡、标签不完备等数据复杂分布问题。因此,面向分布式复杂数据样本的语义分割研究具有显著的工程实践价值,成为领域关注的热点问题。

联邦学习[13~15]是近年来新兴的一种多客户端协同训练方法,能够有效整合不同节点或不同机构拥有的数据。相比传统的分布式协同训练,参与联邦学习的客户端将本地模型的参数或梯度加密后发送至中心服务器,而不会在节点间直接共享数据。这种方法有效保护了用户的数据隐私,因而在诸多领域的分布式数据语义分割任务上具有广阔前景。相较于面向图像分类任务的联邦学习研究案例[16],语义分割是密集预测型任务,其输出结果是与输入图像同分辨率的特征图而非单一标签,应用联邦学习在多客户端协同训练语义分割模型(以下简记为联邦语义分割)具有显著的理论创新价值并受到持续关注。

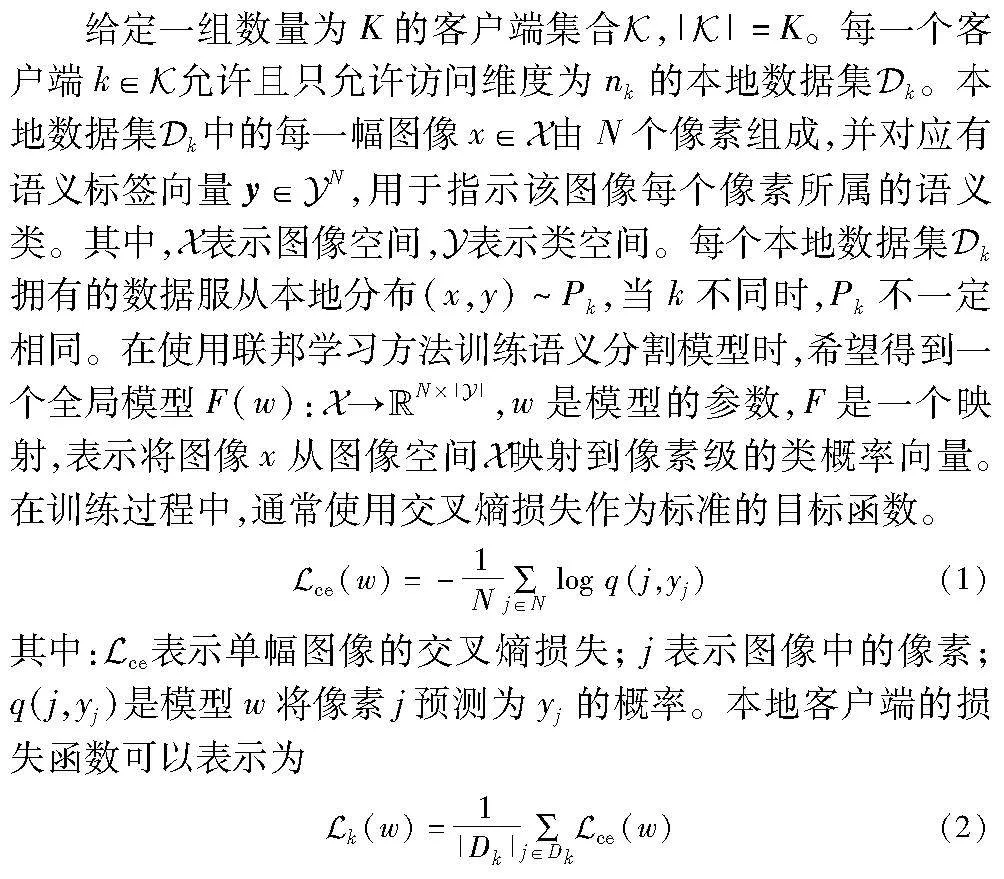

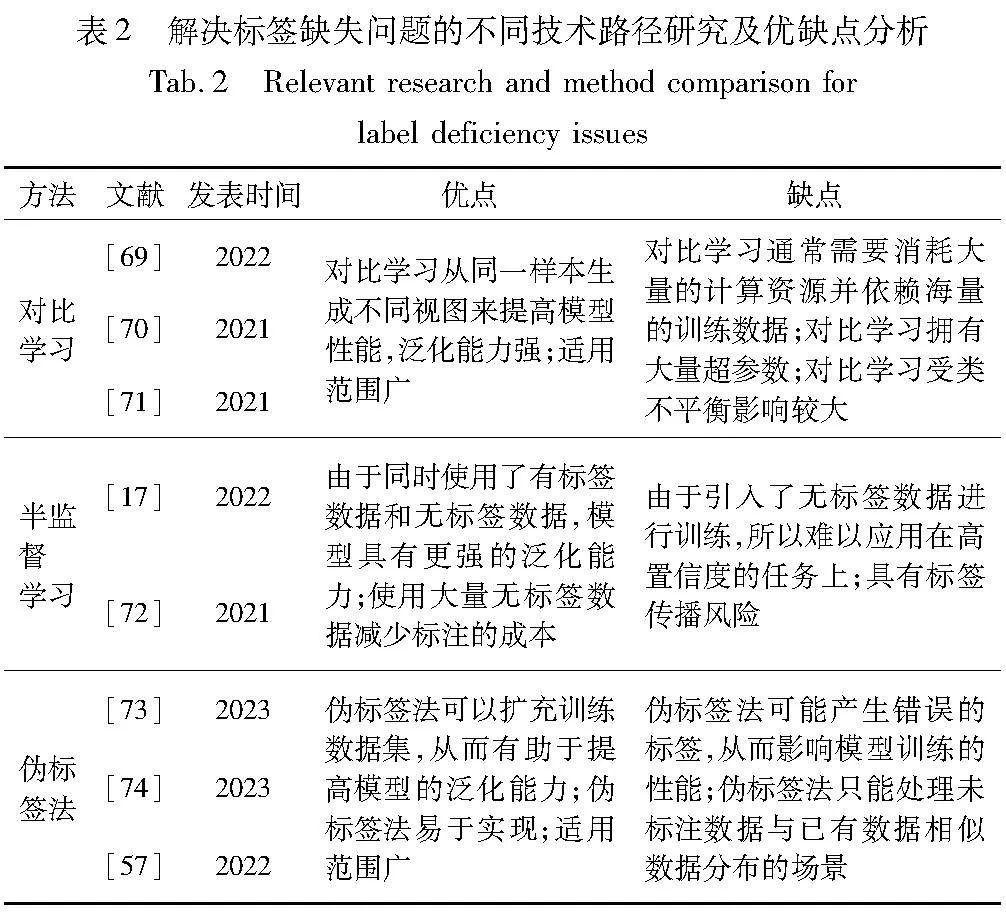

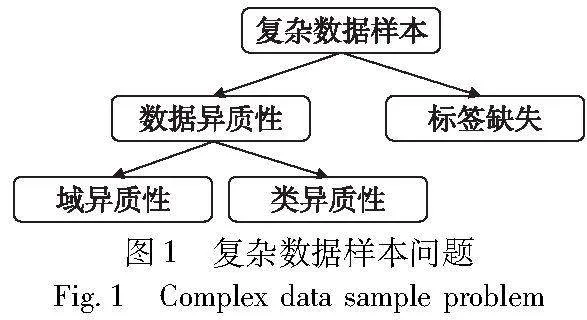

分布式场景下数据样本的复杂性主要来自于数据本身以及对数据样本的标注两个方面[17]。数据样本自身的复杂性包括异构性与异质性两个方面,其中数据异构产生的挑战主要集中于样本特征描述与提取环节,而分布式场景下的语义分割更关注全局模型的生成,因此本文主要关注数据异质性问题。数据异质性问题可进一步分为域异质性和类异质性两种。从标注角度看,数据样本的复杂性表现在标签的缺失和噪声。在分布式场景下,边缘节点缺乏足够的人力实时标注数据,无标注数据占比远高于噪声标签,且对无标注数据处理时本身就要考虑克服伪标签等带来的噪声,因此本文聚焦于标签缺失的问题,不再单独围绕标签噪声展开,如图1所示。

基于此,本文开展面向分布式复杂数据样本的联邦语义分割方法研究综述,在问题描述与定义基础上,结合数据样本复杂性特征,分析解决数据异质性、标签缺失挑战的联邦语义分割关键技术模型进展,并进行方法比较与适应性讨论,总结并展望未来的研究方向,以期为领域相关研究提供参考。

1 问题定义

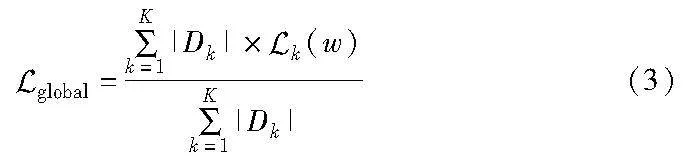

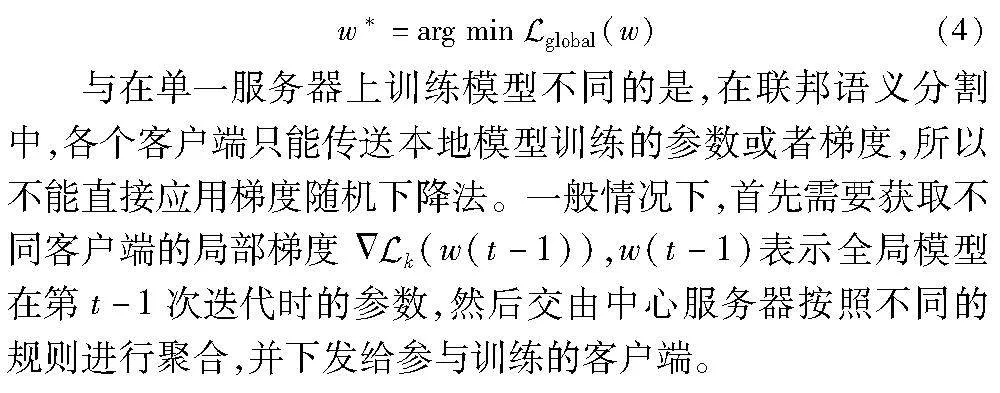

此时,全局模型的损失函数可以由参与联邦学习的客户端的本地损失函数组成:

为了获取模型的最优参数w*,需要使其损失函数最小,即计算式(4)。

2 面向数据异质性的联邦语义分割研究

数据异质性几乎是多客户端协同训练时必然面对的问题,它是由于不同客户端拥有的数据分布不同所导致的。目前关于数据异质性的分类尚无统一标准,Ma等人[13]将数据异质性分为标签分布偏态、特征分布偏态、相同标签不同特征、相同特征不同标签和数量偏态五类,而Li等人[18]则将数据异质性分为标签分布偏态、特征分布偏态和数量偏态三类。

考虑到标签分布偏态、特征分布偏态等数据异质性问题在联邦语义分割任务中经常同时存在,难以准确分离研究界面,本文以数据异质性产生的原因为切入点,将联邦语义分割中的数据异质性分为域异质性(domain-heterogeneous)与类异质性(class-heterogeneous)两类。

2.1 域异质性

2.1.1 域异质性问题描述

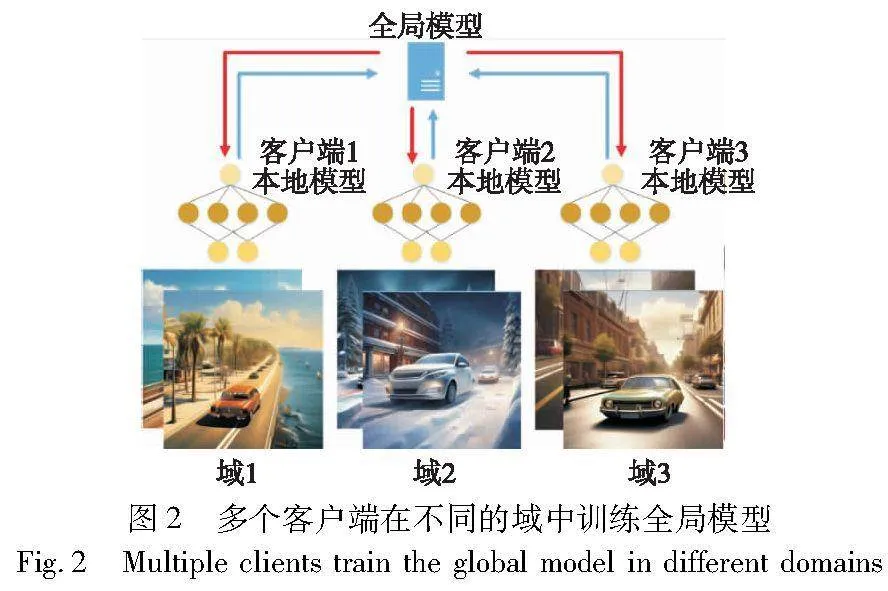

域异质性是指不同客户端拥有的数据采集于不同的领域或环境(包括采集地点、条件和时间等因素),导致数据在特征分布、类别分布和终端分布等方面存在差异,从而在联邦学习过程中呈现出数据异质性的特点。

图2展示的是一种典型的在域异质性情况下协同训练全局模型的情况,不同客户端所呈现的车辆、道路、背景等语义类别在外观方面都存在显著的差异。这种差异是由于采集数据的地点不同所导致的,更具体地说,是所在地点地貌、天气特征、经过车辆类型不同所产生的。因此,尽管具有相同的语义标签,但是同一神经网络提取到的特征差距极大。

2.1.2 技术路径

本文整理了近年来联邦语义分割方法中针对数据样本域异质性问题的主要技术路径,包括个性化联邦学习、风格迁移、簇联邦学习、损失函数优化和强化学习五大类。

1)个性化联邦学习

相比传统的联邦学习训练一个通用的全局模型,个性化联邦学习旨在为参与训练的客户端提供一个个性化模型[19,20],使该模型在本地客户端上拥有更好的泛化能力。Tan等人[21]将个性化联邦学习方法分为全局模型个性化与本地模型个性化两类。第一类方法中所有参与训练的客户端共享一个全局模型,但是在生成预测结果时需要进行局部适应;而在第二类方法中,每个参与训练的客户端都拥有一个独立架构相同但参数不同的个性化模型。此外,Kulkarni等人[22]提到了个性化联邦学习的几种不同实现方法。

2)风格迁移

它是将目标图像的风格与源图像的内容结合,生成新图像的过程[23~25],最初被用于艺术创作[26],随后成为了数据增强的一个重要工具并被广泛用于工业界,尤其是在医学图像处理领域[27]。但遗憾的是,尽管有着大量成熟的风格迁移方法,受限于联邦语义分割中隐私保护的需求,只有很少的风格迁移方法可以应用到联邦语义分割领域。这些方法通常是基于傅里叶变换实现的[28,29]。通过傅里叶变换将一幅图像分为幅度图和相位图,并在各个客户端之间传递,不会泄露图像内容的幅度图。

3)簇联邦学习

簇联邦学习[30]将参与训练的客户端按照一定的规则(如余弦相似度等)分为不同的簇,每个簇内的参与者协同训练一个模型。相比传统联邦学习为所有的参与者提供一个全局模型,簇联邦学习只为数据分布相似的客户端提供一个专门的簇模型,减轻了不同数据分布对模型泛化能力的影响。

4)损失函数优化

损失函数[31]是一个数学函数,量化了模型的性能表现。它接受模型的输出和真实目标值作为输入,并计算模型的预测与真实值之间的差异。设计一个合适的损失函数有助于提高模型的分割能力,但在分布不同的数据中,同样的损失函数有时反而会起到负面影响,导致可迁移性差。

5)强化学习

强化学习(reinforcement learning)[32,33]是一种智能体在与环境的交互过程中通过学习策略以达成回报最大化或实现特定目标的问题。强化学习的主要特点是试错学习和开发已有的经验来获取收益,使得未来可以获得更好的动作选择空间。但强化学习在训练过程中可能会表现出不稳定性,使得重复实验结果难以预测。

2.1.3 方法对比

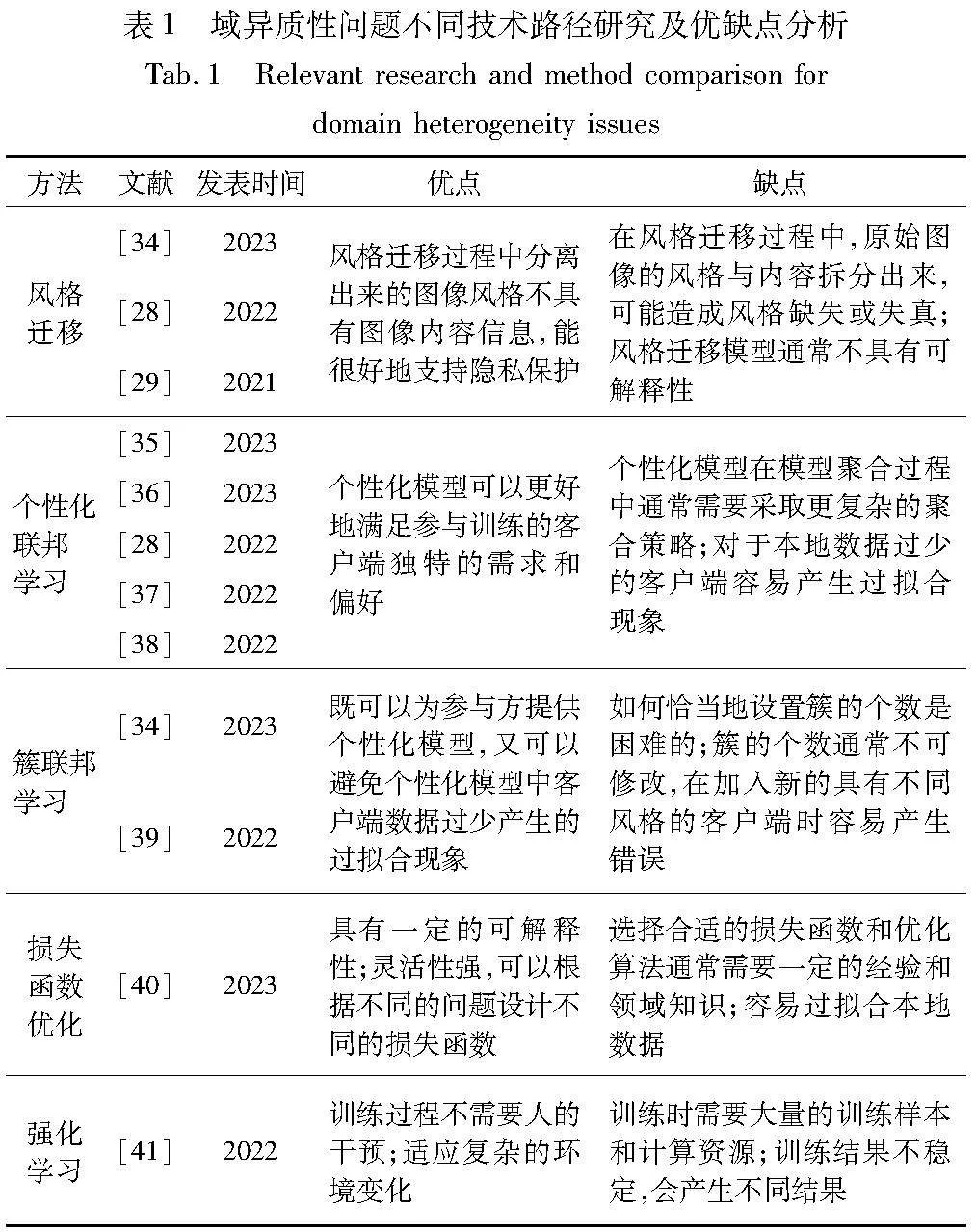

表1的数据显示风格迁移被广泛用于解决域异质性问题,簇联邦学习、损失函数优化和强化学习也被用于校正域异质性对模型性能的影响。其中个性化联邦学习与簇联邦学习之间存在着一定的相似性。个性化联邦学习是指为每一个参与训练的客户端提供一个适应本地数据的模型,而簇联邦学习是将参与训练的客户端按照一定的规则分为不同的簇并为每一簇提供一个个性化模型。表1分析了不同技术路径的优点与缺点。

1)FedDrive[28]

FedDrive是第一个面向自动驾驶任务的联邦学习语义分割模型。Fantauzzo等人[28]认为批量归一化层的缺点是假设所有数据是同分布的,这与联邦学习中不同客户端持有数据为非独立同分布的事实不符,导致了模型精度的下降。基于此,FedDrive将FedAvg的批量归一化层替换为更适合联邦学习的FedBN[42]或SiloBN[43]。FedBN与传统的批量归一化层的区别是在联邦学习过程中,批量归一化层只在本地客户端训练时更新参数而不会发送到中心服务器参与聚合过程。这种做法可以使模型更快地收敛并且更好地适应本地数据。为了解决不同域之间数据分布差异较大的问题,FedDrive使用风格迁移[23]技术对原始数据进行预处理。具体而言,是使用连续频率空间插值(continuous frequency space interpolation,CFSI)[29]或者 LAB(LAB-based image translation)[44],将一半的本地客户端数据变换为具有其他客户端分布的图片。在这一过程中,客户端之间共享的是幅度图或者均值-方差对,并不会造成隐私泄露。

2)FBL(forgetting balanced learning)[40]

FBL方法主要解决类异构问题中的灾难性遗忘问题(catastrophic forgetting)[45],即本地客户端增加了新类别的数据并使用这部分数据训练后,模型在曾经学习过的旧类上准确率大幅下降的问题。FBL将这一问题分为客户端内部和客户端之间两部分,并分别给出了解决方案。对于客户端内部的灾难性遗忘问题,Dong等人[40]认为主要是由背景漂移[46,47]引起的,因此借鉴了类增量语义分割中常见的修正背景漂移的方法。具体而言,FBL设计了一种自适应类平衡伪标记方法为输入的图像生成伪标签,同时在伪标签的指导下计算两种特殊的损失,分别是遗忘-平衡语义补偿损失和遗忘-平衡关系一致性损失。对于客户端之间的灾难性遗忘问题,FBL提出了一种名为任务转换监控器的方法。在这种方法中,每次模型迭代都会计算客户端的交叉熵损失并根据客户端交叉熵损失变化幅度判断是否出现新的类别。

3)FedSM[38]

FedSM由三部分组成,分别是位于中心服务器的全局模型wg、位于各个客户端的个性化模型wp,k和用于评判全局/个性化模型泛化能力的模型选择器ws。其中全局模型wg使用经典的联邦学习算法FedAvg[48]获得。对于位于不同客户端的个性化模型wp,k,Xu等人[38]在现有的插值方法上进行了改进,提出了一种新的个性化模型优化方法SoftPull。与其他插值方法[49]取个性化模型和全局模型之间的插值不同,在SoftPull方法中,全局模型并不参与个性化模型的优化,而是取客户端K与其他客户端个性化模型的插值。这种新方法确保经过插值后的模型在某个明确的目标函数下达到最优。

4)LADD[34]

LADD在正式训练之前额外增加了预训练阶段,它的目的是为联邦语义分割提供一个足够鲁棒的初始化模型。为了提高预训练模型的泛化能力以应对不同客户端之间的域异质性,LADD在预训练阶段中首先应用风格迁移技术对中心服务器的数据进行数据增强[50],在不共享本地数据的条件下传递本地数据分布信息。Shenaj等人[34]认为相邻的城市在数据分布上呈现出一定的相似性,因此,在LADD通过K-means[51]算法和轮廓系数[52]确定簇的数量并将相同分布的客户端分为一簇。在训练过程中,每一簇都有一个对应的模型,模型参数最初与预训练模型相同并随着迭代不断更新。对于本地客户端的无标签数据,LADD通过计算L2范数确定与该图像风格最接近的簇,并使用对应簇的模型计算得到伪标签。为了防止确认偏见[53]问题,LADD结合知识蒸馏[54]和随机权重均值法[55],提出了一种新的损失函数作为正则项。

5)LC-Fed[37]

相比传统的联邦学习,LC-Fed的模型由两部分组成:一部分是可共享参数的主体网络Euclid Math OneMApr,该网络采用编码器-解码器架构,负责学习图像特征表示;另一部分是负责校正图像预测结果的不可共享网络Euclid Math OneMAph,负责对解码器复原的预测结果进行校正,使之更适应本地数据。具体来说,在Euclid Math OneMApr的最后一个编码器和解码器之间,LC-Fed设计并添加了个性化通道选择模块。该模块将不同客户端编码,为客户端嵌入向量,并与原有的输入特征结合后生成客户端增强向量。该向量可以表示在不同客户端中不同通道的重要程度,并据此修改原有的特征向量。在Euclid Math OneMAph中,模型首先确定多客户端预测结果不一致的区域,然后对该区域应用高斯滤波后与原始预测图结合,得到最终的预测结果。

2.2 类异质性

2.2.1 类异质性问题描述

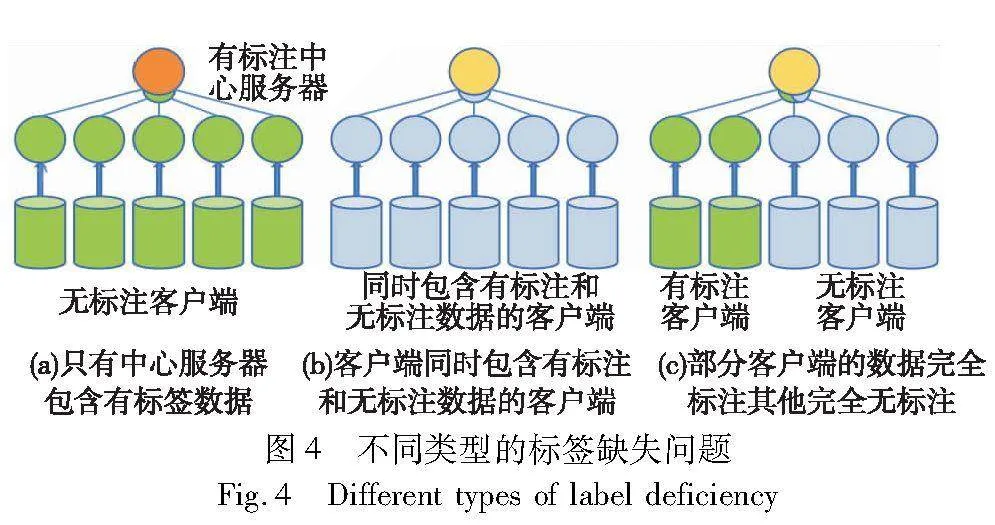

类异质性最早出自Miao等人[56]的研究,是指相同物体标注为不同类别。例如,在某些客户端中猫被归类到“背景”,而其他客户端则将其标注为“猫”。在这种情况下,有“猫”标注的本地客户端中,本地模型通常会向着“猫”的方向优化,从而忽略了其他类别。图3[56]展示了由类异质性引发的局部发散问题。

在文献[56]中虽然没有直接提及类异质性,但其所做工作本质上也是解决相同物体不同标签的问题。基于此,本文认为类异质性是指由于标注条件限制或标注标准不同所引发的同一物体不同标签的现象,即对应联邦学习中相同特征的不同标签。

2.2.2 模型实例

本文通过详细介绍FedSeg[56]和FedMix[57]两个经典模型,以此阐述现有研究方法如何解决类异质性问题。

1)FedSeg

FedSeg是Miao等人[56]首次提出的一种基线方法。该方法主要是针对前景类在不同客户端中被标注为背景类的问题。FedSeg首先调整了损失函数,在传统的交叉熵损失函数的基础上进行了修改,使之适用于修正局部优化。其次,FedSeg提出了一种新的局部到全局的对比学习方法。具体来说,在本地模型更新过程中,FedSeg同时提取本地模型和全局模型的像素表示。本地模型的像素表示向着全局模型中相同类别的全局像素表示靠拢,并远离不同语义类别的像素表示。通过这种方式使本地像素嵌入空间更加逼近全局像素嵌入空间。

2)FedMix

为了充分利用不同客户端上不同标注级别的数据,FedMix设计了伪标签生成与选择方法和用于联邦模型更新的自适应聚合方法。在伪标签生成与选择方法中,FedMix首先对于非像素级标注数据使用两个不同的无监督学习模型生成两个不同的伪标签Y1和Y2,然后结合原有数据的弱标签进行细化,生成最终的伪标签Y^1和Y^2。最后,FedMix通过比较Y^1与Y^2之间的Dice损失[58]是否大于设定的阈值,判定伪标签是否正确并丢弃不正确的伪标签。考虑到不同标注等级的数据对模型训练的影响不同,在联邦模型更新时,FedMix根据训练损失函数动态调整分配权重。该方法不但可以使模型优先从信息丰富的客户端中学习,还可以有效防止全局模型过拟合。

2.2.3 方法对比

尽管FedSeg与FedMix解决了类异质性的问题,但两者关注的地方并不相同。FedSeg关注于解决将部分前景归为背景的类异质性问题,而FedMix则关注解决不同标注等级的类异质性问题。从方法上看,FedSeg通过使用对比学习,拉进同一类之间的距离,推远不同类之间的距离,FedMix则首先使用无监督方法生成不同的伪标签,并使用不同标注等级的标签对伪标签进行调整。两种方法都是围绕着其关注的问题展开的研究。FedSeg使用对比学习,可以将相似物体的特征表示拉进,从而达到将其他客户端学习到的前景类迁移到本地客户端的效果。但是对比学习具有固定特征表示,即模型训练完成之后学习到的特定的特征表示不会继续发生改变。因此,在客户端不断增加数据或者有新的客户端加入的场景中,该方法无法满足训练需求。而FedMix需要首先生成一个伪标签,然后再根据不同标注等级的标签对伪标签进行校正,在这个过程中需要确保伪标签是可靠的。如果在伪标签生成阶段产生大量错误的伪标签,则会直接影响模型训练结果。

3 面向标签缺失的联邦语义分割研究

3.1 标签缺失问题定义

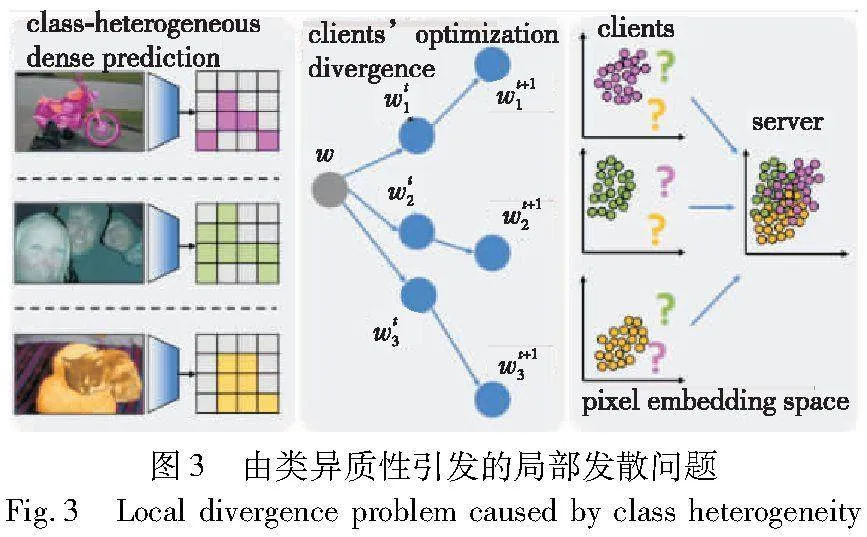

针对标签缺失问题,学界展开了广泛研究并依据不同应用场景对标签缺失问题进行分类。Li等人[59]将标签缺失问题分为三类。第一类[60,61]假设应用场景中只有中心服务器包含有标签数据,第二类[62]假设应用场景中客户端同时包含有标签和无标签数据,第三类[59,63]则假设应用场景中部分客户端具有全部有标签数据而另外的客户端则完全不具备有标签数据。图4分别展示了这三种不同的标签缺失情况。此外,文献[64]将前两种场景归为一类,将标签缺失问题分为客户端未拥有数据的全部标注和客户端拥有数据的全部标注两大类别。

3.2 技术路径

本文整理归纳了现有研究方法的技术路径及优缺点,如表2所示,主要可分为对比学习、伪标签法和半监督学习三类。

1)对比学习

对比学习[65,66]是一种自监督学习的机器学习策略。它通过最大化同一图像的不同变换视图的相似度,最小化不同图像的变换视图的相似度来进行学习。相比其他算法,对比学习能够在缺乏标注数据的情况下通过构建正负样本对进行学习,得到较好的分割模型。但是,如果客户端的数据样本呈现明显的类不平衡,对比学习可能出现样本选择不均匀的情况,将进一步影响模型性能。

2)半监督学习

半监督学习[67]旨在利用有限的有标签数据和大量的无标签数据训练一个性能良好的模型,是一种新的机器学习范式。由于训练过程中使用到了大量无标注数据,提高了模型的泛化能力和领域适应性。

3)伪标签法

伪标签法[53]是一种重要的无监督或半监督机器学习方法,它为无标签数据生成一个伪标签,并在伪标签的指导下训练模型,由于使用伪标签法生成的标签有可能是错误的,所以一般与正则化[68]方法同时使用。一致性正则化[68]是最常用的一种防止错误的伪标签产生的方法,它通过增加额外的正则项防止过拟合伪标签。

3.3 方法对比

观察表2可以发现,对比学习作为一种自监督学习策略,相对更为广泛地用于标签缺失问题。与半监督学习相比,对比学习在训练过程中并不需要标签,有标签数据主要在应用对比学习的模型训练完成之后对其进行微调,使之更加适应参与训练的数据。而在半监督学习中,一般情况下并不会直接应用无标签数据训练并使用有标签数据微调。

3.4 模型实例

1)FedMoCo[71]

FedMoCo是最早提出的面向医学图像的联邦对比学习框架之一,与Wu等人[69]的联邦对比学习框架同时发表在2021年的医学图像处理会议MICCAI上。该框架主要由两个模块组成,分别是元数据转换模块与自适应聚合模块。元数据转换模块主要起到一个数据增强的作用,在该模块中首先对客户端提取到的特征向量进行Box-Cox变换[75],然后计算变换后的特征均值与协方差并上传中心服务器,最后中心服务器将这些特征均值和协方差集合发送到各个客户端。自适应聚合模块是一种新的基于表征相似性分析进行模型聚合的方法,它首先计算上一轮全局模型与当前轮次本地模型预测结果的皮尔森相关系数[76],然后据此得到相异矩阵[77],并进一步计算斯皮尔曼等级相关性[78],最终依据斯皮尔曼等级相关性计算出模型的聚合权重矩阵。

2)FCL-VMIS[69]

Wu等人[69]同样在2021年的MICCAI上提出了一种面向医学图像分割的联邦对比学习框架,但遗憾的是,他们并没有给这种新框架起一个合适的名字。因此,为了便于描述,本文使用研究标题的首字母FCL-VMIS描述该框架。FCL-VMIS的训练过程可以分为两个阶段:第一阶段是预训练解读,使用联邦对比学习从无标签数据中训练一个可共享的全局编码器;第二阶段是微调阶段,使用预训练阶段得到的可共享编码器初始化本地客户端的U-Net模型,然后经过本地有监督学习或者有监督联邦学习得到适用于本地数据的个性化模型。

3)FCLOpt[70]

现有的联邦对比学习框架通常需要消耗大量的时间和资源进行客户端间的通信,这在移动设备等低算力平台上是不现实的。因此,FCLOpt在现有联邦对比学习框架的基础上结合BYOL[79]进行了修改,使之能够有效地部署到移动设备等低算力设备。具体而言,FCLOpt中的每个客户端有一对孪生网络,分别是在线网络和目标网络。在线网络与目标网络都拥有相同结构的编码器,但目标网络不具备预测器。在本地训练时,一幅图像经过两次增强生成不同的图像并分别作为在线网络和目标网络的输入。在线网络通过两个网络输出的对比损失更新自身模型参数,而目标网络则依据指数平均数进行更新。这种方法去除了负面样本的参与,极大地减轻了模型的通信压力。为了更进一步减少模型通信,Wu等人[70]又依次提出了预测目标网络更新(PTNU)和距离预测(DP),分别减少了下载和更新次数。

4 应用进展

联邦语义分割可以在不泄露数据隐私的情况下利用不同客户端的数据协同训练语义分割模型,使训练得到的语义分割模型相对利用单个客户端数据,具有更高的准确率和泛化能力,因此受到学术界和产业界的广泛关注。目前,联邦语义分割已经在医学图像分析[35]、自动驾驶[34]、工业控制[80]和遥感图像分割[39]等领域率先取得应用。

在医学图像分析领域,联邦语义分割被广泛用于各种病变组织的分割。例如:Mushtaq等人[17]应用联邦学习训练了一个用于肾脏肿瘤分割的语义分割模型,以发现肾脏中的肿瘤组织;Dong等人[71]应用联邦学习训练了一个语义分割模型,用于在CT图像上分割出COVID-19感染区域;Wang等人[36]则将其应用到了息肉组织分割。

在自动驾驶领域,使用联邦语义分割提升模型的鲁棒性以适应不同城市的自动驾驶任务,这具有重要研究价值。如Fantauzzo等人[28]应用联邦学习从不同客户端获取的数据中协同训练一个全局语义分割模型,有效缓解了自动驾驶任务中不同城市风格不一致的问题,有效提高了模型的泛化能力。

在工业控制领域,联邦语义分割可以用于监测工业制作流程。如Mehta等人[80]将联邦语义分割应用到增材制造过程中,借助联邦语义分割模型在增材制造中进行过程监测与控制,使增材制造过程更加可靠。

在遥感图像分割领域,Zhang等人[39]为了解决遥感图像训练数据不足、数据质量不高的问题,应用联邦语义分割在多个客户端之间协同训练分割模型,提高模型的分割效果。

5 研究展望

基于上述分析,本文认为以下方向在未来领域研究中值得关注:

a)面向数据异质性的联邦语义分割研究。

将现有基于深度学习的风格迁移方法应用到联邦语义分割中是未来值得关注的一个热点方向。针对数据异质性中的域异质性问题,部分学者提出使用风格迁移的方法在参与训练的客户端之间传递风格特征。使单客户端通过共享的风格特征对本地数据进行增强,得到具有不同风格的图像数据并用于本地模型训练,减轻域异质性带来的模型精度降低问题。但是,现有研究仍局限于手动提取特征的方法,如使用傅里叶变换将图像分为幅度图和相位图,并将无法复原图像数据的幅度图在参与训练的客户端中共享。而近几年,在风格迁移方面取得良好进展的深度学习方法并没有被用于联邦语义分割。将基于深度学习的风格迁移方法用于联邦语义分割能够更好地增强单客户端的图像数据多样性,从而缓解域异质性问题,对于提高联邦语义分割训练模型的精度具有重要意义。

在全局模型和个性化模型之间寻找一个平衡点是未来联邦语义分割亟待解决的问题。为弥补单一客户端数据量、数据多样性不足的问题,需要应用联邦学习在多客户端间协同训练语义分割模型。但是,由于不同域存在的物体类别不同,一个高性能全局模型在某些特定的域无法充分适应本地数据,以致分割效果不佳。如在南极的企鹅和在北极的海鸦由于外观相似,直接应用全局模型对采集到的图像或视频帧进行分割,容易将企鹅预测为海鸦。但同时,对于南北极共有的生物,如海豹、贼鸥与长须鲸等,个性化模型又需要充分利用不同域内的数据,以提高对共有类别的分割性能。当前研究只是将个性化联邦学习或簇联邦学习方法直接应用于联邦语义分割领域,而没有结合语义分割任务自身的特点,也没有充分考虑到全局模型和个性化模型性能之间的权衡。

b)面向标签缺失问题的联邦语义分割研究。

针对联邦语义分割中的标签缺失问题,部分学者为无标签数据生成伪标签并指导模型训练。但是,由于语义分割是一个像素级分类任务,且联邦学习过程中不同客户端之间通常呈现出数据异质性的特点,要求得到完全没有错误的伪标签几乎是不可能的。因此,避免模型训练受到错误伪标签影响是相关研究中需要解决的关键问题,尤其需要克服噪声标签对训练模型效果的制约。

6 结束语

联邦语义分割的出现打破了不同设备、不同组织之间的数据孤岛,缓解了当前基于深度学习的模型训练过程中数据量不足的问题。但同时联邦语义分割独特的分布式场景也使训练数据呈现出复杂多变的特性。因此,本文通过剖析复杂数据样本的特点,从数据异质性和标签缺失两个层面介绍联邦语义分割训练过程中遇到的问题,整理归纳了当前已有研究针对该问题所提出的方法,并横向比较了这些方法的优缺点。同时,本文系统整理了联邦语义分割在不同领域的应用成果,并分析了当前研究存在的局限性以及由其带来的潜在研究机会,以期为领域内相关研究提供借鉴和参考。

参考文献:

[1]Siam M,Gamal M,Abdel-Razek M,et al. A comparative study of real-time semantic segmentation for autonomous driving [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops.Piscataway,NJ: IEEE Press,2018.

[2]Yu Hongshan,Yang Zhengeng,Tan Lei,et al. Methods and datasets on semantic segmentation: a review [J]. Neurocomputing,2018,304: 82-103.

[3]田萱,王亮,丁琪. 基于深度学习的图像语义分割方法综述 [J]. 软件学报,2019,30(2): 440-468. (Tian Xuan,Wang Liang,Ding Qi. Review of image semantic segmentation based on deep learning [J]. Journal of Software,2019,30(2): 440-468.)

[4]Wang Li,Li Dong,Liu Han,et al. Cross-dataset collaborative learning for semantic segmentation in autonomous driving [EB/OL]. (2021-11-02). https://arxiv.org/abs/2103.11351.

[5]李顺新,吴桐. 面向自动驾驶的轻量级道路场景语义分割 [J]. 计算机工程与应用,2023,59(19): 177-183. (Li Shunxin,Wu Tong. Lightweight semantic segmentation of road scenes for autonomous driving [J]. Computer Engineering and Applications,2023,59(19): 177-183.)

[6]徐国保,麦锐滔,叶昌鑫,等. 用于自动驾驶的轻量级语义分割神经网络 [J]. 计算机工程与应用,2023,59(10): 328-334. (Xu Guobao,Mai Ruitao,Ye Changxin,et al. Lightweight semantic segmentation neural network for autonomous driving [J]. Computer Engineering and Applications,2023,59(10): 328-334.)

[7]Song Chunfeng,Huang Yan,Ouyang Wanlin,et al. Mask-guided con-trastive attention model for person re-identification [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2018: 1179-1188.

[8]Wang Kesai,Yao Xifan,Ma Nanfeng,et al. Real-time motion removal based on point correlations for RGB-D SLAM in indoor dynamic environments [J]. Neural Computing and Applications,2023,35(12): 8707-8722.

[9]徐风尧,王恒升. 移动机器人导航中的楼道场景语义分割 [J]. 计算机应用研究,2018,35(6): 1863-1866,1886. (Xu Fengyao,Wang Hengsheng. Semantic segmentation of corridor scene for mobile robot navigation [J]. Application Research of Computers,2018,35(6): 1863-1866,1886.)

[10]杨鹤,柏正尧. CoT-TransUNet: 轻量化的上下文Transformer医学图像分割网络 [J]. 计算机工程与应用,2023,59(3): 218-225. (Yang He,Bai Zhengyao. CoT-TransUNet: lightweight context Transformer medical image segmentation network [J]. Computer Engineering and Applications,2023,59(3): 218-225.)

[11]谷辛稼,陈一民. 基于U-Net的COVID-19病灶医学影像ZMINet分割模型 [J]. 计算机应用与软件,2023,40(8): 235-243. (Gu Xinjia,Chen Yimin. ZMINet: medical image segmentation model of COVID-19 lesions based on U-Net [J]. Computer Applications and Software,2023,40(8): 235-243.)

[12]罗圣钦,陈金怡,李洪均. 基于注意力机制的多尺度残差U-Net实现乳腺癌灶分割 [J]. 计算机应用,2022,42(3): 818-824. (Luo Shengqin,Chen Jinyi,Li Hongjun. Multiscale residual U-Net based on attention mechanism to realize breast cancer lesion segmentation [J]. Journal of Computer Applications,2022,42(3): 818-824.)

[13]Ma Xiaodong,Zhu Jia,Lin Zhihao,et al. A state-of-the-art survey on solving non-IID data in federated learning [J]. Future Generation Computer Systems,2022,135: 244-258.

[14]Li Li,Fan Yuxi,Tse M,et al. A review of applications in federated learning [J]. Computers & Industrial Engineering,2020,149: 106854.

[15]茆启凡,王亮亮,王子涵. 基于隐私保护联邦学习与区块链的图像分类方案 [J]. 计算机应用研究,2024,41(2):356-360. (Mao Qifan,Wang Liangliang,Wang Zihan. Image classification model based on federated learning and blockchain [J]. Application Research of Computers,2024,41(2):356-360.)

[16]Roth H R,Chang Ken,Singh P,et al. Federated learning for breast density classification: a real-world implementation [M]// Albarqouni S,Bakas S,Kamnitsas K,et al. Domain Adaptation and Representation Transfer,and Distributed and Collaborative Learning. Cham: Springer,2020: 181-191.

[17]Mushtaq E,Ding J,Avestimehr S. What if kidney tumor segmentation challenge (KiTS19) never happened [C]// Proc of the 21st IEEE International Conference on Machine Learning and Applications. Piscataway,NJ: IEEE Press,2022: 1740-1747.

[18]Li Qinbin,Diao Yiqun,Chen Quan,et al. Federated learning on non-IID data silos: an experimental study [C]// Proc of the 38th IEEE International Conference on Data Engineering. Piscataway,NJ: IEEE Press,2022: 965-978.

[19]Lu Jianfeng,Liu Haibo,Jia Riheng,et al. Toward personalized federated learning via group collaboration in IIoT [J]. IEEE Trans on Industrial Informatics,2023,19(8): 8923-8932.

[20]Achituve I,Shamsian A,Navon A,et al. Personalized federated lear-ning with Gaussian processes [C]// Advances in Neural Information Processing Systems. Red Hook,NY:Curran Associates Inc.,2021: 8392-8406.

[21]Tan A Z,Yu Han,Cui Lizhen,et al. Towards personalized federated learning [J]. IEEE Trans on Neural Networks and Learning Systems,2023,34(12): 9587-9603.

[22]Kulkarni V,Kulkarni M,Pant A. Survey of personalization techniques for federated learning [C]// Proc of the 4th World Conference on Smart Trends in Systems,Security and Sustainability. Piscataway,NJ: IEEE Press,2020: 794-797.

[23]颜明强,余鹏飞,李海燕,等. 语义风格一致的任意图像风格迁移 [J]. 计算机科学,2023,50(7): 129-136. (Yan Mingqiang,Yu Pengfei,Li Haiyan,et al. Arbitrary image style transfer with consistent semantic style [J]. Computer Science,2023,50(7): 129-136.)

[24]Gatys L A,Ecker A S,Bethge M. Image style transfer using convolutional neural networks [C]// Proc of IEEE Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2016: 2414-2423.

[25]Jing Yongcheng,Yang Yezhou,Feng Zunlei,et al. Neural style transfer: a review [J]. IEEE Trans on Visualization and Computer Graphics,2020,26(11): 3365-3385.

[26]杨玥,冯涛,梁虹,等. 融合交叉注意力机制的图像任意风格迁移 [J]. 计算机科学,2022,49(S1): 345-352,396. (Yang Yue,Feng Tao,Liang Hong,et al. Image arbitrary style transfer via criss-cross attention [J]. Computer Science,2022,49(S1): 345-352,396.)

[27]Yin Xu,Li Yan,Shin B S. Medical image processing with contextual style transfer [J]. Human-Centric Computing and Information Sciences,2020,10(1): 46.

[28]Fantauzzo L,Fanì E,Caldarola D,et al. FedDrive: generalizing fede-rated learning to semantic segmentation in autonomous driving [C]// Proc of IEEE/RSJ International Conference on Intelligent Robots and Systems. Piscataway,NJ: IEEE Press,2022: 11504-11511.

[29]Liu Quande,Chen Cheng,Qin Jing,et al. FedDG: federated domain generalization on medical image segmentation via episodic learning in continuous frequency space [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2021: 1013-1023.

[30]Ouyang Xiaomin,Xie Zhiyuan,Zhou Jiayu,et al. ClusterFL: a similarity-aware federated learning system for human activity recognition [C]// Proc of the 19th Annual International Conference on Mobile Systems,Applications,and Services. New York: ACM Press,2021: 54-66.

[31]Barron J T. A general and adaptive robust loss function [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2019: 4326-4334.

[32]Lim W Y B,Luong N C,Hoang D T,et al. Federated learning in mobile edge networks: a comprehensive survey [J]. IEEE Communications Surveys & Tutorials,2020,22(3): 2031-2063.

[33]Li Xiaoxiao,Jiang Meirui,Zhang Xiaofei,et al. FedBN: federated learning on non-IID features via local batch normalization [C]// Proc of International Conference on Learning Representations. 2021.

[34]Shenaj D,Fani E,Toldo M,et al. Learning across domains and devices: style-driven source-free domain adaptation in clustered federated learning [C]// Proc of IEEE/CVF Winter Conference on Applications of Computer Vision. Piscataway,NJ: IEEE Press,2023: 444-454.

[35]Jiang Meirui,Yang Hongzheng,Cheng Chen,et al. IOP-FL: inside-outside personalization for federated medical image segmentation [J]. IEEE Trans on Medical Imaging,2023,42(7): 2106-2117.

[36]Wang Jiacheng,Jin Yueming,Stoyanov D,et al. FedDP: dual persona-lization in federated medical image segmentation [J]. IEEE Trans on Medical Imaging,2024,43(1): 297-308.

[37]Wang Jiacheng,Jin Yueming,Wang Liansheng. Personalizing federated medical image segmentation via local calibration [C]// Proc of European Conference on Computer Vision. Cham: Springer,2022: 456-472.

[38]Xu An,Li Wenqi,Guo Pengfei,et al. Closing the generalization gap of cross-silo federated medical image segmentation [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Pisca-taway,NJ: IEEE Press,2022: 20834-20843.

[39]Zhang Boning,Zhang Xiaokang,Man-On P,et al. Prototype-based clustered federated learning for semantic segmentation of aerial images [C]// Proc of IEEE International Geoscience and Remote Sensing Symposium. Piscataway,NJ: IEEE Press,2022: 2227-2230.

[40]Dong Jiahua,Zhang Duzhen,Cong Yang,et al. Federated incremental semantic segmentation [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2023: 3934-3943.

[41]Guo Pengfei,Yang Dong,Hatamizadeh A,et al. Auto-FedRL:federated hyperparameter optimization for multi-institutional medical image segmentation [C]// Proc of European Conference on Computer Vision. Cham: Springer,2022: 437-455.

[42]Mnih V,Kavukcuoglu K,Silver D,et al. Playing Atari with deep reinforcement learning [EB/OL]. (2013-12-19). https://arxiv.org/abs/1312.5602.

[43]Andreux M,Du T J O,Beguier C,et al. Siloed federated learning for multi-centric histopathology datasets [M]// Albarqouni S,Bakas S,Kamnitsas K,et al. Domain Adaptation and Representation Transfer,and Distributed and Collaborative Learning. Cham: Springer,2020: 129-139.

[44]Wahab O A,Mourad A,Otrok H,et al. Federated machine learning: survey,multi-level classification,desirable criteria and future directions in communication and networking systems [J]. IEEE Communications Surveys & Tutorials,2021,23(2): 1342-1397.

[45]Kalb T,Beyerer J.Causes of catastrophic forgetting in class-incremental semantic segmentation [C]// Proc of Asian Conference on Computer Vision. Cham: Springer,2022: 361-377.

[46]Michieli U,Zanuttigh P.Continual semantic segmentation via repulsion-attraction of sparse and disentangled latent representations [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Re-cognition. Piscataway,NJ: IEEE Press,2021: 1114-1124.

[47]Douillard A,Chen Yifu,Dapogny A,et al. PLOP: learning without forgetting for continual semantic segmentation [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscata-way,NJ: IEEE Press,2021: 4039-4049.

[48]Brendan M,Eider M,Daniel R,et al. Communication-efficient lear-ning of deep networks from decentralized data [C]// Proc of the 20th International Conference on Artificial Intelligence and Statistics. [S.l.]: PMLR,2017: 1273-1282.

[49]Deng Yuyang,Kamani M M,Mahdavi M. Adaptive personalized federa-ted learning [EB/OL].(2020-03-30). https://doi.org/10.48550/arXiv.2003.13461.

[50]Yang Yanchao,Soatto S. FDA: Fourier domain adaptation for semantic segmentation [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2020: 4084-4094.

[51]MacQueen J. Some methods for classification and analysis of multivariate observations [C]// Proc of the 5th Berkeley Symposium on Mathematical Statistics and Probability. 1967: 281-297.

[52]Rousseeuw P J. Silhouettes: a graphical aid to the interpretation and validation of cluster analysis [J]. Journal of Computational and Applied Mathematics,1987,20: 53-65.

[53]Arazo E,Ortego D,Albert P,et al. Pseudo-labeling and confirmation bias in deep semi-supervised learning [C]// Proc of International Joint Conference on Neural Networks. Piscataway,NJ: IEEE Press,2020: 1-8.

[54]Hinton G,Vinyals O,Dean J. Distilling the knowledge in a neural network [EB/OL].(2015-03-09). https://doi.org/10.48550/arXiv.1503.02531.

[55]Izmailov P,Podoprikhin D,Garipov T,et al. Averaging weights leads to wider optima and better generalization [C]// Proc of the 34th Conference on Uncertainty in Artificial Intelligence. 2018: 876-885.

[56]Miao Jiaxu,Yang Zongxin,Fan Leilei,et al. FedSeg: class-heterogeneous federated learning for semantic segmentation [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2023: 8042-8052.

[57]Wicaksana J,Yan Zengqiang,Zhang Dong,et al. FedMix: mixed supervised federated learning for medical image segmentation [J]. IEEE Trans on Medical Imaging,2022,42(7): 1955-1968.

[58]Milletari F,Navab N,Ahmadi S A. V-Net: fully convolutional neural networks for volumetric medical image segmentation [C]// Proc of the 4th International Conference on 3D Vision. Piscataway,NJ: IEEE Press,2016: 565-571.

[59]Li Ming,Li Qingli,Wang Yan. Class balanced adaptive pseudo labeling for federated semi-supervised learning [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2023: 16292-16301.

[60]Jeong W,Yoon J,Yang E,et al. Federated semi-supervised learning with inter-client consistency & disjoint learning [C]// Proc of International Conference on Learning Representations. 2020.

[61]Yao Chunhan,Gong Boqing,Qi Hang,et al. Federated multi-target domain adaptation [C]// Proc of IEEE/CVF Winter Conference on Applications of Computer Vision. Piscataway,NJ: IEEE Press,2022: 1081-1090.

[62]Lin Haowen,Lou Jian,Xiong Li,et al. SemiFed: semi-supervised federated learning with consistency and pseudo-labeling[EB/OL]. (2021-08-21). https://arxiv.org/abs/2108.09412.

[63]Liu Quande,Yang Hongzheng,Dou Qi,et al. Federated semi-supervised medical image classification via inter-client relation matching [EB/OL]. (2021-06-16). https://arxiv.org/abs/2106.08600.

[64]Liang Xiaoxiao,Lin Yiqun,Fu Huazhu,et al. RSCFed: random sampling consensus federated semi-supervised learning [C]// Proc of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway,NJ: IEEE Press,2022: 10144-10153.

[65]Chen Ting,Kornblith S,Swersky K,et al. Big self-supervised models are strong semi-supervised learners [C]// Advances in Neural Information Processing Systems. Red Hook,NY:Curran Associates Inc.,2020: 22243-22255.

[66]Chen Ting,Kornblith S,Norouzi M,et al. A simple framework for contrastive learning of visual representations [C]// Proc of the 37th International Conference on Machine Learning. [S.l.]:PMLR,2020: 1597-1607.

[67]Yang Xiangli,Song Zixing,King I,et al. A survey on deep semi-supervised learning [J]. IEEE Trans on Knowledge and Data Engineering,2023,35(9): 8934-8954.

[68]Berthelot D,Carlini N,Cubuk E D,et al. ReMixMatch: semi-supervised learning with distribution matching and augmentation anchoring [C]// Proc of International Conference on Learning Representations. 2019.

[69]Wu Yawen,Zeng Dewen,Wang Zhepeng,et al. Federated contrastive learning for volumetric medical image segmentation [EB/OL]. (2022-04-23). http://doi.org/10.1007/978-3-030-87199-4_35.

[70]Wu Yawen,Zeng Dewen,Wang Zhepeng,et al. Distributed contrastive learning for medical image segmentation [J]. Medical Image Analysis,2022,81: 102564.

[71]Dong Nanqing,Voiculescu I. Federated contrastive learning for decentralized unlabeled medical images [EB/OL]. (2021-09-15). https://arxiv.org/abs/2109.07504.

[72]Yang Dong,Xu Ziyue,Li Wenqi,et al. Federated semi-supervised learning for COVID region segmentation in chest CT using multi-national data from China,Italy,Japan [J]. Medical Image Analysis,2021,70: 101992.

[73]Qiu Liang,Cheng Jierong,Gao Huxin,et al. Federated semi-supervised learning for medical image segmentation via pseudo-label denoi-sing [J]. IEEE Journal of Biomedical and Health Informatics,2023,27(10):4672-4683.

[74]Zhu Meilu,Chen Zhibo,Yuan Yixuan. FedDM: federated weakly supervised segmentation via annotation calibration and gradient de-conflicting [J]. IEEE Trans on Medical Imaging,2023,42(6): 1632-1643.

[75]Osborne J. Improving your data transformations: applying the box-cox transformation [J]. Practical Assessment,Research,and Evaluation,2010,15(1): 12.

[76]Lee R J,Nicewander W A. Thirteen ways to look at the correlation coefficient [J]. The American Statistician,1988,42(1): 59-66.

[77]Kriegeskorte N,Mur M,Bandettini P A. Representational similarity analysis-connecting the branches of systems neuroscience [J/OL]. Frontiers in Systems Neuroscience.(2008-11-24).https://doi.org/10.3389/neuro.06.004.2008

[78]Zar J H. Significance testing of the spearman rank correlation coefficient [J]. Journal of the American Statistical Association,1972,67(339): 578-580.

[79]Grill J B,Strub F,Altché F,et al. Bootstrap your own latent-a new approach to self-supervised learning [C]// Advances in Neural Information Processing Systems. Red Hook,NY :Curran Associates Inc.,2020: 21271-21284.

[80]Mehta M,Shao Chenhui. Federated learning-based semantic segmentation for pixel-wise defect detection in additive manufacturing [J]. Journal of Manufacturing Systems,2022,64: 197-210.