基于Camshift 方法的视觉目标跟踪技术综述

2024-07-24伍祥张晓荣潘涛朱文武

摘要:视觉目标跟踪技术是机器视觉、模式识别等相关领域中重要的研究内容之一。受限于场景的复杂度、目标速度、目标的遮挡程度等状况,其相关研究具有一定的难度和挑战性,而均值漂移及其相关算法是解决该类问题的重要途径。首先介绍视觉目标跟踪的研究方法和原理,然后介绍Camshift方法的前身Meanshift方法的原理和算法过程,并做出相应的分析和阐述。再介绍针对Camshift算法的相关研究和改进方法,最后总结Camshift方法的应用情况以及后续可能的研究方向。

关键词:机器视觉;模式识别;目标跟踪;Meanshift;Camshift

中图分类号:TP391 文献标识码:A

文章编号:1009-3044(2024)17-0011-04 开放科学(资源服务)标识码(OSID) :

0 引言

实现视觉目标跟踪可能的前置步骤包括目标分类、物体检测以及图像分割。目标分类是指根据目标在图像中呈现的特征,将不同类别的目标加以区分的图像处理方法。物体检测是指在某张图像中,检测出目标出现的位置、尺度以及其对应的类别。相较于目标分类,物体检测不仅需要指出其类别,还需返回该目标在图像中的物理坐标信息,其量化度得到了增强。而图像分割在物体检测的基础上提出了更加精细的要求,即不仅需要指出物体在图像中的坐标位置信息,还要标注出目标在图像中的精准轮廓,其难度和复杂度进一步提升。

上述技术在图像处理过程中,存在一些共性化的技术难点,比如尺度变化、部分遮挡等[1-2]。针对物体尺度变化,一种常规的方式是采用尺度不变特征变换(SIFT) 技术[3],通过尺度空间极值计算、关键点定位、方向和幅值计算以及关键点描述等步骤完成目标在尺度变化时的特征匹配。针对目标部分区域被遮挡的问题,Wang B等[4]提出了一种通过网络流优化的轨迹片段(tracklet) 关联中的在线目标特定度量来忽略目标被遮挡的时段,从而连续化目标运动轨迹;Fir⁃ouznia Marjan[5]提出了一种改进的粒子滤波方法,通过状态空间重构,在有遮挡的情况下提升目标跟踪的精度。

在图像中完成对目标的检测和标定之后,需要对连续的图像帧实现目标搜索,其代表方法有均值漂移(Meanshift) 方法[6]。然而,目标在视频流中处于非静止状态,这种非静止性可能导致其尺度、角度、形状等特征的改变,进而导致目标的丢失。基础的Camshift方法在一定程度上规避了目标尺度变化对跟踪效果的影响,但在环境因素复杂的场景中,其算法效果仍然得不到有效保证。

1 Meanshift 方法

Meanshift[7-8]方法是目标跟踪技术中目标搜索技术的经典算法之一,Comaniciu等[9-10]将其成果应用于特征分析领域之中,不仅如此,该方法也被广泛应用于图像等相关处理之中。

1.1 基本的Meanshift 算法

Meanshift 算法过程主要如下:在一个n 维空间中,假设有m 个样本点(设为p1, p2, p3……pm),其中有h个在设定的区域之内,则在点px处的Meanshift向量可表示为:M( px ) =1hΣi= 1h ( pi - px )。

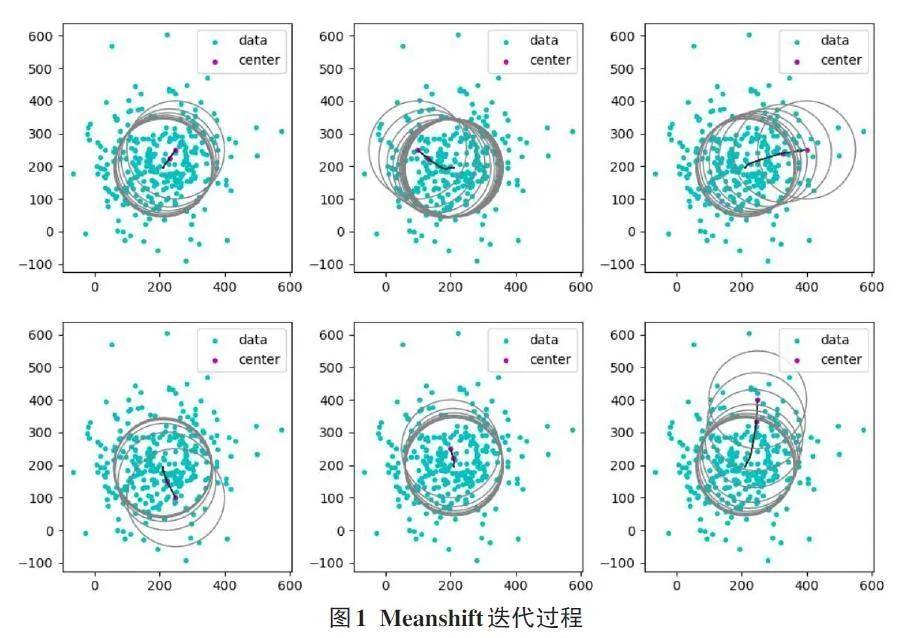

以二维坐标点为例,生成随机300个数据点,分别取不同坐标为质心,实验模拟6 次Meanshift 算法实现,其迭代过程如图1所示。

由图1可知,在数据点质心随机的情况下,当存在全局最优时,经过Meanshift算法,最后都将收敛至相同的最高密度区域。

1.2 Meanshift 算法应用

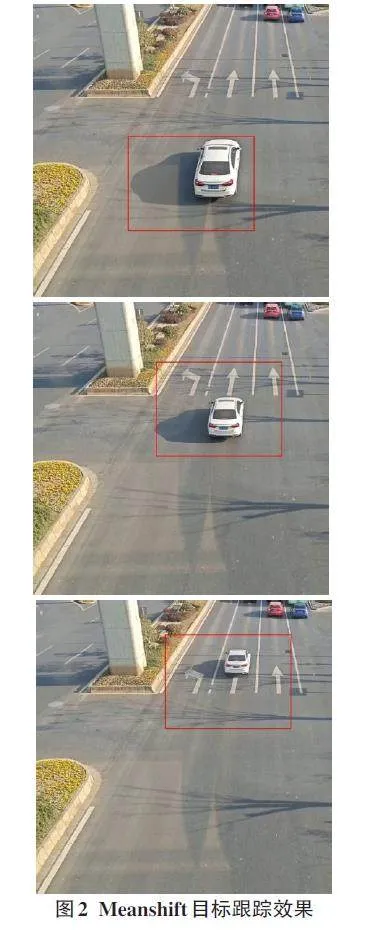

使用Meanshift算法跟踪标定图像目标,首先根据第一帧图像选取一个目标窗口,即目标物体区域的位置和尺度。然后计算该窗口内图像信息的直方图分布,并与后续帧进行相似性度量计算。最后,通过不断迭代视频流,寻找到新的目标位置并更新目标窗口位置[9]。通过构建实际运动场景模拟该方法的运行过程,图2显示了Meanshift方法在初始化目标窗口后的跟踪效果。通过抽取部分标注图像观测目标窗口的位置变化情况,可以看出目标窗口随着车辆的行驶其位置也随之改变。但在目标逐渐驶离区域时,其在整个场景中的面积占比变小,而跟踪窗口始终保持大小不变。

由图2可知,在场景光线较为充足的前提下,当人工选定搜索窗口后,Meanshift方法能有效地完成对搜索框内物体的跟踪。然而,由于搜索窗口尺度固定,在应对目标移速较快时,其外在表现形式往往达不到预期的效果。此外,如果区域存在多个高密度区域,最终可能会收敛至局部最优解,也将削弱其最终的标定结果。

基于此,各专家学者对Meanshift 算法进行了相应的研究和改进。针对Meanshift在距离度量上对集合数据和非线性数据的不可靠性,Qiangqiang C等[11]提出了基于邻域颗粒运算的颗粒向量相对距离和颗粒向量绝对距离,并在机器学习库(UCI) 上从内部度量和外部度量两个方面得到了较好的聚类效果。Park Hanhoon 等[12]针对Meanshift 在每次迭代产生较大计算量的缺点,提出了一种基于网格的Mean⁃shift++的改进方法,通过Hash降低存储冗余,再通过引入alpha 加速因子来减少迭代次数,提高收敛速度,使得其比传统的Meanshift++算法的平均速度提升了4 倍。Zou Yang 等[13]针对传统Meanshift 算法目标半径固定易在物体大小或形状变化时造成目标丢失的问题,提出了基于相似函数值的模糊机制,大大提升了跟踪效果。针对传统Meanshift 方法在背景受到干扰或遮挡的情况下,陈薇等[14]提出了一种结合Kalman 滤波的Meanshift改进算法,使其在复杂场景下仍能对目标进行有效的跟踪。Irene Anindaputri Iswanto 等[15] 针对传统Meanshift 及其衍生算法在跟踪任务中的低效和局限性,将Kalman滤波器、粒子滤波器以及Meanshift结合起来,并提取图像的直方图特征和纹理特征来提高其准确性,其实验效果较为理想。王广龙等[16]融合五帧差分法,在目标遮挡问题中,结合边缘轮廓特征,从而对传统的Meanshift 方法进行了改进。

2 Camshift 方法

2.1 Camshift 方法原理

Camshift(Continuously Adaptive Meanshift) 方法是对Meanshift方法的改进,在继承Meanshift复杂度低、运算量小等优点的同时,克服了Meanshift方法搜索窗口固定等不足,使实际跟踪效果得到了显著提升。

该方法首先将捕获的图像转换为HSV空间,并以色调分量作为基础,提取其概率分布直方图,作为相似性度量的依据。然后,使用基础的Meanshift方法确定质心位置。在移动距离阈值的判定下,调整搜索窗口的位置和大小。

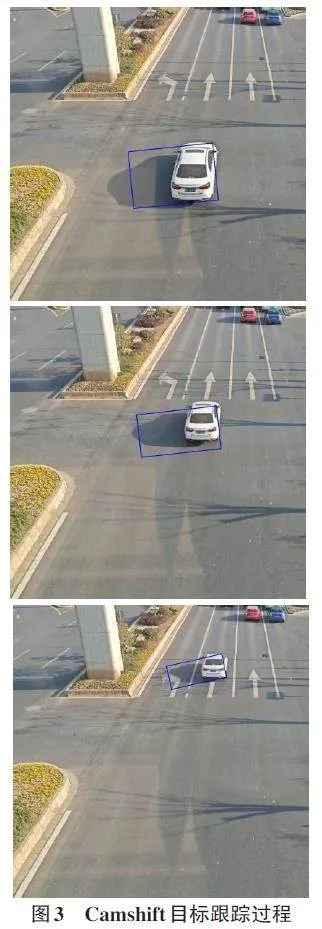

图3 展示了Camshift 方法对目标的跟踪过程截图。由图可见,随着目标面积占比的减小,搜索窗口的大小也随之缩小。

2.2 Camshift 改进算法

2.2.1 结合Kalman 滤波算法的改进算法

Camshift方法在搜索窗口自适应性上对Meanshift 方法进行了优化,但在目标受遮挡或背景干扰等情况下,跟踪效果仍受到较大影响。为此,通常引入Kal⁃man滤波方法来适应复杂场景和光照变化,通过观测数据输入输出,对系统状态进行最优估计。基于相邻帧图像的连续性和平滑性,Kalman滤波能预测后续时态的状态数据和误差信息,从而在一定程度上缓解遮挡问题等引起的干扰。

在此基础上,李建良等[17]针对传统Camshift方法在目标变速或颜色与背景接近的问题,提出了一种以目标色度、饱和度以及边缘幅值作为特征分量,结合Kalman滤波,并使用Bhattacharyya系数作为准确度判别的量化指标,从而实现复杂场景下的目标跟踪。Guan Weipeng等[18]提出了一种改进的Camshift方法,通过计算目标在帧间的像素坐标差值来估计目标位置,从而更加准确地完成对目标的跟踪。Pei Lili等[19]结合Accelerated-KAZE 特征匹配和Kalman 滤波,解决了背景干扰问题,实验分析表明其识别的有效帧率及图像识别速率均有显著提升。为了提高目标跟踪的抗遮挡能力,Liang Shuang等[20]在球类运动视频应用中,结合Kalman滤波,从目标检测、识别、轨迹和球员轨迹等方面改进方法,通过搜索窗口中确定遮挡因子并简化计算过程,实现了更加稳健的目标跟踪。

2.2.2 结合多特征融合的Camshift 改进算法

传统的Camshift方法主要依据HSV空间中的色调分量进行目标特征提取,但在背景复杂且目标本身与周围物体色调区分不明显的情况下,易丢失目标,影响最终的跟踪效果。为了解决这一问题,通常引入如纹理、边缘及相似度等特征与色调特征融合,综合确定目标。

基于特征融合的方式,党海鑫等[21]结合纹理、边缘特征,根据目标物体的尺度和概率密度,提升了目标跟踪的抗干扰性和稳定性,并在ROS系统中得到验证。段继光等[22]借助FPGA技术,提出了一种基于协方差的多特征融合策略,提升了Camshift方法对微小目标的跟踪效果。Du Sijie等[23]提取目标的HSV特征中的色调和饱和度双特征,并与LBP特征直方图相结合,提升了目标识别的精度,实验验证其实时性优于传统目标跟踪算法。

2.2.3 结合深度神经网络的改进算法

随着计算机硬件和算力的提升,人工智能技术在众多领域得到广泛应用,其中深度神经网络在图形图像,尤其是目标检测和跟踪中,相较于传统计算机视觉方法在精准度等方面有更好的识别效果。通过构建相应的神经网络结构,并引入卷积层来提取颜色、纹理、形状等特征,结合误差反向传播调整网络结构参数,经过若干次迭代,形成最优解,从而实现目标图像的识别。

基于上述方式,解梦达等[26]通过提取YCbCr空间中的蓝色色度分量和红色色度分量,构建Camshift颜色直方图,采用支持向量机建立肤色分割模型实现人脸跟踪,并使用拉依达准则判定异常,提升了跟踪准确度。Li Xiaofeng等[27]提出一种基于多智能体强化学习的移动机器人多模式滤波目标跟踪方法,通过机器人间状态通信建立强化学习模型,经过不断训练更新和纠正,有效实现实时目标跟踪。Saada M等[28]设计了一种基于动态贝叶斯网络的跟踪器,通过实时滤波方法预测下一帧位置,使用YOLOv5对象检测器评估对象检测对跟踪器性能的影响,并通过实验验证了其有效性。Shahbazi M等[29]基于递归神经网络的长短期记忆(LSTM) 结构,利用目标的外观特征和运动方式特征,构建新型运动跟踪模型,在低分辨率、快速运动、部分遮挡等情况下,能够实时有效地跟踪目标。

3 结束语

Camshift方法作为视觉目标跟踪技术的重要算法之一,凭借其低算法复杂度和强自适应性,广泛应用于交通运输、建筑、机械、船舶等实际场景中,同时也在运动学与体育学的教学实践中得到了体现。然而,Camshift方法在目标跟踪过程中存在稳定性不足的问题,特别是在特征边界模糊的情况下,如何更有效且均衡地利用特征融合以实现更高精度的跟踪,成为当前研究和实践中的重点和难点。

目前,随着硬件水平的发展,深度神经网络技术逐渐成为应用于目标跟踪的主流技术。但其算法的实施依赖于海量数据集的支撑。因此,将Camshift方法与深度神经网络进行更加有效的融合,一直以来都是研究的目标。

参考文献:

[1] 朱伟杰,朱洪军,伍祥,等.基于相关滤波技术的目标跟踪方法综述[J].信息工程大学学报,2019,20(6):684-688.

[2] WU Y,LIM J,YANG M H.Online object tracking:a benchmark[C]//2013 IEEE Conference on Computer Vision and PatternRecognition.Portland,OR,USA.IEEE,2013:2411-2418.

[3] LOWE D G.Object recognition from local scale-invariant fea⁃tures[C]//Proceedings of the Seventh IEEE International Confer⁃ence on Computer Vision.Kerkyra,Greece.IEEE,1999:1150-1157.

[4] WANG B,WANG G,CHAN K L,et al.Tracklet association withonline target-specific metric learning[C]//2014 IEEE Confer⁃ence on Computer Vision and Pattern Recognition.Columbus,OH,USA.IEEE,2014:1234-1241.

[5] FIROUZNIA M,KOUPAEI J A,FAEZ K,et al.Adaptive chaoticsampling particle filter to handle occlusion and fast motion invisual object tracking[J]. Digital Signal Processing, 2023, 134:103933.

[6] 闵志方,杜虎,朱雪琼,等.单目标跟踪研究综述[J].光学与光电技术,2023,21(4):1-14.

[7] FUKUNAGA K,HOSTETLER L.The estimation of the gradientof a density function,with applications in pattern recognition[J].IEEE Transactions on Information Theory,1975,21(1):32-40.

[8] CHENG Y Z.Mean shift,mode seeking,and clustering[J].IEEETransactions on Pattern Analysis and Machine Intelligence,1995,17(8):790-799.

[9] COMANICIU D,MEER P.Mean shift:a robust approach towardfeature space analysis[J].IEEE Transactions on Pattern Analy⁃sis and Machine Intelligence,2002,24(5):603-619.

[10] COMANICIU D, RAMESH V, MEER P. The variable band⁃width mean shift and data-driven scale selection[C]//Proceed⁃ings Eighth IEEE International Conference on Computer Vi⁃sion.ICCV.Vancouver,BC,Canada.IEEE,2001:438-445.

[11] CHEN Q Q,HE L J,DIAO Y N,et al.A novel neighborhoodgranular meanshift clustering algorithm[J].Mathematics,2022,11(1):207.

[12] PARK H.α-MeanShift++:improving MeanShift++ for imagesegmentation[J].IEEE Access,2021,9:131430-131439.

[13] ZOU Y,XIAO Z K,WANG Z. Research on improved meanshiftalgorithm based on fuzzy control principle[C]//MIPPR 2019:Pattern Recognition and Computer Vision. November 2-3,2019. Wuhan, China. SPIE, 2020: 1-6.

[14] 陈薇,袁文定,方强,等.基于自适应卡尔曼滤波的Meanshift 跟踪算法[J].制造业自动化,2021,43(6):16-20,48.

[15] ISWANTO I A,CHOA T W,LI B.Object tracking based onmeanshift and particle-kalman filter algorithm with multi fea⁃tures[J].Procedia Computer Science,2019,157:521-529.

[16] 王广龙,田杰,朱文杰,等.RGB-D与MeanShift相结合的实时目标跟踪[J]. 中南大学学报(自然科学版),2019,50(9):2163-2170.

[17] 李建良,张婷婷,陶知非,等.基于改进Camshift与Kalman滤波融合的领航车辆跟踪算法[J]. 电子测量与仪器学报,2021,35(6):131-139.

[18] GUAN W P,LIU Z P,WEN S S,et al.Visible light dynamic po⁃sitioning method using improved camshift-kalman algorithm[J].IEEE Photonics Journal,2019,11(6):7906922.

[19] PEI L L,ZHANG H,YANG B.Improved Camshift object track⁃ing algorithm in occluded scenes based on AKAZE and Kal⁃man[J].Multimedia Tools and Applications,2022,81(2):2145-2159.

[20] LIANG S,LI Y.Using camshift and Kalman algorithm to trajec⁃tory characteristic matching of basketball players[J].Complex⁃ity,2021,2021:4728814.

[21] 党海鑫,高嵩,曹凯,等.多特征自适应融合的CamShift算法与ROS 跟随小车实现[J]. 科学技术与工程,2021,21(10):4141-4147.

[22] 段继光,周玉宏.多特征融合和深度信念网络的红外弱小目标跟踪方法[J].激光杂志,2023,44(7):143-148.

[23] DU S J,XU H X,LI T P.Implementation of camshift targettracking algorithm based on hybrid filtering and multifeaturefusion[J].Journal of Sensors,2020:8846977.

[24] LECUN Y,KAVUKCUOGLU K,FARABET C.Convolutionalnetworks and applications in vision[C]//Proceedings of 2010IEEE International Symposium on Circuits and Systems.Paris,France.IEEE,2010:253-256.

[25] CHHETRI S, ALSADOON A, AL-DALA’IN T, et al. Deeplearning for vision-based fall detection system:enhanced opti⁃cal dynamic flow[J]. Computational Intelligence, 2021, 37(1):578-595.

[26] 解梦达,孙鹏,张志豪,等.类肤色背景下的人脸追踪改进算法[J].计算机工程与应用,2022,58(18):205-217.

[27] LI X F, REN J, LI Y B. Multi-mode filter target trackingmethod for mobile robot using multi-agent reinforcementlearning[J]f04054d45e6a1f437e6dd44b78ed6ed86abb8c695fcb980906d9aea4f6214a89.Engineering Applications of Artificial Intelligence,2024(127):107398.

[28] MOHAMAD S, CHRISTOS K, LI B H, et al. A multi-objecttracker using dynamic Bayesian networks and a residual neu⁃ral network based similarity estimator[J].Computer Vision andImage Understanding,2022(225):1-12.

[29] SHAHBAZI M,BAYAT M H,TARVIRDIZADEH B.A motionmodel based on recurrent neural networks for visual objecttracking[J].Image and Vision Computing,2022,126:104533.

【通联编辑:唐一东】

基金项目:安徽省教育厅科学研究项目资助: 基于深度学习的路面缺陷检测方法研究(2023AH052699) 、多模态数据驱动的工业互联网预知性维护决策技术研究(2022AH052367) ;芜湖市科技重点项目:工业机器视觉虚拟仿真教学装备平台关键技术研发及应用(2022yf65) ;安徽职业与成人教育重点研究项目:基于产教同频共振的工业互联网专业课教学质量提升研究(AZCJ2023028)