“AI 教母”李飞飞“AI越强大,我们越要珍视人性”

2024-06-03徐梅

徐梅

斯坦福大学以人为本AI研究院( 斯坦福HAI) 联合主任李飞飞和 约翰·埃奇门迪。图/视觉中国

“很多人都在写关于AI的内容,但你的经历是独一无二的。”约翰·埃奇门迪一开口,李飞飞就知道,自己在新冠大流行期间花了一年时间写出的关于AI科技史的书稿并未得到这位智者的认可。

2019年李飞飞在斯坦福大学建立以人为本AI研究院(以下简称“斯坦福HAI”)时,约翰出任联合主任,他曾担任斯坦福大学教务长,得益于他的鼎力支持,李飞飞设想的一个以鲜明的AI价值观为核心的跨学科研究机构得以顺利落地。当美国科技大厂的AI研究投入已经超过研发原子弹的曼哈顿计划甚至登月计划而成为一项特权、越来越被大型科技企业掌控时,斯坦福HAI不断向政府和公众发出公正、专业的警示之声。

李飞飞说她当时感到有些沮丧,但约翰关于书稿修改的建议令她无法拒绝,这本名为《我看见的世界》的传记最终以双线交织的结构呈现,一条线索是青年科学家在AI研究领域的好奇、探索与发现,另一条线索则是一个移民少女成长为世界级科学家的曲折历程。

约翰坚信,在人工智能这个“男山男海”的世界里,15岁才从中国移民到美国的女性科学家李飞飞是不被看见或者说“不被听见”的少数人群的最佳代表——曾经长期被贫困和第二语言困在命运浓雾之中的亚裔女性、洗衣房店主的女儿,初到美国时,连计算器都只能从车库的二手市场购买;持守对科学真知的热爱,耐住贫寒一路读到博士毕业成为一名“青椒”,仍然摆脱不了生活压力和职业晋升的双重挤压。

直到2009年33岁的青年助理教授李飞飞和自己的学生一起完成了ImageNet(美国斯坦福大学的计算机科学家模拟人类的识别系统建立的目前世界上最大的图像识别数据库),将史上最大的一个图像数据集投向冰封的人工智能世界,沉寂许久的神经网络算法AlexNet吃下这个大数据,电脑显示出与人类接近的识别能力,人工智能研究就此结束寒冬。她也因为让计算机“看见世界”而被世界看到,美国著名科技媒体《连线》杂志称,李飞飞是对AI飞跃式发展具有突出贡献的少数科学家之一,“这些人非常少,以至于厨房里的一张餐桌就可以坐下。”

约翰坚信李飞飞的书里不应该只有AI,当AI走出实验室,成为一个深刻影响全社会的技术,每个人都需要知道自己在AI中的位置,也有权利发出声音,“这些人可能包括移民、年轻女性以及来自不同背景的人们,他们并不一定是典型的硅谷AI从业者。如果你能为他们提供一个发声的平台,你的书将会更具影响力。”

这本书在2023年底推出英文版后,备受好评,中文简体版也于2024年4月底出版发行。评论家认为她开口讲述的宝贵之处不仅在于对AI和智能研究的深刻洞察,更在于她以自己真实的人生经历,做了一个关于“人类力量和可能性的美好见证”。

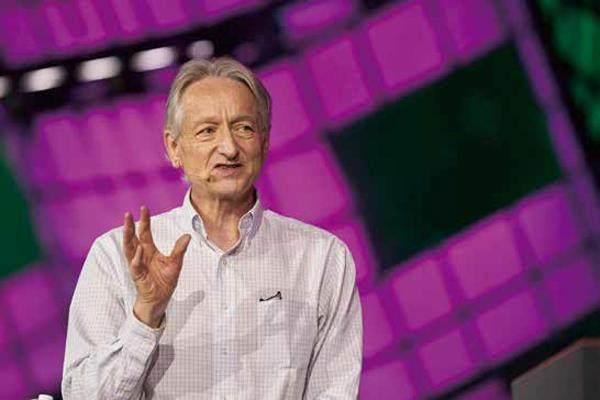

当李飞飞书中的两条故事线交汇于“人性”和人文关怀时,常为AI可能毁灭人类忧心的“深度学习三教父”之一的辛顿教授说,“在当前历史的关键时刻,我们急需这样的声音。”

“你是一个什么样的科学家?”

“飞飞,你到底是做什么的?”

“什么?”李飞飞把视线从膝盖上的笔记本电脑转到病床上刚刚醒来的母亲,母亲的这个问题实在奇怪,她忍不住大笑了起来。

这是2013年的夏天,过去的二十多年里,她已经记不清有多少次,父亲突然告诉她,“你妈妈病了!你在哪里?”

从高中开始,她就必须陪同父母一起去医院,充当母亲和医生之间的翻译,一路走来,身为独女的她曾在母亲的病床边写作业、考试、写论文、改学生的论文……

“照顾母亲的健康已经成了我的第二职业,”李飞飞写到日常生活的时候,有小说家一般的精准生动,“每当手机屏幕上显示母亲的名字,我就感到自己的心在下沉。无论生活把我带向何方,我都觉得自己永远处于一种脆弱的状态。”

多年求医,她将病患和家属的痛苦定格为几个画面——“酸痛的双脚、走破的网球鞋、休息室里冷冷的披萨。”这几幅画面如果放在她创立的ImageNet里,可以做一个简单明了的静物标注,只是人不用看画面,只读一遍文字就会产生深刻的共鸣,而机器无心,不知道那几个形容词里有多少心灵的焦灼。

“媽妈,你问我是在做什么?是问我靠什么赚钱吗?”

“我知道你是科学家,但这么多年,我们都没有讨论过你是哪种科学家。”

这个最初看起来有点滑稽的瞬间,李飞飞后来每一回想就心生一种“崇敬之情”。一直以来,她都将科学家和照顾慢性病人的两个角色区分得泾渭分明,妈妈的随口一问,以及听到她关于人工智能研究的阐释后追问的那一句“飞飞,人工智能还能做哪些事来帮助别人呢?”让她意识到AI不是科学家满足好奇心的研究对象,如果连穿着病号服的母亲都渴望了解更多,像她这样的人工智能科学家就有了更大的使命感。

李飞飞说,是这些让她在AI还未成为产业热点和社会痛点的时候,就成了一名具有鲜明价值立场的“AI人本主义者”——“人工智能在医院里能做什么?我不禁想问,在医院这个我们度过了如此多时光的地方,是不是有最需要被讲述的故事?”

与母亲在病房里讨论人工智能之后的几个月里,李飞飞一直在思考如何把AI与病人护理结合起来。她认识了医疗领域的传奇人物阿尼博士,阿尼告诉她,仅仅是因为医护人员的看护疏忽,就导致美国每年有10万病患意外死亡。

他希望李飞飞能够将AI带入已经开始的远程医院监控技术中。他们将减少院内感染的大问题逐步分析聚焦,发现只要通过监控并提示医护人员按照要求“洗手”,仅这一个细节的改善就可以大大预防住院病人的意外感染。

这是李飞飞“环境智能”研究的开始,最初她以为这只是一个技术问题。当她将AI技术带出实验室后,通过这个小小的介入,她得以触碰到AI技术在现实场景下衍生出的惊人的复杂性:刚性技术监控撞上复杂的医患心理,最新技术与既有医疗伦理如何兼容,世界充满细节,细节令人敬畏。

第一位同意她和研究团队进入诊疗空间的医师告诉她,在见到她之前,他很讨厌那些关于AI要取代人的论调,“飞飞,我喜欢你,因为你总说,AI是为了帮助人。”护士则悄悄告诉她,她们很不喜欢这种机器监控,称之为“老板监控”。 而李飞飞的母亲在一次病后恢复中,因为女儿和某个小仪器的双重监督,感到自己只是被要求而不是被关爱,“连你都在管我!”老人家以不合作的方式表达了无声的抗议,“哪怕你是为我好,但那个时候你们让我感觉自己失去了尊严,就连生命也不值得我去争取了。”

“场景越混乱,就需要越长的时间才能理解。”李飞飞的感触有时候是针对机器学习,有时候是针对包括自己在内的AI科学家。事实上,对于人工智能如何帮助人?什么是人真正需要的帮助?很多时候,就连科学家群体也不清楚最重要的问题是什么,它曾经被视为一个单纯的技术问题,而现在,技术介入具体场景的伦理问题以及对人之为人的认识才是最大的挑战。

常年陪同母亲就医、住院,李飞飞知道一个当班护士一天要在病房走6到8公里。当一个脚底酸痛的护士一边手法娴熟地为母亲调整静脉注射的针管,一边还能用温柔的言语和眼神给予患者理解、尊重和同情时,她总会情不自禁地泪目,“我本该记录一些机械且容易量化的东西,但我无法将视线从医护人员身上挪开。”

她由衷感谢过往无数次出入医院时在急诊室、ICU遇到过的医护人员,“一个好医生是信息的总汇、力量的源泉,有时甚至是病人及其家属在痛苦时刻的精神支柱。AI肯定不是为了取代这样的人!”

满足人的需要、增强人的能力、赋予人尊严,她渐渐清晰自己是“哪一种科学家”,不是她父亲开玩笑的“疯狂科学家”,而是一个以人性为中心的科学家,甚至是科学思想家。“我一直强调,我们不能忘记我们的人性和尊严。在这个机器日益普及的时代,我们更要珍视彼此的人性。这是我们独特的核心,也是我们构建和应用机器技术的出发点。”

800个GPU

2024年年初,李飞飞开始了自己的第二次学术休假。对于这位斯坦福大学明星科学家的动态,媒体极其关注,据悉她已经启动了一个关于空间智能的创业项目,但她本人对此次创业的具体内容却三缄其口。相反,她第一时间在社交媒体上推荐大家认真阅读斯坦福HAI在4月15日推出的《2024年人工智能指数报告》,“值得从头读到尾!”

斯坦福大学HAI研究中心的创立,与李飞飞的第一次学术休假密不可分。2016年她利用长达21个月的学术休假时间,第一次从大学走进大厂,担任了谷歌云的首席科学家。大厂的实地工作经历和观察让她对AI的未来发展充满担忧,她公开了自己的立场:“光是靠企业那些陈词滥调,绝对不足以让我们相信AI值得信赖。”

第一次学术休假结束后,她重返校园,发起成立了斯坦福以人为本智能研究院,研究院致力于三个方向的工作:推进和发展下一代 AI 科学(着重与脑科学和认知学交叉)、研究和预测 AI 对人类社会和生活的影响、设计和实践以人为本的 AI 技术和应用。斯坦福HAI倡导全球各地的学者、创新企业和非政府组织以及政府联手,“整个AI学科似乎是重新诞生了一次”,重生的目的是为了确保“AI领域不会永远被科技巨头,甚至我们这样的大学所垄断。”

斯坦福HAI推出的人工智能指数报告关注AI学科研究的透明度、行业及法规监管的及时性以及社会心理对这一超级技术的反应和变化。

最新推出的报告全面追踪了2023年全球人工智能的发展趋势。根据估算,最先进的AI模型的训练成本已经达到了前所未有的水平——OpenAI的GPT-4估计使用了价值7800万美元的计算资源,而谷歌的Gemini Ultra的计算成本则高达1.91亿美元。相比之下,几年前发布的一些RoBERTa Large(2019 年)和原始transformer模型(2017 年),训练成本分别约为16万美元和900美元。

2023年,以AI大厂为主的产业界一共发布了51个著名的機器学习模型,而学术界只贡献了15个。报告特别强调,当红炸子鸡LLM(大语言模型)在安全检测方面缺乏统一的标准化方法。包括OpenAI、谷歌和Anthropic在内的头部AI机构,都是依据不同的安全标准测试他们的模型,“这使得比较不同顶级LLM的风险和局限性的工作变得更加复杂。”

社会心理对AI的认识从新奇变为焦虑,2023年,美国52%的人表示对AI感到担忧多于兴奋,这一比例比 2022 年的 38% 有所上升。此外,超过三分之一的人对AI持悲观态度,认为自己的工作在5年内会被AI取代。

能给人稍稍带来安慰的是AI监管也在同步发展,《2024年人工智能指数报告》显示,2023年全球立法机构中有2175次提及人工智能,几乎是上一年的两倍。美国人工智能相关法规的数量在过去一年大幅增加,2023年有25项,比2022年增长了56.3%,而2016年只有1项。其中许多法规包括生成式人工智能所使用的素材及产出内容的版权规范指南和网络安全风险管理框架。

“AI正在成为一种特权!但AI应该是一种责任,从业人员除了专业技术,也必须懂得哲学、伦理学,甚至法律。”当公众开始畏惧AI的发展失控,当大厂CEO的狂妄达到新高度,当科技企业对劳动者公然流露出冷漠,李飞飞深知AI的发展之路充满复杂性,“若想取得真正的进展,需要抱着一份崇敬,硅谷在这点上似乎并不合格。”

被称为“深度学习之父”的科学家杰弗里·辛顿。图/视觉中国

2018年,当她得知谷歌的AI研究机构正在用800个GPU同时训练800个模型时(当时最新的英伟达GPU单个售价1000美元,已经贵到令人咋舌,今天最先进的GPU已经涨到3-4万美元一个),常年在预算线上挣扎的大学教授默默算了一下成本,“光这一项就砸进去将近百万美元啊!”她自己的实验室在当时东凑西凑咬牙买了10个GPU,而辛顿教授和学生们在2012年训练神经网络算法学习ImageNet时只用了两个GPU。

当AI进入大语言模型时代,现实更加残酷。“今天,美国已经没有任何一所大学能够独自训练出一个ChatGPT这样的模型。我们缺乏成千上万的GPU,更不用说像A100、H100甚至B200这样的高端设备了。”

2024年3月,在与英伟达首席科学家Bill Dally的对谈中,李飞飞再次明确阐释了自己的AI观,AI不应该成为少数人的特权,必须让每个人都参与其中——

我经常被问到一个问题,每次听到这个问题,我都深感触动。那就是,“我在AI中扮演什么角色?”提问的人不是计算机科学家,也不是斯坦福理科专业的毕业生,更没有从事软件工程的工作,甚至在一个没有电脑的家庭长大。他们可能喜欢跳舞,在为自己的社区服务,或者为一个半农村社区的各种人群服务。他们总是问我,“我们在AI中有什么角色?”因为AI似乎非常复杂,比如7000亿个参数,怎么可能理解呢?还有那些花哨的词汇,比如Transformers(利用注意力机制处理序列数据的神经网络架构)、生成式扩散等,都让人觉得遥不可及。

但我想说的是,AI只是一个工具。它确实需要一些数学和计算知识来实现,但最终,人类不仅是这个工具的创造者,更是决定如何使用它的决策者。我们是工具应用的创新者,也是它的使用者。我们还是选民,决定如何治理这个工具以及使用它的人。

AI蕴含着巨大的社会潜力。我特别希望那些热爱艺术、社区、法律、医学、化学等各个领域的年轻人,都能拥抱这项技术,并以一种负责任的态度去拥抱它。你们实际上有能力改变它,让它变得更好。这是我的呼吁:你们在AI中都有角色,请加入我们,一起让它变得更好。

“AI教母”保证布料不会缩水

因为将大模型带入AI研究,并令神经网络迸发出巨大的能量,李飞飞被尊称为人工智能“教母”,她的一位老朋友认为她对这个称谓肯定是不大接受的。

然而5月10日,在彭博Bloomberg Tech活动中,当彭博社记者在分享会现场问及看法时,李飞飞说,“我自己从未自称为任何事情的教母,当我被授予这个头衔时,我确实停下来思考了一下。我想,如果男性可以被称为某事的教父,那么女性也可以,所以我完全接受这个称号。”

当大数据、神经网络算法和超级图像处理芯片GPU三块拼图连在一起,AI自2012年开始一路狂飙,计算机科学世界山河变色,电脑迅速完成了“机器学习”、“深度学习”和“生成式AI”的跃迁。人工智能从一个实验室的专业词语,变成了老少皆知的热词儿,与它一同流行的还有“第四次工业革命”。

2019年,科学家杨立昆、杰弗里·辛顿、尤舒亚·本吉奥共同获得了计算机科学的最高奖项——ACM图灵奖(该奖项自1966年起每年颁发一次,以计算机之父艾伦·图灵的名字命名),这三位获奖者被称为“深度學习教父”。

“教父”辛顿为AI坐了30年学术冷板凳,当AI大热起来,名震天下的他开始后悔自己的研究,担心自己可能成为毁誉参半的原子弹科学家奥本海默。

2023年6月,他在北京智源大会闭幕式上发表演讲,认为比我们聪明的超级智能肯定能学会欺骗人类,“毕竟人类有那么多小说和政治文献可供学习。”

一旦超级智能学会了欺骗人类,它就能让人类去进行它想要的行为。辛顿举例说,如果某人想要入侵华盛顿的某栋大楼,他其实无需亲自前往,他只需要欺骗人们,让他们相信入侵这栋大楼是为了拯救民主。

他表示人类或许有一个优势,“尽管是相当小的优势。”“AI 不是进化而来的,而是人类创造的。这样一来,AI 就不具备原始人类那样的竞争性和攻击性目标。也许我们能够在创造 AI 的过程中为它们设定道德伦理原则。”

但辛顿说他从没见过智能水平更高的东西被智能水平远远更低的东西控制的案例,“我觉得这非常可怕。”“深度学习之父”76岁了,他的悲观溢于言表,“现在,我看不到该怎么防止这种情况发生,我已经老了。”

对AI越过奇点超越人类表示高度不安的AI科学家不止辛顿。日前,OpenAI首席科学家伊莱亚·苏孜克维正式宣布离开了这家头部AI机构,他在ChatGPT的训练中究竟看到了什么惊人的内容,至今还未公之于众。伊莱亚曾师从辛顿,在神经网络算法重焕生机上起了重要作用。

2023年10月辛顿与李飞飞在多伦多大学的现场对谈时,主持人问他俩,AI究竟有没有跨越那道红线,“人工智能是不是已经具备了人一样的智能?”

辛顿说“Yes!”

“NO!”李飞飞马上反对。

当“深度学习之父”几乎要弃养AI时,“AI教母”李飞飞决定要将AI和使用AI的人引导到正确的道路上。李飞飞坚持认为决定AI与人类未来的,不是技术,而是人,“仅仅坐而论道是不够的,我们需要承担起集体责任。我们肩负着教育下一代技术人才的使命,不仅仅是教会他们如何编写AI代码,更要培养他们具备AI的伦理框架和社会影响的认识。”

“我并不是盲目乐观,因为我深知这个世界的复杂性和混乱,特别是对于年轻人来说。有时,这个世界甚至给人一种反乌托邦的感觉。然而,如果我们回顾人类文明的发展历程,它是一个漫长而曲折的过程,但总体上是在朝着正义、希望和仁慈的方向前进的,前提是我们能够正确使用技术。”

2024年5月9日,美国加州,李飞飞( 右) 在彭博技术峰会上与主持人对谈。图/视觉中国

较之出身于学术世家的辛顿,李飞飞身上有一种底层奋斗者的复杂、深刻和柔韧,恰如她在书中写到的,“我不只是个有学术热忱的书呆子,多年的磨难锤炼我,让我斗志昂扬,这是与我同辈的人少见的,加上务实的本领,使我与众不同。”

她靠车库拍卖的二手物品念完了高中,靠奖学金上了普林斯顿,在接受科学训练的同时,还要长期应对复杂艰困局面的操练。在加州实验室中她听到电脑风扇呼呼作响,“心中雪亮”,为自己找到了一生的智识归属而心生幸福。如果有人担心她因为跻身著名实验室而骄傲自大,“看到这一幕就不会这么想了”,因为她时常接到母亲从新泽西洗衣店打来的长途电话,“鲁索太太您好,我是店主的女儿,对,您放心,我了解了,我会跟我母亲说清楚您这个特殊布料的干洗注意事项,保证洗完不会缩水……”

她认为自己与其说是在研究机器,不如说是在研究人类心智的产生,“ImageNet不仅仅是一个数据集,甚至也不仅仅是一个视觉类别的层次结构。它是一个假设、一个赌注,它受到我们自身生物学起源的启发,即实现真正机器智能的第一步,是沉浸在完整的视觉世界中。”

她深信,人作为机器学习和模仿的对象,有机器永远无法替代的能力和价值,“工作的本质远不止于执行任务。如果我们将工作定义为创造力、独特性、意图、同理心、情感联系以及对他人或社会的独特贡献,那么这些方面是人类独有的,且无法被完全替代。”

作为两个孩子的母亲,她要竭尽所能保证AI的胜利不能只是科学的胜利,而必须是人文的胜利,包括她自己在内的科学家有责任将AI训练为“遵循优良的学术传统,愿意协作,尊重他人的意见与专业的机器”。

“(AI)可以辅助人们更好地完成工作,但它们永远无法取代我们作为人类的核心价值。”李飞飞坚信,真正的创造力和人类智慧是无法被训练的。“独特的创造力和不确定性是人类社会的宝贵财富。无论我们如何训练机器,它们都无法复制人类的智慧和创造力。我自己的孩子,他们的独特性、智慧和幽默感,是無法被任何机器替代的。这是人类的核心价值,是机器永远无法剥夺的。”