基于视觉同时定位与地图构建的水下图像增强式视觉三维重建方法

2024-03-31梅杰覃嘉锐陈定方陈昆

梅杰 覃嘉锐 陈定方 陈昆

摘要 :针对仿生机器鱼水下作业时面临的水下图像质量偏低、水下自主定位难的问题,提出一种颜色均衡与G-B通道先验融合的水下图像增强式算法。将该算法和视觉同时定位与地图构建(SLAM)方法结合,实现了水下图像增强式的视觉三维重建。在不同水域环境下进行了水下图像处理实验、水下环境视觉三维重建实验和运动轨迹跟踪实验,结果表明该方法有效提高了水下图像综合质量,特征匹配效率提高了16.03%,真实轨迹与估计轨迹的误差平均约为7.99 mm。

关键词 :水下图像增强;三维重建;运动轨迹跟踪;视觉同时定位与地图构建(SLAM)

中图分类号 :TP391.4;X832;P283

DOI:10.3969/j.issn.1004-132X.2024.02.011

开放科学(资源服务)标识码(OSID):

SLAM-based Underwater Image Enhanced Visual 3D Reconstruction Method

MEI Jie 1,2,3 QIN Jiarui 1,2 CHEN Dingfang 2 CHEN Kun 1,2

1. School of Transportation and Logistics Engineering,Wuhan University of Technology,Wuhan,430063

2. Institute of Intelligent Manufacturing and Control,Wuhan University of Technology,Wuhan,430063

3.Key Laboratory of Port Cargo Handling Technology of Wuhan University of Technology,

Wuhan,43006

Abstract : Regarding with problems of low quality of underwater images and difficulty of underwater autonomous localization faced by bionic robotic fish in underwater operations, an enhanced underwater image algorithm with color equalization and a priori fusion of G-B channels was proposed. The algorithm was combined with visual SLAM construction methods to enhance visual 3D reconstruction of underwater images. Underwater image processing experiments, underwater environment visual 3D reconstruction experiments, and motion trajectory tracking experiments were carried out in different water environments. The results show that the method effectively improves the comprehensive quality of underwater images. The feature matching efficiency is improved by 16.03%, and the error between the real trajectory and the estimated trajectory is about 7.99 mm on average.

Key words : underwater image enhancement; 3D reconstruction; trajectory tracking; visual simultaneous localization and mapping(SLAM)

0 引言

自主式水下机器人是海洋资源勘探和开发的重要工具之一。仿生机器鱼模拟鱼类运动,具备噪声低、尾流小、灵活性高和控制简单等特点,近年已成为研究热点。机器鱼在水下的实时定位是否精确, 能否反映水下的真实情况,已成为衡量机器鱼价值的重要标准。算法缺陷导致水下定位精度较低,难以满足愈来愈严格的水下勘测、地图测绘等任务要求。视觉同时定位与地图构建 (simultaneous localization and mapping,SLAM)算法 [1] 是一种比较高效的方式。但水下环境复杂,水体对光的吸收及散射造成水下图像质量显著下降 [2] ,不利于视觉SLAM技术的前端处理,影响算法稳性。为解决这一问题,优化水下图像处理技术需结合到视觉SLAM算法中,以提高水下图像质量,改善地图构建的结果,提高机器人定位的准确性。

水下图像处理技术分为水下图像增强方法和水下图像复原方法。水下图像增强方法利用计算机图形学和数学变换的方法直接对图像进行增强处理,其中,具有代表性的方法有直方图均衡化 [3] (histogram equalization, HE)、自适应直方图均衡化 [4] (adaptive histogram equalization, AHE)和限制对比度自适应直方图均衡化 [5] (contrast constrained adaptive histogram equalization, CLAHE)。馬敏慧等 [6] 提出一种改进的带色彩恢复的多尺度视网膜与限制对比度自适应直方图均衡化多尺度融合的水下图像增强算法(multi-scale retinex with color restore contrast limited adaptive histogram equalization, MSRCR-CLAHE),以解决水下图像颜色衰退和对比度低的问题。李广豪等 [7] 提出一种改进的水下融合算法,将自适应伽马校正算法、MSRCR算法、CLAHE算法、锐化算法和水下图像融合增强算法相结合,降低了图像噪声,解决局部对比度增大造成的颜色失真问题。以上两种算法能在一定程度上提高图片的对比度,但图片锐化程度较高,图像局部边缘细节视觉效果差,颜色衰变问题仍有待解决。

水下图像复原方法通过计算物理成像过程中的模型参数,反向求解模型变量,最后获得复原的水下图像,其中,具有代表性的有基于维纳滤波器(Winener filter, WF)去噪的复原算法 [8] 和暗通道先验(dark channel prior,DCP)去雾算法 [9] 。直接将这些算法应用于水下图像增强,存在噪声大、颜色偏差和过度曝光的问题。龚万齐等 [10] 提出的改进水下暗通道先验方法有效解决了低照度水下图像颜色衰退的问题,但图像出现了雾化现象。 ZHOU等 [11] 提出一种新的中值水下暗通道先验(median underwater dark channel prior, MUDCP)去雾算法来精确估计蓝绿通道传输图, 该算法在图像局部对比度差距较小时增强效果较差。

上述方法仅对水下图像进行处理,对水下环境的视觉SLAM研究较少。LI等 [12] 提出的水下目标可视化三维重建系统由水下图像序列采集、水下图像预处理和三维重建组成,利用CO-LMAP+OpenMVS+Meshlab对水下图像序列进行重构,但该方法建图精度不足,平均误差达到3%。HUO等 [13] 提出一种基于雙目视觉的水下目标检测与三维重建系统来对系统视觉获取的图像序列进行去噪和色彩恢复。HOU等 [14] 提出了一种基于立体摄像机的水下实时三维重建系统,基于SLAM系统和密集点云融合拼接的方法来提高视差图的精度、实现多视图的点云拼接。

水下图像增强处理算法可提高水下地图构建质量 [15] ,但目前的水下图像算法没有考虑图像对比度、噪声、颜色偏差和雾化等问题的综合影响,导致水下图像处理效果不佳,水下地图构建精度误差较大。因此,为实现仿生机器鱼在水下环境的地图测绘和自身定位,需以视觉SLAM为基础框架,研究出一种结合水下图像增强算法的视觉三维重建方法。本文提出一种颜色均衡与G-B通道先验融合(the fusion of color balance and G-B channel prior, CB-GBCP)的水下图像增强算法,基于视觉SLAM实现水下地图三维重建。通过改进的关键帧跟踪实验验证了CB-GBCP算法对特征匹配环节优化的效果,基于标准数据集和测试数据集的建图实验验证了本方法在地图构建和定位上的可行性。

1 CB-GBCP图像增强算法

图像处理是各种视觉算法的基础和重要环节。水下环境的复杂性导致水下图像质量较低,存在亮度低、饱和度低、色彩偏差和白色雾化等问题。针对以上问题,提出CB-GBCP水下图像增强算法。

1.1 CB-GBCP算法总体方案

如图1所示,CB-GBCP算法主要有三个环节,即RGB颜色空间色彩均衡、G-B通道先验图像复原、Lab颜色空间直方图拉伸。通过该方案能够逐步消除水下图像的缺陷,综合提高图像的对比度、色彩、亮度和清晰度等属性质量。

RGB颜色空间色彩均衡主要通过计算图像红色(R)、绿色(G)和蓝色(B)通道值的比值,按比例调整通道值来消除色偏。水下图像的R通道值通常较小,因此在色彩均衡阶段仅需处理G、B通道。通过G、B通道的平均通道值 G av G、 G avB 计算放大系数 r G、 r B来抑制G、B通道值,再对图像整体的像素值进行拉伸,完成图像的色彩均衡。

首先将输入图像 Q 在RGB颜色空间中按照红色、绿色和蓝色进行通道分离,获得3个独立颜色通道值 Q R、 Q G和 Q B。然后计算水下图像绿色通道平均值:

G avG = 1 MN ∑ M i=1 ∑ N j=1 Q G (i,j) (1)

式中,MN为图像的像素总数。

再计算绿色通道的放大系数:

r G = 2G avG 255 (2)

最后计算色彩均衡后的绿色通道值:

Q′ G = Q G r G (3)

同理可得色彩均衡后的蓝绿颜色通道值 Q′ B 。 合并修正后的Q′ G 、Q′ B 和Q R ,完成 RGB 颜色空间内的色彩均衡处理,再对图像整体像素值进行拉伸,进一步提高均衡效果,得到最终的均衡图像,具体流程如图2所示。

在G、B通道先验图像复原环节中,对DCP去雾算法中的透射率与背景光的估算环节进行优化,采用引导滤波器对G、B通道内计算的传输图进行细化,最后实现图像的复原,如图3所示。

复原通道计算公式为

J c(x)= Q c-A c t c(x) +A c c= G,B (4)

其中,A c为环境背景光照强度;t c(x)为估计透射率;x为相机成像中某一位置的像素点。

为使水下图像的整体色调不变,并提高复原后图像的质量,先对图像进行颜色空间RGB到颜色空间Lab的转换,然后对亮度通道L和色彩通道a、b进行像素值自适应拉伸,在使亮度提高的同时色彩不会过度增强,最后达到提高复原图像亮度、减小色偏及增强对比度的目的。

首先进行RGB到Lab的颜色空间转换,并进行3个通道(亮度L、色彩a和b)的分离。对亮度通道L分量像素值进行自适应拉伸,对单个分量中的所有像素进行变换:

L′(i,j)=100 L(i,j)-L min L max -L min (5)

式中,L(i, j)、L′(i, j)分別为 L 通道中坐标为(i, j)处的像素值及拉伸后的像素值;L max 、L min 分别为 L 通道中像素的最大值和最小值。

对色彩通道 a 和色彩通道 b 的像素值分别进行自适应拉伸,遍历两个通道中的像素,对每个像素进行变换:

C′(i,j)=C(i,j)φ 1-|C(i,j)|/128 (6)

式中,C(i, j)、C′(i, j)分别为 a、b 分量中位于(i, j)处的像素原始值和对比度校正之后的值。

取指数函数对像素进行拉伸,φ=1.3。最后将对比度拉伸之后的 L、a和b 分量进行极限值限制和通道合并,如图4所示。

1.2 算法实验对比

为验证CB-GBCP算法在提高水下图像综合质量的可行性和有效性,对选取的一组水下图片(图5)进行实验分析,可以看出,原始图像的亮度和对比度较低,存在蓝色、绿色的色彩偏差与白色雾化现象。

图6 所示为不同算法处理后的结果,可以看出,HE算法处理后的图像对比度显著提高,但存在对比度过度增强、噪声增大和改变图像色调等问题;CLAHE算法处理后图像的对比度小幅度提高,图像基本色调保持不变,但存在蓝绿色偏和模糊等问题;DCP算法处理后,图像的白色雾化问题得到改善,提高了清晰度,但存在加剧色偏和亮度变低等问题;MSRCR-CLAHE算法处理后的图像对比度提高,但存在模糊、蓝绿色偏的问题;MUDCP算法处理后,对比度小幅度提高,但依然存在图片去雾效果不佳的问题; CB-GBCP算法处理后的图像在色彩得到有效均衡的同时,合理提高了图片对比度和亮度,改善了水下图像的白色雾化现象,输出图像具有清晰度高、对比度饱和、色彩偏差小且明亮的特点。

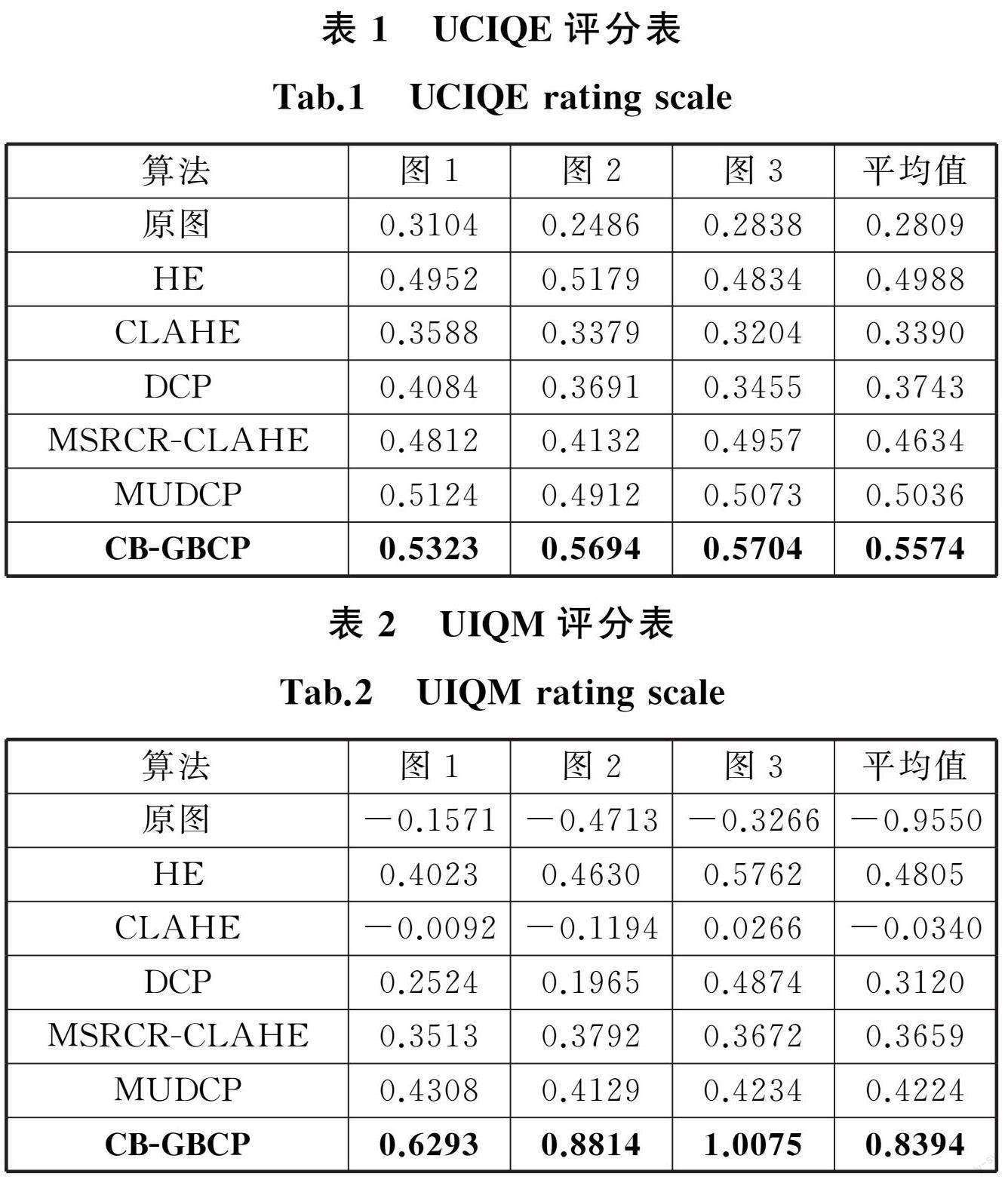

采用水下彩色图像质量评估(underwater color image quality evaluation, UCIQE)及水下图像质量度量(underwater image quality measurement,UIQM)的方法来对水下图像的质量进行计算与评价,结果如表1、表2所示。CB-GBCP 算法处理结果在 UCIQE 方法下的评分均值为 0.5574, 在 UIQM 方法下的评分均值为0.8394,均高于其他算法。

2 基于SLAM的水下视觉三维重建

2.1 水下视觉三维重建方法总体方案

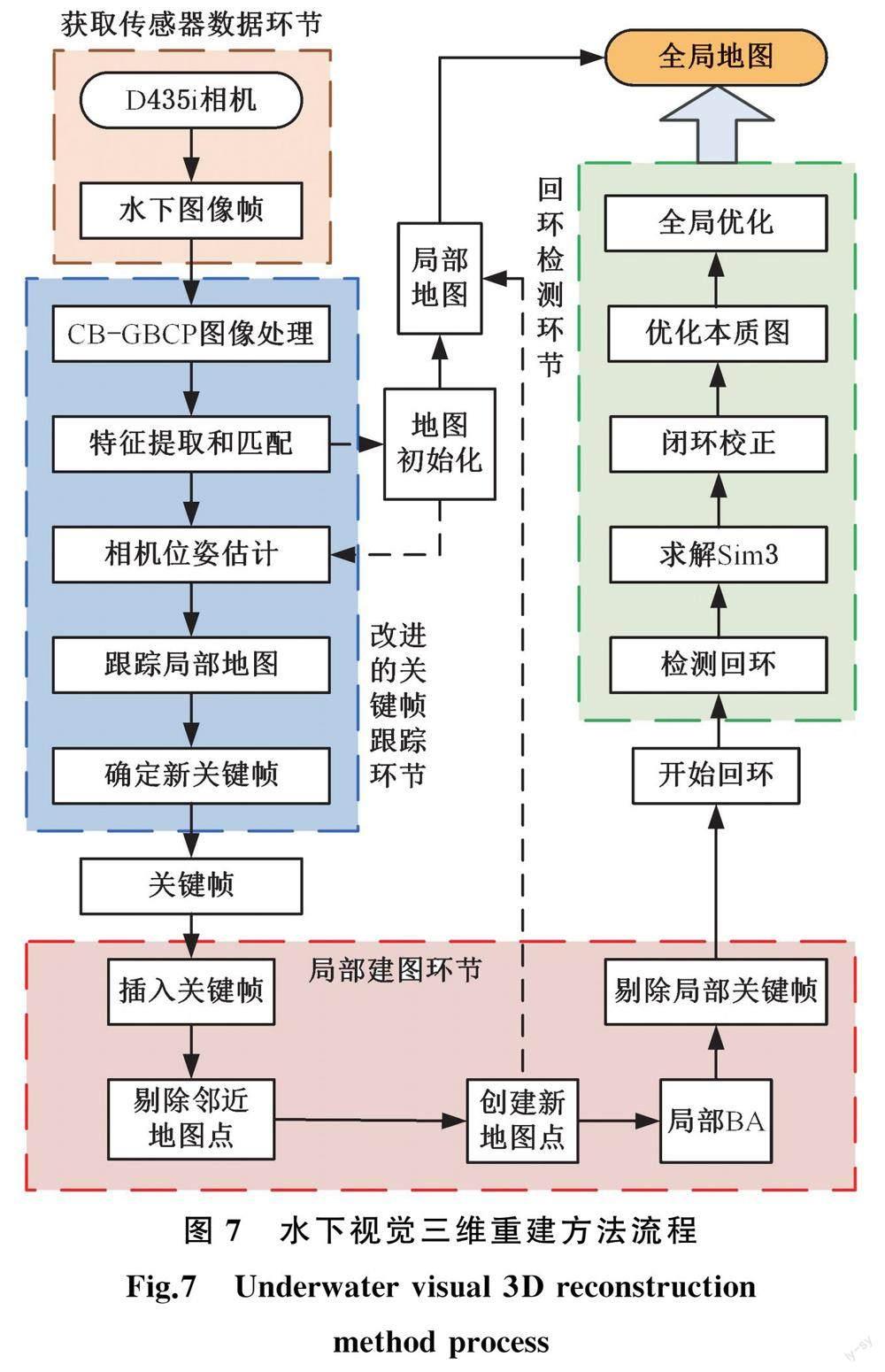

根据SLAM算法的数据传输和计算流程,将水下视觉三维重建方法分为获取传感器数据环节、改进的关键帧跟踪环节、局部建图环节和回环检测环节(分别对应SLAM系统的前端、后端和建图部分的内容)。结合CB-GBCP算法的水下视觉三维重建方法如图7所示。与orb-slam算法相比,CB-GBCP算法的区别如下:获取视觉传感器数据后,将获取的图片数据代入CB-GBCP算法进行图像处理,提高水下图像的质量、特征提取与匹配的效率;在改进的关键帧环节中,针对获取特征点较为困难的问题,采用尺度不变特征转换(scale-invariant feature transform,SIFT)算法提取特征点,并进行特征点匹配。相对于特征描述算法ORB(oriented FAST and rotated BRIEF),SIFT算法能进一步提高匹配的效率与质量,优化相机的位姿估计,提高相机在水下的定位精度;在局部建图环节中,三维点云存在平面投影位置偏差问题,SIFT可提高三维点云的配准,让点云匹配更准确,SIFT特征点匹配后,通过构建光束平差 (bundle adjustment,BA)问题来进一步减小重投影误差。

2.2 视觉三维重建各环节的实现方法

2.2.1 获取传感器数据环节

仿生机器鱼运动时,主机会控制搭载的相机采集环境数据并传输给后续模块。在控制机上采用OpenCV模块调用相机接口以采集图像信息,获取的图像数据包含图像的RGB信息和深度信息,将图像信息输入系统后,先将原始图像转换为灰度图,再将图像帧序列按顺序读取,并进入到下一环节——改进的关键帧跟踪环节。

2.2.2 改进的关键帧跟踪环节

根据处理后相邻帧之间的图像相似度进行特征提取和匹配,通过确认相邻帧图像的位置关系判断相机是否进入新的坐标位置,然后估计两帧之间的相机位姿变换关系,生成局部地图。改进的关键帧跟踪环节的流程如图8所示。

特征点提取环节采用 SIFT 算法进行特征点的提取,该算法计算精确,充分考虑了光照、尺度、旋转变换等因素对水下图像特征点提取数量与匹配效率的影响,具体提取与匹配流程如图9所示,图中,K=( max d+ min d)/2,d为特征点X t与X t+1 之间的距离。

相机的位姿估计与轨迹追踪主要由以下几个步骤完成:

(1) 相机位姿初次估计。相机位姿通过当前帧的图像特征点,基于EPnP算法的匹配过程实现初次估计。该方法首先对上一帧获取的数据进行初始化,定义匹配算法参数;然后利用已知的3D点获取对应的控制点; 再将已知的3D坐标在相机坐标系中投射成2D坐标,求解控制点在相机坐标系中的坐标;最后利用最近点迭代(iterative closest point,ICP)算法迭代求解初步的位姿。

(2)构建 BA问题。BA 问题指的是如何在视觉重建中得到最好的地图和相机位姿,即将相机的重投影误差最小化。通过计算化简得到误差 e 关于扰动量 δ ξ 和 p w i( p w i表示为空间点i的世界坐标系)的导数,优化两个导数来最小化误差以求解精确的位姿:

e δ ξ = e p c i p c i δ ξ =

f x Z′ i 0

0 f y Z′ i

- f xX′ i (Z′ i) 2 - f yY′ i (Z′ i) 2

- f xX′ Y′ i (Z′ i) 2 -f y- f y(Y′ i) 2 (Z′ i) 2

f x+ f x(X′ i) 2 (Z′ i) 2 f yX′ Y′ i (Z′ i) 2

- f xY′ Z′ i

f yX′ Z′ i T (7)

e p w i =- f x Z′ i 0 - f xX′ i (Z′ i) 2 0 f y Z′ i - f yY′ i (Z′ i) 2 R (8)

式中, p c i為点i在相机坐标系上的坐标, p c i=(X′ i,Y′ i, Z′ i) T ; f x、f y为将该点投影到归一化平面需要乘的系数; R 为点i的相机坐标与世界坐标的导数, R = p c i p w i 。

(3)g2o位姿优化。g2o位姿优化是将图像描述成由顶点和边构成的广义图像。相机的位姿也就是状态变量对应广义图像的顶点,位姿之间的变化关系对应广义图像的边,g2o位姿优化是将顶点和边之间的关系构建成最小二乘优化问题,进而组成一个广义上的超图,具体结构如图10所示。

2.2.3 局部建图环节

局部建图环节的作用是筛选出质量较好的地图点并筛选出对应的关键帧。通过三角化计算出新的地图点,将与新地图点重复的地图点剔除,然后将与当前关键帧相连的另一关键帧及其地图点做局部BA来进行优化。该环节的流程如图11所示。

针对水下地图构建时三维点云的配准问题,本文采用的方法如图12所示。该方法分为点云粗匹配与点云精匹配两个环节。点云粗匹配首先计算出每个特征点的法向量,然后检测并匹配空间中的SIFT关键点,之后采用随机采样一致性(random sample consensus,RANSAC) 算法去除点云中的错误匹配点。点云精匹配基于ICP算法对匹配结果进行进一步优化,最后用奇异分解(singular value decomposition , SVD)算法计算出最终的变换矩阵来完成点云的精匹配。

2.2.4 回环检测环节

相机的运动会导致位姿和地图点位置产生一定的误差 [16] 。误差累计过多会导致相机偏移,从而使地图构建失败,所以利用回环检测来消除误差,如图13所示,其中,Sim3求解进程是使用3对匹配点进行相似变换(similarity transformation) [17] 的求解,进而解出两个坐标系之间的旋转矩阵、平移向量和尺度。

3 基于SLAM水下图像增强算法的视觉三维重建实验

3.1 改进的关键帧跟踪实验

本小节实验的实施方案如图14所示。分别选取两组水下图像帧进行特征点提取与匹配实验,第一组图像帧不进行水下图像处理,直接进行特征提取与匹配,如图15所示,由此测出其提取的特征点数与匹配对数;第二组先对图像进行CB-GBCP图像处理,再来进行特征提取与匹配,如图16所示。

将两组实验数据进行对比,如表3所示,其中,括号内左右两个数值分别为左图和右图的特征点提取数量。由表3可知,CB-GBCP图像增强处理之后,提取的特征点数量与匹配点对数量明显增大。

为进一步验证算法的有效性,将各算法对两组图像帧进行处理之后提取的特征点数量与匹配对数进行对比,如表4所示,可看出,CB-GBCP算法在水下图像的特征点提取与特征点匹配上均好于其余算法。

各算法的匹配精度如表5所示,通过计算出不同算法分别在大于2、3、4、5个像素中的平均视觉误差。

相机的重投影误差计算可以通过固定标定板(图17a),移动相机使标定板位于不同位置、姿态下采集图像(图17b),从采集到的图像中选取12张图像作为输入图像,得出相机的外部参数,然后计算出相机的重投影误差。计算得双目重投影平均误差约为0.612,优于文献[20]的0.705。

3.2 实验室环境下的视觉三维重建

本小节根据相机在实验室环境录制的测试数据集进行视觉三维重建, 步骤如图18所示。首先对相机进行初始化, 获取相机节点后开启机器人操作系统 (robot operating system , ROS) 节点, 然后在ROS中启动数据集录制(rosbag record)功能录制数据集,最后在Rviz开启相应话题,保存数据集进行三维重建。实验环境为晴天,通过光照计测量得到室内光照强度为800-1000lux, 实验采用的设备为摄像头Intel REALSENSE D435i。 实验室环境测试数据集如图19所示。

将ROS中的节点切换成mono节点进行系统输入来完成实验室环境的三维点云重建。物体上的地图点虽然匹配正确,但基于这些特征点估计出的位姿是物体运动和相机运动的叠加,算法通过地图点筛选,剔除移动物体上的点,如图20所示,图中,有效地图点为红色,移动物体上被剔除的地图点为黑色,绿色方框为相机位置。

将ROS中的节点切换成rgbd节点进行系统输入,进而完成实验室测试数据集的视觉三维重建,建成的视觉三维地图还原效果清晰且符合原始色彩,如图21所示。

在使用相机进行实验室数据集的视觉三维重建过程中,跟踪相机的位姿如图22所示。

结合上述实验结果可知,在使用相机采集图像数据时,提出的方法能在实验室环境下完成三维地图的精确重建,并在建图的同时实现运动轨迹的跟踪。

3.3 户外水下环境的视觉三维重建

实验设备为搭载摄像头Intel Realsense D435i的仿生机器鱼,如图23所示;实验环境为晴天户外,光照计测量得到户外光照强度为 28 000—30 000lux, 水下水深2 m处的光照强度为16 800—19 000lux。

3.3.1 CB-GBCP算法优化的关键帧跟踪实验

图24为机器鱼在不同的水下环境采集到的代表性图像帧。对图24中的图像进行SIFT特征提取和匹配实验,结果如图25所示。

先采用CB-GBCP算法对机器鱼在两个水下环境采集到的图像进行增强处理,再进行SIFT特征提取和匹配实验,结果分别如图26、图27所示。

两组图像的特征匹配数量如表6所示,CB-GBCP算法增强后,户外水下图像特征提取和匹配的数量增多。

3.3.2 视觉三维重建实验与结果分析

针对仿生机器鱼获取的景观池塘和野外池塘的水下图像,在预处理后重建两个水下环境的三维地图,结果如图28、图29所示

图30为CB-GBCP算法优化生成的三维地图点云图。景观池塘重建地图中的地图点从 350 123 个增加到401 361个,野外池塘重建地图中的地图点从786 498个增加到923 598个,平均增幅约16.03%。

实验结果表明:本文设计的水下图像增强式视觉三维重建方法能提取更多的环境特征点,增加了重建點云的地图点,丰富了水下地图细节,实现了仿生机器鱼的水下环境感知和地图测绘。

3.3.3 运动轨迹跟踪实验

仿生机器鱼实验平台在完成水下视觉三维重建后,将计算的机器鱼运动轨迹提取出来,并在重建点云中实时显示。图31中的绿色轨迹为仿生机器鱼在水下运动的轨迹(通过算法估算的运动位姿转换而成)。仿生机器鱼实验平台估算的运动轨迹和真实的运动轨迹如图32所示。

在同一数据帧,即同一时刻的前提下,真实轨迹与预估轨迹的误差值随着数据帧的变化曲线如 图33所示。由表7可知,平均误差约为7.99 mm,真实轨迹的平均位置为1327.53 mm,所以平均误 差率为0.6%,在机器鱼定位的误差允许范围内。

文献[12-14]对水下物体进行了重建,并测出相机实际轨迹与预估轨迹的误差,它们与本文结果如表8所示。

实验结果表明:基于SLAM的水下图像增强式视觉三维重建方法完成了机器鱼的水下运动跟踪,轨迹误差在允许范围内并优于参考方法,能实现机器鱼的水下定位。

4 总结

(1)针对水下图像质量偏低的问题提出了CB-GBCP水下图像增强算法,实验证明所提算法在改善图像色偏,提高对比度、亮度和清晰度方面具有良好的效果。

(2)结合CB-GBCP算法提出了水下视觉三维重建方法的总体方案。改进的关键帧跟踪实验验证了CB-GBCP算法优化特征匹配进程的性能。实验室环境的视觉三维重建实验的地图重建结果和轨迹跟踪效果验证了所提方法在解决水下地图三维重建和仿生机器鱼定位的问题上具有一定的优越性。

(3)完成了水下图像增强式视觉三维重建实验。实验结果表明,CB-GBCP水下图像增强算法能有效提高水下图像的综合质量,并能提高特征匹配效率。

参考文献 :

[1] MACARIO BARROS A, MICHEL M, MOLINE Y, et al. A Comprehensive Survey of Visual Slam Algorithms[J]. Robotics, 2022, 11(1):24-51.

[2] WANG X, FAN X, SHI P, et al. An Overview of Key SLAM Technologies for Underwater Scenes[J]. Remote Sensing, 2023, 15(10):2496.

[3] RAO B S. Dynamic Histogram Equalization for Contrast Enhancement for Digital Images[J]. Applied Soft Computing, 2020, 89:106114.

[4] ULUTAS G, USTUBIOGLU B. Underwater Image Enhancement Using Contrast Limited Adaptive Histogram Equalization and Layered Difference Representation[J]. Multimedia Tools and Applications, 2021, 80:15067-15091.

[5] REZA A M. Realization of the Contrast Limited Adaptive Histogram Equalization(CLAHE) for real-time image enhancement[J]. Journal of VLSI Signal Processing Systems for Signal, Image and Video Technology, 2004, 38:35-44.

[6] 马敏慧,王红茹,王佳. 基于改进的MSRCR-CLAHE融合的水下图像增强算法[J]. 红外技术,2023,45(1):23-32.

MA Minhui, WANG Hongru, WANG Jia. Underwater Image Enhancement Algorithm Based on Improved MSRCR-CLAHE Fusion[J]. Infrared Technology, 2023, 45(1):23-32.

[7] 李广豪, 席志红. 基于图像融合的水下光照不均匀图像增强算法[J]. 计算机仿真,2023,40(4):330-335.

LI Guanghao, XI Zhihong. Underwater Illumination Inhomogeneity Image Enhancement Algorithm Based on Image Fusion[J]. Computer Simulation,2023,40(4):330-335.

[8] PETKOVA L, DRAGANOV I. Noise Adaptive Wiener Filtering of Images[C]∥2020 55th International Scientific Conference on Information, Communication and Energy Systems and Technologies (ICEST). Serbia, 2020:177-180.

[9] ANAN S, KHAN M I, KOWSAR M M S, et al. Image Defogging Framework Using Segmentation and the Dark Channel Prior[J]. Entropy, 2021, 23(3):285-312.

[10] 龔万齐,冯常. 基于改进暗通道的水下图像快速复原[J]. 计算机工程与设计,2022,43(7):2015-2021.

GONG Wanqi, FENG Chang. Rapid Underwater Image Restoration Based on Improved Dark Channel[J]. Computer Engineering and Design,2022,43(7):2015-2021.

[11] ZHOU J, LIU D, XIE X, et al. Underwater Image Restoration by Red Channel Compensation and Underwater Median Dark Channel Prior[J]. Applied Optics, 2022, 61(10):2915-2922.

[12] LI B, MA H, LI J. Design and Realization of Underwater Target Vision 3D Reconstruction System[C]∥2022 IEEE International Conference on Mechatronics and Automation (ICMA). Guilin, 2022:467-474.

[13] HUO G, WU Z, LI J, et al. Underwater Target Detection and 3D Reconstruction System Based on Binocular Vision[J]. Sensors, 2018, 18(10):3570-3601.

[14] HOU J, YE X. Real-time Underwater 3D Reconstruction Method Based on Stereo Camera[C]∥2022 IEEE International Conference on Mechatronics and Automation (ICMA). Guilin, 2022:1204-1209.

[15] 魏郭依哲, 陈思遥, 刘玉涛, 等. 水下图像增强和修复算法综述[J]. 计算机应用研究, 2021, 38(9):2561-2569.

WEI Guoyizhe, CHEN Siyao, LIU Yutao, et al. Survey of Underwater Image Enhancement and Restoration Algorithms[J]. Application Research of Computers, 2021, 38(9):2561-2569.

[16] 王霞, 左一凡. 视觉SLAM研究进展[J]. 智能系统学报, 2020, 15(5):825-834.

WANG Xia, ZUO Yifan. Research Progress on Visual SLAM[J]. Journal of Intelligent Systems, 2020, 15(5):825-834.

[17] 余卓平,鞠然,韩燕群,等. 融合车辆动力学的双目视觉惯性SLAM研究[J]. 华中科技大学学报(自然科学版),2022,50(11):85-89.

YU Zhuoping, JU Ran, HAN Yanqun, et al. Study on Binocular Vision Inertial SLAM Based on Vehicle Dynamics[J]. Journal of Huazhong University of Science and Technology (Natural Science Edition), 2022, 50(11):85-89.

[18] HIRSCHMULLER H. Accurate and Efficient Stereo Processing by Semi Global Matching and Mutual Information[C]∥Proc of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition. Washington DC, 2005:807-814.

[19] GEIGER A, ROSER M, URTASUN R. Efficient Large-scale Stereo Matching[C]∥Asian Conference on Computer Vision. Queenstown, 2010:25-38.

[20] 王子昂,李剛,刘秉琦,等. 超大视场长波红外立体视觉外部参数标定及内外参数评价[J]. 光谱学与光谱分析,2020,40(9):2670-2675.

WANG Ziang, LI Gang, LIU Bingqi. Calibration of External Parameters and Evaluation of Internal and External Parameters of Long-wave Infrared Stereo Vision with Large Field of View[J]. Spectroscopy and Spectral Analysis,2020,40(9):2670-2675.

( 编辑 张 洋 )

作者简介 :

梅 杰 ,男,1985年生,副教授。研究方向为微纳机电系统、仿生机器人路径规划与导航。发表论文25篇。E-mail:meijieben@foxmail.com。