基于U-Net的湖北省露天矿山土地损毁信息提取应用

2024-02-26李彧磊陈梦源

何 睿, 王 润*, 徐 航, 刘 帅, 李彧磊, 张 硕, 陈 琨, 蔡 宇, 陈梦源

(1.资源与生态环境地质湖北省重点实验室,湖北 武汉 430034; 2.湖北省地质环境总站,湖北 武汉 430034)

湖北省矿产资源丰富,开采方式以露天开采为主,对矿区及其毗邻区域造成了地貌景观破坏和土地资源损毁等危害。近年来,为准确掌握全省矿山地质环境现状及其变化情况,为政府部门合理制订矿山生态修复治理措施提供依据,湖北省对重点矿集区开展了持续性的遥感监测工作。但由于矿集区面积大、矿山数量多,使得遥感监测数据处理工作量较大,有必要研究高效快速的遥感信息提取方法,提升露天矿山土地损毁信息的提取效率。

遥感技术自20世纪70年代开始应用以来,其时间分辨率和空间分辨率得到持续提升,已成为矿山地质环境调查监测的重要手段[1-5]。近些年,深度学习方法由于具有比传统方法更高的分类识别精度[6],在多种地质工作场景得到有效应用,其中卷积神经网络(convolutional neural network,CNN)是目前常用的深度学习方法,该方法可提取局部关联性特征以提高对大量变化数据的适应能力,针对高分辨率遥感影像开展地物分类工作可获得较高的准确率[7-9]。以卷积神经网络为基础,众多研究人员不断对U-Net等模型进行优化,进一步提升了其学习效率[10-12]。将国产高分辨率卫星数据与包括U-Net模型在内的深度学习方法相结合,已有效应用于矿山露天开采区的识别,对于尾矿库的空间变化监测也有一定成效[13-18]。

目前在绿色矿山建设、矿山地质环境修复治理等工作中,还是主要利用高分辨率遥感数据结合无人机进行现场调查,并对治理效果进行监测[19-23],如果将深度学习方法应用于这些工作场景,可能会进一步提高相关信息提取的准确度和效率。本文以湖北省露天矿山为研究对象,以高分二号(GF-2)卫星影像为数据源,结合研究区以往遥感解译成果,利用U-Net模型开展区内露天矿山土地损毁信息提取的应用研究,以验证U-Net模型进行该项工作的可行性,并提升湖北省对矿山地质环境现状及其变化情况的掌握程度。

1 研究区概况及数据源

1.1 自然地理概况

本次选择的研究区为湖北省内3个重点矿集区(图1),均位于江汉平原及周边山区的过渡区域,总面积约1 212 km2,其中荆门石膏矿区(图1-b)位于荆山山脉与江汉平原的过渡地带;荆襄磷矿区(图1-c)位于汉江中游、大洪山南麓、鄂北山区向江汉平原的过渡地带;松宜煤矿区(图1-d)位于鄂西北山区东缘向江汉平原的过渡地带。

图1 研究区分布图Fig.1 Location map of the study area

1.2 矿山土地损毁概况

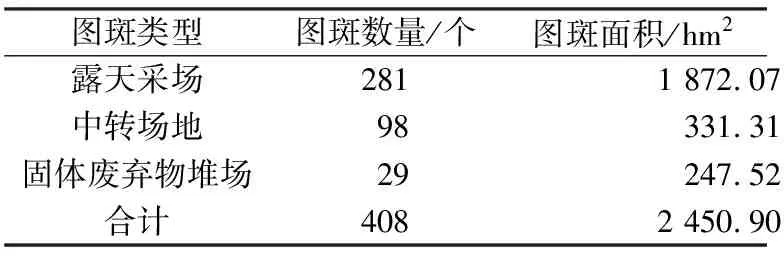

研究区各矿山主要开采煤、磷、石膏、岩盐、灰岩、页岩、石材、石料等矿产。根据2021年矿山遥感解译资料,遥感解译图斑分为3类:露天采场、中转场地、固体废弃物堆场,图斑总面积为2 450.90 hm2,具体如表1所示。

表1 研究区矿山土地损毁情况Table 1 Land damage situation of mines in the study area

1.3 数据源

本次研究所用数据源为高分二号卫星影像数据,该卫星搭载了1台1 m分辨率全色相机(光谱范围0.45~0.90 μm)和1台4 m分辨率多光谱相机(光谱范围0.45~0.52、0.52~0.59、0.63~0.69、0.77~0.89 μm),可实现亚米级的空间分辨率,成像效果整体清晰、辨识度高。为覆盖研究区范围,共使用11景2021年度影像数据。将高分二号卫星影像数据作为训练样本集影像片基础,结合2021年矿山遥感解译图斑,可制作U-Net模型所需的数据训练集。

2 工作方法和流程

工作流程包括解译标志建立、数据训练集创建、模型选择与训练、信息提取结果对比验证等4部分,总体技术流程如图2所示。

图2 总体技术流程Fig.2 Overall technical flow chart

2.1 解译标志建立

根据研究区2021年矿山遥感解译资料,露天采场是最主要的露天矿山土地损毁表现形式,其影像边界较清晰,开采区域多呈浅色,可见阶梯状开采面(图3)。

图3 露天采场遥感影像Fig.3 Example of open-pit mining area

2.2 数据训练集创建

为开展基于U-Net模型的土地损毁信息提取工作,需要准备数据训练集并对其进行标注,利用ArcGIS Pro软件的深度学习模块可实现数据训练集的导出。数据训练集主要由影像数据和矢量数据(shp)构成,将矢量数据叠加在影像数据上进行分类标记,完成后导出即可获得数据训练集。以研究区281个露天采场解译图斑的矢量数据为基础,结合高分二号卫星影像数据,生成相应的影像片,并对影像片进行不同角度的旋转以创建其他影像片,从多个角度捕获相同的训练样本(图4),实现样本数据增强。不同旋转角度下所创建的数据训练集的样本量是不同的(表2)。

表2 不同数据训练集样本量Table 2 Sample capacity of different data training sets

图4 不同旋转角度的训练样本Fig.4 Training sample with different rotation angles

2.3 模型选择与训练

卷积神经网络是深度学习方法中常用的一种模型,其优势在于将多维数据样本图像作为模型输入层时,不需要对样本数据进行特别复杂的处理,避免了进行图像信息学习时所需的复杂的图像特征提取过程和图像数据重建过程。对于矿山遥感影像的图斑识别,主要利用影像光谱信息来进行,选择用于像素分类的U-Net模型进行模型训练。

U-Net模型网络结构包括编码部分和解码部分(图5)。在编码部分,每次下采样之前使用2个卷积核为3×3的卷积层进行特征提取,卷积之后使用ReLU激活函数,使用大小为2×2的最大池化操作减少特征维度,以增大感受野。每经过1次下采样,图像尺寸缩小1/2,维度增大1倍。通过这种重复的操作可以充分提取图像的高层特征并过滤掉不需要的信息。在解码部分,使用反卷积进行上采样,上采样之后同样使用2个卷积核为3×3的卷积层,逐步恢复图像的细节信息,并最终恢复特征图至输入图像的尺寸。每经过1次上采样,图像尺寸增大1倍,维度缩小1/2。编码部分和解码部分对应阶段之间使用跳跃连接结构,复用低层次特征信息,以更好地还原图像细节信息。

图5 U-Net模型网络结构Fig.5 The network structure of U-Net

在选择U-Net模型的基础上,需要进一步选择模型所使用的骨干模型,即卷积层和池化层的排列组合方式。本次研究使用ResNet作为骨干模型(图6)。ResNet是一种主要针对传统堆叠网络缺点进行改进的骨干模型,即提出残差结构用以优化网络,解决深度网络化下的退化问题[24-26]。ResNet通过堆叠非线性层用以拟合残差,同时提出恒等快捷连接用于执行恒等映射,并将其输出添加到堆叠层的输出,恒等快捷连接既不会增加额外的参数,也不会提高计算复杂度。假设原先的网络输入为x,网络输出为H(x),ResNet令H(x)=F(x)+x,则残差网络可以通过对残差F(x)=H(x)-x进行学习,其学习效率会高于直接学习H(x)的效率。ResNet主要有5种不同大小的网络,即ResNet18、ResNet34、ResNet50、ResNet101和ResNet152,各ResNet网络之间的不同主要在于中间卷积部分的block参数和个数存在差异。

图6 ResNet网络结构Fig.6 The network structure of ResNet

设置数据训练集、模型、骨干模型等参数后,可以进行模型训练。为保证模型训练效果,将最大新纪元数量设置为20,即数据训练集将通过神经网络向前和向后传递20次。完成参数设置后,选择1个重点矿集区来建立露天采场土地损毁信息提取的数据训练集,分别使用U-Net模型和金字塔场景来开展信息提取实验,并在此基础上选择效率更高的骨干模型及参数来开展整个研究区的露天矿山土地损毁信息提取工作。

2.4 信息提取结果对比验证

需要对不同骨干模型及参数开展精度评价,包括模型的训练损失与验证损失对比、精度评价参考值对比,其中精度评价参考值选取精确度(precision,P)、召回率(recall,R)和F1值。精确度表示模型预测的像素总数中,正确预测的真实像素数量占预测的真实像素数量的比例;召回率表示模型预测的像素总数中,正确预测的真实像素数量占实际的真实像素数量的比例;F1值表示精确度与召回率的调和平均数,其取值范围为[0,1]。F1值计算公式如下:

在理想状态下,应考虑精确度和召回率均为高值,但实际情况中两者互相制约,追求精确度高,则召回率就低;追求召回率高,则精确率通常较低。而引入F1值可以平衡精确度和召回率的影响,较为全面地评价模型精度,F1值越大表示模型效果越好。

在模型精度评价的基础上,利用所选择的骨干模型及相应的参数,对3个重点矿集区分别开展露天矿山土地损毁信息提取,将信息提取结果与高分辨率遥感影像进行对比验证。

3 模型精度评价与信息提取

3.1 模型精度评价

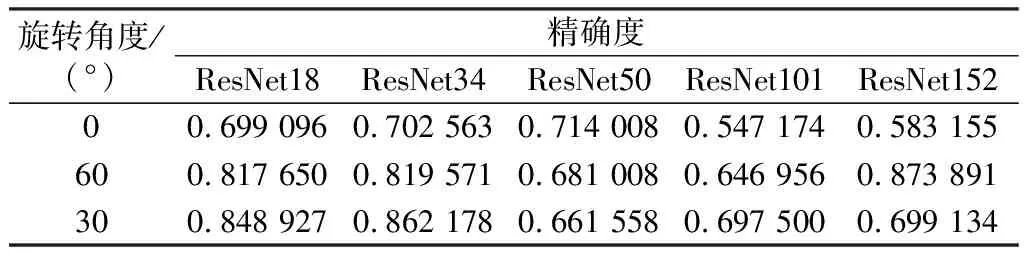

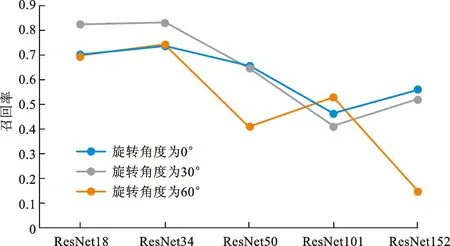

利用荆门石膏矿区79个露天采场图斑制作旋转角度分别为0°、60°、30°的数据训练集,在U-Net模型中依次将骨干模型设置为ResNet18、ResNet34、ResNet50、ResNet101和ResNet152,经深度学习后获得对应的训练模型及其影像预测结果。

当训练样本旋转角度为0°时,不同骨干模型的训练损失与验证损失图如图7所示,对应的影像识别验证对比图如图8所示。当骨干模型设置为ResNet18、ResNet34时,随着训练批次的增加,验证损失曲线尽管存在一定波动,但趋势趋于平稳;当骨干模型设置为ResNet50时,训练批次有所增加,验证损失曲线随之趋于平滑;当骨干模型设置为ResNet101和ResNet152时,训练批次大量增加,但验证损失曲线出现大幅度波动。

图7 训练样本旋转角度为0°时不同骨干模型的训练损失与验证损失图Fig.7 Training loss and validation loss graph for different ResNet models with training sample rotation angle of 0°

图8 训练样本旋转角度为0°时不同骨干模型的影像识别验证对比图Fig.8 Verification comparison chart for different ResNet models with training sample rotation angle of 0°

当训练样本旋转角度为60°时,不同骨干模型的训练损失与验证损失图、影像识别验证对比图分别如图9、图10所示。当骨干模型设置为ResNet18、ResNet34时,随着训练批次的增加,验证损失曲线在早期存在一定波动,在后期趋于平稳;当骨干模型设置为ResNet50时,训练批次有所增加,验证损失曲线随之趋于平滑,但后期出现波动;当骨干模型设置为ResNet101时,验证损失曲线随着训练批次的增加发生大幅波动;当骨干模型设置为ResNet152时,验证损失曲线随着训练批次的增加,在前期趋于平缓,在后期出现高峰值波动。

图9 训练样本旋转角度为60°时不同骨干模型的训练损失与验证损失图Fig.9 Training loss and validation loss graph for different ResNet models with training sample rotation angle of 60°

图10 训练样本旋转角度为60°时不同骨干模型的影像识别验证对比图Fig.10 Verification comparison chart for different ResNet models with training sample rotation angle of 60°

当训练样本旋转角度为30°时,不同骨干模型的训练损失与验证损失图、影像识别验证对比图分别如图11、图12所示。当骨干模型设置为ResNet18、ResNet34时,随着训练批次的增加,验证损失曲线尽管存在一定波动,但整体趋于平稳;当骨干模型设置为ResNet50时,训练批次有所增加,验证损失曲线随之趋于平滑;当骨干模型设置为ResNet101时,验证损失曲线随着训练批次的增加,在后期出现大幅度波动;当骨干模型设置为ResNet152时,验证损失曲线随着训练批次的增加持续出现波动。

图11 训练样本旋转角度为30°时不同骨干模型的训练损失与验证损失图Fig.11 Training loss and validation loss graph for different ResNet models with training sample rotation angle of 30°

图12 训练样本旋转角度为30°时不同骨干模型的影像识别验证对比图Fig.12 Verification comparison chart for different ResNet models with training sample rotation angle of 30°

由图7、图9和图11可知,在训练样本数量不同的情况下,当骨干模型设置为ResNet18和ResNet34时,其训练损失曲线和验证损失曲线的变化趋势在整体上更为接近,说明在此骨干模型下的预测效果更好。同时,将不同旋转角度的训练样本集对应的各骨干模型的精确度、召回率和F1值进行统计,如表3-表5和图13-图15所示,可知ResNet18、ResNet34的精确度、召回率和F1值均高于其他骨干模型。

表3 各骨干模型精确度统计表Table 3 Statistical table of precision for different ResNet models

表4 各骨干模型召回率统计表Table 4 Statistical table of recall for different ResNet models

表5 各骨干模型F1值统计表Table 5 Statistical table of F1 for different ResNet models

图13 各骨干模型精确度变化曲线Fig.13 The change curve of precision for different ResNet models

图14 各骨干模型召回率变化曲线Fig.14 The change curve of recall for different ResNet models

图15 各骨干模型F1值变化曲线Fig.15 The change curve of F1 for different ResNet models

综上所述,以不同样本量(即不同旋转角度)的训练样本集进行深度学习训练时,当骨干模型设置为ResNet34时,其精确度、召回率和F1值均达到最大值;当骨干模型设置为ResNet18时,其精确度、召回率和F1值均略低于ResNet34;同时随着训练样本量的增加(即旋转角度由0°变为60°,再变为30°),ResNet18、ResNet34所对应的各精度评价参考值也随之提高,表明训练样本量的增加有利于提高模型精度。

因此,本文研究在U-Net模型中将骨干模型设置为ResNet34,将训练样本旋转角度设置为30°。

3.2 信息提取结果

利用U-Net模型对3个重点矿集区开展露天矿山土地损毁信息提取,结果如图16-图18中黄色区域所示,另外在图上标注了人机交互解译结果(红线范围)并进行对比。对于荆门石膏矿区,信息提取的面积为14.06 km2,人机交互解译的面积为7.61 km2,两者重合部分的面积为6.74 km2,由此来看信息提取结果的识别率达到了88.6%;对于荆襄磷矿区,信息提取的面积为9.78 km2,人机交互解译的面积为7.43 km2,两者重合部分的面积为4.97 km2,信息提取结果的识别率达到了66.9%;对于松宜煤矿区,信息提取的面积为6.41 km2,人机交互解译的面积为4.92 km2,两者重合部分的面积为4.42 km2,信息提取结果的识别率达到了89.8%(表6)。合计来看,研究区信息提取面积为30.25 km2,人机交互解译面积为19.96 km2,两者重合部分面积为16.13 km2,信息提取结果的识别率达到了80.8%。

表6 信息提取结果统计表Table 6 Statistics table of information extraction

图17 荆襄磷矿区信息提取结果Fig.17 Information extraction results of Jingxiang phosphate mining area

图18 松宜煤矿区信息提取结果Fig.18 Information extraction results of Songyi coal mining area

3.3 信息提取结果对比验证

将U-Net模型信息提取结果与高分辨率遥感影像进行对比验证(图19),对于开采面积较大、露天开采面影像特征明显的矿山,U-Net模型对其土地损毁信息提取的效果较好,提取结果的边界清晰,能够对露天采场及其周边未开采区域进行有效地区分,同时能对矿山之间的道路进行较好地筛除。由于矿集区面积较大,不仅涵盖了矿山区域,还包含城镇等区域,利用U-Net模型进行信息提取过程中不可避免地对包括城镇在内的其他区域进行信息提取,会将城镇区域的裸露空地、工业场地等错判为矿山损毁土地。

图19 信息提取结果与遥感影像的对比Fig.19 Comparison of information extraction results with remote sensing images

4 结论

(1) 本文的应用研究表明利用U-Net模型结合高分二号卫星影像数据,可以对湖北省重点矿集区的露天矿山土地损毁信息进行有效提取,在以往人机交互解译的基础上提高了信息提取效率。在此基础上,可进一步改进模型以应用于周期性的矿山土地损毁监测、矿山生态恢复治理效果监测等工作。

(2) U-Net模型各骨干模型的信息提取效果差异较大,骨干模型层数过深时会发生过拟合现象,降低信息提取结果的精度;当骨干模型设置为ResNet34时,其信息提取效果相对更好。同时,在计算机硬件条件允许的情况下,数据样本集中样本量越大,模型学习的效果越佳,信息提取的效果越好。

(3) 由于本次研究选取的矿集区面积大、涵盖的地物类型多,基于U-Net模型进行露天矿山土地损毁信息提取时,一些影像特征与其相似的地物也会被提取出来,如城镇区域的裸露土地、建设用地、工业场地等,从而对信息提取结果造成干扰。在未来研究中,可以通过建立更准确的解译标志、增加训练样本集数据量、更新矿山范围信息、优化模型结构和参数等,提升信息提取结果的精度。