基于生成对抗网络的非织造布二维图像重建

2024-01-31王志禄1b1b

王志禄,侯 珏,1b,2,杨 阳,1b,刘 正

(1.浙江理工大学,a.服装学院;b.浙江省服装工程技术研究中心;c.国际时装技术学院,杭州 310018; 2.武汉纺织大学武汉纺织服装数字化工程技术研究中心,武汉 430073)

非织造布是由定向或随机排列的纤维成网加固而成,内部具有复杂的纤维结构。探究纤维集合体的内部结构有助于分析非织造布的力学性能、透气性、过滤性能等特性,为非织造布的设计和应用提供指导[1-3]。

目前,对非织造布的内部结构分析往往采用CT设备,该设备成本较高,测试流程复杂。研究人员通常采用参数模拟或分形理论对非织造布的结构进行建模。潘莺等[4]使用计算机生成随机排列的直线来模型熔喷纤网的孔径分布,并与实际的单层熔喷纤网进行对比分析。Simmonds等[5]基于纤网平面一致性理论,通过多层直线状纤维网叠加构造出非织造布孔隙分布模型。金关秀等[6]以纤维根数、纤维平均直径以及纤维直径变异系数为参数,运用MatLab编程对非织造布图像进行建模。上述研究中模拟的纤网虽然与实际的非织造纤网在孔隙率等指标接近,但是其纤维形态呈直线,与实际的纤维卷曲形态相差甚远。杨旭红[7]利用随机分形曲线模拟纤维的卷曲形态,进而模拟出各种类型的非织造纤维网。高贵[8]将分形理论与图像处理技术结合,提出了分形维数与纤维网的随机程度、孔隙率成正相关的理论模型。分形理论解决了纤维形态难以表达的问题,但该理论只是抽象地对非织造结构进行概括性描述,无法具象地重构真实的非织造布结构。Wang等[9]基于生成对抗网络对拆分后的单根纤维图像进行重建,并使用重建后的单根纤维在一定空间内随机分布重构出非织造布的三维结构。然而,由于纤维之间存在相互作用力,拆分后的纤维失去力的作用后形态发生变化,基于此重建出的纤维图像并不能反映非织造布结构的真实纤维状态。

上述方法模拟生成的纤网结构形态与真实情况有着较大的差异,容易造成非织造布性能评估的误差。基于体视学理论,使用二维图像结构的统计信息能够分析非织造布的内部结构[10]。为了重建出与真实纤维结构一致的非织造布二维图像,构建基于多尺度训练策略的纤维生成对抗网络(Fiber generation adversarial network,FGAN),通过对非织造布显微图像样本进行训练学习,可实现真实的非织造布纤维结构图像重建。重建出高质量且真实的非织造布纤维图像能够用于非织造布立体结构的建模和仿真。

1 非织造布图像生成模型

1.1 生成对抗网络

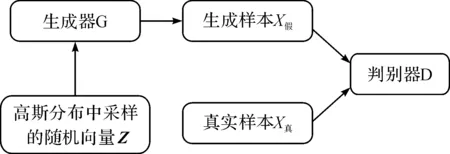

生成对抗网络(Generate adversarial networks,GANs)是一种无需大量标注数据就能学习图像深度信息的方法[11]。生成对抗网络由生成器G和判别器D两部分组成,其模型结构如图1所示。生成器G是由参数化后的深度神经网络模型实现,其输入是一个从高斯分布中采样的随机向量Z,输出可以看作采样于某个分布的一个样本X假。假设真实数据的分布为Pdata,在给定大量真实数据的前提下,对生成对抗网络进行训练,使得生成器G生成的数据分布接近于真实数据的分布,从而生成类似于真实数据的样本。在这个过程中,D的输入是由真实样本和生成样本两部分组成,D的作用是判别两个样本之间的差异。当G和D经过训练达到平衡状态,即D无法判断真实样本和生成样本之间的差异,此时可以认为生成器G拟合了真实数据的分布。输入一个从高斯分布采样的随机向量Z,生成器便能重建出一张非织造布图像。

图1 GAN模型结构图Fig.1 GAN model structure diagram

1.2 模型结构

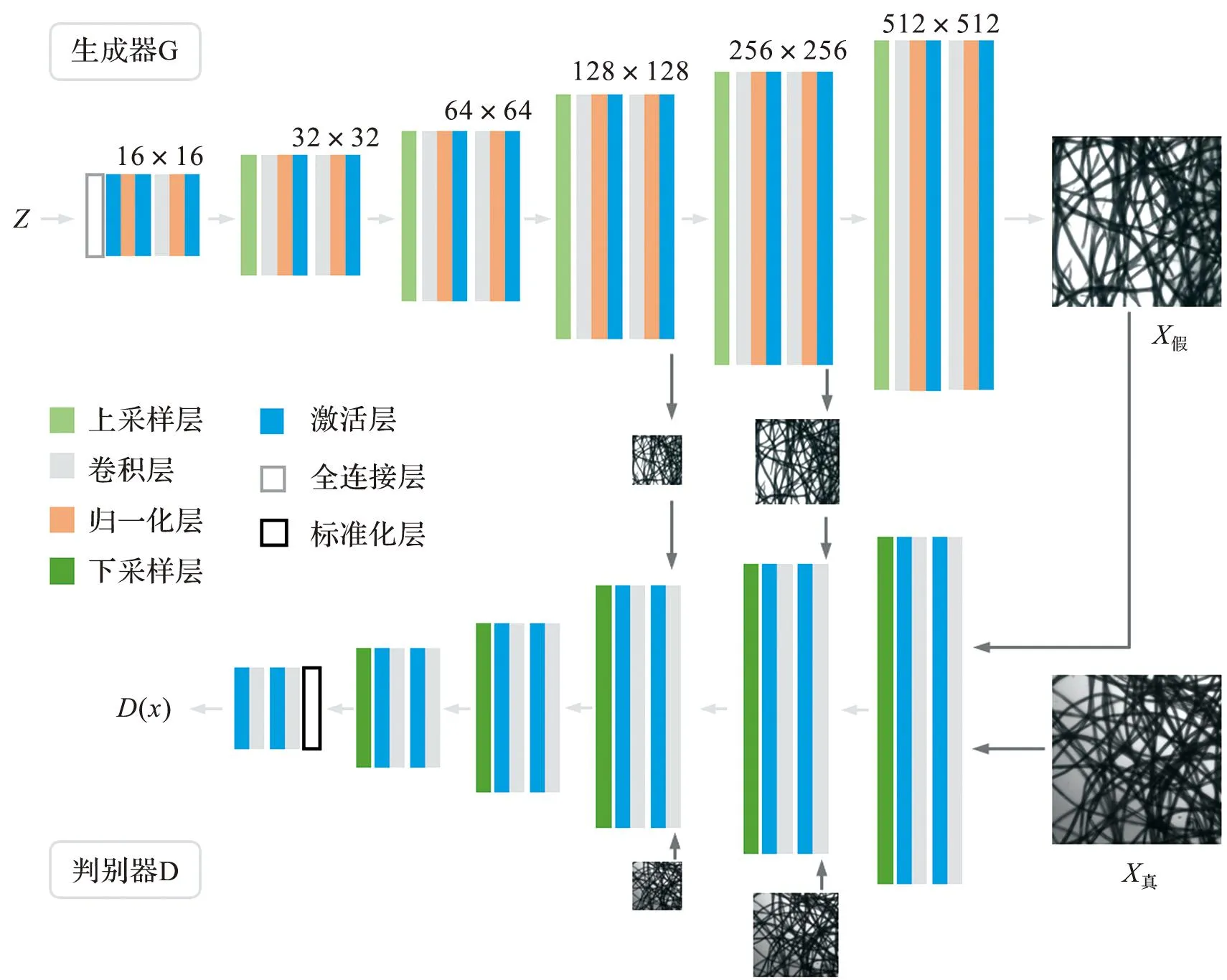

本文参考GANs[12]基本框架构建了生成模型FGAN。为了生成器稳定重建出高质量的非织造布图像,判别器对网络最后3个特征层的输出进行监督,同时为了增加模型训练过程的稳定性,采用PixelwiseNormalization归一化层并引入标准化层。FGAN结构如图2所示,模型使用一个全连接层对随机向量Z进行特征映射,然后将其调整成一个尺寸为16×16×512的三维矩阵(16×16表示输入图像的分辨率,512表示输入图像的维度)。

图2 FGAN模型结构图Fig.2 FGAN model structure diagram

生成器的网络结构一共有6层,每一层由3个基础模块组成,分别为卷积层、PixelwiseNormalization归一化层和LeakyReLU激活函数。与传统GANs使用BatchNormalization归一化层不同的是,PixelwiseNormalization归一化层没有需要训练的参数,其作用是将特征层中的每个像素在不同维度上的值归一化,PixelwiseNormalization归一化层公式为:

(1)

式中:ax,y、bx,y分别是输入和输出的特征层,是防止除以零的常数。该模块能够防止像素位置上的信号在训练过程中失控,提升训练的稳定性。上采样层将分辨率尺寸扩大为原来的两倍,并且第1个卷积层将维度数减少为原来的一半,直到特征的空间尺寸达到512×512,维度减少到3,即红、绿、蓝3个通道。判别器的网络结构可以看作为生成器的镜像,如图2所示,判别器的输入分别是生成的假图和真实非织造布图像,输出的是一个概率值,用于表示输入数据是真实数据还是生成器生成的数据的概率。判别器的结构同样有6层,每层中间有一个下采样层使得图像的尺寸减半,第1个卷积层将维度数扩大一倍。判别器最后一层中引入标准化层,该层没有需要训练的参数,其作用是求取一个训练批次(Batch)内各个像素在维度上对应标准差,再求其均值,将其作为一个新维度与原来的特征层拼接。该维度反映了训练批次内像素在维度上的平均标准差,为模型提供了更丰富的特征表示,从而指导生成器生成更加多样化、更加接近真实数据分布的非织造布图像。

1.3 损失函数

FGAN的损失由3部分组成:生成器损失、判别器损失和多样性损失。生成器损失的作用是让生成器生成逼真的非织造布图像,由内容损失和正则化项构成。内容损失用于衡量生成器生成的图像与真实图像之间的差异,使用均方误差(Mean squared error,MSE)来计算。正则化项的作用是防止生成器崩溃或产生不稳定的输出。生成器损失函数可以用式(2)表示:

(2)

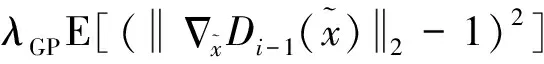

本文判别器损失函数由两部分组成:Wasserstein距离[13]和梯度惩罚项。Wasserstein距离用来衡量两个分布之间的相似度,可以用来度量生成图像和真实图像之间的差异。梯度惩罚项可以防止在训练过程中出现梯度爆炸和梯度消失。判别器的损失LD可以用式(3)表示:

(3)

为了增加生成器生成样本的多样性,本文引入了权重多样性损失WMI Loss。WMI Loss运用于每个训练批次,在模型训练过程中,WMI Loss计算生成数据分布与真实数据分布之间的KL散度均值。通过最小化LWMI(G)损失,可以使生成器生成更接近真实数据的样本,避免只生成单一纤维结构的非织造布图像。多样性损失LWMI(G)用式(4)表示:

(4)

式中:G是生成器,N是样本数量,xi是输入样本,z是隐空间向量,P(z)是隐空间的先验分布,Q(z|G(xi))是在给定输入xi的情况下生成器生成的z的分布,K为KL散度,I表示KL散度运算符。

综上,模型的总损失Ltotal可以表示为:

Ltotal=LG+LD+λLWMI

(5)

式中:λ是超参数,用于控制多样性损失在总损失中的权重。通过多个批次的训练,计算目标函数的值,并通过反向传播机制来得到误差梯度,以利用梯度下降法来降低网络的训练误差,最终的目标是获得符合预期的高质量非织造布图像。

1.4 模型的多尺度训练

在传统GANs的训练中,通常采用一次性训练方式,即同时训练生成器和判别器的所有层。这种方式存在训练不稳定、生成图像质量差等问题[14-15]。为解决这一问题,本文在ProGan[16]网络模型的渐进式训练基础上将模型的训练改进为多尺度训练策略,不同分辨率图像对应训练不同网络层。判别器不仅对最后生成图像进行监督,还对前两个网络层的输出特征进行监督。多尺度训练策略有助于避免整体训练过程中出现梯度消失或梯度爆炸等问题,并且使生成器能够同时关注图像的细节和整体结构。通过在不同尺度上对生成图像进行监督,可以鼓励生成器生成更加逼真和细致的图像。

1.5 模型的评价指标

基于生成对抗网络重建的图像通常从以下两个方面进行评估:一是图像的质量,生成的图像是否真实,是否清晰,结构是否完整;二是多样性,在图像生成任务中,生成器所生成的图像应该具有多样性,如果生成单一纤维结构的无纺布图像,即出现模式坍塌的现象。一般使用 Inception score(IS)和 Fréchet inception distance(FID)两种常用指标对图像进行评估。IS是基于Inception网络的分类器来计算图像的分类置信度和类别分布熵。然而,其网络分类在大规模图像分类任务(ImageNet)上进行训练,在本文的非织造布数据集上的适用性受到限制。FID能够适应不同数据集的特征分布差异,因此本文选取FID进行评价。FID使用一个预训练的图像分类器网络作为特征提取器,该网络能够从图像中提取出高级语义特征,这些特征是分类器网络中某一层的输出。FID的计算可用式(6)表示:

(6)

式中:μr、μg和∑r、∑g分别表示生成和真实非织造布图像的特征均值与方差。真实图像与生成图像特征越接近,其均值与协方差就越小,则FID值也越小,生成图像的质量越高。

2 实验部分

2.1 数据集构建

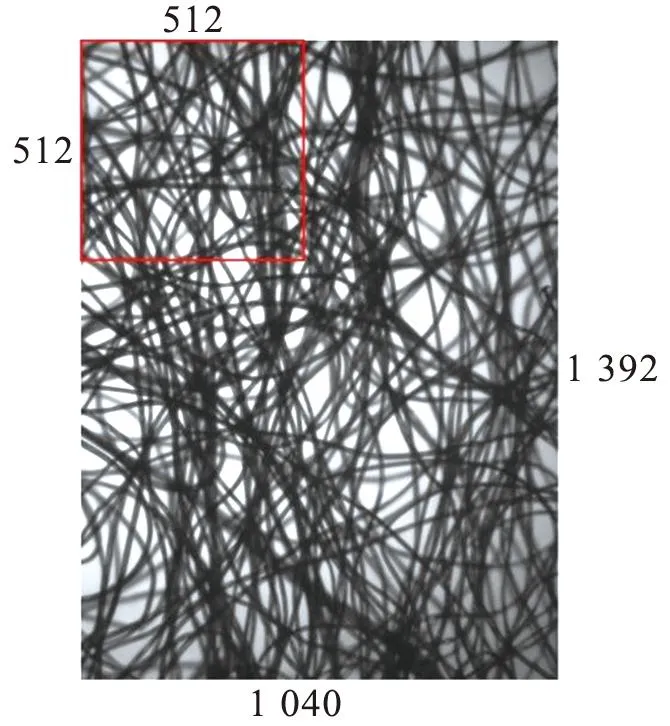

为了获得高质量的非织造布图像,采用全自动光学显微镜对一块粘胶熔喷非织造布(面密度为 30 g/m2,厚度为0.153 mm)样品拍摄获得纤维图像。显微镜平台为北昂医疗器械(上海)有限公司生产的M318型全自动显微镜,主要包含摄像机、目镜、物镜、载物台、20 W卤素光源与三轴电机等,如图3所示。拍摄获得大小为1392×1040个像素的RGB图像,同时在拍摄图像的过程中,移动不同视野获得不同纤维结构的图像,最终得到原始图像1150张。为了满足模型的训练要求,如图4所示对图像进行裁剪获得大小为512×512个像素的训练图像和验证图像6975 张,其中:5875 张用于模型训练,1000 张图像用于计算模型的评价指标,100张图像用于验证模型性能。数据扩充是训练卷积神经网络常用的方法[17],能够有效防止模型过拟合,5875 张图像经过垂直、水平翻转扩充,获得23000 张用于训练。

图3 全自动光学显微镜Fig.3 Fully automatic optical microscope

图4 纤维显微图像的裁剪Fig.4 Cropping of the captured image

2.2 训练参数与环境配置

本文训练模型设置初始学习率为0.0001,使用Adam优化器,动量参数为0.0,学习率衰减率为0.99。训练数据尺寸调整为16×16、32×32、64×64、128×128、256×256、512×512,调整后的图像如图5所示,用于训练不同特征层,单个训练批次输入图像数量分别为256、128、64、32、8、4。所有训练数据训练完一轮称为1个epoch,不同特征层对应的训练epoch次数为20、20、20、20、20、50次。模型训练环境配置:采用Windows 10的64 位操作系统,使用深度学习框架Pytorch1.13.1,CPU为3.60 GiHz Intel(R) Core(TM)i7-12700KF,GPU为NVIDIA GeForce RTX 3080 Ti。

图5 不同分辨率下的纤维显微图像Fig.5 Fiber microscopic images at different resolutions

2.3 生成效果展示

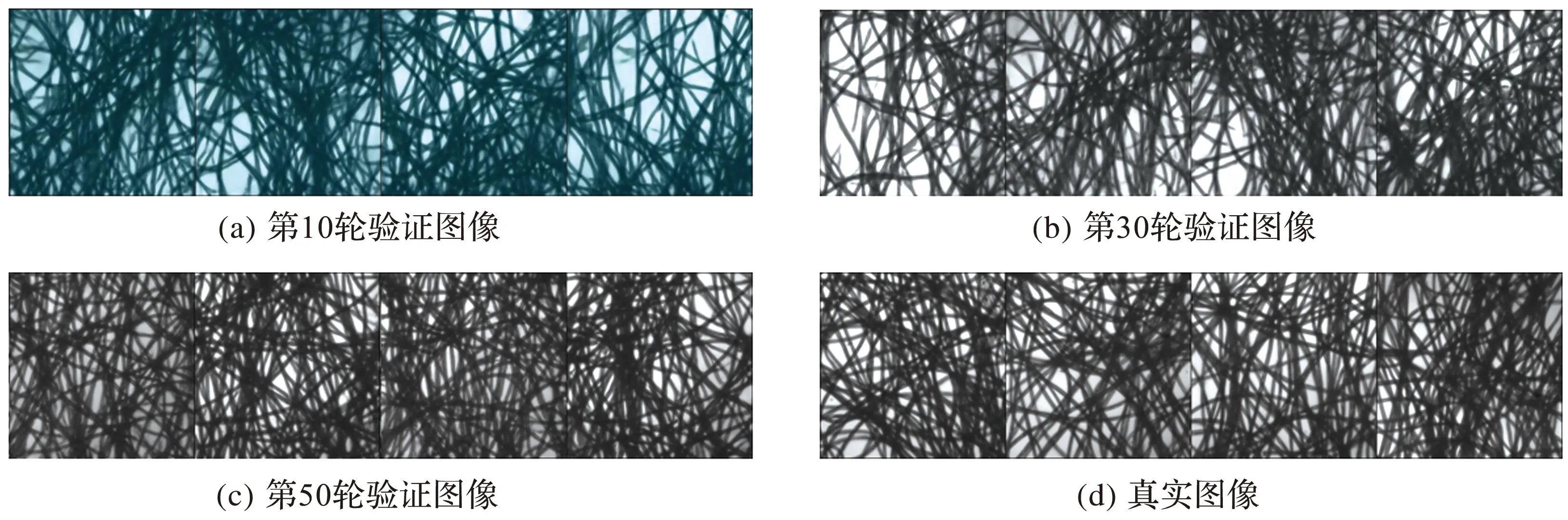

通过使用大量真实的非织造布图像对模型进行逐步增强训练和整体训练,总训练耗时68.5 h。最终模型学习到非织造布的纤维结构分布,输入一个从高斯分布中采样的随机向量便能够生成一张真实的非织造布图像。在整体训练阶段每隔5个epoch便对模型进行一次验证并保留该批次的模型参数文件。验证示例图像如图7所示。从 图6 中可以看出,在训练初期模型能够学习到整体的纤维结构分布,但在细节上不够完美,有较多的纤维并不连续,并且纤维结构不够真实。随着训练批次的增加,模型对整体纤维结构不断优化,纤维的形态和连续性越来越自然,最终生成图在纤维形态上与真实图几乎一致。

图6 不同训练批次下的生成图像和真实图像Fig.6 Generated and real images of different training batches

2.4 对比实验

为验证本文所提出模型FGAN的性能,进行了一系列的对比实验。实验结果如图7所示,分别是DCGAN[18]、WGAN-GP[19]、BEGAN[20]、PROGAN[16]、FGAN的生成图像结果和真实图像。从图7可以看出,DCGAN在本文非织造布图像重建中存在图像模糊、纤维结构不清晰的问题。WGAN-GP和BEGAN重建的图像中纤维结构不真实,图像有明显失真。基于噪声生成高质量图像的方法PROGAN,从视觉效果上生成了较真实的非织造布图像,但生成的图像的质量与真实图像仍有差距,纤维的颜色和结构与真实图像有明显差异。与上述方法相比,本文提出的FGAN可以生成结构多样化的非织造布图像,并且在视觉上几乎和真实图像一致;同时FGAN产生的图像并未出现失真问题。这主要是由于模型采用逐层训练的方式,在训练阶段学习到更好的数据分布;此外,引入的WMI Loss也有助于提升模型的性能。

本文使用FID定量评估模型,结果如表1所示。从表1可见,模型所生成的图像的FID值为25.51,相较于PROGAN降低了35.77%,且远低于DCGAN、WGAN-GP、BEGAN。相比之下,本文提出的模型能生成更高质量,纤维结构更真实的非织造布图像。

表1 FGAN与其他生成模型的对比Tab.1 Comparison between FGAN and other generative models

2.5 消融实验

为了进一步验证WMI Loss和多尺度训练策略的有效性,本文FGAN进行了消融实验,实验结果如表2所示。使用传统训练策略训练模型,得到模型生成图像的评估指标FID值为40.21,添加WMI Loss后模型生成图像的FID值降低了20.31%,表明WMI Loss有助于生成器学习更多的纤维结构信息。此外,采用多尺度训练策略与传统一次性训练所有层相比FID降低了24.52%,表明该方法同样能够提高模型的性能。WMI Loss与多尺度训练结合进一步增强了模型的生成能力,从而生成了纤维排列更真实的非织造布图像。

表2 不同方法的消融实验结果Tab.2 Results of ablation experimentsby different methods

2.6 验证实验

分析非织造布孔隙结构的方法分为:实验法和图像法。实验法测量孔隙率的方法有多种,包括液体渗透法、气体渗透法、压汞法等。液体渗透法和气体渗透法是通过测量渗透液体或气体的体积来计算孔隙体积,相对简单易行,但在处理一些特殊非织造布时可能存在一定的局限性。压汞法可以直接测量孔隙体积,但在实验过程中需要使用昂贵的压力计和有毒的汞,不太适合大规模应用。

相对于实验法,图像分析法有着明显的优势。首先,图像法不需要接触样品,避免了样品损伤和污染,能够更好地保护样品的完整性。其次,图像法能够观察孔隙形态和大小,提供更为详细、准确的孔隙信息,这对于研究非织造布的物理性质和结构特征有重要意义。相关研究[21]对比了实验法和图像法测量织物的孔隙率,结果表明实验法在测试过程中受多种因素的干扰而影响最终的结果。因此为了验证本文模型生成非织造布图像的真实性,采用图像法分析验证真实图像与生成图像的平均孔隙率以及孔隙分布,分析过程如图8所示。

图8 图像法分析过程Fig.8 Image analysis process

采取孔隙率和孔隙分布两个指标对非织造布图像的结构进行量化分析,生成图像和真实图像经过二值化处理后,计算图中白色像素占总像素的比值即为孔隙率。孔隙率φ用式(7)表示:

(7)

式中:φ表示孔隙率,Ap表示孔隙面积,At表示总面积。

使用OpenCV图像处理库函数获取图像中的连通区域,每一个连通区域代表一个孔隙,计算出每个连通区域内的像素个数,以该数值作为孔隙的大小。使用训练好的模型重建出100张非织造布图像与100张未参与模型训练的验证图像,经过如图8所示的处理过程后计算得到每张图像的平均孔隙率,结果如图9所示。从图9中可以看出,模型生成图像的平均孔隙率(30.02%)与真实非织造布的平均孔隙率(30.87%)十分接近。

图9 生成图与真实图孔隙率Fig.9 Porosity of generated and real images

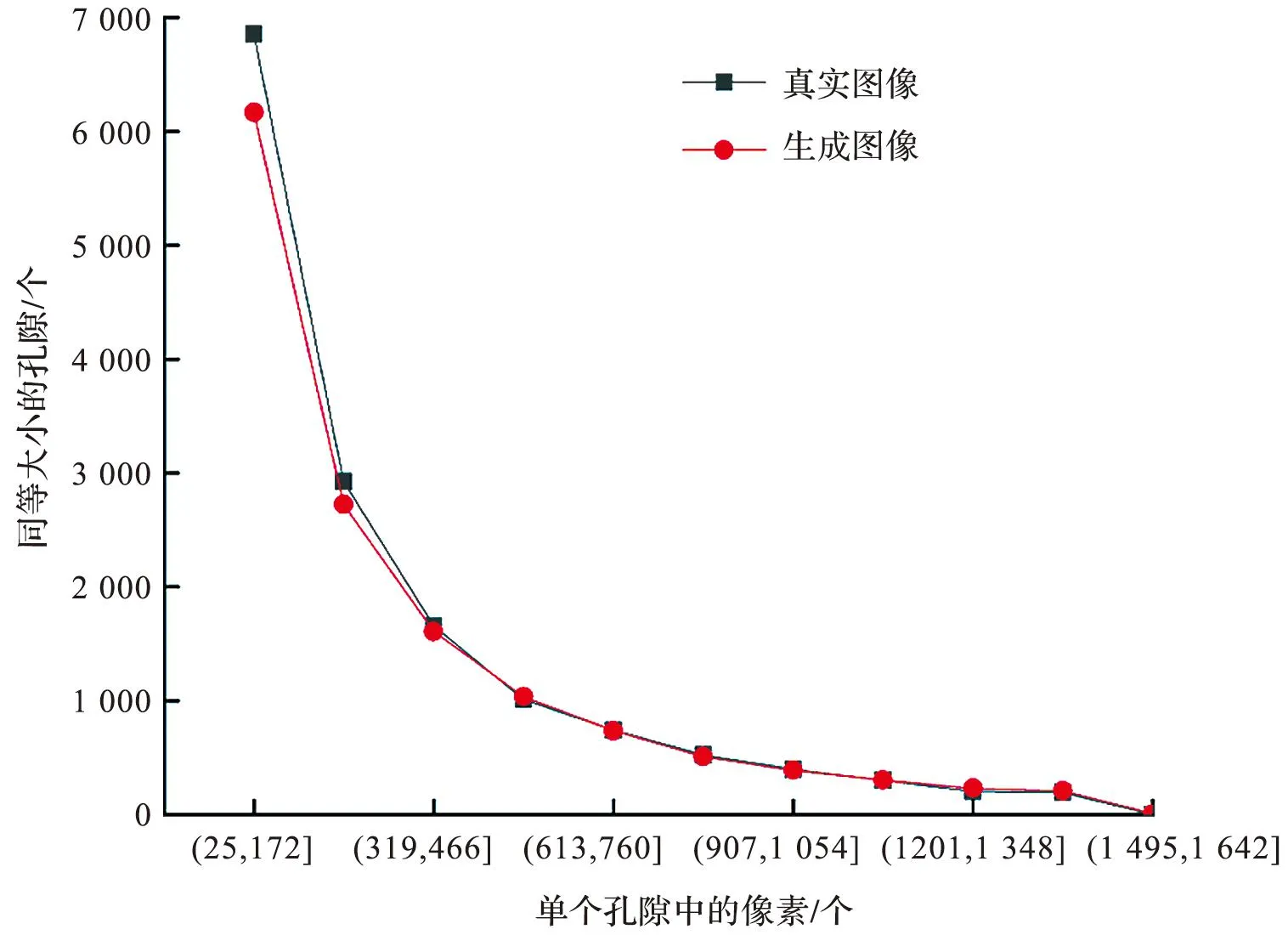

统计出生成图像与真实图像中孔隙的数量,结果如图10所示,得到生成图像与真实图像的孔隙数量分布曲线重合度较高,在不同的区间内有着数量接近的孔隙,模型生成的非织造布图像孔隙分布与真实图像一致。

图10 生成图与真实图孔隙分布Fig.10 Pore distribution in generated and real images

3 结 语

本文提出了一种基于生成对抗网络的非织造布图像重建新方法。构建了纤维生成对抗网络模型FGAN,通过真实的非织造布图像数据集进行训练学习,实现了对高分辨率非织造布图像的重建。为了验证重建图像的纤维结构排列与真实图像的一致性,选取了孔隙率和孔隙数量分布两个指标,对100张真实图像与生成图像进行了对比分析。结果显示,FGAN重建的图像与真实图像在纤维形态与结构分布上接近一致,且生成图像的质量优于其他模型,验证了本文方法的可行性。基于体视学理论,通过堆叠二维图像能够对非织造布的真实三维结构数据进行建模和仿真,本文研究成果可为非织造布立体结构分析研究提供技术支撑。