基于球形变换的无人机视频图像实时拼接方法

2024-01-20曾国奇牛子凡郑丽丽李杰郝得霖

曾国奇,牛子凡,郑丽丽,*,李杰,郝得霖

1.北京航空航天大学 无人系统研究院,北京 100191

2.北京航空航天大学 电子信息工程学院,北京 100191

随着无人机技术的发展,无人机已广泛应用于测绘、货运、监控、军事等各个领域,特别是在应急测绘、工业检测[1]、自然灾害监测[2]、绿地植被监测[3]、城市安全[4]等方面,无人机起着至关重要的作用。随着5G 通信的发展,无人机通信链路的峰值速度可达10~20 Gbit/s,空中接口延迟低至1 ms,无线通信实时性大大提高,使得高清无人机的实时图像传输成为可能。

在某些场景中,无人机需要拍摄并获取某一区域的图像信息,然后形成该区域的整体地形图,如野外测绘、自然灾害态势观测、城市建设管理和控制等。传统的态势获取方法,需要无人机按照特定的航线进行重复往返飞行,在飞行结束后,需要手动从机载相机上获得原始的拍照图片,进行图像矫正等预处理操作,并根据拍摄时的相机参数信息,进行事后拼接,形成拍摄图像的拼接图,从拍摄到形成拼接图像需要数小时,该方法适用时效性不高的测绘领域。然而,在一些时敏性要求较高的场合,例如火灾态势监测、地震救援指挥、公路交通疏导等场景下,指挥现场需要实时获取目标区的现场全局态势信息,并根据现场情况判断是否进行下一步决策。无人机一般不会按照特定的路线进行飞行,现场需要获取无人机视频图像的同时获得已飞行区域的现场态势。由于无人机飞行时大角度和非规则航线,传统的图像拼接方法无法形成稳定、快速的图像。因此本文提出了一种基于球形变换的无人机实时图像拼接方法,改进无人机图像拼接的稳定性和时效性,提高了拼接算法的实用性。

图像拼接是根据2 张具有重叠区域的图像中的匹配关系进行配准,形成一张更大的图像的过程。从流程上可以分解为图像的畸变预处理、匹配和配准、拼接融合几步[5],其中图像配准是最为关键的一步。关于图像拼接的研究通常主要围绕提升图像配准的精度和效率展开,图像配准的算法大体可以分为2 类,第1 类是基于特征的图像配准方法,另外一类是非特征的图像配准,主要有基于变换域以及基于灰度信息的图像配准方法。在无人机图像拼接领域,基于特征的图像拼接方法综合表现较好,在算法的精度、效率、鲁棒性上全面超过非特征的拼接算法[6],是目前主流的配准方法,下面着重介绍基于特征匹配的图像拼接算法。

Lowe[7]提出了SIFT(Scale Invariant Feature Transform)算子,该方法可以得到对图像尺度、旋转、缩放具有不变性的特征描述,随后Bay等[8]对SIFT 算法进行了改进,提出了SURF 算法,使用小波变换构造特征向量提高了运算速度,Dosovitskiy 等[9]在进行特征提取时通过训练卷积神经网络创建特征,改善了相似特征的提取情况;Nguyen 等[10]提出通过卷积神经网络直接创建特征描述子,简化了特征提取算法。

基于特征的拼接方法中存在单应性变换误差积累的问题,很多学者在消除单应性变换误差积累上做了研究,例如使用光束平差法[11]优化单应性矩阵的计算误差,或者直接对单应性误差积累问题进行消除,例如APAP(As-Projective-As-Possible)算法[12]使用局部单应性矩阵进行图像拼接,SPHP(Shape-Preserving Half-Projective)算法[13]使用附加项优化网格化单应性矩阵,使用透射变换和相似变换结合的方式增加拼接的全局相似性,Chen 等[14]提出了一种基于全局相似性先验校正方法,但是线性结构没有得到很好的保护,Zhang 等[15]通过设置一系列预约束来实现更好的性能,Lin 等[16]考虑了像素强度的差异,这在低纹理图像中效果良好,Lee 等[17]将图像分割,并根据视差的扭曲残差计算出的特征匹配进行扭曲,但是这些方法大都需要计算多个单应性矩阵,通过改进附加项优化拼接效果,或使用多张图像间的匹配关系进行计算,通常计算效率比较低。

本文主要针对全局单应性误差校正的问题,在不建立局部单应性的前提下允许拼接图像之间出现角度变化,通过球形校正算法提高图像拼接算法的效率和稳定性,可以解决大角度下视频图像的快速、稳定、持久拼接的难题。

1 基于特征的图像拼接方法流程

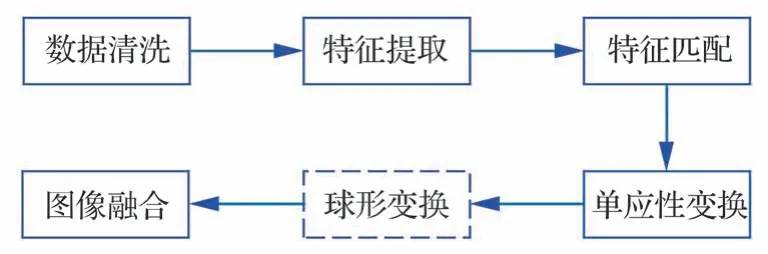

基于特征的图像拼接的通用方法一般包括数据清洗、特征提取、特征匹配、单应性变换以及最终图像融合。数据清洗主要对图像的几何畸变和色差畸变进行校正,特征提取主要使用特征描述算法计算图像中的特征信息,特征匹配对特征点进行匹配、筛选,并计算图像之间的几何变换模型参数,随后使用单应性变换完成拼接,使用融合算法进行融合。

在传统的拼接流程中,单应性误差积累问题使算法对视角不具有鲁棒性,因此本文主要改进了传统的透射变换模型参数计算,通过球形校正增加单应性变换对视角的鲁棒性,从而提升图像拼接算法的稳定性和效率,增加图像拼接算法的实用性,图像拼接流程如图1 所示。

图1 图像拼接流程图Fig.1 Image stitching flow chart

2 单应性误差校正

2.1 透射误差积累

单应性变换时产生误差,在进行基于特征匹配的图像拼接时,图像间的几何变换可以用单应性变换表示,因此需要基于局部特征进行单应性变换完成拼接过程,在连续2 张图像的重叠部分完成图像的配准,然而在非重叠区域的图像则会发生拉伸或压缩形变,在下一次拼接时基于已形变的特征进行配准,会使单应性误差不断积累,形变误差逐步放大,最终过度形变导致特征提取无法完成,从而失去匹配关系,如图2 所示。

图2 由于单应性变换误差累积而引起的图像失真Fig.2 Image distortion caused by accumulation of homography transformation errors

本文使用SIFT 特征提取算法、穷举法完成图像匹配,RANSAC(RANdom SAmple Consensus)算法完成匹配筛选,并最终计算得到透射变换模型,对68 张连续帧图像进行的一段图像拼接如图3 所示。在拼接之初效果较好,然而随着拼接次数增多失真逐渐严重,最后无法进行拼接。

图3 透射变换拼接效果Fig.3 Transmission transformation stitching effect

如果无人机处于平稳飞行状态,即不存在俯仰角和滚转角的变化,那么采集的图像数据在世界坐标系中处于同一平面上,因此图2 中的单应性误差大部分来源于计算误差,因此可以使用光束平差法对单应性误差进行消除,优化拼接效果。但如果对图像添加光束平差约束,图像之间需要具有相对较高的重叠率[11],同时需要以组为单位对图像进行计算,无法对2 张图像进行实时拼接。除此之外,无人机不可能处于绝对正射状态,实际场景中会引入角度变换,尤其是在应急场景中,因此算法需要考虑在无人机大角度下的拼接性能。

2.2 球形校正模型

设定首张拼接图像所在平面为基准平面ST,图像坐标系中特征点坐标为(x,y),相机坐标系中特征点坐标为(m,n,h),则拼接的全局相似性条件为在所有拼接图像在单次拼接后,端边界处的像素点集必须收敛到基准平面ST上,使2 张图像的像素点集X、Y满足:

式中:fx、fy分别为相机在x轴方向和y轴方向焦距的像素长度;cx、cy分别为相机主点的实际位置;rij、ti分别为旋转参数和平移参数,点集M、N为

式中:(mi,ni,hi)为相机坐标系中的特征点坐标;dwidth为相机在x方向上的最大像素距离;dheight为相机在y方向上的最大像素距离。

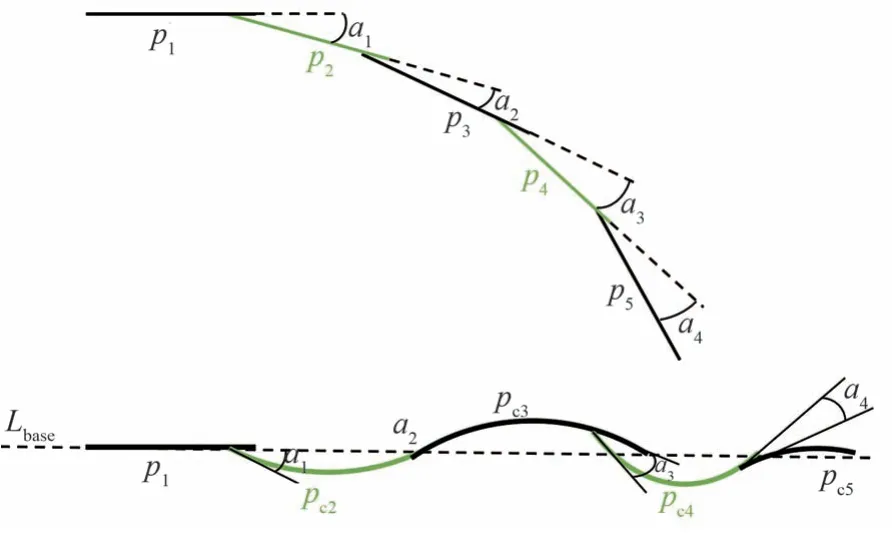

当拼接过程满足该约束时,能够保证拼接完成时视角距离位于初始水平,为了满足这一条件,本文使用球形对图像进行投射变换。图4 展示了p1~p5在进行拼接时发生了α1~α4的透射偏移,在经过不同半径的球形透射变换后,p2~p5图像变换为pc2~pc5,使得图像拼接后的边缘像素点收束到了ST平面,原本的单应性视角距离改变转化为了像素的波浪状形变。

图4 球形变换Fig.4 Spherical transformation

2.3 球参数计算

以图4 中首张图像帧p1所在的直线为基准线,记为Lbase,在随后的拼接中对其他图像做球形投影变换,第i帧图像pi球形投影变换后的图像记为pci,球半径记为r,使得每次变换后的图像进行配准时,保持右侧端点始终落在Lbase上。

在此方法下,设pi和pi-1之间的夹角为ai,pi和pi-1在y方向上的相对位移为di个像素,设pi的宽度为wi,则可以求解得出pci所在的球半径ri为

式中:Xi为相机位移在Lbase上的投影;αi为相机在Lbase方向的偏转角度,使用迭代法求解此超越方程,计算得到校正球半径ri。

对于相机位姿变化参数Xi和αi,可以通过无人机采集图像时的POS 信息直接得到,除此之外也可以使用PnP(Perspective-n-Point)算法对相机位姿进行大体估计计算。对于投影矩阵为

消去s后,可以得到2 个约束

假设有N个特征点,可以求线性方程组

式中:Pn为第n个像素点的齐次坐标;t1、t2、t3为[R T]的行向量,由于其为12 维度,所以6 对匹配点即可完成线性求解,获得相机位姿参数。当匹配点>6 对时,可以使用SVD(Singular Value Decomposition)方法求最小二乘解[18]。

2.4 球面投影

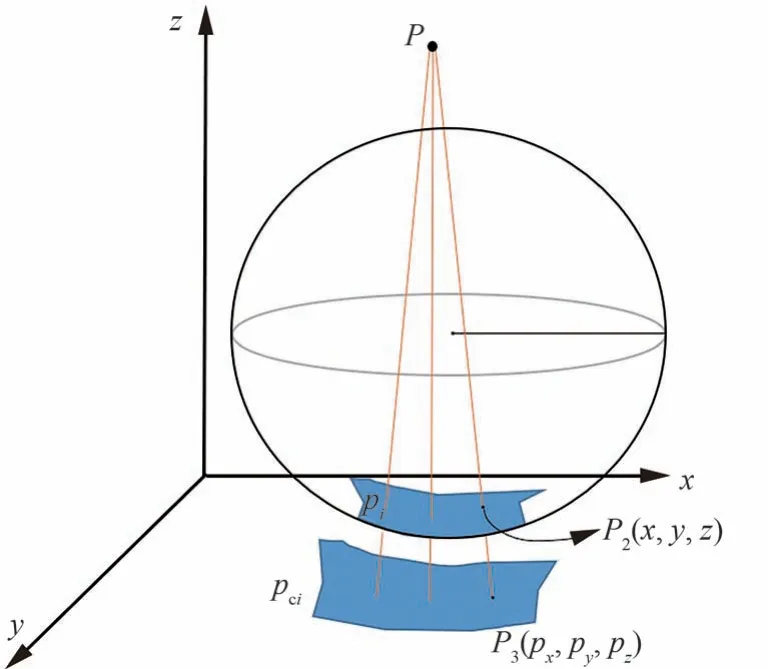

对pi进行以ri为半径的球形投影,如图5 所示,假设图像pi位于半径为ri球面上,此时pi上任意一点P2的像素坐标值记为(x,y,z),在(0,0,h)处设置一个光源点P,通过点P向z=0 的平面进行投影,设投影比例系数为k,从P通过P2投影到P3,则有

图5 球形投影示意图Fig.5 Schematic diagram of spherical projection

最终可得到pci的横坐标px=kx,纵坐标py=ky,式中:

球形投影的效果如图6 所示,可以看到右图为球形变换后的扭曲图像。

图6 球形投影效果图Fig.6 Spherical projection rendering

2.5 球形变换的效果分析

当图像进行球形变换后再进行单应性变换时,拼接后像素点集X、Y收敛到了基准平面ST上,使得图像间特征像素尺度向最初的特征像素尺度收敛,避免了次级拼接时的特征尺度变化的扩大。

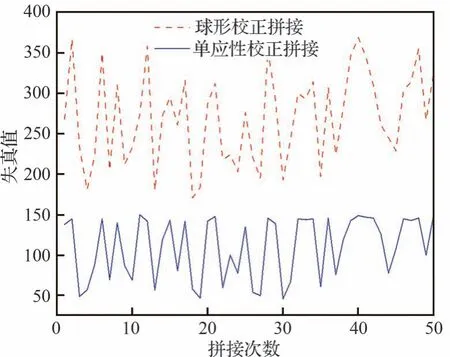

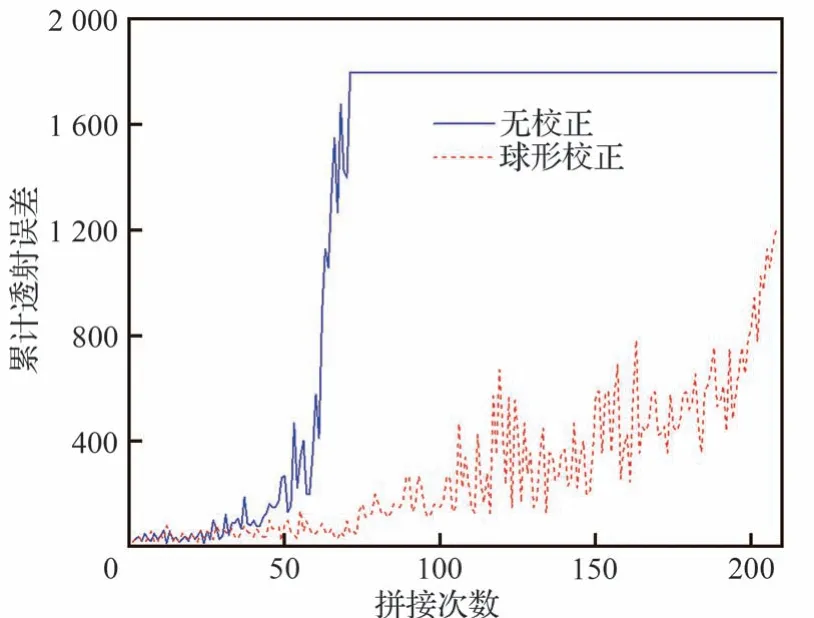

建立几何失真函数G,以图像单应性变化后的非刚体形变程度作为特征尺度均匀性的度量,即

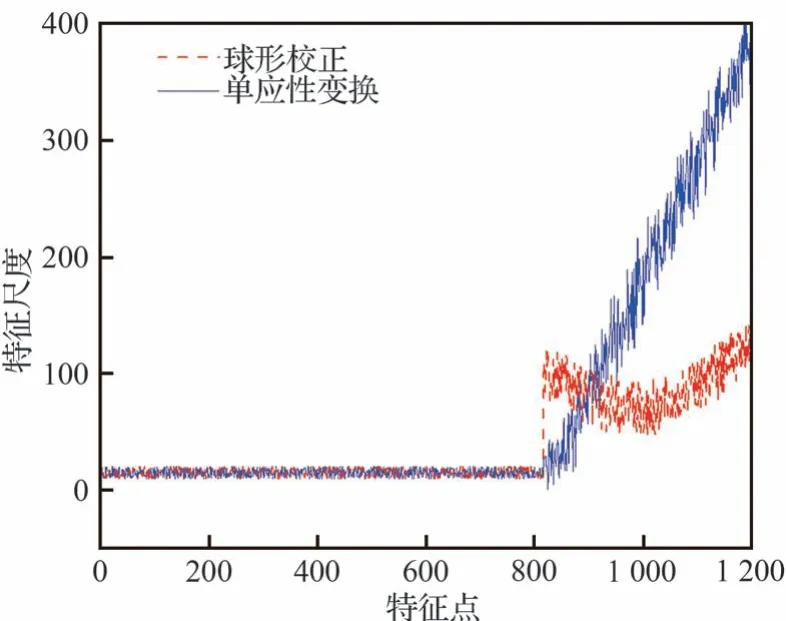

式中:w1、w2为原始图像的两对边宽为变换后图像的两对边宽分别为变换前后图像的高,αi为图像的第i个内角的角度。求取临边比和对边比偏离初始值的程度,以及各个角偏离初始角度的程度,相乘后作为特征尺度均匀性函数,分别对98 张匹配图像进行49 次单应性拼接,以及将其中的49 张配准图像进行球形变换后再次单应性拼接进行对比,结果如图7 所示。可以看出,经过球形校正的单应性拼接,降低了单应性变化带来的特征尺度不均匀性,因此在后续的拼接时降低了特征尺度不均匀带来的误差积累。

图7 单应性拼接和球形校正拼接后一系列拼接图像的几何失真变化Fig.7 Geometric distortion change between spherical correction and homography transformation on a series of images

而对于同一次拼接,分别计算单应性变换和球形校正单应性变换得到的拼接图像后,拼接图各个特征变换后与相邻特征距离的值的变化比例,如图8 所示。可以看到,由于在800 个特征之前(沿拼接方向)为参考图像,特征间的距离与拼接前后保持不变,而在拼接图像加入后,单应性变换产生的特征尺度变化迅速积累,在球形校正后的尺度变换被均匀的分散为整张图像的球面扭曲,从而降低了特征的尺度变化。相对于单应性变换来说,在拼接缝隙处增加了一些尺度不连续性,但是特征尺度的缩小将大幅降低单应性变换的误差积累。

图8 单应性拼接和球形校正拼接后单张拼接图像的特征尺度变化Fig.8 Features scale change between spherical correction and homography transformation on single image

3 基于球形校正的图像拼接效果

3.1 特征提取

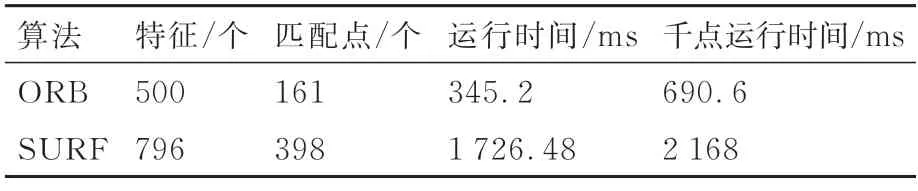

图像特征描述符是描述关键点周围像素信息的向量,由于无人机图像之间可能存在旋转、平移、缩放等变换,特征描述也需要具有平移、旋转、缩放和传输的不变性。目前,SURF 和ORB(Oriented FAST and Rotated BRIEF)是计算速度较快的特征描述子。Li 等分析了2 种算法的性能比较[19],如表1 所示。

表1 SURF 和ORB 的性能比较[19]Table 1 Comparison of performance of SURF and ORB[19]

虽然ORB 算法较快,但有效特征点数量不及SURF 的1/2,为了保证拼接质量,本文采用了SURF 特征描述符。对图9 左图提取SURF 特征点,特征如图9 右图所示,可以清晰地反映图像特征。

图9 利用SURF 算法提取特征点Fig.9 Using SURF algorithm to extract feature points

3.2 特征匹配

遍历每个特征点描述子与所有其他特征点描述子之间的距离,然后取最近的一个作为匹配点,这样可以获得最高的匹配精度,以特征点之间的最小欧氏距离建立最优解,即

式中:n为特征点的数量;xk、yk分别为该特征点在x方向和y方向上距离第k个特征点的像素距离。

如图10 所示,使用穷举法对2 幅部分重叠的图像进行特征匹配,并将匹配成功的特征点连接起来。

图10 SURF 特征点粗匹配Fig.10 Rough matching of SURF feature points

本文采用RANSAC(Random Sample Consensus)算法[20]对匹配点进行滤波。在滤波过程中,以最佳单应矩阵为目标,即寻找一个能满足单应变换且数据量最大的单应矩阵。单应变换满足

式中:hij为单应性矩阵的构造参数。

从匹配数据集中随机选择4 个样本,并通过确保4 个样本不共线来计算单应性矩阵。然后利用该模型对所有数据进行检验,计算出满足该模型的数据点数和投影误差,使相应的代价函数最小化。代价函数为

经过RANSAC 滤波匹配后,错误匹配明显减少,匹配质量大大提高,如图11 所示。

图11 RANSAC 精匹配Fig.11 RANSAC fine matching

4 试验结果分析

4.1 稳定正射图像的拼接效果

在无人机飞行较稳定、区域特征清晰时,对57 张连续帧图像进行传统的透射变换拼接,效果如图12 所示,可以看出拼接末端产生了一点失真,但整体失真情况较小。

图12 稳定正射图像的拼接效果Fig.12 Stitching effect of stable orthophoto images

在无人机飞行较不平稳、存在些许抖动时,对68 张连续帧图像进行传统的透射变换效果如图13 所示,可看出在拼接末端的失真明显。

图13 由于单应性变换误差累积而引起的图像失真Fig.13 Image distortion caused by accumulation of homography transformation errors

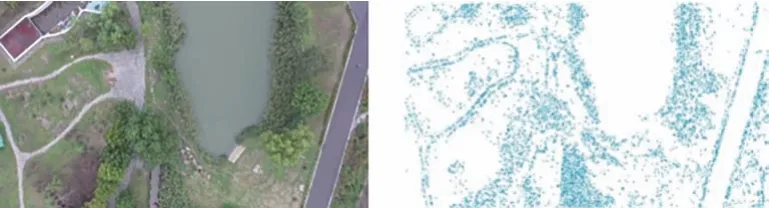

在加入球形校正的全局相似性约束后,对拼接图13 使用的68 张连续帧图像进行透射变换拼接的效果如图14 所示。可以看出,经球形校正后大大改善了单应性误差积累形变的问题,在拼接末端的像素比例基本与初始图像保持一致。如图15 所示,图中统计了拼接时图像形变引起的重投影误差,在基础拼接第70 次左右时误差快速放大积累,到达了视觉明显可见的失真后停止拼接,而加入球形校正后拼接第220 次时仍然能够保持视觉允许的失真程度进行拼接。

图14 经球形校正模型约束后的拼接效果Fig.14 Stitching effect constrained by spherical correction model

图15 校正算法优化前后的累积透射误差对比Fig.15 Comparison of cumulative transmission error before and after optimization of correction algorithm

4.2 大角度图像的拼接效果

如图16 左图所示,无人机在俯仰角存在较大变化的情况下采集到2 张图像,通过传统的透射变换进行拼接,效果如图16 右图所示。

图16 基于透射变换模型和特征匹配的大视角图像拼接效果Fig.16 Effect of large view image stitching based on transmission transformation model and feature matching

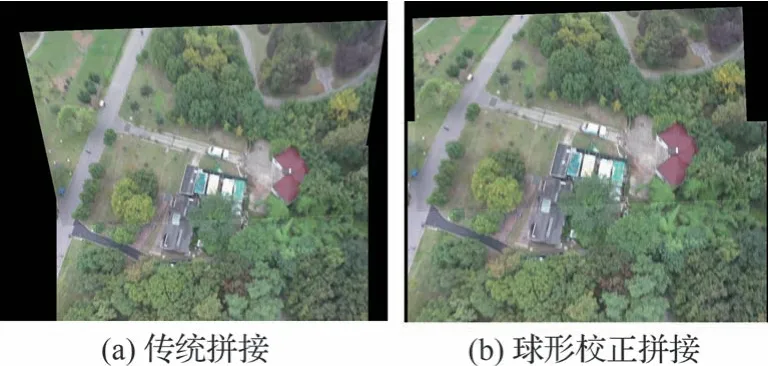

使用传统拼接和球形校正拼接算法对这2 张大角度变化图像进行拼接,如图17 所示,球形校正算法的拼接具有全局一致性,拼接边缘的像素比例与参考图像基本保持一致,没有出现图17(a)中出现的拉伸形变,这使得图像拼接途中允许一定的视角变化,不会由于误差和视角变化的干扰过早出现拼接失真,大大增强了算法的鲁棒性,更适用于实时应急拼接场景,代价则是在重叠处的接缝变得相对明显。

图17 传统拼接和球形校正拼接的效果对比Fig.17 Effect comparison between traditional splicing and spherical correction splicing

图18 为分别使用SPHP 算法和本文提出的球形校正拼接算法进行的校正结果,可以看到SPHP 算法和球形校正拼接算法都优化了拼接边缘的形变问题,SPHP 算法在拼接缝隙处的形变相对较大,在拼接边缘处正常收敛到了标准的全局像素比例;而球形校正拼接算法的形变则是均匀分散到了整张图,重叠区域对齐性较好,在拼接远处呈轻微过度收敛趋势,总体上都为图像增加了全局相似性。

图18 SPHP 拼接和球形校正拼接的效果对比Fig.18 Comparison of SPHP splicing and spherical correction splicing

4.3 大视差图像的拼接效果

图像拼接在采集具有视角差的物体时往往配准效果较差,拼接时具有明显的拼接缝隙,融合后容易产生鬼影,本文测试了具有视角差的高楼建筑地形的图像拼接。如图19 所示,对75 张连续帧图像进行拼接,由于无人机在飞行时建筑物表现出了视差,在基础拼接时很快产生了失真趋势,右图使用了本文的球形透射约束,能够看到降低了视差变换带来的单应性误差积累。

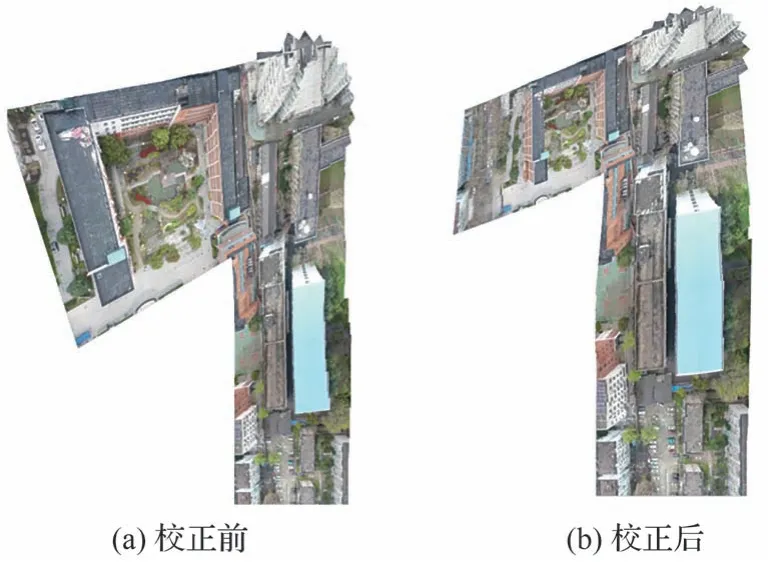

图19 存在视差图像的球形校正前后效果对比Fig.19 Effect comparison before and after spherical correction of parallax images

在图20 中对101 张连续帧图像进行了拼接,图20(a)展示了由视差变化引起的严重失真的一种情况,图20(b)采用了本模型的误差校正算法进行了预处理,提升了拼接的全局一致性,但仍然存在一定的视差导致的拼接误差。

图20 存在较大视差图像的球形校正前后效果对比Fig.20 Effect comparison before and after spherical correction for images with large parallax

4.4 算法效率分析

通过对同一地区连续采集的150 张图像使用不同算法进行拼接测试,算法的耗时情况如表2 所示,对比了ODM(Original Design Manufacture)、SPHP、和本文的球形校正算法(Ball)拼接耗时,由于不需要网格化计算多个单应性矩阵,球形校正算法在拼接效率方面有着较好的发挥。

表2 SPHP、ODM、球形校正算法耗时对比Table 2 Comparison of time consumption of SPHP,ODM,and Ball

在计算校正球参数时,相机位姿信息可以直接从POS 信息中获取,从而省去位姿估计耗时,当使用POS 信息辅助时,算法耗时情况如表3 所示。与SPHP 算法相比,平均每2 张拼接时间从2 345.25 ms 减少到1 528.6 ms,算法效率提升了34.8%

表3 SPHP、ODM、基于POS 的球形校正算法耗时对比Table 3 Comparison of time consumption of SPHP,ODM,and Ball based on POS

5 结论

通过球形校正算法,显著提高了基础拼接算法对相机角度变化的鲁棒性,从而使拼接算法在应急场景中更具稳定性;除此之外相对传统的单应性误差消除算法,球形校正算法提高了误差的校正效率,从而使拼接算法在实时性场景中更具实用性。

本文提出的球形校正算法将单应性误差积累问题转化为全图的波动形变,将误差分散到全图的模式相比于重叠区形变过滤、非重叠区进行相似变换的方法具有更好的拼接精度,但是会将单次拼接产生的波形误差向后传递。虽然这种传递不会像单应性误差一样积累,但是误差大小取决于全局中角度差最大的2 张图像,因此设计在平稳阶段逐渐将球参数调节回平面投影是有必要的,因此对于稳定时的波动消除也是我们下一步的研究方向。

除此之外,图像的POS 信息是非常重要的信息,在本文中已经直接使用POS 信息代替相机位姿的计算,实验表明能够显著加速球参数的计算过程,在此基础之上,研究如何通过原始相机位姿参数直接计算校正后图像的单应性矩阵也是非常有意义的研究方向,能够进一步对算法进行加速。