基于多尺度特征融合的钢材表面缺陷分类方法

2024-01-19田志新林彬彬

田志新,徐 震,茅 健,林彬彬,廖 薇

(1.上海工程技术大学 机械与汽车工程学院,上海 201620;2.上海工程技术大学 电子电气工程学院,上海 201620)

钢材生产过程中的表面缺陷分类与识别较为重要,而基于人工经验的判断不仅成本高且效率低下,利用计算机视觉替代人工实现缺陷检测是一种较为高效的方法。缺陷图像的纹理是一种重要的视觉线索,普遍存在但较难描述[1]。特征提取作为分类识别任务的关键环节,直接影响分类结果。传统方法通过手工设计特征提取模型进行特征提取[2],但是其在单一尺度上进行,不能反映图像特有的多尺度特征,缺乏图像的全局信息。纹理特征依赖于提取时采用的尺度[3],多个尺度下的图像特征均具有较强的表示能力[4]。研究发现多尺度分析更能有效地描述纹理特征。文献[5~11]针对多尺度特征融合、多尺度结合卷积神经网络(Covolutional Neural Network,CNN)特征提取方式,结合灰度共生矩阵(Gray Level Co-occurrence Matrix,GLCM)的多尺度特征提取方式以及Gabor多尺度特征提取方式进行了深入研究,并在遥感图像场景分类、航空图像分类和医学影像分类等领域进行了尝试。在特征提取阶段,CNN面向原始图像数据,在一定程度上可以弥补因图像变换等操作造成的信息丢失。CNN模拟了动物皮层的功能,能够感觉到不同空间特征的视觉刺激[12],且具有局部连接、权值共享等特点[13],能够自动检测出重要特征[14]。文献[15]通过设计多尺度CNN网络,融合不同尺度特征信息实现了对手势的精确识别。文献[16]认为CNN能描述类的边、角以及纹理等空间特征。

长短时记忆网络(LSTM)[17]是一种常见的深度学习模型。有研究人员将LSTM用于分类任务,取得了较好的效果。文献[18~19]研究了LSTM网络,并结合CNN卷积特征提取能力开发出集成分类方法,分别应用于图像分类和水果识别等领域。

本文提出一种基于Gabor变换和GLCM的多尺度特征提取方法。将原始图像通过Gabor滤波器进行多尺度变换,构建图像的多尺度空间。利用GLCM对多尺度空间下的图像进行特征提取,在数据域建立特征向量,同时使用CNN卷积层对原始图像进行特征提取。将GLCM提取的包含多尺度统计信息的特征与CNN提取的特征信息做特征融合。融和后的特征向量经过以序列方式输入LSTM网络分类器,实现对缺陷图像的准确分类。

1 方法原理

1.1 多尺度Gabor变换

Gabor滤波器是傅里叶变换的一种方式[20],也被称为Gabor小波。受哺乳动物的简单皮质细胞概念启发[21],其具有多尺度、多方向等特性,能够捕捉图像对应的空间位置、尺度以及方向等结构信息。

复数表达为

(1)

(2)

式中,λ代表波长;θ指定Gabor条纹方向;γ决定Gabor滤波器形状;σ表示高斯因子的标准差,影响Gabor滤波器的带宽;标准差和波长的关系为σ=0.56λ;Ψ表示相位偏移。

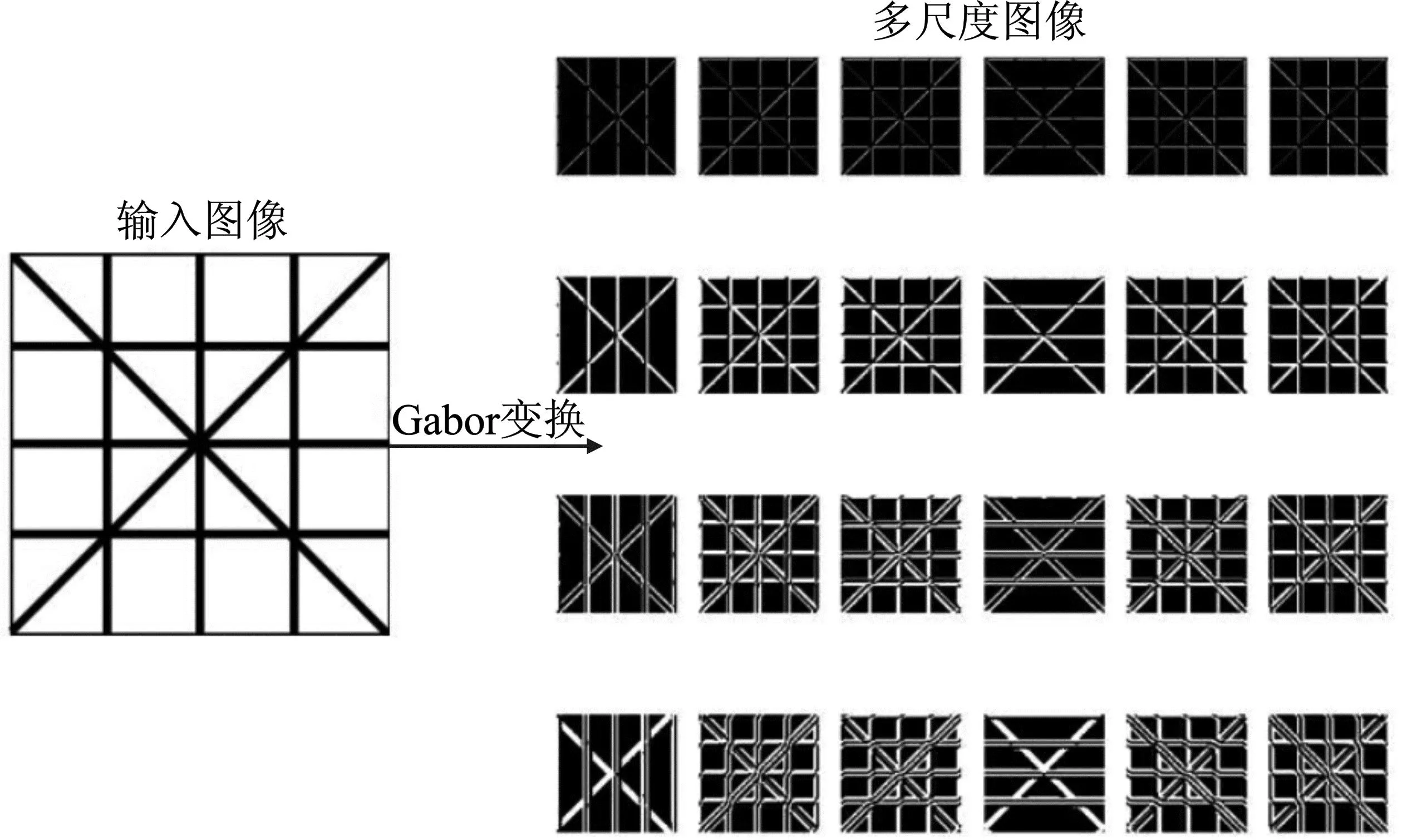

图像经过滤波器后生成各个尺度上的图像,多尺度变换结果如图1所示,图像通过Gabor变换后产生多尺度子图,各个子图在保留一部分原图信息的同时仍在各个方向上具有各自的特有信息。

图1 图像的多尺度变换Figure 1. Multi-scale transformation of image

1.2 灰度共生矩阵

图像以数据矩阵为方式在计算机里进行存储,携带较大数据量。为了减少运算成本,将输入图像数据转换为特征向量的简单集[22],该转换过程被称为特征提取过程。该特征向量包含相关信息,被作为分类的输入向量。

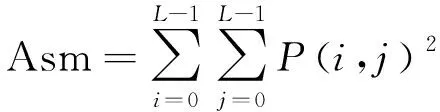

对经过多尺度变换后的子图进行特征提取,GLCM是一种传统且广泛应用的基于统计学思想的纹理特征提取方法[23-24],依据图像中距离较近的像素之间各种距离和角度关系进行计算[25]。在实际操作时,本文方法对原始图像统计一定方向和一定距离上像素对出现的次数,构成灰度共生矩阵,依据灰度共生矩阵计算并导出纹理特征数据,构成特征向量。

如果将14种纹理特征[24]都考虑进去,由于数据量较大将造成过拟合问题,并且有较多特征量线性相关性强(例如“和熵”、“差熵”与“熵”的意义相近),统计意义较小[26]。

本文选择“对比度”、“熵”、“角二阶矩”以及“逆差矩”4种特征量。

(3)

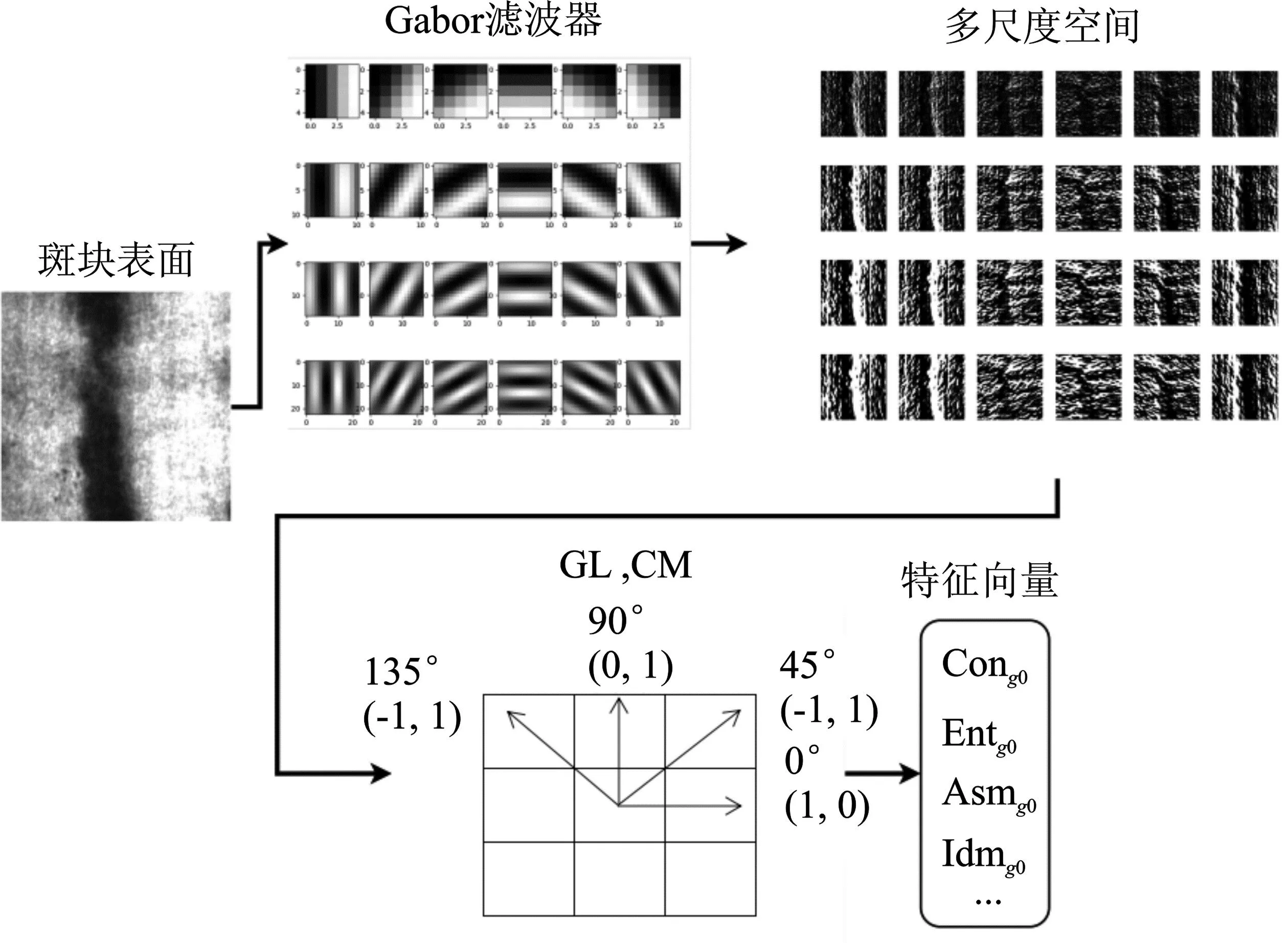

(4)

(5)

(6)

式中,对比度反映图像中局部灰度变化;熵表示图像所具有的信息量的复杂程度;角二阶矩反映图像灰度分布均匀程度;逆差矩反映图像纹理的局部变化;P(i,j)表示灰度为i和j的像素对出现的概率;L表示灰度级。

f={Conk,Entk,Asmk,Idmk}

(7)

fg={Cong0,Entg0,Asmg0,Idmg0,…,Congk-1,

Entgk-1,Asmgk-1,Idmgk-1}

(8)

式中,f为灰度共生矩阵计算的特征向量;fg表示各尺度子图的特征向量融合生成的高维向量;g表示Gabor变换后多尺度特征量;k表示第k幅图像。

2 相关工作

2.1 多尺度特征提取

本文选取Gabor滤波器组的θ角范围是[0,π],以π/6为增量分为6个方向,滤波器尺寸为3、5、7、9,构建四尺度六方向滤波器组,图2为多尺度特征提取过程。

图2 多尺度特征提取Figure 2. Multi-scale feature extraction

2.2 CNN特征提取

CNN是图像分类常用的网络结构,图像经过卷积、池化层以及BN层等处理后实现图像的特征提取。加深CNN层数可以的扩大感受野,但同时参数量也会增加。考虑到计算成本问题,部分CNN层使用空洞卷积,在增加感受野的同时减少了参数量,CNN模块的搭建如图3所示。

图3 CNN卷积模块Figure 3. CNN convolution module

经过两次3×3卷积与最大池化层实现图像下采样操作,然后通过3层不同膨胀率的膨胀卷积。为了解决多层膨胀卷积引起的“gridding effect”问题,b本文引入混合膨胀卷积(Hybrid Dilated Convolution,HDC)模块,膨胀率的选择应满足式(9)[27]。

Mi=max[Mi+1-2ri,Mi+1-2(Mi+1-ri),ri]

(9)

式中,ri为膨胀率;Mi为空洞数。当卷积核尺寸为3时,M2必须小于3才能避免空洞的产生。基于此,HDC层的膨胀率分别取r=1、r=2、r=3。

对卷积层输出的特征图进行维数压缩后输入全连接层FC,FC输出结点数与多尺度特征向量的维数相同。

2.3 多尺度特征融合

多尺度特征提取利用统计学方法,充分考虑了不同尺度下像素间的位置关系。而CNN卷积对图像语义特征信息的提取能力强,将两种特征向量进行融合得到增强版的纹理特征向量,在一定程度上丰富了多尺度提取的特征信息。图4为多尺度特征融合过程。

图4 多尺度特征融合Figure 4. Multi-scale feature fusion

2.4 分类模型

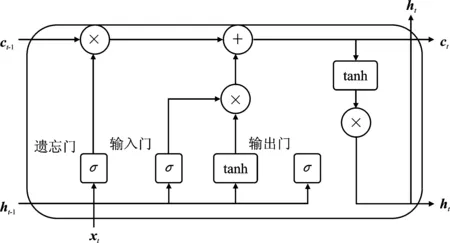

传统分类器在处理高维特征向量前先进行数据降维操作,从一定程度上降低模型运算量,计算量也相应减小。本文使用LSTM处理高维信息,其是循环神经网络(Recurrent Neural Network,RNN)的一种[28],引入“遗忘门”、“输入门”和“输出门”,有效解决了“梯度消失”和“梯度爆炸”问题,能更好地能处理长序列问题,其单元结构如图5所示。

图5 LSTM网络示意图Figure 5. LSTM network

对于分类问题,本文将图像提取出的多尺度特征向量fg定义为序列值xt,xt是一个96维向量。

ft=σ(Wxxt+Whfht-1+bf)

(10)

ft将参数xt与上一时刻输出状态ht-1合并后输入Sigmoid函数,实现将输入值映射到0~1之间,实现“门”的功能。

gt=tanh(Wxgxt+Whght-1+bg)

(11)

it=σ(Wxixt+Whiht-1+bi)

(12)

ct=ct-1⊙ft+gt⊙it

(13)

gt和it处理输入纹理信息,ct将当前时刻的信息累加到“记忆传送带”ct上,ct记录了长记忆信息,当前的图像纹理已经在“记忆细胞”内储存。

ot=σ(Wxoxt+Whoht-1+bo)

(14)

ht=ot⊙tanh(ct)

(15)

yt=Wyhht+by

(16)

式中,σ为Sigmoid函数;“⊙”为对应元素相乘的运算符;W为权重参数;xt为输入序列;yt为输出结果;b为偏置项;ot处理当前时刻输出纹理信息,将输出信息与长记忆带信息结合作为此刻的输出状态ht,最终输出采用“One-Hot”编码。损失函数选择交叉熵损失函数,根据目标输出值进行迭代,LSTM纹理分类器模型记录了图像在不同尺度下的纹理信息,从而充分利用了图像的多尺度信息。

3 实验与结果分析

实验流程如图6所示。原始图像经过图像预处理后通过Gabor变换,将图像映射到多尺度空间,经过GLCM进行特征提取。另一支路经过CNN网络将两路提取的特征进行融合,送入分类器网络进行分类测试,结果采用混淆矩阵(Confusion Matrix,CM)进行指标评判。

图6 实验流程Figure 6. Experimental flow

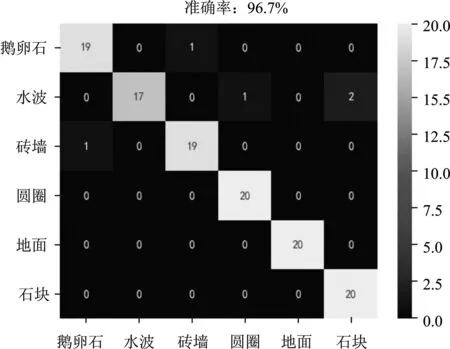

为了验证该方法的有效性,本文使用公开纹理数据集Brodatz进行实验验证,选取鹅卵石(cobble)、水波(wave)、砖墙(brick)、圆圈(circle)、地面(ground)以及石块(stone)6种纹理图片进行分类。纹理图像进行分块处理,生成100块子图,取前80块子图作为训练集训练模型,后20块作为测试集,搭建长短时记忆神经网络(LSTM)分类器对图像进行纹理分类,得到单尺度和多尺度下LSTM分类器的分类混淆矩阵和F1指标柱状图。

使用混淆矩阵记录LSTM分类器在不同尺度下的分类结果,如图7所示。

(a)

图7(a)是单一尺度下LSTM分类器对6个类别的分类混淆矩阵,分类准确率为96.7%。图7(b)是多尺度下LSTM分类器对6个类别的分类混淆矩阵,分类准确率为98.3%。

F1指标评价模型精确度,是准确率和召回率的调和平均数,计算式如式(17)所示。

(17)

式中,Precision表示准确率;Recall表示召回率。

由图8可知,多尺度下LSTM网络分类结果F1指标普遍较单一尺度下的分类结果F1指标高,表明多尺度下对每个类的分类精度较高。

图8 LSTM网络分类F1指标Figure 8. F1 index of LSTM network classification

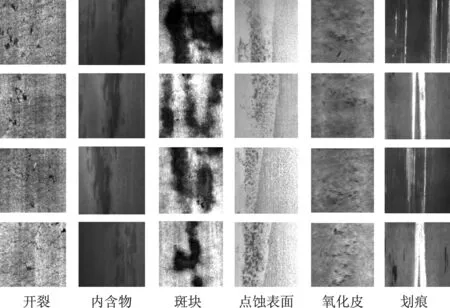

3.1 数据集

选择NEU数据集[29]中6种表面缺陷图片进行分类实验,分别为开裂(crazing)、内含物(inclusion)、斑块(patches)、点蚀表面(pitted)、轧制氧化皮(rolled-in)以及划痕(scratches)。如图9所示,每种表面缺陷有300张图像数据,每张图像为3通道200×200像素的bmp格式,按照8∶2的比例划分训练集与测试集。

图9 NEU数据集6类表面缺陷Figure 9. Six kinds of surface defects of NEU data set

3.2 特征提取

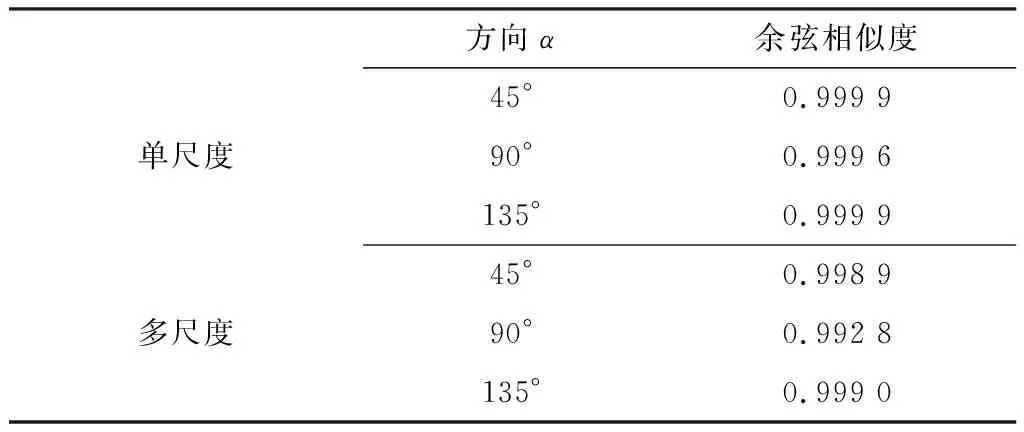

训练集图像经过预处理后,通过Gabor变换为多尺度图像,经过GLCM提取统计特征。文献[30]从理论上证明了的计算GLCM并不需要选取所有参数即可完整描述图像的纹理特征。

表1列出了在不做处理的单尺度图像与Gabor多尺度变换后的图像中,GLCM在像素对方向α取不同值时提取出的特征向量与α在0°时提取出来的特征向量的余弦相似度。可以发现,余弦相似度均约为1,说明只提取一个方向的特征量即可满足要求。因此,为了减少计算量,本文选择在0°方向上做灰度共生矩阵提取特征。

表1 不同方向与0°提取的特征量余弦相似度对比Table 1. Comparison of cosine similarity of feature quantity extracted from different directions and 0°

3.3 特征融合

经过预处理的训练集图像再经过CNN卷积模块提取特征。为了使CNN卷积模块初始权重去随机化,在参与特征提取前先将其FC层连接6分类Classifier结点在训练集上进行有监督训练。在测试集中达到80%的验证精度,然后去掉Classifier层,将其FC层接在GLCM特征输出上。

特征融合的方式有两种:1)直接进行特征向量的拼接;2)各元素数值相加。对这两种融合方式进行实验,结果如表2所示。

表2 不同融合方式的预测结果Table 2. Prediction results of different fusion methods

由表2可知,随着特征维数增加,预测结果降低,所需的预测时间更多。该现象可能是由于数据量大造成了模型过拟合,因此需采用元素相加的融合方式。

3.4 结果与分析

使用混淆矩阵(CM)记录LSTM分类器在本文方法下的分类结果,如图10所示。

图10 LSTM网络分类混淆矩阵Figure 10. LSTM network classification confusion matrix

图10表明,除了“点蚀表面”和“划痕”两类有错分以外其他类都能被正确识别。

由式(18)计算得到模型分类准确率为97.5%。

(18)

式中,TP为正类分类正确的个数;TN为负类分类正确的个数;FP为正类分类错误的个数;FN为负类分类错误的个数。由于本文为多分类问题,因此分子为所有类分类正确的总数,分母为所有的样本数。

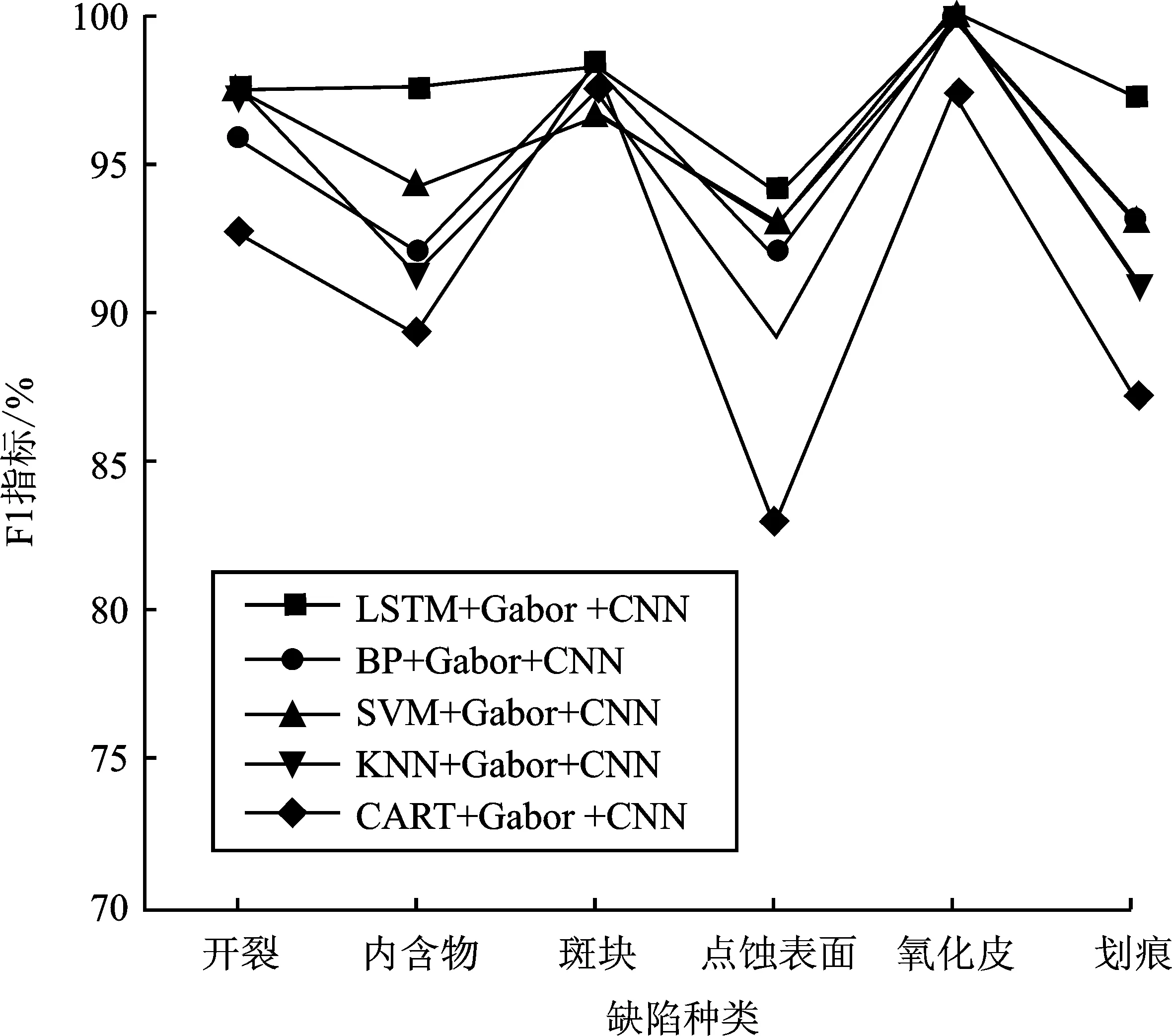

在多尺度特征和CNN特征融合的前提下分别使用LSTM、BP网络、SVM、KNN以及CART等分类器对纹理图像进行分类并将分类结果进行对比。图11为各个分类器对图像的分类F1指标。

图11 多尺度下各分类器F1指标Figure 11. F1 index of classifiers at multi-scale

图11表明,在Gabor变换后多尺度下,在同时使用CNN卷积进行特征提取的各个分类器中,LSTM表现最好,对于较难分类的“点蚀表面”类,其F1指标高达94%,而对于其余5个类别的分类的F1指标也都在95%以上。

在多尺度下,图像特征信息量较大,对KNN、SVM、CART等分类器易受到异常点影响,从而导致分类效果不佳。在这种情况下,神经网络分类器由于其复杂的网络结构,具有较好的处理复杂信息的能力。对于一般的神经网络,例如BP神经网络在一定程度上通过训练迭代使分类效果有所提高,但是在多维数据下,泛化能力较弱。LSTM网络在一定程度上对输入输出具有选择筛选能力,对于纹理图像的多尺度特征有一定的记忆能力,通过不断地迭代学习,LSTM网络模型可以充分利用多尺度特征信息,从而改善了分类效果。

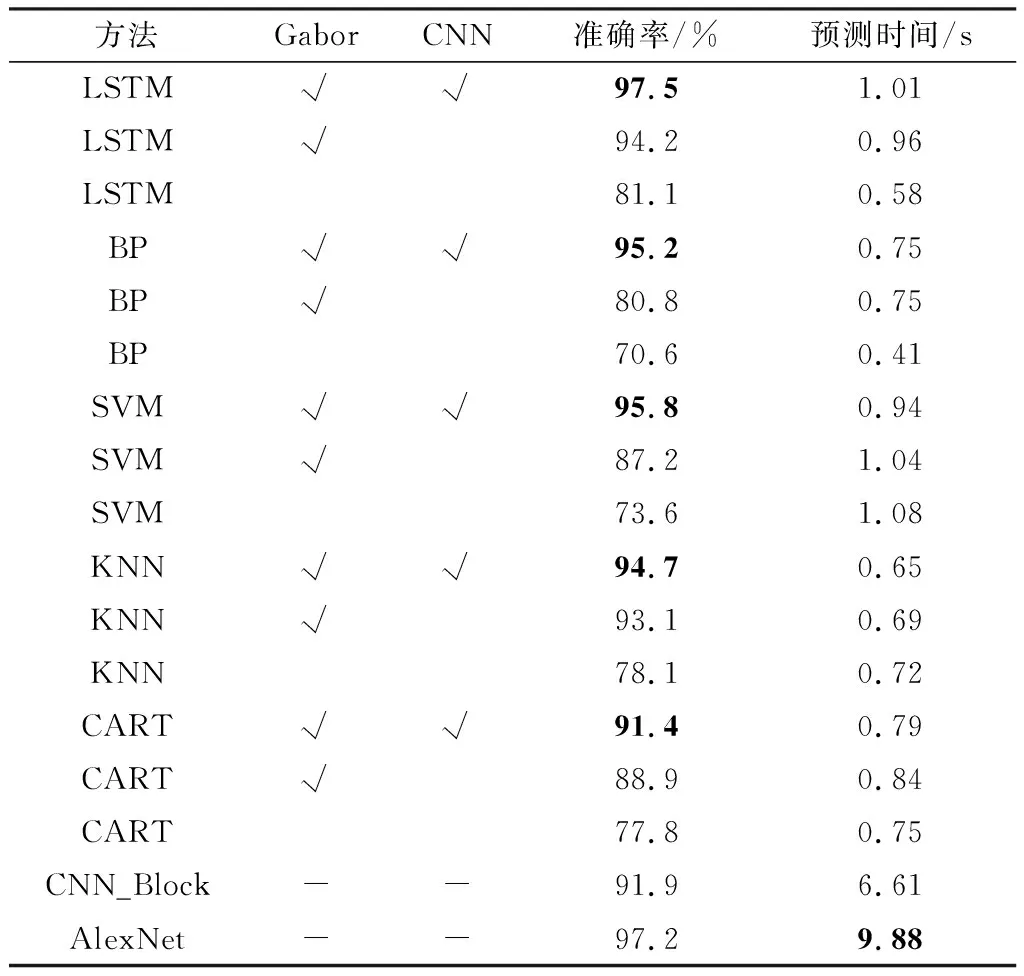

为了验证本文方法的普适性,进行了消融实验。本文搭建了机器学习中常用的分类方法SVM、KNN、CART以及深度学习神经网络LSTM、BP、CNN和AlexNet网络,实验结果如表3所示。表3中“√”表示使用了对应的特征提取方式,并将每种分类结果的准确度计算出来。

表3 各分类器不同特征提取方式结果对比Table 3. Comparison of results of different feature extraction methods of various classifiers

表3表明,使用了Gabor多尺度变换和CNN卷积提取特征融合后的LSTM分类器准确率最高,达到97.5%。同等分类器情况下仅使用Gabor多尺度变换的准确率较低,而不使用Gabor多尺度变换和CNN卷积模块的单一尺度分类效果较差。

CNN_Block为本文搭建的CNN模块,表3显示单独使用CNN_Block模块的效果并不好。由于神经网络深度以及迭代次数的影响,尤其是Alexnet等大型CNN网络较耗时,在综合考量检测实时性以及检测精度的情况下,采用本文方法能够达到较好的效果。

4 结束语

针对钢材表面缺陷分类问题,本文提出了一种基于纹理图像多尺度特征融合的分类方法。利用多尺度Gabor变换将图像映射到多尺度空间,并利用GLCM实现多尺度特征提取。其次采用引入HDC模块的CNN模块提取纹理图像的特征,将两种特征向量进行融合得到特征信息增强的特征向量。最后根据该融合特征向量的序列特性使用LSTM网络作为分类器。为了验证该方法的准确性,使用NEU数据集中热轧带钢表面的不同缺陷进行分类识别。利用LSTM、BP网络、SVM、KNN、CART,CNN以及AlexNet分类方法对测试集中的360张图像进行了分类检测,通过消融实验验证了该方法的普适性。基于LSTM分类的分类方法的准确率达到97.5%,在分类器中表现最好。实验结果表明,特征融合后以及采用LSTM进行分类的方法有效提升了纹理图像的分类精度。

本文方法实现了图像的多尺度特征信息提取,可同时用于缺陷等级划分等后续研究,对于钢材表面缺陷分类的研究具有意义。