基于改进MAE 的装甲车辆目标前景遮挡部分补全方法*

2024-01-16余晓晗毛绍臣綦秀利王家宝张所娟

余晓晗,毛绍臣,綦秀利,王家宝,张所娟

(陆军工程大学指挥控制工程学院,南京 210007)

0 引言

现代战争中,作为无人装备遂行侦察、打击行动的基础,目标识别能力不可或缺[1-2]。随着深度学习的发展,计算机视觉领域的图像检测算法层出不穷,极大提升了图像目标识别与分类的速度与精准度,如:网络简洁、识别快速的一阶段YOLO 系列算法[3-4]及SSD 算法[5],以Fast RCNN[6]、Faster RCNN[7]为代表的高精度二阶段算法RCNN 系列等。在此背景下,无人装备与计算机视觉识别紧密的结合,能有效增强识别战场目标的自主性及稳定性,提升作战行动效能。

然而在作战中,由于城镇、村庄、丛林等环境下建筑物林立和自然物众多,敌方目标往往有前景遮挡,对精确识别目标提出挑战,尽管前期研究者针对前景遮挡目标提出了一系列方法策略提升检测识别算法性能[8-10],但仍难以保证识别结果的置信度,达不到军事应用的可靠性要求,特别是当军事人员不能够从高比例遮挡的目标图像中直接分辨目标时,容易质疑算法识别结果。如果能先进行图像语义分割,实现前景遮挡物的分割,再补全图像中被前景遮挡部分,而后使用算法对补全图像进行识别,军事人员不仅能够得到识别结果,更能通过恢复出的完整目标,清楚算法识别的依据,有助于消除质疑,增强行动决策决心。其中,补全图像中前景遮挡部分是亟需解决的难点。

针对疑似目标存在大面积前景遮挡,影响军事人员和视觉识别算法可靠识别目标的问题,提出一种基于改进的掩码自编码器模型(masked autoencoders,MAE)[11]对疑似目标前景遮挡部分进行补全预处理的方案,以便军事人员结合补全图像确认识别结果,以更高的可靠性侦察或打击目标。展示了前景遮挡目标的补全结果,并与原始MAE 及生成式对抗网络等方法的补全结果进行了定性、定量比较,充分说明本文方法的实用性。

1 问题背景

无人装备在侦察中拍摄传回有前景遮挡的疑似目标图像(图1(a)),智能算法自动移除前景遮挡并补全目标图像(图1(b)),然后对补全后的目标图像进行识别检测(图1(c)),检测到敌方目标后,将目标图像补全结果与识别结果一起展示给军事人员,进行结果确认(图1(d)),作为后续决策的依据。

图1 对被前景遮挡疑似目标侦察流程示意图Fig. 1 Schematic diagram of reconnaissance flow for suspected targets sheltered by foreground

从图1 的前景遮挡目标图像看,有时人眼很难从高比例遮挡的图像中辨认目标,这种情况下,即使准确率很高的算法给出目标识别结果,军事人员也很难消除质疑和顾虑,更不用说依据此时的目标识别结果进行高风险决策。先补全后识别的方案,相当于使用补全结果对目标识别结果进行解释,从而提升算法的可信赖程度。

由于目标识别算法相对成熟,本文更关注如何从高比例前景遮挡的图像中补全目标的过程,实现高质量的目标补全效果。

2 相关工作及模型选择

侦察图像承载了大量的战场和目标信息,恢复出完整的受前景遮挡目标类似于将图像缺失的纹理和语义信息进行修复补全。得益于计算机视觉和计算机图形学相关领域的研究和深度学习的不断发展,数字图像修复相关算法已经取得了一系列显著的成果。

其中,在传统的图像修复方法中,基于结构修复的BSCD(bertalmio-sapiro-caselles-ballester)模型[12]及CDD(curvature-driver-difusions)模型[13]等,通过广播扩散机制,由等照度线的方向逐步向待修复区域填充,能够利用边缘信息补全破损图像,此类方法适用于修复尺度小的破损图像,面对较大或者纹理复杂的缺失区域,扩散的方法就会失效;基于纹理修复的相关算法则采用在完好区域内寻找与缺失区域相似度高的图像块来填充补全的思想,包括EFROS 等提出的马尔科夫隐式场[14]、CRIMINISI 等提出的纹理合成法[15]以及BARNES 提出的PatchMatch 算法[16]等,此类算法适用于较大区域受损的图像,但算法本身都较为复杂,不便于后续改进,且难以学习到高层次的特征,修复结果往往分辨率低或者存在伪影等问题。

深度学习的图像修复方法则大致可以分为基于自编码器的图像修复[17-18]、基于生成式对抗网络的图像修复[19-20]、基于边缘性对抗算法的图像修复[21]及上下文感知语义的修复方法[22],借助神经网络强大的学习能力,以上方法大都比较简洁,能够实现端到端的学习,而且可以获得图像高层次语义信息,图像修复后更加真实。但是,基于自编码器的方法网络结构一般较为简单,此类方法在纹理细节等方面存在问题,生成式对抗网络类模型容易出现训练不稳定、模型坍塌等问题,基于边缘性对抗学习算法的修复效果则会受到受损区域影响,当受损区域较大时,修复结果也不尽如人意。同时,神经网络训练时对计算量也有着一定的需求,需要迭代成千上万次才能获得一个性能较好的模型。

传统图像算法的灵活性不够、分辨率不高,难以高效解决现实现场景下大面积被前景遮挡目标补全预处理任务。采用深度学习的相关模型,同样需要面对以下难点:一是被打击军事目标本身具有迷彩伪装色,易与周围环境融合,加之敌方主动伪装、隐匿目标的手段丰富多样,因此,相比于人脸、手写数字、动物等普通遮罩图像数据,算法补全难度更大;二是相机拍摄的军事目标本身尺寸较大,对成像的清晰度具有一定的要求;三是军事目标数据集相比公开数据集更小,难以满足较大神经网络的训练需求,易出现模型过拟合的问题。

为解决上述问题,本文首先将前景遮挡统一马赛克式裁剪,然后基于已经在大规模公开数据集ImageNet-1K(超过120 万张图片)[23]上进行预训练的掩码自编码器(masked autoencoders,MAE),在对MAE 模型改进后,在车辆公开数据集和装甲车辆数据集上先后进行两次针对性微调,不仅集成了从数据集ImageNet-1K 上获得的大部分知识,也避免了从头训练模型对硬件、时间和数据集的高要求。另外,MAE中堆叠的注意力模块可以较好地区分目标伪装色及环境,可以实现对遮挡军事目标较为准确的补全。

3 基于改进MAE 的遮罩目标补全模型

3.1 MAE

MAE 是一种可以进行自监督学习的生成类预训练模型。该模型将自然语言处理领域模型(bidirectional encoder representa-tion from transformers,BERT)[24]的训练思路应用到计算机视觉领域,在训练时仅使用无标签的数据集进行训练。模型以完整图像作为输入,主动随机遮罩处理部分“像素块”(patch)后,利用其余未遮罩的“像素块”重建完整图像。其本质可以理解为一种去噪自编码器(denosing auto-encoder,DAE)[25],通过主动破坏输入信号,以重构原始未破坏信号为目标训练模型。MAE 模型架构如图2、图3 所示,图3 中字母L表示堆叠层数。

图2 MAE 模型架构示意图Fig. 2 The architecture of MAE model

图3 采用Transformer 结构的编码器、解码器结构示意图Fig. 3 The structures of encoder and decoder by using Transformer

MAE 采用了非对称式的编码器-解码器架构。编码器采用了以Transformer[26]为基础的ViT(vision transformer)[27]骨干网络,图像未被遮罩的“像素片”(patch)经过线性映射层被映射为特征向量,而后与对应的位置嵌入结合,输入编码器得到各个“像素片”对应的隐层表征。相较于编码器,解码器采用了更加轻量化的结构(即如图3 的Transformer 结构,编码器堆叠层数大于解码器的),以隐层表征和遮罩标志结合位置嵌入作为输入,重建原始图像,采用目标图像与修复图像的均方误差作为训练损失。

在原始的MAE 模型中,重建被遮罩的图像仅仅为MAE 预训练手段,训练完毕后,MAE 将舍弃解码器,编码器结合下游网络在下游任务上进行微调训练。如:在图像分类下游任务中,MAE 在编码器后接入一个分类网络,通过固定住编码器权重对分类器进行微调。由于本文需要解决的目标问题为前景遮挡图像的补全,因此,将继续使用MAE 的编码器-解码器结构。

然而,原始MAE 模型中,为了充分训练编码器,提高下游分类任务准确率,不仅未使用特殊标志CLS_token,同时,仅仅对遮罩部分计算训练损失,补全图像视觉效果存在一定割裂,除非将已知“像素片”在预测图像上作结合处理,否则直接成像整体性不强,需要针对任务目标进行改进。

3.2 改进MAE 及其结构

MAE 模型通过海量数据的预训练,已经使得编码器能够提取供解码器重建图像的语义特征,并展现出对未知区域强大的预测能力。因此,针对MAE的改进将从整体上继续保留编码器-解码器的结构。

训练时,固定编码器预训练权重,仅对解码器权重进行微调。同时,为了实现预测结果的整体性,本文借鉴了条件神经过程[28]和神经过程[29]的模型构建思想,为每个像素块设定一个完全相同的全局变量以增强最终成像的整体性。结合MAE 结构,本文选用原模型中未利用的特殊标志CLS_token 作为全局变量,该全局变量经过编码器获得的表征G 将同等作用于图像的每个像素块,与隐层表征结合作为解码器的输入。

与MAE 模型不同,训练后,改进的MAE 以被遮挡图像的已知像素片作为输入,预测完整图像。改进MAE 模型结构如图4 所示。

图4 改进MAE 模型架构示意图Fig. 4 The architecture of improved MAE model

编码器。输入图像统一调整为224×224 尺寸,而后被划分为多个规则、不重叠的“像素片”,每个片的尺寸为P×P×C(一般来说,P的大小为16,C为图像的通道数),并通过大小为P×P×C的卷积核将每个“像素片”映射为特征向量。通过划片及映射操作,输入图像的维度由(批次,通道,高,宽)变为(批次,高×宽,映射维度)。按照均匀分布,随机选择每张输入图像上25%可见的patch 子集(即不被遮罩的patch)对应的特征向量结合1-D 位置编码输入编码器,通过多层堆叠的自注意力机制相互处理提取特征,最终被编码为隐层表征(latent representation)。其余75%的特征向量进行遮罩处理,以便减少图像上的冗余信息,提升重建图像的难度。

隐层处理。编码器部分采用了ViT 的骨干结构[27],因此,编码器输入除隐层表征外,也包括特殊标志CLS_token。在原始MAE 模型中,虽然CLS_token 经过自注意力机制与其他像素片相互处理后,已经包含了大量的图像信息,但并未使用。在本文的改进模型中,富含未遮罩图像块语义信息的CLS_token 将作为一个全局变量,与隐层表征及非掩码表征相加,由此,可以维持预测图像全局信息的整体性,获得视觉效果更佳的预测结果。详见实验4.1 部分。

解码器。解码器的输入包括处理后的遮罩标志(图4 中解码器输入灰色部分)和隐层表征。遮罩标志采用了一个共享且可以训练的参数结合代替。两部分按照原图像中的顺序进行拼接,并与位置编码相结合,输入一个8 层、节点数为512 的Transformer解码器重建原始图像。

改进的MAE 模型在微调训练时,以预测图像整体与原始图像的均方误差为损失,通过梯度回传,仅调整训练解码器权重。鉴于装甲车辆军事目标样本数量有限,微调分为两个阶段完成。在第1阶段中,采用Compcars 车辆数据集[30]对模型进行初步训练,在模型基本收敛后,利用装甲车辆数据集对模型进行了第2 阶段的微调。

4 实验部分

4.1 训练设置及评价指标

4.1.1 训练设置

本实验的计算机配置为:CPU:Intel Xeon(R)Sliver 4114@2.20GHz*40;内存:64G;显卡:Tesla V100*4。编程语言为python,使用PyTorch 神经网络框架,训练时采用4 张显卡分布式并行训练,使用AdamW[31]的优化方式,beta=(0.9,0.95),学习率的优化方式使用Warmup,初始学习率设为5×10-3,预热10 代次。

为验证本文针对遮罩装甲目标恢复的方案,改进MAE 模型分阶段进行训练,第1 阶段采用Compcars 数据集训练,而后使用公开装甲车辆数据集*(包含不同国家的含装甲车、坦克、自行火炮在内的20 000 张图片),并选取其中的85%作为训练集进行2 次训练,其余图像数据作为测试集。

4.1.2 评价指标

装甲目标遮罩部分恢复的重建效果可以衡量算法的优劣,其评价可以分为主观评价(定性)及客观评价(定量)。其中,主观评价以人的观测对图像进行定性分析的一种评价标准。客观评价的指标则较为丰富,这些指标往往根据人眼的视觉系统建立模型,运用量化手段对成像结果进行评价,包括:MSE、PSNR、SSIM 等[32]。以上指标的具体定义方式如下:

1)均方误差(mean-square error,MSE)能够反映估计量与被估计量之间的差异,可以表示重建图像变化的大小:

式(1)表示图像X和图像Y所有对应像素点Xi和Yi差值平方的期望。

2)峰值信噪比(peak signal to noise ratio,PSNR)是目前应用较为广泛的图像评价客观指标,该指标反映了修复后的图像与原图像之间的失真大小,其值越大,表示失真越小、修图图像质量越高。其计算公式如式(2)所示:

3)结构相似性(structural similarity,SSIM)可以结合亮度、对比度、结构3 个方面度量图像相似性,更加客观地评价成像质量,其值越大,表示图像的质量越高。其计算公式表示为:

4.2 算法结果分析

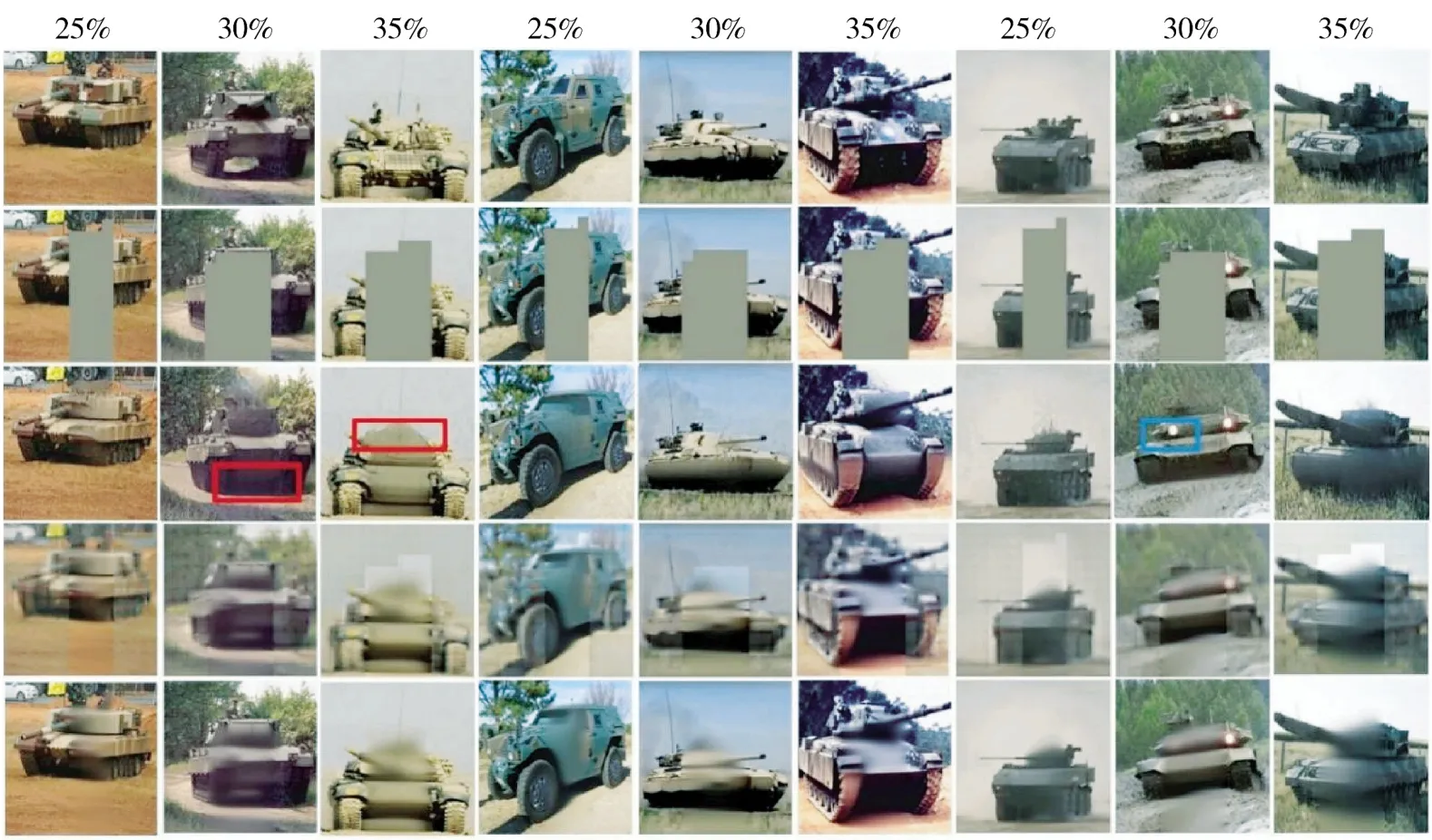

现实场景中,装甲目标前景遮挡物的种类多样,但从形式上可以划分为两类,一是丛林、植被等造成的散点随机遮挡;二是树干、巨型石块、房屋等带来的集中规则遮挡。因此,在本节实验中,也采用了两种马赛克遮挡模拟真实场景下对目标的遮挡,散点遮挡设置60%、70%、80%等不同比例,集中遮挡采用25%、30%、35%三种比例。

另外,为了更加全面地评估算法性能,对比模型表现,本文使用了多码生成对抗网络先验(Multi-Code GAN Prior,mGAN)[33]、原始MAE 等与改进MAE 模型进行定性、定量对比。

表1 和表2 分别展示了不同比例随机遮挡和规则遮挡图像补全指标数值。通过结果可以看到,遮挡的比例越大,修复后图像的失真越大,成像质量越低,与人的认知和预期基本一致,体现出各算法均有较好的稳定性。相比于较为规则的集中遮挡,随机遮挡修复后的成像质量更高,这一表现在MAE 类算法上尤为明显,主要原因在于该算法可以通过周围的已知像素块对未知部分进行计算或推测,遮罩过于集中时,即便遮罩比例并不高,也难以对该区域补全复原。虽然生成对抗网络相关模型本身具有很强的图像生成能力,以本文选定的mGAN为例,该模型能够实现图像增强、图像上色、图像修复多种任务,但其较强的修复能力主要体现在小面积遮挡或图片划痕等情况下。因此,面对装甲目标大面积遮挡图像的补全任务,同等遮罩比例条件下,改进MAE 算法在补全图像的精度上有明显优势,说明针对遮罩后装甲目标恢复,本文提出的策略更为有效。

表1 不同比例散点遮挡补全结果与原图像定量比较Table 1 Quantitative comparison between the occlusion complementation results of scattering points with different proportions and their original images

表2 不同比例集中遮挡补全结果与原图像定量比较Table 2 Quantitative comparison between the concentrated occlusion completion results of different proportions and their original images

图5、图6 展示了相关模型修复遮挡部分后的定性结果,效果展示采用了美国、德国、日本、印度等国家的主战坦克、自行榴弹炮、装甲车目标,含丛林迷彩及荒漠迷彩,具有较强的概括性。可以看到,修复图像的视觉效果优劣与上表中定量分析的结果基本一致。在遮挡比例较大的情况下,mGAN 整体性较好,且能够利用图像的对称性实现遮挡部分的生成,如图6 中能够预测出被遮挡的灯(图中蓝色框),但对前景遮挡部分的预测存在一定模糊、扭曲以及不够准确的情况,如图5 中生成的炮管长度、炮塔清晰度均存在一定问题(图中红色框),图6中30%、35%集中遮挡情况下无法预测车底空隙部分以及炮塔部分(图中红色框);原始MAE 算法与已知色块结合后,预测部分与已知部分的边界较为明显,从视觉效果来看,融合度不理想。改进后的MAE 算法与原图更为接近,虽然由于采用MSE 作为训练误差导致补全部分较为平滑,但胜在图像线条较为明显,补全视觉效果最好。

图5 不同比例散点遮挡补全结果效果Fig. 5 The occlusion complementation results of scattering points with different proportions

图6 不同比例集中遮挡补全结果效果Fig. 6 The concentrated occlusion complementation results of different proportions

4.3 应用效果展示

改进MAE 模型使其能够较为清晰地修复大面积遮挡的装甲目标,最终目的在于降低目标检测模型对目标识别检测的难度。如果该模型在装甲数据集上训练后产生了数据领域问题,即存在遮挡物的图像中本身并不存在装甲车辆,但模型在补全图像过程中主动生成了装甲目标,进而误导检测算法,将导致虚警、误警问题,反而会干扰军事人员对相关目标的判断。为此,本文另从图像类别多样的COCO[34]数据集中抽取了大量以草地、丛林为背景的图像,模拟装甲目标所处环境进行测试。实验中,采用了30%的集中遮挡与70%的散点遮挡分别进行测试,结果如图7 所示。

图7 非装甲车辆目标图像修复效果Fig. 7 The restoration effects of images with non armored vehicle targets

图7 中,虽然部分较小的被遮挡的目标,如马背上的人、马腿、部分斑马,无法清晰完整地补全出来,但是改进MAE 算法仍然能够对图像整体进行修复,且并未生成装甲车辆目标。其原因为:MAE 模型本身经过了大规模数据集的预训练,具有较强的补全能力,即便MAE 改进后并针对装甲车辆数据集进行了训练,其本身的预测能力仍然较强,并不会产生虚警问题。

为模拟现实场景中的应用,本节以丛林树叶装甲目标形成散点遮挡和树干形成的集中遮挡为例,展示目标图像补全效果。实验中,所有装甲目标原始图像本身均完整可见,本文为其添加了相同的丛林枝叶或树干遮挡物,并通过网格选定,将其处理为马赛克,经过改进MAE 模型处理,获得预测结果。实验效果如图8 所示。

图8 模拟现实场景中的改进MAE 应用Fig. 8 The application of improved MAE in simulated reality scenes

从图中可以得到,密集的树叶前景遮挡及粗壮的树干虽然对人判定目标产生了较大影响,且装甲车辆本身的迷彩色与枝叶颜色混合,干扰视觉判断,但经处理后,其马赛克比例相对于模型训练时遮罩比例更低,恢复难度不大。恢复后的装甲目标与真实目标相比,除部分完全前景遮挡的零部件外,整体观轮廓吻合,色彩非常接近,便于操作手的判定,基本能够达到对目标的视觉识别。

5 结论

无人装备侦察、打击与深度学习算法的结合是现代作战形式的一个缩影,显示出无人智能化作战注定成为现代战争不可逆转的趋势,也将成为各个军事强国交锋的军事科技战场,高速、成熟、配套、协作的智能化作战力量将取得最终的胜利。在推动人工智能与作战相结合的道路上,无数的成果正在竞相涌现,本文所提出的模型改进及补全识别策略仅仅是其中一点细微工作,能够实现对有前景遮挡物情况下的装甲目标还原,为军事人员对战场信息获取提供一定参考,但整体来看在算法的成像清晰度及部署仍然有较多的细节需要进一步研究、探讨,这也将成为下一步研究工作的重点。