跨模态跨尺度跨维度的PET/CT图像的Transformer分割模型

2023-11-18陆惠玲侯森宝彭彩月师宏斌

周 涛 党 培 陆惠玲 侯森宝 彭彩月 师宏斌

①(北方民族大学计算机科学与工程学院 银川 750021)

②(宁夏医科大学理学院 银川 750004)

③(北方民族大学图像图形智能处理国家民委重点实验室 银川 750021)

④(宁夏医科大学总医院泌尿外科 银川 750004)

1 引言

随着医学影像设备的发展,多模态医学图像成为医学图像分析的研究热点[1]。正电子发射计算机断层显像(Posit ron Em ission Tom og raphy/Com puted Tomography,PET/CT)图像是重要的多模态图像之一,结合了正电子发射型计算机断层显像(PET)图像对肿瘤检测的高灵敏度和电子计算机断层扫描(CT)图像的解剖信息,能够充分利用不同类型的医学图像对病灶信息描述的冗余性和互补性。

目前的多模态图像分割方法大多基于图像分析任务的知识融合来自每个模态的信息。Fu等人[2]引入一个基于深度学习的框架,使用多模态空间注意模块自动学习强调与肿瘤相关的空间区域进而分割出病灶区域。周涛等人[3]提出一种跨模态的多编码混合注意力U型网络(Multi-Encoder Attention UNet,MEAU-Net),该网络设计多编码器解决单模态医学图像病灶提取能力不足的问题。Kumar等人[4]用一种新的监督卷积神经网络量化每个模态特征在不同空间位置的相对重要性。上述表明,结合多模态图像可以获得更丰富的疾病信息。同时,多尺度信息能够结合高分辨率特征和高语义特征,实现对不同尺度目标的有效学习[5]。因此,针对目标对象多尺度问题,胡敏等人[6]提出一种基于改进U型神经网络的图像分割模型(A ttention U-Net p lus,AUNet+),该网络针对脑出血CT图像病灶部位多尺度的问题,提出残差8度卷积块融合不同层次的特征信息,提高对目标区域的特征提取能力。W ang等人[7]提出一种多尺度密集跳跃连接网络模型,该模型利用多尺度特征信息,有效地解决由于左心室边缘信息模糊和心脏区域收缩末期分割精度低而导致分割困难的问题。Zhou等人[8]提出利用密集连通性捕捉了多尺度上下文信息进行语义分割提高分割精度。

如何综合使用多模态医学图像,从不同角度提取多模态医学图像信息,避免不同医学图像的缺点同时又能获得更丰富的疾病信息,以及如何充分提取跨尺度上下文信息是肺部肿瘤医学图像分割需要解决的关键难题。针对上述问题,本文提出跨模态跨尺度跨维度的PET/CT图像的T ransformer分割模型,主要贡献是:(1)在编码器设计PET/CT主干分支和PET,CT辅助分支提取多模态图像信息;(2)在跳跃连接设计跨模态跨维度注意力模块(Cross-m odal and Cross-d im ension A tten tion Module,C2AM),从模态和维度的角度提取跨模态图像各维度的有效信息;(3)在瓶颈层提出跨尺度T ransform er模块(C ross-sca le T ransfo rm er M odule,CTM),自适应学习编码器的浅层的空间信息和深层的语义信息从而学习到更多的上下文信息,并从中获取跨尺度全局信息;(4)在解码器构造多尺度自适应解码特征融合模块(Multi-scale Adaptive Decoding Feature fusion M odule,MA-DFM),聚合并充分利用解码路径得到精细程度不同的多尺度特征图,有效抑制上采样中引入的噪声。

2 模型整体流程

本文跨模态跨尺度跨维度的PET/CT图像的T ransform er分割模型如图1所示,在编码器部分采用主辅网络思想,使用PET/CT图像(如图1所示加深颜色M区域)为主干网络输入,PET和CT图像为辅助网络输入;在瓶颈层部分设计跨尺度T ransform er模块,利用多尺度自适应编码特征融合模块(M u lti-scale Adap tive Encoding Feature fusion M odu le,M A-EFM)自适应地融合编码器前4层信息,并利用T ransform er编解码模块,实现全局上下文语义信息的建模;在跳跃连接部分将3种模态图像拼接传入C2AM,从模态和维度的角度捕获跨模态图像各维的有效信息,综合表达病变组织器官的解剖信息和功能信息,从而指导肺部肿瘤组织分割的过程;在解码器部分利用MA-DFM融合解码器各个阶段特征图,有效抑制上采样中引入的噪声。

从临床医学角度讲,多模态图像综合表达病变组织器官的解剖和功能信息,缓解单种模态医学图像病灶信息缺失的问题。因此本文使用跨模态跨维度的注意力机制捕获不同模态不同维度的空间语义信息。同时,U型网络(U-shaped Network,U-Net)编解码不同阶段的特征图具有不同的空间信息和语义信息,为了充分学习多尺度的上下文信息,本文在U-Net编码器和解码器使用多尺度特征融合的思想并调节相应的上下采样策略,实现对不同尺度特征图的充分利用。

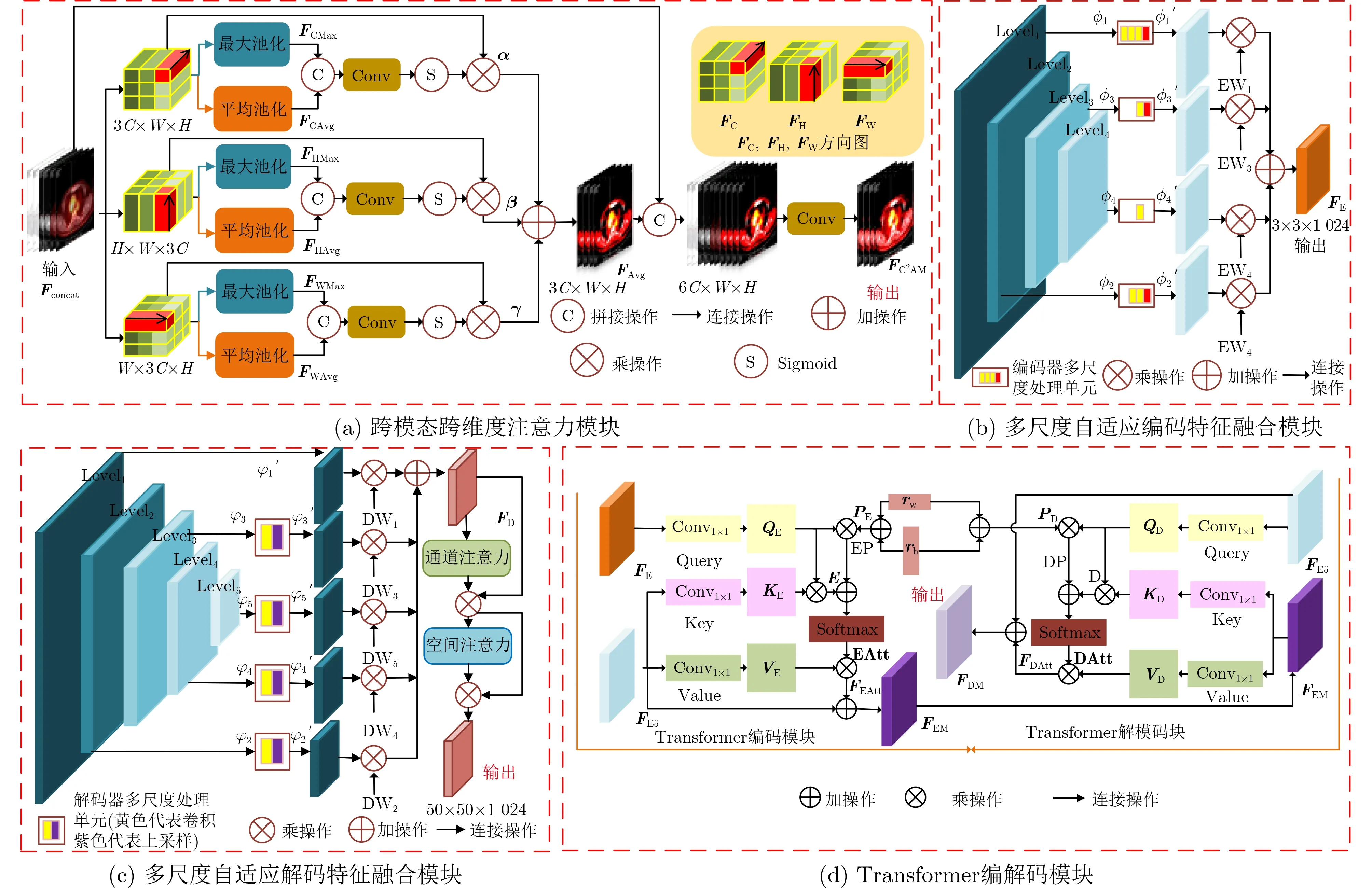

2.1 跨模态跨维度注意力模块

本文提出跨模态跨维度注意力模块如图2(a)所示,将3种模态特征图拼接为Fconcat;通过转置运算将Fconcat转换为分别以Channel,Height,W eigh为第1维度的特征图,记为FC,FH,FW并对每个维度的特征图使用空间注意力机制捕获不同维度的语义信息。例如在特征图FC上进行最大池化和平均池化得到FCMax和FCAvg,拼接两种池化的特征图后进行卷积和sigmoid操作并与FC相乘,得到Channel维度空间信息的特征图α∈R3C×H×W。同理可以得到Height和W eigh维度空间信息特征图β ∈R H×3C×W和γ ∈R W×H×3C,如式(1)—式(3)所示。对β,γ进行转置运算使其与Fconcat尺寸一致后进行平均运算得到FAvg有效融合不同维度的空间信息,如式(4)所示;最后将FAvg与Fconcat拼接并卷积输出,捕获多模态背景下不同维度的语义信息

图2 跨模态跨尺度跨维度模块

2.2 跨尺度Transformer模块

跨尺度T ransformer模块用于自适应学习编码器前4层多尺度特征图的语义信息和空间信息并提取跨尺度全局信息。该模块主要包含两个步骤:第1步,通过多尺度自适应编码特征融合模块提取多尺度上下文信息;第2步,利用T ransformer编解码模块捕获跨尺度全局信息。

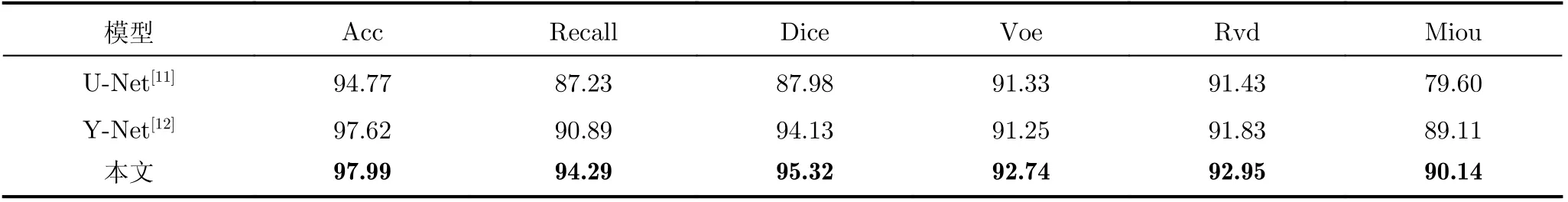

2.2.1多尺度自适应编码特征融合模块

本文使用多尺度自适应编码器特征融合模块学习对其他层次上的特征进行空间过滤,保留有用的信息组合。如图2(b)所示,该模块主要包含两个部分:编码器多尺度处理单元(Encoder M u lti-scale Processing Unit,EMP Unit)和自适应融合模块。

编码器多尺度处理单元:EMP Unit中黄色代表3×3卷积,红色代表下采样。该模块用于调节不同尺度特征图的下采样策略,使其与瓶颈层同尺寸。

2.2.2 Transformer模块

缺乏多尺度上下文信息会降低分割性能。受文献[10]启发本文设计了一个T ransform er编解码模块,建模全局上下文语义信息。该模块由T ransform er编码模块(T ransform er Encoding M odu le,TEM)和T ransform er解码模块(T ransform er Decoding Module,TDM)组成,具体如图2(d)所示。

TEM:T ransform er编码模块Query分支的输入为MA-EFM模块得到的多尺度自适应特征图FE,Key和Value分支的输入为具有高层语义信息的瓶颈层特征图FE5,利用高层语义信息指导提取跨尺度全局信息。首先,3个1×1卷积分别将FE映射为QE,将FE5映射为KE和VE并将QE和KE的通道压缩到C/8,即QE,KE∈RB,C/8,H,W,VE∈R B,C,H,W。为了使特征的自我注意操作对位置敏感,本文采用可学习参数分别从垂直和水平方向对特征位置进行编码得到PE并利用PE对QE进行编码得到 EP。然后,将QE和KE相乘计算相似度矩阵,在高级语义信息的引导下获得跨尺度全局空间信息相关权值。并将其结果与 EP相加,通过softmax获得注意权重EAtt。将其E Att与VE相乘,得到具有强全局语义的跨尺度全局特征信息FEAtt。最后,FEAtt与FE5进行元素级相加,得到跨尺度全局特征映射FEM。具体如式(7)—式(11)所示

TDM:与TEM类似,T ransform er解码模块Query分支的输入为具有高层语义信息的U-Net编码器瓶颈层特征图FE5,Key和Value分支输入为跨尺度全局特征映射FEM,在FEM的引导下,进一步提取特征图FE5中包含的强语义位置自相关信息。分别将FE5映射为QD,FEM映射为KD和VD。压缩QD和KD的信道使得QD,KD∈R B,C/8,H,W,VD∈R B,C,H,W。采用可学习参数分别从垂直和水平方向对特征位置进行编码得到PD∈R B,C/8,H,W利用PD对QD进行编码得到 DP;然后,计算QD和KD之间的相似度矩阵并将其与 DP相加,通过softmax获得注意权重DAtt。并将其结果和VD相乘,得到具有强语义位置信息的空间特征信息FDAtt;最后,FDAtt与FE5进行元素级相加,得到最终的跨尺度强语义全局特征图FDM。具体如式(12)—式(16)所示

2.3 多尺度自适应解码特征融合模块

本文使用一种多尺度自适应解码器特征融合模块,旨在自适应聚合解码阶段不同尺度的特征图,并通过串并联的空间和通道注意力机制使模型关注感兴趣区域。该模块主要包含3个部分,如图2(c)所示:解码器多尺度处理单元(Decoder Multi-scale Processing Unit,DMP Unit)、自适应融合、串并联的空间和通道注意力机制。

DMP Unit用于调节统一U-Net解码器各层特征图尺寸为(50×50),然后再融合,本文相应地修改了上采样策略,具体如式(17)所示

其中φi为U-Net解码器第i层 的特征图,φ′i为DMP Unit输出特征图,DMP Unit模块,通过卷积调节特征图通道数,通过上采样调节尺寸。

受文献[9]启发,在解码器部分构造了一个自适应融合规则,具体如式(18)所示

其中,D Wi是融合系数,代表解码器不同层特征图的权重,其值之和为1并通过训练得到。以λDWi为控制参数,利用softmax函数分别定义D Wi,如式(19)所示。并通过标准反向传播学习。最后利用串并联的空间和通道注意力机制进一步关注病灶区域得到最终的输出O utput如式(20)所示

3 实验结果与分析

3.1 数据集及预处理

数据集从宁夏某三甲医院核医学科收集,并进行预处理,从3个模态截取有较强区分能力的子图作为感兴趣区域(Region O f Interest,ROI)归一化为50×50。最终采用预处理后3种模态图像各2 025张作为训练集,各405张作为测试集。

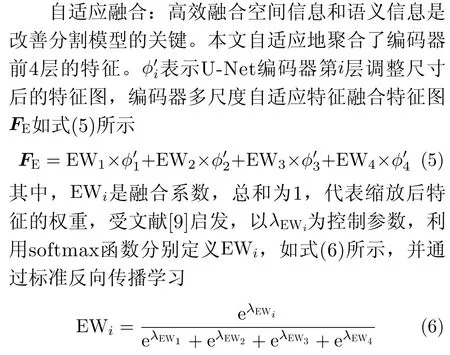

3.2 评价指标

本文使用的评价指标为准确率(A ccu racy,Acc)、召回率(Recall)、戴斯相似系数(Dice sim ilariy coefficient,Dice)、体积重叠误差(Volum etric overlap error,Voe)、相对体积差异(Relative volume difference,Rvd)和平均交并比(Mean intersection over union,M iou),为了方便显示各项指标的性能,本文所使用的Voe和Rvd评价指标结果为1减去模型测试值。公式定义如表1所示。其中,病灶区域被正确分割的定义为真阳性(T rue Positive,TP),正常组织区域被正确分割定义为真阴性(T rue Negative,TN),正常组织区域被分割为病灶区域定义为假阳性(False Positive,FP),病灶区域分割为正常区域定义为假阴性(False Negative,FN)。P表示模型预测的目标像素,G表示标签值(Ground truth)中的目标像素。

表1 评价指标

3.3 实验

本文模型基于Pytorch实现,实验室硬件环境服务器Intel(R)Xeon(R)Gold 6154 CPU,内存256 GB,显卡NV ID IA T ITAN V,py thon3.7,PyTorch1.7.0,CUDA版本为11.1.106。本文采用了Adam优化器,训练周期为120,学习率为0.0001,批处理大小为8。采用2元交叉熵损失函数反映模型预测值与实际值之间的差距。

实验思路:通过3组实验来说明本文所提模型的先进性,第1组实验证明跨模态图像对分割结果的影响;第2组实验与一些先进的分割网络进行比较;第3组实验证明跨模态跨维度跨尺度的有效性。

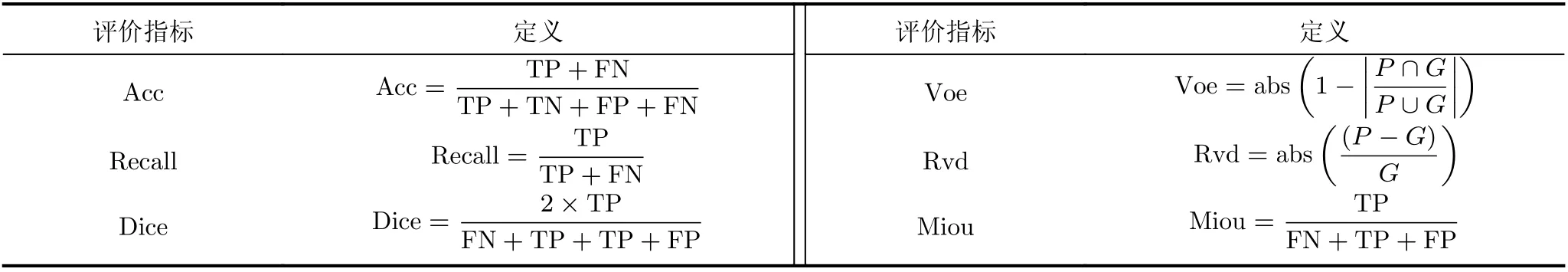

3.3.1跨模态相关性实验

本次实验通过3个实验来验证跨模态网络的优势。U-Net[11]网络,输入图像为PET/CT图像;Y-Net[12]网络,输入图像为CT与PET/CT两种模态图像;本文所提出的模型,输入3种模态图像,主干网络为PET/CT模态图像,辅助网络为PET和CT模态图像。不同网络分割结果如表2所示,图3为跨模态相关性实验的雷达图和可视化分割结果图,其中,图3(b)第3列为CT灰度图,在灰度图中能清晰地看出不同病灶区域的灰度变化。通过表2可以清楚地看出,Y-Net各项评价指标高于U-Net。而本文模型各项评价指标高于Y-Net,同样在图3(a)中,本文所提模型各项评价指数的坐标轴覆盖范围最大,证明了多模态医学图像有效缓解单种模态医学图像分割时病灶特征提取能力不足等问题;从图3(b)可以看出,U-Net仅使用单种模态图像,在分割不规则病灶时效果不如其他两种网络,例如第1行、第4行显示出的效果;Y-Net虽然相较于U-Net具有丰富的病灶信息,但病灶信息仍然不足,对于肺部病灶尺度形状大小不一与正常组织粘连等复杂的问题,分割处理时存在明显的缺陷,如第2行;而本文提出的模型,能够在模态、维度和尺度方面进行信息的互补,各项评价指标均得到了一定程度的提升,针对复杂的病灶有很好的分割效果。

表2 跨模态相关性实验分割结果(%)

图3 跨模态相关性实验的雷达图和可视化分割结果图

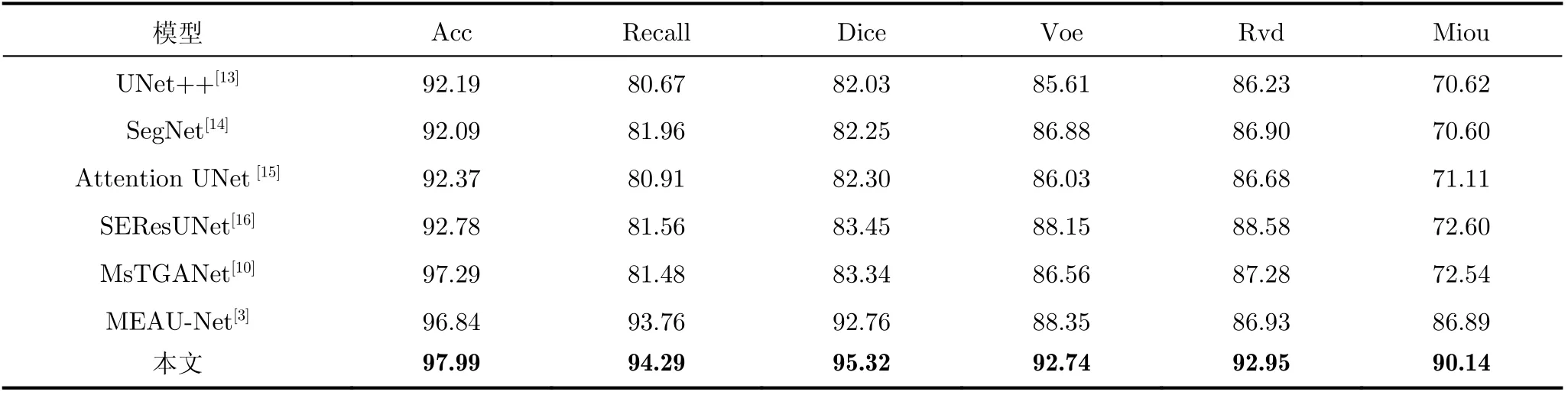

3.3.2不同分割网络对比实验

本次实验通过与6个不同先进分割网络对比实验验证本文所提模型的先进性,实验结果如表3所示。从图4(b)可以看出UNet++[13]第4行、第5行的病灶组织出现了肿瘤病灶断裂的状况,第1行和第2行不规则病灶区域分割效果欠佳;SegNet[14]没有出现病灶区域分割断裂的问题但对于不规则病灶分割结果明显欠佳;在第4行中,A ttention UNet[15]和挤压激励和残差UNet[16](Squeeze-and-Excitation Residual UNet,SEResUNet)在正常组织与病灶间均不同程度地出现了分割白点;多尺度T ransformer全局注意网络[9](M u lti-scale T ransform er G lobal A ttention Network,M sTGANet)有效解决病灶区域与正常组织粘连等问题。MEAU-Net[3]使用3种模态图像,但由于其不具有跨尺度上下文信息,第1行和第2行没有区分正常组织。通过图4(b)与表3中不同方法的对比,可以看出本文所提模型分割效果好,各项指数也高于其他网络。证明本文所提模型的可行性和先进性。

表3 不同分割网络对比实验分割结果(%)

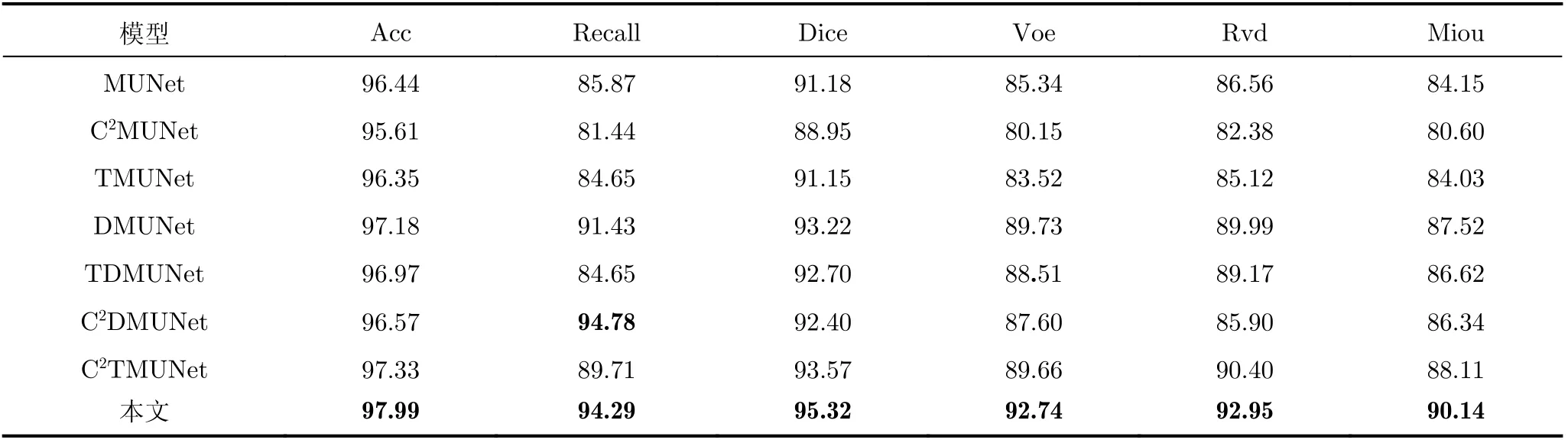

3.3.3跨模态跨尺度跨维度实验

本组实验共设计了8个实验验证跨模态跨维度和跨尺度方法的有效性。在本组实验中使用3模态输入称为多模态UNet(Multi-modal UNet,MUNet),在瓶颈层仅使用PET/CT,跳跃连接处将3种网络拼接传入;C2代表在MUNet中加入C2AM,T代表在MUNet中加入CTM,D代表在MUNet中加入MA-DFM;最后的本文行为本文所提完整模型。从图5(b)可以清晰看出加入CTM后,可以捕获跨尺度上下文信息,有效解决正常组织粘连的问题,证明CTM模块的有效性。C2AM模块能够提取跨模态图像不同维度的有效互补信息,从表4可以看出在MA-DFM模块和跨尺度T ransformer基础上添加C2AM模块相较于未加C2AM模块的分割结果评价指标明显提高,证明了C2AM有效性。但仅仅使用C2AM模块由于缺乏跨尺度上下文信息效果不佳,从图5(b)可以添加C2AM模块模型的分割效果明显改善。同时对比表4的实验结果表明MA-DFM模块能够有效地提高分割结果。尽管在主辅网络的基础上添加各个模块评价指标并不是依次逐渐提高,但最终所提出的模型合理地使用各个模块,评价指标和分割效果均为最优,对于肺部肿瘤与正常组织粘连、不同尺度的病灶以及复杂的病灶边缘都能有效分割。

表4 跨模跨尺度跨维度实验分割结果(%)

图5 跨模态跨尺度跨维度实验的雷达图和可视化分割结果图

4 结论

本文充分考虑多模态医学图像的特点。提出跨模态跨尺度跨维度的PET/CT图像的T ransform er分割模型。通过跨模态相关性实验证明本文提出的模型在跨模态方面的有效性;通过不同分割网络的对比实验中证明本文所提出模型的先进性;通过跨模态跨尺度跨维度实验证明各个模块的合理性。结果表明所提模型对于肺部病灶分割的Acc,Recall,D ice,Voe,Rvd和M iou分别为97.99%,94.29%,95.32%,92.74%,92.95%和90.14%,对于复杂的病灶分割,具有较高的精度和相对较低的冗余度。