基于跨域自适应的立体匹配算法

2023-10-21李传彪毕远伟

李传彪,毕远伟

基于跨域自适应的立体匹配算法

李传彪,毕远伟*

(烟台大学 计算机与控制工程学院,山东 烟台 264005)( ∗ 通信作者电子邮箱byw@ytu.edu.cn)

虽然卷积神经网络(CNN)在有监督立体匹配任务中取得了较好的进展,但多数CNN算法的跨域表现较差。针对跨数据域的立体匹配问题,提出一种基于CNN的使用迁移学习实现域自适应立体匹配任务的跨域自适应立体匹配(CASM-Net)算法。所提算法使用一个可供迁移的特征提取模块提取丰富的广域特征用于跨域立体匹配任务;并且,设计一个自适应代价优化模块,从而通过自适应地利用不同感受野的相似度信息优化代价,进而得到最优的代价分布;此外,提出一个视差分数预测模块,以量化不同区域的立体匹配能力,并通过调整图像的视差搜索范围进一步优化视差结果。实验结果表明:在KITTI2012和KITTI2015数据集上,CASM-Net算法的2-PE-Noc、2-PE-All和3-PE-fg相较于PSMNet(Pyramid Stereo Matching Network)算法分别降低了6.1%、3.3%和19.3%;在Middlebury数据集上,在未经重新训练的情况下,在和其他算法的对比中,CASM-Net算法在所有样本上取得了最优或次优的2-PE结果。可见,CASM-Net算法具有改善跨域立体匹配的作用。

有监督立体匹配;卷积神经网络;迁移学习;跨域;视差分数

0 引言

立体匹配算法对于理解三维场景和重建至关重要,已经广泛应用于无人机[1]、自动驾驶[2]和虚拟现实[3]等领域。通常,立体匹配算法指计算两幅经过矫正的图像中对应像素的水平位移,即视差。一般情况下,传统方法利用图像的先验知识构造一个立体匹配函数,得到一个密集的视差图[4]。

卷积神经网络(Convolutional Neural Network, CNN)因为具有强大的特征表示能力,已经被广泛应用于视觉任务,如目标检测[5]、图像分类[6]等。基于CNN的有监督立体匹配算法显著提高了立体匹配的性能,成为当前主流的研究方向。基于CNN的有监督立体匹配算法的主要流程包括:特征提取和代价构建及优化。基于CNN的立体匹配算法只有经过大型数据集训练多轮次后才能得到良好的表现,部分原因是小型数据集特征提取不够充分,导致算法跨域效果差[7]。近期,研究者提出使用注意力机制获取更广泛的特征。张亚茹等[8]提出了一种多维注意力特征聚合立体匹配算法以提取丰富的全局特征信息,增加信息交互以自适应地调整视差结果。Kendall等[9]最早提出通过残差网络(Residual Network, ResNet)结构获取图像特征,并使用它们构建代价立方体,并使用3D-CNN优化代价分布。对于代价构建与优化阶段,大部分算法使用单一尺度特征构造代价,但是不同数据集的图像分辨率不同,使用单一尺度代价可能导致信息丢失,影响跨域精度。此外,构造的代价立方体由于视差搜索范围固定,很难自适应地优化代价分布,这也是大多数算法鲁棒性差的原因。Rao等[10]提出了一个非局部上下文注意模块,通过优化上下文信息以自适应地调整代价分布。以上工作充分显示了特征提取和代价优化对于立体匹配任务的重要性。

为了缓解上述问题的干扰,本文提出了一种融合跨域特征信息的跨域自适应立体匹配(Cross-domain Adaptation Stereo Matching Network, CASM-Net)算法。首先,针对特征学习不充分的问题,使用迁移的特征提取模块提取广域特征,为跨域立体匹配任务提供丰富匹配线索;其次,提出域自适应代价优化模块,使用组相关方法[11]构造不同阶段多尺度代价,以逐阶段更新的方式优化匹配代价,通过对匹配代价回归得到视差结果;最后,提出视差分数预测模块,获取的视差分数可以调整视差范围,进一步更新视差结果,同时使用视差分数量化不同区域的立体匹配能力。

1 算法架构

本文提出了一个用于从一对矫正的图像中获取视差图的跨域自适应立体匹配(CASM-Net)算法,算法架构如图1所示。首先,输入的立体图像对经过一个迁移ResNet算法(即特征提取模块)获取图像不同尺度的广域特征;同时使用一个U型结构过滤广域特征,减少冗余信息干扰。其次,将不同尺度的特征图作为域自适应代价构建和聚合的输入,每个阶段经过一个编解码器结构过滤噪声,优化多尺度代价。最后,通过回归方法获得视差图,经过逐阶段更新视差结果,得到优化后的视差图。CASM-Net算法使用Smooth L1损失与平均绝对误差(Mean Absolute Error, MAE)损失共同监督算法训练。

图1 CASM-Net算法的架构

1.1 特征提取模块

特征提取影响着算法的立体匹配表现,本文选用了在大规模数据集上预训练的模型抵抗域偏移。文献[12]中提出了一种基于迁移学习的煤料立体匹配算法,但它应用的模型只是在特定立体匹配数据集上预训练。与上述研究不同,本文希望从大规模广域数据集中获取更多有利于立体匹配任务的线索,从而优化跨域立体匹配效果。在大规模数据集(如ImageNet数据集[13])上,算法能够学习各种风格的图像,因此可以很好地执行跨数据域任务。如图1所示,CASM-Net算法使用了在ImageNet上预训练的ResNet算法作为特征提取模块的骨干结构,并固定它的参数,因此在训练阶段,不更新它的参数,以提高算法训练效率。预训练的ResNet算法可以从浅层特征中进一步提取广域特征信息,与分类任务相比,CASM-Net算法只使用ResNet算法第3次下采样前的结构获取特征,最终可以得到原图大小1/2、1/4和1/8的特征图。基础结构包含2D Conv(Convolution)层、BN(Batch Normalization)层、ReLU(Rectified Linear Unit)激活函数和最大值池化(Max-pooling)下采样层。

此外,为了减少特征带来的冗余信息,并为之后的匹配代价构建提供更多的特定任务信息,CASM-Net算法使用一个U型结构进一步优化广域信息。该沙漏结构作为特征提取模块的一部分,随着特征提取模块进行训练并优化广域特征信息。U型结构虽然不使用大规模数据集训练,但是它仍具有域泛化的能力,原因在于它的输入是广域特征,同时U型结构也可以降低网络过拟合的风险。

1.2 域自适应代价聚合

通常只使用单一尺度的代价进行回归或分类会导致特征信息冗余或不足,可能在某一个域上过拟合,影响算法的鲁棒性。张锡英等[14]结合密集连接模块和空间金字塔池化模块获取多尺度特征,以构造多尺度代价;邱哲瀚等[15]使用稀疏卷积获取并融合不同尺度的特征信息;唐家辉等[16]使用4种不同尺度的特征提取模块提取多尺度特征。与上述研究相比,CASM-Net算法直接利用U型结构输出的多尺度特征信息作为多尺度代价构造的输入。

经过优化的多尺度特征信息通过组相关方法[11]构造多个匹配代价。与组相关方法使用的单一尺度特征相比,不同尺度特征构造的代价可以增加多尺度信息之间的交互。不同尺度代价分别经过编解码器进一步过滤噪声信息,低尺度代价上采样后与高尺度代价融合,减少由于病态区域而导致的误匹配。编解码器主要包括3D卷积层和3D反卷积层,编解码器的主要结构如图2所示。

图2 编解码器结构

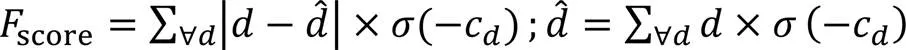

1.3 视差分数预测及视差更新

代价分布反映了候选像素对的匹配相似度,大多数情况下像素的代价分布为多峰分布,易导致高估计错误率。为了缓解上述问题,在融合3个由低到高的匹配代价后,对匹配代价进行视差分数预测,并将预测的分数作为视差范围预测的输入,视差分数的预测公式为:

通过调整视差搜索范围和预测视差分数,优化代价分布,增强算法对不同数据域的适应能力。

2 实验与结果分析

2.1 数据集和实验设置

1)Scene Flow[17]。大型合成数据集,图像大小为960×540,包括训练、测试图像对35 454、4 370张,提供视差真实值,最大视差为192。网络训练10个周期需要约50 h,学习率设置为0.001。

2)KITTI[18]。包括KITTI2012和KITTI2015,是具有挑战性和多样性的道路场景数据集,图像大小为1 236×376,仅提供稀疏视差图作为训练的标准。CASM-Net算法在这两个数据集上微调模型,网络训练300个周期需要约48 h,在前200个周期学习率设置为0.001,后100个周期设置为0.000 1。

3)Middlebury[19]。小型室内数据集,用于验证模型对真实场景的泛化能力,图像分为F、H、Q这3个尺度,最大视差为256。实验使用1/2大小的数据在模型未经重新训练的情况下进行验证。

4)ETH3D[20]。小型室内和室外场景的灰度数据集,包含27个训练图像对和20个测试图像对,该数据集带有稀疏的视差真实值,视差范围为[0,64]。实验在模型未经重新训练的情况下进行验证。

2.2 评估指标

2.3 消融实验及结果分析

对不同模块进行了消融研究,实验结果如表1所示。

1)特征提取。

分别使用原始ResNet算法和迁移ResNet算法进行对比实验。由表1可知,相较于原始ResNet,迁移ResNet可以达到更优的性能。在3个数据集上,使用迁移ResNet的3-PE均有所降低,其中,在KITTI数据集上,使用迁移ResNet的3-PE降低了15.2%。虽然迁移ResNet与原始ResNet的推理时间相同,但由于迁移的ResNet算法训练阶段参数不需要更新,算法训练的效率得到了提高。使用迁移ResNet获得的特征可视化结果如图3所示,可以发现,两个样本获取的特征图包含大量的纹理信息,并且不同特征对不同信息各有侧重。如图3第2列对轮廓边缘的信息较敏感,图3第3列对小物体的特征值较高。定量和定性结果都显示使用迁移ResNet有很好的特征获取能力,有利于立体匹配任务。

表1 在多个数据集上不同网络设置的实验结果

2)代价优化。

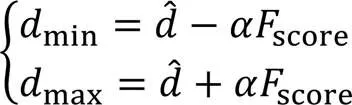

由表1可知,相较于单尺度代价优化方法,CASM-Net算法的多尺度优化方法在损失少量推理时间的前提下可以获得更好的性能。具体地,在3个数据集上,相较于单尺度代价优化模型,多尺度代价优化模型的3-PE均有所降低,在KITTI数据集上效果最明显,为34.0%。由定量结果可知,多尺度代价优化模块在损失少量推理时间的前提下,达到了更优的性能。由于代价分布较为复杂,本文研究了不同阶段代价优化模块,实验结果如图4所示。由于输入图像包含无纹理区域、遮挡区域等病态区域,而不准确的初始匹配代价通常会导致匹配错误,获得错误视差结果。如图4所示,当使用单尺度代价优化时,4个样本的代价概率分布呈多峰分布,不利于算法通过匹配代价获得最优的视差结果;当使用多尺度代价优化策略时,代价概率分布趋向于单峰分布,且最优代价值趋向于视差真实值。实验结果表明,多个阶段的代价优化策略可以优化代价分布,从而获取最优视差值。

图3 使用迁移ResNet算法预训练特征的可视化结果

图4 不同尺度下代价预测策略的代价概率分布

3)视差分数预测。

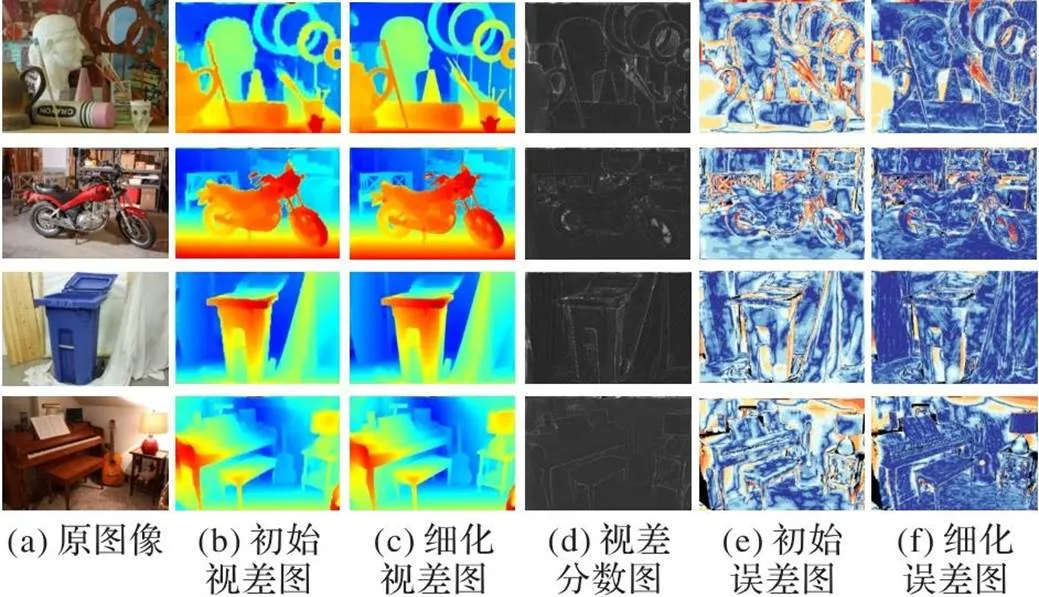

不同阶段的代价由于尺度不一致,视差搜索范围变化较大,而简单地对图像上采样可能导致错过真实视差。本文提出的视差分数预测通过调整不同阶段的视差搜索范围,得到最优视差。由表1可知,视差分数预测有利于提升立体匹配性能,其中在KITTI数据集上3-PE降低了27.7%,在Middlebury和ETH3D数据集上误差也有所降低。此外,本文还将预测的视差不确定性分数图,以及视差分数预测前后的视差图和误差图进行了对比实验,实验结果如图5所示,其中,误差图中的暖色区域表示误差较大的区域。经过视差分数调整后,与初始视差图相比,细化视差图的视差边缘更平滑,并且误差图中的暖色区域明显下降,验证了视差分数优化视差的能力。由式(1)的计算过程可知,当代价概率分布呈多峰分布时(如视差边缘区域),由式(1)得到的视差分数值较大;当代价概率分布趋向于单峰分布时,由式(1)得到的视差分数值较小,呈多峰分布的代价曲线,有更大的概率得到错误的匹配结果。这也就意味着误差较大的匹配点视差分数也越大,符合图4中不同代价的抽样结果。定量和定性实验结果显示,视差分数预测可以优化视差结果,提升立体匹配性能。

4)损失函数。

由表1可知,相较于只使用Smooth L1损失函数,搭配使用MAE损失函数后,算法性能在3个数据集上也有小幅提升。

图5 不同阶段视差图和误差图的对比结果

综上所述,算法各个模块均能不同程度地优化立体匹配性能,且不会消耗过多的时间。

2.4 跨域性能分析

为了验证算法的跨域泛化性能,本文选用了KITTI、Middlebury和ETH3D数据集作为测试集,Scene Flow数据集作为训练集对算法进行实验。实验的对比算法如下。

1)半全局立体匹配(Semi-Global Matching, SGM)算法[21]。SGM算法是一种较成熟的传统算法,跨域立体匹配表现较为稳定。与SGM算法相比,CASM-Net算法引用了广域特征信息,并设计了一个域自适应的代价优化模块,实现跨域立体匹配任务。

2)PSMNet(Pyramid Stereo Matching Network)[22]。经典的端到端立体匹配算法。与CASM-Net算法的多尺度代价优化策略不同,它使用了一个级联的沙漏模块优化单一尺度代价。

3)SegStereo算法[23]。该算法将分割数据集上训练的分割子网络迁移到立体匹配任务中,改进了视差边缘的结果。与SegStereo算法相比,CASM-Net算法利用了ImageNet广域数据集上预训练的模型并迁移到立体匹配任务中。

4)PBCP(Patch Based Confidence Prediction)算法[24]。该算法引入一个置信度预测网络预测视差置信度,再将置信度与SGM传统算法融合,利用预测的置信度调整SGM算法的惩罚项。

5)CRD-Fusion(Confidence guided Raw Disparity Fusion)[25]。提出一种针对遮挡区域的置信度预测方法,通过置信度的引导,优化遮挡区域立体匹配效果。与上述两种算法相比,CASM-Net算法在成本优化的中间阶段预测视差分数,利用视差分数端到端逐层更新的方式优化代价分布。

6)iResNet[26]。iResNet是一个使用多尺度特征进行视差优化的立体匹配网络,与CASM-Net算法相同,使用多尺度特征构造代价并优化。

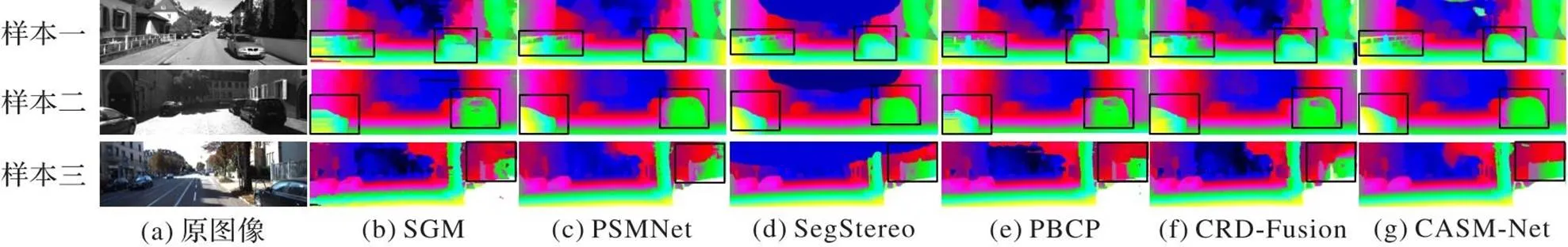

在两个KITTI数据集上的测试结果如表2所示。与PSMNet相比,在KITTI2012数据集上,CASM-Net算法的2-PE-Noc、2-PE-All分别降低了6.1%、3.3%;在KITTI2015数据集上,3-PE-fg降低了19.3%。在KITTI2015数据集上,与SegStereo相比,CASM-Net算法的所有误差指标更优。定性实验结果如图6所示,对于一些病态区域,如无纹理区域和细薄结构等,相较于SGM和PSMNet,CASM-Net算法可以产生更平滑且正确的视差图;相较于SegStereo,CASM-Net算法在细薄结构上取得了更好的视差结果(图6中样本一)。因此,CASM-Net算法可以很好地适应KITTI室外数据域。

表2 在KITTI数据集上不同方法的实验结果

注:Noc(Non occluded)表示非遮挡区域;All表示所有区域;bg(background)表示背景区域;fg(foreground)表示前景区域;加粗数据为该列最优值,下划线数据为该列次优值。

图6 在KITTI数据集上不同算法的定性结果

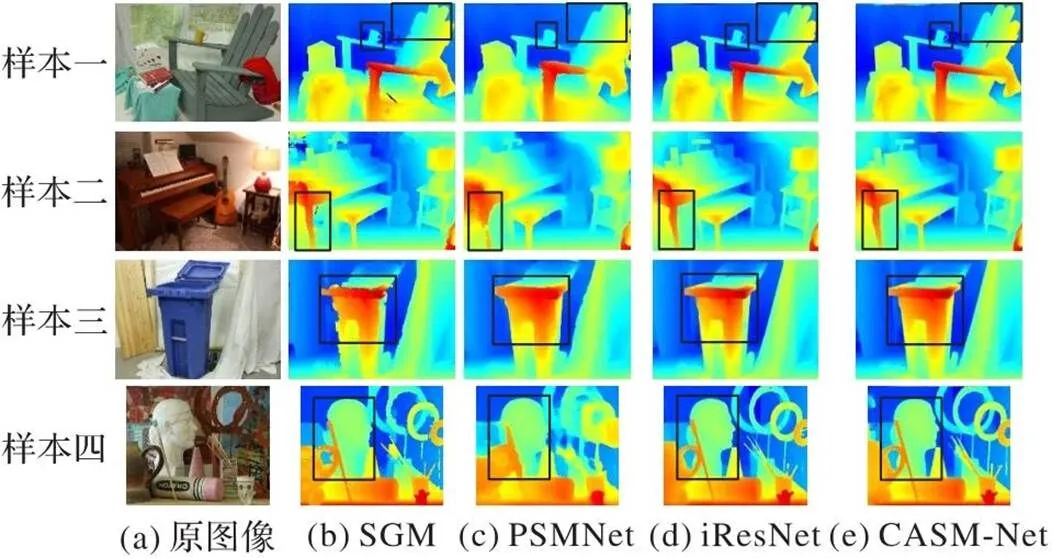

此外,本文选取了Middlebury训练集中的Adirondack等7个典型室内样本进行验证,实验结果如表3所示。在未经重新训练的情况下,CASM-Net算法的2-PE在Teddy以外的样本上取得了最优或次优结果,在样本ArtL、Piano和Recycle上取得了最低的误差;此外,在KITTI数据集上表现一般的SGM在Middlebury数据集上的表现良好。

表3 在Middlebury数据集上不同算法的2-PE结果 单位:%

Middlebury数据集上的定性实验结果如图7所示,相较于SGM和PSMNet,CASM-Net算法对细薄结构视差预测更准确且视差边缘较平滑。

图7 在Middlebury数据集上不同算法的定性结果

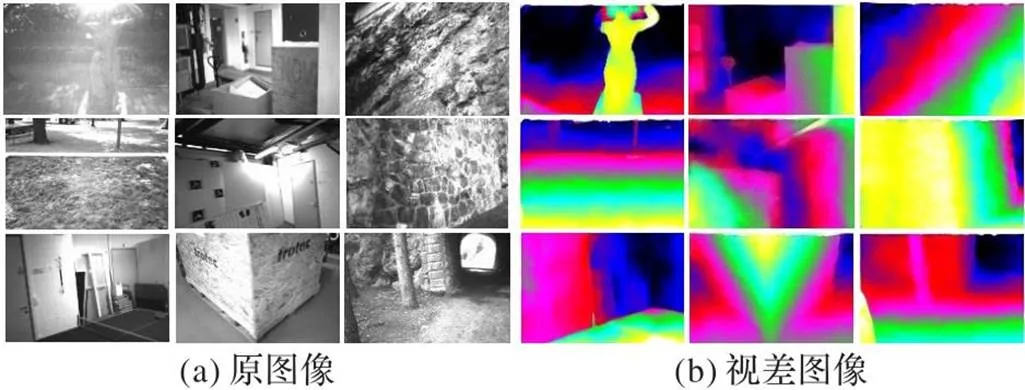

图8显示了CASM-Net算法在ETH3D数据集上取得的定性实验结果,可以发现,ETH3D数据集包含室内和室外场景且均为灰度图像;对于大部分测试样本,CASM-Net算法可以得到平滑且正确的视差图,这进一步说明算法对于不同数据域的立体匹配性能。

图8 CASM-Net算法在ETH3D数据集上的定性结果

在KITTI、ETH3D和Middlebury数据集上的定量和定性实验结果显示,CASM-Net算法具有一定的跨域能力。

3 结语

本文提出了一种基于跨域自适应的立体匹配算法CASM-Net。为了更好地获取不同数据域的特征,CASM-Net使用了预训练的广域模型作为特征提取模块,获取广域特征信息用于立体匹配任务;此外,为了减少因为单一尺度代价造成的错误匹配,本文提出多尺度代价优化策略,进一步优化了代价分布,同时多尺度代价预测阶段的视差分数预测可以帮助算法处理更多的病态区域。实验结果表明,本文提出的立体匹配算法的各个模块对提升匹配精度都有一定作用,并且在各个数据域的实验结果也充分验证了该算法具有一定的泛化能力。

未来将进一步尝试提升该算法的立体匹配性能,并在更多数据域进行实验验证。此外,受一些遮挡区域的影响,即使经过视差调整,最终也未获得正确视差结果,如何进一步优化病态区域匹配效果,将在今后的工作中继续开展。

[1] 周思达,邱爽,唐嘉宁,等. 基于深度神经网络的无人机路径决策的研究[J]. 计算机仿真, 2022, 39(6):449-452, 477.(ZHOU S D, QIU S, TANG J N, et al. Research on path decision of UAV based on deep neural network research[J]. Computer Simulation, 2022, 39(6):449-452, 477.)

[2] 陆慧敏,杨朔. 基于深度神经网络的自动驾驶场景三维目标检测算法[J]. 北京工业大学学报, 2022, 48(6):589-597.(LU H M, YANG S. Three-dimensional object detection algorithm based on deep neural networks for automatic driving[J]. Journal of Beijing University of Technology, 2022, 48(6):589-597.)

[3] 吕霁. 基于VR全景图像处理的三维重构算法研究[J]. 安阳师范学院学报, 2022(2):31-34.(LYU J. Research on 3D reconstruction algorithm based on VR panoramic image processing[J]. Journal of Anyang Normal University, 2022(2):31-34.)

[4] 黄松梅,毕远伟,许晓. 双目立体匹配算法的研究与实现[J]. 鲁东大学学报(自然科学版), 2018, 34(1):25-30.(HUANG S M, BI Y W, XU X. Research and implementation of binocular stereo matching algorithms[J]. Journal of Ludong University (Natural Science Edition), 2018, 34(1):25-30.)

[5] 王启胜,王凤随,陈金刚,等. 融合自适应注意力机制的Faster R-CNN目标检测算法[J]. 激光与光电子学进展, 2022, 59(12): No.1215016.(WANG Q S, WANG F S, CHEN J G, et al. Faster R-CNN target-detection algorithm fused with adaptive attention mechanism[J]. Laser and Optoelectronics Progress, 2022, 59(12): No.1215016.)

[6] 张雪晴. 基于CNN的图像分类[J]. 电子技术与软件工程, 2022(7):182-185.(ZHANG X Q. CNN-based image classification[J]. Electronic Technology and Software Engineering, 2022(7):182-185.)

[7] ŽBONTAR J, LeCUN Y. Computing the stereo matching cost with a convolutional neural network[C]// Proceedings of the 2015 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2015:1592-1599.

[8] 张亚茹,孔雅婷,刘彬. 多维注意力特征聚合立体匹配算法[J]. 自动化学报, 2022, 48(7):1805-1815.(ZHANG Y R, KONG Y T, LIU B. Multi-dimensional attention feature aggregation stereo matching algorithm[J]. Acta Automatica Sinica, 2022, 48(7): 1805-1815.)

[9] KENDALL A, MARTIROSYAN H, DASGUPTA S, et al. End-to-end learning of geometry and context for deep stereo regression[C]// Proceedings of the 2017 IEEE International Conference on Computer Vision. Piscataway: IEEE, 2017: 66-75.

[10] RAO Z, HE M, DAI Y, et al. NLCA-Net: a non-local context attention network for stereo matching[J]. APSIPA Transactions on Signal and Information Processing, 2020, 9: No.E18.

[11] GUO X, YANG K, YANG W, et al. Group-wise correlation stereo network[C]// Proceedings of the 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2019: 3268-3277.

[12] 中国矿业大学. 基于深度迁移学习的带式输送机煤流量双目视觉测量方法:202011509023.7[P]. 2021-03-26.(China University of Mining and Technology. Binocular vision measurement method for coal flow of belt conveyor based on deep transfer learning: 202011509023.7[P]. 2021-03-26.)

[13] KRIZHEVSKY A, SUTSKEVER I, HINTON G E. ImageNet classification with deep convolutional neural networks[J]. Communications of the ACM, 2017, 60(6): 84-90.

[14] 张锡英,王厚博,边继龙. 多成本融合的立体匹配网络[J]. 计算机工程, 2022, 48(2):186-193.(ZHANG X Y, WANG H B, BIAN J L. Stereo matching network with multi-cost fusion[J]. Computer Engineering, 2022, 48(2):186-193.)

[15] 邱哲瀚,李扬. 基于稀疏卷积的前景实时双目深度估计算法[J]. 计算机应用, 2021, 41(12):3680-3685.(QIU Z H, LI Y. Real-time binocular foreground depth estimation algorithm based on sparse convolution[J]. Journal of Computer Applications, 2021, 41(12):3680-3685.)

[16] 唐家辉,赵芸,徐兴. 一种改进的多尺度引导聚合立体匹配网络研究[J]. 浙江科技学院学报, 2021, 33(5):378-385.(TANG J H, ZHAO Y, XU X. Research on an improved multi-scale guided aggregation stereo matching network[J]. Journal of Zhejiang University of Science and Technology, 2021, 33(5): 378-385.)

[17] MAYER N, ILG E, HÄUSSER P, et al. A large dataset to train convolutional networks for disparity, optical flow, and scene flow estimation[C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2016: 4040-4048.

[18] GEIGER A, LENZ P, URTASUN R. Are we ready for autonomous driving? the KITTI vision benchmark suite[C]// Proceedings of the 2012 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2012: 3354-3361.

[19] SCHARSTEIN D, HIRSCHMÜLLER H, KITAJIMA Y, et al. High-resolution stereo datasets with subpixel-accurate ground truth[C]// Proceedings of the 2014 German Conference on Pattern Recognition, LNCS 8753. Cham: Springer, 2014: 31-42.

[20] SCHÖPS T, SCHÖNBERGER J L, GALLIANI S, et al. A multi-view stereo benchmark with high-resolution images and multi-camera videos[C]// Proceedings of the 2017 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2017: 2538-2547.

[21] HIRSCHMÜLLER H. Accurate and efficient stereo processing by semi-global matching and mutual information[C]// Proceedings of the 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition — Volume 2. Piscataway: IEEE, 2005: 807-814.

[22] CHANG J R, CHEN Y S. Pyramid stereo matching network[C]// Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2018: 5410-5418.

[23] YANG G, ZHAO H, SHI J, et al. SegStereo: exploiting semantic information for disparity estimation[C]// Proceedings of the 2018 European Conference on Computer Vision, LNCS 11211. Cham: Springer, 2018: 660-676.

[24] SEKI A, POLLEFEYS M. Patch based confidence prediction for dense disparity map[C]// Proceedings of the 2016 British Machine Vision Conference. Durham: BMVA Press, 2016: No.23.

[25] FAN X, JEON S, FIDAN B. Occlusion-aware self-supervised stereo matching with confidence guided raw disparity fusion[C]// Proceedings of the 19th Conference on Robots and Vision. Piscataway: IEEE, 2022:132-139.

[26] LIANG Z, FENG Y, GUO Y, et al. Learning for disparity estimation through feature constancy[C]// Proceedings of the 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2018: 2811-2820.

Stereo matching algorithm based on cross-domain adaptation

LI Chuanbiao, BI Yuanwei*

(,,264005,)

Convolutional Neural Networks (CNNs) have made good progress in supervised stereo matching tasks, but most CNN algorithms are difficult to perform well in cross-domain situations. Aiming at the stereo matching problem of cross-domain data, a Cross-domain Adaptation Stereo Matching Network (CASM-Net) algorithm was proposed to achieve domain adaptive stereo matching tasks using transfer learning based on CNN. In the algorithm, a transferable feature extraction module was used to extract rich wide-domain features for stereo matching tasks. At the same time, an adaptive cost optimization module was designed to obtain the optimal cost distribution by making use of the similarity information on different receptive fields to optimize the cost. In addition, a disparity score prediction module was proposed to quantify the stereo matching ability of different regions, and the disparity results were further optimized by adjusting the disparity search range of the image. Experimental results show that on KITTI2012 and KITTI2015 datasets, compared with PSMNet (Pyramid Stereo Matching Network) algorithm, CASM-Net algorithm reduces 6.1%, 3.3% and 19.3% in 2-PE-Noc, 2-PE-All and 3-PE-fg, respectively; on Middlebury dataset, without re-training, CASM-Net algorithm achieves the optimal or suboptimal 2-PE results on all samples in the comparison with other algorithms. It can be seen that CASM-Net algorithm can improve cross-domain stereo matching.

supervised stereo matching; Convolutional Neural Network (CNN); transfer learning; cross-domain; disparity score

1001-9081(2023)10-3230-06

10.11772/j.issn.1001-9081.2022091398

2022⁃09⁃19;

2023⁃02⁃04;

李传彪(1997—),男,山东济南人,硕士研究生,主要研究方向:双目立体匹配、三维重建; 毕远伟(1972—),男,山东威海人,副教授,硕士,主要研究方向:三维重建系统、软件工程、数据库技术、嵌入式技术。

TP391.41

A

2023⁃02⁃08。

LI Chuanbiao, born in 1997, M. S. candidate. His research interests include binocular stereo matching, three-dimensional reconstruction.

BI Yuanwei, born in 1972, M. S., associate professor. His research interests include three-dimensional reconstruction system, software engineering, database technology, embedded technology.