融合评分上下文和物品相似度的推荐算法

2023-10-17卢泽伦古万荣毛宜军陈梓明1

卢泽伦 古万荣 毛宜军 陈梓明1

摘 要:推荐系统中用户的评分往往会受到评分上下文的影响,即用户先前对一些物品的评分会影响其对当前物品评分的客观性。稀疏线性方法在计算物品相似度时将受到上下文影响的用户评分与其他评分同等看待,然而该部分评分并不能客观地反映出物品之间的相似度。针对以上问题,在稀疏线性方法的基础上提出了融合评分上下文和物品相似度的推荐算法,算法分为三个阶段:第一个阶段使用加权评分计算物品最近邻进行特征选择;第二个阶段利用评分误差权重减少算法模型对受到上下文影响的评分的拟合,训练得出物品相似度矩阵;第三个阶段根据用户评分和物品相似度进行评分预测以完成物品推荐。在MovieLens的四个数据集上进行实验,采用平均准确率(MAP)、平均倒数排名(MRR)和归一化折损累计增益(NDCG)指标来评估算法效果。实验结果表明,融合评分上下文将进一步提高物品相似度的准确性,从而提高推荐的性能。

关键词:显式反馈; 推荐系统; 评分上下文; 物品相似度; 稀疏线性方法

中图分类号:TP391 文献标志码:A 文章编号:1001-3695(2023)10-024-3040-07

doi:10.19734/j.issn.1001-3695.2023.02.0057

Recommendation algorithm with rating context and item similarity

Lu Zelun1, Gu Wanrong1, 2, Mao Yijun1, Chen Ziming1

(1. College of Mathematics & Informatics, South China Agricultural University, Guangzhou 510642, China; 2. Guangzhou Key Laboratory of Intelligent Agriculture, Guangzhou 510642, China)

Abstract:In the recommendation system, the users ratings are often affected by the rating context, that is, the users previous ratings of some items will affect the objectivity of his rating of the current item. Sparse linear method treats user ratings affected by context as the same as other ratings when calculating item similarity. However, this partial ratings cannot objectively reflect the similarity between items. To solve the above problems, this paper proposed a recommendation algorithm combining rating context and item similarity based on sparse linear method. It divided the algorithm into three stages.The first stage used weighted ratings to calculate the items nearest neighbor for feature selection.In the second stage,it used the rating error weight to reduce the fitting of the ratings affected by the context of the algorithm model, and trained the item similarity matrix. In the third stage,it predicted the ratings according to the users ratings and the item similarity, and finally sorted the predicted ratings to complete the item recommendation. Experiments were conducted on four datasets of MovieLens, it used mean average precision (MAP) , mean reciprocal rank (MRR) and normalized discounted cumulative gain (NDCG) to evaluate the effectiveness of the algorithm. The experimental results show that the fusion rating context will further improve the accuracy of item similarity and thus improve the performance of recommendation.

Key words:explicit feedback; recommendation system; rating context; item similarity; sparse linear method

0 引言

隨着互联网的高速发展和数据信息的爆炸式增长,人们面临着严重的信息过载问题,推荐系统作为解决信息过载问题的主要技术之一,可根据用户的历史数据将物品准确地推荐给用户,同时获取用户对物品的评分,进一步分析出用户的偏好以进行更好的推荐[1~3]。用户的历史数据常分为隐式数据和显式数据,隐式数据包括用户对物品的点击等[4, 5],显式数据包括用户对物品的评分等[6, 7]。然而在显式数据中,用户对物品的评分往往不完全代表用户的实际偏好或者物品的质量,该评分还受到其他因素的影响[8]。在很多情况下,用户先前对其他物品的评分情况会影响其对当前物品的评分,如在观看电影的场景中,当用户先前观看的电影的质量很低且用户对该电影的评分也很低,那么用户很有可能会给当前观看的电影评一个高分,即使当前电影的质量一般,这种情况称为用户的评分受到评分上下文的影响。例如,用户A对剧情电影A的评分原本只能打到3分,然而因为用户A在观看剧情电影A之前看了一部十分差劲的剧情电影B,导致其在两部电影间作出对比之下给剧情电影A打了5分的高分。在包括稀疏线性方法(sparse linear method,fsSLIM)[9]等使用物品相似度进行推荐的推荐算法中,计算物品相似度常基于用户对物品的评分,且将用户的所有评分同等对待[10~12],忽略了受到上下文影响的用户主观评分并不能客观地反映出物品之间的相似度这一问题,即物品之间的相似度不应受到用户评分先后顺序的影响。针对上述问题,本文在稀疏线性方法的基础上提出一种利用时间信息来融合评分上下文和物品相似度的推荐算法(fsSLIM with rating context,RCfsSLIM)。首先,利用时间信息对用户评分进行加权处理,使用加权处理后的评分计算并选择出物品最近邻;然后,在基于物品最近邻的基础上,使用评分误差权重减少算法模型对受到上下文影响的评分的拟合,训练得出物品相似度矩阵,再通过结合用户评分矩阵和物品相似度矩阵计算得到预测评分,最终完成物品的推荐;最后,本文在四个标准数据集上进行了实验比较,结果表明融合评分上下文将进一步提高物品相似度的准确性,从而提高推荐的性能。

1 相关工作

本文提出的基于物品相似度的推荐算法利用时间信息将评分上下文融入其中,与之相关的工作包括用户评分上下文的影响、融合时间信息的推荐算法、基于物品相似度的推荐算法三方面。

1.1 用户评分上下文的影响

Lu等人[8]统计用户阅读新闻的数据发现,用户的评分经常发生变化,且这些变化与用户交互的上下文高度相关。其将数据分为阅读前、阅读后和任务后。前两个阶段是在用户浏览有顺序的新闻列表上下文中收集的,这可能会受到新闻在列表中的位置、周围新闻和以前阅读的新闻的影响。为了消除这些影响,任务后阶段在用户完成新闻阅读后,将所有新闻重新显示给用户,然后再一次要求用户提供对每个新闻的实际评分,文献[8]认为此阶段中新闻在列表中的位置和上下文的影响都被消除了,并以此当做用户对每个新闻的实际评分。将收集的数据经过T检验后分析发现,用户对前一个点击的新闻的评分会影响当前阅读新闻的用户体验,当用户先前阅读不喜欢的新闻时,其在阅读后阶段中对当前阅读的新闻的评分会高于实际评分。分析数据表明,用户交互上下文将影响用户对当前阅读的新闻的即时评分,这可能与用户的实际评分不一致。因此本文利用时间信息体现出评分的上下文关系,将同一用户的评分按时间顺序排序后,对受到评分上下文影响的评分进行加权处理以改变其对算法模型的影响。

1.2 融合时间信息的推荐算法

传统的推荐系统倾向于利用用户对物品的所有评分来学习用户的长期偏好,在这种情况下用户的全部评分是同等重要的。然而用户对物品的选择往往受其最近的短期偏好以及最近浏览或购买物品等时间相关的上下文场景所影响[11,13]。针对上述问题,研究人员将时间信息融合进推荐算法中[14],近年来,基于序列和基于会话的推荐系统悄然兴起,其中一项重要的工作是处理物品中如时间、用户等上下文信息。Tang等人[15]认为用户最近的偏好对其当前如何选择物品会造成更大的影响,于是通过卷积神经网络对用户短期序列的信息进行提取。Kang等人[16]和Sun等人[17]使用自注意力机制对用户最近的若干个历史行为进行信息提取,以此将时间信息融合进推荐算法中。这些算法都表明融合了时间信息的推荐模型能有效地获得更好的推荐结果,也从另一角度表明融合时间信息有助于模型构建用户偏好或物品属性。因此,本文利用时间信息将评分上下文融合到推荐算法中,以获得更好的推荐效果。

1.3 基于物品相似度的推荐算法

推荐系统主要分为基于内容的推荐、基于协同过滤的推荐和混合推荐[18,19]三大类。结合用户评分和物品相似度进行推荐是基于协同过滤的推荐中常用的一种技术[11,20]。Kabbur等人[21]通过用户评分训练出两个低维的隐因子矩阵,同时将两个隐因子矩阵乘积得到的高维矩阵视为物品的相似度矩阵。Lin等人[22]将自注意力机制融合到算法中以获得更加准确的物品相似度。Ning等人[9]提出了fsSLIM模型,该模型可通过基于邻域的方法提前计算出物品的相似物品进行特征选择。对于某一物品,模型只使用其相似物品对其进行学习,而不需要考虑其他所有物品,其目的是为了减小模型的训练时间。在特征选择步骤中,常用皮尔森系数度量相似度,物品u和v的皮尔森相似度计算方法如下:

其中:Ri,u和Ri,v分别表示用户i对物品u的评分和用户i对物品v的评分;Ru和Rv分别表示物品u所有评分的平均分和物品v所有评分的平均分;Iuv表示对物品u和v都有评分的用户。接着fsSLIM模型可使用评分矩阵结合特征选择训练出物品的相似度矩阵,其目标函数如下:

其中:Rj是评分矩阵R的第j列;Wj是物品相似度矩阵W的第j列。最后fsSLIM模型使用用户评分和物品相似度进行评分预测以进行物品推荐。然而,无论是在特征选择阶段还是模型训练阶段,fsSLIM模型都忽略了用户的评分上下文对部分评分的影响,降低了训练得到的物品相似度矩阵的准确性和推荐效果。因此,本文在fsSLIM模型的基础上利用时间信息对用户评分进行加权处理,将受到上下文影响的评分与其他评分进行区分,并在特征选择阶段使用加权评分更加准确地计算出物品最近邻。同时在模型训练阶段根据评分的权重情况减少算法模型对受到上下文影响的评分的拟合,以此将评分上下文融入其中,从而提高推荐的性能。

2 融合评分上下文和物品相似度的推荐算法

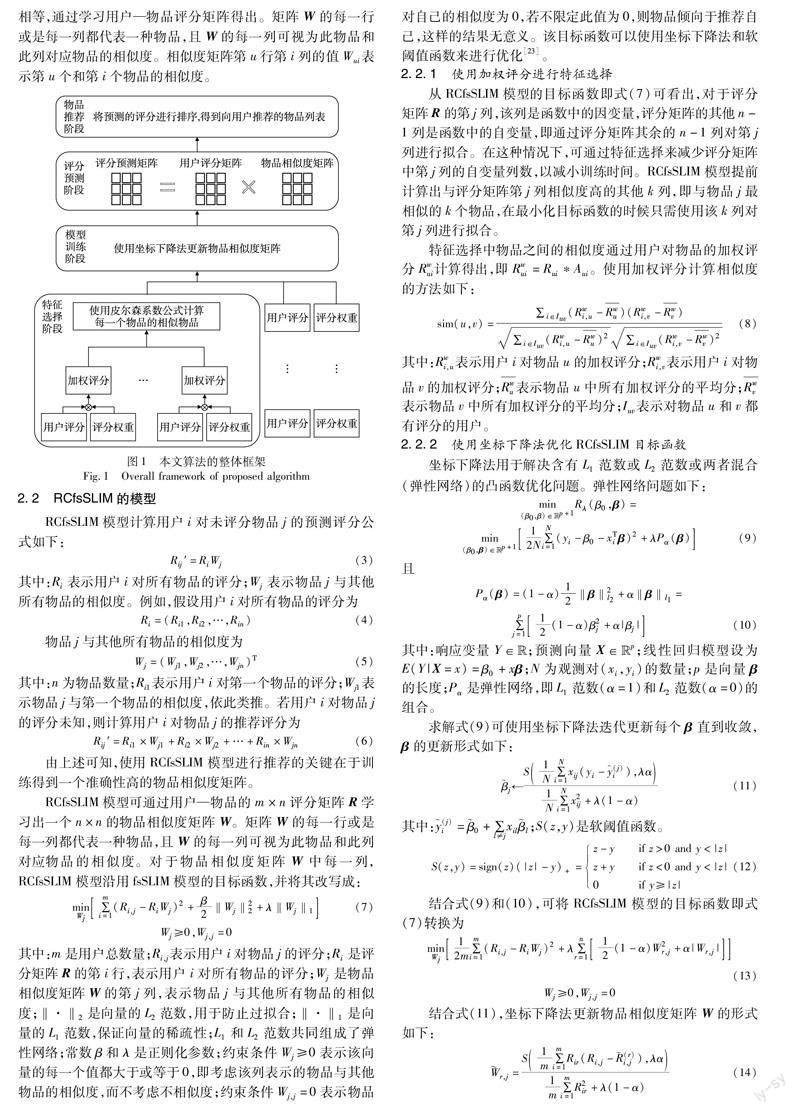

本文所提出的RCfsSLIM算法框架如图1所示,主要分为三个阶段:在第一个阶段即特征选择阶段中,使用加权评分计算物品最近邻进行特征选择以减少算法模型训练时间;在第二个阶段即模型训练阶段中,使用评分误差权重减少算法模型对受到上下文影响的评分的拟合,以减少该评分对物品相似度的影响,训练得出物品相似度矩阵;在第三个阶段即评分预测与物品推荐阶段中,通过用户评分矩阵和物品相似度矩阵完成评分预测,最终将预测的评分进行排序后形成推荐的物品列表。

2.1 符号定义

在提出本文模型之前,先对本文主要使用到的三个矩阵进行说明:

矩阵R為用户—物品评分矩阵,即用户的评分矩阵。评分矩阵的每一行代表一个用户,每一列代表一个物品。评分矩阵第u行第i列的值Rui表示用户u对物品i的评分。

矩阵A是评分权重矩阵,大小与评分矩阵R相同。在评分权重矩阵A中,每一个位置上不为0的值Aui是对应评分矩阵R中评分Rui的权值,权值大小经过以下处理:a)对同一用户的评分按时间先后进行排序,若前一个评分等于最高评分,则当前评分权值大于1;b)对同一用户的评分按时间先后进行排序,若前一个评分等于最低评分,则当前评分权值小于1;c)其他情况下评分权值等于1。其中,加权评分不应高于原始评分的更高一级评分且不应低于原始评分的更低一级评分,如用户评分为4分(评分区间为1~5分,评分间隔为1分),则加权评分不超过5分且不低于3分。

矩阵W为物品相似度矩阵,其行数与列数都和物品数量相等,通过学习用户—物品评分矩阵得出。矩阵W的每一行或是每一列都代表一种物品,且W的每一列可视为此物品和此列对应物品的相似度。相似度矩阵第u行第i列的值Wui表示第u个和第i个物品的相似度。

2.2 RCfsSLIM的模型

RCfsSLIM模型计算用户i对未评分物品j的预测评分公式如下:

排序由式(18)得到的预测评分,即可获得向用户推荐的物品列表。RCfsSLIM模型的算法描述如下:

输入:用户的评分数据,每一评分数据包括用户ID、物品ID、评分值和时间戳。

输出:用户的物品推荐列表。

a)使用每一评分数据的时间戳信息计算出该评分的评分权重值。同时将每一评分数据的评分值和评分权重值相乘,得出加权评分。

b)根据式(8)使用加权评分计算出物品之间的相似度,得到物品的最近邻。

c)初始化物品相似度矩阵,根据式(16)使用物品的最近邻、评分值和评分权重,通过坐标下降法更新物品相似度矩阵。

d)物品相似度矩阵更新完成后利用式(18)计算得出评分预测矩阵。

e)对预测的评分进行排序,取预测评分高的多个物品作为物品推荐列表。

3 实验结果与分析

3.1 数据集

实验采用MovieLens的四个数据集,分别是ml-100k、ml-latest-small(ml-ls)、Hetrec2011-movielens-2k(ml-10m2k)和ml-1m。其中,Hetrec2011-movielens-2k数据集将MovieLens数据集的电影与其在IMDb和烂番茄中的相应网页链接起来,是Movie-Lens10M数据集的扩展。数据集的具体信息如表1所示。

3.2 评价指标

实验采用top-N推荐评价指标来评估推荐算法的性能,其中包括平均准确率(mean average precision,MAP)、平均倒数排名(mean reciprocal rank,MRR)和归一化折损累计增益(normalized discounted cumulative gain,NDCG)。

3.3 实验结果与分析

本文实验在四个数据集上都随机抽取了70%的训练数据和30%的测试数据。由于数据集ml-ls和ml-10m2k的评分间隔为0.5分,数据集ml-100k和ml-1m的评分间隔为1分,所以这四个数据集的评分权值进行如下设置:a)对同一用户的评分按时间先后进行排序,若前一个评分等于最高评分,则在数据集ml-ls和ml-10m2k中,当前评分的权值设为1.1,在数据集ml-100k和ml-1m中,当前评分的权值设为1.2;b)对同一用户的评分按时间先后进行排序,若前一个评分等于最低评分,则在数据集ml-ls和ml-10m2k中,当前评分的权值设为0.9,在数据集ml-100k和ml-1m中,当前评分的权值设为0.8;c)其他情况下评分权值等于1。

除了fsSLIM模型以外,本文提出的RCfsSLIM模型还与以下五种基线模型进行了对比:

a)ItemKNN[10]:一种经典的基于物品的推荐算法,ItemKNN根据物品之间的相似度大小进行排序后完成推荐。

b)WRMF[24,25]:该算法使用加权的方法来表征用户对物品行为的置信度,以此改变部分训练数据对模型的影响。

c)FISM[21]:该算法通过用户评分训练出两个低维的隐因子矩阵,两个矩阵乘积得到的高维矩阵视为物品的相似度矩阵。

d)LRML[26]:该算法使用用户和物品之间的潜在关系进行建模,以此提高特征选择的能力和推荐的性能。

e)AutoInt[27]:该算法使用多头自注意力来进行特征的交叉学习,有效地构造了高阶特征以获得更好的推荐效果。

3.4 实验结果与分析

3.4.1 推荐结果比较

本文提出的RCfsSLIM模型与六个基线模型应用于稀疏度不同的数据集上的整体效果如表2所示。本文算法RCfsSLIM明显优于其他六种对比方法,相比于fsSLIM模型,RCfsSLIM模型在特征选择阶段使用加权评分计算物品相似度以找出更加准确的相似物品,并在模型训练时减小对部分受到用户评分上下文影响的评分的拟合,提高了训练得到的物品相似度矩阵的准确性,体现出更好的推荐效果。

3.4.2 第一个阶段中使用加权评分进行特征选择的作用

RCfsSLIM模型第一个阶段中特征选择的本质是使用加权评分提前计算出物品之间的相似度,接着只使用物品的多个相似物品进行训练即可,由此可见在特征选择阶段中更加准确地找出某一物品的多个相似物品的重要性。

本节实验使用物品最近邻算法(item K-nearest neighbor,ItemKNN)探究使用加权评分进行特征选择的作用。ItemKNN算法首先使用式(1)通过评分矩阵R中的物品向量来计算得到物品之间的相似度;接着对于一个用户未评分的物品,該算法将该物品和用户已评分物品的相似度进行累加;最后对每一个未评分物品累加的相似度进行排序从而达到推荐的目的。从相似度计算式(1)可以看出,计算物品相似度完全基于用户评分,即对于两个物品而言,若用户评分越相近,则两个物品的相似度越高,且ItemKNN在推荐物品的过程中仅累加物品之间的相似度进行排序,所以可将使用该算法进行推荐的性能视为物品之间相似度的准确性。

作为与式(1)的对比,本文在ItemKNN算法中使用式(8)通过加权评分计算物品之间的相似度,除此之外其余所有参数保持不变。实验结果如表3所示,使用加权评分计算物品之间的相似度表现出更好的推荐效果,即对于某一个物品而言,使用加权评分可以更加准确地寻找出与其相似的k个物品,这也正是RCfsSLIM模型中特征选择阶段所需要的效果。

3.4.3 第二个阶段中评分误差权重的影响

RCfsSLIM模型的第二个阶段中,一个评分的评分误差权重δ的大小影响着模型对该评分的拟合程度。若δ为1,则表示模型对该评分进行完全拟合,仅在特征选择时使用加权评分计算物品相似度;若δ为0,则表示模型不对该评分进行拟合;δ的值在0~1,则表示模型将减小对该评分的拟合。可见评分误差权重δ在RCfsSLIM推荐模型中的重要性。

本节实验进一步研究了评分误差权重对推荐结果的影响,在数据集ml-100k、ml-ls、ml-10m2k中,top-N取5的情况下,各个评估指标的实验结果如图2所示。作为对比,图2将同时画出同样条件下fsSLIM的评估指标情况,由于不存在评分误差权重,所以fsSLIM在所有图中都是直线,每一条直线代表的数据集为距离其最近的折线所代表的数据集。

由图2可看出,RCfsSLIM的推荐效果普遍都比fsSLIM要好。同时当评分误差权重偏大或偏小时,推荐效果都有所下降。在数据集ml-100k中,评分误差权重取0.4时推荐效果普遍最好;在数据集ml-ls中,评分误差权重取0.8时推荐效果普遍最好;在数据集ml-10m2k中,评分误差权重取0.5时推荐效果普遍最好。

另外,在评分误差权重很小的情况下,部分数据集的RCfs-SLIM的推荐效果比fsSLIM差,說明RCfsSLIM在不对受到用户评分上下文影响的评分进行完全拟合的同时,也不可完全舍去这一部分评分,其在一定程度上有助于模型构建物品相似度矩阵。

3.4.4 在RCfsSLIM模型的两个阶段中进行加权处理的有效性

本文RCfsSLIM模型在第一个阶段即特征选择阶段中,对评分进行加权处理以计算物品的最近邻;在第二个阶段即模型训练阶段中,使用坐标下降法进行目标函数的优化时,对评分误差进行加权处理以减少算法模型对受到上下文影响的评分的拟合,从而减少该部分评分对物品相似度的影响。

本节实验进一步研究了仅在第一阶段或者仅在第二阶段进行加权处理的推荐效果,在数据集ml-100k、ml-ls、ml-10m2k中,top-N取3的情况下,各个评估指标的实验结果如图3所示。其中,fsSLIM模型表示第一个阶段和第二个阶段都不进行加权处理的情况;fsSLIM-weightknn模型表示仅在第一个阶段即特征选择阶段进行加权处理的情况;fsSLIM-weighterror模型表示仅在第二个阶段对评分误差进行加权处理的情况;RCfs-SLIM模型即本文方法则表示同时在两个阶段进行加权处理的情况。

由图3可看出,无论是仅在第一个阶段对评分进行加权处理,还是仅在第二个阶段对评分误差进行加权处理,其推荐效果都比不进行加权处理的情况要好,这是因为在第一个阶段即特征选择阶段中对评分进行加权处理可以更好地找出某个物品的相似物品,在第二个阶段即模型训练阶段中对评分误差进行加权处理可以减少算法模型对受到上下文影响的评分的拟合,从而减少该部分评分对物品相似度的影响以提高物品相似度矩阵的准确性。同时,本文提出的在第一个阶段和第二个阶段都进行加权处理的RCfsSLIM模型表现出最好的推荐效果。

4 结束语

在一些使用用户评分计算物品相似度的推荐算法中,受到评分上下文影响的用户主观评分并不能客观地反映出物品之间的相似度,从而影响推荐的性能。本文在fsSLIM模型的基础上提出了融合评分上下文和物品相似度的RCfsSLIM推荐模型。RCfsSLIM模型首先使用加权评分计算物品相似度的方法进行特征选择,在进一步使用坐标下降法优化目标函数时,对受到用户评分上下文影响的评分误差进行加权处理,使RCfs-SLIM推荐模型减小对这些评分的拟合以减小该评分对计算物品相似度的影响,从而提高模型训练得到的物品相似度矩阵的准确性。实验结果验证了本文算法的可行性和有效性。

未来将进行以下两方面的工作:a)当前设置某一评分的权重的做法是将用户评分按时间排序后,考虑该评分的先前一个评分的情况,未来工作将综合考虑该评分的先前多个评分的情况,以另一种角度分析评分上下文;b)由于评分权重矩阵的值为人工提前设置,下一步将研究通过算法模型自动学习出各个评分的权重值以提高推荐性能。

参考文献:

[1]Xu Kerui, Yang Jingxuan, Xu Jun, et al. Adapting user preference to online feedback in multi-round conversational recommendation[C]// Proc of the 14th ACM International Conference on Web Search and Data Mining. New York: ACM Press, 2021: 364-372.

[2]Srivastava R, Palshikar G K, Chaurasia S, et al. Whats next? A recommendation system for industrial training[J].Data Science and Engineering,2018,3(3):232-247.

[3]Liu Luyao, Du Xingzhong, Zhu Lei, et al. Learning discrete hashing towards efficient fashion recommendation[J].Data Science and Engineering,2018,3(4):307-322.

[4]陈碧毅, 黄玲, 王昌栋, 等. 融合显式反馈与隐式反馈的协同过滤推荐算法[J].软件学报, 2020,31(3): 794-805. (Chen Biyi, Huang Ling, Wang Changdong, et al. Explicit and implicit feedback based collaborative filtering algorithm[J].Journal of Software,2020,31(3): 794-805.)

[5]Askari B, Szlichta J, Salehi-Abari A. Variational autoencoders for top-k recommendation with implicit feedback[C]// Proc of the 44th International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2021: 2061-2065.

[6]Lin Guanyu, Liang Feng, Pan Weike, et al. FedRec: federated re-commendation with explicit feedback[J].IEEE Intelligent Systems,2021,36(5):21-30.

[7]Jadidinejad A H, Macdonald C, Ounis I. Unifying explicit and implicit feedback for rating prediction and ranking recommendation tasks [C]// Proc of ACM SIGIR International Conference on Theory of Information Retrieval. New York: ACM Press, 2019: 149-156.

[8]Lu Hongyu, Zhang Min, Ma Shaoping. Between clicks and satisfaction: study on multi-phase user preferences and satisfaction for online news reading [C]// Proc of the 41st International ACM SIGIR Conference on Research and Development in Information Retrieval. New York: ACM Press, 2018: 435-444.

[9]Ning Xia, Karypis G. SLIM: sparse linear methods for top-n recommender systems [C]// Proc of the 11th IEEE International Confe-rence on Data Mining. Piscataway, NJ: IEEE Press, 2011: 497-506.

[10]Deshpande M, Karypis G. Item-based top-N recommendation algorithms[J].ACM Trans on Information Systems,2004,22(1):143-177.

[11]Choi M, Kim J, Lee J, et al. Session-aware linear item-item models for session-based recommendation [C]// Proc of Web Conference. New York: ACM Press, 2021: 2186-2197.

[12]Linden G, Smith B, York J. Amazon.com recommendations: item-to-item collaborative filtering[J].IEEE Internet Computing,2003,7(1):76-80.

[13]Wang Shoujin, Cao Longbing, Wang Yan. A survey on session-based recommender systems [J].ACM Computing Surveys,2022,54:1-38.

[14]包玄,陳红梅,肖清.融入时间的兴趣点协同推荐算法[J].计算机应用,2021,41(8):2406-2411.(Bao Xuan, Chen Hongmei, Xiao Qing. Time-incorporated point-of-interest collaborative recommendation algorithm[J].Journal of Computer Applications,2021,41(8):2406-2411.)

[15]Tang Jiaxi, Wang Ke. Personalized top-N sequential recommendation via convolutional sequence embedding [C]// Proc of the 11th ACM International Conference on Web Search and Data Mining. New York: ACM Press, 2018: 565-573.

[16]Kang Wangcheng, McAuley J. Self-attentive sequential recommendation [C]// Proc of the 18th IEEE International Conference on Data Mining. Piscataway, NJ: IEEE Press, 2018: 197-206.

[17]Sun Fei, Liu Jun, Wu Jian, et al. BERT4Rec: sequential recommendation with bidirectional encoder representations from transformer [C]// Proc of the 28th ACM International Conference on Information and Knowledge Management. New York: ACM Press, 2019: 1441-1450.

[18]Ozgobek O, Gulla J A, Erdur R C. A survey on challenges and me-thods in news recommendation [C]// Proc of the 10th International Conference on Web Information Systems and Technologies. 2014: 278-285.

[19]Van B J, Goethals B. High-dimensional sparse embeddings for collaborative filtering [C]// Proc of Web Conference. New York: ACM Press, 2021: 575-581.

[20]Bhattacharya M, Barapatre A. Query as context for item-to-item re-commendation [C]// Proc of the 14th ACM Conference on Recommender Systems. New York: ACM Press, 2020: 575-576.

[21]Kabbur S, Ning X, Karypis G. FISM: factored item similarity models for top-N recommender systems [C]// Proc of the 19th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM Press, 2013: 659-667.

[22]Lin Jing, Pan Weike, Ming Zhong. FISSA: fusing item similarity models with self-attention networks for sequential recommendation [C]// Proc of the 14th ACM Conference on Recommender Systems. New York: ACM Press, 2020: 130-139.

[23]Friedman J, Hastie T, Tibshirani R. Regularization paths for genera-lized linear models via coordinate descent[J].Journal of Statistical Software,2010,33(1):1-22.

[24]Pan Rong, Zhou Yunhong, Cao Bin, et al. One-class collaborative filtering [C]// Proc of the 8th IEEE International Conference on Data Mining. Piscataway, NJ: IEEE Press, 2008: 502-511.

[25]Hu Yifan, Koren Y, Volinsky C. Collaborative filtering for implicit feedback datasets [C]// Proc of the 8th IEEE International Confe-rence on Data Mining. Piscataway, NJ: IEEE Press, 2008: 263-272.

[26]Tay Y, Anh T L, Hui S C. Latent relational metric learning via me-mory-based attention for collaborative ranking [C]// Proc of the 26th International Conference on World Wide Web. New York: ACM Press, 2018: 729-739.

[27]Song Weiping, Shi Chence, Xiao Zhiping, et al. AutoInt: automatic feature interaction learning via self-attentive neural networks [C]// Proc of the 28th ACM International Conference on Information and Knowledge Management. New York: ACM Press, 2019: 1161-1170.

收稿日期:2023-02-18;修回日期:2023-04-20

基金項目:中山大学广东省计算科学重点实验室开放基金资助项目(2021010);广东省自然科学基金面上项目(2022A1515011489);国家社科基金后期资助项目(19FTJB001);广东省哲学社会科学规划项目(GD19CGL34)

作者简介:卢泽伦(1997-),男,广东惠州人,硕士,CCF会员,主要研究方向为推荐系统、机器学习;古万荣(1982-),男(通信作者),广东梅州人,讲师,硕导,博士,主要研究方向为搜索引擎、互联网大数据分析与挖掘、推荐系统(guwanrong@scau.edu.cn);毛宜军(1979-),男,湖北公安人,讲师,博士,主要研究方向为基因数据处理、信息安全、人工智能;陈梓明(1998-),男,广东广州人,硕士,主要研究方向为机器学习.