基于注意力机制的YOLOv5 口罩佩戴检测算法

2023-10-15江西理工大学杨云吉邝先验唐滨钧

江西理工大学 杨云吉 邝先验 唐滨钧

针对目前YOLO 网络在口罩正确佩戴中检测率偏低的问题,提出了一种基于协同注意力机制和BiFPN 特征融合的改进YOLOv5 口罩佩戴检测算法(YOLOv5-BC)。为了提高原始图像特征点的利用,将BiFPN 中的特征融合方法引入到Neck 模块;将CA 注意力机制引入YOLOv5 网络用于增强口罩佩戴检测中对面部关键信息的提取。实验结果表明,改进的YOLOv5-BC 算法在自制数据集上的检测精度达到了92.9%,相比于原始算法提高了1.3%,检测速度达到了60FPS,相较于主流算法具有较好的检测精度与实时性。

针对日常的口罩检测,国内外已有许多学者对其进行了研究。引用[1]基于YOLOv5 算法,实现对口罩佩戴情况的实时监测,相比于之前的版本[2-5],YOLOv5 检测精度有所上升,且实时性较强,更满足实际使用需求,但在人群密集情况下口罩识别率仍然有待提高。

针对上述问题,为了提高口罩检测的识别精度,提出一种改进的YOLOv5s-BC 口罩识别算法。依据BiFPN 的特征融合思想,采用去权重的BiFPN 优化YOLOv5s 算法的Neck 部分,可以有效解决过程中缺失功能信息的问题。同时,在主网边缘辅引协同注意机制(CA),能够保持YOLOv5 算法提取特征的能力。

1 理论基础

1.1 YOLOv5 算法原理

YOLOv5 相比于之前的版本,结构更简洁,图像地处理速度更快,更能满足对图像信息的实时性检测的需求。

考虑到口罩检测需要较快地实时性,所以本次实验选取了深度最小、特征图宽度最小,但速度较快的YOLOv5s作为权重。

YOLOv5s 网络由输入端、主干网络、Neck 部分、预测网络四个部分构成,如图1 所示。

图1 YOLOv5 网络结构图Fig.1 YOLOv5 network structure

1.2 CA 注意力机制

本文选用了协同注意力机制来优化网络算法。相较于SE、CBAM 等注意力机制,CA 所具有的优势有如下几点:首先,在通道间信息取得的同时,CA 注意力机制还分析了方向相关的位置信息,可以更好地定位和识别目标;其次,它体量较小,可以比较灵活地添加到算法的核心结构中。

2 改进后的网络模型

2.1 BiFPN 特征融合

BiFPN 首先简化FPN+PAN 结构,去掉一条边的输入和输出结点,当输入和输出结点同为一层时,则另行添加一条边。

经实验后发现,若使用原始的BiFPN,检测效果并不能达到预期效果,而且还会增加计算量和参数量。借鉴BiFPN 的特征融合方法,去掉BiFPN 的权重,使得图片的原始特征信息可以输入到算法的PAN 结构。

2.2 改进后的网络结构

依据YOLOv5s 原始算法,改进前面的三种方式,取得最终算法YOLOv5s-BC,其网络结构,如图2 所示。图像在经过加强处理后,传入骨干网络结构,其中的CA注意力机制添加如图2 所示,会对图像关键特征点进行提取。同时,原始特征也会传入到Neck 层,进一步提高对图像的检测精度。

图2 改进后的YOLOv5s-BC 算法Fig.2 Improved YOLOv5s-BC algorithm

3 实验结果及对比分析

3.1 实验数据处理与实验环境

本实验操作系统为Windows 10,64 位,CPU 为Intel(R)Core(TM) i5-11400H @ 2.70GHz 2.69 GHz,16G 运行内存,GPU 为NVIDIA RTX3050 显卡,采用CUDA11.0计算架构,模型的搭建、训练和验证,由Pytorch 深度学习框架实现,并添加Cudnn 来增速计算能力。

3.2 实验数据集

实验所需的数据集,采用网络爬取与现实拍摄相结合的方式制作。考虑到日常生活中口罩佩戴的规范性会直接影响口罩的防护能力,因此将数据集细分为Mask(正确佩戴口罩)、Mask-F(不规范佩戴口罩)、Face(未佩戴口罩)三种类别,处理后各类目标的数量如表1 所示。

表1 数据集类别Tab.1 Data set categories

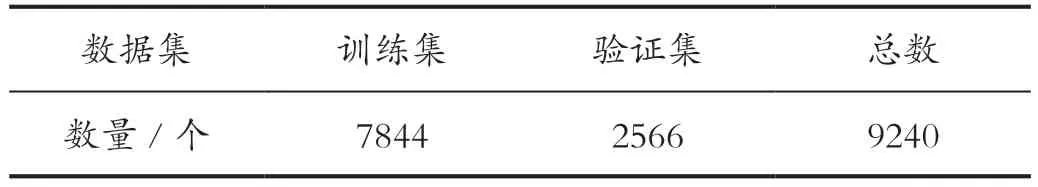

本数据集中共有9240 张带标注的图像,本文按照8:2 的比例分为训练集和验证集,划分后各部分图像数量,如表2 所示。

表2 数据集划分Tab.2 Data set partitioning

3.3 模型评估指标

模型评估指标主要包括平均精度均值、召回率、精度。mAP 为所有类别的平均精度求和除以数据集中所有类的平均精度,召回率为原始样本中的正例有多少被预测正确的比率,精确率为预测结果中预测为正的样本中有多少是真正的正样本的比率。TP、FP和FN分别为正确检测框、误检框和漏检框的数量,AP为某个目标类的平均精度,如式(1)、式(2)、式(3)所示:

3.4 加入CA、BiFPN 的实验分析

以YOLOv5s 为基础,添加CA 注意力机制,并借鉴BiFPN 特征融合方法得到YOLOv5s-BC 算法,将不同位置的算法在数据集上进行训练并测试,实验结果如表3所示。

表3 性能比较Tab.3 Performance comparison

通过表3 中的实验结果可知,在本文模型中,将CA注意力机制添加后和BiFPN 特征网络可以获得相对更好的检测效果。

3.5 对比实验

为了验证改进算法YOLOv5-BC 的有效性与优越性,将本文YOLOv5-BC 算法与YOLOv5s、Faster R-CNN、YOLOv4 等算法在相同数据集上进行实验比较,结果如表4 所示。

表4 不同算法模型在相同数据集上的性能对比Tab.4 Performance comparison of different algorithm models on the same data set

依据表4 中不同算法模型的对比实验检测结果可以看出,相较于精度相近的原始YOLOv5s 算法,本文算法精度优化了约1.6%,比早期的Faster R-CNN 精度优化13%,比YOLOv4 优化15.8%。综上所述,本文的YOLOv5s-BC相比于其他主流算法,有着较好的检测精度,整体表现比较优异,证明了本文所提算法的优越性。为了更直观地体现本文算法的优越性,本文YOLOv5s-BC 算法的效果图,如图3 所示。

图3 检测效果图Fig.3 Test effect diagram

从图3 中可知,YOLOv5s 虽然可以识别口罩佩戴情况,但是当人员拥挤时,会出现检测率较低,漏检甚至错检的情况。本文YOLOv5s-BC 算法相比于原始YOLOv5s 具有更高的检测精度,并且在漏检错检方面都有较好的改进。

4 结论

本文针对当前检测口罩佩戴情形的应用背景,提出了一种改进的YOLO 网络的口罩规范性检测算法,首先通过对Neck 层改进为去权重的BiFPN,加强了对原始图像特征点的使用;然后,融合了CA 注意力机制方法的集成,提高了对面部识别的检测度。改进后的YOLOv5s-BC 相比于原始算法,在自制数据集上,精度提升了约1.6%,在对于公共卫生安全的发展和实施中,具有重要的现实意义。