基于深度学习的CT-MR 图像联合配准分割方法

2023-09-18钱旭升申明磊胡冀苏戴亚康周志勇

洪 犇,钱旭升,申明磊,胡冀苏,耿 辰,戴亚康,周志勇

(1.南京理工大学 电子工程与光电技术学院,南京 210094;2.中国科学院 苏州生物医学工程技术研究所,江苏 苏州 215163)

0 概述

人工智能技术已经成功应用到许多医学领域中,如手术计划导航、辅助诊断、图像引导的消融等。作为医学图像分析中最基本的两项任务,图像配准和图像分割对于辅助解决医学领域的各种问题具有重要意义[1-2]。

图像配准的目的是得到两幅图像之间的逐像素转换参数,利用这组转换参数使两幅图像在解剖结构上保持一致[3]。不同于单模态配准,多模态配准在不同模态图像的灰度和纹理上差异较大[4],以往基于灰度的测度方式无法有效匹配多模态图像之间的特征[5]。基于生成对抗网络(Generative Adversarial Network,GAN)的方法将图像从一种模态转换到另一种模态,从而将多模态配准转换成更为简单的单模态配准[6]。文献[7]进一步扩展了该工作,同时实现单模态和多模态的配准。生成对抗网络的方法往往难以训练,且不可避免地带来一些人工特征的干扰[8]。通过构造特征描述符,文献[9]基于邻域描述子(Modality Independence Neighborhood Descriptor,MIND)设计损失函数,以人工构造特征对配准进行监督。然而,无监督学习的方法缺少解剖学的语义信息,难以达到更加准确的配准效果[10-11]。弱监督学习的配准方法使用组织分割标签描述不同模态图像之间相同的器官边界或病灶区域,引导配准网络从分割标签推断解剖结构对应关系,从而实现多模态配准。例如,文献[12]利用分割标签作为弱监督信息,在MR-TRUS 图像对上实现了多模态配准。为了解决分割标签覆盖面积不足的问题。文献[13]在配准的同时对图像和分割标签进行形变操作,形成全局和局部相结合的配准网络。

医学图像分割的目的是得到感兴趣区域的分割标签[14],并提取出边界信息进一步执行图像分析与计算机辅助诊断等任务。2015 年,文献[15]提出了U-Net 分割网络,利用U 型结构和跳跃连接融合了不同层次的信息,在图像分割领域得到了广泛的应用。通过设计不同深度的嵌套子网络,UNet++[16]的提出解决了U-Net 网络深度设计的问题,并通过深监督机制大幅缩减了参数量,使得网络分割精度进一步提升。文献[17]将U-Net 中传统卷积替换为内卷操作,进一步提升了局部特征学习能力。然而,上述方法都依赖于真实标注的组织分割标签,并且容易受到不同标注者的主观影响。针对这一问题,文献[18]利用两个协同模型组成协同训练框架,分别预测未标记数据的伪标签来互相指导,通过互补性避免了单个模型无法保证伪标签质量的问题。

配准和分割网络在各自的领域已经达到了一定的效果,然而它们却被视为相互独立的任务。但是,分割和配准任务存在一定的关联性,即配准和分割都可以通过分割标签的辅助解剖信息来提高任务的精度[19]。具体地说,分割可以通过将带有分割标签的图像配准到待分割图像上以得到对应的分割标签[20],配准可以通过将辅助分割标签信息加入损失函数[21]实现多模态配准。因此,通过分割和配准网络的联合优化,可以进一步提升两者的精度[22-24]。文献[25]利用硬参数共享的方式提出联合配准分割网络U-ReSNet,通过最小化均方误差和局部互相关来同时约束配准和分割网络。文献[26]利用软参数共享的方法,提出一种“十字绣”网络结构,同时在编码和解码阶段共享配准和分割网络参数,实现更好的泛化性能。以上多任务学习的方法虽然很好地将配准与分割相结合,但是需要对网络结构进行大量修改,难以适应最新的配准和分割算法。为此,一些无须改动网络结构的联合配准分割框架被提出。文献[27]提出一种联合配准分割网络框架DeepAtlas,为缺少标签时分割和配准的联合训练提供了一个通用的解决方案,该方案将已知的概率图谱通过逆形变场进行形变,并将得到先验的已形变概率图谱作为分割的真实标签。文献[28]实现了无监督联合配准分割模型U-RSNet。文献[29]提出了联合学习框架RsegNet,通过正逆形变场的双一致性监督实现解剖一致性,并在4 个公共数据集上进行验证,效果均优于单独训练的网络。然而,目前的各种联合配准分割方法大都局限于单模态数据。由于分割网络难以适应不同模态的图像,因此无法同时得到不同模态的图像分割标签,导致联合配准分割方法难以应用到多模态数据中。此外,联合配准分割网络大都需要大量的分割标签来保证训练的进行,如果缺少标签则难以完成联合过程[27]。

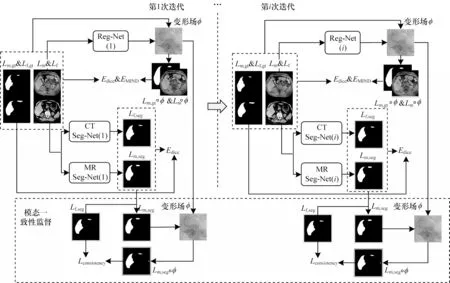

本文提出一种基于深度学习的联合配准分割算法,并构建基于多尺度邻域描述符和一致性监督的联合配准分割网络(Multi-scale neighborhood descriptor and Consistency supervision based joint Registration and Segmentation Network,MC-RSNet)框架,该框架包含两个分割网络和一个多模态配准网络,通过配准-分割迭代优化的方式同时实现两项任务,利用模态一致性监督通过配准产生的形变场使两个独立的分割网络互为监督,进而提升多模态图像分割的精度,并在此基础上设计一种多尺度模态独立邻域描述符,通过构建多个尺度的邻域范围扩充描述符的上下文信息,为多模态图像配准提供更准确的不同模态之间的特征对应关系,以提高配准精度。

有些学生为了达到美化的目的,在绘图手段上花费的时间过多;也有的为了“可视化”而“可视化”,置换了一些更好的教学方法,得不偿失。所以,教师要注意,教无定法,在中考复习中“思维可视化”只是一种策略、一种手段,不是替代当前的教学方法,而是与之相适应、相配合。只有让“思维可视化”与“中考复习”和谐地融为一体,促进学生对科学本质的理解,才能使凝固的课堂重新焕发出生命的活力,才能在这场没有硝烟的中考复习战中获胜。

1 联合配准分割方法

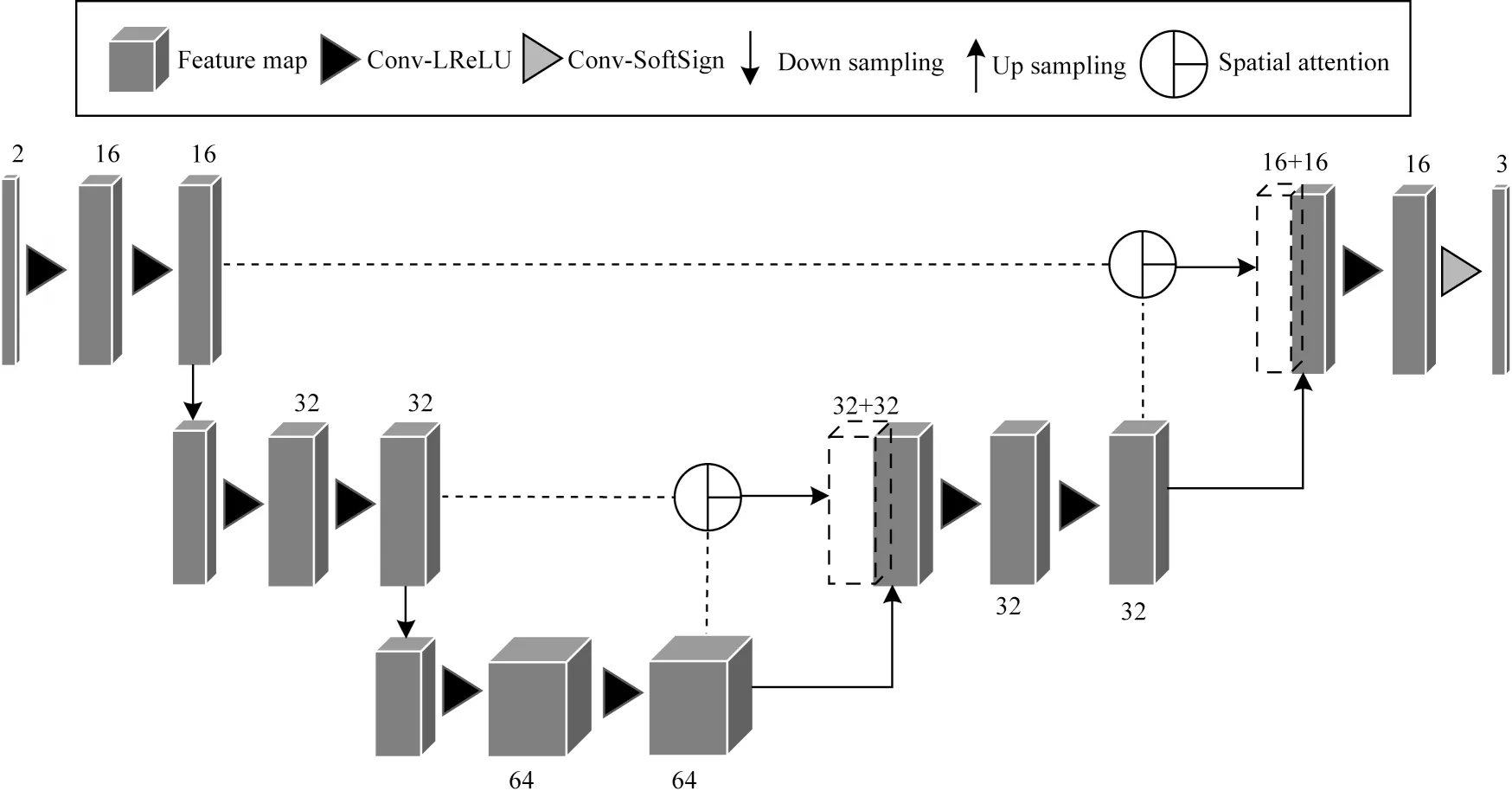

定义Im和If分别表示浮动图像(MR)和固定图像(CT),Lm,seg和Lf,seg分别表示MR 图像的分割标签和CT 图像的分割标签,在所有M对CT-MR 图像对中提供了N(N 多模态配准的目的是找到一组最优的空间变换参数ϕ(形变场),使得不同模态的图像在解剖结构上对齐;分割的目的是在图像中分离出器官等感兴趣区域。对于上述两项任务,通过最小化相似性度量来训练网络,以学习最优网络参数,从而得到最优网络模型。根据本文中损失函数的具体设计,将图像配准和分割的过程表示如下: 其中:EmsMIND是基于多尺度模态独立邻域描述符构造的图像相似性测度,用于计算图像结构相似度;Econsistency用于约束分割标签图像中的图像轮廓对齐程度;Esmooth表示对形变场不平滑的惩罚;∘表示由配准形变场ϕ对浮动图像Im进行空间变换。 出口边界:割草机出口设置为pressure-outlet,压力边界值p=1.3×105 Pa,即表压设为0 Pa,湍流强度为5%,水力直径为500 mm。 为了能够得到最佳的配准效果,构建基于多尺度配准算法Ms-RNet[4]的配准子网络,如图3 所示。在编码阶段,配准子网络利用卷积来提取原始输入图像的特征。每个卷积中的核大小和步长分别被设置为3×3×3 和1×1×1,随后使用LReLU 激活函数增加非线性特征。卷积核的初始数量被设置为16,随着每次最大池化不断倍增最终达到64 个。在解码器阶段,通过上采样恢复原始图像的大小,同时通过跳跃连接与空间注意力结构恢复编解码过程中特征图丢失的细节。 联合配准分割网络框架如图1 所示,该框架包括分割子网络和配准子网络两个分支。在整体上,以M对浮动图像Im和固定图像If及N对真实分割标签Lm,gt和Lf,gt作为输入(N 1.3.4 对照品溶液制备 精密称取橙皮苷3.75 mg,置25 mL量瓶中,加甲醇溶解并稀释至刻度,即得橙皮苷对照品储备液,浓度为 0.15 mg/mL。 图1 基于配准与分割的联合优化网络框架Fig.1 Joint optimization network framework based on registration and segmentation 具体而言,在进行联合训练之前,首先利用配准子网络在无监督情况下[4]进行预训练,然后利用分割子网络在含有N对分割标签的M对数据上进行预训练,得到预训练模型之后进入联合训练阶段。在联合训练过程中先后执行配准、分割,交替训练两种网络中的一种,同时保持另一种固定,形成完整的训练过程。在该过程中,分割为配准提供标签辅助配准,配准为分割提供形变场实现模态间一致性约束。利用两者互补的特性,在循环交替的过程中传递互补的约束,实现互相提高,交替过程如图2 所示。需要注意的是,只在第一轮训练时使用了预训练模型,此后交替训练使用的网络均为上一步训练优化的结果。具体训练步骤如下: 图2 配准与分割的交替训练过程Fig.2 Alternating training process of registration and segmentation 步骤1利用配准子网络单独对所有M对CTMR 图像进行预训练;利用分割子网络对N对含有分割标签的CT-MR 图像进行预训练。将预训练网络作为联合框架中的初始网络。 其中:P表示预测标签;G表示真实标签(groundtruth)。 福建省在国家防办制定的实施方案编制大纲基础上,制定了福建省建设实施方案编制大纲,监测预警系统建设技术要求,防御宣传手册、宣传栏、警示牌样式和防御预案编制要求和范本等。这些技术标准明确了“构建监测预警网络和群测群防的防御体系,完善‘预警到乡、预案到村、责任到人’工作机制,实现有效防御山洪灾害,保障人民群众生命安全,最大限度减轻山洪灾害损失”的建设目标;规范了建设任务、建设内容和概算编制要求等;体现了具有福建特色的项目总体要求和技术方案,为各地编制实施方案奠定了良好基础。 步骤3将所有M对CT-MR 图像输入到联合框架的分割部分,在有无真实标签的两种情况下分别使用Edice和Econsistency约束分割标签。 步骤4交替运行步骤2 和步骤3,直到网络趋于稳定得到最终的配准和分割模型。 由于配准与分割子网络在未经训练时网络参数随机初始化,得到的配准和分割结果可能效果并不理想。直接使用配准和分割子网络进行联合优化,可能并不会朝着正确的方向进行优化[29],由于互相的约束作用反而会使结果逐渐恶化,因此选择预训练配准与分割子网络为两者提供较好的初始参数,保证联合训练时不会出现恶化的情况,使联合训练过程只需要在预训练的基础上进一步微调优化即可[29]。此外,在全部M对CT-MR 图像中仅有N对图像包含真实标签(N 值得注意的是,本文方法采用了联合训练的方式而非多任务学习,这是因为多任务学习需要更改配准和分割网络结构,对于任意新的配准和分割网络来说都需要重新设计网络。采用联合训练的方式同时实现配准和分割,无须对子网络结构进行改动,对于任意新的深度学习配准分割网络可以直接组合。在联合训练框架中,对于配准和分割的要求是输入两种模态的图像,分别输出两种模态图像之间的形变场和两种模态图像的分割标签。配准与分割的联合交替优化主要通过形变场和分割标签来完成,如图2 所示。本文提出的框架是一种即插即用[30]的网络框架,对于任意多模态配准网络和分割网络,在满足输出形变场和分割标签的情况下均可进行组合应用到联合框架中。通过即插即用的方式组合现有的配准和分割网络,可以直接在现有模型的基础上专注于特定任务进行优化,在决策级别进行联合避免了特征级别联合需要更改网络结构的操作,保证配准和分割互相作用,在提升效果的同时大幅减轻了工作量。 为了解决目前联合配准分割算法难以应用于多模态数据的问题,本文提出一种基于多尺度邻域描述符和模态一致性监督的联合配准分割框架(MCRSNet),通过模态一致性监督将两个分割网络和一个多模态配准网络联合起来,两个分割网络串行运行,分割和配准并行运行,实现配准和分割的同时提升。 以掘进机截割臂升降角度为例,验证建立的基于油缸行程传感器的截割头姿态角检测模型。试验中,截割臂从0°到最大角度23°,将掘进机平台参数L0=388 mm,L1=202 mm,L2=470 mm,θ=54.18°和油缸行程传感器相对截割臂为0°时伸长量代入式(2),得出的截割臂升降角度为测试值,以安装在截割臂上的精度为0.01°的两轴倾角传感器SCA120T检测的截割臂角度为理论参考值,结果见表2。 图3 配准子网络结构Fig.3 Structure of registration subnetwork 1.2.2 基于多尺度邻域描述符的损失函数 图4 分割子网络结构Fig.4 Structure of segmentation subnetwork 本文提出一种应用于联合配准分割框架MCRSNet 的损失函数,其中,CT-MR 有标签和CT-MR无标签情况下的损失函数如式(3)和式(4)所示: 其中:Ereg表示配准损失部分;Eseg表示分割损失部分;EmsMIND用于约束配准的局部结构;Edice用于在有标签的情况下约束配准和分割的全局轮廓边界;Esmooth用于使配准形变场平滑;Econsistency用于在无标签的情况下提供监督信息同时约束两种模态分割标签之间的模态间一致性;If和Im分别表示固定图像和浮动图像;Lf,segandLm,seg分别表示固定图像和浮动图像的分割结果;Lm,gt和Lf,gt分别表示固定图像和浮动图像的ground-truth;ϕ表示形变场;∘表示非线性变换。经过多次实验验证,最终α、β、λ分别为20、2.0、0.5。 1.2.1 模态一致性监督损失函数 为了进一步提升配准效果,本文设计一种多尺度模态独立邻域描述符(multi-scale Modality Independence Neighborhood Descriptor,msMIND),并基于msMIND 设计结构损失函数,提升配准的结构准确性。 在真实标签存在的情况下,配准和分割所需标签由已标注的真实标签提供。当标签不存在时,通过模态一致性监督损失来为配准和分割继续提供监督信息。本文利用配准产生的形变场对MR 图像的分割标签进行形变并将形变后的标签与CT 图像的分割标签进行结构匹配,从而在无标签时也能够提供监督信息。模态一致性监督损失Econsistency定义如下: 其中:Sm(y)和Sf(y)表示体素y处的浮动和固定的分割标签;ϕ代表形变场;∘代表非线性变换。 配准网络产生的形变场ϕ提供了从浮动图像到固定图像的逐体素位移分量。对于配准网络来说,浮动图像的分割标签经过形变场形变后应该具有与固定图像分割标签相同的解剖结构,即Lm,seg∘ϕ≈Lf,seg。此时,分割网络固定,利用分割标签对配准进行监督进一步提高了配准在标签覆盖区域的精度。对于分割网络来说,它产生的分割结果Lf,seg和Lm,seg提供了图像上感兴趣区域的体素分布,同样也会存在Lm,seg∙ϕ≈Lf,seg,此时配准网络固定,两个模态的分割网络互为监督,使得两个分割网络的分割标签具有模态间一致性。本文通过优化一致性损失Econsistency在缺少标签的情况下实现对配准和分割的约束。也就是说,这种约束可以帮助配准算法找到准确的标签对应关系,帮助分割算法补充缺失的监督信息,使分割结果具有模态间一致性。 本文利用模态一致性监督Econsistency建立了不同模态分割与配准之间的联系,并为联合训练过程中的两个任务参数的更新提供了指导,将模态一致性监督集成到损失函数中,从而形成了基于模态一致性监督的损失函数。 为了尽可能保证精度,构建基于空间通道双注意力模 块scSE-block[31]的分割网络nnU-Net[32]作 为本文的分割子网络,称为scSE-nnU-Net,如图4 所示。在下采样过程中使用跨步卷积与最大池化来进行特征提取,并使用转置卷积与scSE-block 执行上采样操作,通过在空间和通道两方面抑制不重要信息,进行有效特征的提取。输入图像尺寸为128×128×96像素,批大小为2。共执行5 次最大池化操作,得到底部特征图大小为4×4×6 像素。每个编码器由两个卷积块组成,激活函数为LReLU 函数,卷积核大小为3×3×3。初始卷积核数目设置为32 个,随着每次最大池化数目倍增,直到底部数量最大为320 个,然后使用上采样将特征图恢复至原始大小,并使用Softmax 得到输出结果。 为了评估配准与分割性能,本文选择了一些表现良好的方法与MC-RSNet 进行对比。配准网络有Elastix[37]、Voxelmorph[38]、Ms-RNet[4],分割网络有U-Net[39]、nnU-Net[32]、scSE-nnU-Net。其中,Ms-RNet[4]和scSE-nnU-Net 分别是本文的配准与分割子网络。 将表面活性剂和助表面活性剂按质量比(Km)混匀,得到混合表面活性剂(Smix);将油相(Oil)和Smix混匀,得到混合油相;在混合油相中缓慢滴加水相,不断搅拌,直至形成透明的体系,记下体系发生透明或浑浊变化时的各组分用量,用origin8.5绘制伪三元相图。根据纳米乳区大小,筛选合适的纳米乳体系。 由于解剖结构在局部邻域内的相对灰度分布基本不受模态变化影响[33],因此通过设计结构描述符来排除模态的影响进而实现多模态配准的测度。本文基于自相似理论[34],描述每个体素周围邻域的灰度分布来表示该体素的局部结构。如图5 所示,选取图像中任一图像块的周围6 邻域图像块,并计算每两个图像块之间灰度上误差的平方作为自相似性,中心图像块周围的12 对图像块的自相似性共同组成了中心图像块的上下文信息,用来表示该中心图像块处的局部结构。如图6 所示,为了更进一步解决6 邻域范围的限制,在原有6 邻域的基础上扩展到了12 邻域,分为内外两层,并给内外两层赋予不同的权重。相比于现有的MIND[9]描述符和MINDSSC[35]描述符,本文的改进在于:将原有6 邻域多尺度化,扩充了局部结构所包含的信息量,在着重于中心点附近重要信息的同时,保证远离中心点的信息也能够被接收到,实现对局部结构更加准确的表达。为了简便起见,在图5 中仅画出了单一尺度的表现形式,多尺度的形式只需以相同的半径将邻域扩充两倍,如图6 中的二维展示。 图5 msMIND 三维展示Fig.5 Presentation of msMIND in 3D 图6 msMIND 二维展示Fig.6 Presentation of msMIND in 2D msMIND 的计算公式为: 现代立体漆艺以三维立体的形式,丰富多变的漆绘语言,表达艺术家的造物能力和审美理想。胎骨,作为塑型的基础,是研究现代立体漆艺无法绕开的核心话题。不论是传承既有的材料处理方式来表现现代人的审美理想,还是在材料的创新上下功夫,其丰富多变的形式都是无法在一篇文章中尽述的。但这“承”与“变”的划分不是最关键的。我们将持续关注的是现代艺术家们欲要表达的心境和理想,以及他们借助现代立体漆艺表现心境和理想的技术能力。 其中:msMIND 表示双重尺度6 邻域范围内的局部结构,与中心图像块x距离为r代表内层6 邻域,距离为2r代表外 层6邻域;α和β分别代 表不同权重;Dp表示以x为中心的6 邻域内任意两个距离向量ri和rj上的图像块zi、zj之间的灰度相似距离;每个图像块大小为p×p×p;P定义为两个图像块之间一系列的位移量;t代表任意分位移量。因此,Dp计算两个图像块内所有点的均方差,如式(7)所示: V(I,x)是图像局部方差的估计,定义为所有6 邻域图像块之间的Dp的期望: 由于msMIND 特征是Dp的高斯函数,因此在不相似时表现为低响应,在相似时表现为高响应,可以很好地表征局部特征[4]。一旦提取了两个图像的msMIND 描述子,相似性度量就可以定义为两者描述子之间的绝对差的平均值。因此,基于msMIND的相似性度量定义如下: 其中:I和J分别是两幅待比较的图像;R是6 邻域向量的集合。 实验数据集来自丽水市中心医院,包括118 对CT-MR 图像及其对应的肝脏标签。CT 图像为平扫未增强,原始尺寸为512×512 像素×L(其中L为CT数据中切片的数量,范围为32~104);MR 图像为T1未增强,原始尺寸为512×512 像素×K(其中K为MR数据中切片的数量,范围为52~80)。肝脏标记由两名放射科医生手动标记,以评估配准性能和辅助配准。需要注意的是,在训练过程中只使用了30%的肝脏标签,极大地减少了图像标注任务的时间。为了进一步评估图像结构配准好坏[36],在每对CT-MR图像上标记了3 个标记点,如肿瘤、囊肿和肝裂隙,标记图像示例如图7 所示。 图7 CT-MR 图像展示Fig.7 Presentation of CT-MR images 对于所有图像数据,CT-MR 图像对使用仿射对齐[37]来减少位置偏差。然后将所有图像重采样到各向同性体素(1 mm×1 mm×1 mm),并进行归一化和剪裁得到分辨率为304×304×228 像素的清晰图像。其中,90 对CT-MR 图像作为训练集,28 对作为测试集,并在训练过程中使用随机仿射变换对数据进一步扩展,同时进行五折交叉验证以减少实验误差。 对于配准任务,采用3 项指标来评价配准结果,其中,Dice 相似系 数(Dice Similarity Coefficient,DSC)用于评估配准前后肝脏的重叠程度,Hd95(95% Hausdorff distance)用于评估标签边界的距离,数值越低表示两者越接近,目标配准误差(Target Registration Error,TRE)用于评估配准前后标记点的距离误差,定义为距离的均方根。具体公式如下: 步骤2将所有M对CT-MR 图像输入到联合框架的配准部分中,使用EmsMIND约束结构对齐,分别通过Edice和Econsistency在有无真实标签的两种情况下约束分割标签对齐。 不,准确来说,也不能算是完全的骸骨,应该是有些皮肉的,只是那皮肉太过干枯,皱巴巴地贴在了骨架上,以至于他的关1.1 配准-分割联合优化的深度学习网络结构

1.2 基于模态一致性监督和多尺度邻域描述符的损失函数

2 实验与结果分析

2.1 数据集与评价指标