距离信息与排序模型融合的显著性目标检测方法

2023-07-14陈睿琦南心蒙

陈睿琦,南心蒙,常 皓

(1 西安现代控制技术研究所,陕西 西安 710065;2 32382部队,北京 100072)

0 引言

在图像制导、引信探测、机器视觉等领域,采用图像探测技术识别复杂背景中的目标是武器系统实现对目标精确打击以及机器人自主避障的重要技术途径。但由于地面背景环境的复杂性,使得探测和识别地面上车辆目标具有很大的难度,特别对制导系统,由于弹药平台体积、信号处理时间等限制,必须在有限时间和有限图像分辨率的约束条件下,实时完成图像信息的处理和目标的检测识别。

显著性目标检测是一种基于辨别图像中最醒目区域或图像特征的目标检测方法,旨在快速有效提取场景中的视觉突出或重要物体,为后续分析和处理提供坚实的基础。目前,针对显著性目标检测方法的研究已涉及地面、航空、航天和船舶等多种武器装备领域。在红外图像检测方面,朱大炜[1]提出了一种基于深度学习的红外图像飞机目标检测方法,以RCNN(region with convolution neural network features)目标检测技术实现了对红外图像中飞机目标的实时检测;管学伟[2]研究了一种机载红外搜索跟踪系统IRST(infrared search and track system)小目标检测技术,首先对机载IRST图像进行预处理以改善成像质量,再通过对红外小目标图像特征进行分析,对比了多种机载红外小目标检测算法,实验并验证了其背景抑制和目标增强效果。在可见光图像检测方面,徐芳[3]提出了一种可见光航天遥感图像海面目标自动检测方法,可有效抑制图像中薄云、海雾、阴影、海杂波等干扰,利用舰船信息改进熵估计和目标像素分布判定的目标鉴别方法对切片中的舰船目标和非舰船目标进行鉴别,无需对图像进行精细分割就能可靠稳定提取舰船目标;刘波[4]针对水下探测器目标检测技术开展研究,为适应水中弱光环境特点对图像进行分割、检测和拼接,使用了一种基于纹理特征的图像型船舶尾流分类辨识技术对船舶目标进行检测识别,实验结果表明该方法平均正确识别率可达到80%以上。

以上显著性目标检测仍集中在可见光图像或红外图像,也可将二者融合起来,以提高对感兴趣目标的检测概率。但无论是可见光图像还是红外图像,图像中只包含场景及目标的二维信息,未利用目标相对于所在地面背景三维轮廓差异这一重要特征。

为了提高图像制导及引信探测系统在复杂背景中检测和识别目标的能力,文中的目标探测装置采用了激光三维成像探测方法获取目标、背景的距离以及目标相对于地面背景的距离投影轮廓信息。在制导系统中,采用中等分辨率的激光三维成像探测快速获取目标背景距离及轮廓信息;在引信探测系统中,则采用低分辨率的激光三维成像探测快速获取目标背景距离及轮廓信息。通过在原有平面二维图像基础之上叠加目标相对于所在地面背景的第三维距离信息,提出了一种基于距离信息图像分割和排序模型融合的显著性目标检测方法,能够有效提高近程探测系统在复杂背景中快速检测及识别目标、抗复杂背景干扰的能力。

1 显著性目标检测及算法

显著性目标检测是通过图像处理算法检测并分割图像中的显著性目标区域,在视觉跟踪[5-6]、图像识别[7-8]、图像压缩[9-10]、图像融合[11-12]等视觉和图像处理过程中起着至关重要的作用。此外,显著性目标检测与动物包括人类对场景中显著性目标的视觉刺激的感知机制有一定的相似性,也成为机器视觉和人工智能等领域的研究热点。

基于流形排序模型的可见光与红外图像显著性目标检测算法具有可适应复杂背景、图像亮度、对比度动态范围大的优势[13],在图像制导和机器视觉领域有重要应用的前景。

流行排序模型可用于可见光图像或红外图像中的显著性目标,也可用于可见光与红外复合体制图像的处理。在可见光图像质量较差或图像场景较复杂的情况下,通过引入热红外图像信息,可显著提高对感兴趣目标的正确检测概率。例如,白玉等[14]研究了一种基于可见光图像和红外图像决策级融合的目标检测算法,该方法使用有监督学习方式对红外图像及可见光图像分别开展检测,通过对单一检测结果进行加权融合得到决策级融合的检测结果,进而实现了基于决策级融合的快速目标检测。然而,现有的可见光/红外复合检测算法仍存在缺点和不足,主要问题在于可见光图像和红外图像只保留了目标及背景的二维平面信息,而对平面图像信息进行分割时,需将整幅图像分割成一定数量的区域,分割数量不同对应的显著性检测结果也不同,且因为分割区域内所有位置具有相同的显著值,使得检测显著图中出现明显的块效应,尤其在目标的可见光特征及红外特征不突出、背景干扰较为复杂时,图像分割的效果不理想。

2 距离信息与排序模型融合的显著性目标检测方法

考虑到上述基于平面二维图像目标检测方法的局限性,通过在二维平面图像探测系统中引入了三维形体成像探测体制,将目标及背景场景距离信息和平面图像信息进行融合,实现了在复杂背景下可见光特征及红外特征不突出时对目标的精确检测。

距离信息实质上是目标及背景场景中各点相对于探测装置的距离图像。针对弹载系统小型化、快速探测和快速信号处理的要求,采用激光探测装置实施快速的立体简易成像探测,获取场景的立体图像,利用图像场景中距离信息的变化和可见光/红外图像信息融合,提高弹载成像系统在复杂背景中探测目标的能力和抗干扰的能力。对现有图像分割和多级深度融合显著性目标检测方法的分析可以看出,在图像预处理过程中,对原始图像的分割一是采取均匀分割方法,二是依据图像的亮度分布、灰度分布或者彩色可见图像RGB的分布进行图像分割。对于相对单一的地面背景和亮度或颜色特征相对突出的目标,上述分割方法是可行的,但对于复杂的地面背景以及亮度和色彩特征不突出目标,图像分割的效果较差。从可见光角度而言,如果地物背景构成复杂,颜色丰富,则目标的颜色和背景是难以区分的;在红外图像方面,当背景的介质构成复杂,受阳光照射等因素影响,目标的红外特征相对背景而言并不突出,则基于热特征的红外图像分割方法精度也受到限制。

针对弹载探测系统对信息处理的需求,为了保证图像信息处理的快速性,探测装置中采用的激光三维成像探测装置采用中低分辨率的图像探测装置,如在图像跟踪系统中采用64×64分辨率的三维图像,在距离更近的图像探测系统中选32×32或16×16分辨率的图像,探测装置的距离分辨率达到0.1 m时就能分辨出目标的形体。

检测图像场景中是否存在感兴趣目标时,利用激光三维成像数据对可见光图像和红外图像进行分割,分割出相对于地面背景有显著距离变化特征的物体,可大幅度降低待处理的可见光或红外图像数据量,提高图像处理的速度和对目标检测的准确性。针对车辆等目标相对地面在形体轮廓方面的特点,采用不同位置距离产生的畸变量和距离尺度范围对三维图像信息进行预处理,获得目标以及与目标相似的背景,而将其余背景剔除,从而实现对可见光图像通过三维距离图像进行分割。

三维立体图像不仅包含背景和目标相对于探测装置的距离信息,同时不同像素单元距离的变化率能够反映具有一定形体的目标相对于背景在距离和结构上的突出特征,为了能将目标和背景分割开来,采用三维立体图像像素所代表的距离信息变化对图像进行分割。采用的分割模型为:

D0=A1XN+A2XN-1-BDN-1

(1)

式中:D0为距离的初始检测阈值;N为图像的第N个像素;A1,A2为调整系数,主要依据图像探测装置视场相对地面的角度而定,对弹载图像制导系统而言,该系数与弹的落角有关;XN为当前像素代表的距离值;XN-1为前一个像素对应的距离值;B为常数,与距离探测装置信噪比有关;DN-1为前次距离检测阈值。

基于距离信息与排序模型融合的显著性目标检测算法需要考虑到从成像探测装置的视角观察目标及其所在的环境背景。对于车辆、工事等目标,目标表面相对于探测装置的距离、背景与探测装置的距离发生较大的跃变,即使从空中向下对地面垂直观察,目标相对于背景也有明显的高度差。由式(1)通过检测目标相对于背景的距离变化来完成图像的分割。

通过三维立体图像相邻像素的距离值的变化率检测目标图像的外轮廓和距离特征的分布区域,对显著性目标做出判断。

基于距离信息的显著性目标检测形成一个与立体图像分辨率一致的集合,记为D,将D与可见光图像V和热红外图像T联合运算,构建多模态图输入图像的阶段图GD=(VD,ED)和GV/T=(VV/T,EV/T),其中,V和E分别是图G的节点集合和边集合。GD和GV/T的所有连接边的权值计算方法为:

(2)

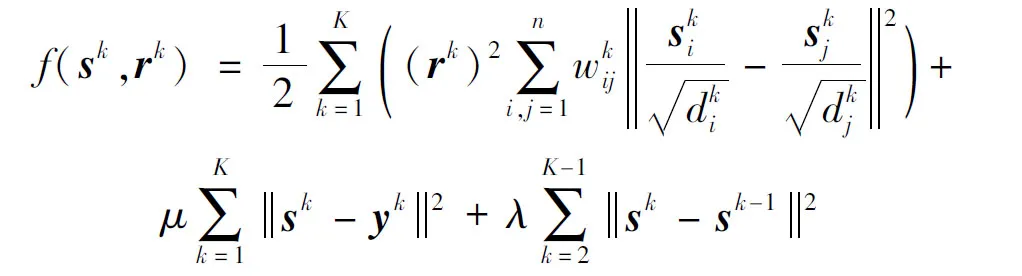

对传统的流型排序模型进行改进,实现如下跨模态一致性的流型排序模型:

(3)

S,R=argminf(sk,rk)

(4)

对模型采用交替方向乘子法(ADMM)进行反复迭代,当式(3)的误差小于预设值时,即得到最优解S。

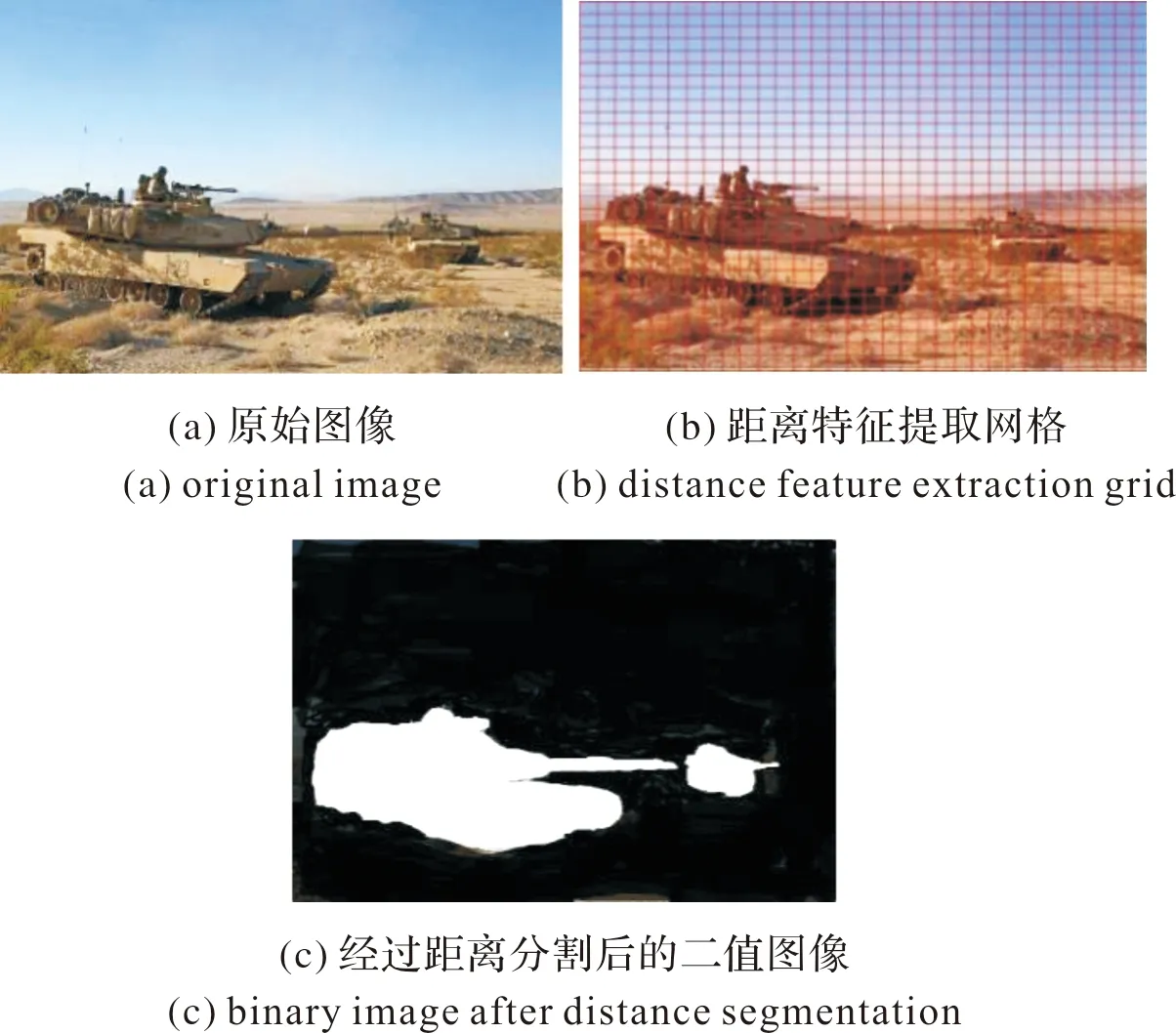

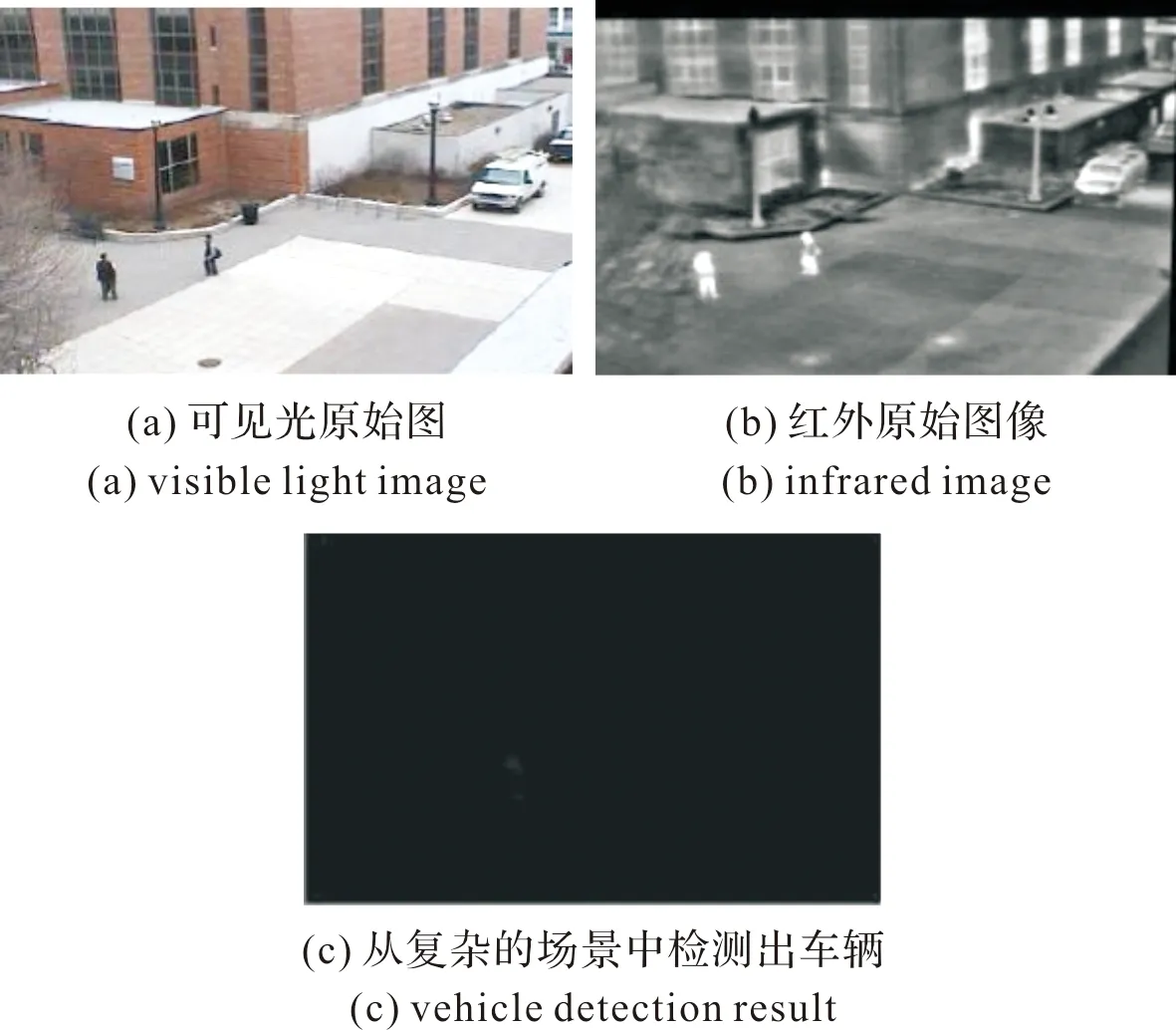

利用式(3)及式(4)对融合了距离信息的可见光/红外图像进行显著性目标检测,得到检测结果的显著图,如图1所示。

图1 目标距离成像及基于距离信息的图像分割Fig.1 Target distance imaging and image segmentation based on distance information

3 算法仿真验证

采用可见光成像装置和红外图像装置获取场景的可见光及红外图像,利用激光成像装置获取场景中样点相对于激光成像装置的距离,采用距离信息与排序模型融合的显著性目标检测方法对图像处理算法进行仿真计算,以验证方法及算法的有效性。

获取可见光、红外以及距离图像时,3种机制的图像信息应在空间是配准的,即图像大小相同,景物空间位置一致。当3种体制图像的空间不匹配时,首先对图像进行预处理,通过图像像素差值等方法使可见光、红外以及距离图像相配准。

采用PR(precision-recall)曲线对检测结果进行评价。当给定图像后,对图像进行二值化操作后得到图B,G是输入图像对应的检测真值图。预测的准确率RP被定义为:

(5)

预测的召回率RR被定义为:

(6)

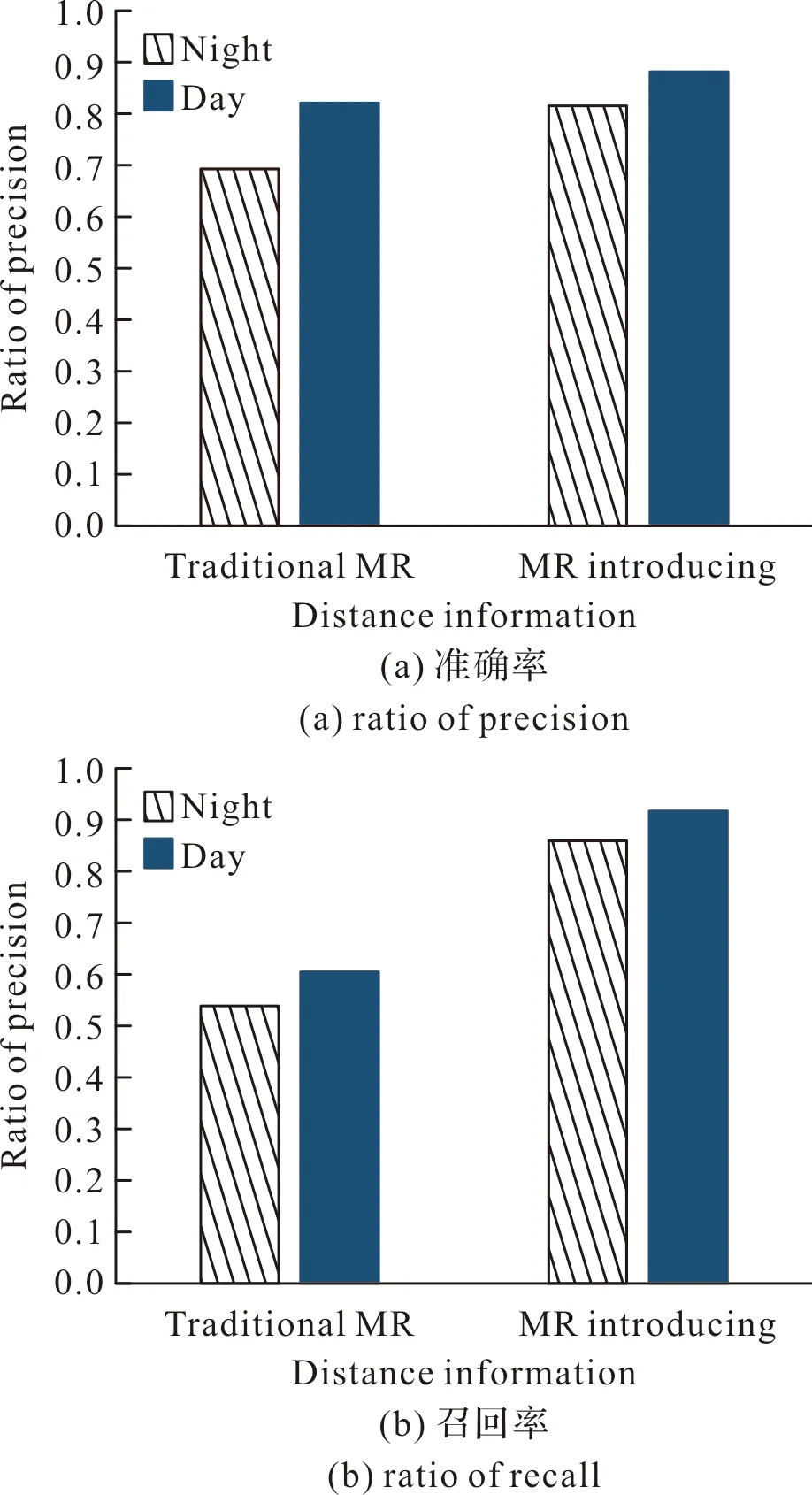

为验证文中显著性目标检测方法的有效性,实验中将该算法与传统的基于图的流形排序MR(manifold ranking)算法[15]进行比较,对两种算法在输入为相同的可见光图像和热红外图像时的检测性能进行了定量分析。实验结果表明,融合了距离信息的显著性目标检测方法拥有更高的准确率和召回率,如图2所示。

图2 白天与黑夜条件下不同算法的准确率和召回率对比图Fig.2 Precision and recall of two algorithms under different light intensities

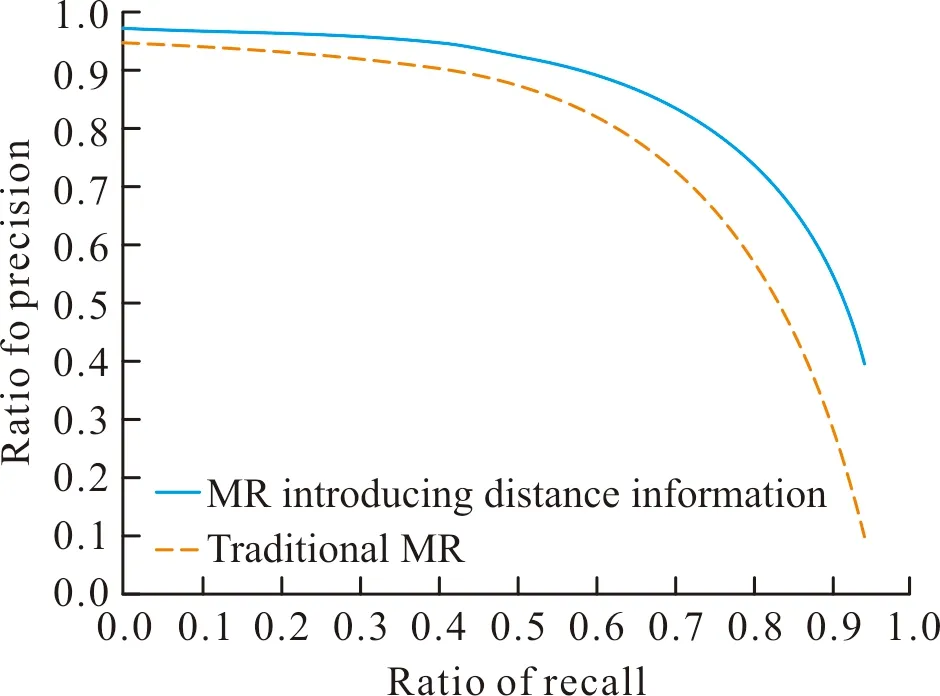

图3显示了PR曲线法定量实验分析结果。可以看出,所建立的算法中包含距离信息和空间注意力机制时性能最好,说明引入距离注意力机制相对于无距离注意力机制,对信息的过滤筛选能力更强,更适用于图像显著性目标检测。

图3 引入距离信息后的显著性检测效果Fig.3 Saliency detection result when introducing distance information

如果将人员视为干扰,将车辆作为感兴趣目标,则可以通过阵列距离信息对目标尺度进行判别,从尺度特征鉴别感兴趣目标和非感兴趣目标,从而将干扰目标剔除。

图4为未引入距离信息的排序模型目标检测结果,检测算法认为图像场景中不存在感兴趣目标,将长时间停放后红外热特征降低并靠近建筑物的车辆漏检。

图4 传统的排序模型显著性目标检测结果Fig.4 Saliency detection result of traditional ranking model

图5是基于距离信息与排序模型融合的显著性目标检测结果,剔除了行人干扰,将距离轮廓符合车辆特征的目标正确检出。

在算法运算量方面,基于距离信息与排序模型融合的显著性目标检测算法与传统的排序模型显著性目标检测算法相比,虽然增加了三维距离图像的数据处理过程,但由于算法采用的是简易成像阵列数据,数据量较小,例如按32×32的像素分辨率,只有1k左右的数据量。在引入距离图像信息后,对可见光图像和热红外图像的分辨率要求大幅度降低,其中可见光图像的数据量可减少70万左右的数据点,热红外图像可减少20万左右数据点,总数据处理量大幅度减少,因此在不降低图像处理运算速度的基础上,该方法提高了对感兴趣目标的检测正确性。

4 结论

在可见光与红外复合图像探测系统中,通过引入场景的三维距离信息,采用距离信息对图像实施分割,采用流形排序模型的显著性目标检测方法,克服了传统的流形排序模型显著性目标检测方法图像分割单元多、运算量大、对可见光及红外图像分辨率要求高、目标显著性特征不突出的问题。实验结果表明,基于距离信息图像分割与流形排序模型相融合的显著性目标检测方法在保证图像处理速度的前提下,提高了对图像场景中目标的检测、识别准确性,其中,白天条件下的目标检测准确率达到87.7%,召回率达到91.6%;夜间条件下的检测准确率达到81.2%,召回率达到86.3%,相比传统MR排序模型算法有了较大的提升。然而,该算法仍旧存在局限性,例如在对可见光或热红外图像进行单模态特征提取后,直接将两个模态特征进行融合操作,未考虑不同模态特征之间的干扰因素,可能对最终显著性预测结果造成一定影响。后续可针对不同模态特征信息融合的过滤机制加以研究,进一步增强特征融合对显著性目标的表达能力。