融合人格特征的概率推荐模型

2023-01-17沈铁孙龙付晓东刘利军

沈铁孙龙,付晓东,+,岳 昆,刘 骊,刘利军

1.云南省计算机应用技术重点实验室(昆明理工大学),昆明650600

2.昆明理工大学信息工程与自动化学院,昆明650500

3.云南大学信息学院,昆明650504

近年来,互联网的蓬勃发展致使网络信息量呈指数级增长,网络大数据给人们带来严重的信息过载问题,导致用户难以准确获取与其需求相符合的信息。推荐系统能够根据用户历史行为数据,分析其潜在偏好,为用户提供个性化推荐,成为缓解信息过载问题的有效手段。目前,推荐系统已应用于电子商务(如Amazon、阿里巴巴)、社交网络(如Facebook、Twitter)、电影推荐(如Netflix)、音乐推荐(如Last.fm)、新闻推荐(如GoogleNews、今日头条等)等领域。

现有推荐系统主要是基于历史信息的推荐,以用户评分矩阵作为主要的用户偏好信息[1]。用户评分具有主观性,不同用户打分标准不同,进而不同用户对同一商品的评分不可比较,导致推荐效果不佳[2-3]。同时用户评分矩阵通常较为稀疏,而推荐系统模型期望稠密输入,稀疏输入带来性能下降,因此现有推荐算法普遍面临评分矩阵稀疏,难以分析提取用户偏好的问题[2],也造成了实际推荐效果不佳。多数推荐平台为用户提供了交互接口,如点赞、评论等。在线评论是用户对项目感受的具体反馈,这些反馈信息通常以非结构文本形式存在,合理分析用户评论信息能够对项目特征及用户偏好进行精细刻画。基于用户评论、基于用户隐式反馈信息的推荐算法在解决冷启动、推荐准确性以及可解释性等方面具有重要潜力[4]。然而当前受到文本信息挖掘技术、用户潜在特征建模技术等方面的限制,基于评论信息分析的推荐算法进展并不明显[3]。

目前的研究广泛认为基于模型的推荐系统推荐效果优于基于历史信息的推荐系统推荐效果,特别是在稀疏数据上效果更好[5]。以模型为基础的协同过滤推荐算法需分析提取“用户-项目”特征矩阵以进行用户推荐。用户特征不同直接导致用户偏好不同,但以模型为基础的协同过滤推荐算法仅考虑分析提取影响项目特征的关键因素而未考虑分析提取影响用户特征的重要因素,这类传统模型往往将用户潜在特征向量随机初始化,并赋予一个假定的正态分布,导致这些推荐系统模型中没有任何一项数据变化可以对用户潜在特征建模结果产生直接影响。另外基于用户的推荐系统模型往往将用户的评论、评分的信息直接近似作为用户特征,传统推荐系统中这些数据引用方式和这些数据本身不足以支撑获取用户的本质特征。这些特征的近似也不能满足个性化推荐的需求。没有对用户本质特征的分析,推荐结果无法匹配用户个性。用户特征模型的不完整,同时也导致了冷启动问题和数据稀疏问题,需要大量的用户数据和历史行为信息才能为用户推荐满意的项目[6]。

针对上述问题,提出一种融合人格特征提取的推荐算法。构建人格特征提取神经网络,从评论信息中获取人格特征进行用户建模,将人格这种非结构数据转换为结构数据。输入用户评论及评分信息,输出用户人格得分。人格是一种心理构造,可用于描述和解释人类的行为。通过人格模型的引入,解决推荐系统“用户-项目”模型面临的用户特征缺失问题,提取人格特征作为用户本质特征,为个性化推荐系统的改进提供了新的思路。本文主要工作包括三方面:

(1)将人格这一心理学领域概念引入推荐系统,并将其作为影响用户特征表示的主要因素进行用户特征模型建模。

(2)设计人格提取神经网络模型,用于获取用户评论中反映的BIG FIVE 人格得分。

(3)设计融合人格感知的协同学习框架,将用户人格特征和项目的评论文本语义分析特征融合到概率推荐模型中,根据学习结果进行推荐,并在真实数据集上进行了全面的验证。

1 相关工作

1.1 推荐系统模型

个性化推荐的目标是通过对影响用户偏好的自身及外界因素进行分析建模,以获取用户潜在的兴趣内容并推荐给用户[7]。以所用方法来进行划分,目前主流的推荐方法主要包括基于内容的推荐算法(contentbased recommender)[7]、协同过滤算法(collaborative filtering)[8]、混合推荐算法(hybrid recommender)[9]。

基于内容的推荐算法通过抽取各个项目的属性特征,分析用户历史行为构建用户对项目的偏好向量,然后计算用户偏好向量与候选项目特征向量的相似性,向用户推荐相似度高的项目。该方法特征提取困难,局限于文本资源推荐,很难挖掘用户潜在兴趣[3-4]。

基于协同过滤的推荐算法可分为两个类别:基于内存的推荐(memory-based methods)与基于模型的推荐(model-based methods)[10]。其中基于内存的推荐仅仅将“用户-项目”历史评分记录作为数据源,没有利用用户的上下文信息。研究发现仅仅依靠“用户-项目”历史评分记录作为依据,在实际应用场景中其准确性与适用性都存在很大问题[11]。

基于模型的协同过滤推荐又可称为隐语义模型(latent factor model)。使用统计和机器学习技术,从“用户-项目”评分矩阵中分解出两个低阶矩阵,分别表示用户和项目的隐藏特征矩阵,通过隐藏特征预测用户评分[12-14]。已有多种模型被用于基于模型的协同过滤方法,如贝叶斯模型[15]、矩阵分解模型[10]、潜在语义分析模型[16]、深度学习模型[10]等。基于矩阵分解的方法,如SVD(singular value decomposition)[5]、NMF(non-negative matrix factorization)等,根据高维用户-项目评分矩阵学习用户、项目的低维向量表示,并将其用于推荐任务。此类方法在处理大规模数据时有良好表现。为了缓解协同过滤算法数据稀疏性和冷启动问题,研究人员将深度学习模型引入推荐领域用于隐藏特征的学习。文献[6]将2 层受限玻尔兹曼机(restricted Boltzmann machines,RBM)用于协同过滤,该文献首次提出基于深度学习的协同过滤模型。文献[10]利用用户信息、历史行为等多源异构数据,将深度神经网络用于YouTube 视频推荐系统的候选集生成模块和精排模块,推荐效果显著提升。Google提出Wide&Deep 学习模型[17]用于手机APP 推荐,该模型联合训练一般的线性模型(wild)和多层感知机模型(deep),使其同时具有记忆能力和泛化能力。目前的研究广泛认为基于模型的推荐结果优于基于历史信息的推荐,特别是在稀疏数据上效果更好[18]。

1.2 推荐系统信息源

若以基于何种信息进行用户推荐来划分个性化推荐方法,可将个性化推荐算法分为基于评分的推荐算法、基于评论的推荐算法、融合评分及评论的推荐算法和利用其他历史信息的推荐算法等。基于评分的推荐算法面临数据稀疏、冷启动等问题,近年来许多研究者将评论信息融入协同过滤算法解决上述问题。研究人员综合考虑了评分信息以及评论信息,提出了一种矩阵分解推荐模型(probabilistic matrix factorization,PMF)[16]。该模型假设存在一个用户特征矩阵和一个项目特征矩阵,通过概率模型方法求解出这两个矩阵,并将两个矩阵的乘积作为用户的最终评分预测矩阵。但该模型未考虑造成用户特征差异的影响因素,假设影响用户特征的影响因素随机,随机初始化用户特征参数。文献[19]提出一种综合考虑评论文本以及项目和用户特征矩阵的模型。该模型在文献[16]的基础上使用卷积神经网络将用户对项目的评论文本特征向量与项目特征矩阵结合,从而提升了模型预测的准确率。

文献[20]提出一个混合了自注意力机制和自编码器的协同过滤推荐模型,通过基于物品的协同过滤实现来挖掘物品与物品之间的局部依赖关系,同时采用注意力网络来为用户不同的历史交互物品和目标物品的相似度计算分配不同的权重。该方法采用注意力机制来分配不同相似度计算的权重,以获得最终的推荐结果,可为推荐结果带来一定效果提升,但使用的核心方法本质上依然是传统的基于近邻的协同过滤推荐方法,并未直接获取到用户特征这一直接影响推荐结果关键信息。文献[21]采用一种融合序列的生成对抗网络生成模型来重现用户喜欢的项目序列,从而实现推荐,一定程度上缓解了传统词嵌入方法中相似项目向量之间的联系不强的问题。文献[22]从内容推荐入手,提出一个基于多层注意力表示的推荐模型,利用用户属性信息和歌曲的内容信息挖掘用户对歌曲的偏好特征,利用注意力网络提升了推荐性能。

上述研究在进行推荐时都假设影响用户偏好的用户特征的影响因子是随机的,没有考虑到有影响因子直接会对用户偏好造成影响,往往采用获取实际的推荐结果逆推的方式拟合这种影响,不利于解决冷启动等推荐系统面临的问题。这些研究仅考虑项目特征对推荐结果的影响,而未考虑不同用户特征对推荐结果的影响,没有对用户特征进行表示,更没有考虑引入人格、情感等作为用户特征表示的影响因子。

1.3 人格与推荐系统

人格是一种持续伴随着个体的行为及人际交互模式[7],在一段时间内它是稳定且可以预测的。相关研究[7-8]表明人格会影响个体的兴趣以及偏好,研究显示,人格与个体的偏好具有很强的关联性。具有相同人格的个体可能具有相同的偏好以及行为模式[12],这为结合人格因素进行用户建模及偏好预测工作提供了可能。人格模型的引入在四方面对推荐算法有促进作用[10,17,22]:(1)人格得分可直接用于用户潜在特征的构建,有助于表示用户特征;(2)心理学领域对BIG FIVE 人格特征模型进行过广泛、深入的验证[21],证明该模型确实可用于客观、准确的人格表示,而人格因素直接对用户偏好产生主要影响[7],将人格模型应用于推荐系统,能够合理表征用户偏好,为用户做出合理、客观的推荐;(3)BIG FIVE 五项人格特征得分包含了不同用户间人格的丰富对比关系,利用多维度的对比关系能够合理区分不同用户的不同偏好取向,为用户做出多样性推荐;(4)通过人格模型将用户的潜在特征联系起来,能够提升推荐系统推荐结果的可解释性(人格相似的用户更可能被推荐相同的项目)。人格不仅能反映个人行为,还会对人类偏好产生重要影响[5]。但人格这一重要数据在推荐系统的应用上存在两个难点,导致当前人格推荐系统研究较少:(1)人格信息难以获取,难以识别。文献[9]提出一种基于性格(temperament)的建模模型,该模型根据Keirsey 理论[8]将信息空间划分为32 个性格段。实验结果表明,基于性格的信息过滤方法在准确率和有效性上均优于基于内容的信息过滤方法。文献[10]提出一个基于人格的音乐推荐系统,该系统通过心理学揭示的人格特质与音乐偏好的联系来进行音乐推荐。这些研究获取人格特征的信息需求量远远大于推荐系统通常能够提供的信息量。往往需要通过调查问卷等方式获取人格特征信息,这些研究并未利用在线用户评论文本中隐藏的丰富人格信息。(2)目前尚未有研究者建立一个将包括人格在内的情感数据应用于推荐系统建模的合理模型,如何将人格数据引入推荐系统模型并与推荐任务产生关联是一个新的挑战。

本文拟采用BIG FIVE 人格模型对推荐系统用户特征进行刻画。大五人格模型(BIG FIVE model)是现代心理学中描述最高级组织层次的五方面的人格特质,这五大人格特质构成了人的主要性格[5],它由五个基本特征组成:开放性(openness)、尽责性(conscientiousness)、外倾性(extraversion)、宜人性(agreeableness)、神经质性(neuroticism)[10]。在心理学实验中每个人格特征由1~7 之间的实数评分确定。心理学研究发现,从个人性格发展的角度上来说,“BIG FIVE”人格特质通常处于长期稳定状态,即使经历重大人生事件,成人的性格特质也不会发生太大的变化[17]。“BIG FIVE”模型是一种已在心理学界被广泛引用的人格模型,也是自20世纪80年代以来人格研究者们在人格描述模式上达成一致共识的最终成果[23]。人格特征数据的应用为推荐系统用户建模提供了一个新的视野,它满足作为推荐系统用户表征数据的三个条件:(1)共同性。心理学研究[24]指出人格会影响个体的兴趣以及偏好,人格与个体的偏好具有很强的关联性。具有相同人格的个体可能具有相同的偏好以及行为模式。(2)特异性。在心理学实践中[6],不同的BIG FIVE 人格特征常常作为不同对象心理特征的重要区分指标。(3)稳定性。相关心理学研究[7-8]表明人格是一种持续伴随着个体的行为及人际交互模式,在一段时间内它是稳定且可以预测的。

由于人格因素直接影响人类偏好的重要特性,本文将人格模型用于用户特征建模,补充推荐系统“用户-项目”特征模型中缺失的用户特征信息,同时增强项目特征提取性能。最后,本文通过理论分析与实验验证了方法的合理性和有效性。

2 融合人格特征的特征提取及推荐

2.1 模型框架

本文讨论输入不完整的评分矩阵R∈RN×M,以及用户评论C和项目评论X,用提出的模型计算分析,输出预测评分矩阵R*。

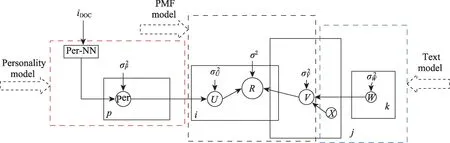

由于基于模型的协同过滤推荐系统中用户特征建模的缺失,本文提出一种融合人格特征提取的推荐算法,根据用户的评论信息及历史行为信息,结合人格提取神经网络提取用户人格得分,作为用户特征模型的主要影响因子;同时对项目的评论信息进行特征提取,作为项目特征模型的主要影响因子。结合提出的协同学习框架将用户特征和项目特征整合到概率推荐模型中,向用户推荐更符合其偏好的项目。

图1 融合人格特征的概率矩阵模型Fig.1 Probability matrix model incorporating personality characteristics

2.2 基于深度学习的人格预测

为了解决文本中的人格发掘问题,目前大多数研究都聚焦于使用人为手段从文本中提取特征,将其添加到人格特征中[16]。这些人为设计的联系往往是文本浅层特征的提取,并没有直接从用户评论文本本身获取丰富的深层特征。因此需要设计模型对文本中体现的用户人格进行提取。

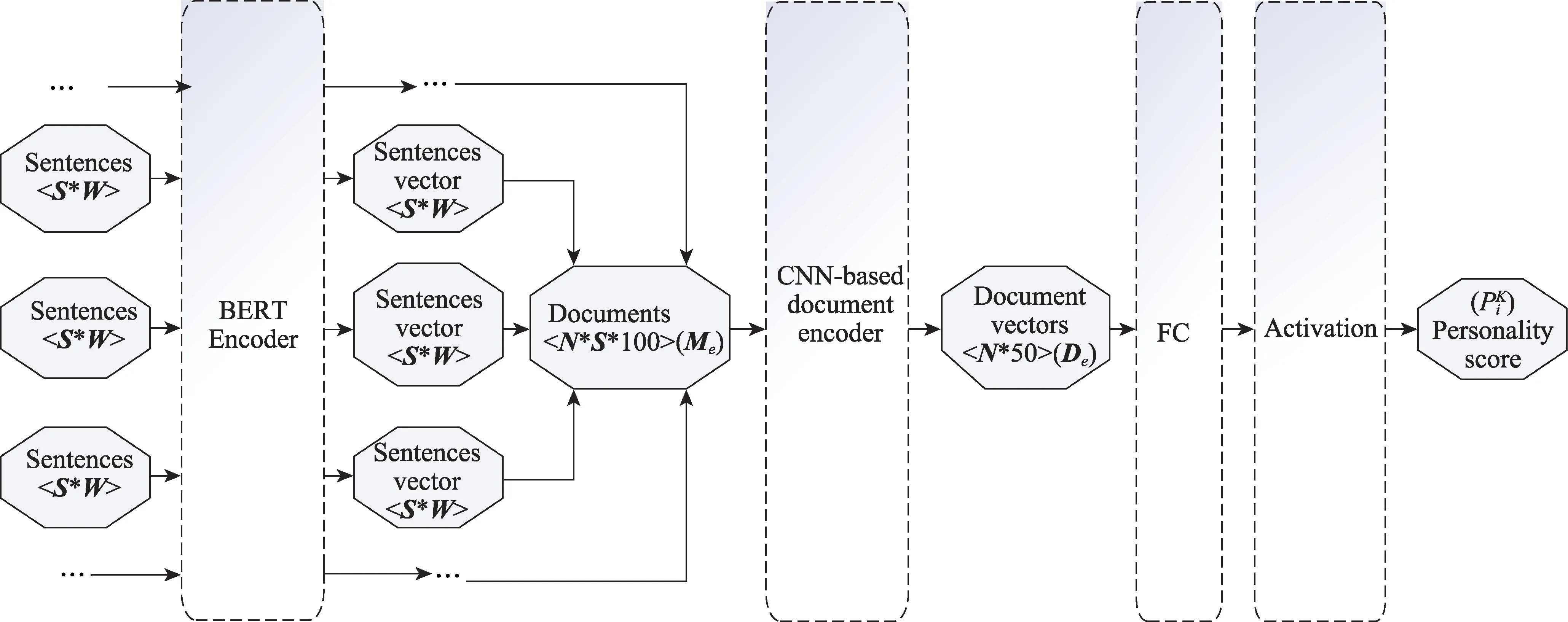

图2 Personality-nn 神经网络结构图Fig.2 Personality neural network frame diagram

2.2.1 文本预处理

由于具有不同人格的用户在使用标点符号、表情以及大小写时有不同的使用习惯,不对这些特殊字符进行特殊处理。用户常在一个单词末尾使用多个重复的字符来加强情绪表达(例如“I’m happyy!”和“I’m happyyyy!”),并且重复数量不同可能会显示不同人格倾向,在预处理过程中保留这些单词,但如果重复字母数量过多则在后续的词嵌入训练中可能会被视为多个不同的单词进而影响预测的准确度,因此设定一个英文单词后面最多可以含有5个重复的字母,如果超出这个阈值,则最多保留5个重复字母。

2.2.2 词嵌入

为了更好地对用户评论所包含的深层语义信息进行建模,采用谷歌发布的BERT 模型进行文本词嵌入,它用Transformer 的双向编码器表示。与其他语言表示模型不同,BERT 旨在通过联合调节所有层中的上下文来预先训练深度双向表示。因此,预训练的BERT 表示可以通过一个额外的输出层进行微调,适用于问答任务和语言推理等任务,无需针对具体任务做大幅架构修改[10]。使用Google 官方的uncased_L-12_H-768_A-12 作为预训练模型。使用personality 数据集进行训练,personality 数据集包含了用户ui的历史评论数据xj以及心理学专家对其进行的BIG FIVE人格评估得分。加载personality 数据集中用户评论数据X进行训练。之后将同一个用户的所有评论聚合成段落,构建词嵌入矩阵Me。

2.2.3 对深层语义信息的有监督学习

与其他的情绪提取文本处理任务不同,用户评论所显示的人格信息受时间因素影响极小,在很长的时间序列(例如一年)内不会产生较大波动[7],并不适宜采用更有利于捕获长期语义特征的RNN(循环神经网络)模型。在捕获短周期语义信息的任务中,CNN 模型比RNN 模型效果更好[12]。因此,本文提出一种基于CNN(卷积神经网络)的段落编码模型,将同一个用户的所有评论通过该神经网络进行编码,模型如图3 所示。该模型参考基于CNN 网络的Iception 模型[13]设置,段落编码网络包含了4 个CNN模块和一个池化模块(MaxPooling),一个级联层和一个全连接层。其中一个卷积模块包含两个卷积层,第一层分别含100 个大小为1 和大小为5 的卷积过滤器(Conv)。在第一个卷积层之上是批正则化层(batch nomalization)以及一个ReLU 函数激活层(ReLU activation)。第二个卷积层分别包含50 个大小为3 的卷积过滤器和50 个大小为5 的卷积过滤器。其中每个卷积核的步长都设置为1。之后将这5部分特征整合输出到全连接层得到项目文本的最终向量表示矩阵De。

图3 基于CNN 的段落编码模型Fig.3 CNN-based document encoder

2.2.4 模型训练及预测

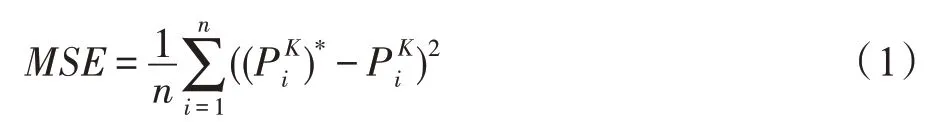

本文使用均方误差(mean square error,MSE)作为模型训练的目标函数,公式如式(1)所示:

其中,n表示用户总数,表示用户第K项人格特征的预测得分(K∈{O,C,E,A,N}),表示用户i第K项人格特征的真实得分。使用相同的网络模型设置针对5 项人格得分训练5 个神经网络。

训练完成后,从神经网络模型中提取段落编码模型的输出作为每个用户所有评论的最终深度语义信息特征向量。将这些特征输入到常见的四种回归模型中,从而预测用户人格得分。

2.3 人格与文本向量的矩阵分解

2.3.1 Per-BERT MF 的概率模型

本小节设计了一个考虑人格和文本向量的矩阵分解模型(personality and BERT matrix factorization,Per-BERT MF)。图1 展示了Per-BERT MF 的总体模型,该模型在进行用户建模时考虑其评论文本的文本向量以及该用户的人格得分。假设针对当前“用户-特征”模型存在一个潜在用户特征矩阵U∈R,以及一个潜在项目特征矩阵V∈R,当前任务是找到用户和项目的潜在特征模型矩阵U以及V,它们的乘积(U)TV构成了预测的评分矩阵R*。

定义2所有用户对项目的评分信息用R∈RN×M表示。

定义3用户ui对所有项目的评论信息用ci(i=1,2,…,n) 表示。所有用户评论的集合用C表示,即C={c1,c2,…,cn}。

定义4项目vj获得的所有用户评论信息用xj(j=1,2,…,m) 表示。所有项目获得的评论集合用X表示,即X={x1,x2,…,xn}。

R与U、V满足以下概率模型:

其中,N(x|μ,σ2)表示均值为μ,变量为σ2的高斯正态分布的概率密度函数。Iij是一个指示函数,当用户对项目进行过评分时,Iij为1,否则为0。

因此用户潜在特征的条件概率分布模型如下:

另外,一个项目的潜在特征模型由三部分组成:(1)使用BERT 模型,将vj的评论文本xj向量化作为内部权重矩阵W。(2)项目vj的评论文本xj。(3)高斯分布的噪声参数。因此项目的潜在特征模型表示如下:

对于每一个W中的权重,使用均值为零的高斯分布作为先验概率(这是最常用的先验概率模型)。

因此,项目潜在特征矩阵的概率模型表示如下:

2.3.2 模型最优化方法

使用最大后验估计[22]将用户潜在特征矩阵与项目潜在特征矩阵优化目标函数计算如下:

采用坐标下降法[23],优化潜在特征向量。计算V或U的最优解:

W词嵌入权重矩阵与BERT 模型内部的神经网络隐层以及激活函数密切相关。当U与V固定时,可以将损失函数看作具有正则项的平方误差函数:

通过反向传播算法,对权重矩阵W进行优化。

Per-BERT MF 算法的学习过程如算法1 所示:

算法1Per-BERT MF 算法

输入:用户-项目评分矩阵R、用户评论文本C、项目评论文本X、用户人格评分P。

输出:潜在用户特征矩阵U、潜在项目特征矩阵V。

1.随机初始化U、V、权重矩阵W

2.fori≤ndo

3.根据式(3)、式(4)初始化U

4.end for

5.forj≤mdo

6.根据式(5)、式(6)、式(7)初始化V

7.end for

8.repeat

9.fori≤ndo

10.根据式(10)更新ui

11.end for

12.forj≤mdo

13.根据式(11)更新vj

14.end for

15.repeat

16.forj≤mdo

17.根据式(12)更新W

18.end for

19.until convergence

20.until 训练结束

算法1 中,通过步骤1~6 对项目、用户进行表征。之后根据表征结果采用最小化损失函数值的方式,更新项目及用户潜在矩阵,最终输出用户、项目的低维表征矩阵。

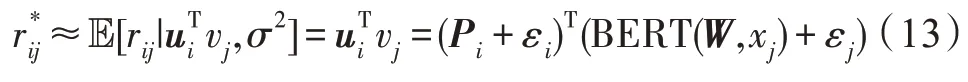

用户的最终预测评分可表示为:

3 实验与分析

为验证提出的融合人格的用户偏好预测模型的性能,本文使用上述人格预测模型获得的用户人格得分结合用户评分及评论数据使用Per-BERT MF 模型生成用户偏好预测,并对其准确性进行验证。

3.1 实验数据及设置

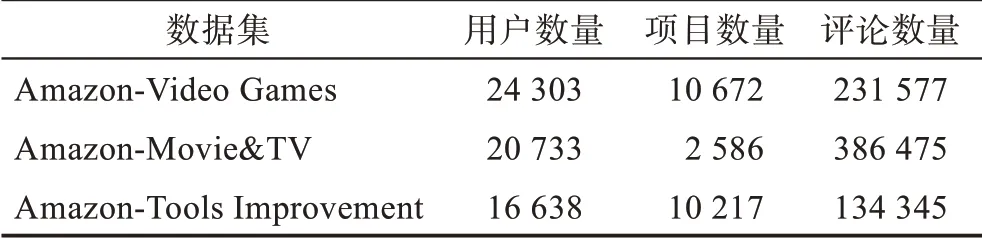

本文采用亚马逊数据集[20]对Per-BERT MF 模型的评分与实际评分误差、准确率、F1 值、AUC(area under curve)等性能指标进行评估与验证。本文使用的3 个亚马逊数据集,分别是游戏数据集、电影电视数据集以及改进工具数据集。采用如下预处理步骤对这3 个数据集进行统一预处理:(1)删除停用词以及出现词频高于0.5 的单词;(2)计算每个单词的tfidf(term frequency-inverse document frequency)分数,并截取其中排名最高的20 000 个单词作为词汇表;(3)截取每项评论中的前200 个单词。数据集信息统计如表1 所示,这3 个数据集各有特点:游戏数据集用户数量最大,项目数量也最多,但用户的平均评论数较少,平均每名用户仅进行了9.5 条项目评价。与之相比,电影和电视数据集项目数量最少,但每名用户平均发表了18.6 条评论。而工具数据集与其他两个数据集相比,用户数量与项目数量的比值最小,该数据集中每个项目平均仅有1.6 名用户对其进行评价,而在电影与电视数据集中每个项目平均有8 名用户对其进行评价。

表1 数据集信息统计Table 1 Statistics of datasets

另外,在模型训练中,参考文献[22]的设置,通过尝试,设置丢弃率为0.2,学习率设定为0.001,批处理尺寸设置为128。

实验运行硬件环境为:4 核Intel®Xeon®E3-1225CPU,3.8 GHz 主频,16 GB 内存,GTX2070super显卡PC 主机。实验运行的软件环境为:Windows 10操作系统,TensorFlow2.4,Pytorch1.8,Python3.8.2。

3.2 基线模型

为验证模型的有效性,本文使用八种推荐算法与Per-BERT MF 进行对比。

(1)PMF(概率矩阵分解)是一种标准的评分预测模型,通过概率模型预测用户和商品特征。处理稀疏且不平衡的数据,向用户提供推荐结果时效果良好。

(2)SVD++将传统的奇异值分解模型进行了扩展,在奇异值分解模型的基础上添加了一组项目特征以对项目相似性进行建模。

(3)ConvMF(卷积概率矩阵分解)将CNN(卷积神经网络)集成到PMF 中。大量实验结果表明,即使在评级数据非常稀疏的情况下,ConvMF 仍显著优于目前最先进的推荐模型[5]。

(4)DeepCoNN(深度矩阵分解)[17]提出了一个从评论文本中共同学习项目属性和用户行为的深度模型。该模型被命名为DeepCoNN(deep cooperative neural networks),在几个基准数据集上进行的实验证明了该模型的有效性。

(5)NARRE(neural attentional rating regression with review-level explanations)模型利用自注意力机制为每个评论赋予权重。实验证明该模型表现优于大部分的基准模型以及DeepMF 等神经网络模型[18]。

(6)TARMF[20]模型使用一个基于自注意力机制的双向递归神经网络,从评论文本中分别提取出用户和项目的文本特征,从矩阵分解模型中抽取隐藏特征。在学习过程中将这两个特征彼此互相近似来互相学习,最终获得缺失评分预测。

(7)ANR(aspect-based neural recommender)[21]提出的模型在预测级别方面的重要程度时,使用了共同关注的方法(co-attention),可以同时关注用户和物品之间的细粒度关系。

(8)CARL(context-aware neural model to learn user-item representations)[22]使用一种融合上下文感知的神经网络模型预测用户的项目评分。

3.3 预测误差

本文采用均方误差(MSE)对实验结果中评分预测值与真实值的误差进行评估。MSE 是所有项目真实评分和预测评分误差的平方和的平均值,公式如下:

其中,n表示用户评价数量,rij表示用户i对项目j的真实评分,表示用户i对项目j的预测评分。MSE值越小说明模型预测得分越接近真实值。

另外,本文采用点击率预估方法(click-through rate prediction,CTR)[21]对模型的推荐效果进行评估。使用AUC、Precision、F1 指标对本文模型及其他对比模型进行比较。实验数据集中评分位于1~5 的区间内,根据评分的分布将CTR 模型中的推荐阈值设置为3.5(例如实验模型预测用户Ui对项目Vj的评分为4.5 分,大于推荐阈值3.5,是正样本,则CTR 模型预测用户Ui会对项目Vj进行点击,进而进行推荐。反之,则为负样本)。

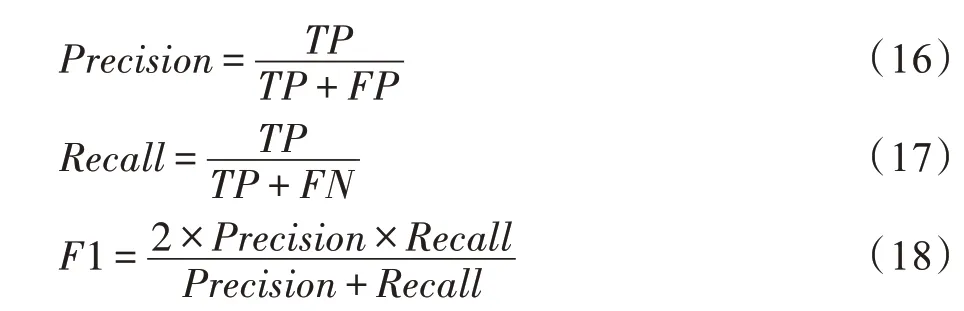

Precision、Recall、F1 的公式如下:

其中,TP表示把正样本成功预测为正,TN表示把负样本成功预测为负,FP表示把负样本错误地预测为正,FN表示把正样本错误地预测为负。Precision及F1 值越大说明结果越准确。

3.4 结果分析

本文提出的Per-BERT MF 模型及其他对比模型在所有数据集上所得出的预测与真实的均方误差如表2 所示,在每列中最低的MSE 值使用粗体标明。表2 的实验结果显示,Per-BERT MF 模型在所有数据集上表现均优于其他对比模型。

表2 各模型在Amazon 数据集上的MSE 值Table 2 MSE of each model on Amazon datasets

表2 结果表明,考虑用户评论的预测模型(如ConvMF、NARRE、TARMF、Per-BERT MF 等)在结果上均优于仅将用户评分作为输入的预测模型(如PMF、SVD++)。实验证明使用评论与评分组合作为预测模型的输入因素相比较单独使用评分作为预测模型的输入因素提高了预测质量,获得了更好的预测结果。评论信息包含了更多潜在的用户及项目特征。

其次,在使用深度学习技术的推荐模型中,使用attention(自注意力)机制进行特征提取的模型(如TARMF、Per-BERT MF 等)在预测结果上的表现均优于未使用attention 机制的模型(如ConvMF 等)。相比较使用词袋(bag-of-word)模型进行特征提取的模型,attention 机制所提取的特征对上下文信息进行了良好的概括。从而在提取特征用于评分预测的实验中取得了更好的结果。

如表2 所示,Per-BERT MF 模型在3 个数据集上的表现均优于其他对比模型。Per-BERT 建立一个用户的人格模型,提取用户评论信息中的情感特征,并转化为人格得分。通过将人格得分引入评分预测模型,提高了预测结果的准确性。

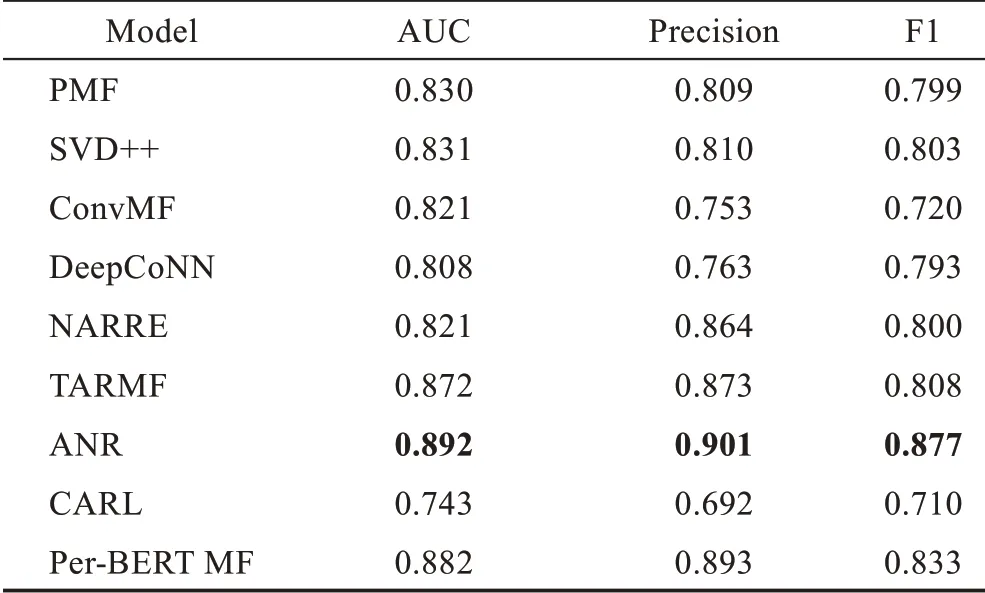

表3 及表4 的实验结果表明,本文提出的模型在Amazon-Video Games 及Amazon-Movie&TV 数据集上推荐表现均优于其他对比模型。说明本文提出的模型除预测用户评分准确率之外,向用户推荐未评价项目的有用性方面也有良好的表现。表5 显示Per-BERT MF 模型在Amazon-Tools Improvement 上的推荐表现略逊于ANR 模型,优于除ANR 之外的其他模型。主要原因是Amazon-Tools Improvement 数据集内用户评论数量及评论平均字数远少于其他数据集,本文提出的模型更依赖用户评论信息。

表3 Amazon-Video Games数据集上的指标对比Table 3 Index comparison on Amazon-Video Games dataset

表4 Amazon-Movie&TV 数据集上的指标对比Table 4 Index comparison on Amazon-Movie&TV dataset

表5 Amazon-Tools Improvement 数据集上的指标对比Table 5 Index comparison on Amazon-Tools Improvement

4 结论与展望

本文提出了一种新的推荐模型Per-BERT MF,该模型解决了用户的特征表示及项目的上下文信息表示问题。同时设计了一个新的Per-NN 神经网络用于从用户评论中提取用户的人格特征得分,并将人格特征得分作为用户的特征表示集成到概率分解模型PMF 中,同时使用BERT 提取用户对项目评论文本的上下文信息。最终集成用户特征和项目特征进行评分预测。实验结果表明Per-BERT MF 模型性能优于其他流行的推荐模型。下一步的研究工作主要围绕优化用户和项目特征的提取方式。