基于轻量级U-Net深度学习的人体安检隐匿违禁物的实时检测

2022-10-29李连伟秦世引

李连伟 秦世引*②

①(北京航空航天大学自动化科学与电气工程学院 北京 100191)

②(东莞理工学院电子工程与智能化学院 东莞 523808)

1 引言

随着公共交通出行量的迅猛提升,公共场所的人流量也在不断增加,使得反恐以及维护社会稳定的任务复杂性和实际要求也在不断攀升,从而对安检系统的技术性能提出了新的严峻挑战。传统的安检方式往往要求被检对象主动配合安检人员进行人体检查,这不仅限制了检测效率,也对人体隐私保护造成影响。近年来被动毫米波成像技术不断发展,在安检系统中的应用越来越广泛。这主要得益于其穿透性、安全性等诸多优良特性[1],并且不需要被检对象主动配合,可大大节省检测时间而提高效率。

获得人体扫描图像后,如何快速高效检测出所携带隐匿违禁物是安检系统研发中的一个严峻的技术挑战。一方面,被动毫米波成像机制不同于一般的可见光成像,其分辨率比可见光图像低,且存在复杂的背景噪声。同时在被动毫米波图像(Passive MilliMeter Wave Image, PMMWI)中展示检测结果容易引发人体隐私泄露问题,因此需要将检测到的疑似违禁物位置标记于可见光图像(Visible Image,VI)之中,这就需要对PMMWI与VI中人体轮廓进行配准。另一方面,仅采用PMMWI进行违禁物检测容易出现误检,例如胳膊与人体的间隙区域容易误检为疑似违禁物。因此需要将VI提取到的信息结合来判断违禁物是否存在。此外,面对公共场所安检流量大的问题,检测算法的运算速度也是需要考虑的重要因素。

本文将被动毫米波成像的穿透性和可见光成像的清晰性相结合,提出一种基于轻量级U-Net的人体安检隐匿违禁物的高性能实时检测算法。首先,采用轻量级U-Net分别对PMMWI和VI中的人体轮廓进行快速分割;进而采用基于相似性测度的无监督学习方法训练图像配准网络对PMMWI与VI分割结果中的人体轮廓进行配准,根据配准结果,初步剔除虚警后检出疑似违禁物,并将其位置标记于VI之中得到单帧图像检测结果;最后通过对多帧序列图像检测结果的综合研判,进一步剔除虚警,输出检测结果。

本文的主要贡献体现在以下3个方面:(1) 基于MobileNetV2[2]作为编码器网络,设计了轻量级UNet分割网络以提高处理速度,满足安检过程中大流量的需求。同时,采用参数共享策略,只需一个模型便可完成PMMWI与VI中人体轮廓的快速分割。(2) 借鉴医学图像配准的经验,将基于相似性测度的无监督学习策略同轻量级U-Net相结合,通过无监督学习生成配准空间位移场,以实现PMMWI与VI中人体轮廓的高效配准,从而为后续的高性能实时检测奠定基础。(3) 在人体轮廓配准的基础上,通过区域比对实现虚警目标滤除,进而结合多帧序列图像检测结果的综合推断得到最终的隐匿违禁物检测结果,并在可见光图像VI中予以标记,从而可实现无接触检测和有效的隐私保护。

2 相关工作与技术动态

在检测PMMWI中人体携带的隐匿违禁物方面,López-Tapia等人[3]在图像中抽取以像素为中心的图像块并通过Haar算子提取特征进而采用随机森林方法在预处理后的PMMWI上检测隐匿物并取得一定成果。文献[4]采用深度神经网络的方法识别图像块中的违禁物,同时利用图像分割的方法对违禁物进行检测定位。文献[5]采用YOLO v3 (You Only Look Once v3)算法检测PMMWI中的违禁物目标,并在其自建小数据集上实现了实时检测。受限于PMMWI成像质量问题,使用单一毫米波图像容易产生误检,因此本文采用PMMWI与VI相结合的方式以高效检测人体所携带的隐匿违禁物,主要采用了图像分割及图像配准技术。

在图像语义分割方面,基于全卷积网络(Fully Convolutional Network, FCN)[6]的方法获得了优越性能。特别是随着U-Net[7]的提出,研究者开始使用编解码器结构融合低、高层特征以获取更多上下文信息来实现更好的分割效果。罗会兰等人[8]将基于区域与基于全卷积两种方法的优点结合起来,并利用带扩张卷积的残差网络进行特征提取,最后通过多模型融合得到分割结果。Zhu等人[9]提出一种统计纹理学习网络用于图像分割,以更好地利用网络低层的纹理信息从而达到更好的性能。

图像配准目前广泛应用于医学图像处理领域,基于深度学习的配准方法主要分为有监督配准[10,11]和无监督配准[12,13]。基于监督学习的配准一般利用已有算法生成标签或者利用模拟变形生成标签,较为复杂。鉴于此,现在的研究者大多倾向于使用基于无监督学习的配准方法。Balakrishnan等人[14]提出一种快速学习图像配准的VoxelMorph框架,使用卷积神经网络来学习变形场,并通过最小化图像之间的相似度代价来实现网络优化。Ma等人[15]提出一种编解码结构的配准网络,并根据特征的性能以及特征之间的关系对特征进行校准,进而设计了层次代价函数用于网络训练。本文借鉴文献[14]处理3维医学图像的经验,结合轻量级U-Net,将无监督配准学习应用于2维PMMWI与VI图像之中。

3 基于轻量级U-Net的人体轮廓快速分割

3.1 轻量级U-Net网络的模型架构

U-Net网络应用跳跃连接结合低层特征的细节信息,能够有效地弥补下采样过程造成的空间信息损失,帮助网络恢复更精确的分割结果,在图像分割中具有卓越的性能优势;同时,其所具有的编解码结构简单,设计改进方便,因此本文根据安检过程中人体轮廓实时分割的技术需求,经过对实验结果的比较分析,选用了U-Net网络。MobileNetV2[2]在V1版[16]采用逐通道可分离卷积的基础上,借鉴ResNet[17]的残差连接,创新性地提出了“倒置残差”结构,兼具速度与性能优势。考虑到安检过程中人流量大且检测算法需要实时快速运行,本文在采用U型网络架构的基础上,利用MobileNetV2作为编码器特征提取网络,进行了必要的轻量化设计以满足人体安检中的快速运行需求。所设计的轻量级U-Net网络架构如图1(a)所示,本文将其命名为Lightweight U-Net,简记为L-UNet。L-UNet网络中所采用的倒置残差模块1~5的组织架构如图1(b)所示,而解码模块1~5则由图1(c)给出。

相较于原始版MobileNetV2,本文对倒置残差模块1~5仅重复堆叠1次从而减少参数量和计算量。其中,除倒置残差模块1以外,其余倒置残差模块均进行下采样使得特征图逐渐减小。在图1(b)所示的倒置残差模块中,首先对输入特征进行1×1卷积并通过预设的扩张倍数使得通道数增加,进而进行3×3逐通道卷积(DepthWise Convolution, DW-Conv),最后通过1×1卷积降低通道数并与输入特征信息直接相加得到输出特征。本文参照原网络参数,将倒置残差模块1的扩张倍数设为1,其余倒置残差模块扩张倍数均为6。在图1(c)所示的解码模块中,首先进行3×3卷积进一步提取特征信息,进而通过转置卷积进行上采样以使空间信息得以恢复。在上采样过程中,通过使用解码模块最后可获得与原图尺寸相同的输出结果。

3.2 轻量级U-Net网络的性能特点与优势分析

在实际毫米波安检过程中,人体通过安检仪的速度快且人流量大,这对隐匿违禁物检测提出了很强的实时性需求。因此需要算法能够快速高效地检测定位出人体所携带的隐匿违禁物,本文所提网络能够很好地满足这些需求。

一方面,以3×3卷积为例,深度可分离卷积的计算量比标准卷积少8~9倍[16],从而可使模型的运行速度显著提升,对实际应用具有重要意义。本文所构建L-UNet仅具有4.3 M参数量,相当于U-Net的13.9%;计算量为2.7 G,相当于U-Net的6.3%。同时,参数量的减少也会使得模型的占用空间降低,从而在实际应用中更具优势。L-UNet在GTX TITAN Xp GPU上处理分辨率为400×200的图像时速度可达126 fps,远超实时性要求。

另一方面,由于逐通道卷积是按通道深度进行分离卷积,不存在通道间信息的混合,其所提特征受限于通道数量。而通过倒置残差模块结构,先对特征通道数进行必要的扩张,以增加通道数量,并在通道分离条件下完成卷积运算,从而使提取的特征信息得以丰富。

3.3 基于轻量级U-Net深度训练的人体轮廓快速分割

在进行人体轮廓分割前,本文首先采用Pixel Annotation Tool[18]软件进行数据标注以生成分割标签。图2展示了5张对应的PMMWI和VI的人体轮廓标注结果。需要说明的是,在数据标注中,行人的背包中隐藏了一种违禁物,对可见光图像VI而言,是无法确认的,所以对背包区域无标注;由于PMMWI的可穿透性,其探测到该违禁物是理所当然的,所以在对PMMWI的标注结果中凸显了该隐匿违禁物的所在区域和位置。

本文采用PyTorch中的随机梯度下降(Stochastic Gradient Descent,SGD)优化器对网络进行迭代深度训练,同时使用交叉熵函数计算训练代价。由于本任务中仅将图像分割为人体和背景,因此采用的二分类交叉熵代价函数L可表示为

根据人体安检需求,本文通过对L-UNet网络的深度训练,实现对人体轮廓的快速分割。图3给出了面向人体安检的人体轮廓分割的网络化算法的执行机理和逻辑流程。

首先利用图像分割标注软件对采集到的PMMWI/VI数据进行人体轮廓的数据标注以生成数据标签。然后将以训练数据激励L-UNet网络而得到模型预测值,进而将结合监督标签信息,采用交叉熵代价函数计算训练代价,以SGD最小代价函数优化器对L-UNet的网络参量进行调优,随着调优训练的迭代进展,使L-UNet的分割性能得以不断提高,在满足终止条件时得到认可。进而利用该认可的L-UNet实施人体轮廓的分割,给出有效的分割结果。

4 基于相似性测度的无监督学习人体轮廓配准

4.1 面向人体轮廓配准的无监督学习策略

训练深度神经网络通常需要大量的带标签数据作支撑,医学图像有监督配准中一般采用以下两种方式获取变形场标签:(1)利用传统方法对图像进行配准以获得变形场作为标签真实值,如文献[11]首先采用对称图像归一化方法对图像进行初步配准,然后进一步对齐边界并生成最终的变形场。(2)人工生成变形场,如文献[19]通过人工合成变形场并对原始图像施加变形场生成形变图像用于训练。可见,这两种方式均复杂且低效,难以推广。与此同时,标签的精准度对网络训练的效果也有影响。区别于需要标签信息的有监督学习,无监督学习不需要数据标签,节省了人工标注的时间。综合上述考虑,本文采用无监督学习的方法来对安检图像中的人体轮廓进行配准学习。

无监督学习分为多种,例如聚类、降维等,本文采用基于相似性测度的无监督学习,通过比对模型输出与被配准图像的相似度,并对相似度代价函数进行最小化来优化调整网络参量。

4.2 被动毫米波图像与可见光图像(PMMWI/VI)的配准基础

一方面,由于PMMWI与VI成像机制不同,成像效果存在明显差异。具体而言,PMMWI成像视野小于VI,且成像质量差,分辨率低。但被动毫米波能检测到隐匿物,具备可见光所没有的穿透性。而VI在清晰性与分辨率上比PMMWI有更好的表现。两种图像的成像差异性使得让其优势互补成为可能。本文同时利用VI的清晰性与PMMWI的穿透性使得隐匿违禁物的检测更加高效。

另一方面,从图4可以看出,PMMWI与VI的人体轮廓分割结果中人体区域均存在黑色空洞,相同位置的空洞是由胳膊与身体的间隙产生的,而PMMWI中存在但VI中没有的空洞区域才是隐匿物所在位置。因此,只有将两者分割结果进行配准,才能有效去除虚警目标,获得隐匿违禁物的位置。此外,由于直接展示PMMWI会带来隐私问题,因此需要在VI中对隐匿物位置进行标记,这也需要PMMWI/VI的配准才能得以实现。

4.3 人体轮廓配准的无监督学习方法

受文献[14]医学图像配准方法启发,本文设计了适合PMMWI和VI图像的无监督学习配准方法,如图5所示。本文采用L-UNet作为配准网络骨架,与分割网络相比变动之处在于去掉了最后的分类层和sigmoid层。将PMMWI分割图像p及VI分割图像v定义在2维图像空间W ⊂R2中,L-UNet配准网络记为fθ(),θ为神经网络参数,则基于L-UNet的配准位移解算过程可表示为fθ(p,v)=u。其中u是一个3维的位移场。对于任一像素点m,u(m)是一个使得v(m)与[p ◦φ](m)表示相同位置的位移,其中映射φ= Id+u,I d表示恒等变换,v(m)表示m在v中的位置,p ◦φ表示p通过映射φ变换后的配准图像,[p ◦φ](m)表示m在配准后图像中的位置。

如图5所示,将待配准的PMMWI和VI分割图像对拼接后输入L-UNet配准网络,通过网络运算输出配准空间位移场u,然后对PMMWI分割图像p进行坐标配准以变换为p ◦φ,得到配准后的PMMWI图像pr。本文基于空间变换网络[20]的思想并采用文献[14]的方法计算p ◦φ。对于配准后图像中的每个像素点m,本文计算其对应原图p中的像素点位置,并利用8个相邻点的像素值进行线性插值得到[p ◦φ](m)。

4.4 基于相似性测度的学习过程优化

本文通过衡量配准后的PMMWI与VI的相似度,并对相似度代价最小化以调优配准网络。同时,在代价函数中加入配准位移场梯度的惩罚项,以使坐标变换更加平滑。总代价函数由式(2)给出

其中,λ为正则化系数,∇u(m)表示对u(m)求梯度。式(2)中前半部分计算配准后的PMMWI与VI的均方误差(Mean Square Error, MSE),后半部分对位移场的梯度施加正则化。如图5所示,通过计算总代价函数及其变化梯度,进而基于总代价函数的变化梯度采用自适应矩估计(Adaptive moment estimation, Adam)优化器对L-UNet进行参数优化从而使网络性能得以不断提升。

此外,在训练过程中,一方面本文将PMMWI/VI分割图像对输入网络进行训练;另一方面,对于分割过程产生的人体内的空洞区域,对其进行填充生成填充后的分割图像,作为训练集的扩增集参与训练以提高网络性能的鲁棒性。

5 面向人体安检的隐匿物高性能检测

5.1 基于PMMWI/VI轮廓配准的疑似隐匿物快速检测

经过轮廓配准后,PMMWI与VI分割后图像中人体轮廓形状基本一致,但PMMWI中包含了疑似隐匿物的位置和形状信息;而VI中仅包含人体轮廓的形状信息。基于配准结果,可以将PMMWI中的疑似隐匿物位置标注在VI中,不仅便于安检人员快速查验,同时也能避免人体隐私的泄露问题。图6展示了基于PMMWI/VI轮廓配准的疑似隐匿物快速检测过程。

具体而言,首先采用L-UNet对PMMWI/VI图像对进行人体轮廓分割,得到对应图像的分割结果。进而基于相似性测度的无监督学习配准方法对分割后图像中的人体轮廓进行配准,最后将隐匿物在VI中进行标记得到最终检测结果。需要说明的是,在本文的安检应用场景中,安检仪1次通过1人次,且仅针对检测中出现的隐匿违禁物这一类目标,但隐匿违禁物可能藏于人体的多个部位,因此属于多目标检测。

5.2 基于U-Net深度学习的漏检补正与虚警目标滤除

经过分割或配准后的PMMWI/VI中可能会存在噪声点,如图7中VI分割结果所示。因此需要在图像配准之后进行背景噪声过滤,以防产生虚警干扰。此外,在人体轮廓配准过程中,PMMWI中的疑似隐匿物经过坐标变换后会因形变而导致形状过小,如图7所示,经过噪声滤除处理容易造成漏检。

为了对漏检目标进行补正以提高检测性能,对配准过程中基于L-UNet骨架网络的无监督学习的代价函数进行了优化调整。具体而言,式(2)中λ可以调节位移场梯度的正则化项占总代价函数的比重大小,影响坐标变换的程度也即控制着图像形变的程度。通过调整优化λ的值,可使配准后PMMWI中人体轮廓与VI趋近一致的同时,隐匿物目标不会形变到很小。

此外,由于人体肢体动作在VI中产生的虚警目标,经过图像配准后,会在PMMWI中对应位置出现。本文通过对比人体轮廓相同位置出现的空洞区域,实现了虚警目标的有效滤除。如图8所示,首先对配准后的PMMWI/VI进行图像滤波,本文采用的是依次进行形态学闭、开运算以去除噪声点并平滑人体轮廓。在此基础上,分别对PMMWI/VI进行空洞填充并与原图进行异或运算,得到对应图像中的空洞区域。最后,通过区域对比将虚警目标去除,从而获得隐匿物目标。

在安检实际情况中,由于人在不断走动行进,因此基于单帧图像的隐匿物检测也会造成漏检或者误检,本文结合安检过程中产生的序列图像进行综合判断以提升检测性能。采用策略为:序列图像数据中每隔5帧输出1次检测结果。具体而言,对每帧图像检测结果中的疑似隐匿物区域像素值置1,其余置0,并将5帧检测结果相加,若叠加图像中某处像素值大于等于n(n ∈[1,5],由实验确定),则认为该区域存在隐匿物。

5.3 从算法体系的综合集成优化到高性能检测

为了实现人体安检过程中隐匿违禁物的快速检测,对本文所提网络与算法进行综合集成,如图9所示。首先,对连续5帧PMMWI/VI图像对采用基于L-UNet的分割算法进行人体轮廓分割,然后采用基于无监督学习的配准算法对PMMWI/VI分割后的人体轮廓进行配准。进而根据配准结果通过区域对比以滤除虚警目标,得到单帧图像的隐匿违禁物检测结果。最后通过对多帧检测结果进行综合判断,得到最终的隐匿违禁物检测结果并在VI中进行标记。

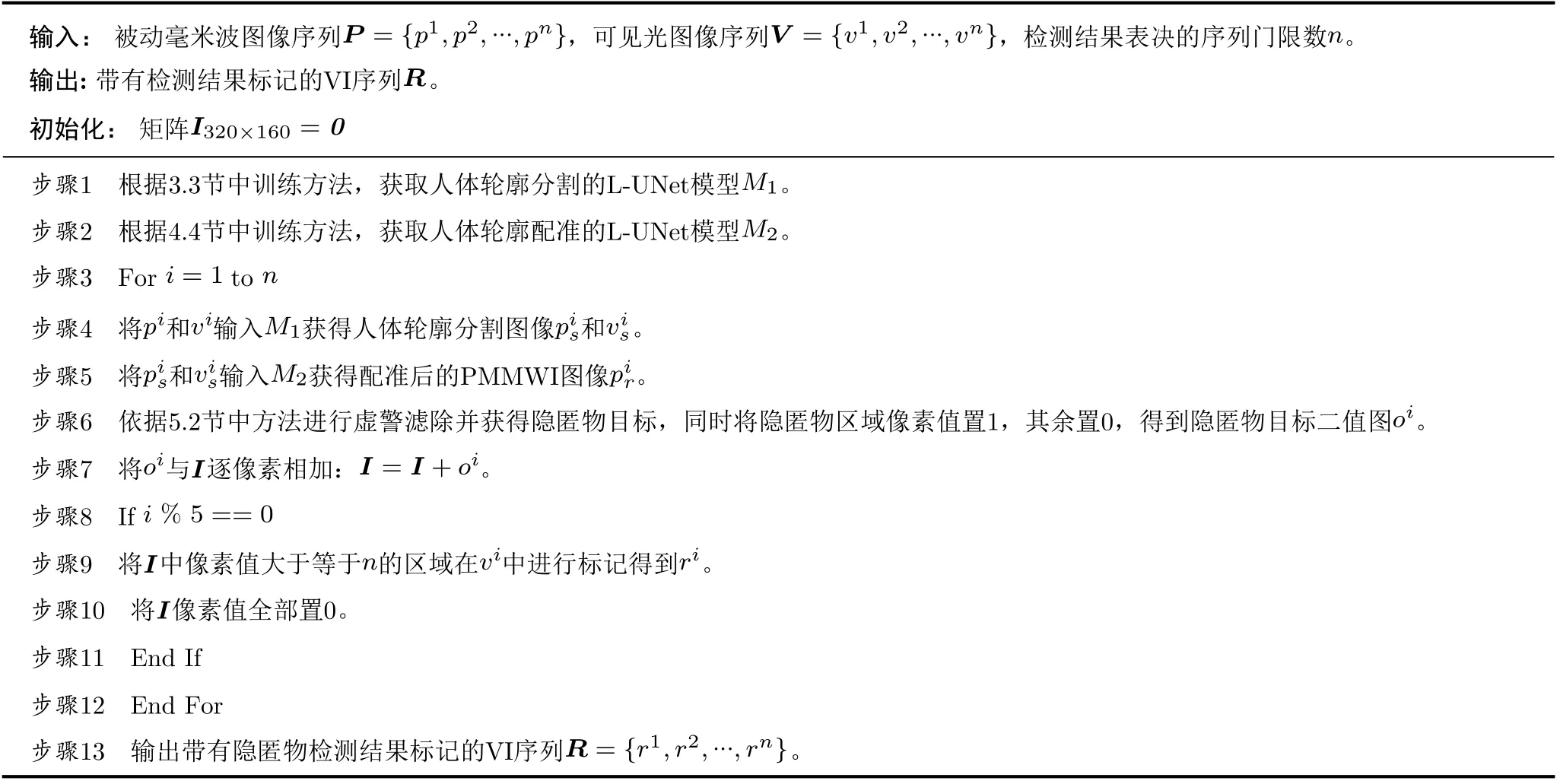

根据第3~5节的研究结果,本文提出基于轻量级U-Net深度学习的人体安检隐匿物的高性能检测算法,如表1所示。

表1 基于轻量级U-Net深度学习的人体安检隐匿物检测算法

6 综合实验与性能分析

6.1 数据集与实验平台

本文采集并标注了1268帧PMMWI及其对应的VI图像作为本文所用数据集,其中PMMWI尺寸为160×80,VI尺寸为400×200。本文数据采集所用设备成像速度为25 fps,即每帧成像时间为40 ms。所采用数据集中,图像对来自多个个体;隐匿违禁物分别位于人体的5个不同位置:前胸、后背、前腰、后腰、侧身,如图10所示,其中隐匿物所在位置用红框标注以便于展示。在实验过程中,1032帧对的标注图像用于进行深度监督训练,训练完成后再用236帧对的标注图像进行测试检验。

本文算法与网络采用基于Python语言的PyTorch深度学习框架并在Windows平台上实现。GPU为NVIDIA GTX TITAN Xp,CPU为Intel Core i7-8700k,内存为32 GB RAM。

6.2 实验框架设计与参数设置

在人体轮廓分割实验中,采用SGD优化器对网络进行调优,学习率为0.01,动量设为0.9,深度监督训练所设置的终止条件为2000轮次的迭代。在人体轮廓配准实验中,采用Adam优化器对网络参数进行更新,学习率为0.01;经过实验验证,网络经过100轮次的迭代可以达到认可的效果,因此训练的终止条件设置为100轮次的迭代。在上述两部分实验的训练过程中,首先对图像进行随机裁剪,使其边长随机裁剪为原来的0.6~1倍,然后将图像缩放到320×160尺寸输入网络;在测试过程中,直接将图像缩放到320×160尺寸输入网络进行测试。

6.3 实验结果与性能评估

6.3.1 基于轻量级U-Net的人体轮廓分割实验

为了验证所提L-UNet人体轮廓分割网络的有效性,本文在所采集的PMMWI/VI数据集上进行实验性能验证。同时,采用平均交并比(Mean Intersection over Union, MIoU)作为性能评价指标,MIoU的计算方式如式(3)所示

其中,pij表示类别标签为第i类的像素点被模型预测到第j类 。由于本文图像分割类别只包含人体区域和背景区域两类,因此i和j的取值范围只有0和1。

由于可见光和被动毫米波成像机制不同,本文首先将PMMWI和VI分别输入L-UNet分割网络进行单独训练,参数不共享,最终获得2个参数不同的L-UNet分割模型。同时,考虑到实际应用的便捷及安检系统的实时性要求,将两种不同数据输入同一L-UNet网络中进行训练,参数共享,最终获得1个L-UNet分割模型。两种训练策略的结果对比如表2所示。

由表2可见,采用参数不共享训练策略的分割性能指标比参数共享策略好。但从实际应用角度出发,将PMMWI和VI数据分开处理需要使用2个模型,并消耗额外的计算资源和存储资源,获得的性能提升却有限。因此权衡利弊,本文研究将采用参数共享的训练方式进行后续实验。

表2 两种训练策略下人体轮廓分割的MIoU对比(%)

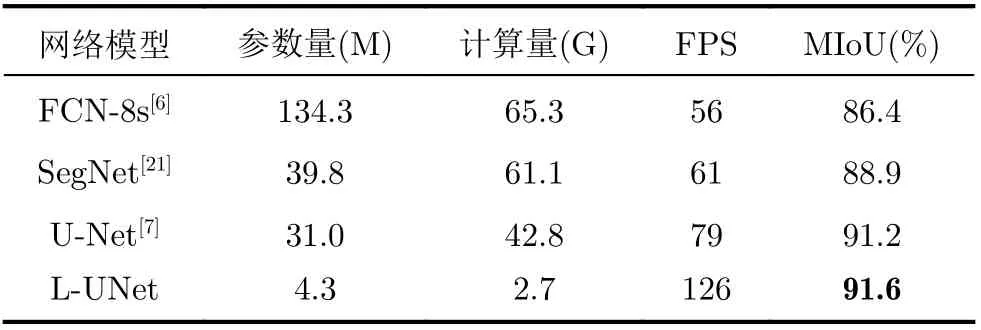

为了展示L-UNet应用于人体轮廓分割的性能优势,本文在所采数据集上与FCN-8s[6], SegNet[21]以及U-Net[7]网络模型进行了对比实验。图11展示了不同网络人体轮廓的分割结果,其中第1列待分割图像中PMMWI与VI是分别对应的。结果表明,FCN的分割效果最差,无法对PMMWI中的隐匿物进行有效分割。SegNet和U-Net的分割效果与L-UNet相似,但处理细节能力弱于L-UNet。例如,对于第1幅PMMWI图像,在U-Net分割结果中,手臂细节部分分割不准确,而SegNet分割时则存在多余空洞,从而可导致隐匿物检测过程中产生虚警。综合来看,L-UNet的分割效果较好,精度较高。

为了定量对比各个网络的分割性能,本文统计了其在自建数据集上的性能指标,如表3所示。同时也对网络参数量、计算量以及运算速度FPS进行了对比分析。从表3可以看出,L-UNet的参数量和计算量都大大低于上述网络,在运算速度和性能上也有明显的优势。虽然L-UNet的分割性能与UNet相近,但是在参数量、计算量和运算速度上都明显优于U-Net。

表3 L-UNet及其他网络在自建数据集上进行人体轮廓分割的性能对比

6.3.2 基于无监督学习的人体轮廓配准实验

本文采用Dice分数[22]来衡量配准后的PMMWI与VI的相似度作为配准性能的评价指标,其计算方式为

本实验将式(2)中的正则化系数λ设置为0.25,并对6.3.1节使用的不同网络进行性能对比。图12展示了不同网络的一组配准结果对比,可以发现,FCN基本保持了分割的结果,配准效果最差;SegNet配准结果中人体轮廓变形严重。U-Net与L-UNet的性能相似,配准后的PMMWI分割图像中人体轮廓与VI分割图像基本一致的同时,保留了PMMWI中的有效信息,为隐匿物的高效检测做好了铺垫。

图13展示了不同网络轮廓配准性能的定量对比,其结果与图12一致:L-UNet性能最好,U-Net次之。

6.3.3 面向人体安检的隐匿物高性能检测实验

本文首先测试了式(2)中λ值的大小对于配准结果的影响。图14展示了两组数据中配准后的PMMWI随λ值变化的情况。结果表明,随着λ的增大,由于对位移场梯度惩罚项权重的增加,坐标变换更平滑,从而空洞区域形变程度变小,配准后的空洞区域面积变大。

为了定量表示,本文统计了随着λ值增大时配准指标Dice分数与隐匿物尺寸的变化情况,如图15所示。可以发现,结论与图14一致:对位移场梯度的惩罚项增大,则空间变换程度减弱,从而使配准指标降低;同时,防止位移场变化过大,也能尽可能地保留原始图像的有用信息,从而更有利于隐匿物的检测。综合考虑,本文选择λ值为0.5时的模型作为实验所用模型,以取得在配准效果与隐匿物尺寸之间的折中。

本文以精确率P、召回率R和 F1分数作为检测性能的评价指标,其中 F1分数可以对检测性能进行综合考量。指标的计算方式如式(5)—式(7)所示,真正例(True Positives, TP)表示图像中违禁物区域被算法正确检测到;假正例(False Positives, FP)表示非违禁物区域被算法错误检测为违禁物区域,即出现误检;假负例(False Negatives, FN)表示违禁物区域未被算法检测到,即出现漏检

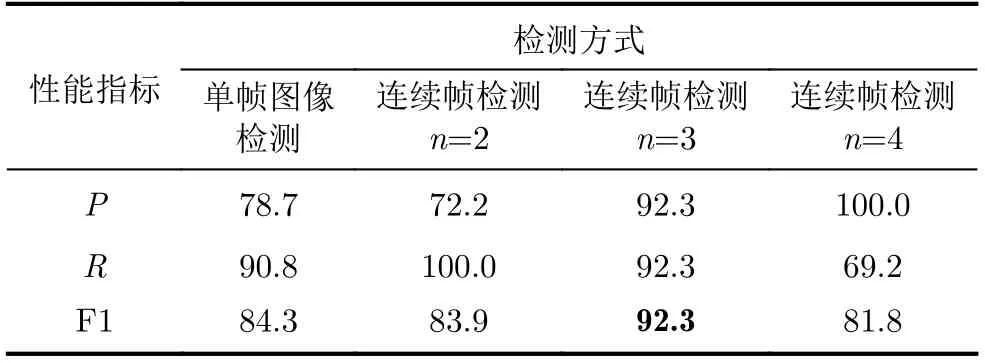

表4展示了基于单帧图像检测以及基于连续帧序列图像检测的性能指标对比。在连续帧检测实验中,基于6.2节提出的策略,本文选定n为2~4进行了实验。可以看到n=2时的R值为100%,这是由于采用单帧检测时召回率R已经达到了90.8%,即FN较小,漏检较少;当采用多帧检测时,漏检会进一步消除,很容易满足FN = 0,即达到R= 100%。但是n较小也会使得图像中噪声点所产生的虚警无法通过多帧判断去除,从而使性能下降,导致n=2时的P值却小于单帧图像检测的值。同时,表4结果表明,连续帧检测n=3时 F1分数最高,n=4时的 F1分数要低于单帧图像检测。这是由于人体在走动过程中,隐匿物位置也在不断变化,从而使得前后帧图像中的隐匿物区域出现差异,导致多帧叠加后检测性能随着n的增加逐渐下降。同时,测得连续帧检测算法的运算速度为每秒可处理34 帧PMMWI/VI图像对,即每帧对图像平均处理时间为29 ms,小于成像时间40 ms,完全满足人体安检的实时性要求。

表4 单帧图像隐匿物检测与连续帧检测性能对比(%)

图16展示了2段各5帧视频的检测结果。第1段视频中PMMWI与VI分别在第1, 3, 4, 5帧和第1,3帧出现误检。但通过配准后进行虚警滤除,可将第1, 3帧虚警目标滤除。因此若采用单帧检测方案,则依然会在第4, 5帧出现虚警目标,干扰检测性能。如若采用连续帧检测并设置n ≥3,则会进一步将第4, 5帧的虚警目标滤除,达到更高的检测性能。需要注意的是,在实际应用中,连续帧检测仅显示最近一帧的检测结果,图16为方便展示均标注了检测结果。第2段视频中第2帧图像出现漏检,同时由于人体运动幅度稍大,造成隐匿物区域位置变化大,使得多帧检测中当n ≥4时检测不到目标,出现漏检。因此,通过实验结果及上述分析,本文选定n=3作为连续帧检测过程中的参数设定值。

进一步,本文对比了基于L-UNet与基于UNet进行分割配准的检测性能,如图17所示。可以看到,尽管两者在分割与配准上的性能相近,但在基于分割与配准相结合的隐匿物检测上L-UNet性能更优。这表明,采用更具优势的MobileNetV2作为编码器,L-UNet提取特征更加高效;同时由于参数量变少,训练更加充分,因此处理细节能力更优,使得检测性能更好。

此外,为了验证本文所提算法性能的优越性,本文与文献[5]中基于YOLO v3的方法进行了单帧检测的性能对比,如表5所示。结果表明,在所有实采图像数据上,尽管由于YOLO v3本身检测性能良好,FP = 0从而P= 100%,没有出现误检,但其 F1指标远低于本文所提方法。原因在于部分PMMWI中没有违禁物目标,造成正负样本不均衡,导致YOLO v3性能表现不佳,这需要进行额外的样本均衡处理;PMMWI与VI成像机制的不同也是YOLO v3性能大幅下降的原因之一。同时,虽然YOLO v3在实采图像中含隐匿物的图像上性能稍高于本文所提方法,但由于缺少与VI的配准,不仅不能去除虚警,而且无法在VI中对违禁物位置进行标记,因此在实际应用中仍具有一定的局限性。

表5 YOLO v3单帧图像隐匿物检测性能(%)

7 结论

本文提出一种基于轻量级U-Net的人体安检隐匿违禁物的高性能实时检测算法。基于MobileNetV2架构,本文设计了L-UNet轻量级分割网络实现了PMMWI/VI中人体轮廓的快速分割,在所构建的数据集上,分割性能指标MIoU达到91.6%。进而,本文结合L-UNet工具,采用基于相似性测度的无监督学习方法实现了PMMWI/VI中的人体轮廓配准,在所建数据集上Dice分数达到98.5%。在人体轮廓配准之后,通过区域对比滤除虚警目标,得到单帧图像的隐匿物检测结果,F1分数达到84.3%。然后,对多帧序列图像的检测结果进行综合评判与优化决策,输出最终检测结果并标记于清晰的VI之中,多帧检测性能F1分数达到92.3%。在后续工作中,将利用主动毫米波成像来获取清晰的违禁物图像进行分类识别,从而向安检工作人员发出可靠的报警信号。