基于主题色板的图像上色方法研究

2022-09-17李锦峰朱永英鲁明羽

李锦峰,裴 伟,朱永英,鲁明羽,宋 琳

(1.大连海事大学信息科学技术学院,辽宁 大连 116026) (2.大连海事大学环境科学与工程学院,辽宁 大连 116026) (3.大连海洋大学海洋与土木工程学院,辽宁 大连 116023)

中国传统文化悠远绵长,包罗万象,是世界文明最优秀成分之一. 千百年来,斗转星移,沧海桑田,中华民族以服饰、器物、建筑等为载体,续写、传承着中国传统文化的精髓. 但由于时空、文化变迁,古人对服饰的色彩运用技法已散漫难寻. 在世界多元文化融合发展的大背景下,人工智能引领古老智慧与东方审美融合的潮流,固本清源,助力中国传统色走向更加缤纷多彩的空间.

图像上色算法为中国传统色的传承打开了一扇门. 图像上色一般分为自动上色[1-6]和交互上色[7-9]. Zhang等[2]将U-net集成到带有辅助分类器的生成对抗网络AC-GAN中,实现漫画草图的上色;Yoo等[4]提出了一种新颖的存储记忆网络MemoPainter,可在无类标签的条件下,实现高质量的图像上色. 以上基于深度神经网络的自动上色方法,在各自领域都展现出了出色的效果,但在人和服饰并存的场景中,上色不准确,人的皮肤易上错颜色(见图1(a)、(b)、(c)). 交互上色指的是在上色过程中有人为干预,例如基于涂鸦的交互上色需用户先提供大量的涂鸦才能完成图像上色[7]. 这对于非专业用户来说较困难. 基于主题色板的图像上色是另一种可靠的交互上色,其需要从图像中获取主题,然后再根据用户提供的目标色板完成图像上色,图像的最终颜色和目标色板的颜色一致. 目前有很多研究方法是基于主题色板来进行图像上色,例如Chang等[8]提出了一种改进的 K-means 算法提取图像的主题,允许用户编辑主色板来实现图像的重新上色;Tan等[9]计算图像像素在5D RGBXY颜色空间中的凸包顶点,将其作为图像的主题色板,根据优化后的图层分解算法完成图像上色.

在众多的图像上色算法中,基于主题色板的图像上色较符合中华传统服饰的传承上色要求,既还原原有色彩,又符合当代人的审美. 但现有的基于主题色板的图像上色,大多采用无监督的方式提取图像主题,提取的图像主题不准确、色彩不和谐、上色目标不明确,易出现张冠李戴的情况(见图1(d)).

图1 图像上色结果Fig.1 Image coloring result

本文针对上述问题,提出一种将图像分割、主题色自动提取、主题色扩增及图像视觉评价有机结合的自动上色方案,实现中华传统服饰在新时代的传承上色.

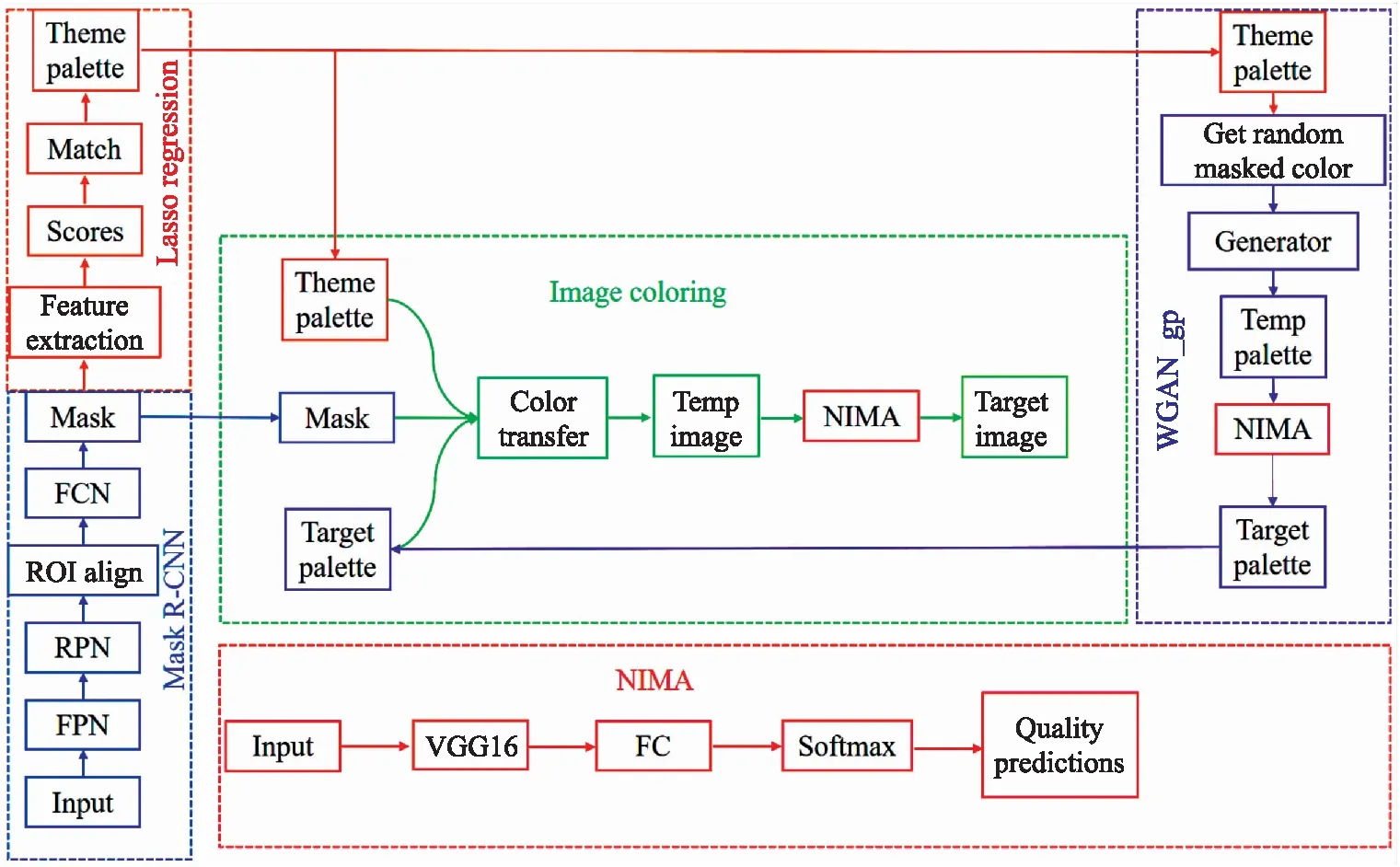

图2 基于图像主题的图像上色模型结构Fig.2 Structure of image coloring model based on image theme

1 基于主题色板的自动上色模型

针对基于主题色板的图像上色方法存在着主题不准确、色彩不和谐、美感评价不客观等问题,本文提出的自动上色方案如图2所示,用Lasso回归模型对Mask R-CNN分割的前景目标提取主题色、WGAN_gp对主题色扩展、NIMA对主题上色方案评价,得分最高的作为图像上色输出.

1.1 图像分割

随着人们审美意识的不断提高,人们对于图像上色有了更高的要求,例如单独修改图像中服装颜色,实现多重变装;或者改变环境颜色,呈现不同的情境. 现有的基于主题色板的图像上色,只能对整张图像进行上色,存在上色不准、局部难把控的问题.

Mask R-CNN[10]是通用的实例分割网络,分为2个分支,第1个分支为原始Faster R-CNN的结构[11],用于对候选窗口进行分类和窗口坐标回归;第2个分支为全卷积网络FCN[12],用于对每一个实例的掩膜进行预测. 本文根据用户的需求及现实的语义环境,用Mask R-CNN进行图像分割,识别出图像中需要上色的区域. 识别出来的区域将作为图像主题的提色区域及图像最终的上色区域.

1.2 图像主题提取

目前,基于主题色板的图像上色方法[8-9]大多采用无监督的方式提取图像主题,在复杂场景下无监督的提色效果并不理想. 为了解决这一问题,本文采用了2013年Lin等提出的Lasso回归模型[13]. 其主要步骤如下:

Step 1 从候选颜色中随机选取5个颜色作为该图像的初始主题色板,并基于图像的显著性、像素覆盖、分割、颜色多样性、颜色纯度及聚类统计这6大特征对初始主题色板进行评分.

Step 2 从初始主题色板的第1个颜色开始使用候选颜色中的颜色替换,重复此操作,到更换初始主题色板第1个颜色不能再增加该初始主题色板的评分为止. 对初始主题色板的第2、3、4、5个颜色执行相同的操作.

Step 3 重复Step 2的操作,到替换初始主题色板中任意位置颜色不再增加初始主题色板的评分为止. 此时获得的主题色板即为该图像的主题.

1.3 图像评估

一直以来图像上色都缺乏适当的评估指标[14],导致上色之后的图像不能进行精准的评估. 为此,本文引入NIMA模型[15]. NIMA使用预训练的VGG16网络作为基准网络,在VGG16网络的基础上,使用随机初始化的全连接层替换掉VGG16网络的最后一层,作为Softmax激活的输入,输出图像的评价分布. 网络结构如图3所示.

图3 NIMA模型网络结构Fig.3 NIMA model network structure

1.4 图像主题扩展

现有基于主题色板的图像上色方法需要用户自己提供目标色板,对于非专业用户而言提供一个色彩和谐的目标色板是非常困难的.

相比于原始GAN,WGAN_gp[16]使用Wasserstein距离和梯度惩罚策略,解决了原始GAN中梯度消失、模式崩塌等问题,改善了网络的稳定性和图像的生成质量. 因此,本文使用WGAN_gp增强Lasso回归模型提取的图像主题质量,生成配色更加符合视觉审美的目标色板. 基于WGAN_gp设计的图像主题加强网络结构如图4所示,该网络由生成器和判别器构成,生成器和判别器以对抗学习的方式来训练,最终生成色彩和谐的目标色板.

1.5 图像上色

在获得图像重新上色的主题色板及目标色板之后,本文采用2015年Chang等提出的色彩转换方法[8],实现图像中需要上色区域的上色. 该色彩转换方式将单个色彩转换分为了2个部分:(1)在L通道上的转换;(2)在A、B通道上的转换. 其中,在L通道的变化由对色板亮度线性插值得到;在A、B通道的变化由颜色在LAB空间内平移得到. 一组色彩的变换可以看作是若干个单独色彩变换的组合,具体的表现形式如式(1)所示.

(1)

式中,权重wi(x)由径向基函数得到;fi(x)为单个色彩变换的结果.

每个目标色板可以生成120张不同上色效果的图像,为了选出最优的上色图像,本文使用NIMA评分模型对这120张图像进行评分,评分最高的图像将作为图像最终的上色结果. 本文的图像上色流程如图5所示.

图5 图像上色流程Fig.5 Image coloring process

2 实验

2.1 图像上色的主题色板提取

首先运用Mask R-CNN模型获得分割图像,再用Lasso回归模型提取图像的主题. 图像分割和图像主题的提取结果如图6所示. 提取的结果将作为图像上色的主题色板.

图6 图像分割和图像主题的提取结果Fig.6 Image segmentation and image subject extraction results

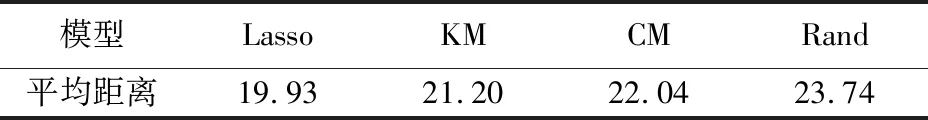

表1 KM、CM、Rand和Lasso结果对比Table 1 Comparison of KM,CM,Rand and Lasso results

为了验证Lasso回归模型的提色准确性,本文加入了KM(K-Means)、CM(C-Means)、Rand 3组对照实验. KM、CM采用无监督的方式提取图像主题;Rand采用随机生成的方式提取图像主题. 表1为实验结果,表中的数值为同一数据集下各个方法提取的图像主题与专家提取的图像主题之间的平均距离. 通过对比可以发现Lasso回归模型提取的图像主题更接近专家提取的结果.

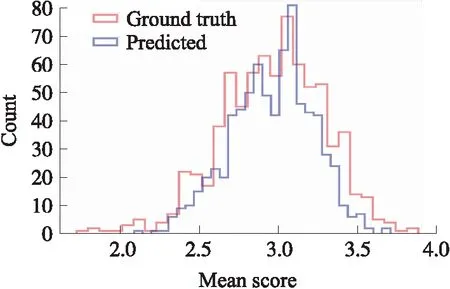

图7 测试集的真实评分分布与预测评分分布直方图Fig.7 Histogram of the true score distribution and the predicted score distribution of the test set

图8 图像上色的目标色板Fig.8 The target palette for coloring the image

2.2 图像上色的目标色板提取

图像的主题色板在经过WGAN_gp优化后,可以获得31种不同的色板. 为了选择最优的色板,本文以colourlovers网站上收集到的1.1万张带有评分的五色色板为依托,重新训练了NIMA评分模型.

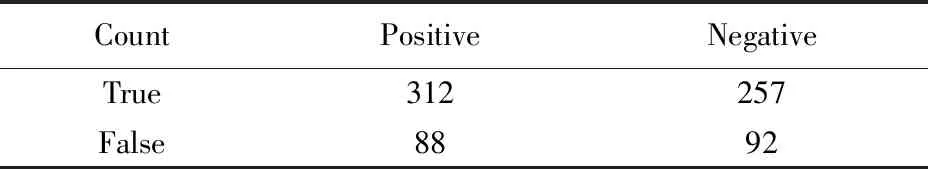

表2 测试集的混淆矩阵Table 2 Confusion matrix of the test set

为了验证模型的准确度,以用户评分均值2.95作为评价的阈值,计算测试集的混淆矩阵(如表2所示),训练后模型的准确度为75.9%. 图7为测试集的预测评分分布及真实评分分布,可以看出模型预测的评分分布和真实评分分布十分接近,表明重新训练好的NIMA模型可以为五色色板打一个接近人类感知水平的可靠分数.

使用重新训练好的NIMA模型对31种不同的主题色板进行评分,最终选择评分最高的主题色板作为图像重新上色的目标色板. 目标色板的提取结果如图8所示. 同时本文对比了主色板和目标色板的NIMA评分,二者的NIMA评分均值分别为2.88、3.23,相比于主色板,目标色板的NIMA评分均值提高了12%,表明目标色板更能得到人们的认可.

2.3 图像上色的效果对比

用本文的图像上色方案进行图像上色,实验结果如图9、10所示,其中图9为原始的图像,图10为重新上色之后的图像. 同时本文对比了图像上色前后的NIMA评分,结果显示,重新上色之后,图像NIMA评分均值提高了3%,表明重新上色之后的图像更能得到人们的认可.

图9 原始图像Fig.9 The original image

图10 重新上色之后的图片Fig.10 Image after recoloring

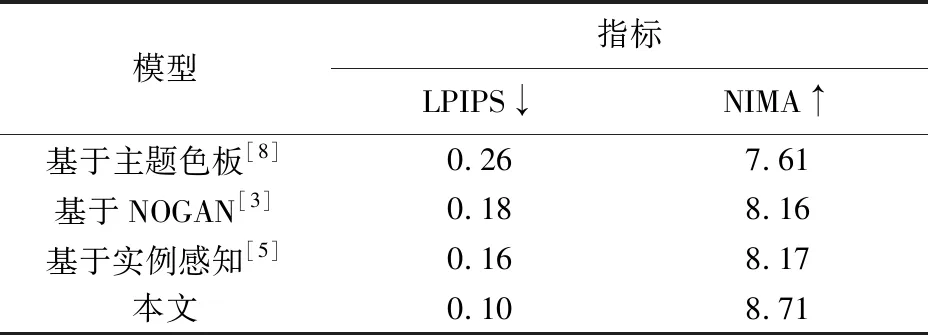

表3 4种模型的上色效果指标比较Table 3 Comparison of the coloring effect indicators of the four models

另外,将本文的图像上色方案与Su等[5]提出的基于实例感知的图像上色模型、Antic[3]提出的基于NOGAN的图像上色模型、Chang等[8]提出的基于主题色板的图像上色模型进行对比. 相比于PSNR、SSIM等传统评估指标,LPIPS[17]和NIMA更符合人们的审美观,因此使用NIMA和LPIPS作为评估指标,验证本文图像上色方案的有效性. 由结果(表3)可知,相比于性能第一的基于实例感知的图像上色模型[5],采用本文方案上色后LPIPS降低了37.5%,NIMA提高了6.6%,表明该方案可行有效.

3 结论

现有基于主题色板的图像上色方法存在着主题不准确、色彩不和谐、上色目标不明确、美感评价不客观等问题. 针对这些问题,本文以中华传统服饰上色作为切入点,以Mask R-CNN、Lasso回归、WGAN_gp和NIMA为传承方法,将古老的智慧与新时代东方审美相融合,实现传统服饰在新时代中的传承上色. 其中,Mask R-CNN用来分割图像,识别出图像中需要上色的传统服饰,解决上色目标不明确的问题;Lasso回归代替原先无监督的提色方式,使得图像主题色板的颜色代表性得到增强;WGAN_gp用来强化主题色板,生成色彩和谐的目标色板;NIMA能够为传统服饰打一个接近人类感知水平的可靠分数,解决美感评价不客观的问题. 在图像上色实验中,本文模型的LPIPS指标和NIMA指标都优于其他模型,表明本方案主题提取准确、色彩和谐、评价客观,更符合人们的审美观. 但是使用Mask R-CNN从图像中分割出的传统服饰边缘不准确. 以后将尝试利用图像的不连续信息及方向场信息,优化Mask R-CNN实例分割的结果,提高图像细粒度的上色效果.