基于超分辨率重建技术的遥感图像小目标检测

2022-09-06张子茜熊再立杨琰鑫付恩康

张子茜,熊再立,张 彪,杨琰鑫,付恩康

(东南大学能源与环境学院 火电机组振动国家工程研究中心,江苏 南京 210096)

近年来,随着航空航天技术的迅速发展,目标识别技术在气象预报/资源普查等领域的应用逐渐得到重视.该技术具有远距离、多角度监测等优势,适用于海洋监测领域,具有广阔的应用前景.目前,遥感图像主要包括合成孔径雷达图像和光学遥感图像两类.其中,合成孔径雷达图像由于具有主动成像的工作特点,通常不受云层、天气等外界因素的干扰,能够全天时、全天候地进行监测;光学遥感图像则能够反映被测物体的真实特征,较好地呈现图像的颜色信息和细节纹理,具有对比度高和噪声低等优点.这两类遥感图像对于海洋监测均具有独特优势,尤其是针对舰船目标的识别,可以为监测水面舰艇、开发海洋资源和维护领海安全提供有力保障,从而有效提高我国军事侦察和海上预警能力.同时,随着航天信息技术的发展,遥感监测设备的数量迅速增加,因此研究遥感目标识别具有重要意义.

超分辨率重建(Super Resolution,SR)技术可以将低分辨率图像经过特定的运算转化为高分辨率图像,从而为图像填充更多信息,对于遥感图像中的舰船小目标检测意义重大.目前,超分辨率重建技术主要包括插值、重建、学习等三种算法.基于插值的算法[1]通过对周围像素点取均值来描述中心像素点的估值.该算法在计算过程中用时较少、复杂度低,但是重建后的图像存在细节信息缺失和过于平滑等缺点[2].基于重建的算法[3]指引入先验信息建立图像变换模型,利用低分辨率图像对模型提供约束,通过模型的计算和检验来恢复图像分辨率.该方法虽然可以较好地恢复图像的细节信息,但是其重建效果不稳定,计算过程复杂、效率较低,难以满足数量庞大的样本重建需求.基于学习的算法是目前学者们研究的重点,首先利用已有的高分辨率图像和低分辨率图像建立大样本学习集,然后通过学习得到高分辨率图像与低分辨率图像之间的非线性关系,建立具有强鲁棒性的重建模型.自2014年,Dong[4]提出基于卷积神经网络(Convolutional Neural Network,CNN)的单幅图像超分辨率重建方法(Single Image Super Resolution,SISR)后,深度学习(Deep Learning,DL)已逐渐成为超分辨率重建的重要方法.Kim[5]和Tai[6]分别对CNN进行改进,在保证学习速度的基础上增加了CNN的网络深度,通过改变不同的卷积层数提高模型学习能力.但是,这类方法重建后的图片通常与人眼直观感受相悖,容易出现纹理损失和过于平滑等问题.针对这些问题,LEDIG等[7]提出一种生成性对抗网络(Generative Adversarial Network,GAN),该网络在生成器G与判别器D不断对抗的过程中进行对抗训练,有助于还原真实自然的目标信息.

目前,针对深度学习背景的遥感图像舰船目标检测算法正在快速发展.与传统检测算法不同,深度学习算法无需对图像特征进行人工提取,识别过程的适应性和一般性得到提升[8,9],成为舰船识别领域中的主要算法[10].GIRSHICK[11]于2015年对R-CNN网络的分割和定位方式进行改进,在VOC 2012上的检测结果显示,平均精度相比之前提高50%以上.2017年,Krizhevsky等[12]尝试建立一个由5个卷积层的R-CNN网络,有效减少连接层的过度拟合,数据集的测试错误率明显降低.在R-CNN基础上,Fast R-CNN[13]和Faster R-CNN[14]陆续被应用于舰船检测中,尤其是Faster R-CNN,在选取候选区域(Regions of Interest,RoIs)方面提出区域生成网络(Region Proposal Network,RPN),有效提升了网络运行速度,成为当前研究的热门方向.

但是,基于深度学习的舰船目标检测算法仍有一些问题需要解决.首先,舰船遥感图像中目标的背景通常较为复杂,易受海岸线、天气和云雾等外界因素干扰;其次,舰船目标在图像中的尺寸较小,单纯依靠卷积神经网络进行检测容易导致目标的位置信息丢失;最后,当前的检测算法对目标的类型和色彩鲁棒性差,难以同时识别合成孔径雷达(Synthetic Aperture Radar,SAR)图像和光学遥感图像.

针对以上问题,我们提出一种基于超分辨率重建的舰船遥感图像小目标检测算法,首先将目标恢复为高分辨率图像,然后运用Faster R-CNN对复杂背景下的舰船小目标进行检测.在AIR-SAR Ship和HRSC2016数据集上进行训练,结果显示改进后算法的综合效率达到65.5%,相比传统检测算法提高12.9%,可以有效完成复杂背景下的舰船小目标检测任务,且算法的鲁棒性和准确率均明显提高.

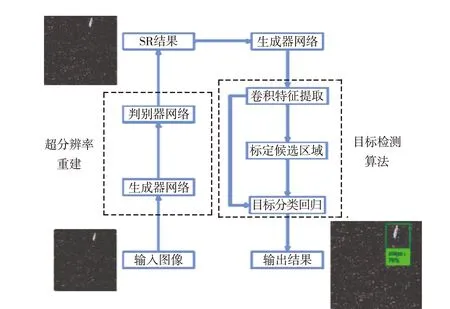

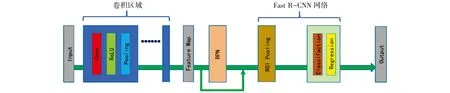

图1 舰船检测算法的整体结构

图2 GAN网络的具体过程

1 算法研究

本研究所提出的基于超分辨率重建的舰船遥感图像小目标检测算法结构如图1所示.首先通过超分辨率重建为低分辨率图像恢复更多的内容信息,克服舰船目标过小带来的纹理细节不足问题,同时弥补后续检测算法中CNN网络导致的高频细节损失.然后,采用Faster R-CNN网络进行目标检测,该网络引入RPN网络对目标的候选区域选取过程进行加速,能够快速准确地识别出复杂背景下的舰船小目标.

1.1 超分辨率重建

本研究采用基于生成性对抗网络的超分辨率重建技术(Super-Resolution GAN,SRGAN),与传统的SRCNN相比,该算法有效抑制重建过程中的梯度变化较小和图像纹理损失等问题.重建后的高分辨率图像具有更丰富的纹理细节和像素信息,从而提高复杂背景下小目标检测过程的检出率.

GAN是一种运用博弈思想训练的重建模型方法,主要由生成器G和判别器D构成,具体过程如图2所示.它通过构建生成器G来不断形成逼真的图像,并使用判别器D来判别输入图像真伪.在该过程中生成器G形成的图像逐渐接近真实的高分辨率图像,并且最终达到判别器D难以准确区分水平.经过多次迭代优化后的生成器G可以使判别器D无法判别图像的真伪性,可以认为生成的图像近似于真实图像.

GAN的目标函数表示为

ξ(G,D)=Ex~pdata(x)[lnD(x)]+Ez~pz(z)[ln(1-D(G(z)))]

.

(1)

其中,真实样本和任意变量分别被记为x和z;生成器所生成的样本满足的数据分布记为G(z);D(x)为判别生成样本真伪的函数,若输入为真则输出1,反之则为0.当生成样本足以欺骗判别器D时,判别函数D(G(z))的数值需要尽可能大.经过生成器G和判别器D的不断博弈训练,最终达到纳什平衡,此时的生成器即具有最优效果.

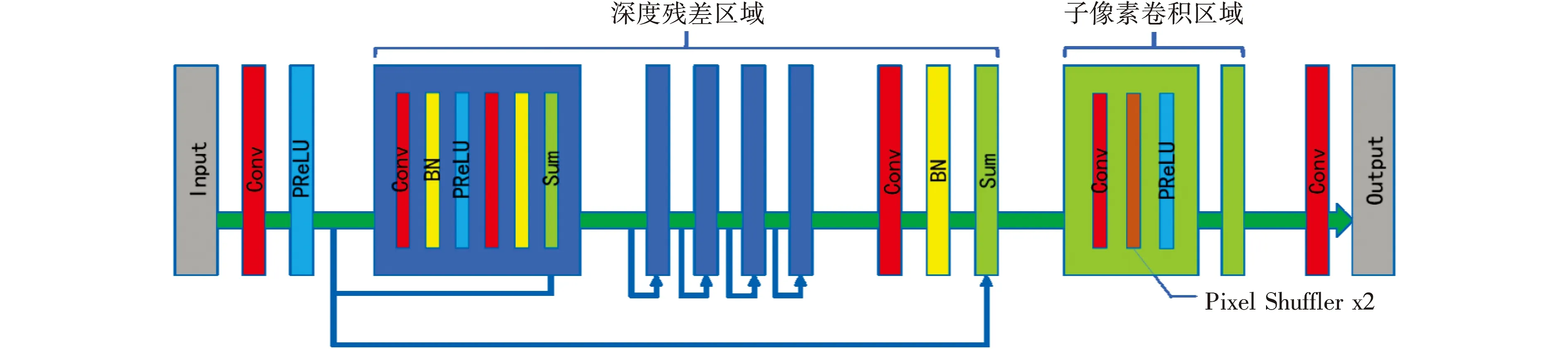

SRGAN网络中的生成器主要由深度残差区域和子像素卷积区域两部分组成,具体结构如图3所示,其中颜色相同的方框代表所在部分执行同一功能.可以看出,每一个深度残差块均从卷积层开始,之后依次通过批归一化层和PReLU层,最终提取出输入样本的特征.生成器网络的后端设置子像素卷积区域,通过卷积变换从而放大输入样本的尺寸.该网络多次采用跳链技术,引入输入样本x作为设定值,使深层次网络与浅层输入直接联系,避免卷积深度过大时造成的误差增加和梯度发散等问题.

图3 SRGAN网络的生成器结构

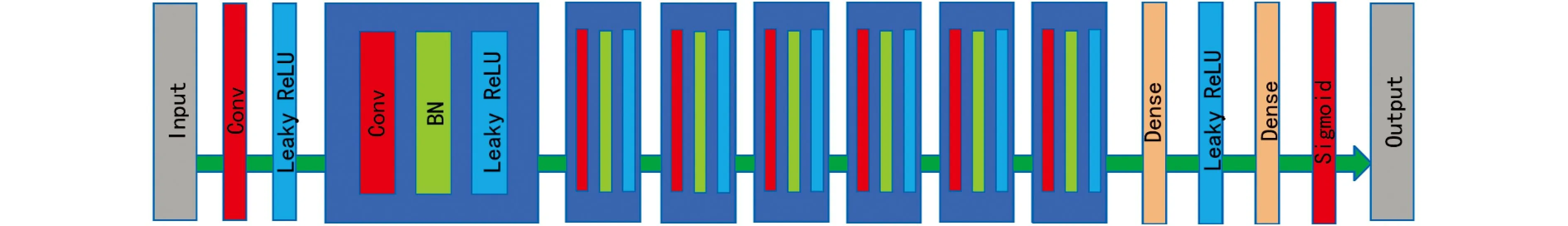

判别器是SRGAN网络中用来判断图像真伪的模块,输出只能为0或1.判别器网络的具体结构如图4所示,其中包含多个串联的卷积层,且越深程度的卷积层所包含的卷积核数目越多,不断降低图像的分辨率以提取样本的本质特征.判别器网络的开始部分未设置BN层,从而防止卷积过程中出现梯度变化过缓的问题.通过对判别器网络进行同步训练和优化,不断增加SRGAN网络的过程鉴别能力,进而提高生成器的图像重建精度.

图4 SRGAN网络的判别器结构

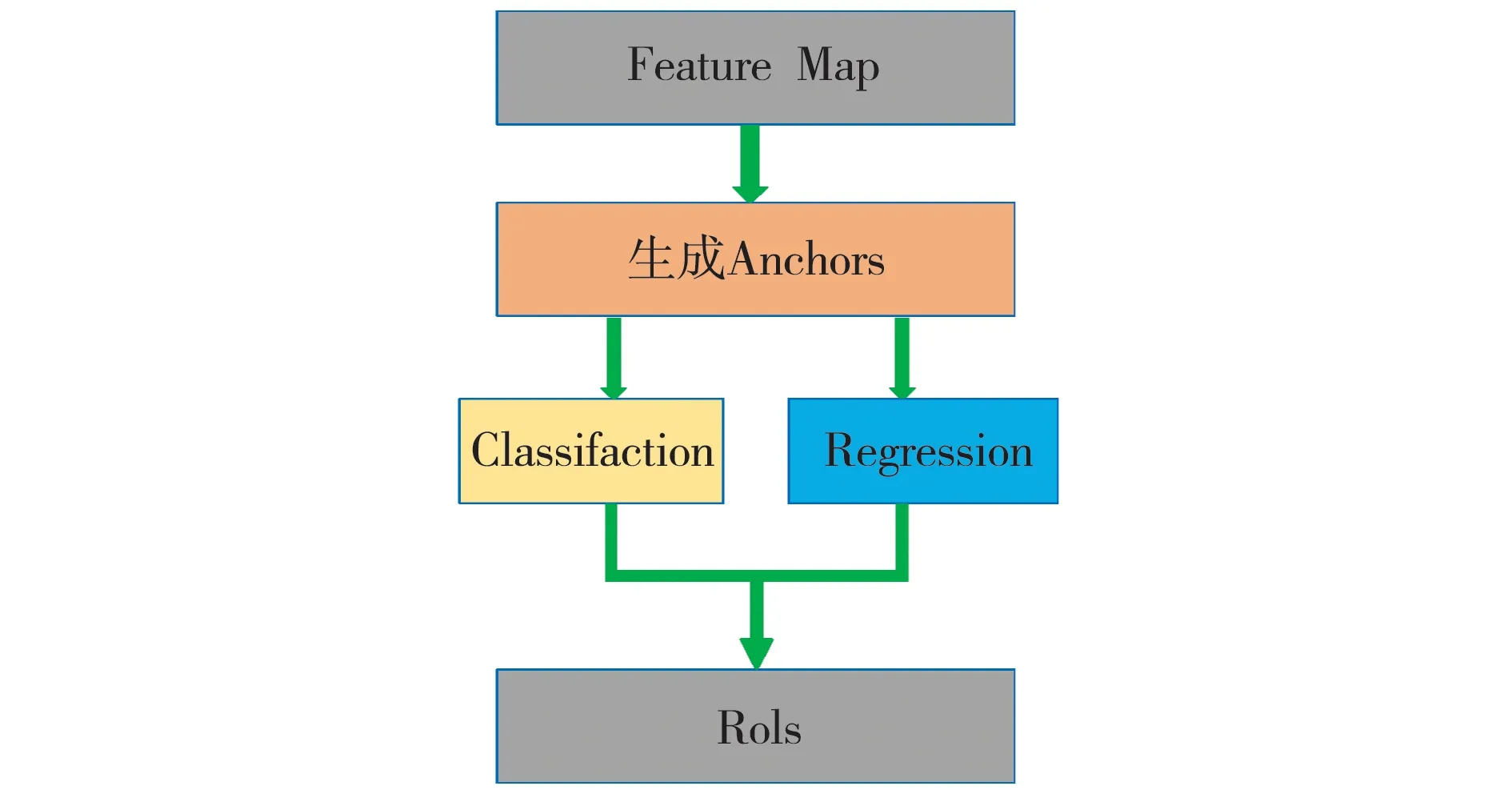

图5 RPN网络结构

1.2 目标检测算法

本研究采用Faster R-CNN[15]网络对超分辨率重建后的高分辨率图像进行检测,并且提出基于Faster R-CNN的舰船遥感图像小目标检测框架.Faster R-CNN网络是在Fast R-CNN网络的基础上发展形成的,它继承了Fast R-CNN网络的候选区域池化算法(RoI Pooling),有效提高网络的运算速度;同时,它采用RPN网络对提取RoIs过程进行优化,克服了传统select search算法的效率低下问题[16].

RPN网络是整个Faster R-CNN网络中最核心的部分,它解决了目标检测中的最复杂的标定候选区域问题.在深度学习过程中,进行目标检测和分类之前需要为图像标定边界框,然而由于目标存在复杂性,因此边界框的大小和位置难以确定.针对这一问题,RPN网络引入锚点进行归一化处理,通过在图像中设置大小一致的边界框,将复杂问题统一代入到边界框中进行解决.如图5所示,RPN网络在边界框中产生一定数量的锚点,将锚点捕捉到的图像信息进行分析,进而判断边界框中是否存在目标对象,同时优化锚点位置以确定目标的最佳位置.

Faster R-CNN网络通过采用RPN网络提高了对候选区域的感知能力,克服了传统卷积神经网络设置边界的固有缺点.锚点的引入增强了候选区域提取的时效性和准确性,进一步缓解了后续目标分类和标定的压力.本文中采用的Faster R-CNN网络结构如图6所示,其将卷积神经网络、RPN网络和RoI Pooling网络融于一体,检测速度和精度均较传统网络有了较大的提升[17].

图6 Faster R-CNN网络结构

Faster R-CNN网络的工作流程可以概括为图像特征提取、候选区域标定和目标分类回归等三部分.首先,图片在CNN网络内经过处理转化为特征图(Feature Map);然后,特征图进入RPN网络中标定目标边界框,利用Anchors准确获取目标的具体位置;最后,将CNN网络提取到的特征信息和RPN网络标定的候选区域一起输入RoI Pooling网络中进行池化,从而获得一个同时包含特征和位置信息的新向量.通过R-CNN网络对该向量进行处理,得到目标的类别信息和置信度,同时在对边界框位置进行微调后最终获得目标的具体坐标.

2 实验过程及结果

2.1 训练集介绍及实验准备

图7 AIR-SAR Ship数据集示例

图8 HRSC2016数据集示例

本文针对SAR图像和光学遥感图像进行无差别检测,其中SAR图像来自AIR-SAR Ship数据集,光学遥感图像来自HRSC2016数据集[18].AIR-SAR Ship数据集由高分三号卫星拍摄,示例图像如图7所示,它包含31景大图,单幅图像分辨率为1 m~3 m,尺寸一般为(3 000×3 000)像素,数据集包括训练集和测试集两部分,其中训练集由1023张21景大图组成,测试集由763张10景大图组成.

HRSC2016数据集来源于谷歌地球系统,示例图像如图8所示,单幅图像分辨率为0.2 m~2 m,尺寸为(200×300)像素到(1 500×600)像素之间,其中训练集有783张图片组成,测试集由569张图片组成.两种测试集均为复杂背景下的舰船小目标图像,且图片中包含港口、海岸、岛屿及其他交通工具.

实验在64 G内存、NVIDIA GeForce 1080Ti GPU和Intel Core i7 8550U CPU的操作平台上进行,采用基于python的编程环境,操作系统为Lunix,编译软件选用VS Code.

2.2 实验结果及分析

本研究采用基于超分辨率重建的小目标检测算法对AIR-SAR Ship和HRSC2016数据集中的图像进行训练和检测,并且引入不同的指标对超分辨率重建效果和整体的目标检测效果进行评估.

首先,引入峰值信噪比(Peak Signal-to-Noise Ratio,PSNR)和结构相似比(Structural SIMilarity,SSIM)对图像重建效果进行评价.同时,因为简单使用上述指标会导致重建图像过于平滑,且PSNR和SSIM两项指标无法较好地体现出SRGAN网络的重建优势,因此采用主观质量指标进行补充评价.

其中,PSNR可以衡量重建后图像的可信度高低,PSNR越大说明图像重建效果越好,具体公式为

(2)

公式中:n为每个采样值的比特数;i、j分别为图像横纵坐标编号;I、J分别为两幅图像的灰度值;M、N分别为图像横纵坐标的总像素数.SSIM通过向量法对高低分辨率图像之间的对比度、亮度等方面进行比较,从而反映出图像重建前后的相似程度,具体公式为

(3)

(4)

公式中:i为得分编号;k为总的得分数;ni为每种得分的评分人数;ci为得分.

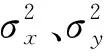

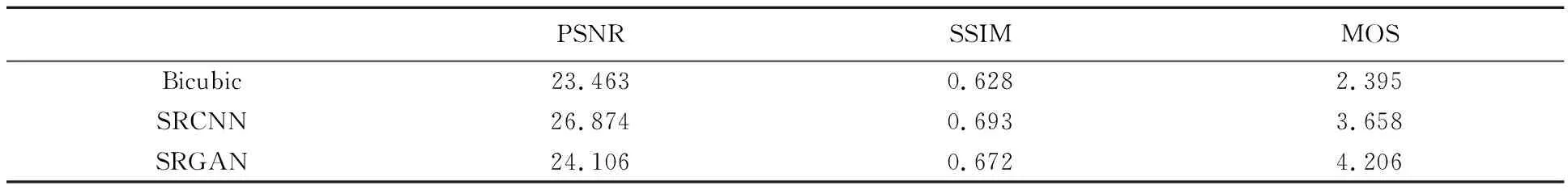

SSIM在0到1之间变化,其值越大则代表相似程度越高,当两张图像相同时值为1.主观质量指标MOS主要用来衡量图像的直观视觉效果,MOS评分在0到5之间,0分最差,5分最好,MOS值越大,表明对应图像的主观质量越好.我们采用双插值方法(Bicubic)、SRCNN和本文方法进行实验,测得的各项指标如表1所示.可以看出,本研究采用的超分辨率重建方法较传统方法有明显的提高,尤其在人眼视觉感受方面格外突出,重建后的图片具有更丰富的细节纹理.图9为采用本研究方法分别对SAR图像和光学遥感图像进行超分辨率重建前后的效果对比,可见重建后的图像在色彩、纹理和分辨率方面均获得明显改善,这也进一步提高了对复杂背景下小目标识别的检测水平.

表1 不同方法的超分辨率重建结果比较

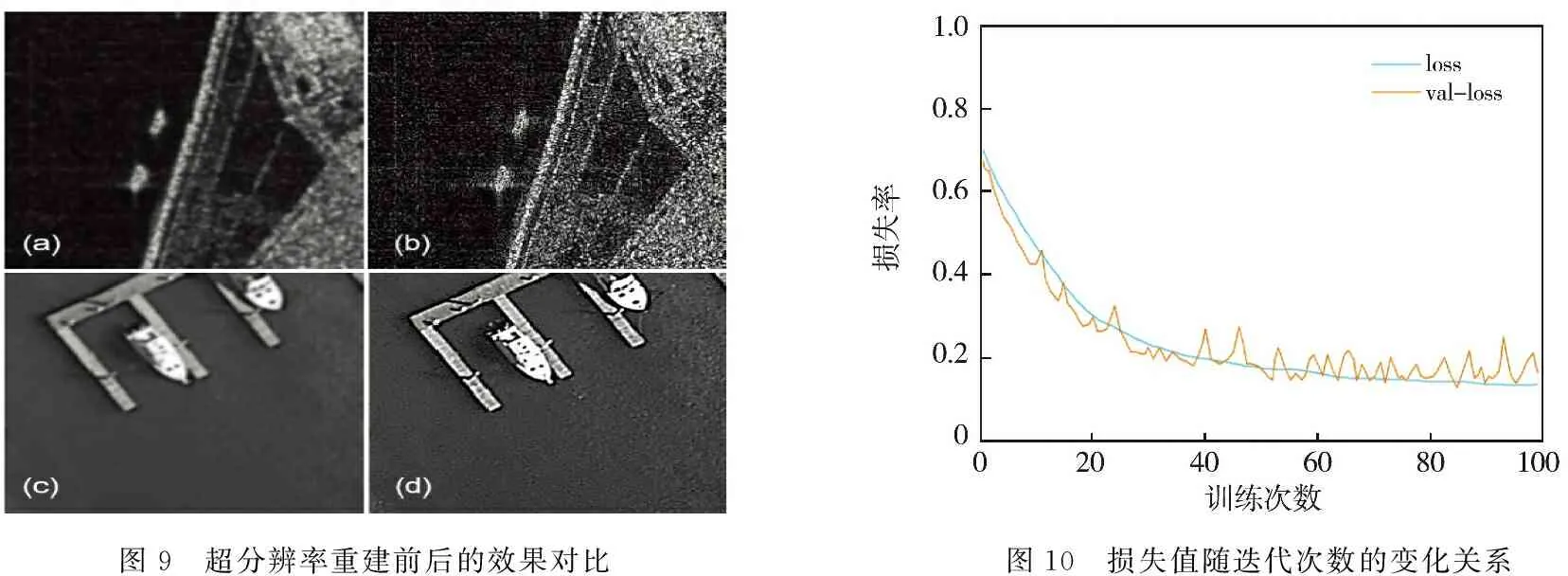

采用识别模型对Faster R-CNN网络进行训练,通过不断增加迭代次数来增强网络的目标检测准确率.损失值随迭代次数的变化关系如图10所示,可以看出,当迭代次数发生较大梯度的增加时,损失值出现明显的下降趋势,目标检测网络的可信度也随之增加.

图9 超分辨率重建前后的效果对比图10 损失值随迭代次数的变化关系

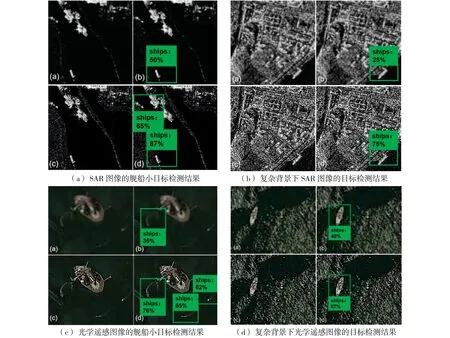

图11 舰船图像检测结果

通过Faster R-CNN检测网络对超分辨率重建后的SAR图像和光学遥感图像进行检测,检测结果如图11所示,其中每个例图中的(a)均为待检测的低分辨率图片;(b)为未结合超分辨率重建算法的检测结果;(c)为超分辨率重建后的高分辨率图片;(d)为结合超分辨率重建算法的检测结果.

图11(a)和图11(c)分别为SAR图像和光学遥感图像中的舰船小目标检测结果.这类图片通常具有目标模糊、面积较小等特点,而且图片中可能具有多个大小不同的被测对象,相邻对象之间存在相互干扰现象,传统算法针对毗邻对象的检测结果漏检率较高.结合超分辨率重建的检测算法可以提高舰船检测的鲁棒性,对不同大小的被测对象具有较好的适应能力,有效降低对于小目标舰船对象的漏检率.

图11(b)和图11(d)分别为复杂背景下的SAR图像和光学遥感图像中的舰船目标检测结果.这类图像中一般具有海岸线、云雾以及其他的交通工具等干扰因素,因此舰船目标的检出率低、错检率高.而且由于传统算法中存在非极大值抑制现象,目标错检后通常会影响相邻正确目标的检测,因此检测效果较差.采用改进后的检测算法可以为舰船目标的纹理细节,从而抑制周围复杂环境对目标检测的影响,进一步提高目标的检出率.

本研究引入准确率P、召回率R和综合效率M等三项指标对整个检测过程的结果进行评价,具体公式为

(5)

(6)

(7)

公式中:Np为检测正确的样本数量;Fp为检测错误的样本数量,Fn为检测遗漏的样本数量.在此基础上,采用综合效率M来衡量算法在检测过程中的综合性能.由于在小目标检测中增加了超分辨率重建过程,除去训练时间外,每张图片(1 500×600)像素超分辨率重建时间大约花费300 ms.

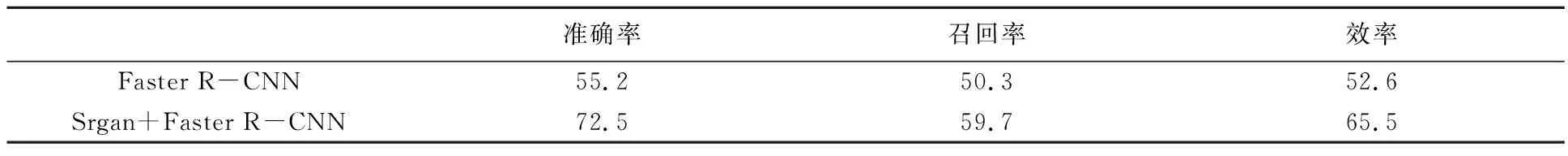

结合超分辨率技术前后的检测效果对比如表2所示,可以看出,改进后的算法综合效率提高了12.9%.这是因为采用超分辨率重建的检测算法可以为输入样本恢复更多的纹理特征和高频细节,并且在深层特征中保存了原始图像的更多位置信息,因此有效提高了过程的鲁棒性.

表2 应用超分辨率技术的前后效果比较(%)

3 结 论

本文提出了一种基于超分辨率重建技术的舰船图像小目标检测算法,并在AIR-SAR Ship和HRSC 2016数据集上进行了实验验证研究.本方法可以有效克服目标尺寸小和背景复杂等问题,通过超分辨率重建算法为低分辨率图像提高像素等级,同时抑制卷积过程中目标位置信息损失,提高舰船检测的鲁棒性.本研究首先检验了超分辨率重建后的图像质量,证明了重建后的图像具有更丰富的纹理细节和视觉特征.同时,基于超分辨率重建的检测算法可以缓解单幅图像中毗邻对象之间的相互干扰现象,提高对不同尺寸舰船目标的适应能力,从而降低对于小目标舰船对象的漏检率.将本研究所提出的算法应用在AIR-SAR Ship和HRSC2016数据集上,综合效率相比传统检测算法提高12.9%,且对于复杂背景下的小目标检测效果获得明显提升.随着遥感图像的广泛应用,实现小目标的高精度检测具有重要实践意义,基于超分辨率重建技术的检测方法有望成为该领域重要辅助工具.