级联结构网络在肺癌患者颈部淋巴结超声图像分割中的应用价值

2022-08-30赵富强吴卫华

宫 霞 赵富强 吴卫华

在传统的医学影像分析中,超声具有成本低、辐射小等优点,应用广泛,但其图像较CT、MRI 图像的分辨率低,分析相关医疗影像较耗时、耗力,且主观性强。近年来随着深度学习技术发展,使得计算机分析医疗影像成为可能,大量的图像分类、图像分割和目标检测等试验[1-4]表明,计算机应用于智能医疗影像后其分析速度和精度均优于临床医师。深度学习中的数据增强、迁移学习和对抗网络等技术可辅助临床医师进行超声图像分析,对提高分析图像的效率和准确性,尤其在区分肺癌转移性淋巴结病变和良恶性病变方面具有重要的临床研究意义。肺癌转移非常关键的一项鉴别诊断是锁骨上淋巴结转移,通过计算机辅助诊断肺癌患者颈部淋巴结超声图像,分割出淋巴结,进而对淋巴结进行良恶性分类,不但在理论上丰富了现有的研究方法,其在临床上也有很好的应用前景。

在超声图像分割中,应用最广的深度学习模型是UNet[1]网络,其变形版本包括:V-Net[2]、mu-Net[3]、M-Net[4]等,但它们均未采用多尺度训练,在医疗图像小目标和小样本分割上精度较低。 UNet 改进的网络结构包括:Attention UNet[5]、UNet++[6]、UNet3+[7]等,这些网络在分割精度上得到了很大提高,注意力机制、多尺度训练、特征融合和混合损失函数等技术值得借鉴。王波等[8]将注意力机制应用于UNet 网络,提出了一种基于改进UNet 网络的甲状腺结节超声图像分割方法,Attention模块对边缘轮廓分割细化;Transformer 在NLP 上取得了很大成功,近期有学者将其引入到目标检测和图像分割中,提出了Swin Transformer[9],其结 合 UNet 提出了 TransUNet[10]和 Swin-UNet[11]。Swin Transformer 根据网络大小,可分为 Tiny、Small、Base 和Large 等级别,网络参数和结构依次增大,所需训练硬件资源也相应增加,这使得Transformer 在临床应用受到限制。为此,本文提出了基于级联结构改进注意力UNet 网络,改进了混合损失函数,图像多尺度输入进行训练和推理,更适合小目标的分割,针对病灶边缘区域的分割更加清晰。

一、UNet与EfficientNet网络

超声图片输入UNet 网络后,先通过左侧的下采样,即4 组卷积,每次下采样图片缩小2 倍;然后特征图上采样,对应右侧4 组反卷积,左侧每层特征图与右侧对应层拼接生成上采样的输入,保留了该尺度图像特征。

深度学习中的Backbone 网络大多采用ResNet 结构,很好地解决了网络的深度问题,但对网络的宽度却无能为力,因此,谷 歌 2019 年 提 出 了 EfficientNet[12]网 络 。 EfficientNet 包 括B0~B7,训练的模型也依次增大,该网络结构能够兼顾网络深度、宽度和分辨率,使模型的准确率、鲁棒性等相关指标均得到了很大提高。

二、级联注意力UNet(CAUNet)

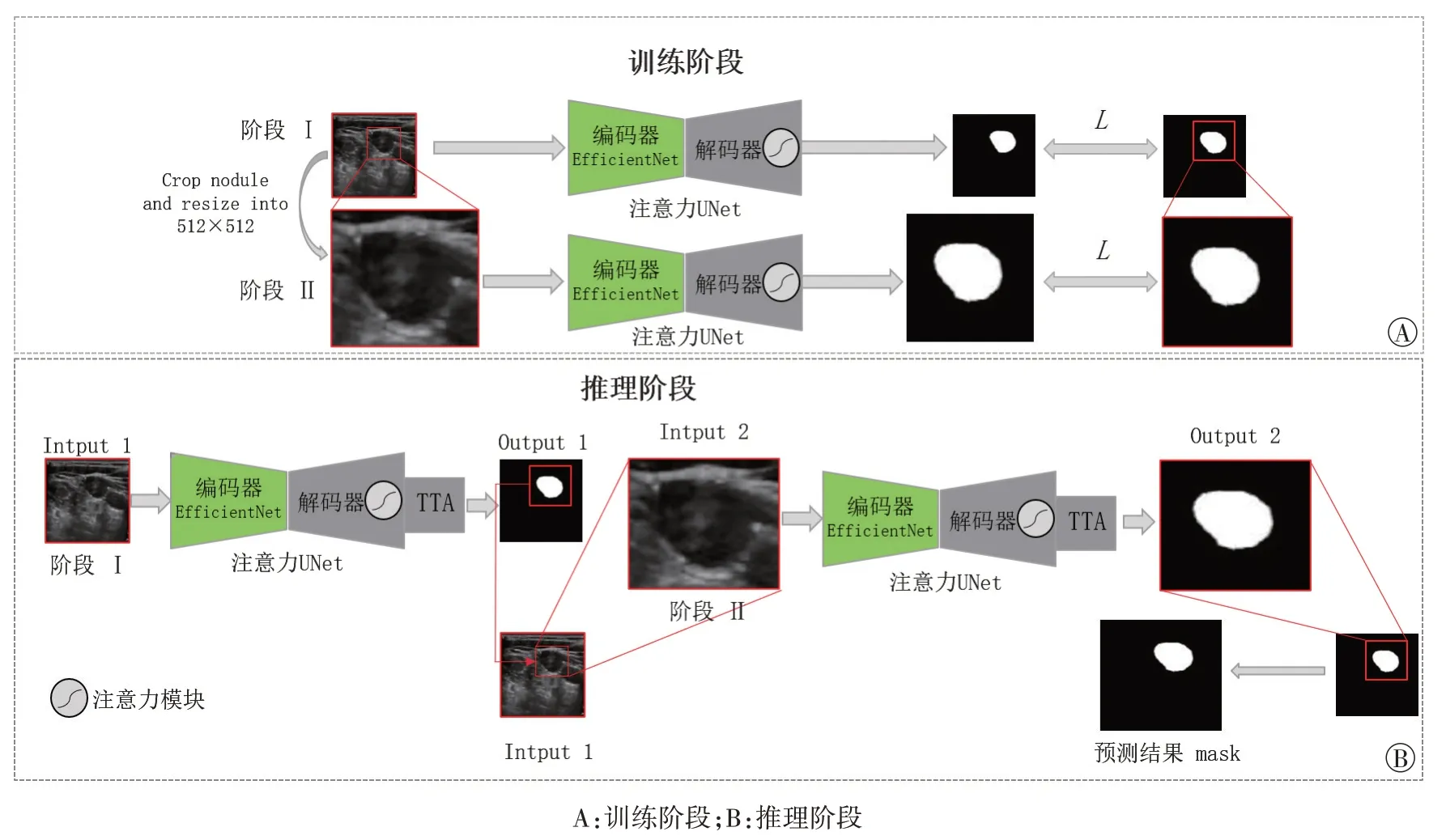

Cascade R-CNN[13]是级联多个检测网络进行模型训练,检测的正负样本通过IOU 值限定,多个网络级联使得网络的检测结果得到优化和提高。与Cascade 级联不同,本文提出的CAUNet(Cascade Attention UNet)网络结构是将注意力UNet 与EfficientNet 结合并进行改进,级联结构如图1 所示。改进的注意力UNet 包括编码器和解码器两部分;其中编码器采用EfficientNet-B5 作为Backbone,更利于提取超声图像病灶区域特征,第一阶段分割网络和第二阶段分割网络下采样均采用该编码器结构,上采样是增加了注意力模块的解码器,构成二阶段级联分割网络。在训练阶段,将采集的超声图像数据预处理后输入到第一个分割网络(级联的阶段Ⅰ),CAUNet 利用改进的损失函数对网络进行训练,该网络提供颈部淋巴结结节的粗略分割;在第一阶段粗略分割的基础上,继续训练二次分割网络(级联的阶段Ⅱ),该网络进行颈部淋巴结结节的精细分割。但训练的输入数据与第一阶段不同,首先对一阶段训练的图像去除非病灶区域,针对mask 掩码轮廓取外接矩形,裁剪出该区域图像;然后将该图像尺度放大到512×512(像素),输入到二阶段网络进行训练。

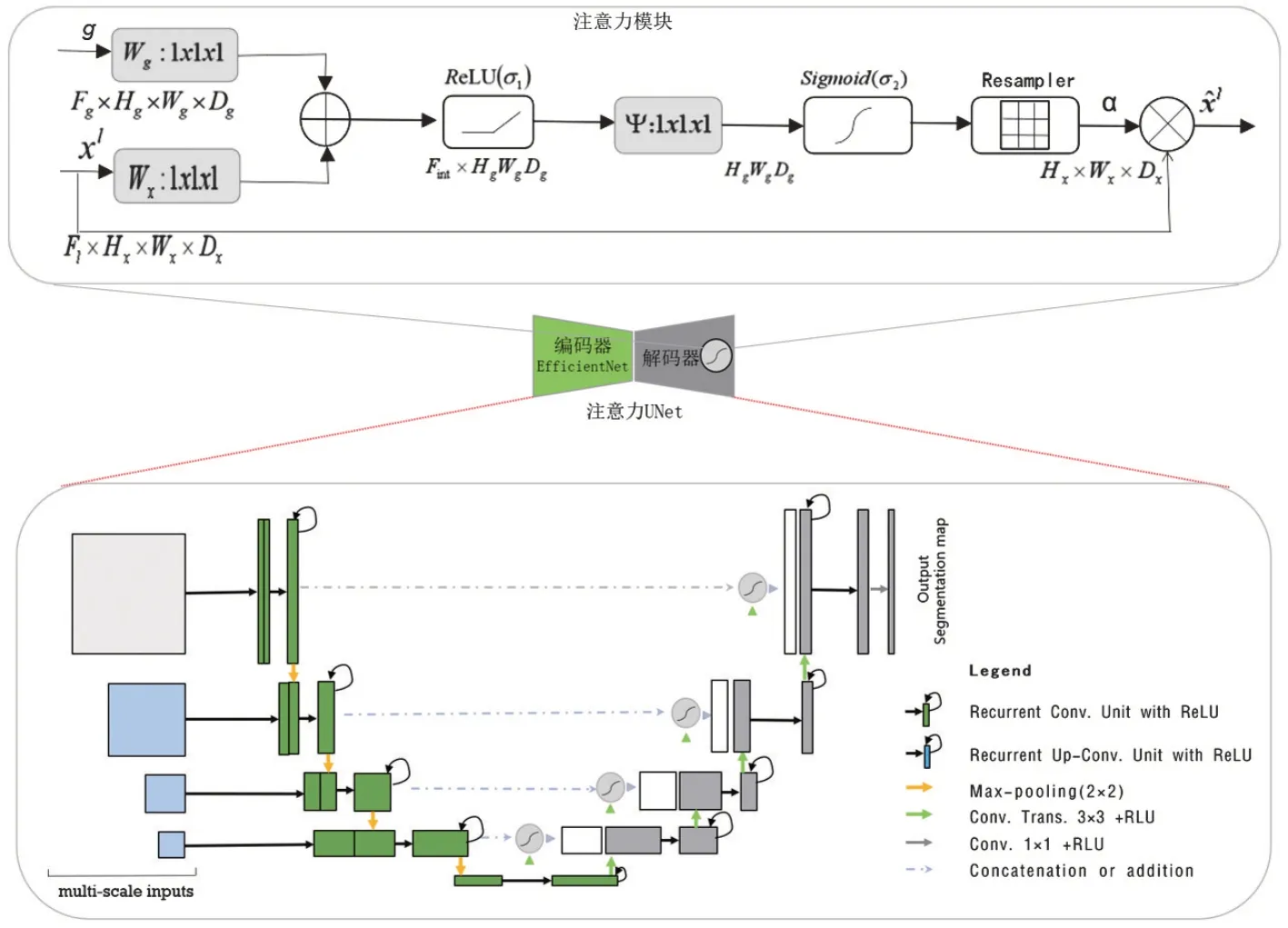

在推理阶段,图片多尺度输入,一阶段同样先进行整张图片分割,然后将分割病灶区域放大,再进行二阶段的精细分割。推理阶段如果使用TTA 技术,病灶区域分割效果更优。注意力UNet 为图1 网络结构中“编码器和解码器”部分,UNet下采样部分不变,上采样部分引入注意力模块,其详细结构组成见图2。输入编码器的颈部淋巴结超声图片采用多尺度信息,输入图像分为4 个尺度,每个尺度在本层使用EfficientNet-B5作为Backbone,提取的特征分别作为下采样和右侧注意力门的输入,将图像的底层feature map 与高层feature map 融合,即g与xl依次进行加、ReLU、ψ、Sigmod、重采样、乘等操作,对病灶区域的边界分割准确率提高更有效。

图1 CAUNet网络结构图

图2 注意力UNet网络结构图

三、损失函数改进

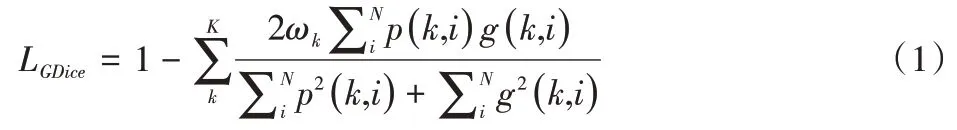

1.Generalized Dice损失函数

Dice loss 在评价小目标病灶区域分割时的误差较大,原因如下:如模型对超声图像中较小的病灶区域预测错误,则Dice loss 值会出现幅度比较大的波动,反向传播的梯度变化相应增大,致使模型训练稳定差。当超声图像病灶分割有多个区域时,使用Generalized Dice loss计算公式如下:

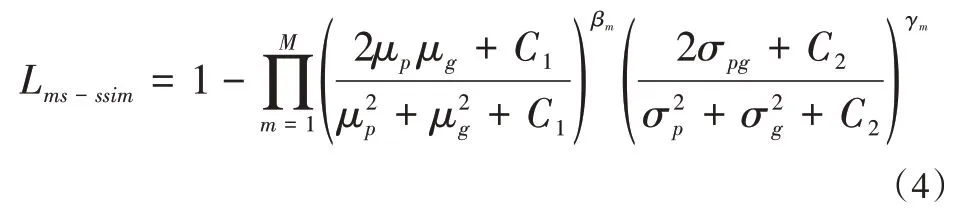

2.多尺度结构相似度损失函数

由于超声图像清晰度相对较低,分割颈部淋巴结病灶区域的边界模糊,为了解决该问题,Wang 等[14]提出了多尺度结构相似度损失函数(Multi-Scale Structural Similarity Index,MSSSIM),模糊边界的权重更大。本文级联结构模型同样对模糊边界更加关注,如超声图像区域分布差异越大,多尺度结构相似度损失值越大。病灶区域分割预测结果p与裁剪了标签mask g对应病灶区域的外接正方形(N×N)公式分别表示为:

多尺度结构相似度loss定义如公式(4)所示:

其中,μp为p的均值,μg为g的均值,σp为p的方差,σg为g的方差,σpg为协方差,M 为尺度数,βm、γm分别为在 m 尺度时p、g的权重,C1、C2为取值很小的常数。

结合 Generalized Dice 损失函数[15]、正则化损失函数、MSSSIM 损失函数Lms-ssim和Focal 损失函数LFocal[16],定义本文总损失函数为:

其中,λ为LFocal损失函数所占权重,其取值为0、0.1、0.5或1;LRg表示正则化损失函数。公式(5)损失函数有效避免在数据不平衡时,组合loss 退化为Dice loss,而且对超声图像小目标病灶区域有较好的分割效果,病灶边界更加清晰[17]。

四、数据增强方法

当收集的肺癌患者淋巴结超声图像数据较少时,通常采用数据增强(Data Augmentation)技术,该技术可以有效弥补数据不足来训练模型,防止过拟合。本文采用的数据增强方法包括:水平翻转、垂直翻转、随机剪切、随机仿射变换、中心裁剪和随机旋转(<90°、90°、180°和270°);此外,还通过调整对比度、模糊(高斯、平均值、中值)、高斯噪声和Cutout 等数据增强方法,得到增强后的图片共4545张。

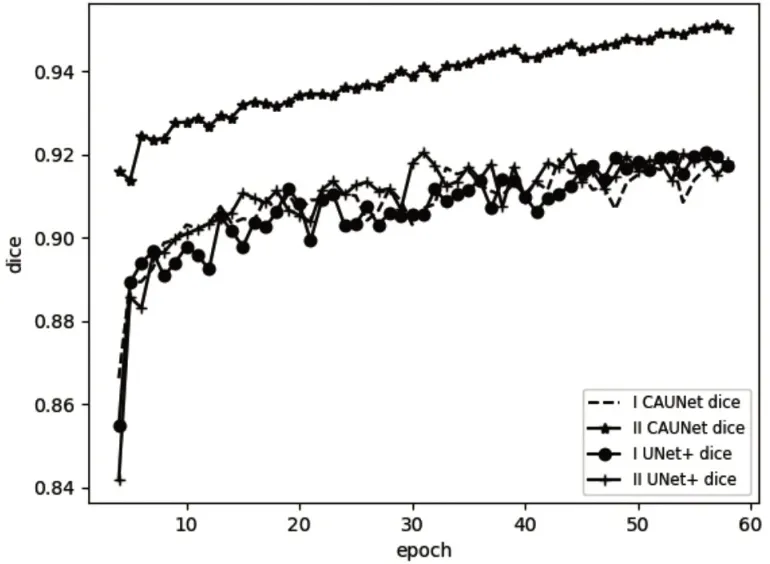

试验环境是基于深度学习Pytorch 框架,GPU 服务器配置为:操作系统为乌班图18.04,CPU为Intel i7-8700K,内存64 GB;显卡为英伟达RTX 1080Ti、显卡显存11 GB。为了提高分割模型的泛化能力,本文采用了TTA技术,包括用于垂直翻转、水平翻转、90°和180°旋转。第60个Epoch训练和验证结果见图3。

图3 模型训练和验证分割结果

五、实证分析

1.数据来源

本文数据来源于上海市胸科医院超声科440 例肺癌患者的510 张淋巴结超声图像,其中男240 例,淋巴结图像260 张;女200 例,淋巴结图像250 张。采集的每张超声图像均由专业超声医师扫描完成,并标注病灶长径和短径,用于训练的超声图像病灶区域由3 名经验丰富的超声医师使用Labelme 共同标注,诊断结果均与病理结果相对应,确保数据的正确可靠;患者的淋巴结均进行针吸细胞学检查及细针穿刺活检。两个阶段使用的数据不同,先去掉参与训练图像的不相关区域,在第一阶段,即上述采集的超声图像,原图和掩码图的分辨率均为256×256,三通道读取;在第二阶段,病灶区域图像与掩码图均相应放大,分辨率为512×512,掩码图为二值化图像,病灶区域为白色,背景为黑色。

2.模型测试与结果分析

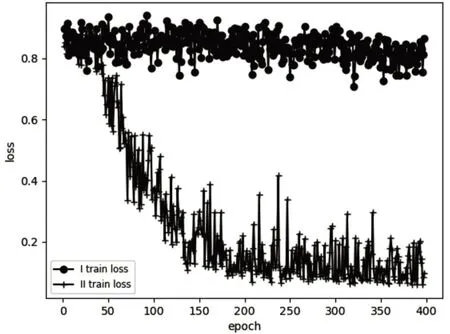

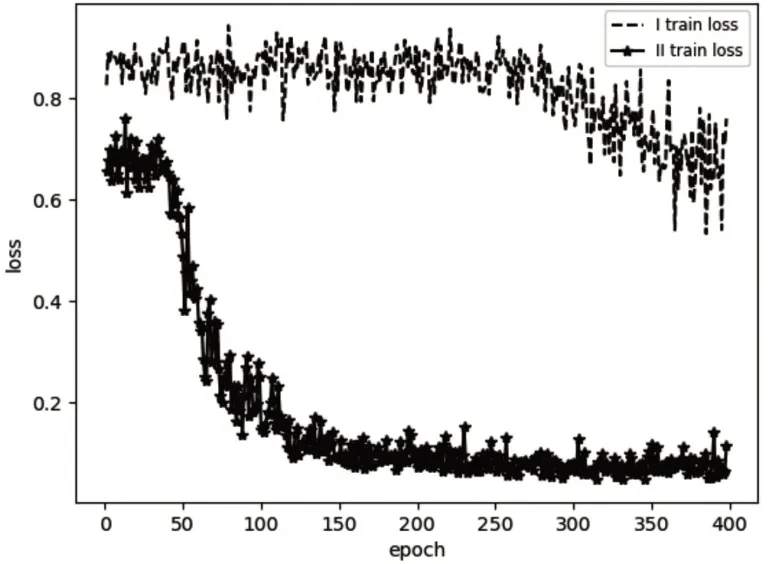

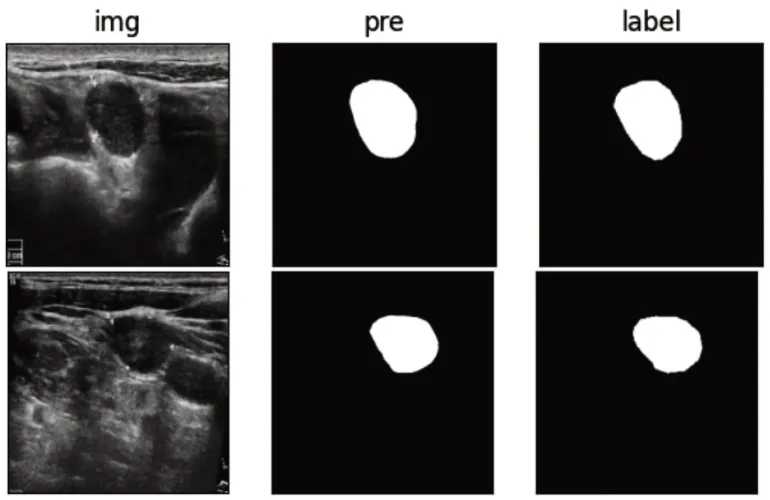

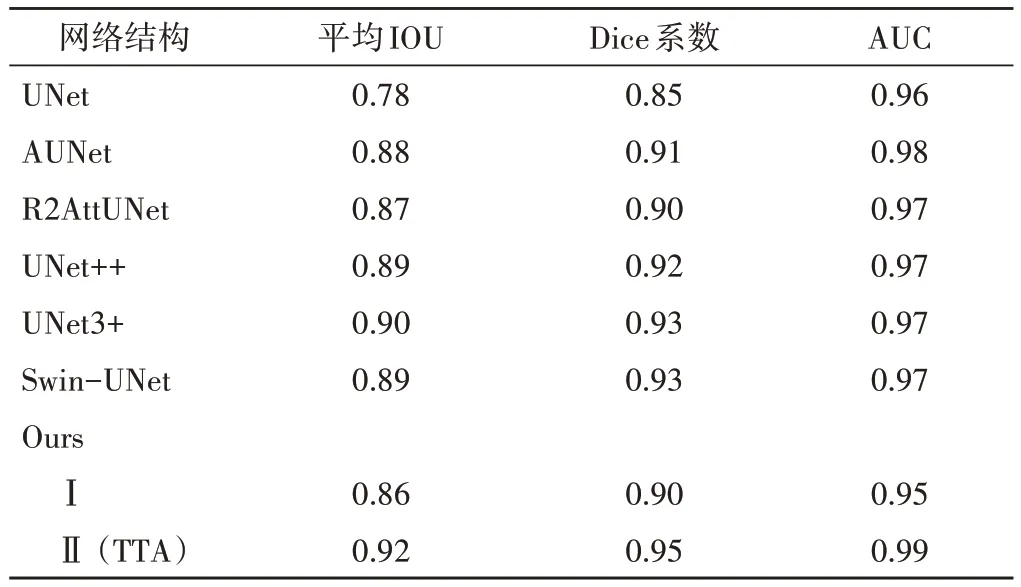

将采集的颈部淋巴结超声图像数据集按照8∶1∶1划分为训练集、验证集和测试集,采用Adam 优化器。使用Dice系数对超声图像的分割结果进行评估。通过图4,5分析发现,UNet++Ⅰ和Ⅱ阶段损失函数收敛较CAUNet 网络慢,第二阶段的loss 值较第一阶段更低;由图6 可知UNet++Dice 系数低于0.92,本文提出的级联二阶段CAUNet 网络Dice 系数达到了0.95,且第二阶段优于第一阶段,说明第二阶段对关键病灶区域的放大训练和分割是有效的。可见,级联二阶段CAUNet 网络分割效果优于UNet++,将提高颈部淋巴结良恶性分类的准确率。测试集结果见图7,从左往右依次为:原图、预测结果、标注结果。与其他UNet 网络比较见表1,该表列出了不同网络结构平均交并比(IOU)、Dice 系数和曲线下面积(AUC)3 个指标比较,验证了本文提出的方法对病灶区域分割最优,上级联CAUNet 在TTA 技术下平均IOU 较UNet 网络提升了14%,Dice 系数提升了10%,AUC 提升了3%,而UNet3+和Swin-UNet 的Dice 系数均为0.93。同样,与其余对比算法相比,本文的模型在各项指标上也均有较大改进。本文Swin-UNet 采用Base 级网络结构,跳跃连接数目为3。

图4 UNet++Ⅰ和Ⅱ阶段损失函数

图5 CAUNet Ⅰ和Ⅱ损失函数

图6 CAUNet与UNet++网络Ⅰ、Ⅱ阶段Dice系数

图7 淋巴结病灶分割

表1 不同网络结构量化指标比较

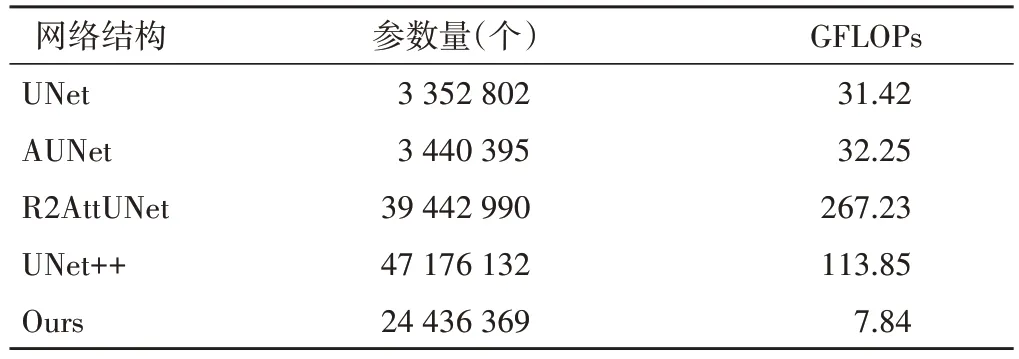

工具包torchstat.stat,可以计算训练模型的算法复杂度、参数量(可训练参数量和总参数量)、GPU 服务器占用量等,得到的不同网络结构参数量见表2。CAUNet 网络是两个阶段训练和推理,因此,较UNet和注意力UNet网络在参数和计算资源消耗上均要大,如需进一步提高实时性,可通过增加GPU 数量实现。

表2 不同网络结构参数量比较

本文结果表明,CAUNet 网络能够快速、准确分割肺癌患者颈部淋巴结超声图像。图像分割结果的敏感性为95%,特异性为96%,准确率为92%,AUC 为0.99,表明本文提出的新模型是有效的,有助于区分肺癌患者转移性淋巴结与良性淋巴结。

六、结论

本文提出了基于注意力UNet 网络级联EfficientNet-B5 的二阶段超声图像分割模型,针对颈部淋巴结超声图像进行增强,多尺度训练;为了提高病灶小目标分割性能和小样本训练模型,提出了新的损失函数,有效防止网络的过拟合,网络的鲁棒性得到提高;采用了数据增强扩充训练数据,试验结果表明该网络提高了Dice系数。今后需进一步深入探讨的内容包括:①对颈部淋巴结超声图像分割出来的区域,需要分类网络进一步预测淋巴结病灶区域的良恶性;②在本文基础上,进一步优化损失函数、对DeepLabv3+网络采用级联结构深入研究;③将GAN 和UNet结合,提出生成对抗UNet,可应用于本文的图像数据增强,改善模型的性能。