基于虚拟现实的视频关键帧特征检索技术

2022-08-22何水静罗灵芝

何水静,罗灵芝

(南京信息工程大学,江苏 南京 210044)

1 引言

目前,大多数视频检索工作耗费大量时间,同时操作复杂,会使提取效果受到人工主观影响,导致文字无法被全面提取,因此为了避免这种问题的发生,需要对视频检索中关键帧进行提取[1,2]。

张航[3]等人提出面向矿山监管的无人视频关键帧影响动态提取方法,该方法优先对视频采集带来的影响进行预处理,并对影像中的关键信息进行提取,计算提取信息及相机参数,利用计算结果获取动态间隔,并对其进行处理,从中提取关键帧,该方法的预处理效果不理想,存在提取误检次数多的问题。王群[4]等人提出视频监视前景图像估计的盲源提取方法,该方法首先构建出特征模型,再对前景图像进行提取,将模型引入到提取方法中,以此提升提取效果,该方法构建的模型不完善,存在提取效率低的问题。邱一城[5]等人提出时空特征分析结合随机密钥的压缩域数字视频水印嵌入和提取方法,该方法首先将密钥进行组成,并利用时空特征分析方法对视频图像特征进行分析,以此完成压缩视频的时空特征提取,该方法的分析效果存有误差,存在视频检测查全率差的问题。

为了解决上述方法中存在的问题,提出基于虚拟现实的视频检索中关键帧提取方法。

2 基于虚拟现实的视频图像分割

2.1 虚拟现实

在计算机领域中,虚拟现实技术应用广泛,虚拟现实可以通过3D传感技术及可视化技术生成虚拟环境,再通过指定设备就可以在虚拟环境中进行操作、感受及体验。随着虚拟现实技术的迅速发展,目前为止,虚拟现实技术已经可以在各个领域中使用,适用范围极广。

虚拟现实[6]与3D模拟技术不同,它主要分为四部分。

1)首先利用虚拟现实技术对虚拟场景进行建立,从而完成可交互的虚拟环境。在场景中用户可以对任何事物进行观察及研究。同时在场景中也包含一个数据库,它主要通过软件实现。

2)安装一个存有虚拟现实软件的计算机,它可以把虚拟场景的内容显示到计算机内。

3)为了使人机接口和用户之间的交互更加便利,设置了I/O接口设备,即输入/输出设备。

4)用户,主要用来操纵虚拟世界。

通过上述分析,给出虚拟现实技术的基本框架如图1所示。

图1 虚拟现实框架

通过图1可知,接入I/O接口设备后,用户具备两种权限,分别是对任务的接收及计算机访问。由于接入设备后用户可以对计算机进行访问,同理,用户也可以直接进入到虚拟场景中,对虚拟事物进行访问,切身感受场景中的变化,具有较强的真实性。

2.2 视频镜头切割

在虚拟现实的基础上,将视频图像投入到虚拟场景中,通过视频镜头分割对关键帧进行提取。视频镜头分割[7]是视频检索的关键部分,属于视频流的基础。对视频镜头进行分割时,需要对图像内的镜头边缘进行检测,根据检测结果进行分割,以此提升视频检索效率。

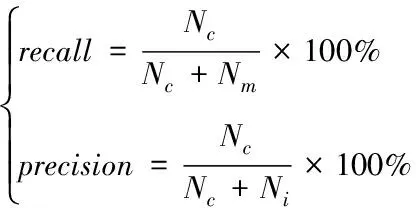

分割视频镜头时,通常会出现漏检或误检两种情况。误检及漏检的好坏决定了视频镜头边界性能的好坏,这时漏检率recall及误检率precision用方程表达式定义如下

(1)

式中,Nc描述的是可以精准检测出的镜头数量,Nm描述的是镜头漏检的数量,Ni描述的是镜头误检数量。

1)视频图像互信息量

进行视频图像分割前,首先要获取视频图像的互信息量[8]。在视频镜头中,互信息量可以对图像之间的相关性进行表示,以此表明图像传递的信息。对镜头进行分割时,相邻图像的互信息量越高,就说明两者的相关性越强,在同一镜头下的概率越大。因此,为了能够对镜头进行精准分割,需要对阈值进行合理设置,通过互信息量及阈值大小,就能够实现对镜头边界的检测。

选取HSV颜色空间,分别对两个相邻视频图像的三种分量H、S、V交互信息量进行计算,此时三种分量的互信息量定义为

(2)

式中,I描述的是互信息量,L描述的是H的量化级数,M描述的是S的量化级数,N描述的是V的量化级数。P(H)t,t+1(x,y)描述的是分量H图像帧x、y的概率密度,P(H)t(x)描述的是t帧x的边缘概率密度,P(H)t+1(y)描述的是t+1帧y的边缘概率密度。同理,P(S)t,t+1(x,y)、P(V)t,t+1(x,y)标记概率密度。P(S)t(x)、P(V)t(x)标记边缘概率密度,P(S)t+1(y)标记分量S的t+1帧边缘概率密度,P(V)t+1(y)标记为分量V的t+1帧边缘概率密度。

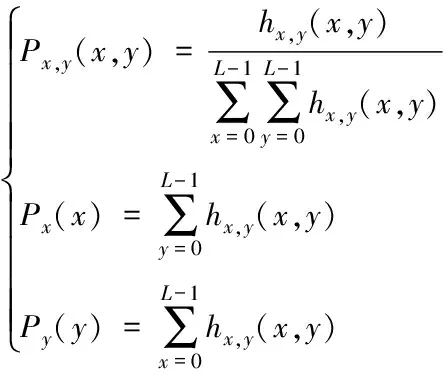

此时,利用直方图归一化对x与y的概率密度及边缘概率密度进行表示,取得

(3)

式中,(x,y)标记为联合概率密度[9],而x、y标记为边缘概率密度。hx,y(x,y)描述的是联合直方图,它主要通过对视频图像的位置灰度进行统计获取而来。

依据取得的互信息量,将最大的权值引入到H中,以此突出视频图像色调,而最小的权值引入到V内,这样就可以有效降低视频图像的光效,以防闪光对视频镜头检测产生影响。这时赋予权值的两帧图像互信息量,用方程定义如下

Z×I(V)t,t+1)

(4)

式中,H、S、V赋予的权值分别通过J、K、Z进行表示。

2)基于互信息量的镜头切割

根据取得的视频图像互信息量可知,当镜头切变以后,转换位置的互信息量就会降低,但在同一个视频镜头的互信息量只会发生较小的波动。为了避免这种问题的发生,优先对视频进行分割,形成连续帧图像,对第一帧的相邻帧间互信息量及相隔k帧的互信息量进行计算,再对镜头切换进行检测,针对检测结果计算分割视频图像的局部自适应阈值[10],再对互信息量的最小值及切变边界进行判断,依据判断结果对渐变起始及结束帧进行检测,从而实现切割,具体流程如下所示:

1)将视频图像划分成N帧连续图像;

2)对视频内所有相邻的互信息量It,t+1进行计算;

3).建立尺寸为2n+1的滑动窗口[11],在窗口内比较各个互信息量大小,以此用来检测帧i,若i为最小值,就将窗口向右进行移动,便于对下一帧进行判断,若i不是最小值,直接进行下一步骤;

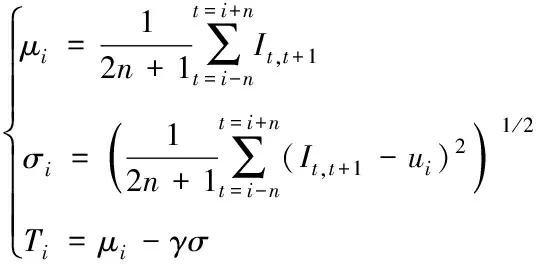

4)对帧i的局部自适应阈值进行计算,表示为

(5)

式中,μ描述的是均值,σ描述的是标准差,Ti=μi-γσ描述的是局部双阈值,u描述的是系数。

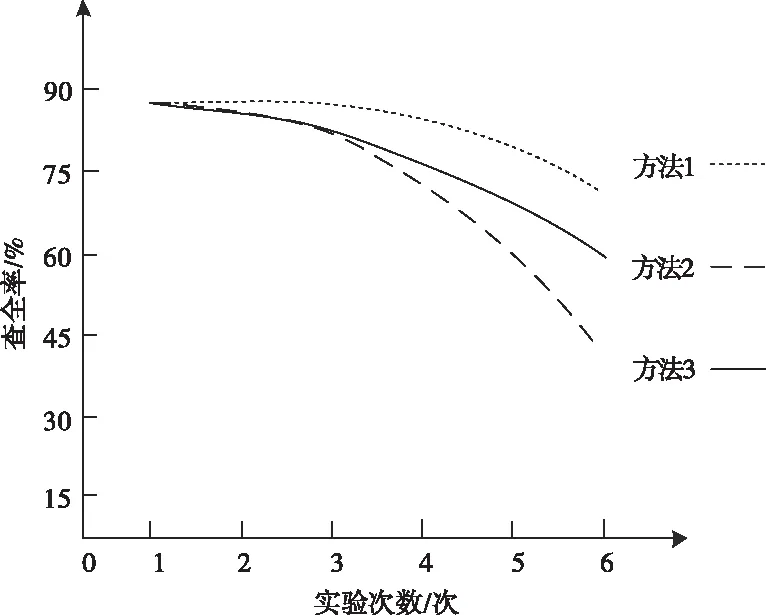

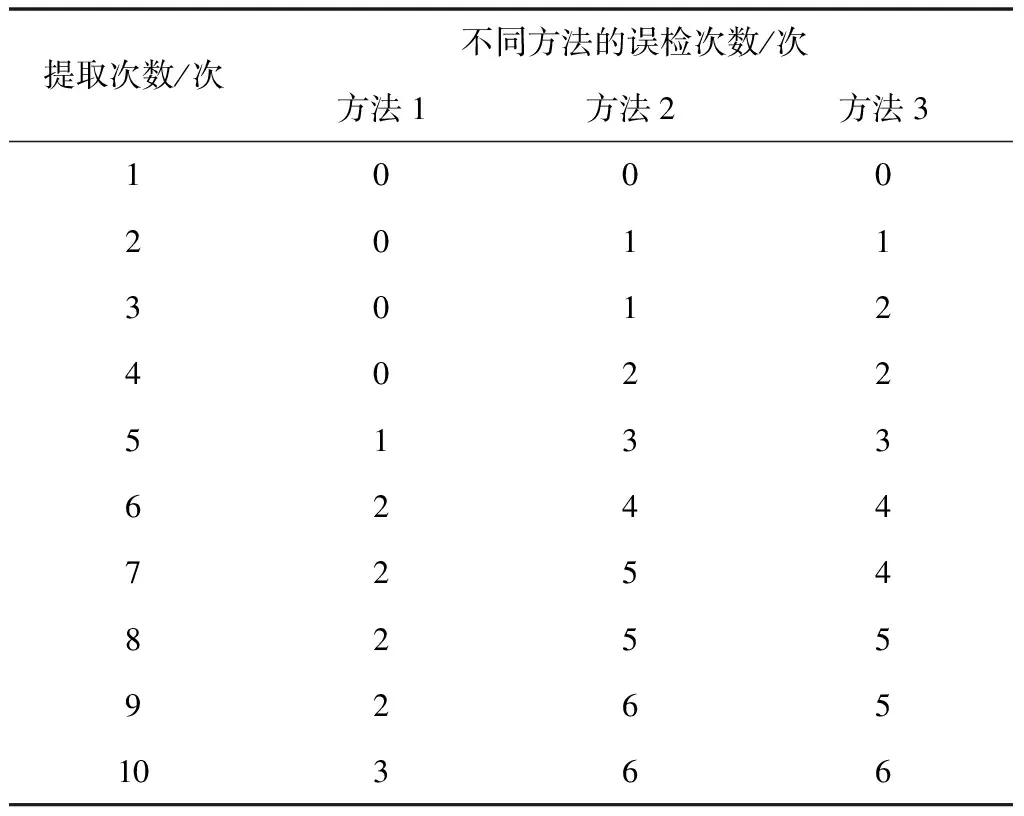

5)对It,t+1与Ti自适应阈值进行比较,若It,t+1 6)对所有帧的信息熵进行计算,若信息熵的值与0相近,那么就设置fs为各个帧的信息熵。当信息熵[12]上升趋势逐渐提升时,那么就设置它的结束帧为fe,以此确认从左向右的fe、fs为镜头淡出,并以相同的方式对右方向进行搜索,将fs到fe作为镜头淡入; 7)对第k帧到第N-1帧的待检测帧和It,t+k进行计算,当待检测的第i帧对切变后的帧进行滤除后,It,t+k 通过对虚拟现实技术的分析描述,以此将视频图像投影到虚拟环境中,在虚拟环境内得到视频图像的互信息量,基于互信息量完成视频流的切割。 根据视频图像的切割,依据切割视频数据的时间及空间特性,采用K-slice算法[13]对关键帧进行提取。 1)由于分割后视频的时间特性,设置原始的聚类中心数量为k,那么选取k+1的切割视频,即num=fnum/(k+1),其中,num描述的是过程变量,fnum描述的是视频总帧数。 此时的聚类中心定义为 center(i)=slice(i*num) (6) 式中,slice(i*num)描述的是视频时空分割,center(i)描述的是像素值,即i=1,2,3,…,fnum。 2)聚类中心数量 由于分割的视频不同,所以聚类中心的数量也大不相同。为了降低聚类中心数量对提取结果产生的影响,需要对最佳聚类中心数量进行确立。 采用K-slice对切割视频进行聚类,即K=1,若聚类数目逐渐提升,那么类别之间的距离均值为 (7) 对ave的边缘直方图差均值Tave进行计算,取得的最佳聚类个数K为:K=min{k|ave(k) 根据选取的最佳聚类数量,对视频检索中关键帧进行提取,流程如下所示: 1)首先对切割的视频图像进行K-slice聚类; 2)对各类减少的连续帧进行处理; 3)对候选关键帧进行提取,切割图像聚类后就会自动形成子镜头,将各个子镜头中图像信息熵最大的帧值看作候选关键帧,并对其进行提取; 4)由于候选帧中,相邻的两个关键帧具有冗余[14,15],所以为了能够精准地对关键帧进行提取,需要对冗余去除; 假设a为伸缩因子,T=a*Tave为阈值,当Tave≥0.05,T=0.5*Tave时,a=0.5;当Tave<0.05,T=1.5*Tave时,a=1.5,若候选关键帧满足上述条件,就说明没有冗余。 5)对没有冗余的候选关键帧进行关键帧提取,实现视频检索中关键帧提取。 为了验证基于虚拟现实的视频检索中关键帧提取方法的整体有效性,需要对该方法进行实验对比测试。 采用基于虚拟现实的视频检索中关键帧提取方法(方法1)、面向矿山监管的无人机视频关键帧影像动态提取方法(方法2)和时空特征分析结合随机密钥的压缩域数字视频水印嵌入和提取方法(方法3)进行实验测试对比。 1)对视频检索中的关键帧进行提取时,其时效因子影响着整个关键帧的提取效率,为了验证关键帧的提取效果,采用方法1、方法2和方法3分别对关键帧提取进行效率测试,以时效因子为参考指标,时效因子越大,说明该方法的提取效果越好,提取效率越高,具体测试结果如图2所示。 图2 关键帧提取效率测试 设置本次实验测试时间为50s,分析图2中的数据发现,在测试期间三种方法的时效因子都随着时间的增加呈现出上升状态。其中方法1的时效因子要高于方法2和方法3,可见方法1的关键帧提取效率较高,提取效果最优。 2)视频检索的关键帧提取方法中,视频镜头被分割时容易出现漏检或误检等情况,这往往会给视频检索的效率带来影响。因此,为了确保视频检索中关键帧提取的精准度,需要采用方法1、方法2和方法3对切割镜头后的视频检测查全率进行测试,查全效果越高,说明该方法的提取精度最大。测试结果如图3所示。 图3 镜头分割后的视频检测查全率测试 根据图3中的数据发现,视频镜头分割后,三种方法的视频检测查全率均呈现出下降趋势。第一次测试时,三种方法的查全率相同。随着实验次数增加后,方法2的查全效果要低于方法1和方法3,这说明方法2的视频检测效果差,导致关键帧提取的准确性较低。同时经对比发现,方法1的运动轨迹下降速度最慢,说明方法1的查全效果最高,关键帧提取的精准度最大。 综上所述,方法1的查全率最高,这是因为方法1对关键帧进行聚类,并对存有冗余的关键帧进行去除,以此提升了视频检测的查全率,进而增强了关键帧提取的精准度。 3)基于上述分割视频检测查全率测试,为了验证关键帧提取效果,设置本次实验对关键帧共进行10次提取测试,利用方法1、方法2和方法3分别对关键帧进行误检实验,误检次数越多,说明关键帧提取效果越差,具体测试结果如表1所示。 表1 不同方法的误检次数测试 分析表1中的数据发现,随着提取次数的不断提升,三种方法的误检次数也不断增加。但从总体上看,方法1的误检次数最低,这说明方法1的关键帧提取效果要优于方法2和方法3。 随着计算机应用领域的发展,信息技术也得到了广泛关注,它可以应用于各个领域中,给人类带来了巨大便利。但由于数据信息的增多,使人们对关键帧进行提取时容易出现漏检的现象,所以针对视频检索中关键帧提取存在的问题,提出基于虚拟现实的视频检索中关键帧提取方法。该方法首先利用虚拟现实技术将视频图像放射到虚拟场景中,基于虚拟现实技术对视频图像互信息量进行获取,依据获取的互信息量对视频镜头进行分割,采用K-slice聚类算法对分割后的视频图像进行聚类,以此完成对关键帧的提取。该方法对视频检索中关键帧提取方法有着显著的帮助,在今后关键帧提取方法中占据着关键地位。3 视频检索中关键帧提取方法

3.1 K-slice聚类算法

3.2 关键帧提取算法流程

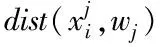

4 实验与分析

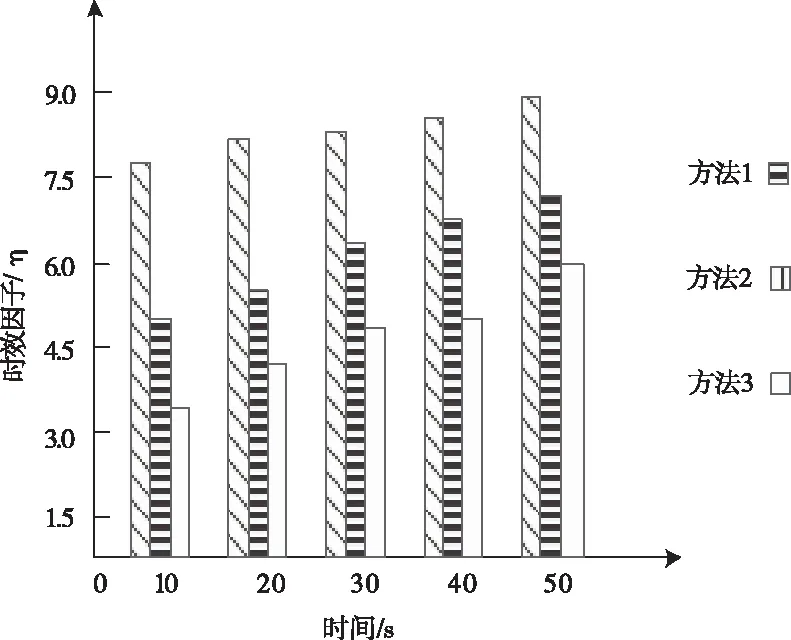

5 结束语