基于关键点的遥感图像舰船目标检测

2022-08-17杨小冈卢瑞涛谢学立

张 涛, 杨小冈, 卢瑞涛, 谢学立, 刘 闯

(火箭军工程大学导弹工程学院, 陕西 西安 710025)

0 引 言

舰船目标定位和监测在海洋环境感知、敌情侦察、海运管理等军事和民用领域发挥着重要作用,是遥感图像智能处理领域的研究热点和重点[1]。在大范围、高分辨率的光学遥感图像中,舰船目标背景复杂多变,多种类的舰船目标常以任意方向密集排列,类内差异小,导致通常的检测模型具有局限性,因此高分辨率可见光遥感图像舰船目标检测成为一项极大的挑战[2]。

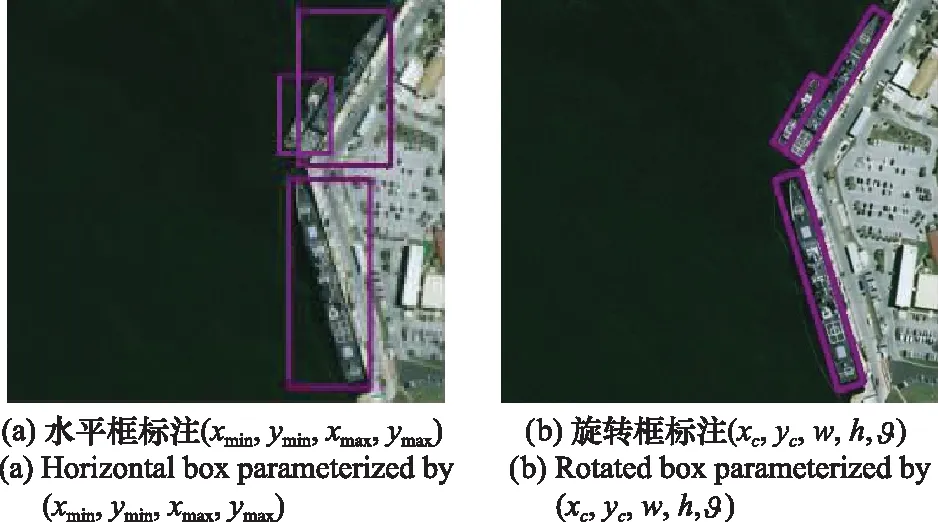

遥感图像中舰船目标的排列方式不同于一般图像目标,舰船目标在图像中呈任意方向排列,复杂背景严重干扰目标识别。同时,遥感图像中舰船目标长宽比大,影响着传统检测方法对舰船目标的识别和精确检测[3]。通用的目标检测算法中采用水平框标记目标,但舰船目标检测采用水平框,会存在大面积背景干扰,导致不同目标框间的重叠区域过大,引起回归不准确的情况,且在后处理非极大值抑制阶段,因重叠过高会造成部分舰船目标漏检[4]。针对舰船目标特性,本文采用目标最小外接矩形框(旋转框)标记目标,有利于获得舰船目标精确的边界信息,还能反映出舰船尺度、长宽比等信息用于后续舰船目标方向和队形识别。

随着深度学习技术在目标检测任务中广泛应用,任意方向遥感图像舰船目标的检测越发受到关注。光学遥感图像舰船目标的旋转框检测方法大多都是通过场景文本检测以及通用目标检测转化而来。文献[5]在单激发多框探测器(single shot multibox detector,SSD)基础上添加反卷积和池化特征模块融合深浅层信息,以增强目标特征之间的关联实现舰船目标检测。文献[6]提出双向特征融合机制,通过语义聚合模块将高层信息融合到低层,再将低层特征图平均处理作为高层注意力权重图进行加权,实现特征融合提高检测精度。文献[7]针对遥感图像中舰船目标的长宽比和排列方式,重新设置锚框的比例和数量,有效改善了舰船目标检测的速度和精度,面对复杂背景鲁棒性也较强。文献[8]改进YOLOV3网络,引入对舰船目标比例和形状自适应的可形变卷积,优化Resnet变体结构并采用ShuffleNetv2轻量化思想实现舰船目标检测,提升目标检测速度。这些方法都是直接将通用目标检测方法迁移到舰船目标检测,未考虑到舰船密集排列时,用水平框标记舰船会导致目标重叠造成漏检,且任意方向的舰船目标存在较大长宽比,水平框会造成检测精度受限。为了解决水平框标记舰船目标存在的问题,文献[9]采用旋转框对舰船目标进行定位,在旋转兴趣区域中引入特征金字塔池化模块对不同尺度的特征进行提取和融合,实现感兴趣区域的分类以及舰船目标的精确定位。文献[10]提出了旋转池化模块用于提取旋转目标特征,以及旋转边框回归模块用于回归舰船目标的5个要素,并针对多类别提出多任务的非极大值抑制实现舰船检测。文献[11]提出了一种旋转框检测器(rotatable bounding box regression,DRBox),DRBox能够正确输出目标的方位角,可以准确识别任意方向的舰船目标,并且生成相应的旋转框,对于多角度舰船目标的定位非常有效,与Faster R-CNN、SSD相比有较大的提升。文献[12]将水平感兴趣区域(region of interest,RoI)转换为旋转感兴趣区域,有效地缓解了RoI与舰船目标间的偏差,还可以减少用于定向物体检测的锚框数量,以促进后续分类和回归。文献[13]提出了旋转区域建议网络用于生成具有舰船方位角信息的建议,为使旋转区域建议准确,回归了边界框的方位角,并在分类子网络中加入旋转感兴趣池化层提取特征,进行有效的目标定位和分类。这些工作考虑到舰船目标特性,采用旋转框检测,同时为了提高检测精度设置了不同比例的锚框,但遍历锚框需要提前设置锚框的比例大小,存在超参数多、计算量大的问题。为了减少计算成本提高检测速度,文献[14]增加一条角度预测分支,基于深浅层融合的特征图送到旋转框大小及角度等预测分支,并采用旋转非极大抑制适应目标旋转框的检测。文献[14]避免了基于RCNN框架旋转锚框成倍增加和旋转非极大值抑制增加的计算复杂性,通过预测每个目标内部的一对中间线实现检测,将目标线段定义为原始旋转边界框标记的两条对应的中间线,无需额外手动标记。文献[15]提出一种自底向上的单阶段无锚检测模型X-LineNet,将任务描述为检测每个目标内部的两条相交线段,并将其分组,而无需任何矩形区域分类。这几种方法都是无锚框任意方向检测的网络,摆脱锚框遍历机制,提高了检测速度,但这些方法中使用的特征不具备旋转不变性,性能仍落后于基于锚框的检测。

基于以上方法中存在的局限性,受CenterNet模型[16]启发,考虑到任意方向排列的舰船中心点不受方向影响,提出一种单阶段无锚框的关键点遥感图像舰船目标检测算法,通过估计中心点位置实现遥感图像任意方向舰船目标检测。算法摆脱锚框遍历机制,并采用深度可分离卷积,减少参数量,提升模型检测速度。此外,算法还结合方向不变模型和无参注意力机制,增强对特征的表达能力,提升模型检测精度,最终达到检测速度和精度平衡。

本文的主要贡献包括:

(1) 提出了一种单阶段无锚框的旋转框舰船目标检测框架,摆脱锚框遍历机制,提升了模型计算速度;

(2) 为了缓解主干网络生成的特征不具备旋转不变性造成的不一致性,引入一种OIM用来生成方向不变特征图;

(3) 引入SimAM无参注意力机制,并结合降低计算冗余的深度可分离卷积,增强对舰船目标的关注度;

(4) 采用可形变卷积来解决多种形式目标几何变换问题;并将提取的特征图输入到检测分支中,完成中心点、目标宽高和角度的回归;最终设置组合损失函数对模型训练优化。

1 基于关键点的遥感图像舰船目标检测

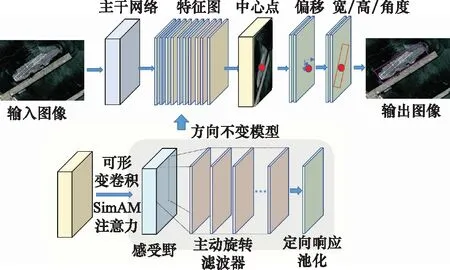

1.1 算法整体框架

本文提出关键点的遥感图像舰船目标检测方法,是一种端到端的anchor free关键点估计算法,整体框架如图1所示。首先使用嵌入OIM的主干网络[17]生成特征图,并引入深度可分离卷积,结合SimAM无参注意力机制[18]增强对目标的表征;然后在特征图上估计舰船目标中心点;最后回归出每个中心点对应特征图上中心点处偏移量、目标大小及角度。

图1 基于关键点的遥感图像舰船目标检测方法结构图Fig.1 Structure diagram of key-point based method for ship detection in remote sensing images

1.2 特征提取网络

令输入图像为I∈RW×H×3,经过特征提取网络,最终得到的特征图大小为F∈R(W/s)×(H/s)×N,其中W、H为图片的宽和高,s为尺寸缩放比例,N为检测目标数。受CenterNet网络启发[16],当前用于关键点估计的提取特征主干网络有Resnet、特征聚合体系(deep layer aggregation,DLA)[19]以及Hourglass Network[20]。Resnet内部残差块跳跃连接,当增加网络宽度和深度的时候能提升网络的性能,以往的bottleneck、residual block等模块从串联形式到跳跃连接形式,但结构仍过于单一。DLA深度网络特征融合的方法通过迭代聚合(iterative deep aggregation,IDA)和分层聚合(hierarchical deep aggregation,HAD)结构进一步扩展单一的跳跃结构,能够在深层网络终融合语义和空间信息。Hourglass是姿态估计专用网络,由两个连续的沙漏模块组成,每个沙漏模块包括5对具有跳跃连接的向下和向上卷积网络,能够捕捉关键点的空间位置信息。实验证明,Hourglass产生更好的关键点估计性能,但Hourglass网络参数量多,计算量大。

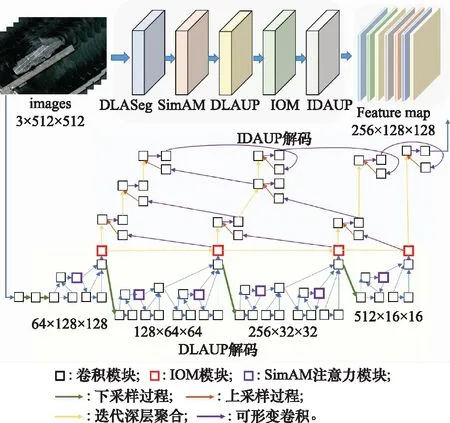

为兼顾网络检测过程的精度和速度平衡,本文采用DLASeg网络为提取特征的主干网络,DLASeg在DLA网络的基础上使用可形变卷积和Upsample层组合进行信息提取。DLASeg核心是DLAUP和IDAUP,这两个类中都使用了Deformable Convolution可变形卷积以及ConvTranspose2d进行上采样。同时,考虑遥感图像舰船目标是任意方向密集排列的,但主干网络生成的特征不具备旋转不变性,因此在DLASeg网络中引入OIM。为了进一步减少计算量,在DLASeg网络中引入深度可分离卷积并插入SimAM无参注意力机制来提升对舰船目标的关注度。改进的特征提取网络如图2所示。

图2 优化的特征提取网络Fig.2 The architecture of the feature extraction network

1.2.1 DLASeg网络

不同于Resnet网络融合方式仅限简单的叠加,DLA结构采用DenseNet和特征金字塔思想,通过将不同stage、block的网络结构迭代式融合语义信息和空间特征,提高检测精度。将IDA和HAD组合,形成DLA结构如图3所示。

图3 DLASeg结构图Fig.3 Structure diagram of DLASeg

1.2.2 SimAM注意力机制

注意力机制常被引入各种网络中提升模型性能。通道注意力(squeeze-and-excite,SE)[21]通过激励-挤压操作,生成2维特征图来构建通道的依赖性;轻量的注意力模块(convolutional block attention module,CBAM)注意力机制进一步将大尺度核卷积引入空间信息进行编码[22];但是SimAM不同于现有空间和通道注意力模块,它不是简单的将空域和通道注意力并联或者串联。3D注意力模块SimAM受“人脑中两种注意力同时工作”启发,设计了一种能量函数来发掘每个神经元的重要性,即计算注意力权值,相比于其他注意力模块,没有额外参数,使用灵活有效,如图4所示。

图4 3D注意力权值图Fig.4 Diagram of three dimenisonal attention weight

一般来说,人脑中激活神经元会抑制周围神经元,即空域抑制,对于空域抑制的神经元应该赋予更高的权重,因此SimAM的能量函数为

(1)

式中:t,xi分别为单一通道中输入特征的目标神经元和其他神经元;(wtxi+bt)和(wtt+bt)是在t,xi上的线性变换;M=H×W为通道上神经元的数量。通过计算出wt,bt的解析解,以及通道中所有神经元的均值和方差,得到最小能量公式为

(2)

由式(2)可知,能量越低,t神经元和其他神经元的区别越大,越重要。SimAM模块最终优化为

(3)

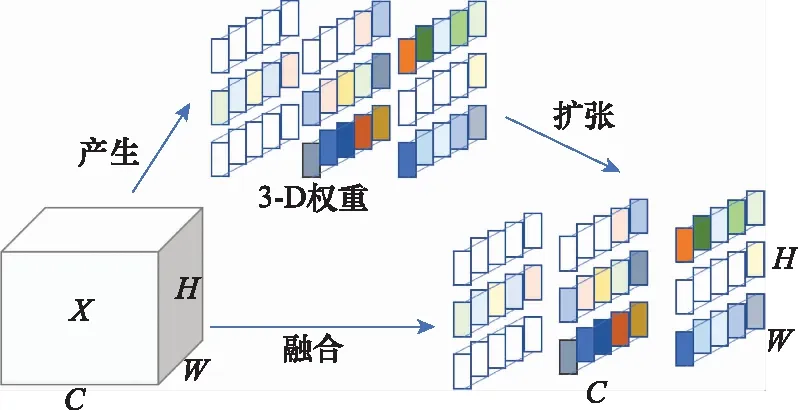

1.2.3 OIM模块

遥感图像舰船目标是任意方向的,组成DLASeg网络的普通线性卷积本身不具备旋转不变性,网络的旋转不变性仅来自于数据增强和多重池化操作,故网络应对旋转目标的检测能力较弱。为提高主干网络对于旋转目标的适应能力,本文引入OIM来缓解不一致性。该模型由主动旋转滤波器(active rotating filters, ARFs)和定向响应池化(oriented response pooling, ORPooling)模块组成。ARFs能够主动旋转生成方向和位置编码的特征图,使用ARFs模块的网络能够产生类内旋转不变深度特征。ARFs是一个k×k×n的filter,在生成特征图的卷积网络中会旋转N-1次。输入I的第i个方向输出为

(4)

(5)

最终得到旋转不变的特征图。此外,OIM只引入了一个卷积层和少量的参数,几乎不影响训练和推理的速度。

1.3 中心点及大小偏移量回归

(6)

高斯核函数f(x,y)将关键点(中心点)映射到特征图C∈R(W/s)×(H/s)×N。

在训练过程中,热力图上只有中心点是正样本,而所有其他点均为负样本,这可能导致正样本和负样本之间的巨大不平衡。为了缓解正负样本不平衡问题,使用focal loss对网络进行优化训练:

(7)

(8)

(9)

式中:Ock为预测中心点处偏移量;ck为中心点预测值;centerk/s-ck为中心点坐标偏移量;Sc k为回归舰船目标大小角度;Sk为原图目标的尺寸大小角度。

2 关键点舰船目标检测实验数据

2.1 数据集准备

HRSC2016是遥感图像中舰船目标变化范围和尺度较大的数据集,包含Google Earth 上6个著名港口的图像。分辨率从2 m到0.4 m不等,图像大小大部分为1 000像素×600像素。训练集、验证集和测试集分别为436张、181张和444张,包含1 207、514、1 228个舰船目标样本,含有3个级别任务(单类舰船目标的检测、4类舰船目标类别识别和19类舰船型号识别)。

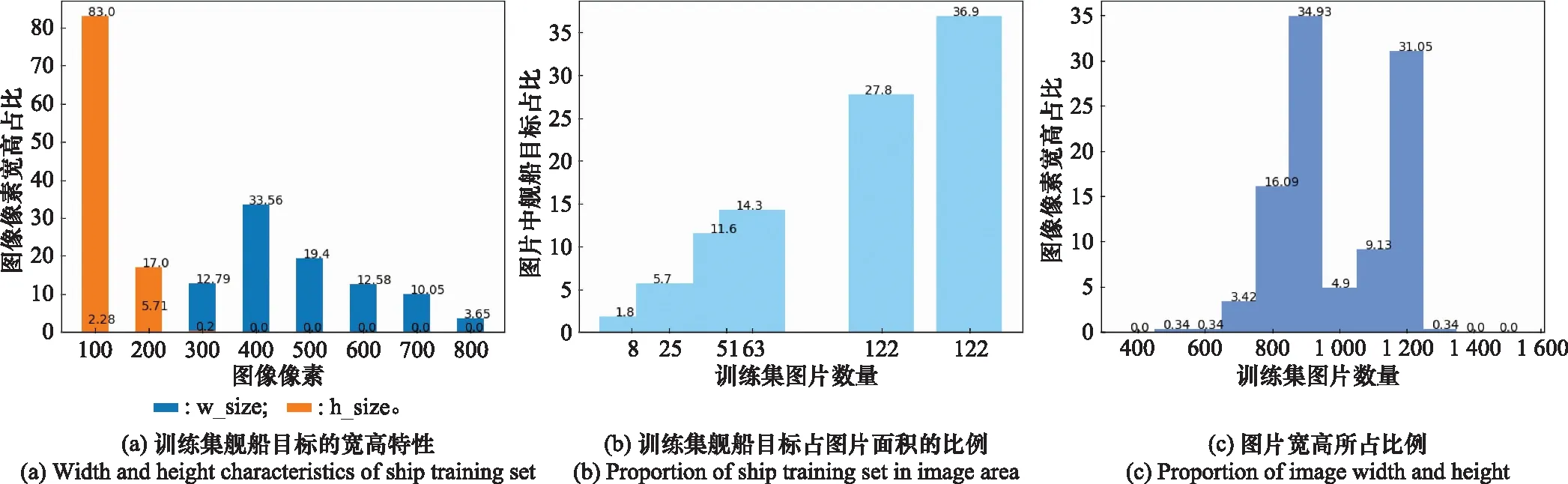

据统计,遥感图像舰船目标数据集HRSC2016图片中舰船目标变化尺度范围较大,图5(a)为训练集舰船目标的宽高特性,其中舰船目标高为300~400像素的占所有宽高的33.56%,目标宽的像素在100内占83%左右。图5(b)为训练集中舰船目标占图片面积的比例,有162张、122张图像中舰船目标面积分别占图片总面积的37%、28%左右,说明数据集中舰船目标相对较大。相比其他遥感数据集,HRSC2016数据集图片本身的大小也很小,图5(c)中图片宽或高像素在1 200~1 300的图片本身仅占训练集的0.34%,且舰船宽或高像素不超过1 400。

图5 HRSC2016数据集特性分析Fig.5 Analysis of HRSC2016 dataset characteristic

本文构建了一个新的遥感图像舰船目标数据集RFUE2021,主要由Google Earth港口图像、HRSC2016数据集部分图像以及FGSD2021数据集[23]部分图像共同组成,共10 296张数据集,其中训练集9 261张、测试集1 035张,数据集包含航母、黄蜂级、提康德罗加级、阿利·伯克级、佩里级、独立级、潜艇等20种类别,含有2个级别任务(单类舰船目标的检测和19类舰船型号识别)。图像大小的范围在200~8 000左右,利用Labelimg2标注舰船边框,标注信息有目标中心点坐标、宽、高以及弧度信息。本文使用RFUE2021数据集的单类舰船目标的检测任务,数据集部分样本如图6所示。

图6 RFUE2021数据集部分示例Fig.6 Partial sample of RFUE2021 dataset

2.2 标注方式

水平框标注如图7(a)所示,任意方向的船舶通常具有较大的长宽比和密集停泊,使用水平边界框的NMS算法容易产生漏检,因此使用水平边界框不适用于任意方向的船舶检测任务。为此,采用旋转边界框标注舰船,使用5元组(cx,cy,w,h,θ)参数化,其中(cx,cy)是旋转边界框中心的坐标,w,h是船舶的宽度和长度。如图7(b)所示,采用旋转框标注方式能够更好地贴合舰船目标边界,不会引入过多的背景噪声。

图7 任意方向舰船目标标注形式Fig.7 Different representations of arbitrary-oriented ship target

2.3 实验损失函数设置

本文设置的组合损失函数Lloss主要由中心点预测损失Lc,中心点处偏移损失Lco以及舰船目标宽高角度损失Lsize组成:

Lloss=Lc+λcoLco+λsizeLsize

(10)

参照CenterNet网络,设置中心点偏移损失权重λco=0.1,目标尺度损失权重λsize=0.1。

2.4 评价指标

本文采用遥感领域专用工具箱DOTA_devkit计算旋转IOU,进一步得到旋转框的mAP。DOTA_devkit工具箱包含大面积图像裁剪,检测结果可视化和结果测评等功能。评价模型好坏,首先需要计算准确率(precision)和召回率(recall):

(11)

(12)

式中:TP为检测正确的舰船数;FN为漏检的舰船数。

准确率和召回率是一对矛盾的度量,需要找到平衡点来度量模型好坏,对于二分类问题,F1度量是准确率和召回率的调和平均,即:

(13)

AP是准确率和召回率下的面积,AP综合考虑准确率和召回率的影响,反映模型对某个类别识别的好坏,取所有类别AP的平均值为mAP,衡量的是在所有类别上的平均好坏程度。

(14)

评价模型的检测速度指标为每秒帧数(frame per second, FPS)。FPS、F1度量、mAP值越大,表明检测速度和精度越高。F1度量的大小反应了模型的稳定性,数值越大越稳定。

3 关键点舰船目标检测实验结果

3.1 实验环境

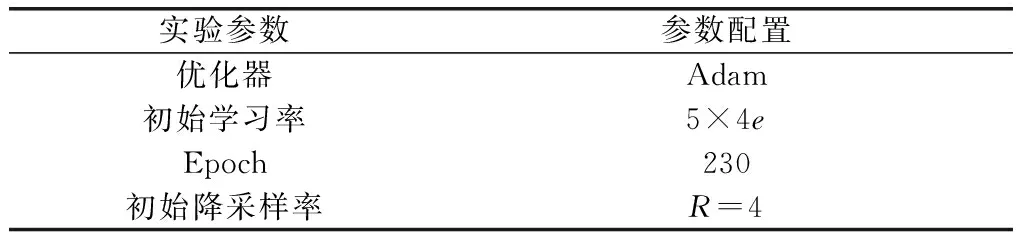

本文方法用Pytorch深度学习框架实现,硬件环境为Intel Core i7 CPU、GEFORCE RTX 2080Ti。输入图像大小调整为512像素×512像素,使用Adam方法作为优化器,在COCO数据集上测试的权重文件,迁移到本网络进行230epoch训练,学习率分别在第180epoch、第210epoch时下降为原来的十分之一。训练过程中使用随机旋转、随机翻转和颜色抖动来增强数据。使用IoU阈值为0.15的旋转非极大抑制来去除重复的检测,其他具体参数如表1所示。

表1 实验环境参数配置

3.2 关键点目标检测实验结果

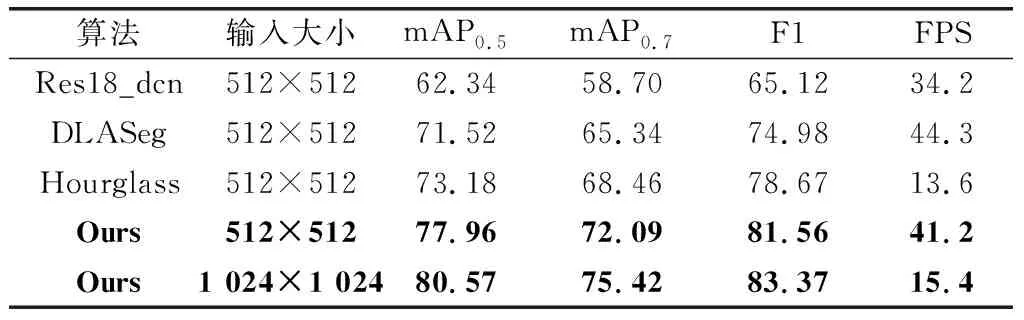

本文按照CenterNet网络设置,在Resnet、Resnet_dcn、DLASeg、Hourglass主干网络以及本文方法(Ours)(输入尺寸515×512)上进行实验验证,以便能更好地评估基于关键点的舰船目标检测算法。在RFUE2021数据集上具体实验结果如表2所示。

表2 实验环境参数配置

由表2可知,基于关键点的舰船目标检测方法在Res18_dcn、DLASeg、Hourglass以及Ours上验证的mAP分别为62.34%、71.52%、73.18%、77.96%,在经过多次训练后,发现使用Hourglass主干网络的精度达到了73.18%,但是由于Hourglass的参数量大、计算缓慢,检测速度仅为13.6FPS。本文为了兼顾检测速度和精度的平衡,选择DLASeg为主干网络进行改进,输入为512×512时本文方法(Ours)相比于其他网络,检测性能明显提高,更加关注目标信息,mAP分别提升了15.62%、6.44%,4.82%,检测速度也达到了41.2FPS。本文相继插入SimAM模块和OIM模块,检测速度相比简单的DLASeg略有降低,但仍能满足遥感图像舰船目标的实时检测。同时,本文方法(Ours)(输入尺寸515×512)的F1度量为81.56%,说明了方法的稳定性。

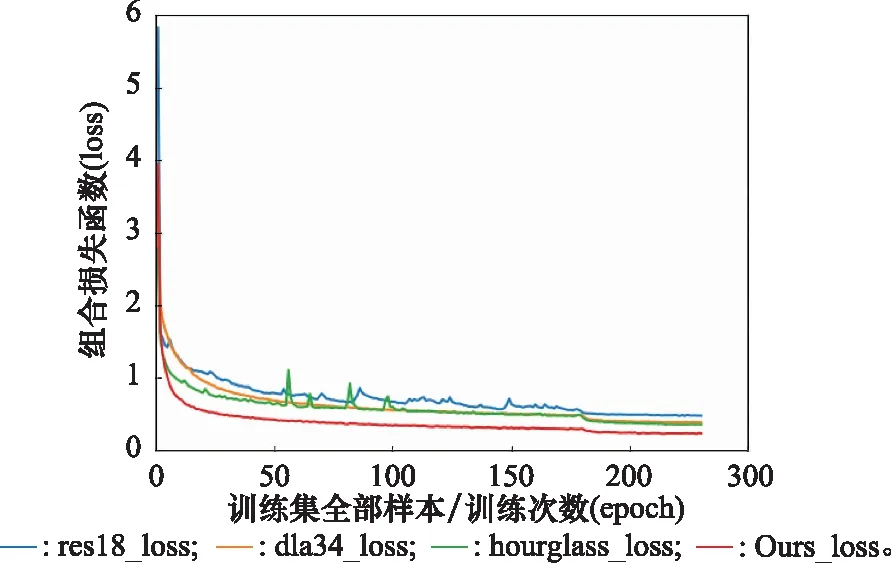

以上网络在本次实验中训练优化的损失函数曲线如图8所示。图中的loss值为组合损失函数Lloss值进行对比,Lloss值是由中心点预测损失、中心点处偏移及目标尺度角度损失,加上不同的权重得到的。实验共有230 epoch,在第180和210 epoch时分别降低了学习率,图8中在第180 epoch后所有网络的损失函数逐渐基于稳定。由于学习特征能力较弱,Res18_dcn 网络损失函数初始值较大; Hourglass相比DLA网络损失函数值更低,但是由于Hourglass参数量多,损失函数下降过程中略有小幅度的波动;Ours_loss损失函数值明显的低于其他网络,并且拟合过程平稳、收敛效果较好。

图8 舰船目标检测损失函数曲线图Fig.8 Loss function curve of ship target detection

图9是在RFUE2021数据集上采用Res18_dcn、DLASeg、Hourglass主干网络以及Ours方法对比得到的舰船目标实验结果图。其中,红色点为检测舰船目标的中心点。图9(a)中以Res18_dcn为主干网络的实验结果图,由于学习特征的能力较弱,导致部分舰船目标误检;图9(c)以Hourglass主干网络,网络结构多次pooling、upsampling操作,检测性能好,误检和漏检相对较少;考虑Hourglass网络的参数量多,在DLASeg结构上优化得到本文方法,检测结果如图9(d)所示,能够精准地定位中心点和目标框的位置,实现了舰船目标的有效检测。

图9 基于关键点的舰船目标检测结果图Fig.9 Result of key-point based method for ship target detection

3.3 对比其他检测方法实验结果

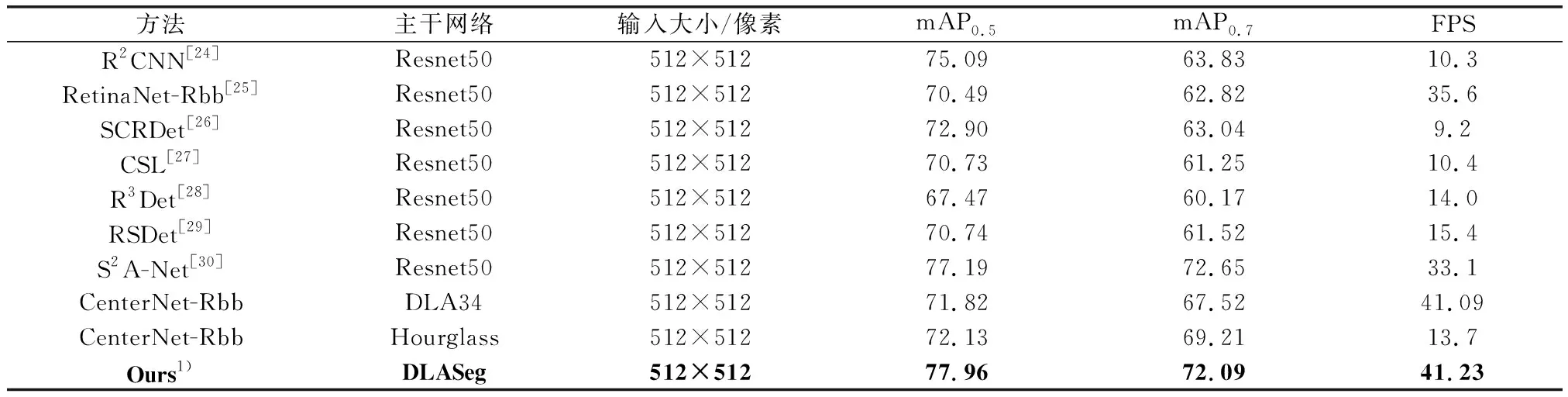

为了进一步验证本文方法的有效性,将本文方法与其他具有代表性的舰船目标检测算法R2CNN、RetinaNet-Rbb、RoI-Trans等在RFUE2021和HRSC2016数据集上分别进行对比实验。为了对比公平,使用DOTA数据集相同的默认参数设置,使用了相同的数据形变、扩充策略,并在实验中设置相同的epoch多次训练。在RFUE2021数据集上实验结果如表3所示。

表3 各种算法性能对比

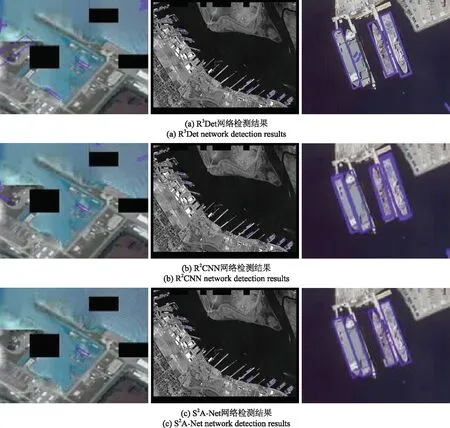

从表3可以看出,图像输入大小统一为512像素×512像素时,本文优化算法(Ours)检测精度达到77.96%,相比R2CNN、Retinanet-Rbb、SCRDet、CSL、DCL、R3Det、RSDet、S2A-Net、CenterNet-Rbb(DLA34)等其他经典算法,精度分别提升了2.87%、7.47%、5.06%、7.23%、7.62%、10.49%、7.22%、0.77%、6.14%。其中,S2A-Net将多层特征融合到有效的锚点采样中,提高对小目标的灵敏度,通过抑制噪声和突出物体特征,共同探索有监督的像素注意力网络和通道注意力网络,对小而杂乱的舰船目标检测良好,因此在RFUE2021数据集上检测精度为77.19%。在RFUE2021数据集上各种算法实验结果如图10所示。

图10(c)中,S2A-Net相比R3Det和R2CNN算法对杂乱的小舰船目标检测效果较好;图10(a)和图10(b)中R3Det、R2CNN检测会有部分目标漏检和误检,且R2CNN方法对舰船小目标较差。本文方法不受密集场景的影响,能够定位出中心点和目标框的精确位置,具有较好的鲁棒性。

为了进一步验证算法,在HRSC2016数据集上与其他舰船目标检测算法对比实验,检测结果如表4所示。

表4 HRSC2016数据集上实验结果

在HRSC2016数据集上对比不同舰船目标检测算法,ROI-Trans将水平感兴趣区域转换为旋转感兴趣区域,减少旋转锚框的设计,检测精度由R2CNN网络验证获取的73.1%提升至86.2%;RSDet引入4个角点坐标,避免角度参数引起的损失不连续性,检测精度达到了86.5%;本文方法与以上几种舰船目标检测算法对比,摆脱锚框设计,输入大小为1 024像素×1 024像素时,检测精度达到了86.7%,表现最佳。

3.4 消融实验

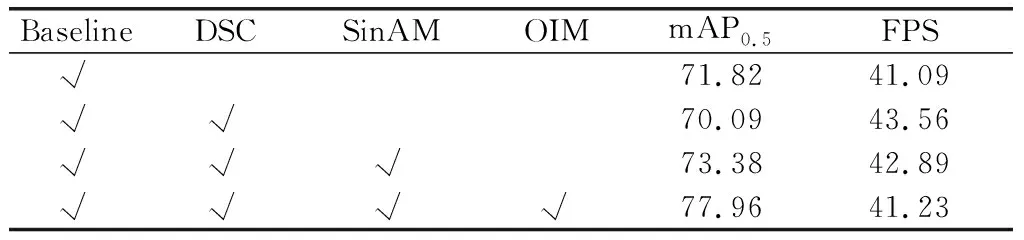

本文分别引入降低计算量的深度可分离卷积、增加目标关注度的SimAM无参注意力模块,以及生成方向不变特征图的OIM模型,来提升舰船目标检测精度,在RFUE2021数据集设计消融实验进行实验验证,实验结果如表5所示。

表5 消融实验结果

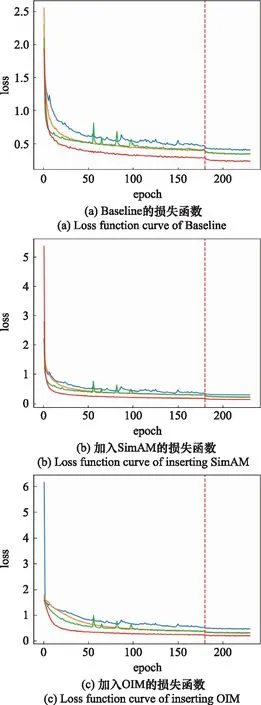

由表5可知,将普通卷积换成深度可分离卷积,降低了计算量,检测速度从41.09FPS提升至43.56FPS;SimAM注意力模块不引入额外参数,对计算速度几乎没有影响,增加了对舰船目标的关注度,提高了1.56%检测精度;当加入方向不变OIM模型时,舰船目标检测精度进一步提升,并且不影响检测速度,仍然可以较好的满足实时检测。消融实验训练过程损失函数曲线如图11所示。

本文的损失函数主要由中心点估计损失,中心点处偏移和目标宽高角度回归损失3部分组成。在图11(a)baseline中损失函数曲线波动较大。加入SimAM模块后,损失函数波动有所缓解,且略有下降。采用OIM模型进行训练时,损失函数曲线如图11(c),第180epoch时已经下降至0.5左右,且185epoch后波动缓和,曲线逐渐趋于稳定。图11(d)为本文算法损失曲线,拟合效果号,损失函数曲线逐渐趋于稳定,多次实验说明此网络检测性能好。

本文采用SimAM模块来增强对舰船目标的关注度,同时SimAM模块也不会引入额外参数,对检测速度不会造成影响。本文对SE、CBAM等注意力机制对比实验,说明SimAM模块的性能,实验结果如表6所示。

表6 引入不同注意力机制实验结果

由表6可知,SE以及CBAM注意力机制对网络检测性能都有所改善。SE机制关注通过之间的关系,学习不同通道特征的重要性,mAP达到了76.54%;CBAM机制在此基础上增加了空间注意力,融合了两种注意力机制,mAP达到了77.28%;本文采用SimAM模块构建了能量函数,避免过多结构调整,没有引入额外参数,在不影响检测速度的前提下增强模型对舰船目标的关注度。

4 结 论

针对目前遥感图像舰船目标检测方法大多为遍历锚框机制,导致参数量和计算量增大的问题;以及遥感图像中的舰船目标任意方向分布,但主干网络生成的特征不具备旋转不变性造成的不一致性,本文提出了基于关键点的遥感图像舰船目标检测方法,实现舰船目标中心点的检测,进而实现舰船目标的检测与识别。

(1) 首先对现有遥感图像舰船目标HRSC2016数据集中的舰船目标特性进行定量分析,针对部分舰船目标尺度过大,以及图像本身尺寸较小的问题,本文构建了RFUE2021数据集,为了验证本文方法的有效性,在设置相同参数下分别在以上两种数据集上实验验证。

(2) 针对现有遥感图像舰船目标检测方法大多是锚框遍历机制,本文提出利用一种端到端的anchor free检测方法,提前设置锚框需要考虑到锚框的大小、比例以及数量等信息,会增大参数量,降低检测速度。受CenterNet网络启发,以及遥感图像舰船目标任意方向密集排列,但舰船目标中心点不变的特点,直接预测目标的中心点,再回归得到每个中心点处目标的偏移、尺度和角度,从而实现舰船目标的检测。

(3) 舰船目标是以任意方向分布的,但直接利用Resnet、DLA、Hourglass等网络生成的特征不具备旋转不变性,为了缓解这种不一致性,引入一种方向不变模型OIM生成方向不变特征图。

(4) 为提升网络的计算速度,将部分普通卷积转换为深度可分离卷积;为进一步增强对舰船目标的关注度、提高目标检测精度,引入SimAM注意力机制,没有产生额外参数,对检测速度也没有造成影响,最终本文方法兼顾了目标检测的速度和精度。

未来将进一步优化检测算法,针对特定场景如云雾遮挡、港口复杂背景等情况,改进算法,提升检测速度和精度。