VR全景视频运动区域目标精准跟踪

2022-08-16蔡小爱张海民

蔡小爱,张海民

(1.宣城职业技术学院,安徽 宣城 242000;2.安徽信息工程学院,安徽 芜湖 241000)

随着虚拟现实和视景仿真技术的发展,采用虚拟视景仿真技术进行VR全景视频运动区域重构,在全景视频环境下进行VR全景视频运动区域目标的跟踪识别,提高VR全景视频运动区域目标的准确检测和视觉信息跟踪识别能力,研究VR全景视频运动区域的跟踪方法在视频成像和目标识别中具有重要意义,在进行全景视频运动区域目标跟踪研究中,受到目标自身的随机性和环境扰动性等因素的影响[1],导致全景视频运动区域目标的跟踪能力不好,需要结合视觉融合和图像优化处理技术,提高全景视频运动区域目标的跟踪识别能力,相关的全景视频运动区域目标跟踪方法研究受到人们的极大关注[2].本文提出基于VR技术的全景视频运动区域目标精准跟踪方法.建立全景视频运动区域目标的虚拟成像模型,采用时频特征提取和多元信息跟踪融合方法进行全景视频运动区域目标图像的特征提取和像素跟踪识别,实现对目标图像的优化特征分离,结合多尺度小波分解方法进行全景视频运动区域目标图像的特征分解,提高目标跟踪能力,最后进行仿真测试分析,得出有效性结论.

1 全景视频运动区域目标成像及预处理

1.1 全景视频运动区域目标成像

EFA(θ*,ρ*)=(θe,ρe)

(1)

设h为全景视频运动区域目标图像的边缘像素集,设定基准线为(θe,ρe),在成像区域,以全景视频运动区域目标图像的灰度特征量为x轴,进行全景视频运动区域目标图像的特征重构[5],得到全景视频运动区域目标图像的灰度特征(EX,EY,EZ)重组输出为:

(2)

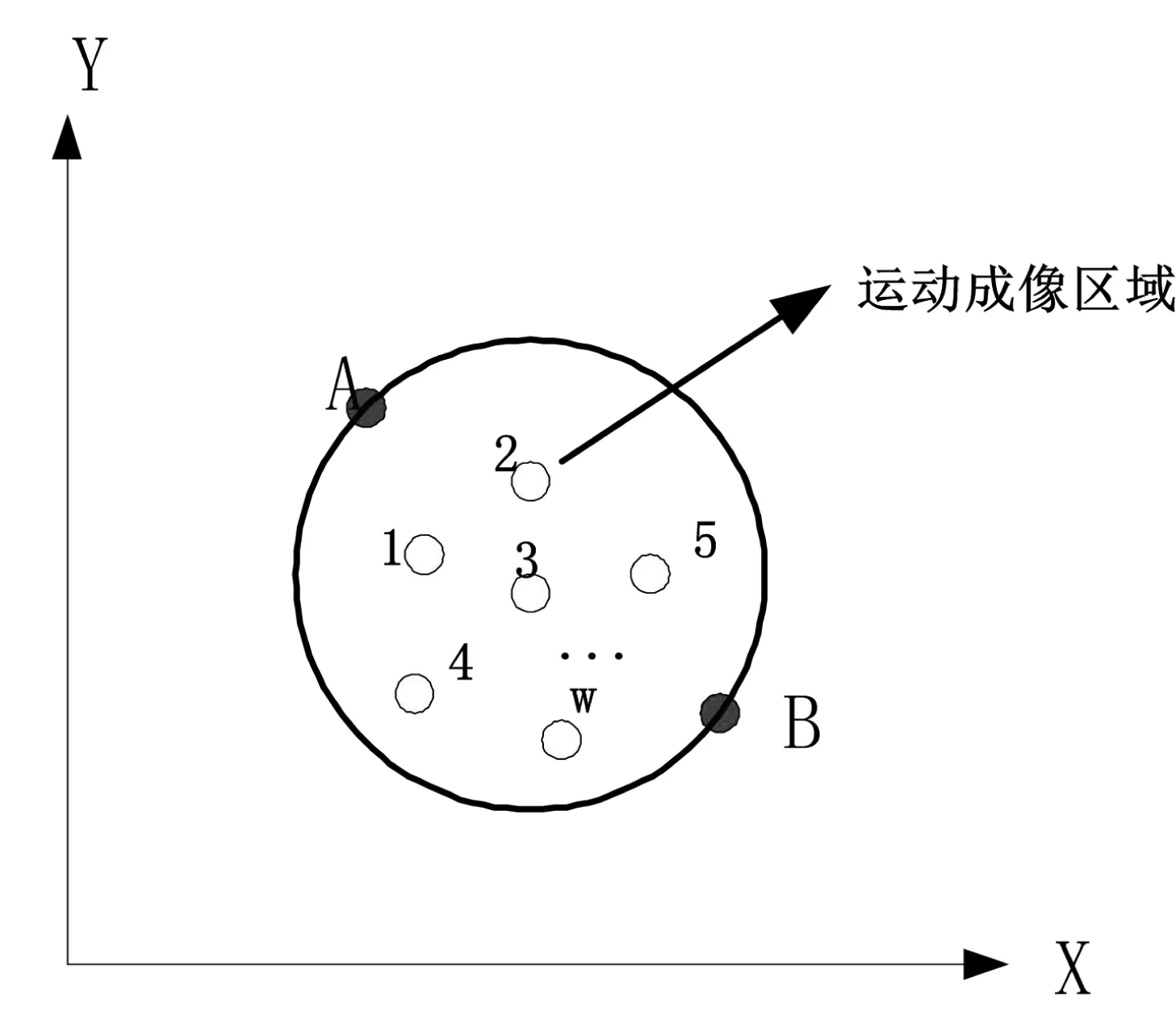

根据上述分析,以ρe-R为位移单位进行x轴方向平移,建立全景视频运动区域目标成像模型,全景视频运动区域目标图像的三维流形分布如图1所示.

1.2 全景视频运动区域目标成像特征分析

图1 全景视频运动区域目标图像的三维流形

建立全景视频运动区域目标的虚拟成像模型,提取全景视频运动区域目标成像的边缘轮廓特征值[6],构建VR全景视频运动区域分布二维张量可以用一个2×2的矩阵表示:

(3)

s≤t⟹κs(A)≤κt(A)

(4)

(5)

(6)

式中,κ(A)为目标图像分块融合模型.

考虑VR全景视频运动目标区域的灰度图像f,对任意像素(x,y),采用模糊信息融合的方法,建立VR全景视频运动成像的拓扑结构为:

(7)

(8)

对任意像素的视频运动区域目标图像(x,y)∈E,令灰度特征值为A(x,y)={T(s,t)|(s,t)∈B(x,y)},根据分块融合结果,进行视频运动区域目标图像的特征提取和目标跟踪识别[8].

2 全景视频运动区域目标精准跟踪

2.1 目标特征提取

在上述建立全景视频运动区域目标的虚拟成像模型的基础上,进行目标跟踪算法的优化设计,本文提出基于VR技术的全景视频运动区域目标精准跟踪方法,提取全景视频运动区域目标成像的边缘轮廓特征值,采用角点跟踪检测方法进行全景视频运动区域融合处理和图像像素融合,对于图像的Harris角点f,结合分块检测的方法,得到目标像素集为(x,y),采用差分信息融合的方法,建立图像的目标特征匹配模型,得到灰度邻域为B(x,y),对图像进行自适应加权融合,提取全景视频运动区域关联信息,得到全序列目标融合的特征量GD为:

(9)

I(x,y)表示全景视频运动区域图像在(x,y)处的灰度值,L(x,y,σ)表示高斯尺度,对全景视频运动区域的向量量化编码和融合处理[9],得到量化编码集g(w,θ)为:

(10)

其中,θj=jπ/J,j={0,1,...,J-1}为全景视频运动区域成像的关联规则特征集,对全景视频运动区域中的色度信息进行自适应融合,得到图像的信息熵表示为:

(11)

采用灰度窗口匹配方法,建立全景视频运动区域图像特征分割模型,得到图像融合特征:

(12)

设特征集F(x,y)∈{g(x,y)-1,g(x,y),g(x,y)+1},采用时频跟踪融合方法进行全景视频运动区域目标图像的像素特征分离,提高运动目标区域精准跟踪和识别能力.

2.2 目标跟踪输出

提取全景视频运动区域目标的关联特征量,采用时频跟踪融合方法进行全景视频运动区域目标区域融合,建立全景视频运动区域图像融合的关联算子,得到输出的关联在特征集定义如下:

(13)

(14)

考虑论域E上的全景视频运动区域图像的关联映射F:E→R3,设T:E→PDS(2)为统计特征集,得到全景视频运动区域图像高维尺度分割的张量模型为(S,I),图像的全序重构输出为:

Ai≤(S,I)Aj⟺h(S,I)(Ai)≤h(S,I)(Aj)

(15)

h(S,I)(A)=K(S,A)-K(I,A)

(16)

采用形态学算法进行全景视频运动区域图像的梯度分解,得到梯度模型,在边缘像素集中,进行全景视频运动区域图像重建,得到归一化重建系数SP为:

(17)

根据上述分析,提取全景视频运动区域图像的VR视景特征量,在虚拟视景仿真模型中实现全景视频运动区域目标的精准跟踪和识别,得到优化识别输出为:A(x,y)={T(s,t)|(s,t)∈B(x,y)},通过自适应特征匹配方法,实现在虚拟视景仿真模型中实现全景视频运动区域目标的精准跟踪[10].

3 仿真实验与结果分析

图2 不同帧下的运动区域目标跟踪结果

分析上述仿真结果得知,采用所提方法能有效实现对全景视频下的运动区域目标精准跟踪,视频跟踪的精度较高,特征分辨能力较好.测试跟踪精度,得到对比结果如图3所示.

图3 跟踪精度对比测试

分析图3得知,所提方法进行全景视频运动区域目标跟踪的精度较高.

4 结 语

提出基于VR技术的全景视频运动区域目标精准跟踪方法.提取全景视频运动区域目标成像的边缘轮廓特征值,建立VR全景视频运动区域融合模型,结合近邻点像素序列重排方法进行VR全景视频运动特征重组,采用自适应加权方法进行图像的加权融合,结合分块检测的方法建立图像的目标特征匹配模型,提取全景视频运动区域关联信息,在虚拟视景仿真模型中实现全景视频运动区域目标的精准跟踪和识别.分析得知,本方法进行全景视频运动区域目标精准跟踪的精度较高,分辨能力较好.