深度学习的人工智能应用处理系统设计研究

2022-05-28安婷郭辉

安 婷 郭 辉

(山西晋中理工学院,晋中 030600)

建立和模拟人脑进行分析学习的神经网络即深度学习。该方法是机器学习研究中的创新技术,通过模仿人脑机制读取和分析数据。人工智能的机器学习方法是在深度学习背景基础上可与之相媲美的方法,在实现图像、声音和文本识别及机器翻译的智能化方向上大力迈进。下面针对深度学习的人工智能应用处理系统进行相关设计。

1 设计目的

基于神经网络、深度学习等的设计,可通过融合生物学、数学和电子信息等技术,以发挥其在应用领域的成效。三次工业革命后,基于深度学习的人工智能应用处理系统设计对生产结构和生产关系产生了颠覆性改变。

2 设计构建要诀

2.1 人工神经网络之仿生人脑

通过深度学习以获得算法并赋予电子元件(如CPU),最终在电子元件与传感器、输入设备链接及其模拟人脑的树突、细胞体、轴突等人脑神经元(神经细胞)中,实现对相关信息的有效处理,并经由内部信息处理和输出结果等神经元刺激,在各电子元件、传感器、输入设备、链接以外的神经网络中获得有效的帮助。由此组成的关系网络识别层面,更好地融合了神经网络的效应,在图像物体识别和解释问题层面获得了良好效果。深度思维团队测验了该神经网络的变量关系问题,与多数人工智能(Artificial Intelligence,AI)算式相比,在推理问题方面的表现尤为出色。如图1所示,人工智能神经网络可以像人类一样推理。

图1 人工智能神经网络人脑仿生图

2.2 深度学习开展环节对学习的仿生

21世纪,人工智能以人脑对外界刺激的识别,更能发挥其抽象和迭代效应。对比单个神经网络,基于多个神经元的信息输入/输出“层次”均归属同一层级,通过使用浅层神经网络实现对信息管理和数据的挖掘。深度信念网络(Deep Belief Network,DBN)的提出,实现了人脑多层神经网络信息处理、分析和学习模拟。深度学习在深层神经网络上开展,多层级数量囊括输入层、中间层和输出层等。例如,微信中有超过上百亿条消息,包括图片、链接及数据等,后台数据分析、广告匹配采用了人工智能技术后端服务。

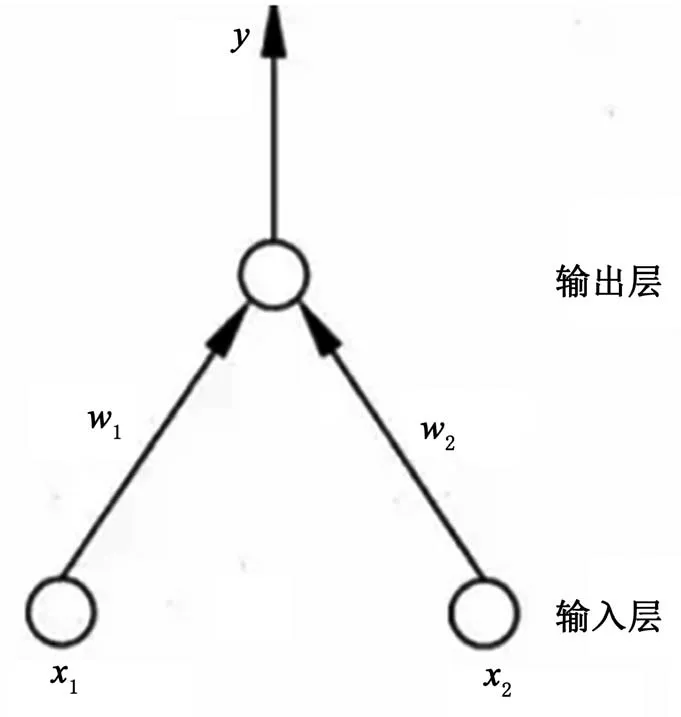

基于人脑设计的深层神经网络处理中,深度展开多层级人工神经网络。在信息判定上,借助不断优化输入信息权重方法,使得判断效果整体上更准确。输入层接收外界输入信号后传递给输出层,输出层是M-P神经元,感知机能轻松实现逻辑与或非的运算(与或非实际上是线性可分问题,存在一个超平面将其分开)。其中,感知机和多层网络结构如图2所示。

图2 感知机和多层网络结构

图像识别、声音识别或AlphaGo围棋学习中,更注重学习过程和算法。多智能、会学习的机器,在实现对字符、人脸、地标等进行几乎精确的识别中应用预测价值更高。该学习作为深度学习的新浪潮,打造了人工智能新的里程碑,在其他方面具有突出的应用功效。

基于深度学习的图像识别原理,对遴选的样本进行数据标注,并为后续数据建模服务提供数据标注依据。在数据标注细节上,通过一定量的已标注数据,在深度学习的大脑中建立模型。模型建成后,一旦再次遇到相似的图像,深度学习就能根据图片的一般情况做好相关模型相似度的对比。在建立模型的过程中,以海量大数据为基础,对其进行精准控制。

2.3 人工智能应用处理系统设计

人工智能技术对电气设备的优化设计,顺利优化了更多、更复杂的计算及模拟,并在传统手工设计向计算机辅助设计转型发展的新时期,获得了更精准、更快速、更迅捷的体验,也能在产品效率、成本控制方面满足电气设备运行设计要求,使得基于深度学习的人工智能技术兼顾经济效益和社会效益。

以电气设备优化设计为例,计算机辅助设计可提高对电气设备设计涉及的电机电器、电磁场、电路等技术手段的效率和质量。永磁直流电动机设计采用等效磁路法,将电机空间内存在的不均匀分布的磁场转化成等效的多段磁路,并近似认为在每段磁路中磁通沿截面和长度均匀分布,将磁场的计算转化为磁路计算,然后用各种系数进行修正,使各段磁路的磁位差等于磁场中对应点之间的磁位差。通过积累一定的经验,取得各种实际的修正系数后,计算精度可以满足工程实际的需要,然后初步确定磁路结构,酌情选择表贴凸出式转子磁路结构和表贴插入式转子磁路结构。

电气设备故障诊断中和电气设备智能控制中,涵盖神经网络控制专家、系统控制及模糊控制。学习内容上,自编码器、卷积神经网络(Convolutional Neural Networks,CNN)、循环神经网络(Recurrent Neural Network,RNN)、DBN都涉及很多技术细节,同时模型复杂程度从原来的线性堆叠变成了可以任意堆叠。

深度学习可借助数据中心、台式电脑、笔记本电脑以及云端等,为世界上速度超快的超级计算机深度学习奠定了基础。GPU加速数据中心可凭借更少的服务器提供突破性性能,以降低成本。在维护操作安全方面,数据存储、处理和分析敏感数据更精准。云计算通过实现数据中心的大众化和转变企业的运作方式,已经成为各行各业实现变革的关键。还可利用全球各大云服务提供商,使用NVIDIA GPU,在存储于云端的数据中获取有用的信息。

2.4 应用可行性分析

人工智能应用处理系统可借助视听觉、味触觉、平衡感及存储器等,赋予学习者多样化选择,寻求一种合乎逻辑的推测、预演和推演,设计智能生命模型,即获取外界信息感知系统、选择性存储信息的信息处理系统、表达感知的反馈系统(语言反馈、肢体动作反馈……)、清除记忆的遗忘系统、对记忆系统数据进行归纳和总结系统。

3 研究综述

基于树莓派平台,借助Intel的视频处理器(Video Processing Unit,VPU)低功耗加速模块,设计并实现了基于残差特征提取模块CNN模型的实时人脸检测系统。对比单纯使用树莓派中央处理器(Central Processing Unit,CPU)进行计算,文中方法在视频流中检测人脸和人脸关键点提取的实验中分别实现了18.62倍和17.46倍的加速,使得在便携式设备中实现快速、实时、在线的人脸检测和特征点提取成为现实,同时为使用便携式、低功耗设备运行深度学习算法提供了一种可行的方案[1]。在复合地形下的长期演进(Long Term Evolution,LTE)网络数据和其他典型数据集下,与传统的经验模型和现有的智能无线传播模型相比,所提模型对各种传播场景均具有适用性,且进一步减小了路径损耗的预测误差。借鉴经验模型,利用一些修正项,使用频率覆盖范围为1 500~2 000 MHz,得到COST231-Hata模型。与Okumura-Hata模型一样,COST231-Hata模型以Okumura等人的测试结果为依据,通过对较高频段的Okumura传播曲线进行分析求解,在频段f(1 500~2 000 MHz)、基站天线有效高度hb为30~200 m、移动台天线高度hm为1~10 m、通信距离为1~20 km等参数设定上取得了显著效果。智能无线传播模型进行重新训练,并部署该智能无线传播模型,以预测该区域的路径损耗[2]。一种使用Ray框架来处理自动驾驶任务的远程分布式计算系统设计方案,克服单一计算平台的算力限制,为更高级别的自动驾驶提供支持。应用设计后,它可大幅减少自动驾驶任务的处理时间,提高系统吞吐量,保证自动驾驶任务的实时性[3]。利用PYNQ-Z2的处理系统(Processing System, PS)和可编程逻辑(Progarmmable Logic,PL)交互式数据传输处理效应,尽可能发挥ARM(Advanced RISC Machines)和现场可编程逻辑门阵列(Field-Programmable Gate Array,FPGA)的优势,从而实时进行人脸检测。搭建Linux环境并运行Jupyter Notebook交互式在线编译器,调用IPython内核和PYNQ的硬件库,导入OpenCV库编写并且编译执行Python程序,可实现在线控制PYNQ-Z2来获得视频流输入并对视频数据进行传输和处理,从而实现人脸图像的分析与检测[4]。基于ROS下的gmapping和move_base等算法,实现巡检机器人自动建图及自主导航功能,设计并实现了ROS系统和Node.js之间的通信架构,并基于Vue.js前端框架进行Web监控系统的设计开发,能够实时查看巡检机器人的检测目标,获取环境信息,并远程控制巡检机器人的移动[5]。

4 结语

深度学习的训练和推理均依赖于图形处理器(Graphics Processing Unit,GPU)加速,而NVIDIA能够在任何平台带来所需的强劲加速性能。无论是图像识别还是自然语言处理,性能和效率对于深度学习推理而言都至关重要。在维护操作安全性的同时,它可存储、处理和分析敏感数据。