天津理工大学聋人工学院 丰富手语资料库 参与冬奥现场直播

2022-03-03撰文潘丽娅

撰文/潘丽娅

2022年2月4日,随着北京冬奥会精彩开幕,央视新闻AI手语主播也正式“上岗”。在北京冬奥会比赛过程中,这位“特殊”的主播用流畅、连贯、准确的手语,为听障人士解说了一场场精彩的赛事。而为这位AI手语主播搭建手语资料库的,是天津理工大学聋人工学院无障碍智能科技研发团队的师生们。

从6年前开始,天津理工大学聋人工学院就开始了手语资料库的研发和积累,希望以此帮助听障人士更好地融入社会,与健听人进行交流沟通。目前,手语资料库已累积20 多万条语料,可以实时把手语动作转化为文字。无障碍智能科技研发团队负责人、天津理工大学聋人工学院副院长袁甜甜教授介绍说,就像现在成熟的语音翻译软件一样,我们这套系统能将输入的手语动作和表情,经由计算机视觉技术识别后翻译成文字或语音,帮助聋人实现其信息向听者方面传输,“这样既能提高沟通效率,也让沟通体现人文关怀。有了双向实时翻译,这个项目才算真正落地。”2021年11月,手语翻译系统语料库被北京冬奥会转播媒体选中,要嵌入到大会的AI 手语主播系统中。

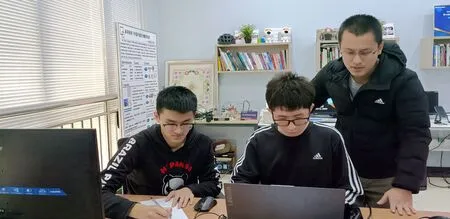

对于研发团队来说,尽管手语资料库已经有了20 多万条语料,但针对体育与新闻方面的专业语料,他们几乎没有积累。现有的手语资料库服务人群是听障学生,而冬奥会期间要面向大众,同时,还要完善与体育和新闻相关的一些专业语料。那么,怎样在短时间内为AI 手语主播系统输入专业词汇、完成手语表达,这是摆在研发团队面前的一道难题。手语是听障人士的语言,语序和健听人的语序不一样。因此,断句、逻辑,方方面面都需要调整。而且手语的表达方式丰富,要“说”出一个意思完整的句子,除了手势,也要配合相应的表情甚至肢体动作。所以,想让AI手语主播系统成为合格的手语翻译,需要把手势、表情、大肢体动作从视频转化为数据,再“教”给计算机学习。此外,为了让AI 手语主播在新闻场景下的手语实时生成能跟上新闻播报的速度,研发团队还要“教”计算机“学会”自己提取主干信息,同时完善与体育、新闻相关的专业语料,并按照听障人士的语言顺序不断调整手语速度、停顿间隙等,让手语含义得到准确表达。为了保证进度,天津理工大学调动300 名师生,负责收集手语语料,撰写符合自然手语语法、语序的句子,还要完成近三年新闻视频的转写。连续三个月,研发团队每天都要工作10 个小时以上,一段时长50 分钟左右的视频,学生最初需要花上6—7 个小时来转写。

“能为北京冬奥会服务,我们感到很光荣、很自豪。”袁甜甜说,研发团队已对百万级日常使用的对译文本、10万级冬奥会专有对译文本及冬奥会专有手语动作进行了多轮打磨,努力为AI手语主播提供尽可能丰富的语料支撑,使其能为听障人士提供专业、准确的手语解说。“此次北京冬奥会,是实现手语识别落地的第一步,我们致力于实现手语识别项目在多个场景下的落地,助力听障人群和健听人群无障碍交流,并将这项技术推广到环境感知、微表情分析等众多领域。”袁甜甜说。