智能环境下的人脸视频深度伪造与防御技术

2022-01-26中国科学技术大学网络空间安全学院周文柏俞能海张卫明赵汉卿刘泓谷韦天一

◎中国科学技术大学网络空间安全学院 周文柏 俞能海 张卫明 赵汉卿 刘泓谷 韦天一

一、引言

当前世界大国将网络空间视为“影响塑造对手行为”和“为对手创造即时困境”的持续对抗空间。在军事领域,物理域、信息域和舆论、心理、决策、民心等认知域融合在一起,形成了“多域作战”态势,构成了远超传统对抗的严峻安全挑战。在此背景下,结合人工智能的多媒体智能生成技术在认知域对抗、社会安全和政治安全方面展现了强大作用和潜力,成为了各大国为争夺网络空间主导权所重点关注的技术。

这其中最有影响的是以视频换脸为代表的深度伪造(DeepFake)技术(见图1 示例)。尤其是针对国家政要、商界名流、公众人物的深度伪造人脸视频数据在境内外社交软件和内容分享平台中快速散播,引起社会舆论广泛关注。深度伪造技术可用于误导舆情,或修改政治人物的讲话影响国家的政治、外交。因而美国发布的《2019年全球威胁评估》指出:“深度伪造已对美国国家安全造成严重威胁”。

图1 Deepfake换脸效果展示

2017年12月,一位名为“Deepfakes”的用户在全球流量排名第四的国际互联网社区“Reddit”上发布了一段好莱坞女星盖尔·加朵的伪造人脸视频,掀起了一阵轰动,这一事件作为开端,标志着人脸深度伪造技术的兴起,而该用户的用户名也被引用成为了这一类技术的代名词“Deepfake”。人脸的深度伪造主要针对成对的人脸进行,它可以将目标视频人物的脸替换成指定的原始视频人脸,或让目标人脸重演、模仿原始人脸的动作、表情等,从而制作出目标人脸的伪造视频。近年来,人脸深度伪造技术在深度学习技术的推动下取得了快速发展,自动编码器、生成对抗网络等深度学习中的生成模型均被应用到了该项技术中,实现了人脸的高真实度生成与替换。深度学习技术的普适性以及高度的开源性使得Deepfake相关技术只需要利用少量的原始人物与目标人物肖像便可以完成换脸过程,这带来了很多换脸技术在娱乐中的应用,如2019年非常流行的“ZAO APP”和最近新上线的“去演APP”,用户可以用自己的脸去替换部分影视剧片段中演员的脸,虚拟的体验一把“当明星”的感觉,此外,“抖音”、“Avatarify”等知名的社交软件也提供了换脸相关的新功能,用户可以用自己的表情去驱动一些著名人物的静态肖像,让他们做出跟自己一致的表情,使静态名人“活化”。

然而,人脸深度伪造技术在为人们带来娱乐性的同时也带来了巨大的安全威胁。由于深度学习的技术门槛相对较低,很多开源技术可以直接利用,因此一些不法分子能够轻易未经许可地伪造特定人物的假视频并恶意使用,如将女明星的脸换到成人电影中,对当事人造成隐私和名誉的侵害,或操纵特定人物肖像发布虚假信息,误导舆论,侵蚀社会信任度,甚至能够将换脸技术用于国家政要,发布涉及国防外交的虚假视频,导致严重的政治危机。因此对伪造人脸视频的检测鉴别至关重要。为了减轻人脸深度伪造技术带来的危害,学术界和工业界都展开了对人脸伪造视频检测技术的深入探索,并提出了涵盖空域、时域、频域等多种维度的检测方法,并在特定数据集上取得了一定成功。此外,Facebook(脸书)公司也联合MicroSoft(微软)等知名企业与高校,在著名竞赛平台Kaggle上发布了迄今为止人脸伪造检测领域规模最大、影响力最高,也是Kaggle 竞赛平台有史以来奖金最丰厚的人脸伪造检测挑战赛(Deepfake Detection Challenge,DFDC),吸引了全球超过2200 支队伍参赛,以期推动检测技术的发展。其中,中国科学技术大学网络空间安全学院人工智能与安全团队在该项比赛中击败了如MIT(麻省理工)、NVIDIA(英伟达)、清华、阿里等知名校企,取得了全球第二,获30 万美元奖金,这也是国内最好成绩。该项比赛成果被中国信通院在2020年《人工智能安全框架》中评选为2014年以来中国在人工智能安全领域的8 项代表性成果之一。

尽管众多学者在人脸深度伪造检测领域做出了不小的努力,但由于高质量数据集缺乏、评价机制不统一、实验环境与真实场景数据失配情况严重等问题,导致相关检测技术的实用性受到极大制约,Facebook 官方也在DFDC 比赛后宣称:“人脸深度伪造检测的问题仍尚未得到解决”。

事实上,尽管目前人脸深度伪造所带来的负面影响远大于积极效应,但人脸深度伪造技术本身却依旧值得研究。现有的人脸深度伪造技术在生成质量的真实感和自然度上仍有可以提升的空间,且伪造技术的进步将带来数据集质量的大幅提升,从而进一步推动检测技术的发展。

二、“换脸”技术发展史

对于人脸的相关研究已经有数十年的历史,“换脸”技术也是计算机视觉和计算机图形学领域的一项经典任务,但以“Deepfake”为代表的深度换脸技术首次将深度学习技术应用到了换脸任务中,将这一传统任务变得智能化和高度真实化,形成了巨大的轰动效应。在“换脸”的发展历程中,主要有三类技术代表,即以“人脸变换(Face Morphing)”为代表的经典换脸技术、以“计算机图形学技术(Computer Graphics,CG)”为代表的高真实度换脸技术,以及以“生成模型(Generative model)”为核心的智能化换脸技术。这三类技术的发展阶段不同,也具有不同的特点和适用场景。其中,以深度生成模型为核心的智能技术,成为了当前各行业关注的主流技术。

深度生成模型是以Deepfake 为代表的人脸视频深度伪造技术的核心。深度生成模型可以简单描述成一个使用深度神经网络进行数据生成的模型,属于一种概率模型。使用生成模型可以生成出不包含在训练数据集中的新数据。目前深度学习主要包含两大类生成模型:自编码器(AutoEncoder,AE)和生成对抗网络(Generative Adversarial Network,GAN)。

其中,GAN 模型的训练包含了对抗博弈的过程,这个过程同时训练了两个模型:捕捉数据分布的生成器G 以及判别器D,D 用于评估输入的样本来源于真实数据分布还是生成数据分布。GAN 模型可以类比为一个造假团队,其中生成器生产假钞并在未经侦测的情况下使用,而判别器类似于警察,从真实数据中找出并区分这些假钞。整个博弈过程如同一场竞赛,迫使生成器与判别器的博弈对抗中不断提升双方性能,取得良好的视觉质量,直至真假数据无法被分辨。部分由最先进的生成模型StyleGAN。生成的人脸如图2所示,其生成的效果非常逼真,已经达到了人眼难以区分真假的程度。

图2 StyleGAN模型生成的人脸示例

生成模型为人脸深度伪造奠定了技术基础,随着生成技术的不断完善,人脸伪造过程中所产生的假脸质量也在不断提升,这为人脸深度伪造的快速发展奠定了良好的基础。但这类生成技术也存在明显的缺点,由于其概率模型的特性,人脸的生成过程往往存在一定随机性,导致人脸伪造的过程不可控,且这类生成模型在生成连续视频帧时较难保持帧间一致性,从而使得合成的人脸视频存在较大的抖动,最终的伪造效果仍有待进一步提升。

综上所述,“换脸”技术的发展,实际上是学术化与工业化不断碰撞、螺旋上升的过程,经典的CG 技术尽管能够取得高度的真实性,但其代价巨大且技术通常用于盈利,并不开源。而以Deepfake 为代表的人脸深度伪造技术的实现门槛与代价都较低,但实际的效果仍有待提升。现阶段,深度学习技术已经被部分应用于电影工业中的CG 特效,在未来,人脸的合成也将继续沿着这个方向发展,通过深度学习技术与部分CG 技术的有机结合,在实现人脸伪造效果提升的同时也保持较低的技术门槛与高程度的开放性。

三、人脸视频深度伪造技术

(一)基于图像域特征编码的方法

现阶段,全智能化的人脸深度伪造技术发展并不完备,其中主流的伪造技术主要从人脸图像域的角度出发,通过对人脸图像进行特征编码、重构的操作方式实现篡改,篡改类型可以概括为面部替换和属性编辑两大类。其中面部替换旨在用原始人脸面部替换目标人脸的面部区域,涉及目标图像身份属性的变化。而属性编辑主要针对目标人脸身份信息外的各类属性进行编辑篡改,如使用表情迁移、唇形篡改等。

面部替换的经典算法是“Deepfakes”,主体结构基于自动编码器实现。对于原始人脸A 和目标人脸B,训练权值共享的编码器用于编码人脸特征,解码端A 和B 各自训练独立解码器用于重构人脸。在测试阶段,用训好的编码器对目标B 进行编码,再用训好的A 解码器来解码B 的特征,以实现A 与B 之间的人脸替换。为了达到更好的替换效果和更佳的可操控性,对抗损失和人脸解耦重构等技术也被用于深伪算法进行约束与监督,并产生了很多变体方法,如FSGAN、FaceShifter 等,使得生成的伪造人脸质量大幅提高。属性编辑算法的基本原理与面部替换类似,但该类算法以人脸属性为对象进行篡改,不涉及到目标人物身份信息的改变,通常用来进行人脸的表情迁移、唇形篡改等应用。代表算法包括早期的表情迁移方法Face2Face、特定人唇形篡改方法ObamaNet 近期应用火热的表情迁移方法First Order Motion 以及唇形篡改方法Wave2Lip等。

人脸深度伪造作为一项应用技术,可用于电影行业或一般的大众娱乐领域,此外也可作为技术反制手段,用于针对特殊政治、公众人物的人脸视频塑造。很多相关的工具和商业软件已经被开发,包括以DeepFaceLab 为代表的支持人工干预的全流程人脸伪造开源项目和以风靡一时的ZAO 为代表的换脸应用软件。开源工具对人脸深度伪造技术的发展起到了巨大的推动作用,表1 列举了部分高影响力的人脸深度伪造工具与商业软件。总体来说,人脸深度伪造相关的开源项目大多从技术角度出发,使用方式的灵活性较高,但对工作的硬件环境和使用者的技术能力有一定要求,而商业软件主要面向不具备专业技术的大众用户,使用便利程度高,但仅能用于指定场景的娱乐用途。

表1 部分人脸深度伪造工具与软件

(二)基于隐变量编辑的方法

在人脸伪造相关技术中,有一类方法基于对抗生成网络(GAN)来实现。与基于图像域特征编码的方法不同,基于GAN 实现的方法依赖于已训练好的GAN 网络,探索人脸图像各属性在隐空间中对应的隐变量,找到待篡改的语义方向,再利用预训练好的GAN 生成器来生成编辑后的人脸。这类方法需要在图像隐空间进行操作,对于已知分布的生成人脸图像可以实现高自由度的编辑和高真实感的伪造,但对于真实人脸图像,首先需要将其映射到隐空间,此时非常依赖GAN 翻转(GAN Inversion)技术的效果。这类方法可探索性强,且思路多样化,近期在学术界得到了快速发展。

四、人脸深度伪造防御技术

(一)被动式检测方法

现阶段的Deepfake 防御主要指针对深伪媒体的被动式检测,即在无辅助信息的条件下对伪造人脸视频进行检测与鉴别,这个任务本质上是一个二分类任务,判断给定的人脸媒体文件是真还是假。二分类任务在多媒体取证、计算机视觉等领域都已有深入研究,但深度伪造的检测具有其特殊性,既不同于一般取证场景下像素级的修改检测,也不同于计算机视觉中语义级的理解分类,而是与二者都有关联但又有实质差别的一种技术。现阶段的Deepfake 的被动式检测方法也大多从这两个领域中借鉴思路,根据检测方法的特点,可以概括为三类。

有伪造样本学习方法

这类方法的核心特点是利用真假成对数据作为训练驱动,模型学习的过程需要有伪造人脸样本的参与。通过人工设计或神经网络挖掘的形式提取到真假人脸的可区分特征,从而进行分类。根据提取特征方式的不同,这类方法可分为基于人工特征的方法和基于深度学习方法两种。其中基于人工特征的检测方法多见于早期阶段,针对伪造技术不完善导致的篡改痕迹进行特征提取,如利用传统图像取证中的隐写分析特征,或捕捉眨眼异常、头面姿势不一致、异瞳和牙齿细节异常等。而基于深度学习的方法则更多建立在深度神经网络强大的图像理解能力之上,从媒体的空域、时域、频域等角度挖掘可鉴别的细节特征。一些经典的网络结构如XceptionNet、EfficientNet 等在deepfake 检测任务中发挥了良好的效果。在此基础上,Two-branch 采用了双向LSTM 来寻找伪造视频的时序伪像,F3-Net 通过精心设计的局部频域统计模块从频域的角度放大了伪造带来的可检测痕迹,MPSM 为特征图设计了块相似度计算模块以捕捉空域和频域特征上的篡改痕迹,均取得了良好的效果。Multi-Attention 首次将deepfake检测定义为细粒度分类任务,采用了多个注意力图来响应人脸图像的不同区域和不同注意力点,以定位局部且细微的篡改伪像。SPSL 则通过分析伪造算法中普遍存在的采样过程,从相位谱中捕捉频域伪造痕迹,实现了更为通用的检测。

无伪造样本学习方法

与“有伪造样本学习”的方法相对应,“无伪造样本学习”方法的模型训练过程不需要使用伪造人脸的负样本,而是抓住了人脸这一特殊信息载体的某些特性,或抓住了深度伪造过程中某一固有的流程漏洞实现检测与鉴别。典型的方法是Face X-ray,其抓住了伪造方法大多需要进行融合操作这一固有流程,进行针对融合操作痕迹的检测,模型训练只需要使用真脸数据和部分人工制作的非人脸融合图像,不需成对的真假脸。类似的还有PCL,通过预测融合面具的方式,判断给定人脸是否有融合痕迹或边界的不一致性。这类方法由于不依赖于真假成对数据,因此对不同的伪造算法具有较强的迁移检测能力。

基于多任务迁移的方法

这是最近新兴起的一类方法,其核心分类器依旧是依赖于成对真假数据进行训练,与前述方法最大的不同在于,该类方法会利用其它任务中的预训练模型或预筛选特征,在deepfake 的真假数据对上进行微调。代表方法为Lip-forensics,利用了唇读模型这一与人脸相关的分类模型,迁移到deepfake检测的任务中来,特征提取过程与唇读任务一致,但最终的目标是利用精准的唇读,区分真假唇的差别,从而实现真伪鉴别。

常用数据集

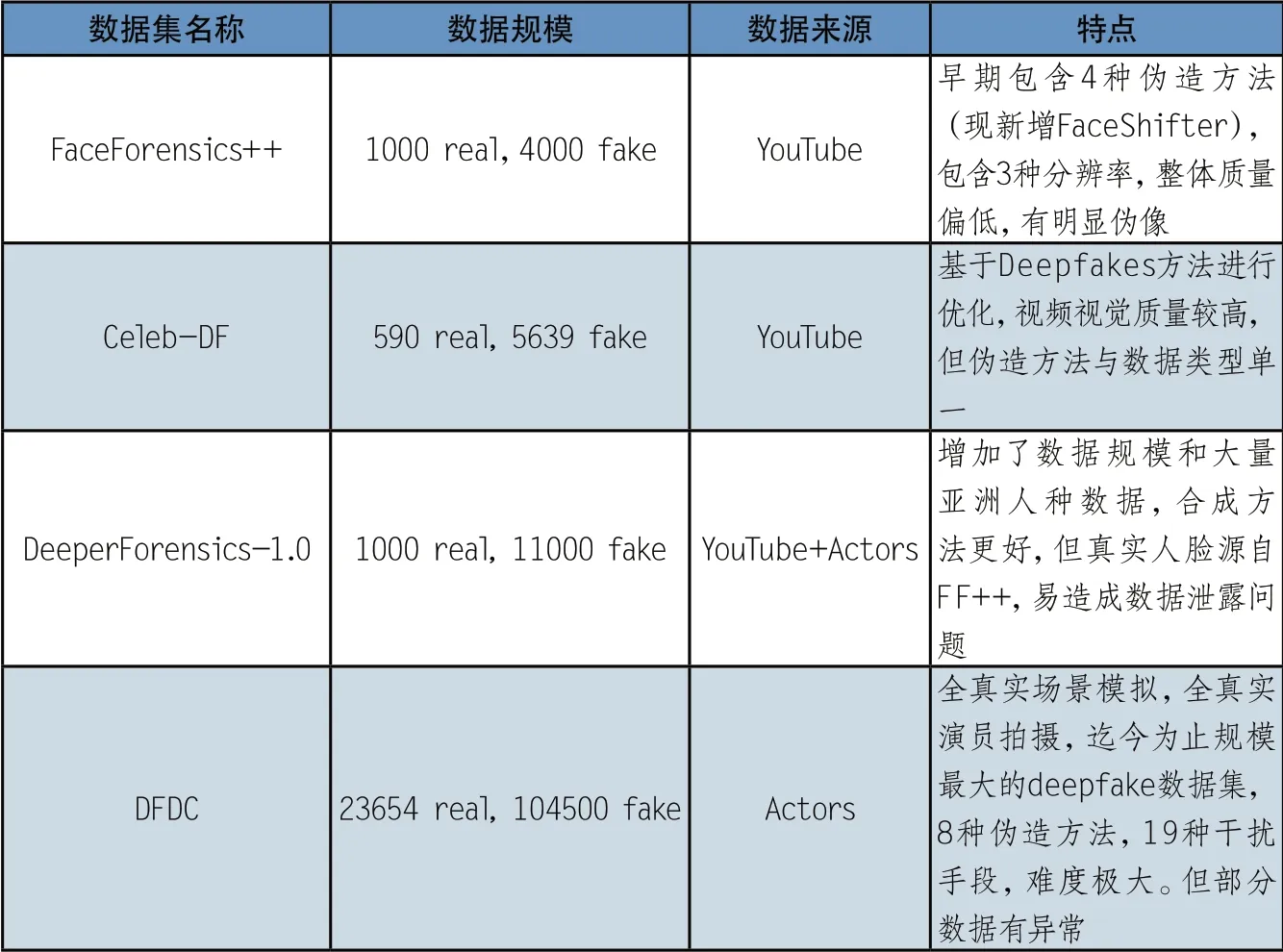

Deepfake 数据集主要用来训练以及评估检测模型的性能。Deepfake发展至今,出现过很多数据集。目前最常用的数据集主要有四个,各数据集的基本情况如表2所示。其中,衡量算法的库内检测性能通常用FaceForensics++,而衡量算法跨库性能时则多使用Celeb-DF 测试。随着领域内技术的进步和研究视角的转变,不同类型的数据集还将继续产生和发展,如近期中国科学技术大学和微软亚研院联合组建的包含人物身份参考的特定人伪造鉴别数据集“Vox-Deepfake”和Zi 等人提出的真实场景下的数据集“WildDeepfake”。

表2 Deepfake主要数据集基本情况

(二)主动式防御

主流的伪造防御技术大多通过事后取证的方式进行,属于被动式检测方法,但此时往往伪造多媒体的危害已经形成。因此,近期一些主动式防御的工作被提出。如Huang 等人提出的基于对抗攻击和数据毒化的人脸主动干扰方法,在不影响人脸多媒体数据视觉质量的前提下,干扰伪造者的模型训练过程,使其难以利用被保护的数据进行伪造。此外,主动式防御也可结合信息隐藏中的鲁棒水印以及模型水印等技术,锁定伪造数据的泄露途径,实现主动取证。

五、总结与思考

Deepfake 伪造及其防御是人工智能安全领域中的热点问题,由于其在安全与伦理问题上的特殊性,受到了科研、政治、社会、经济等多个领域的广泛关注。而解决Deepfake 相关问题,绝不仅仅是技术上的问题,更应该从立法监管、新闻宣传、知识科普等多个角度协同攻坚。Deepfake 技术的发展依旧存在如下研究难点。

1、伪造的智能化与真实感的权衡。智能化的伪造技术带来的是便捷性和自由度,但由于场景需求不同,统一的伪造框架无法很好的适应需求,因此结合人工干预的后处理手段可能是深度伪造更高级的形态。

2、多维度协同防御。事后取证的检测技术难以抵消已经发生的危害,因此事前保护的主动防御技术是值得期待的发展方向。目前相关的研究较少,且由于数据来源不可控,这类方法的应用受到了极大制约。

3、真实场景防御问题。当前Deepfake 检测技术的一大难点就是真实伪造场景下的鲁棒检测方法。由于传播场景复杂,对抗因素多,现有技术的泛化能力尚未达到实用,这一点也被2020年Facebook 牵头举办的DFDC比赛结论所验证。为了解决这一难题,发展多样化且高度真实的数据集和伪造方法也是一大关键问题。