结合分组联合字典的图像超分辨率重建

2022-01-07岳彦敏

岳彦敏,刘 丛

(上海理工大学光电信息与计算机工程学院,上海 200093)

0 引言

遥感卫星图像分辨率越高包含的地物信息越丰富,其利用价值就越高。但是图像的采集过程容易受到外界环境和成像设备等多种因素影响,会丢失高频信息。提升硬件设备性能的成本高、难度大。因此,从软件方面来提高遥感图像分辨率成为研究热点。图像超分辨率重建(Super-Resolution Reconstruction,SRR)[1]是利用一幅或多幅低分辨率(Low-Resolution,LR)图像获得一幅高分辨率(High-Resolution,HR)图像,它可以较好地改善遥感图像的重建质量,在遥感卫星领域具有重要的应用价值。

图像超分辨率重建是一个病态逆问题[2]。为解决该问题,研究人员提出了基于插值[3]、基于重建[4]和基于学习等[5-7]方法。其中,基于稀疏学习的超分辨重建算法应用最为广泛。Yang 等[8]、Zhang 等[9]受压缩感知(Compressive Sensing,CS)思想启发,利用字典学习将稀疏编码引入图像的超分辨率重建问题中,提出一种基于稀疏表示(Sparse-Representation,SR)的图像超分辨率重建算法;Rohit 等[10]、Zeyde 等[11]使用主成分分析(Principal Component Analysis,PCA)和正交匹配追踪(Orthogonal Matching Pursuit,OMP)算法对字典学习方法进行改进,提高了算法速度,取得了较好的重建效果。在面对结构较为复杂的图像重建时,以上算法学习的单一联合字典具有一定局限性;后来Dong等[13]提出了非局部自回归模型方法,将样本分类,利用PCA 算法得到的每个类的子字典较好地重构了图像结构;Wang 等[14]使用分组字典思想,根据主方向角对图像块分类并训练多个字典和残差字典,取得了较好的重建效果。但是分组字典也有缺点,即每个子字典都是一个独立的字典,并没有考虑每个子字典与样本间的关联性;在图像分类方面,Yang[15]使用具有关联性的分组字典比其他算法更有效。上述研究启发我们要加强每个子字典与样本间的关联性,以提高字典的精确性。

因此,本文提出结合分组联合字典的图像超分辨重建算法。该模型首先将训练样本分类,针对每一类学习一组联合字典。每类样本不仅可以被其学习到的子联合字典强线性表示,还可以被所有分组联合字典所组成的总字典线性表示。实验表明,本文提出的分组联合字典在遥感图像超分辨重建中效果较好。

1 基于稀疏表示的重建模型

一幅低分辨率图像是由其对应的高分辨率图像经模糊及下采样等操作获得,该退化模型可表示为:

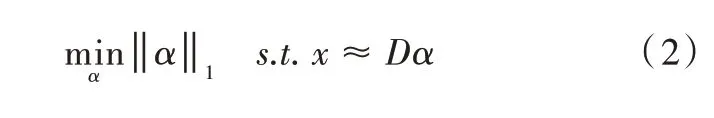

其中,X、Y分别为高、低分辨率图像;H表示模糊算子,S表示下采样,v表示噪声矩阵。一个d维的输入信号x∈Rd可用一组原子的线性组合对其逼近,表示为x ≈Dα。由于L0 范数在优化过程中存在一定困难,通常将其松弛为L1 范数形式。其中D∈Rd×m表示稀疏字典,m表示字典中原子的个数。通过求解如下模型可获得具有稀疏性的系数:

2 图像超分辨重建

2.1 分组联合字典模型建立

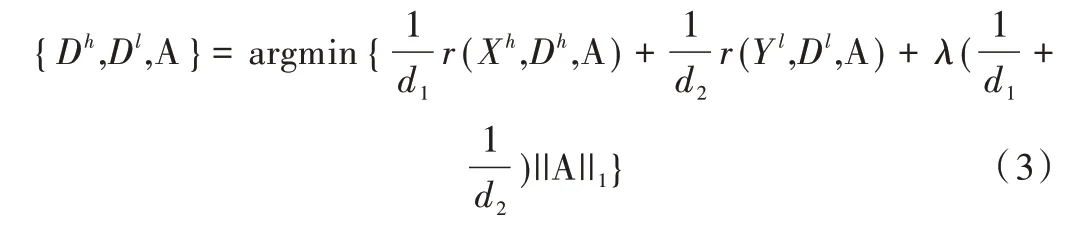

基于联合字典和分组字典学习的思想,本文设计了一种基于分组联合字典的超分辨率重建方法。将LR 特征图像块划分为C 类,其对应的HR 图像也赋予相应的类标签,分别表示为,其中分别表示第i类的HR 图像块和LR特征图像块,ni为样本数目。HR 图像与LR 图像的字典对为{Dh,Dl},分别表示HR 图像和LR 图像对应的字典。每个类别都需要学习一个子字典,所以高、低子字典可表示为和分别表示第i类样本的HR 字典和LR 字典,mi为第i类字典的原子数目。n个样本的稀疏系数矩阵表示为A=[α1,α2…,αn]∈Rm×n,系数矩阵对应C 个类,表示为A=[A1,A2…,AC]。建立分组联合字典模型如下:

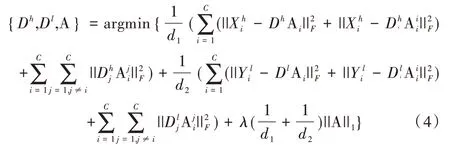

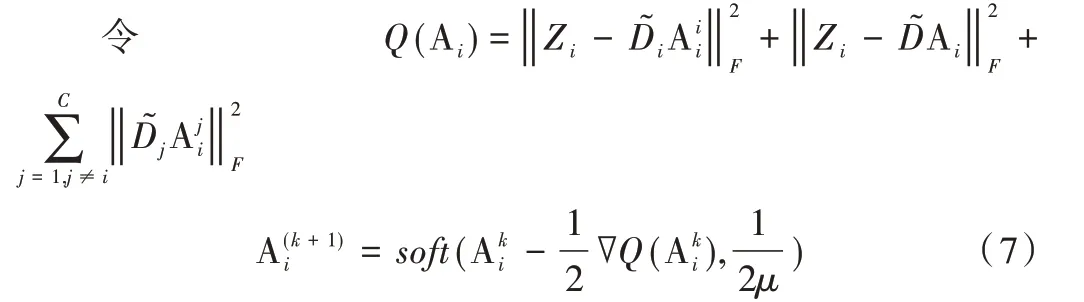

根据文献[15]算法优化方法将式(3)展开:

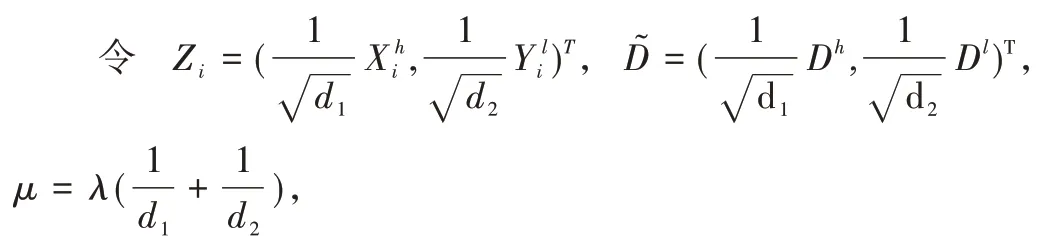

结合文献[8],上式可改写为:

2.2 模型优化与图像重建

本节对模型进行优化,优化算法仿照文献[15-16]设计。

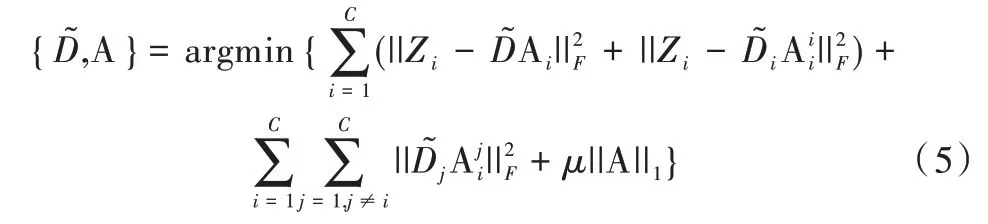

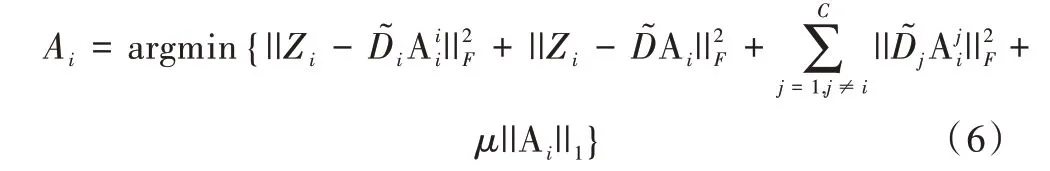

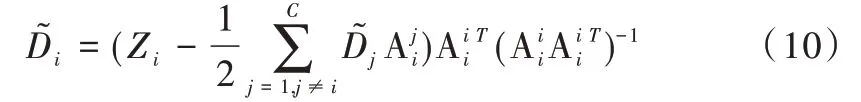

(1)求解稀疏系数Ai。固定字典和所有的系数Aj(j≠i),分别更新系数Ai(i=1,2,…,C)并合成系数矩阵A。根据式(5)可得:

式(6)可由迭代软阈值算法[17]求解:

其中,soft(*,*)为软阈值算子,k为迭代次数,表示Q(Ai)对Ai求一阶导数为软阈值。

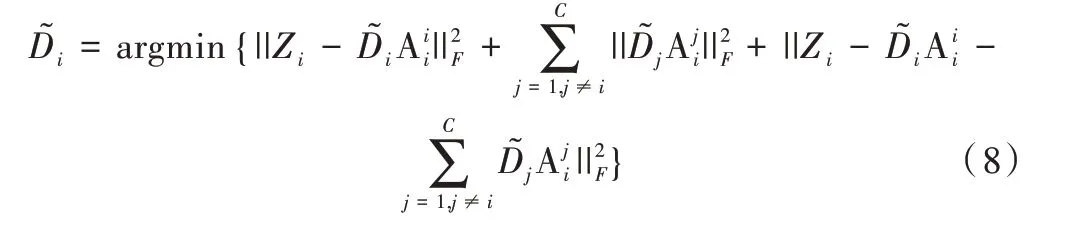

对式(8)求解计算的过程如下:

固定变量Ai,更新:

依据此步骤迭代更新编码系数A 和分组联合字典D,直到满足停止标准后停止更新。然后,使用分组联合字典进行图像重建。

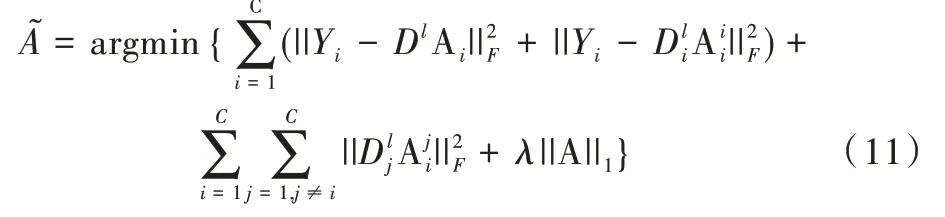

重建过程:①首先使用一阶和二阶梯度算子提取图像特征,获得一幅低分辨率特征图像;②将该图像划分成n个尺寸相同的子块,并对所有子块向量化,得;③计算每个图像块到类中心(训练模型时分组获得)的欧氏距离,将划分到C 个不同类中,表示为,每个类对应一个子联合字典。根据分组联合字典思想,使用公式(11)可获得图像块的稀疏表示系数,式中λ 为正则化标量参数。

使用该系数重建高分辨率图像块,将获得的图像块合并为整幅初始估计Xh,并加强图像块间的全局约束,得到最终的高分辨率图像:

3 实验结果与分析

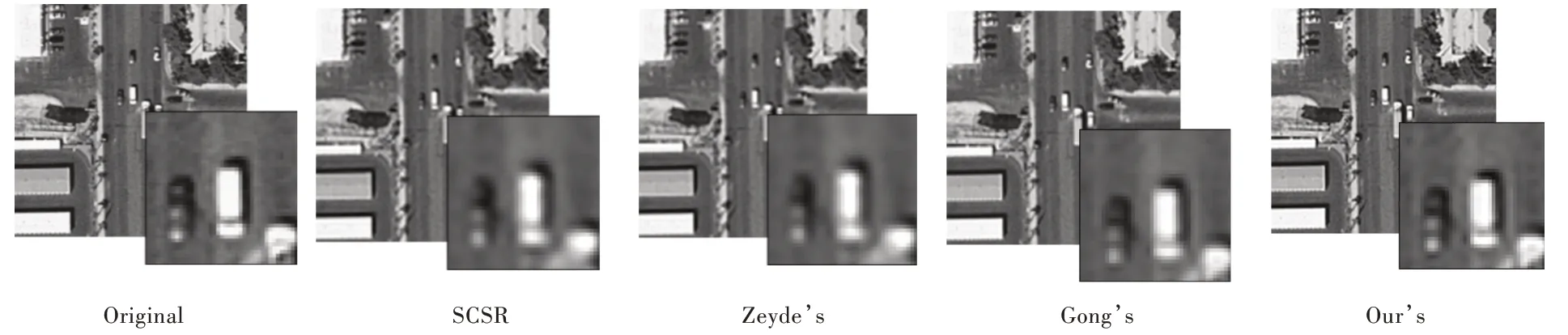

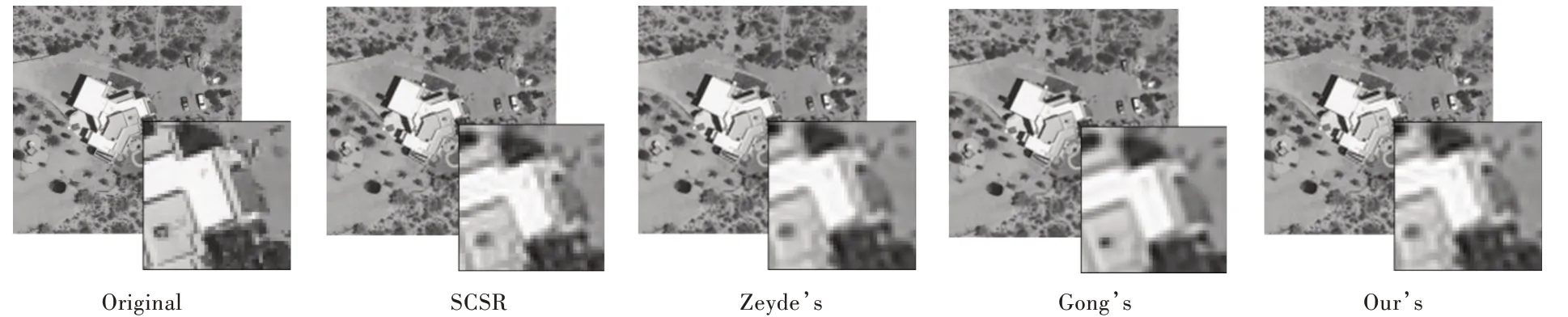

为验证本文算法的有效性,使用UCMerced_LandUse[18]作为训练集和测试集。所有算法都使用Matlab R2016a 仿真软件编程,在Windows 10 64 位操作系统中运行。硬件配置为CPU Inter(R)Core(TM)i7 2.6GHz,运行内存8G。在字典训练过程中,将高分辨率图像块大小设为6×6,两个相邻块之间的重叠像素宽度设为4,并对其做去均值运算。低分辨率图像块大小设为3×3,重叠像素为2。分别与SCSR 算法、Zeyde’s 算法和Gong’s 算法[19]进行对比。重建质量使用峰值信噪比(PSNR)和结构相似性(SSIM)两种指标进行评价。图1—图3 展示了3 张使用不同重建算法获得的高分辨率图像重建结果。

通过观察图1—图3 的局部效果可以看出,Bicubic 算法出现明显的模糊现象,SCSR 算法对图像的整体锐化度较高,局部边缘轮廓模糊并伴有伪影,Zeyde’s、Gong’s 算法较好地保持了图像边缘,但是引入了噪声点,图像部分出现了块状和边缘白边现象,视觉效果欠佳。本文算法较好地保持了图像边缘清晰度,有效抑制了噪声点对重建效果的影响,图像轮廓保持较好。

Fig.1 Comparison of reconstructed images of airplane23图1 airplane23 重建图像比较

Fig.2 Comparison of reconstructed images of intersction34图2 intersction34 重建图像比较

Fig.3 Comparison of reconstructed images of residenal93图3 residential93 重建图像比较

使用PSNR 和SSIM 指标来客观评价算法性能。由表1可知,本文算法与SCSR 和Zeyde’s 相比,PSNR 和SSIM 均相对提高,单幅图像的PSNR 最高可达1.36dB。与Gong’s 算法相比,本文算法PSNR 平均提高0.20dB,说明本文算法确实有效。SSIM 的平均值提高约0.02~0.06,表明本文重建出的图像与原图的结构更接近,进一步说明了本文算法的有效性。

Table 1 Comparison of PSNR/SSIM values of different algorithms表1 不同算法的PSNR/SSIM 值比较

4 结语

本文受分组字典和字典—样本间关联性思想启发,提出了一种结合分组联合字典的图像超分辨率重建算法。根据重建样本所属的类别找到最合适的主子字典和次子字典进行重建,使重建出的遥感图像边缘细节更为清晰,图像整体更为自然。但本文方法仍有一些可改进之处,如图像块的聚类方法、图像块的提取特征方法需改进,以及加快稀疏字典编码的速度。本文方法可推广到其他领域进行图像重建。