基于区域生长均值漂移聚类的苗期作物行提取方法

2021-12-28王爱臣刘青山王丽丽魏新华

王爱臣,张 敏,刘青山,王丽丽,魏新华

基于区域生长均值漂移聚类的苗期作物行提取方法

王爱臣1,2,张 敏1,2,刘青山1,2,王丽丽3,魏新华1,2※

(1. 江苏大学农业工程学院,镇江 212013;2. 江苏省农业装备与智能化高技术研究重点实验室,镇江 212013;3. 中国农业机械化科学研究院土壤植物机器系统技术国家重点实验室,北京 100083)

为解决传统机器视觉方法检测苗期作物行时不同作物种类、不同生长背景和不同作物行数导致的作物行提取精度低的问题,该研究提出一种基于区域生长和均值漂移聚类的苗期作物行提取方法。首先,通过Lab颜色空间中a、b双颜色分量最大熵法选取最优阈值进行图像分割;其次,通过垂直投影获取均值漂移的聚类窗口带宽,均值漂移时以聚类窗口边缘为种子点进行区域生长来归类和标记每一行作物,之后遍历所有作物行获取聚类中心点;最后,通过最小二乘法拟合聚类中心点得到作物行直线。试验结果表明,该方法对大蒜、玉米、油菜、水稻和小麦5种作物的苗期作物行提取精度较高,5种作物的平均行识别率为98.18%,平均误差角度为1.21°,每张图片的平均处理时间为0.48 s。该方法的作物行提取性能明显优于Hough变换方法,为田间环境多因素影响下的苗期作物行提取提供了一种更具鲁棒性的方法。

算法;图像处理;机器视觉;区域生长;均值漂移;最小二乘法

0 引 言

随着精准农业的不断发展,农业机械田间自动导航技术被广泛研究和应用,可大幅提高农机的作业精度和效率。目前应用于农业的自动导航技术主要有卫星导航和机器视觉两种方式,卫星导航常采用差分全球导航卫星系统(Global Navigation Satellite System, GNSS)实现厘米级定位,并通过导航处理软件实时更新农机位置数据,与规划路径对比分析实现导航偏差参数的计算和自动导航[1–3],但其易受树木遮挡,且无法感知当前作物行的特征信息。机器视觉导航具有接收信息丰富、设备体积小和非接触测量等优点,被广泛应用于作物行的检测和识别。

国内外学者对基于机器视觉技术的作物行提取做了大量研究。Hough变换是作物行识别最常用的经典方法之一[4],但存在因求取累加器峰值导致过大计算量的问题,且易受杂草和作物缺失影响。为了提高Hough变换检测作物行的适应性,王珊珊等[5]提出一种基于特征点邻域Hough变换的水稻秧苗行检测方法,通过建立不同光照条件、杂草密度和秧苗状况的水稻秧苗行数据库提高检测的适应性。陈子文等[6]提出一种基于自动Hough变换累加阈值的蔬菜作物行提取方法,首先采用双阈值分段投影法对作物行特征点进行提取,再通过Hough变换对提取的特征点进行直线拟合,将不同Hough变换累加阈值获得的拟合直线映射到累加平面上,之后通过K-means聚类将累加平面数据聚类为与作物行数相同的类数并基于聚类质心距离差和组内方差确定最优累加阈值,最后将最优累加阈值下累加平面的聚类质心作为识别出的真实作物行线,该方法的阈值优化耗时较长,达到1.00 s以上。鉴于田间作物行具有直线分布的特点,基于最小二乘法的方法也被用作拟合作物行。姜国权等[7]提出基于图像特征点粒子群聚类的麦田作物行检测方法,根据农田作物行中心线周围区域的特征点到该直线的距离均小于某一距离阈值的特点,通过粒子群优化算法对每一作物行的特征点分别进行聚类,最后对每一类的特征点用最小二乘法进行直线拟合得到麦田作物行中心线。垂直投影方法也常被用于作物行检测,但该方法对作物行分布较为敏感,容易出现检测出的行数与实际不符的情况,导致准确率降低,针对该问题,亢洁等[8]提出通过垂直投影得到中心作物行所在列,并对灰度图进行条形带分割,之后在每个条形带中寻找作物轮廓,最后通过最小二乘法拟合直线得到作物行。Ponnambalam等[9]基于卷积神经网络(Convolutional Neural Networks, CNN)分割作物区域,并通过多感兴趣区域提取作物行中心点,通过线性回归拟合作物行直线,该方法处理速率和精度相比传统Hough变换有较大提升。孟笑天等[10]提出根据距离函数求出最佳作物行数,采用K-means和最小二乘法对作物行的特征点进行聚类和拟合,但通过聚类获取作物行数的结果受杂草影响较大,无法处理行间杂草较为明显的场景,限制了其应用范围。为减少行间杂草对作物行提取的影响,Zhang等[11]提出一种基于位置聚类和最短路径法的作物行提取方法,能有效提取生长有杂草的苗期玉米行。此外,Vidović等[12-13]提出结合动态规划在全局数据集中寻找最优点,该方法可以精确检测直线和曲线作物行,但仅适用于已知2~3行作物,无法处理未知或更多作物行的场景。近年来,深度学习也开始被用于作物行提取。Bah等[14]将CNN与Hough变换融合形成HoughCNet网络,并与SegNet网络结合用于无人机航拍图片的作物行提取,作物行识别准确率达到93.58%。Pang等[15]提出了最大面积掩模得分区域神经网络用于提取航拍图像中的苗期玉米行。相比于传统方法,基于深度学习的作物行提取方法模型训练需要的数据量大、模型复杂且计算时间较长,难以用于田间实时作物行提取[16]。

在实际作物行检测中,多数场景都是直线作物行,但更多的挑战在于不同作物种类、不同作物生长背景和不同作物行数等因素导致的作物行识别率低、识别误差角度大等问题。综上,该研究提出一种结合区域生长和均值漂移聚类的作物行提取方法,通过边聚类边生长的方法获取作物行中心线,再利用最小二乘法拟合作物行。首先,将获取的RGB图像转换到Lab颜色空间,利用该空间中的a、b颜色分量分割作物和背景,采用双颜色分量最大熵法选取最优阈值进行图像分割,通过去除小面积连通区域和形态学操作过滤部分杂草噪声;其次,通过垂直投影获取均值漂移聚类窗口带宽,在均值漂移过程中以聚类窗口边缘为种子点进行区域生长来归类和标记每一行作物,避免聚类窗口边缘作物影响其余作物行的均值漂移结果,之后遍历所有作物行获取聚类中心点;最后,通过最小二乘法将聚类中心点拟合得到作物行直线。

1 材料与方法

1.1 作物行提取方法

1.1.1 绿色植物提取

提取绿色植物的主要目的是将田间绿色植物与背景中的泥块、建筑物、地膜等杂物分离,为后续作物行提取奠定基础。常规环境下植物和背景存在显著颜色差异,常采用超绿法(Excess Green, ExG)将图片进行灰度化处理,再利用Otsu方法确定分割阈值并进行阈值分割[17],但该方法在田间复杂环境下的分割效果不理想,如本研究所采集样本之一的大蒜图像(图1a),由于大蒜田覆盖偏绿色地膜,该图像经ExG处理后的灰度图(图1b)不能很好的区分苗期大蒜和背景,导致Otsu方法分割苗期大蒜的效果不理想(图1c)。

田间实际图像采集易受自然光照的影响,尤其是晴天午后和阴天,过强或过弱的光照影响图像质量并使得植物分割较为困难。为了更好地分割图像中的植物和背景,本研究采取亮度和色彩信息分离的Lab颜色模型。该模型与图像采集设备无关,能够更好地还原植物原本的颜色,其中a分量对绿色信息敏感,b分量对蓝色信息敏感[18]。图1a所示大蒜图像的a、b颜色分量的二元直方图如图2所示。

由图2可知,a和b分量近似呈多峰值正态分布(图2a),其中颜色越亮代表当前灰度下像素越多(图2b),由此可知a和b分量有明显的大小峰,即对应图像中背景和目标作物。图像的熵反映了图像灰度分布的聚集特征,故可通过最大熵法(Maximum Entropy Method,MEM)分别求取a、b分量的最佳分割阈值[19]。单颜色分量下目标区域的熵H和背景区域的熵H分别如式(1)和式(2)所示:

式中为单颜色分量分割阈值;为图像的灰度级数量;0()和1()分别为以为阈值分割的目标区域和背景区域像素的累计概率,两者之和为1;()为灰度值为的概率。当a、b分量中图像背景区域熵与目标区域熵之和分别达到最大时的灰度值即为最佳分割阈值*,其通过最大化目标和背景区域的信息熵之和确定,双颜色分量最大熵法最佳分割阈值*的计算如式(3)所示:

式中a和b分别为a、b两颜色分量通过最大熵法确定的最佳分割阈值,H_a()和b_a()为a分量的目标区域熵和背景区域熵,H_b()和b_b()为b分量的目标区域熵和背景区域熵。

通过获得的最佳分割阈值对图1a所示的大蒜图像进行分割并二值化得到二值化图像(图3a),本研究通过计算连通区域面积,将小面积的区域滤除,避免田间杂草干扰,然后进行形态学闭操作去除噪声点,再进行形态学操作填充孔洞,结果如图3b所示。

1.1.2 作物行聚类窗口带宽确定

本研究的聚类策略首先设定初始聚类中心点为整幅图像的顶部中心像素点,聚类过程从初始聚类中心点先沿纵向作物行扩散,聚类完一行作物后再横向扩散到相邻作物行。确定聚类窗口带宽时应避免发生跨行,所以基于最小行间距选取聚类窗口带宽。另外,图像透视会造成作物行呈斜线向上延伸,图像顶部的行间距最小,故截取二值化图像顶部高度为的图像带得到二值化图像带(图4a),并进行垂直投影来获取最小行间距。垂直投影是将二值化图像带(图4a)中每列像素点的值(0或1)累加得到垂直投影曲线(图4b),将累加值高于一定阈值的区域视作作物区域,否则视作背景区域。二值化图像带的垂直投影()的计算如式(4)所示:

式中(,)为二值化图像带中位置(,)处像素点的值(0或1);为二值化图像带的高度,像素,设置为图像总高度(像素)的十分之一,即=0.1。

为保证聚类时窗口在唯一作物行间移动,需根据截取的二值化图像带垂直投影选择合适的聚类窗口带宽。聚类窗口带宽的选择直接影响聚类效果,若选取的带宽过大易使多条作物行被识别为一行,而带宽过小则会增加聚类迭代次数,影响效率,故要求聚类窗口带宽在不会横跨多条作物行的情况下尽量大。为确定聚类窗口带宽,先根据式(5)计算二值化图像带垂直投影()的均值,之后根据将二值化图像带分为作物行区域和背景区域,具体规则:若()<,则()=0,属于背景区域;若()≥,则()=,属于作物行区域,其结果如图4c和图4d所示。

式中为图像总宽度,像素。

注:为二值化图像带的高度,像素;为图像总高度,像素;为图像总宽度,像素;()为二值化图像带的垂直投影;为垂直投影()的均值;为聚类窗口带宽;图4a中矩形区域为二值化图像带,图4b和图4c中曲线为二值化图像带的垂直投影(),图4c中直线为二值化图像带垂直投影()的均值,图4d中线框内为通过均值确定的作物行区域。

Note:is the height of the strip from binary image, pixel;is the total height of the image, pixel;is the total width of the image, pixel;() is vertical projection of the strip from binary image;is the mean value of the vertical projection();is the clustering window bandwidth; In Fig.4a, the green rectangular area is a strip from binary image; In Fig. 4b and Fig. 4c, the red curve is the vertical projection() of the strip from binary image; In Fig.4c, the yellow straight line is the mean valueof the vertical projection() of the strip from binary image; In Fig. 4d, the region within red lines are crop row areas determined by the mean value.

图4 聚类窗口带宽获取过程

Fig.4 Acquisition process of clustering window bandwidth

由图4可知,由于图像透视原因,两侧作物行斜率较大且向中间倾斜,两侧最边缘作物存在重叠现象,所以选取图像中间区域作为感兴趣区域(Region of Interest,ROI),选取ROI中作物行间距的最小值为聚类窗口带宽。聚类窗口带宽确定后,以选定的聚类中心点为中心点、以2倍聚类窗口带宽为边长生成聚类窗口。

1.1.3 作物行聚类与拟合

通常提取作物行的方法有Hough变换和垂直投影,但Hough变换中累加阈值的选取对提取作物行结果有着很大影响,同时Hough变换检测出的直线存在过度检测的问题,即检测出的作物行数远大于实际作物行数。垂直投影对于如本研究的场景存在顶部投影峰值和底部投影峰值个数无法匹配的问题,因此本研究采用先聚类后最小二乘法拟合的方法进行作物行提取。

本研究聚类策略基于均值漂移(mean shift)思想[20-21],其核心思想是沿着密度上升的点寻找聚集簇,通过计算特征空间中样本点概率密度最大的位置,将概率密度函数收敛到稳态点,基于均值漂移的聚类在图像平滑和图像分割中效果较好。为了提高算法的准确度,Comaniciu等[22]提出根据采样点的局部密度自适应调整搜索区域的大小,此方法可以应用在作物行聚类中,当聚类陷入因作物不连续导致的局部最优时,通过扩大搜索半径跳出局部最优。均值漂移方法的基础公式如式(6)所示:

本研究所用方法的具体聚类步骤如下:

1)选中整幅图像顶部中心像素点作为初始聚类中心点,以该点为中心点、以2倍聚类窗口带宽为边长生成聚类窗口,将聚类窗口内的所有像素点记为集合S;

2)根据式(6)和式(7)计算集合S的漂移向量,同时选取聚类窗口边缘的像素点作为种子点,通过区域生长法向聚类窗口两侧扩张,标记此次集合S内像素点和区域生长扩张的像素点为已聚类点,归为聚类簇集1;

3)初始聚类中心点沿漂移向量指向的位置移动形成新的聚类中心点;

4)重复步骤2)、3),记录每次的聚类中心点,如因作物种植不连续导致聚类陷入局部最优,即漂移向量停滞但仍未到达整幅图像底部时,则扩大聚类窗口带宽,直到聚类中心点漂移至图像底部,此时第一行作物已被聚类标记,得到聚类簇集1;

5)进入下一行作物聚类,重复步骤1),并将初始聚类中心点以聚类窗口带宽为漂移距离向左或右平行漂移,此时聚类簇集视为2;

6)重复步骤2)、3)、4)、5),直至聚类的标记点达到图像边界,当前聚类簇集视作C,此时所有作物行都被聚类标记;

7)对聚类簇集1,2,…C的聚类中心点通过最小二乘法拟合作物行直线。

单作物行的聚类过程如图5所示,开始时在原始图像中标记起始聚类窗口内所有非零像素点(图5b),同时以聚类窗口边缘为种子点向外生长,计算聚类窗口内像素点的漂移向量(),聚类中心点向()方向移动,移动距离为||()||,至此完成一次聚类,一次聚类后聚类窗口位置和已标记像素点如图5c所示,多次聚类和区域生长后聚类窗口位置和已标记像素点如图5d所示。

对于多作物行聚类,以图像顶部中心像素点为初始聚类中心点、以2倍聚类窗口带宽为边长生成聚类窗口,如图6a中方框A所示,对初始聚类中心点对应的作物行进行图5所示的聚类过程。当同一作物行的两株作物间存在较大空白区域时,即当前聚类中心点和下一个聚类中心点重合时,聚类陷入局部最优,此时扩大聚类窗口带宽,直至聚类窗口包含新的未聚类点,如图6a中嵌套的3个方框B所示。在完成一个作物行聚类时,聚类中心点到达图像最底部,之后聚类中心点返回到图像顶部,若当前顶部聚类窗口内的漂移向量为0,则继续平移聚类中心点,顶部聚类中心点的移动轨迹为从中间至两侧。聚类中心点平移后重复图5所示聚类过程,直至完成图中所有作物行聚类,得到对应每个作物行的聚类点集,如图6b所示。由图6a和图6b可知,图像中间部分的作物行②~⑨呈明显直线趋势,可被有效聚类,而位于图像两侧的作物行①和⑩以及作物行①左侧和作物行⑩右侧的三角形区域作物分布杂乱,区域生长时该区域被聚类为一簇。所有作物行聚类过程中聚类中心点形成聚类中心点集,如图6a中星点所示。聚类完成后,将每一作物行的聚类中心点进行最小二乘法直线拟合,即可得到作物行,如图6c中直线所示。

1.2 作物行提取方法的试验验证

1.2.1 试验图像与计算平台

为验证本研究提出的作物行提取方法的适用性,选取了5种不同生长背景和生长情况的苗期作物,包括大蒜、玉米、油菜、水稻和小麦。其中大蒜田覆盖了偏绿色地膜,部分油菜图像中的油菜作物行不连续,小麦生长较为密集。油菜和大蒜的图像通过佳能EOS 60D相机(EOS 60D,佳能,日本)搭配50 mm定焦镜头(EF 50mm f/1.8 STM,佳能,日本)分别在江苏大学校内实验田和山东省临沂市兰陵县大蒜田采集;小麦和水稻的图像通过萤石S2相机(S2,萤石,中国)在江苏润果农业发展有限公司(江苏省镇江市大港新区)的种植基地采集;玉米图像来自于Vidović等[13]公开的数据集中含直线作物行的玉米图像。大蒜、玉米、油菜、水稻和小麦5种作物的图像数量分别为20、40、40、40和30。试验计算机环境配置中央处理器频率为2.5 GHz,内存为8 GB,处理图像所用软件平台为MATLAB R2018b。

1.2.2 作物行提取效果评价

为验证作物行提取效果,分别采用本研究提出的作物行检测方法、Hough变换方法和投影-邻近分类拟合方法[23]进行作物行提取,作为对比标准的参考作物行则通过作物行标注工具生成[13]。Hough变换是一种经典常用的作物行检测方法,常被用于进行作物行检测效果对比。投影-邻近分类拟合方法通过邻近关系对作物行中心的特征点进行分类,并对归类后的特征点进行最小二乘拟合得到作物行[23]。

所用Hough变换的边缘提取算子为Canny算子,累加阈值通过手动选取,选取原则为尽可能检测到大部分作物行,同时避免因累加阈值过大导致的过检测问题。另外,由于Hough变换在提取作物行时每行作物会检测出多条直线,所以对这些直线进行K-means聚类,K-means聚类的目标函数采用误差平方和(Sum of the Squared Error, SSE)[6],其计算如式(8)所示:

式中为聚类数量,表示聚类点,C为第类的聚类点集,c为第类聚类点集的聚类中心,dist表示欧几里得距离求解函数。本研究将Hough变换检测的作物行直线斜率作为点集,为聚类的数量,即作物行数量,通过K-means聚类将Hough变换检测的作物行直线聚类成与作物行数相同的类,再提取每类中的最优直线作为Hough变换提取的作物行直线[6]。

为评价作物行提取效果,本研究计算了作物行直线误差角度(°)和行识别率(%)。行识别率为作物行提取方法识别出的作物行数量和实际作物行数量的比值。作物行直线误差角度采用Jiang等[24]提出的方法,如图7所示,假设参考作物行直线1和作物行提取方法得到的作物行直线2分别表示为

注:灰色区域为一行作物,1为参考作物行直线,2为作物行提取方法得到的作物行直线,1、2分别为1、2的斜率,1、2分别为1、2的截距,为作物行直线误差角度(°)。

Note: The grey area is a row of crops,1is the reference straight line of a crop row,2is the straight line of a crop row obtained by a crop row extraction method,1and2are the slopes of1and2respectively,1and2are the y-intercepts of1and2respectively, andis the error angle of crop row straight lines (°).

图7 作物行直线误差角度定义

Fig.7 Definition of the error angle of crop row straight lines

式中1、2分别为作物行直线1、2的斜率,1、2分别为作物行直线1、2的截距。定义1和2的夹角为作物行直线误差角度(°)[24],则有:

平均误差角度(°)定义为所测试图像中所有作物行直线误差的平均值,其计算如式(12)所示:

式中θ为平均误差角度(°),为作物行数量,θ为第行作物行对应的作物行直线误差角度(°)。

2 结果与分析

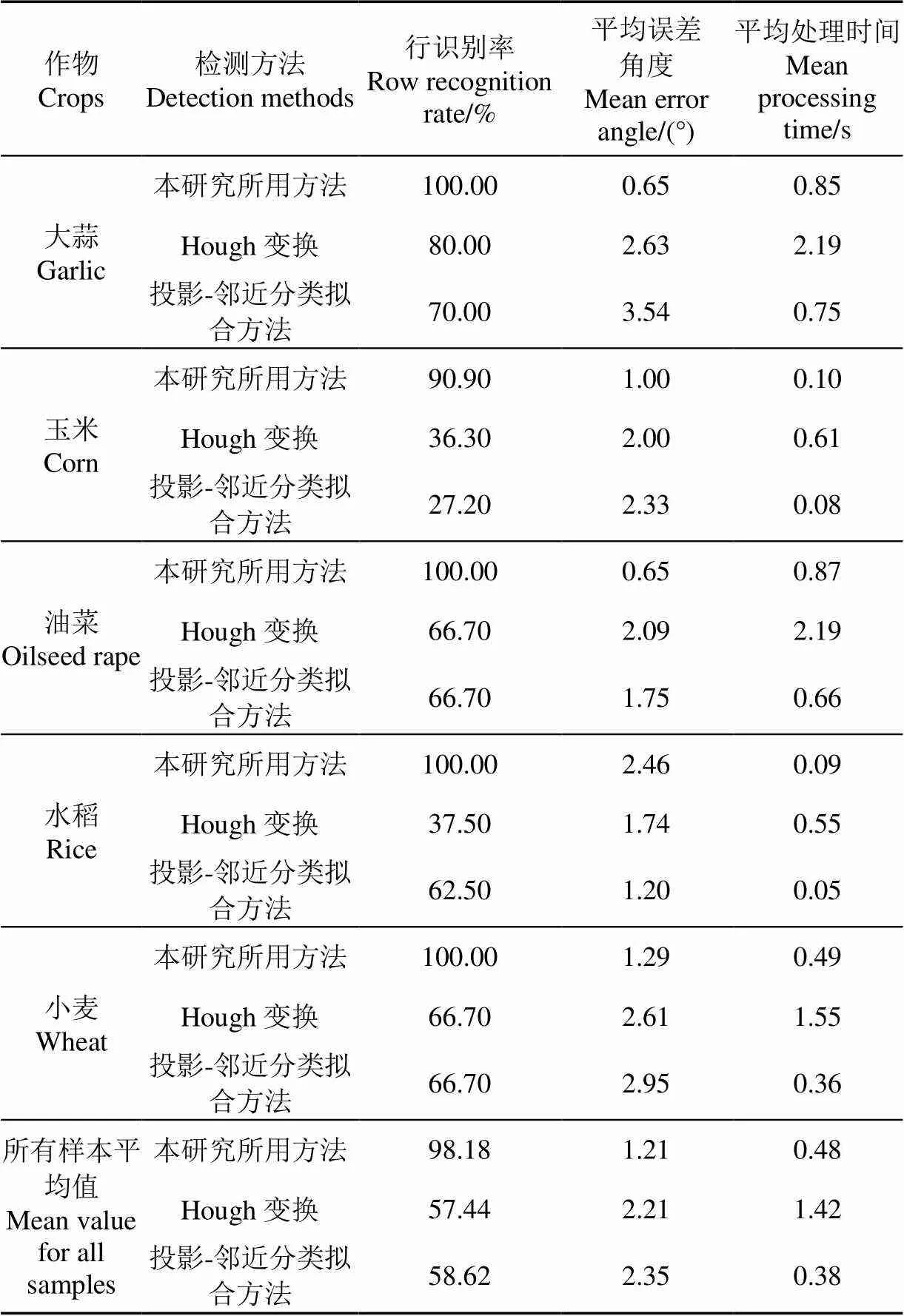

本研究所用方法、Hough变换和投影-邻近分类拟合方法[23]对5种作物图像提取作物行的效果图如图8所示,3种方法的作物行提取效果对比如表1所示。

在进行作物行提取时,本研究所用方法对5种场景下共170张图像中所有可见作物行的平均识别率为98.18%,远超过Hough变换方法的57.44%和投影-邻近分类拟合方法的58.62%。大蒜图像中由于苗期大蒜行距较小、行数较多,且两行大蒜苗之间存在相互重叠现象,投影-邻近分类拟合方法对大蒜图像底部图像带进行垂直投影时峰值不易区分,故投影获取作物中心点时误差较大,不能准确反映作物行分布,行识别率只达到70.00%,平均误差角度高达3.54°;Hough变换识别的行数严重依赖于累加阈值,且计算时间较长,每张图片的平均处理时间为2.19 s,行识别率为80%,平均误差角度为2.63°;本研究方法可以识别大蒜图像中全部可见作物行,包括两侧作物密集区域,行识别率达到100.00%,平均误差角度为0.65°。

表1 3种作物行检测方法的对比

对于玉米作物行的提取尤其体现本研究所用方法识别作物行的准确性,在多达11条作物行且透视现象严重的苗期玉米图像中,除最边缘颜色特征不明显的作物行外,所有可被二值化的作物行全部被准确识别;相比之下,由于图像透视导致图像中大部分作物行较短且没有贯穿图像,Hough变换只识别出了中间区域图像透视现象较弱作物行,行识别率仅为36.30%,且平均误差角度高于本研究所用方法;同样地,投影-邻近分类拟合方法识别的作物行数局限于图像底部垂直投影峰值数,只能识别出27.20%的苗期玉米作物行。油菜图像中由于缺苗和油菜苗株间距较大,二值化图像中作物不连续,Hough变换提取的作物行与参考作物行相差较大,平均误差角度达到2.09°;相比之下,本研究所用方法依靠在聚类过程中不断扩大搜索半径确保作物被有效聚类,行识别率达到100.00%,平均误差角度为0.65°,明显优于Hough变换的2.09°和投影-邻近分类拟合方法的1.75°。低分辨率的苗期水稻图像中,图像两侧存在明显作物行重叠现象,本研究所用方法通过区域生长把两侧连通作物聚为一类拟合出作物行,作物行识别精度高于Hough变换和投影-邻近分类拟合方法,虽然两侧的水稻被识别为独立的作物行,但由于水稻苗生长杂乱重叠,导致拟合的作物行直线与参考作物行直线误差角度较大,这也导致了水稻图像中本研究所用方法的作物行提取平均误差角度较2种对比方法大。对于生长密集的冬小麦,基于Lab颜色空间下a、b双颜色分量最大熵法的阈值分割能够准确地对小麦苗进行二值化分割,本研究所用方法也能够准确地识别出可见作物行,行识别率和平均误差角度分别为100.00%和1.29°,明显优于2种对比方法。

综合所测试5种作物的作物行提取结果,本研究所用方法在行识别率、平均误差角度和平均处理时间方面均较Hough变换和投影-邻近分类拟合方法更优,平均行识别率达到98.18%,平均误差角度为1.21°,每张图片作物行提取的平均处理时间为0.48 s,接近提取步骤较少的投影-邻近分类拟合方法的0.38 s。本研究所用方法对于不同作物种类、不同作物生长背景和不同作物行数场景下的作物行提取都有较好的适应性。

3 结 论

本研究针对不同作物种类、不同作物生长背景和不同作物行数等因素导致的作物行提取精度低的问题,通过最大熵法、区域生长、均值漂移和最小二乘法,实现了大蒜、玉米、油菜、水稻和小麦5种作物苗期作物行的有效提取,为机器视觉导航提供参考。通过试验得到以下结果:

1)采用Lab颜色空间中的a、b双颜色分量最大熵法分割绿色植物,并通过形态学操作对杂草和噪音进行滤波。结果表明,该方法可避免背景中石块和薄膜等对作物分割的干扰,实现绿色植物的准确提取。

2)对图像顶部的二值化图像带进行垂直投影获取作物行区域,基于所获取作物行区域的最小行间距确定聚类窗口带宽,试验表明该方法适用于所测试5种作物的作物行提取时聚类窗口带宽的选择。

3)基于区域生长和均值漂移(mean shift)方法对作物进行聚类,均值漂移时以聚类窗口边缘为种子点进行区域生长来归类和标记每一行作物,避免聚类时作物行间干扰,提高了作物行识别率和精度。试验结果表明,本研究提出的方法对所测试5种作物的平均行识别率为98.18%,平均误差角度为1.21°,明显优于Hough变换和投影-邻近分类拟合方法。

在今后研究中,将提高自适应调整搜索区域效率,从而进一步提高计算速度,同时将该方法移植到实时嵌入式平台,可为基于机器视觉的农机自动导航提供有效信息。

[1] 张漫,季宇寒,李世超,等. 农业机械导航技术研究进展[J]. 农业机械学报,2020,51(4):1-18.

Zhang Man, Ji Yuhan, Li Shichao, et al. Research progress of agricultural machinery navigation technology[J]. Transactions of The Chinese Society for Agricultural Machinery, 2020, 51(4): 1-18. (in Chinese with English abstract)

[2] Reid J F, Zhang Q, Noguchi N, et al. Agricultural automatic guidance research in North America[J]. Computers and Electronics in Agriculture, 2000, 25(1/2): 155-167.

[3] 韩树丰,何勇,方慧. 农机自动导航及无人驾驶车辆的发展综述[J]. 浙江大学学报:农业与生命科学版,2018,44(4):381-391.

Han Shufeng, He Yong, Fang Hui. Recent development in automatic guidance and autonomous vehicle for agriculture: A review[J]. Journal of Zhejiang University: Agriculture and Life Sciences Edition, 2018, 44(4): 381-391. (in Chinese with English abstract)

[4] Illingworth J, Kittler J. A survey of the Hough transform[J]. Computer Vision, Graphics, and Image Processing, 1988, 44(1): 87-116.

[5] 王珊珊,余山山,张文毅,等. 基于特征点邻域Hough变换的水稻秧苗行检测[J]. 农业机械学报,2020,51(10):18-25.

Wang Shanshan, Yu Shanshan, Zhang Wenyi, et al. Detection of rice seedling rows based on Hough transform of feature point neighborhood[J]. Transactions of the Chinese Society for Agricultural Machinery, 2020, 51(10): 18-25. (in Chinese with English abstract)

[6] 陈子文,李伟,张文强,等. 基于自动Hough变换累加阈值的蔬菜作物行提取方法研究[J]. 农业工程学报,2019,35(22):314-322.

Chen Ziwen, Li Wei, Zhang Wenqiang, et al. Vegetable crop row extraction method based on accumulation threshold of Hough transformation[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(22): 314-322. (in Chinese with English abstract)

[7] 姜国权,杨小亚,王志衡,等. 基于图像特征点粒子群聚类算法的麦田作物行检测[J]. 农业工程学报,2017,33(11):165-170.

Jiang Guoquan, Yang Xiaoya, Wang Zhiheng, et al. Crop rows detection based on image characteristic point and particle swarm optimization-clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(11): 165-170. (in Chinese with English abstract)

[8] 亢洁,马振. 基于轮廓查找与线扫描的作物行检测算法[J]. 科学技术与工程,2019,19(20):273-277.

Kang Jie, Ma Zhen. Detection algorithm of crop row based on contour searching and line scanning[J]. Science Technology and Engineering, 2019, 19(20):273-277. (in Chinese with English abstract)

[9] Ponnambalam V R, Bakken M, Moore R J, et al. Autonomous crop row guidance using adaptive multi-ROI in strawberry fields[J/OL]. Sensors, 2020, 20(18), [2020-9-10], https://www.mdpi.com/1424-8220/20/18/5249.

[10] 孟笑天,徐艳蕾,王新东,等. 基于改进K均值特征点聚类算法的作物行检测[J]. 农机化研究,2020,42(8):26-30.

Meng Xiaotian, Xu Yanlei, Wang Xindong, et al. Crop line detection based on improved K-means feature point clustering algorithm[J]. Journal of Agricultural Mechanization Research, 2020, 42(8): 26-30. (in Chinese with English abstract)

[11] Zhang X Y, Li X N, Zhang B H, et al. Automated robust crop-row detection in maize fields based on position clustering algorithm and shortest path method[J]. Computers and Electronics in Agriculture,2018, 154: 165-175.

[12] Vidović I, Scitovski R. Center-based clustering for line detection and application to crop rows detection[J]. Computers and Electronics in Agriculture, 2014, 109: 212-220.

[13] Vidović I, Cupec R, Hocenski Ž. Crop row detection by global energy minimization[J]. Pattern Recognition, 2016, 55: 68-86.

[14] Bah M D, Hafiane A, Canals R. CRowNet: Deep network for crop row detection in UAV images[J]. IEEE Access, 2020, 8: 5189-5200.

[15] Pang Y, Shi Y V, Gao S C, et al. Improved crop row detection with deep neural network for early-season maize stand count in UAV imagery[J/OL]. Computers and Electronics in Agriculture, 2020, 178, [2020-9-10], https://www.sciencedirect.com/science/article/pii/S0168169920311376.

[16] Rabab S, Badenhorst P, Chen Y P, et al. A template-free machine vision-based crop row detection algorithm[J]. Precision Agriculture, 2020, 20(3): 1-30.

[17] Riehle D, Reiser D, Griepentrog H W. Robust index-based semantic plant/background segmentation for RGB-images[J/OL]. Computers and Electronics in Agriculture, 2020, 169, [2020-01-14], https://www.sciencedirect.com/science/article/ pii/S0168169919314346.

[18] Wang A C, Zhang W, Wei X H. A review on weed detection using ground-based machine vision and image processing techniques[J]. Computers and Electronics in Agriculture, 2019, 158: 226-240.

[19] Yang D, Li H, Liu S, et al. In situ capture of spatter signature of SLM process using maximum entropy double threshold image processing method based on genetic algorithm[J/OL]. Optics and Laser Technology, 2020, 131, [2020-06-10], https://www.sciencedirect.com/science/article/pii/S0030399220310045.

[20] Guo Y, Şengür A, Akbulut Y, et al. An effective color image segmentation approach using neutrosophic adaptive mean shift clustering[J]. Measurement, 2018, 119: 28-40.

[21] Vallabhaneni R B, Rajesh V. Brain tumour detection using mean shift clustering and GLCM features with edge adaptive total variation denoising technique[J]. Alexandria Engineering Journal, 2018, 57(4): 2387-2392.

[22] Comaniciu D, Ramesh V, Meer P. The variable bandwidth mean shift and data-driven scale selection[C]//Proceedings Eighth IEEE International Conference on Computer Vision, Vancouver: IEEE, 2001.

[23] 司永胜,姜国权,刘刚,等. 基于最小二乘法的早期作物行中心线检测方法[J]. 农业机械学报,2010,41(7):163-167.

Si Yongsheng, Jiang Guoquan, Liu Gang, et al. Early stage crop rows detection based on least square method[J]. Transactions of the Chinese Society for Agricultural Machinery, 2010, 41(7): 163-167. (in Chinese with English abstract)

[24] Jiang G Q, Wang Z H, Liu H M. Automatic detection of crop rows based on multi-ROIs[J]. Expert Systems with Applications, 2015, 42(5): 2429-2441.

Seedling crop row extraction method based on regional growth and mean shift clustering

Wang Aichen1,2, Zhang Min1,2, Liu Qingshan1,2, Wang Lili3, Wei Xinhua1,2※

(1212013;2212013,; 3.100083,)

Automatic navigation can be used to significantly improve the operation accuracy and efficiency of agricultural machinery. Particularly, machine vision-based automatic navigation can greatly contribute to crop row detection. In this study, a novel crop row extraction was proposed using regional growth and mean-shift clustering, especially for higher accuracy of crop row extraction under different crop types, the number of crop rows, and growing backgrounds. Firstly, the a and b components of an image were obtained in the Lab color space, and then the maximum entropy values of a and b components were calculated for the optimal segmentation threshold, after which the image was segmented by the threshold for the binarization image. Secondly, the vertical projection operation was performed on the top strip of the binary image, where the mean value of the vertical projection curve was calculated to distinguish crop and non-crop areas. The minimum distance between crop areas was selected as the bandwidth of the crop clustering window. The top center pixel of the whole image was selected as the initial center point of the clustering window. The clustering center point moved from the center to both sides of the top of the image with the iteration of crop row clustering, where the shift vector was calculated in the clustering window. The clustering center point moved along the shift vector in single row clustering, where the edge of the clustering window was used as the seed point for regional growth. As such, all crop rows were obtained by the movement of clustering window and regional growth, while, the clustering center points of each crop row were grouped into a cluster. Lastly, least-squares fitting was performed on these clustering center points to obtain crop row lines. A total of 170 seedling images of five crop varieties were obtained to verify the feasibility of the method, including garlic, corn, oilseed rape, rice, and wheat. Hough transform and projection-proximity classification were also used to extract crop rows for comparison. Experimental results showed that more satisfactory performance of segmentation was achieved for the images with less significant color difference between crops and growing background using the maximum entropy of a and b components in the Lab color space, compared with the conventional segmentation using an excess green index. Furthermore, the crop row extraction for tested five crops performed better than that of Hough transform and projection-proximity classification fitting, in terms of row recognition rate, mean error angle, and mean processing time. The mean row recognition rate for the 170 tested images was 98.18%, the mean error angle of extracted straight lines of all crop rows was 1.21°, and the mean processing time for each image was 0.48 s. This finding can provide a more robust for crop row extraction under the influence of multi factors in the field using machine vision, particularly on real-time embedded platforms in practical applications.

algorithm; image processing; machine vision; regional growth; mean shift; least square method

王爱臣,张敏,刘青山,等. 基于区域生长均值漂移聚类的苗期作物行提取方法[J]. 农业工程学报,2021,37(19):202-210.doi:10.11975/j.issn.1002-6819.2021.19.023 http://www.tcsae.org

Wang Aichen, Zhang Min, Liu Qingshan, et al. Seedling crop row extraction method based on regional growth and mean shift clustering[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(19): 202-210. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.2021.19.023 http://www.tcsae.org

2020-11-02

2021-08-24

国家自然科学基金(32001417);国家重点研发计划(2019YFB131230201);江苏省现代农机装备与技术示范推广项目(NJ2021-64);镇江市重点研发计划(NY2020006)

王爱臣,博士,副研究员,研究方向为农业信息智能感知与应用。Email:acwang@ujs.edu.cn

魏新华,博士,研究员,研究方向为农业智能装备与控制。Email:wei_xh@126.com

10.11975/j.issn.1002-6819.2021.19.023

S24; TP751

A

1002-6819(2021)-19-0202-09