面向高速公路的车辆视频监控分析系统

2021-11-12毛昭勇王亦晨沈钧戈

毛昭勇,王亦晨,王 鑫,2,沈钧戈

(1.西北工业大学 无人系统技术研究院,陕西 西安 710072;2.陕西交通控股集团有限公司,陕西 西安 710065)

在高速公路管理中,保障道路交通的稳定和畅通是重中之重。然而,高速公路车辆异常事件,如违法停车、交通拥堵等时常发生,极大程度地影响了高速公路畅通与安全。目前高速公路车辆监测多停留在基于全球定位系统(GPS)的位置信息监测[1]以及事故后调取视频行车记录进行取证还原上。此方法由于信息传输延迟,故缺乏交通车辆监测的实时性和准确性。随着我国高速公路视频监控规模的迅速扩大,已经基本实现了路网视频监控全覆盖,因此,利用监控视频实现车辆监测可提升高速公路智能化管理水平,即通过监控摄像头采集视频流数据,并对视频流中的车辆进行检测和跟踪,实现交通车辆监测应用。近年来,随着计算机硬件发展和运算力的提高,尤其是图形处理器(GPU)的广泛应用,研究者利用深度学习方法对车辆进行检测和跟踪[2-4],使得高速公路场景下的车辆监测更准、更快、更智能化。

目前,基于智能视频分析的高速公路车辆检测与跟踪面临以下几个问题:(1)车辆实时性检测要求高。由于高速公路交通流量检测和异常事件等车辆检测信息需要实时的反馈,并且要求同一平台运行多路监控视频,因此对目标检测算法的速度和效率都要求较高,需要完成实时的检测和跟踪以确保及时地反馈高速路况。(2)车辆尺度变化大。由于高速公路场景中存在车辆由近及远、由远及近等车辆尺度变化的情况,且车辆目标在图片的不同位置会有明显的形变,同一车辆目标在摄像头画面边缘位置会发生明显的大小形变,影响小目标的检测和跟踪精度。(3)场景变化大。由于高速公路监控的架设场景不同,摄像头视角和高度也会存在差异。场景变化对检测算法的影响较大。

面向高速公路的车辆视频监控分析方法的基础包括目标检测、跟踪等技术。目前,目标检测技术已经有着广泛而成熟的应用,主要有一阶段算法和两阶段算法两大类别:一阶段算法从图像直接预测目标,速度较快但精度较低;两阶段算法先在图像上产生可能包含目标的候选框,再对候选框进行修正,该类算法精度高但速度较慢,以区域卷积神经网络(Region-Convolution Neural Network,RCNN)系列[5-7]为代表。一阶段算法,如YOLO检测算法[8],凭借其检测速度快且不失准确率的优点目前被广泛应用于目标检测领域中。特别是YOLOv3[9],其主干网络 DarkNet53 特征提取性能强大,检测精度有了很大提升,成为目标检测领域精度和速度都表现较好的算法。虽然YOLOv3对在检测精度上表现优异,但是其主干网络DarkNet53仍包括53层卷积层,巨大的计算量和参数量会影响实际高速公路车辆监测的实时性。YOLOv3-tiny[9]是一种低参数量的检测方法,只需34.7 MB的储存空间,有训练速度快、训练时所需显存少、检测速度快等优点。但YOLOv3-tiny对图像的深层特征的提取能力较弱,泛化能力较差,尤其是对多场景变化以及尺度变化较大的物体检测效果不理想。为解决实时性问题,在特征提取主干网络上,笔者将主干部分特征提取网络替换成EfficientNet[10]轻量级网络,其为一个可以平衡缩放网络输入图像分辨率、网络宽度和网络深度的模型,减少了模型参数量,增强了其特征提取能力,使网络处于高效、平衡的状态。

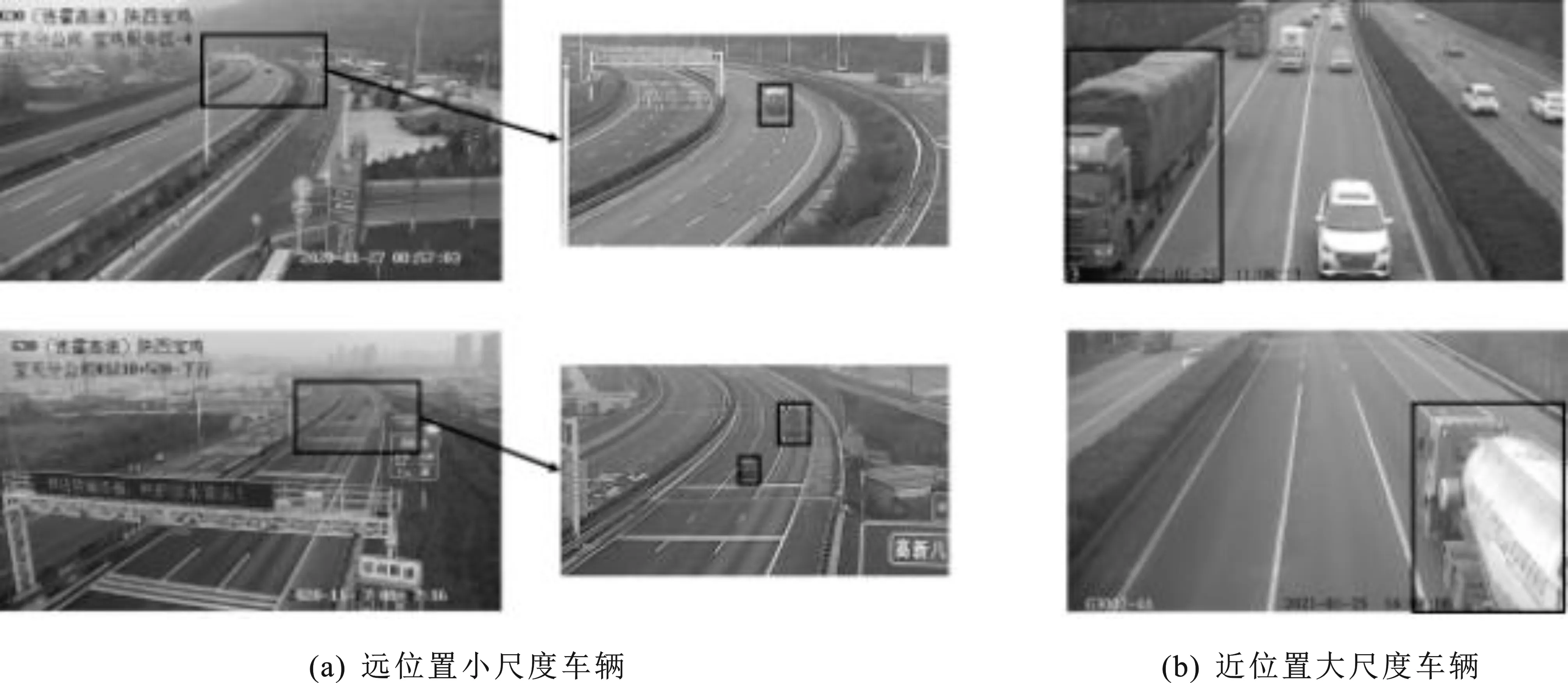

如图1所示,高速公路监控场景多样,拍摄角度也不尽相同,存在车辆在监控画面中的不同位置尺度不同的情况。如何有效地表示和处理多尺度特征,是目标检测中的主要难点。因此,在检测车辆时需进行多尺度特征融合。LIN等[11]提出了特征金字塔网络(Feature Pyramid Networks,FPN),将神经网络中更抽象的顶层特征进行上采样,并通过横向连接将其与神经网络前向传播过程中生产的相同大小的特征图进行融合,在基本不增加计算量的情况下,提高了模型对小物体的检测能力。在特征金字塔网络的基础上,LIU等[12]提出PANet,PANet 在特征金字塔网络原有的结构上添加了一条自底向上的路径聚合网络,进一步提升了效果,但PANet的参数量和计算开销都比较大。以上这些融合特征金字塔网络都只是简单地上采样后将特征相加,没有考虑不同分辨率特征贡献程度的差别。

图1 监控画面中的不同尺度车辆

在多目标跟踪算法方面,基于匈牙利算法的后端追踪优化算法,如 SORT[13]、DeepSORT[14]算法,能够满足实时跟踪的要求。其中,DeepSORT算法在SORT算法的基础上,通过提取深度表观特征明显提高了多目标的跟踪效果。

综上所述,笔者提出并应用于面向高速公路的车辆视频监控分析系统,主要创新点如下:

(1)提出实时、高效的高速公路车辆监测系统,通过分析高速公路监控视频,以车辆检测跟踪为基本算法可完成车流量统计、交通异常事件检测等事件,实现面向高速公路的车辆视频监控分析系统,达到高速公路实时高效智能化车辆管理的目的;

(2)为解决高速公路车辆监测中的场景多变、多尺度目标检测问题,同时兼顾车辆检测的精度和速度,提出了基于双向金字塔多尺度融合的轻量级车辆检测跟踪算法,使用EfficientNet轻量级网络,实现了检测模型的轻量化和目标检测实时性;同时增加双向特征金字塔网络,对原模型多尺度融合模块进行优化,利用跨尺度连接和加权特征融合在参数量更小的情况下实现对多尺度车辆的检测;

(3)依据真实视频数据构建了一个包含不同交通场景的车辆目标数据集,场景包括高速公路白天、高速公路傍晚、高速公路低能见度、高速公路收费站以及隧道视角,以验证高速公路监控场景变化问题。

1 面向高速公路的车辆视频监控分析系统

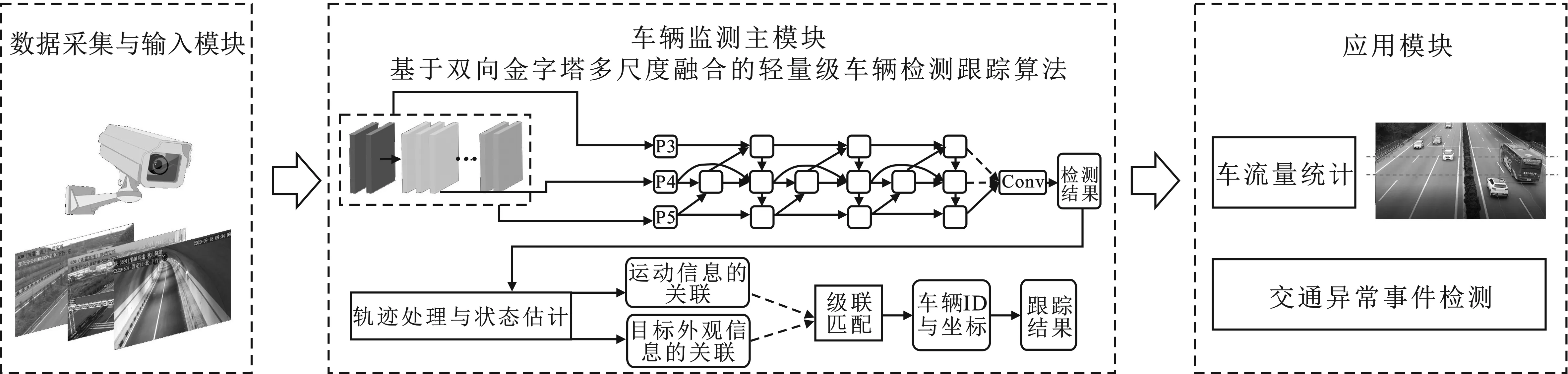

为解决高速公路实时智能化车辆监测问题,笔者提出了面向高速公路的车辆视频监控分析系统,整体框架如图2所示。该系统主要分为高速公路数据采集与输入模块、车辆监测主模块和应用模块。下面对每一模块功能进行介绍。

图2 面向高速公路的车辆视频监控分析系统整体架构

数据采集与输入模块:通过高速公路上的监控摄像头拍摄视频,采集实时视频流数据,并将视频流数据以连续帧序列的结构输入车辆监测主模块。

车辆监测主模块:即基于双向金字塔多尺度融合的轻量级车辆检测模型,包含车辆检测模块和车辆多目标跟踪模块。车辆检测模块采用多尺度融合的轻量级车辆检测方法对输入的连续帧序列进行车辆检测;将车辆检测模型输出的每辆车候选框大小和位置信息输入至车辆跟踪模块,采用DeepSORT多目标跟踪方法进行跟踪,得到连续帧内车辆的坐标、轨迹信息。

应用模块:结合车辆检测和跟踪所得到的信息,采用虚拟线设置技术进行车流量统计;采用车辆坐标及轨迹变化进行高速公路异常事件的判断。

2 基于双向金字塔多尺度融合的轻量级车辆检测跟踪模型

在车辆监测主模块,提出了基于双向金字塔多尺度融合的轻量级车辆检测跟踪算法,以达到实际高速公路场景的应用要求。针对高速公路监控摄像头拍摄画面中存在的拍摄视角多样、高速公路场景多样、车辆尺度变化等问题,提出了基于双向金字塔多尺度融合的轻量级车辆检测跟踪模型。下面对该模型进行详细介绍。

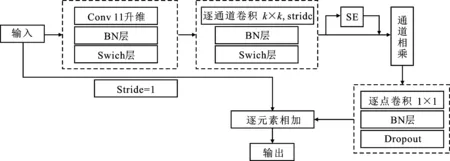

2.1 车辆检测模块特征提取网络的轻量化

为改善 YOLOv3的特征提取能力以及降低模型参数,引入EfficientNet作为特征提取主网络。对应不同场景的需求,EfficientNet系列网络有B0~B7共8种由小到大的网络模型。针对高速公路监控场景车辆检测任务,兼顾检测精度与实际运行速度,故将EfficentNet-B2去掉最后的全局平均池化层、Dropout 层和全连接层后代替YOLOv3原始的DarkNet53网络进行特征提取,得到YOLOv3-EffiNet网络,具体结构如图3所示。

输入图像 EfficientNet-B2特征提取网络 多尺度融合 检测结果输出

将摄像头采集到的视频流通过连续帧序列的方式输入至EfficientNet-B2特征提取网络。EfficientNet-B2网络可以平衡缩放网络输入图像分辨率、网络宽度和网络深度,减少了模型参数量,增强了其特征提取能力,使网络处于高效、平衡的状态。其网络结构如图4所示。EfficientNet-B2由多个 MBConv(MobilenetV2卷积[15])模块构成,MBConv中包含深度可分离卷积,Swish 激活函数以及Dropout连接。MBConv网络模型结构如图5所示。深度可分离卷积是由逐通道卷积(Depthwise Convolution)和逐点卷积(Piontwise Convolution)组合而成的。逐通道卷积中每一个通道被一个卷积核独立计算,没有利用不同通道在相同的空间区域上的特征信息,因此使用逐点卷积将逐通道卷积产生的特征图进行融合。逐点卷积的卷积核大小为 1×1,对逐通道卷积产生的特征图在深度方向进行加权组合,得到最终的输出特征层。

图4 EfficientNet-B2网络结构

图5 MBConv模块结构

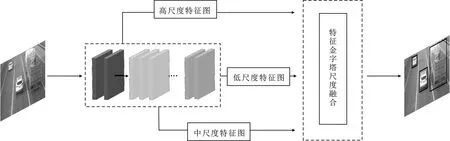

2.2 双向特征金字塔网络多尺度特征融合

针对高速公路监控摄像头拍摄画面中存在的拍摄视角多样、摄像机参数设置导致车辆变形、车辆尺度变化等问题,应用双向金字塔网络多尺度融合方式替代YOLOv3中特征金字塔网络堆积融合方式,以提高对多尺度车辆的检测准确性。

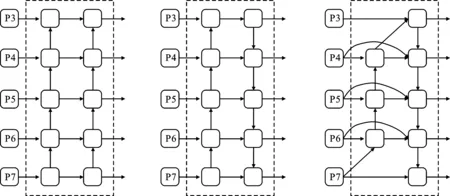

如图6所示,FPN网络和PANet网络融合方式都只是简单地上采样后将特征相加,没有考虑不同分辨率特征贡献程度的差。双向特征金字塔网络(Bi-directional Feature Pyramid Network,BiFPN)[16]利用跨尺度连接(Cross-Scale Connections)和加权特征融合(Weighted Feature Fusion)在参数量更小的情况下取得了更好的效果。

(a)FPN网络 (b)PANet网络 (c)BiFPN网络

跨尺度连接:双向特征金字塔网络的跨尺度连接在PANet网络基础上主要从3个方面优化了特征网络。(1)在 PANet 中的部分节点只有一个输入,这意味着这些节点没有进行特征融合。特征网络的目的是融合不同的特征,因此这些节点对特征融合的贡献很小。BiFPN移除这些节点简化了网络结构,减少了计算开销。(2)BiFPN在相同 level 的输入和输出之间增加一个连接,在没有增加太多计算开销的情况下融合了更多的特征。(3)将 BiFPN 当作一个基础的特征网络层,并将其重复多次,每一层都会在原有的融合特征上进一步提取到更高层次、更加抽象的融合特征。

加权特征融合:对不同分辨率的特征进行融合时,通常将所有输入的特征视作同等重要;输入相同的特征权重,这种方式过于简单,可能会在融合的过程中损失一些有用的信息。加权特征融合为每个输入的特征赋予了不同的权重,并让网络自动地学习每个输入特征的权重。加权特征融合的函数表达式为

(1)

其中,ωi是可学习的权重,ε是一个远小于 1 的数。从式(1)可以看出,特征融合的权值被限制在 0~1 之间,并且成功地避免了使用会使计算时间显著增加的softmax 函数。式(2)及式(3)描述了在 level 6 上BiFPN网络的跨尺度连接和加权特征融合的过程:

(2)

(3)

其中,Pin为输入特征,Pout为输出特征,Ptd为自顶向下的特征融合过程中的中间层。

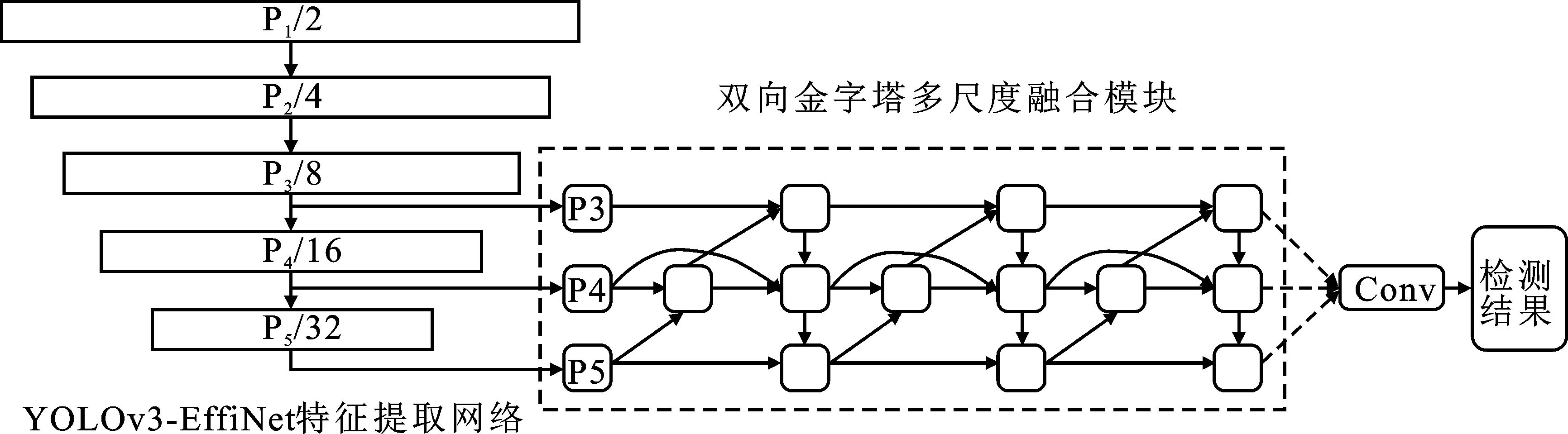

车辆检测模块的特征融合如图7所示,将双向特征金字塔多尺度特征融合与节2.1中提出的EfficentNet-B2主干网络结合。EfficentNet-B2特征提取网络共有23个MBConv模块,取第8个MBConv模块的输出层为 P3层(低特征层),取第16个MBConv模块的输出层为 P4层(中特征层),取第23个MBConv模块的输出为 P5 层(高特征层),并在 P3、P4和P5层之间使用BiFPN融合方式重复3次,进行多尺度特征融合。每一次融合在原有的融合特征上进一步提取到更高层次、更加抽象的特征,以提升检测的鲁棒性。

图7 车辆检测模块的双向特征金字塔多尺度特征融合

2.3 DeepSORT车辆跟踪

通过车辆检测模块可以得到视频连续帧中的车辆候选框大小和位置信息,并将其输入 DeepSORT多目标跟踪模块对待跟踪的车辆目标进行轨迹追踪,得到待跟踪车辆出现的坐标集合、整个轨迹及其对应的帧数。DeepSORT在图像空间中通过卡尔曼滤波预测,使用匈牙利算法逐帧关联数据,由关联度量计算边界框的重叠率。它在处理跟踪问题上的具体过程主要包括状态估计、轨迹处理、信息关联和级联匹配等步骤。

状态估计和轨迹处理:DeepSORT使用标准卡尔曼滤波器进行目标车辆的运动状态预测,其帧频采用25 帧每秒。对每个车辆的跟踪器设置一个计数器,使其在卡尔曼滤波预测期间依次递增。如果跟踪与检测结果相互匹配,则跟踪器的计数器重置为0;如果一个跟踪器在一段时间内一直找不到匹配的结果,则将该跟踪器从列表中删除。当某帧出现新的检测结果时,为该帧创建新的跟踪器。如果新跟踪目标位置的预测结果与检测结果能够连续3帧相匹配,则认为出现了新的目标;否则,认为出现了“虚警”,并从跟踪器列表中删除该跟踪器。

信息关联:对于目标运动信息的关联程度计算,使用检测框与跟踪器预测框之间的马氏距离来描述:

(4)

(5)

与SORT算法把检测和跟踪框的IoU作为输入,采用匈牙利算法输出匹配结果不同。DeepSORT算法采用融合度量的方式,同时考虑了运动信息和目标外观信息的关联。将两种方式进行线性加权来计算最终检测和跟踪轨迹之间的匹配程度:

ci,j=λl(1)(i,j)+(1-λ)l(2)(i,j)。

(6)

级联匹配:当一个目标被长时间遮挡后,卡尔曼滤波预测的不确定性就会大大增加。此时如果两个跟踪器竞争同一个检测结果的匹配权,则一般遮挡时间较长的那条轨迹因为长时间没有更新位置信息,使得马氏距离会更小,因而更可能和遮挡时间较长的那条轨迹相关联。这种不理想的效果往往会破坏跟踪的持续性。而级联匹配思想的核心是由小到大对消失时间相同的轨迹进行匹配,这样能够保证对最近出现的目标赋予最大的优先权。

3 实验与结果分析

3.1 数据集的构建

为验证笔者所提出的高速公路车辆监测系统的有效性以及算法的实时性和准确性,构建陕西地区高速公路视频监控数据集,包括绕城高速、西汉高速及终南山隧道等路段。其中西安绕城高速位于靠近市区地区,具有车流量大、车速适中、摄像头拍摄角度多样等特点;而西汉高速及终南山隧道位于秦岭区域,具有车辆种类多样、车速快、隧道多等特点。该车辆监测视频数据集的场景包括高速公路白天、高速公路晚间、高速公路低能见度、高速公路收费站以及隧道等视角,具有多场景变化的特点,如图8所示。

图8 高速路多场景监控数据集

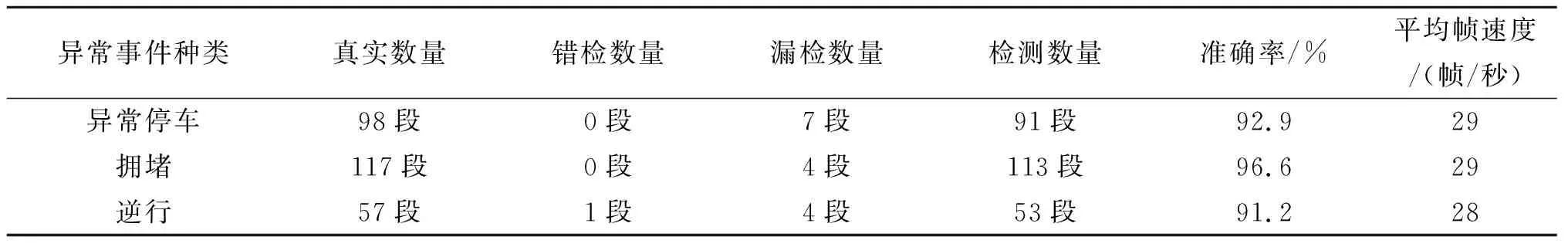

视频总长度达到273 h,存储总量达到了400 GB。为建立多样化数据集,对不同场景中的不同车辆按照VOC数据集样式进行了标注。同时,为了验证车辆监测系统在高速公路异常事件检测应用的准确性,选取了98段包含异常停车事件的视频、117段包含拥堵事件的视频和57段包含逆行事件的视频,并对每段视频分别标记异常事件标签,以作为异常事件检测数据集。

为了验证笔者所提出的高速公路车辆检测跟踪系统针对多尺度变化目标的准确性,在数据集标注时特别对监控场景中的远处小目标车辆、近处大目标车辆等存在多尺度变化的车辆进行标注。如图9所示,标注类别为小汽车、货车、出租车和面包货车,并应用高斯噪声、随机裁剪等方法进行数据增强。最终数据集包含2 278张高速公路监控视频,以接近7∶3的比例划分数据集,其中将1 593张用于训练,685张用于测试。在训练过程中采用边训边验的方式,随机选取训练集的230张用于验证。

图9 数据集车辆类别

3.2 评价指标

在车辆检测模块中使用精确率(Precision)、召回率(Recall)、平均精度(AP)、全类平均精度(mAP)及总耗时和平均耗时来判断检测结果。

交并比(IoU)衡量的是两个区域的重叠程度,即模型产生的目标窗口与原来标记窗口的交叠率。检测的IoU计算公式如下所示:

(7)

在理想情况下,IoU=1,即完全重合。

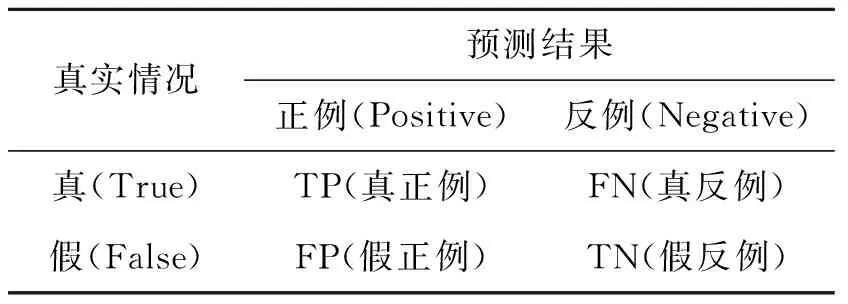

在混淆矩阵中,TP表示将真实正样本预测为正样本的数量,TN表示将真实负样本预测为负样本的数量,FP表示将真实负样本预测为正样本的数量,FN表示将真实正样本预测为负样本的数量。由表1混淆矩阵可计算出各个评价指标。

表1 混淆矩阵

精确率表示预测正样本中真实正样本的比例:

(8)

其中,PR表示精确率,TP表示将真实正样本实例预测为正样本的数量,FP表示将真实负样本预测为正样本的数量。

召回率表示真实正样本被预测正确的比例:

(9)

其中,R表示召回率,FN表示将真实正样本预测为负样本的数量。

每个预测样本经过分类后,都得到了一个置信度,表示该样本为正样本的概率。大于某一阈值的样本被预测为正样本,反之为负样本。置信度阈值不同,会使得混淆矩阵发生变化,得到不同的精确率和召回率。以精确率为纵轴,召回率为横轴,绘制出P-R曲线辅助分析。平均精度即P-R曲线与横轴围成的面积。平均精度越大,模型性能越好。而mAP是多个类别平均精度的平均值,用于衡量多分类检测器的性能:

(10)

此外,在车辆监测系统应用实验中,使用帧速度(Frames Per Second,FPS)来评估目标检测和跟踪的速度,即每秒内可以处理的图片数量。帧速度越大,检测速度越快。当帧速度大于等于25时,可以认为算法满足实时性要求。在车流量统计应用实验中,使用车流量统计准确率(Flow Accuracy)来评估模型的准确性,即模型在固定时间内检测到的车流量总数(Flow Detected Number,FDN)与实际车流量总数(Flow Truth Number,FTN)的比值。

在异常事件检测应用实验中,使用异常事件检测准确率(Event Accuracy)来评估模型的准确性,即模型在各类事件检测数据集上检测到的包含异常事件视频总数(Event Detected Number,EDN)减去错检视频总数(Fault Detection Number,FDN)与实际异常事件视频总数(Event Truth Number,ETN)的比值。

将车流流量统计准确率、异常事件检测准确率分别结合在应用中模型的帧速度,以评估所提出的车辆监测系统的有效性。

3.3 实验环境与参数设置

使用python作为算法编程语言,用Pytorch深度学习框架搭建网络,并用GeForce RTX 2080Ti平台进行实验。操作系统为Ubuntu18.04,配套环境为CUDA11.2,Python3.6.9,Pytorch1.7.1。训练前设置网络初始学习率为0.001,网络初始输入分辨率为416×416,Batch size取4,epoch为200。

依据高速公路领域的工程背景,现已进行初步的落地测试。在异常事件检测实验中,本系统开发配置环境为Ubuntu18.04系统、CUDA11.2、Python3.6.9、Pytorch1.7.1、opencv-python4.5.3.56,环境包含easydict、scipy、matplotlib和tqdm等。

3.4 车辆检测实验结果

为验证车辆检测算法的有效性,将YOLOv3、YOLOv3-tiny、YOLOv3-EffiNet与YOLOv3-EffiNet+BiFPN模型分别在笔者制作的数据集上训练200个epoch,将获得的模型权重在685张测试集上进行评估。实验结果如表2所示,其中mAP表示4类车型平均检测精度的平均值,平均耗时表示平均处理一张图片所用的时间。

表2 4种检测模型在数据集上性能的对比

由实验1和实验3结果对比可得,YOLOv3-EffiNet轻量化模型参数储存空间为62.9 MB,mAP为91.47%,比原始YOLOv3的mAP高约9.7%,同时平均耗时缩短约35.3%;由实验1、实验3和实验4对比可知,笔者所提出的检测模型YOLOv3-EffiNet+BiFPN 参数储存空间为67.6MB,仅为原YOLOv3模型的约1/4;由于增加了双向特征金字塔尺度融合,虽然其速度与YOLOv3-EffiNet相比有所下降,但其 mAP高达97.11%,比原YOLOv3高约16.5%,比YOLOv3-tiny高约27.7%,同时检测的速度与YOLOv3相当,可达到实时性。这充分证明了文中改进检测模型的有效性。

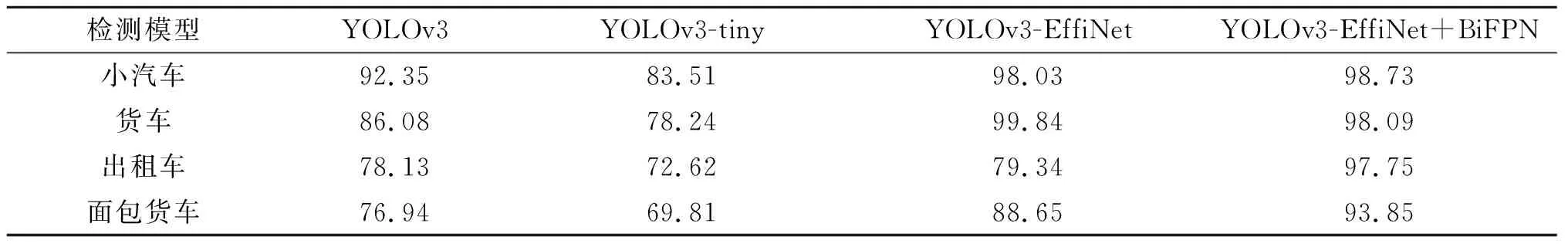

同时,为验证YOLOv3-EffiNet+BiFPN算法模型对不同车辆的检测准确性,对各算法在高速公路上不同车型的检测准确率进行展示(如表3)。由实验结果可以看出,笔者提出的算法对各种车型的检测准确率均优于原始YOLOv3模型,且对小汽车、货车、出租车的检测准确率均在97%以上。

表3 不同车型检测平均精度 %

为了分析模型在高速公路场景中存在车辆尺度多样情况下的检测效果,从测试集中分别选取存在大小尺度车辆的特殊场景,用YOLOv3、YOLOv3-tiny与YOLOv3-EffiNet+BiFPN模型分别进行检测。检测结果如图10所示。

(1)针对大尺度车辆,YOLOv3-EffiNet+BiFPN模型对大尺度车辆检测精度高于其余两种算法;(2)针对视频远端的小尺度车辆,YOLOv3和YOLOv3-tiny对监控中的小目标不敏感,会出现检测不到的情况,而YOLOv3-EffiNet+BiFPN模型可以检测出视频中所有车辆,包括极小目标;(3)针对隧道内摄像头参数原因导致车辆变形的情况,YOLOv3模型会出现目标误识别(将面包货车误识别为小汽车),YOLOv3-tiny模型对隧道内变形的小目标不敏感,而YOLOv3-EffiNet+BiFPN模型在车辆变形情况下仍能保证高准确率的检测。对比实验结果表明,笔者提出的YOLOv3-EffiNet+BiFPN模型对图像中多尺度、变形目标的检测效果优异。

3.5 车辆监测系统应用

3.5.1 车流量统计

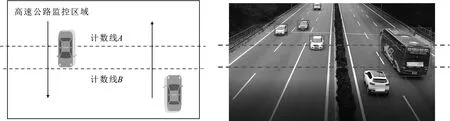

通过车辆检测及跟踪模块得到待跟踪车辆出现的坐标集合、整个轨迹及其对应的帧数,输入至应用模块完成车流量统计。在车流量统计任务中,采用监控画面实时对车辆目标计数,实现流量实时统计。计数部分采用虚拟线设置技术,在监控区域任意需要检测的位置设计虚拟计数线,通过判断车辆跟踪模块获得的车辆轨迹(由跟踪窗口中心点组成)是否越线来对车流量进行统计。考虑到高速公路摄像头的安装位置不同,所拍摄画面可能存在单车道、多车道、双向车道等情况,采用单虚线计数无法对车辆的运动方向、在监控区域的滞留情况进行准确判断,因此采取如图11所示的双线虚拟计数。车辆轨迹由A→B视为下行,当越过B线时,下行车辆加1;由B→A视为上行,当车辆跨过A线时,上行车辆数加1;上行车辆数与下行车辆数的和记为该时刻总车流量。

图11 车流量统计示意图

为验证笔者所提出的系统在车流量统计应用上的准确性,将模型YOLOv3、YOLOv3-tiny、YOLOv3-EffiNet及YOLOv3-EffiNet+BiFPN分别与DeepSORT结合,根据双向计数规则,接入实际高速公路监控视频进行30 min检测,统计结果如表4所示。据统计,视频段中实际上行车辆856辆,实际下行车辆625辆,总车辆数1 481辆。由结果可得,YOLOv3-EffiNet+BiFPN+DeepSORT模型实际检测上行车辆数792辆(漏检64辆),下行车辆数590辆(漏检35),总车辆数1 382辆,统计准确率约93.3%,平均运行速度达到31帧/秒,满足实时性要求。

3.5.2 异常事件检测

在进行高速公路监控视频的检测和跟踪后,可以得到每辆车的实时坐标信息和轨迹信息。因此笔者所提出的系统根据车辆坐标的变化信息,可以进行简单交通事件的检测,如高速公路车辆违停、交通拥堵、车辆逆行事件的检测。其检测策略如下:(1)车辆违停。根据车辆在连续帧画面中的坐标位置变化,可判断该车辆存在车辆违停事件。(2)交通拥堵。根据该时刻监控画面中车辆识别码数是否大于该场景下车辆阈值,可判断该路段存在交通拥堵事件。(3)车辆逆行。首先对高速公路监控画面按照正常的车流方向进行手动分割,而后判断在某个方向区域内,根据车辆在连续帧中坐标位置变化与车流方向相反,可判断该路段存在车辆逆行事件。图12展示了异常事件的视频数据例图。

图12 异常事件种类检测效果展示

为验证系统在事件检测应用的准确性,将笔者提出的车辆监测模型结合异常事件检测策略,在包含异常停车事件、拥堵事件和逆行事件的272段视频组成的异常事件数据集上进行检测,统计结果如表5所示。由检测结果可得,笔者提出的车辆监测模型在高速公路停车、拥堵和逆行事件检测上的准确率均达到90%以上,错检率低于5%,漏检率低于10%,且平均运行速度满足实时性要求。

表5 异常事件检测结果

同时为验证系统的有效性,笔者接入帧率为 25 帧每秒的实时视频流数据进行检测。在保证每路视频的车流量统计和异常事件检测达到上述准确率的情况下,可以最大支持16路监控视频同时检测。由此说明笔者提出的系统实现了车辆检测、跟踪、车流辆检测和异常事件检测的有效性,具有实际应用价值。

4 结束语

笔者提出了一套面向高速公路的车辆视频监控分析系统。针对高速公路监控场景中车辆检测跟踪的多尺度问题和检测实时性要求,设计了一种基于双向金字塔多尺度融合的轻量级车辆检测跟踪算法。基于YOLOv3模型在主干网络上使用轻量级网络EfficientNet,并采用双向特征金字塔网络模块进行多尺度特征融合。同时依据采集到的真实视频数据构建了一个包含不同交通场景的车辆目标数据集,以解决高速公路多场景问题。实验结果表明,YOLOv3-EffiNet+BiFPN模型检测精度达97.11%,高于原始YOLOv3检测算法约16.5%,并且结合DeepSORT模型在车辆跟踪上以31帧每秒的帧速度实时运行。同时该车辆监测系统可在车流量统计、交通异常事件检测领域进行多路实时检测,具有实际应用价值。