注意力机制的多尺度单目标跟踪算法

2021-11-12宋建锋苗启广王崇晓

宋建锋,苗启广,王崇晓,徐 浩,杨 瑾

(西安电子科技大学 计算机科学与技术学院,陕西 西安 710071)

单目标跟踪是计算机视觉领域重要的研究课题之一。其概念被定义为在给定视频的初始时刻,给出感兴趣的目标,在后续视频序列中以矩形框的形式将跟踪结果进行展示[1]。单目标跟踪技术广泛应用于智能视频监控、现代化军事、智能视觉导航等国防及民用领域[2]。

近年来,随着深度学习的发展,基于深度学习的单目标跟踪算法取得显著进展。文献[3]提出的利用多层卷积特征的跟踪器,结合深度特征与相关滤波算法,摒弃传统的手工特征提取,取得了很好效果。文献[4]提出基于全卷积网络的跟踪算法(Fully-Convolutional Siamese networks for object tracking,SiameseFC),该算法是基于孪生网络结构的单目标跟踪算法,核心是基于模板匹配思想,通过互相关运算,将得分图上个的最大响应点作为目标。文献[5]提出多域网络跟踪算法(Multi-Domain Network,MDNet),用于解决网络离线训练时可能不包含目标的问题。该算法使用图像分类任务的预训练模型VGG-M作为特征提取网络,在特征提取网络后加入2个全连接层作为分类器,取得良好跟踪效果。文献[6]提出的基于重叠面积最大化的跟踪算法(Accurate Tracking by Overlap Maximization,ATOM)是表现最好的实时跟踪算法之一。该算法将跟踪过程分为检测分支和目标粗定位分支。其中,检测分支离线训练好,目标粗定位结果是目标分类网络的输出,目标分类网络使用共轭梯度法在线微调,其取得卓越的效果。文献[7]提出有一种图注意力机制的局部匹配模型,增强特征提取鲁棒性以提升跟踪效果。

目前,已有算法对目标尺度变化等挑战具有良好的鲁棒性,但在单目标跟踪过程中面对相似目标干扰、目标遮挡、目标消失挑战时,已有算法由于利用的目标特征单一,无法有效结合局部特征和全局特征,导致相似目标干扰、背景和跟踪目标的判别能力不强,产生错误跟踪结果;在面对目标消失时,由于网络的在线更新无法对目标消失的视频帧进行筛选,导致不可靠的视频帧参与到网络在线更新过程,产生模型漂移,进一步产生错误跟踪结果。针对这些问题,笔者结合ATOM算法特点,提出新的跟踪算法,使其在实际应用过程中有更鲁棒的跟踪效果。

1 理论基础

现有工作表明,ATOM跟踪算法在实际应用中有不错效果,但面对目标遮挡、目标消失、相似目标干扰时容易出现跟踪错误情况。笔者以ATOM算法为基础,通过引入基于Inception[8]的多尺度网络来结合局部特征和全局特征,增强对背景和跟踪目标的判别能力。通过使用基于注意力机制的网络在线更新过程对视频帧进行筛选,增强网络在跟踪过程中的鲁棒性,提升跟踪效果。

1.1 ATOM跟踪算法

ATOM算法是2019年IEEE CVPR会议中提出的实时跟踪算法。该算法分为目标分类网络、目标评价网络以及网络在线更新三部分。

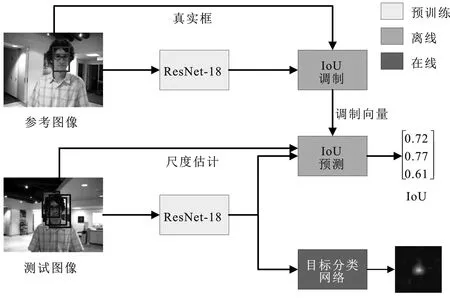

ATOM跟踪算法如图1所示。图1中目标分类网络由不同尺度的卷积核组成,主要用来判断某个位置是否有跟踪目标的存在,对目标和背景进行区分,完成对目标的粗定位,但其对目标的尺度并不敏感。

图1 ATOM跟踪算法示意图

目标尺度在目标跟踪中的具体意义为目标所在位置和目标的长宽,是目标评价网络中需要求解的。将跟踪框架分成目标分类网络和目标评价网络两个模块有助于提高整体的跟踪性能。网络在线更新[9]是在跟踪过程中,使用已经完成跟踪的视频帧对目标分类网络进行优化,使目标分类网络在当前的跟踪任务中对目标和背景有更好的区分能力,提高跟踪的鲁棒性。

1.2 Inception网络架构

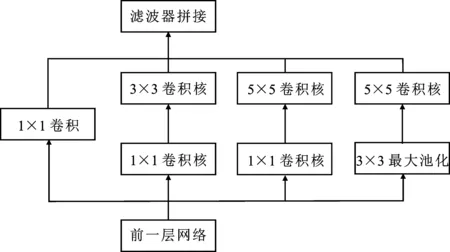

Inception网络架构使用了不同尺度的卷积核,在Inception V1 网络中的结构,如图2所示。这些卷积核尺度分别为3×3,5×5和1×1,这些不同尺度的卷积核能够提取不同尺度特征,增加特征多样性。

图2 Inception V1网络结构

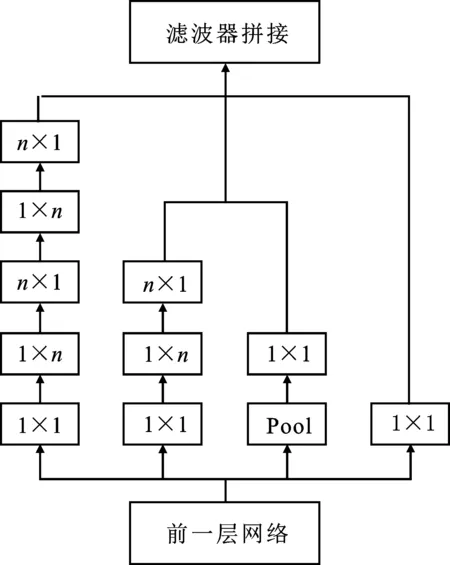

为减少网络参数过多带来的网络难以训练的问题,在Inception V3网络中使用非对称卷积网络,设计出如图3所示的Inception V3网络。

图3 Inception V3网络结构

Inception V3[10]网络利用7×1和1×7的2个卷积层卷积代替原始的7×7卷积层,利用5×1卷积层和1×5卷积层代替原始的5×5卷积层。该思想总结为使用尺度为1×n和n×1的2个小卷积核取代原始n×n的卷积核,相比把5×5用2个3×3代替能更有效减少参数量,并通过减少计算量提升推理速度,同时利用这种非对称的卷积结构能够产生更丰富的特征,增加特征多样性。

1.3 目标跟踪中的注意力机制

在计算机视觉领域,注意力机制常用于强化网络对目标部分的学习,弱化背景对网络的影响。在深度卷积网络中,注意力机制可以实现自动选择图像中感兴趣部分区域,或对输入图像的不同位置赋予不同的权重。文献[11]将注意力机制与残差网络相结合,提升了目标跟踪的准确度和鲁棒性。笔者通过利用网络的输出,计算网络关于输入图像的偏导数作为注意力图。而偏导数作为注意力图的原因是在深度神经网络的前向传播的过程中,可以利用一阶泰勒公式进行展开描述:

fc(I)≈AcTI+B,

(1)

其中,I表示输入图像,c表示图像属于某一特定类别,fc表示深度神经网络的输出,该公式表示的意义是输入图像属于类别c的可能性,AcT表示网络相对于输入I的梯度,B表示偏置。对于AcT,可以表示为

(2)

从式(2)中可以看出,输入图像I的类别受到Ac值的影响。Ac内部的元素值表示输入图像I0的对应像素对最终类别得分的贡献度,其中,输入图像目标区域的贡献度高,背景区域的贡献度较低。因此,可将Ac看做是当前图像的注意力图,对输入的图像,可以利用前向传播得到预测值,然后利用链式求导法则进行反向传播,得到的偏导数Ac作为注意力图[12]。需要注意的是,在求解偏导数的过程中不会进行网络更新,也不改变网络参数。

2 基于注意力机制的多尺度单目标跟踪算法

2.1 基于Inception的多尺度目标分类网络

为强化ATOM的目标分类网络对相似目标干扰、目标遮挡的判别能力,笔者结合Inception网络架构,利用Inception架构的多感受野思想,让网络学习到目标局部特征和全局特征,通过不同层次的特征融合,增强网络对目标遮挡或者相似目标干扰的区分能力。其原始目标分类网络与改进后的基于Inception的多尺度目标分类网络对比如图4所示。

图4 目标分类网络改进示意图

虚线范围内为基于Inception结构的目标分类网络。在输入视频帧后经过ResNet-18提取block4卷积特征,并输入到基于Inception结构的目标分类网络。首先经过卷积降低通道维度至64维度,以减少之后计算响应图所用卷积的参数量。将该特征图输入到第二层Inception网络结构中,经过非对称卷积操作,分别得到3个响应图,将这3个响应图融合为最终响应图。需注意虚线内第一层用于降维的卷积参数在网络更新阶段不参与更新,该参数在第一帧初始化后进行优化,在后续跟踪中不需要进行更新。通过这种网络结构能够捕捉被跟踪目标的细节和整体特征,同时融合不同尺度下的响应,能更准确地对目标进行粗定位。

2.2 基于注意力机制的网络在线更新过程

笔者提出基于注意力机制的网络在线更新过程,将注意力图与网络在线损失函数进行结合,提出基于注意力机制的损失函数。

当输入的图像为I0,通过网络的前向传播可以得到在目标分类网络的输出S。对输出S利用链式求导法来计算其对I0的偏导数,得到注意力图Mattention。在这里引入一个权重矩阵W。该权重矩阵代表在注意力图中各个点的重要程度,在此处的权重矩阵值定义如下:

(3)

其中,y表示对应的高斯标签中的像素值。当标签值大于等于给定阈值ε时,判断为前景[8],将权重矩阵值设置为标签对应位置的y+1;当标签中的像素值小于给定阈值ε时,判断为背景,将权重矩阵值设置为-1。

计算得到权重矩阵W及利用偏导数求取Mattention:

M=WMattention。

(4)

根据式(4)得到结果M,该矩阵代表对目标区域进行加权,提高对目标区域的关注,并强化目标和背景区域的差异。获得M后,在矩阵中计算目标区域元素的均值μp和方差σp,计算背景区域元素绝对值的均值μn和方差σn。在计算最终损失中,加入注意力图的正则项后,用于在线更新的损失函数如下所示:

(5)

式中,最后一项为上述对注意力图的正则约束,前半部分是原始的ATOM损失。其中,xj表示第j个样本的特征图;w表示目标分类网络的权重参数;yj表示第j个样本的标签,该标签是以目标为中心的高斯形状标签;f(xj;w)表示目标分类网络的输出;γj为超参数,用于调节损失函数;λk为对权重wk的正则系数;λj表示对注意力图的正则系数。在线更新阶段使用此损失函数,可对目标分类网络部分进行更新。

为将不存在目标的视频帧从网络在线更新的样本中剔除,笔者提出采用结合响应图得分响应比和注意力图响应比的方法[13],其中,注意力图Ma结合目标分类网络输出得到响应图Ms。

(6)

依据式(6)得到注意力图响应比Pa和响应图响应比Ps。公式中,分子用(x1,y1)至(x2,y2)表示最大响应范围,分母表示整个矩阵的元素值之和。

将响应图得分响应比和注意力图响应比依据式(7)进行加权求和,得到置信度P,用于判断当前跟踪视频帧是否为可靠视频帧。此处,Pa和Ps分别为注意力图响应比和目标分类响应图响应比,η1和η2分别取值为0.5。

P=η1Pa+η2Ps。

(7)

选取阈值为0.35。当置信度高于该阈值时,认为是可靠的跟踪结果,将该视频帧加入后续的网络在线更新过程;当置信度小于该阈值时,则认为当前跟踪结果不可靠,丢弃该跟踪视频帧,不让其参与后续的网络在线更新过程,避免产生模型漂移,学习到干扰或背景特征。

2.3 基于注意力机制的多尺度单目标跟踪算法

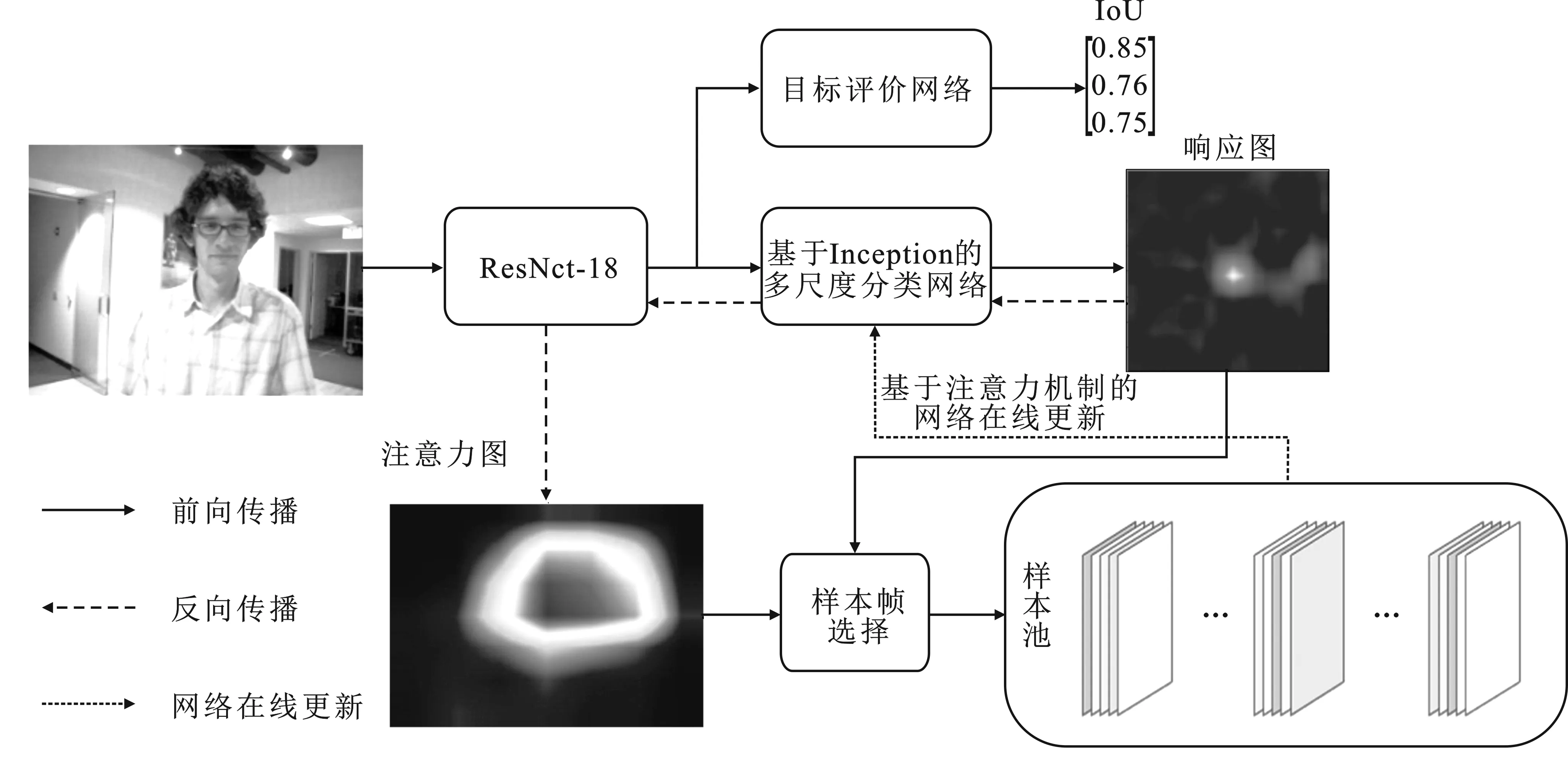

笔者结合基于Inception的多尺度目标分类网络和基于注意力机制的网络在线更新过程,设计基于注意力机制的多尺度单目标跟踪算法(IA-ATOM),如图5所示。

图5 基于注意力机制的多尺度单目标跟踪算法

算法的输入是要跟踪的视频帧,经过ResNet-18[14]提取block 3和block 4的特征,将block 4的特征图输入到基于Inception的目标分类网络,结合局部和全局特征,得到目标的响应图,实现对目标的粗定位。把响应图中最大响应点坐标还原到输入图像中,得到目标所在位置,结合上一帧跟踪结果中目标尺度信息得到最终结果。样本帧选择器的输入为注意力图和得分图,利用样本选择策略,将不可靠样本帧删除。在跟踪过程中,每经过10帧进行网络在线更新,在线更新的损失函数为式(5)的基于注意机制的损失函数,循环该过程完成目标跟踪。

3 实验与结果分析

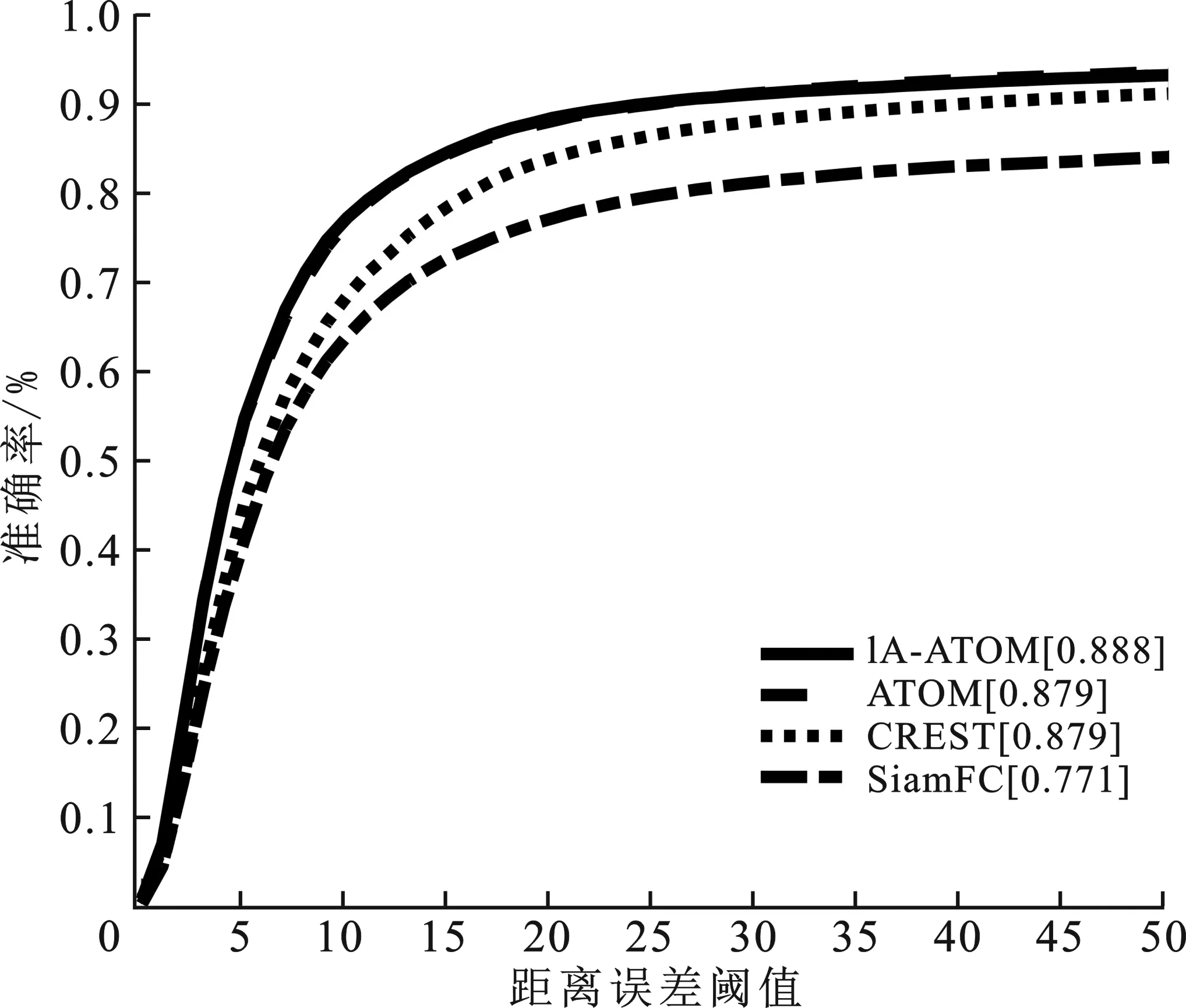

在测试数据集OTB-100[15]上测试算法效果,结果对比如图6所示。该测试数据集包含灰度图像和彩色图像,涉及到目标跟踪过程中出现的11种挑战。其中,每个测试序列都对应着2个或多个属性,每个序列都有人工标注的真实框文件;该手动标注的真实框文件中记录有人工标注的目标中心位置和目标大小。

(a)准确率

IA-ATOM算法在准确率上较ATOM算法有0.9%的提升,在成功率上有0.8%的提升,能有效改进ATOM算法。对比其他跟踪算法,笔者提出的方法也在准确率和成功率上存在较大优势。

IA-ATOM、ATOM、CREST[16]、SiamFC[17]算法在不同视频序列的跟踪结果如图7所示。其中第1行为Bird 1视频序列,第2行为Board视频序列,第3行为Soccer视频序列。Bird 1视频序列存在目标遮挡和相似目标干扰情况,在视频第150帧左右目标彻底消失,当目标重新出现后,存在多个相似目标干扰。ATOM算法和SiamFC算法由于目标分类网络的分类能力不强,导致错误跟踪目标。CREST网络由于在线更新过程没有剔除目标消失帧的影响,导致模型学习到背景信息,产生模型漂移,在目标出现后继续跟踪到背景上。而笔者提出的IA-ATOM算法能剔除目标消失不可靠的样本帧,并能保持目标和背景的良好分类能力,持续跟踪正确目标。

图7 跟踪结果对比图

在Board视频序列中,SiamFC算法和ATOM算法由于无法正确区分背景与目标,造成跟踪失败。笔者提出的算法能有效地关注目标局部和整体特征,对目标和背景有良好的区分能力,能正确跟踪目标。Soccer视频序列中存在目标消失、目标遮挡、相似目标干扰困难,ATOM、CREST以及SiamFC算法在面对目标遮挡、相似目标干扰情况时,由于其无法结合目标的局部与整体特征,容易产生错误跟踪结果;同时,由于ATOM和CREST的网络在线更新过程使用了不可靠视频帧,导致模型学习到背景信息,在目标跟丢后无法再次找回目标。笔者提出的算法通过结合局部和全局特征更好地对目标和背景进行区分,网络在线更新过程剔除了存在遮挡物或目标消失的不可靠视频帧,不让其加入更新过程,避免模型学到背景信息;同时基于注意力机制的损失函数强化网络学习到目标特征,有效地提高了跟踪效果。

4 结束语

基于深度学习模型,笔者研究了单目标跟踪过程中存在的目标遮挡、目标消失和相似目标干扰问题。为提高对这3类问题的鲁棒性,对ATOM跟踪算法进行改进,通过借鉴Inception网络结构对局部和全局特征进行结合,改进了目标分类网络,使其对相似目标干扰和目标遮挡有更好鲁棒性。通过研究目标跟踪过程中的注意力机制,提出基于注意力机制的损失函数,并加入样本筛选步骤,设计新的网络在线更新过程,使其对目标消失、目标遮挡、相似目标干扰有更好的适应性。最后结合两部分改进,设计出基于注意力机制的多尺度单目标跟踪算法,并在OTB-100数据集进行测试。该算法相较ATOM算法在准确率上有0.9%的提升,在成功率上有0.8%的提升,验证了算法的有效性。