基于深度学习的场景遥感图像分类方法研究

2021-07-01汪晓洲石翠萍杨焜王权

汪晓洲,石翠萍,杨焜,王权

基于深度学习的场景遥感图像分类方法研究

汪晓洲,石翠萍*,杨焜,王权

(齐齐哈尔大学 通信与电子工程学院,黑龙江 齐齐哈尔 161006)

:为了解决场景遥感图像通常分类性能较差、分类精度不高的问题,提出一种基于改进VGG16的场景遥感图像分类方法。针对传统VGG16模型参数量庞大的问题,对通道数以及参数量进行缩减。在算法运行过程中对数据进行正则化处理,并在分类方法中加入注意力机制。通过将注意力机制与CNN模型进行结合,并对两者进行端到端的训练,提高了模型的分类性能。在不同的分类与检测数据集上进行测试,实验结果表明,在相同的参数设置下,提出的方法能明显提高对场景遥感图像分类的性能。

深度学习;卷积神经网络;图像分类;场景遥感图像

近年来,随着航空遥感领域和卫星遥感领域技术的日渐增长,领域内应用的遥感图像分辨率也逐步提升,工作人员们可以从中提取到更精确以及更有效的图像信息。遥感图像与人们日常生活中所拍摄的照片相类似,都是一种可以从图像中获取有效信息的信息载体。通过遥感图像,可以辨别出很多地物信息,如水体、植被、土地、山地等。也可以从高分辨率遥感图像上辨别出较小的物体,如树、人、交通路口,甚至是篮球场内的中场标志线。与此同时,遥感影像分类随着时代的发展受到了广泛关注,越来越多的民用场合需要用到相应的遥感图像,如城市规划、自然灾害监测、地理图像检索等。计算机视觉与人工智能(Artificial intelligence,AI)技术更深层次的结合,使遥感场景分类得到了更广泛的应用。可以通过遥感图像分类获得土地利用图、植被覆盖图以及其他图像,进而应用于资源环境、土地利用、植树造林等多个场合。遥感场景分类是根据图像内容为图像分配唯一的标签(如机场或森林),以便于后续应用,其主要目的是区分图像中的各类地物,将各类地物的光谱特征测量值作为遥感图像分类任务的起始特征变量,通过图像上像素点的亮度及接近程度进行区分,进而完成分类任务。

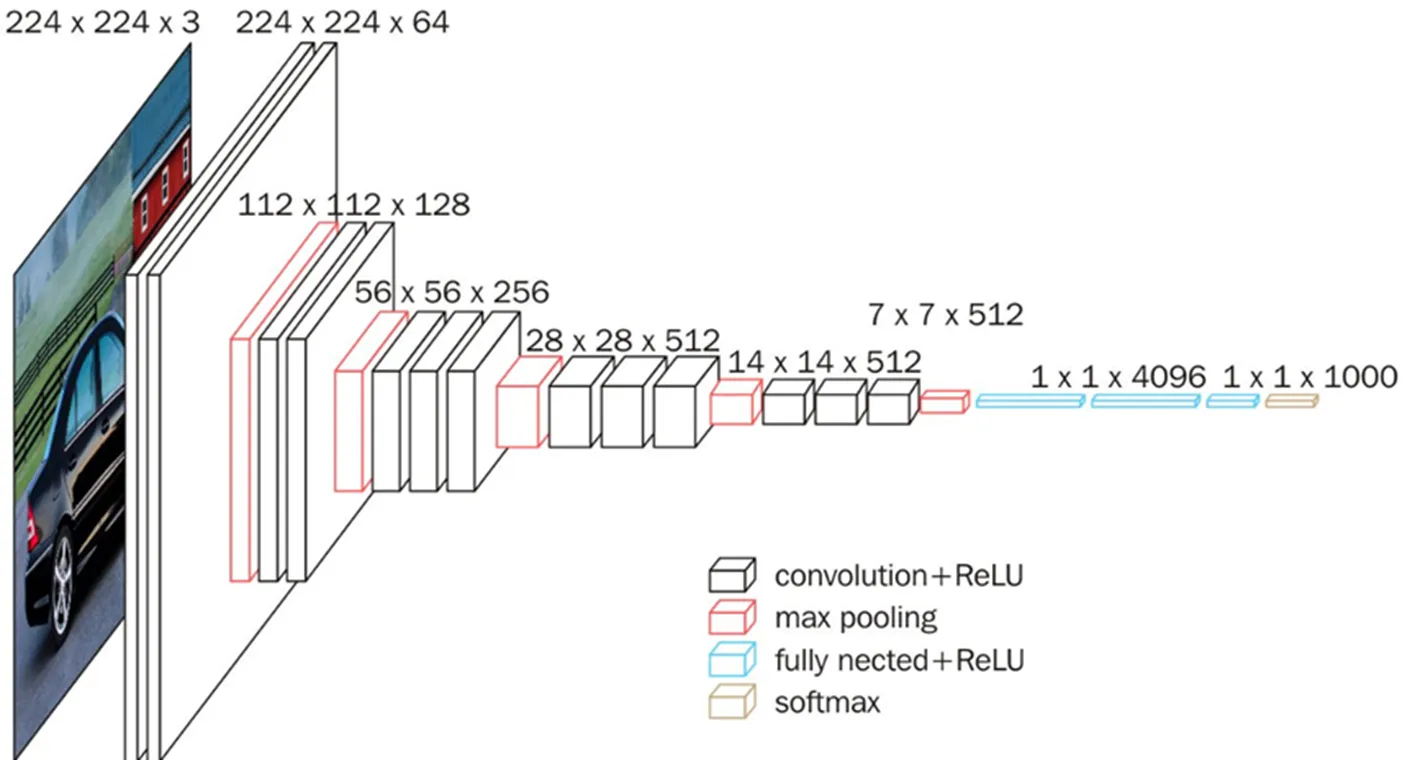

最近几年,卷积神经网络(Convolutional neural network,CNN)在计算机视觉领域发展迅速,大量基于CNN的模型被用于场景遥感影像分类[1-8]。通常情况下,基于CNN的模型在分类中性能要优于传统的模型。文献[1]中提出了VGG16模型,该模型是在2014年提出的一个具有历史性意义的卷积神经网络框架。其中,VGG网络模型引入了一个重要思想:卷积层使用3×3卷积核,并连续多次采用基于3×3卷积核的卷积层。如对原始图像进行3×3卷积后,继续进行3×3卷积,再继续进行3×3的卷积,如此连续地使用小卷积核对图像进行多次的卷积操作。连续多层卷积的网络架构会带来如下很多性能上的优化:(1)连续多层卷积的网络架构比单卷积层的网络结构能更有效地提取出图像的高维特征。因为卷积神经网络的每一层都要经过独立的训练,所提取的特征均不一样,层数越深,所提取的特征维度越高;(2)大幅减少卷积神经网络中的权重参数。由于缺乏方法对网络中大量的权重参数进行归一化、约减等操作,因此训练大卷积核的卷积神经网络模型就变得非常困难,对硬件和时间都有着更多的要求;(3)有效地减少边界特征的损失。假设卷积操作均使用Same padding,使得输入和输出特征矩阵大小相同。大卷积核在卷积前会在输入矩阵边缘填充更多的无效数据,导致卷积后产生大量的无效数据,影响特征提取的准确性。

1 系统模型分析

VGG模型的基本构成层是卷积层、全连接层以及softmax输出层。max-pooling(最大化池)层则用于分开与连接各类层,同时采用ReLU函数作为所有隐层的激活单元。

该模型的主要特点是通过运用多个较小卷积核的卷积层来替换一个卷积核较大的卷积层。这么做的好处是一方面减少了网络的参数量,而另一方面是让网络进行了更多的非线性映射,从而增强模型的表达及拟合能力。VGG虽然在网络结构上借鉴了Alex Net[4],取之代替的主要特点是小卷积核(如3×3),通过增加卷积子层数来达到同样的性能(VGG:从1到4卷积子层,Alex Net:1子层)。

文献[9]中认为一个5×5卷积的感受野大小可以通过使用两个3×3卷积的堆叠来进行近似替换;而7×7的卷积的感受野也可通过使用3个3×3卷积的堆叠来近似获取。同时相比Alex Net 3×3的池化核,VGG全部采用2×2的池化核。通过小池化核代替大池化核。VGG网络第一层的通道数为64,后面每层都进行了翻倍,最多到512个通道,通道数的增加,使得更多的信息可以被提取出来。为使模型在获取更深更宽架构的同时还能控制计算量的增加规模,则要通过运用卷积核来扩大模型的通道数、池化层来缩小模型的宽与高。VGG模型的详细结构如图1所示。

图1 VGG模型的结构示意图

2 算法提出与改进

近年来,注意力机制在各种图像识别以及分类任务中运用广泛。注意力机制(Attention Mechanism,AM)最早是在人类对视觉进行系统研究时所提出。它的机制借鉴于人类在进行信息处理时会选择性地去关注信息的主要部分而去忽略信息无用部分。注意力机制可以应用于任何类型的输入而不管其形状如何。在计算能力有限情况下,注意力机制是解决信息超载问题的主要手段的一种资源分配方案,将计算资源分配给更重要的任务。

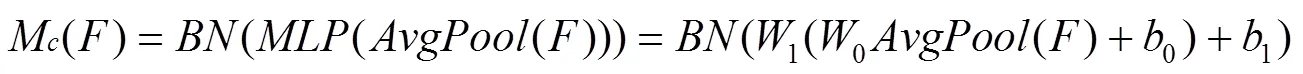

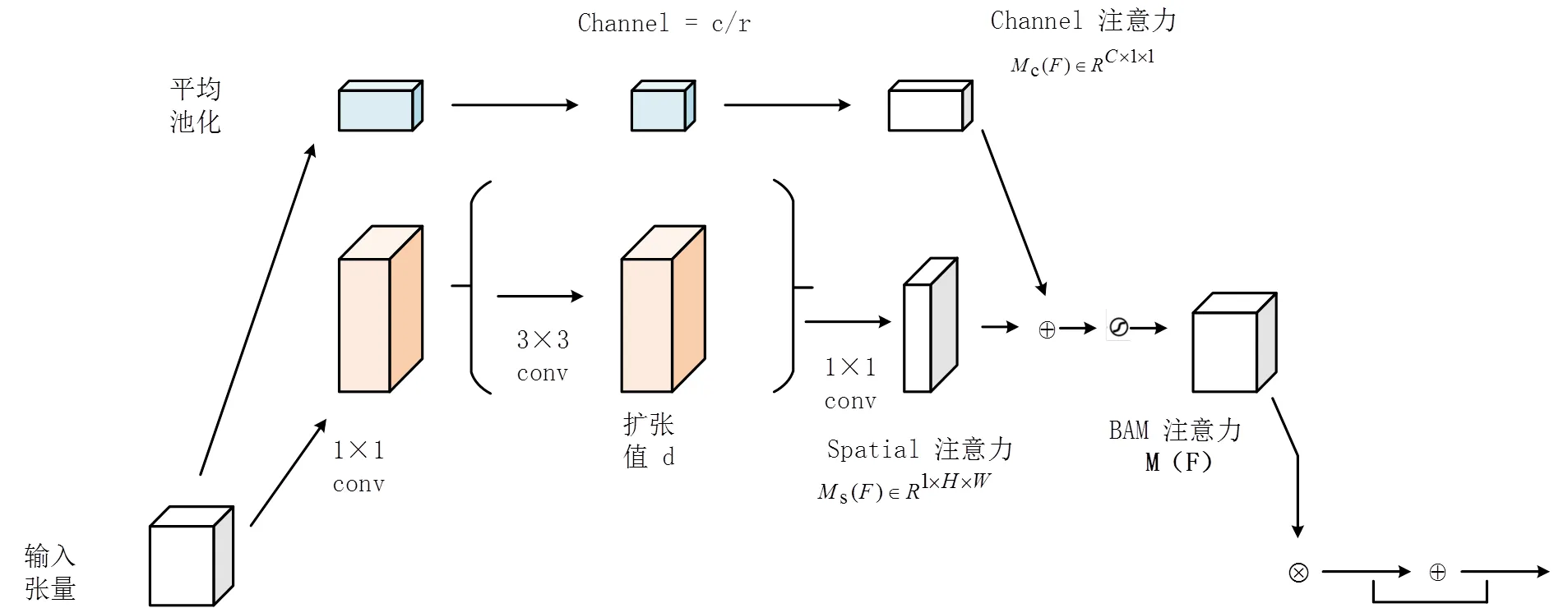

为了聚合特征图谱(feature map),采用全局平均池化(Avg Pool)得到,同时使用了一个多层感知(MLP)用一层隐藏层。在MLP之后,增加了去调整规模和空间分支一样的输出,通道注意力(channel attention)可以被计算为

BAM注意力机制的结构示意图如图2所示。

图2 BAM注意力机制结构示意图

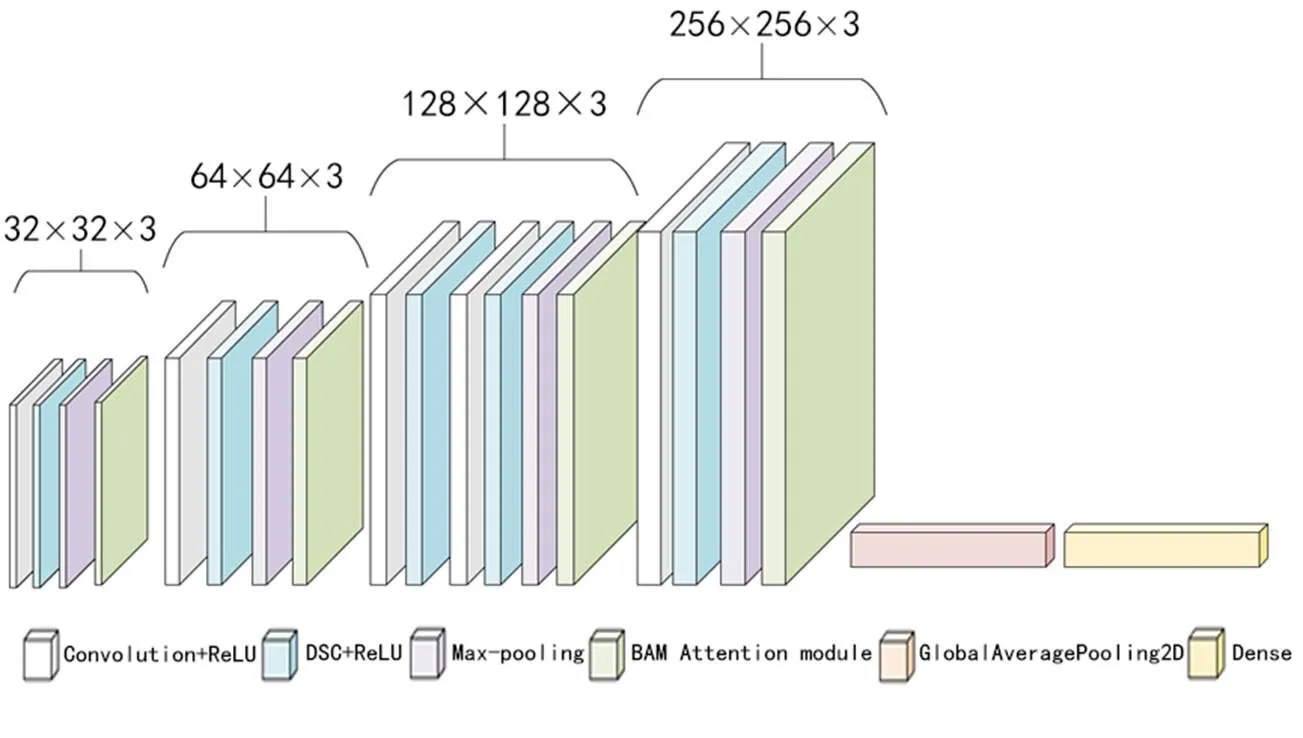

基于VGG模型的基础上本文加入了Mobile Net中深度可分离卷积(depthwise separable convolution,DSC)[10]。该卷积层的加入,可以减少模型的参数量。在对模型通道数以及参数量进行缩减的同时对数据进行了正则化处理。具体来讲,就是3×3的卷积核厚度只有一层,然后在输入张量上一层一层地滑动,每一次卷积完生成一个输出通道,当卷积完成后,在利用1×1的卷积调整厚度。

本文以VGG模型为基础,通过加入深度可分离卷积层来减少模型参数。同时,通过在模型中嵌入BAM注意力机制,对模型进行改进,以在场景遥感图像分类任务中达到更好的分类效果。提出的模型分类结构如图3所示。

图3 模型分类方法总体结构示意图

3 模型实验性能分析

为验证模型分类性能,本文采用The UC Merged Land Use(UC)[4]数据集进行测试,该数据集内包含了21个场景类别的图像,总共2100张图像,每一个类别包含了100张大小为256×256的航空图像,图片的空间分辨率为1英尺。训练时对数据集进行数据增强处理:(1)对于输入图像,旋转范围为0~70°;(2)输入图像的长度和宽度被偏移随机,偏移系数为0.1;(3)随机水平翻转输入图像;在数据增强之后,所有的样本都被按批次标准化了。另外,为了避免训练时内存溢出,输入图像的大小调整为256×256。训练网络的初始学习率设置为0.01。一种自动学习率降低机制已添加。在训练过程中,批量大小被设置为16,对模型迭代100次。

实验平台计算机配置如下:Intel(R)Core(TM)i7-8750H CPU@2.20GHz,GPU:NVIDIA GeForce GTX 4G 1050 Ti,实验环境为Windows 10操作系统,基于Python语言的Tensorflow架构进行编程。通过loss(损失率)以及Acc(准确率)来验证模型的性能。

从图4可以看出,在对模型进行训练的过程中,loss也在慢慢降低,而Acc也在随着训练过程中慢慢地提高,且提升相对稳定。

图4 模型训练时准确率与损失率的变化情况

通过对模型进行迭代训练后,最终模型的loss稳定在0.37%左右,而Acc稳定在0.95%左右,有着不错的分类性能。

为验证本文提出方法的性能,将提出模型与几种经典方法进行比较。通过比较来验证模型分类性能,实验结果如表1所示。

表1 与其他经典方法进行比较

可见,与其他几种分类方法相比,提出方法在场景遥感图像分类方面,通过在普通卷积层中混合深度可分离卷积,使得模型拥有更少的训练权重参数(模型更加轻量),模型训练时间更少。而注意力机制的加入,让模型可以更细腻的遍历图像,在训练后以获得更高的训练精度。具有明显的优越性。

4 结束语

针对于场景遥感图像分类问题,提出了一种基于VGG模型的场景遥感图像分类模型。对VGG网络模型结构进行改进,若单纯采用堆叠的方式,会大大增加模型参数量,从而加大模型训练时间,且不能提高模型的分类性能。本文通过加入深度可分离卷积,减少了模型的参数量。同时通过加入注意力机制,改善了模型分类时的聚焦方式,在UCM数据集上取得了不错的分类性能。下一步,还会不断改善模型的结构,同时引入不同的注意力机制,增加模型训练的批次大小,以求获得更少的训练参数以及获得更好的分类性能。

[1] Fan H, Xia G S, Hu J, et al. Transferring deep convolutional neural networks for the scene classification of high-resolution remote sensing imagery[J]. Remote Sensing, 2015, 7(11): 14680-14707.

[2] Cheng G, Yang C, Yao X, et al. When deep learning meets metric learning: Remote sensing image scene classification via learning discriminative CNNs[J]. IEEE Transactions on Geoscience and Remote Sensing, 2018, 56(5): 2811-2821.

[3] Chaib S, Liu H, Gu Y, et al. Deep feature fusion for VHR remote sensing scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(8): 4775-4784.

[4] Li E, Xia J, Du P, et al. Integrating multilayer features of convolutional neural networks for remote sensing scene classification, IEEE Transactions on Geoscience and Remote Sensing, 2017, 55(10): 5653-5665.

[5] Nogueira K, Penatti O, Santos J. Towards better exploiting convolutional neural networks for remote sensing scene classification[J]. Pattern Recognition, 2017, 61: 539-556.

[6] Szegedy C, Wei L, Jia Y, et al. Going deeper with convolutions[C]//IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 2015: 1-9.

[7] Li L, Tian T, Li H. Classification of remote sensing scenes based on neural architecture search network[C]//IEEE 4th International Conference on Signal and Image Processing (ICSIP), 2019.

[8] Alajaji D, Alhichri H. Few shot scene classification in remote sensing using meta-agnostic machine[C]//2020 6th Conference on Data Science and Machine Learning Applications (CDMA), 2020.

[9] Simonyan K, Zisserman A. Very deep convolutional networks for large-scale image recognition[J]. Computer Science, 2014: 1-13.

[10] Howard A G, Zhu M, Chen B, et al. MobileNets: Efficient convolutional neural networks for mobile vision applications[J]. 2017.

[11] Yang Y, Newsam S. Bag-of-visual-words and spatial extensions for land-use classification[C]//Sigspatial International Conference on Advances in Geographic Information Systems. ACM, 2010: 270-279.

[12] Kumar M P. Scene classification via pLSA[J]. Computer Vision-Eccv, 2006, 3954: 517-530.

[13] Yang Y, Newsam S. Spatial pyramid co-occurrence for image classification[C]//IEEE International Conference on Computer Vision. IEEE, 2011: 1465-1472.

[14] David B M, Andrew N Y, Michael J I, et al. Latent dirichlet allocation[J]. Journal of Machine Learning Research, 2003, 3(4-5): 993-1022.

[15] Lazebnik S, Schmid C, Ponce J. Beyond bags of features: Spatial pyramid matching for recognizing natural scene categories[C]//IEEE Computer Society Conference on Computer Vision and Pattern Recognition, 2006, 2: 2169-2178.

[16] Cheriyadat A M. Unsupervised feature learning for aerial scene classification[J]. IEEE Transactions on Geoscience and Remote Sensing, 2014, 52(1): 439-451.

Research on scene remote sensing image classification based on deep learning

WANG Xiao-zhou,SHI Cui-ping*,YANG Kun,WANG Quan

(College of Communication and Electronical Engineering, Qiqihar University, Heilongjiang Qiqihar 161006, China)

To solve the problems of poor classification performance and low classification accuracy of remote sensing images of scenes, this paper proposes a classification method of remote sensing images of scenes based on the improvement of VGG16. In order to reduce the large number of parameters in VGG16 model, the number of channels and parameters are reduced. During the operation of the algorithm, the data is regularized, and attention mechanism is added to the classification method. By combining the attention mechanism with CNN model and training them end-to-end, the classification performance of the model is improved. Experimental results on different classification and detection data sets show that the proposed method can significantly improve the performance of scene remote sensing image classification under the same parameter settings.

deep learning;convolutional neural network;image classification;scene remote sensing image

2021-03-13

2020年省级一般大学生创新创业训练计划资助项目(202010232054);黑龙江省省属高等学校基本科研业务费科研项目(135509136);黑龙江省教育科学“十三五”规划2020年度重点课题研究成果“‘新工科’背景下大学生创新能力培养的教学实践研究-以《数字图像处理》为例”(GJB1320385);2019年度黑龙江省高等教育教学改革研究项目(SJGY20190718);2020年齐齐哈尔大学教育科学研究项目(GJZRYB202002)

汪晓洲(2000-),男,贵州遵义人,本科,主要从事计算机视觉研究,2018132038@qqhru.edu.cn。

石翠萍(1980-),女,内蒙古牙克石人,副教授,博士,主要从事人工智能与计算机视觉研究,scp1980@126.com。

TN919

A

1007-984X(2021)05-0011-05