基于自适应模板更新的改进孪生卷积网络目标跟踪算法

2021-04-15孙淑艳

柳 赟 孙淑艳

(华北电力大学电气与电子工程学院 北京 102206)

0 引 言

机载光电平台是由伺服控制系统、测距机、红外热像仪、电视、跟踪器等单体组成,可实现对地目标检测、跟踪与识别[1]。目标跟踪技术是机载光电平台实现对地目标稳定跟踪的主要技术,其跟踪的性能直接关系到对地目标感知的精度。

目标跟踪是计算机视觉领域非常重要的研究课题之一,广泛应用于运动分析[2]、机器人导航[3]、人机交互[4]、视频监控[5]等领域。现有的目标跟踪算法主要从模型泛化与特征表征两个方面提高目标定位精度与跟踪鲁棒性[6]。然而,复杂的跟踪算法或特征表征方法虽然改善了目标跟踪性能,但同时也增加了计算复杂性。因此,如何平衡跟踪算法的精度与速度是跟踪算法工程化应用亟需考虑的核心问题。

基于低层次特征的跟踪算法,如LAKCF[2]和TMFT[4],大都融合了多尺度、多分辨率、多特征信息来提高跟踪指标与跟踪速度,而基于深度模型的跟踪网络,如Siamese跟踪网络[7],则是平衡了速度和精度之间矛盾而逐渐成为单目标跟踪研究中最优模型。一般来说,基于深度模型的跟踪算法将传统的跟踪任务从目标搜索和回归过程转换为相似性比较问题,并在固定时间内完成目标跟踪。DSiam网络采用在线学习目标的外观变化和背景抑制,在排除背景干扰的同时适应目标变化,提高跟踪性能[8]。

尽管改进Siamese跟踪方法能够平衡跟踪的速度和准确性,但仍有三个问题需要解决:(1) 大多数Siamese网络跟踪器无法更新模板,主要是由于简单的固定模板确保了较高跟踪速度,但牺牲了更好地适应目标外观形变的能力;(2) 由于复杂背景的干扰,大多数Siamese跟踪网络的性能无法得到保证,这是由于传统的跟踪边界框不能分离背景干扰,最终由于目标跟踪点漂移而导致跟踪失败;(3)由于大多数Siamese跟踪网络采用的是本地搜索策略,对视场外目标和全遮挡目标仍然具有很大的挑战。因此,为了解决这些问题,本文提出一种自适应模板更新策略的全连接Siamese跟踪模型,该模型利用了轮廓模板代替传统的边界框模板,减少语义背景的干扰;设计了基于目标检测网络和轮廓检测网络的模板更新网络,能够根据不同的条件自适应地更新模板。多种数据集的仿真实验结果表明本文提出的改进模型能够实现无人机空地跟踪性能,具有较高的工程应用价值。

1 相关工作

1.1 模板更新

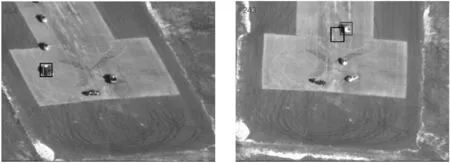

近年来,许多跟踪算法在无人机空对地跟踪应用中取得了巨大的成功,这些算法能够解决因姿态变化、部分遮挡和光照变化等干扰造成的跟踪失败问题。但是,对于无人机机动转向导致目标图像大角度旋转,大多数跟踪算法可能无法稳定跟踪目标。图1展示了由车辆快速转向引起的跟踪失败的例子,其中黑色为基准结果,白色则是跟踪结果。第15帧跟踪结果与基准结果存在漂移;随着目标机动变化,目标外观剧烈变化,导致跟结果出现较大的差异。第37帧时跟踪框逐渐偏离目标,最后在第69帧完全跟踪到错误的目标上。

为了跟踪出现剧烈外观变化的目标,一些方法会按固定帧率或自适应帧率更新目标模板,以提高跟踪精度。这些模板更新策略假定当前更新的模板比先前帧中的任何其他模板更好地描述目标[9]。然而,这种假设有时可能面临以下问题。(1) 模板通常是根据当前帧的跟踪结果进行更新。由于跟踪器无法精确跟踪目标,这就使得跟踪结果包含错误信息,导致模板更新不准确。因此,更新后的模板无法准确描述当前目标,最终导致跟踪器失效。显然,上述简单的模板更新方法无法满足空对地跟踪需求。(2) 当跟踪目标被背景信息部分遮挡时,例如被树遮挡的坦克,传统的方形边界框模板更新会将坦克周围的部分背景作为跟踪目标的一部分而引入背景干扰。为了避免复杂背景杂波对目标模板的影响,需要两种模板更新策略。第一种策略是引入自适应策略让跟踪器计算更新模板最佳时机,而不是简单地按照固定帧更新,该策略不仅可以降低模板被干扰的频率,而且可以降低无用模板频繁更新的计算复杂度;第二种策略是保留备份模板,一旦当前模板遇到不匹配的问题,备份模板可能会发挥重要作用,该策略可以有效地提高跟踪算法的鲁棒性[10-11]。

1.2 形状自适应模板

目标检测和跟踪是计算机视觉中两个基本而又具有挑战性的研究课题。它们在大多数任务中高度相关,目标检测提供的输入可以指导跟踪并提高其跟踪性能[12]。同时,精确跟踪为目标检测提供了可靠的观测结果。目前,已经有多种边界框输出的目标跟踪方法,这类基于判别模型的目标跟踪算法都是利用边界框模板在搜索区域进行相似性检测。由于边界框只是指明了目标所在区域,受背景噪声的干扰无法精确定位目标[13]。相比之下,物体边缘轮廓清楚地显示了目标的形状和精确位置。利用目标轮廓代替边界框进行检测或跟踪,不仅有助于提高精度,而且可以根据目标的形状识别目标。

图2显示了边界框标记方法和对象轮廓标记方法的结果。利用边界框标记目标位置,得到的是一个粗糙的波门,而利用轮廓标记目标位置得到的结果是目标的轮廓边界。显然,与边界框标记相比,目标轮廓模板结果包含了大部分的目标信息和最少的背景信息。

(a) 边界框模板 (b) 轮廓模板图2 跟踪模板

在无人机空对地跟踪系统中,初始锁定目标在大多数情况下非常小。此外,目前实时跟踪系统都是利用边界框锁定目标,不可能在图像上描绘目标边界区域进行锁定。这就需要使跟踪器更智能,能够区分目标和背景。因此,提出一种自适应模板更新策略的全连接Siamese跟踪模型,该模型从目标中提取形状自适应模板,并使用完全卷积Siamese网络进行跟踪。与大多数在跟踪中使用初始边界框标注目标位置不同,本文模型通过单击监视器屏幕上的目标来选择实时视频中的目标。一旦有操作员点击目标的任何部分,系统将自动获取目标轮廓信息,并利用深度学习实现稳定跟踪。特别是本文模型将在语义级别自动检测和分割所选目标的轮廓,然后从没有背景信息的轮廓模型中提取目标特征。也就是说,跟踪器是在跟踪目标,而不是跟踪边界框区域。

2 自适应模板更新策略的全卷积Siamese跟踪模型

大多数现有的跟踪方法都是利用公共数据集中准确的基准参数初始化模板,而本文的目的是基于实时视频中人工选择目标来设计目标跟踪网络。该模型不需要目标边界框进行目标锁定,而是自动获取目标轮廓信息,并利用深度学习实现稳定跟踪。

2.1 系统流程设计

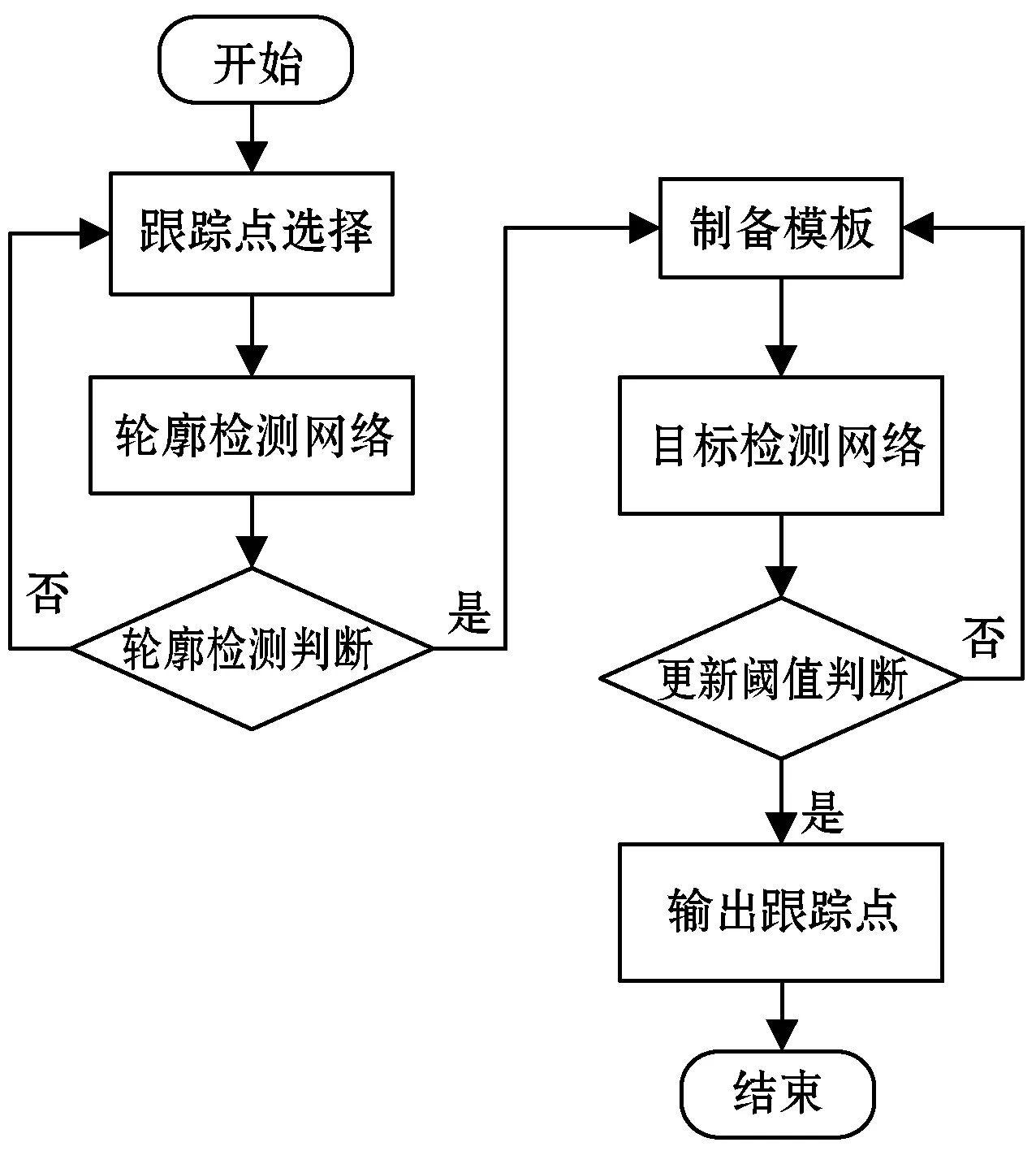

本文提出的跟踪模型主要应用在无人机光电跟踪系统上,通过操作手对地面目标进行锁定,实现复杂地面目标的稳定跟踪,其系统流程如图3所示。首先,红外热像仪获取的数字视频在屏幕显示,并由操作手通过单击选择待跟踪的目标;然后,系统将根据初始点的位置通过检测轮廓和抽象语义信息自动学习要跟踪的目标的特征信息。提取目标特征后,系统开始逐帧跟踪目标,并保存具有高可信度的模板作为待跟踪目标。如果由于目标形变或遮挡导致模板和跟踪目标之间相似而小于阈值,这表明初始模板不能在当前帧中精确匹配对目标特征,系统将使用一些策略更新模板。

图3 系统流程

2.2 自适应模板更新策略

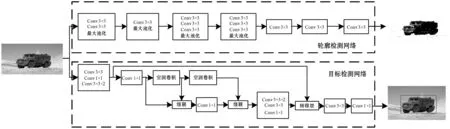

本文提出的模板更新网络包含两个独立网络:轮廓检测网络和目标检测网络,其跟踪主框架如图4所示。第一帧选择获取目标的轮廓,所对应的算法就是轮廓检测网络。在轮廓检测网络的输出端,采用人工选择点开始的填充算法建立模板。一旦系统需要根据模板更新网络的结果更新后续帧中的模板,轮廓检测网络的输出可以重新用于进一步处理。具体来说,填充算法以当前帧中跟踪结果的中心点为起点,搜寻轮廓并生成新的模板。

图4 轮廓跟踪模型主框架

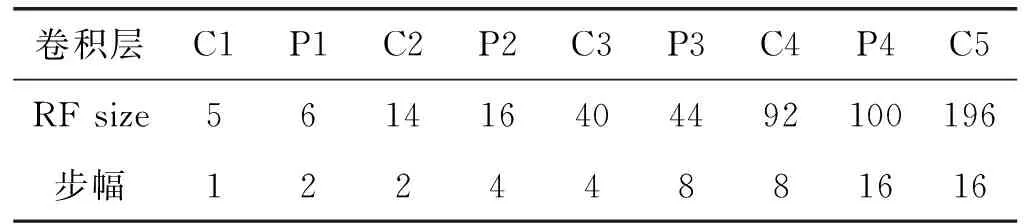

1) 轮廓检测网络。VGG-16网络具有很高的深度和密度,由于训练简单、收敛速度快,在分类任务中得到了广泛的应用[14]。因此,本文也采用VGG-16网络结构来提取轮廓特征。为了检测边缘,轮廓检测网络做了一些修改。首先,移除所有完全连接的层,然后将最后一个最大池化层删除,最后将输出端与精化模块连接。VGG-16网络中最大池化的Conv1、Conv2、Conv3、Conv4和Conv5作为前端来提取目标的特征,然后对后端进行修改,使网络能够提取轮廓信息。这种思想源于整体嵌套边缘检测网络(Holistically-Nested Edge Detection,HED)的五个多尺度汇集层[15]:较低层捕获更多的空间细节,但缺乏足够的语义信息;相反,较深层编码更多的语义信息,但缺少空间细节信息。在本文任务中,无用的背景信息和抽象的目标轮廓干扰需要被减少。因此,本文使用更深层的特性来构建模板。然而,特别是在较深的层次上,HED网络中的边缘输出更容易受到密集边问题的影响。需要对输出边界进行细化,以生成清晰和准确的目标轮廓。此外,最终的输出需要通过上采样最大池化和反卷积调整到原始大小[16]。为了在卷积过程中获得最佳的性能,本文选择了最小的卷积滤波器(3×3),其步幅为一个像素,可以捕获左/右、上/下和中心运动;最大的池化是在2×2像素的窗口上以步幅2操作。因此,本文采用的轮廓检测网络中每个卷积层和最大池化层的参数配置如表1所示,其中RF、C和P分别是感受野、卷积与池化的缩写。

表1 轮廓检测网络中每层参数设置

本文采用的轮廓检测网络输出是具有边缘信息的二值图。 首先,本文使用泛洪填充方法来生成连通区域,以表示从等高线图中选择的目标的位置;然后在二值图基础上进一步生成目标掩模,该掩模将背景信息设置为零,并且从原始图像中分割所选目标;最后,提取目标特征,表征为没有背景信息的目标模板。可以看出,该策略成功地解决了复杂背景下边界框的漂移问题。

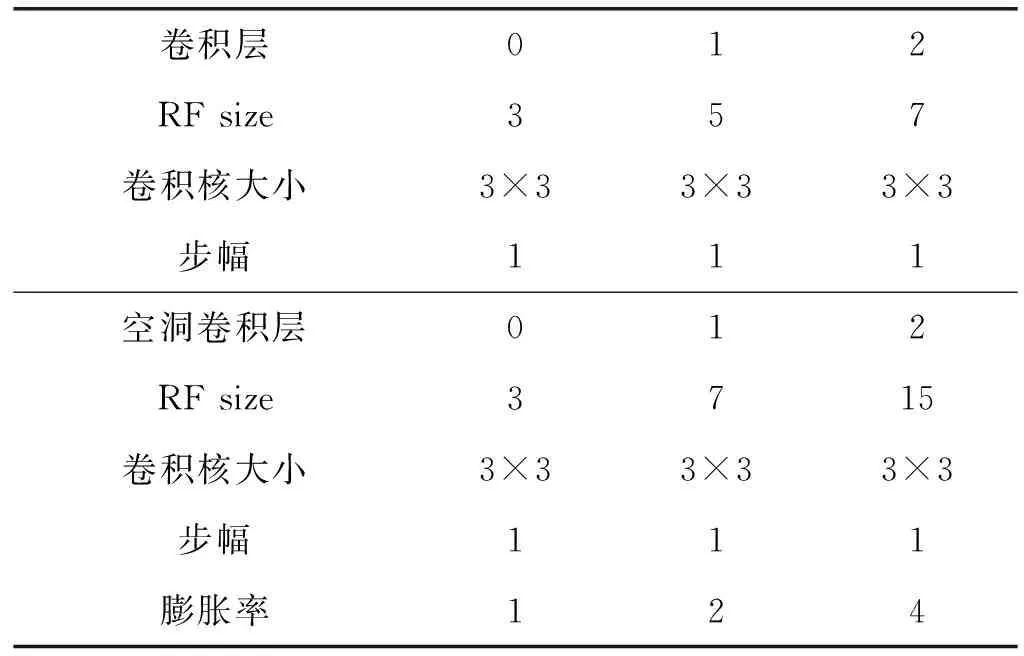

2) 目标检测网络。目标检测是计算机视觉中的热点问题之一。对于无人机平台光电实时搜跟系统,本文只关注高速目标检测算法。目前,基于深度网络的目标检测模型已经具有较高的检测性能。例如,作为最先进的目标检测方法之一,YOLOv3可以高精度地检测不同尺度的目标[17-18]。轻量级YOLOv3通过通道裁剪牺牲了检测精度,以提高检测速度,对于小目标不能有效检测。但是,在空对地光电系统中大多数目标都是小尺寸的。为了避免上下文信息的丢失,本文在空洞卷积(dilated convolution)[19]启发下引入了扩张模块层来扩展感受野。表2给出了卷积网络与扩张卷积网络之间参数的比较。

表2 不同网络间的参数对比

为了融合较低层中的目标位置信息和较高层中的语义信息,网络结构中引入转移层(passthrough layer)。 具体而言,较低层的特征包含更细粒度的信息,这有助于定位小目标。 因此,本文设计一个带有步幅2的转移层,它将特征图从2M×2N×C转换为M×N×4C,其中M、N与C分别表示特征图的分辨率与特征通道。功能图如图5所示,可以看出不同灰度点分别扩张到四个通道。最后得到了与YOLOv3类似的精度和速度。转移层通过将相邻特征堆叠到不同的通道,利用下采样时同一位置像素分解成四幅子图,然后将较高分辨率特征与低分辨率特征的信息融合。变换后通道数变为4倍,分辨率降为原来2倍。例如26×26×512的特征图转换为与原始特征相连接的13×13×2 048的特征图。

图5 转移层示意图

3) 基于模板更新策略的改进Siamese跟踪网络。对于大多数改进的Siamese跟踪网络,例如Tian等[20]提出的ISCCT,在没有目标特征信息的情况下首先通过缩放和裁剪输入目标图像。在此过程中,当目标移出边界框时,为上下文添加边缘信息是非常有用的,但同时,它可能会导致目标尺度降低,并且引入更多背景信息。ISCCT优于SiamFC有三个原因:(1) SiamFC的全卷积网络结构使得离线训练数据具有高度可辨识性;(2) SiamFC使用严格有监督约束的响应图而不是回归分析;(3) 利用相关层作为融合张量,提高了融合张量的准确性。可以看出,ISCCT使用前一帧中的回归结果并更新每个帧中的模板,SiamFC[7]根据第一帧中的基准区域生成模板,而本文模型则是操作员在系统中手动选择,利用轮廓检测网络获取目标的轮廓模板。通过相关运算计算模板与搜索区域之间的特征相似度,并生成相似性响应图,然后通过更新阈值判断实现模板的更新。响应图中的最高响应值表示目标中心在下一帧中的位置。因此,系统实现了逐帧跟踪功能。

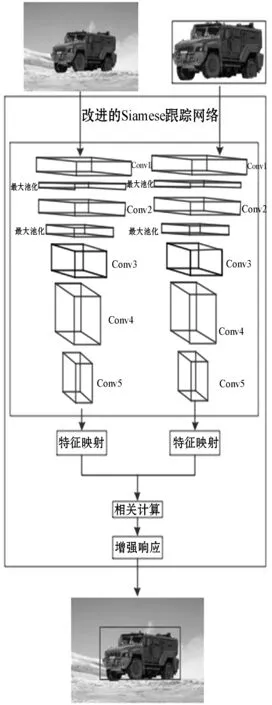

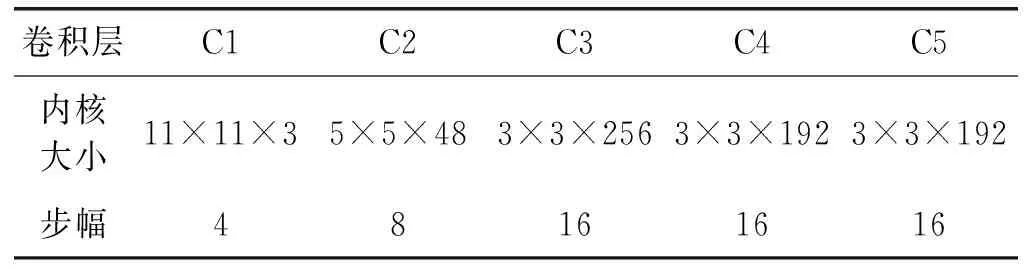

图6展示了本文改进的Siamese跟踪网络的架构:首先,全卷积网络分别将轮廓模板和搜索区域作为输入,并输出模板和搜索区域的深度特征。然后,通过模板特征与搜索区域特征之间的相似性进行相关来生成响应图。最后根据响应图上的最高响应点作为在搜索区域中跟踪目标。 Siamese网络中卷积层的内核大小和步幅的参数设置如表3所示。

图6 本文改进的Siamese跟踪网络的架构

表3 Siamese网络中的参数设置

3 实 验

3.1 实验设置及其性能评价指标

为了验证本文提出的深度跟踪模型的有效性,采用标准数据集DARPA VIVID[21]、ILSVRC2015、VOT-TIR2016,以及挂飞收集的自建数据集进行训练与测试。所有数据都逐帧标注了目标位置与尺寸,基本覆盖了尺度变化、形变、透视变换、运动模糊、遮挡、灰度变换、背景干扰等干扰因素。本文采用的定量评价为一次评估OPE(One-Pass Evaluation),主要采用了两个评价指标:精确度图(Precision plot)和成功率图(Success plot),其中精确度图能够显示出估计位置在给定的准确值的阈值距离之内的帧数占总帧数的百分比;成功率图给出了阈值从0到1变化时成功帧所占的比例[21]。

本文提出的模板更新网络和Siamese跟踪网络是基于Python TensorFlow框架实现,所有实验是在一个具有40核双路Intel Xeon,最高频率为2.4 GHz的CPU以及4张GeForce GTX 1080Ti GPU显卡的工作站上进行。

3.2 定性定量分析

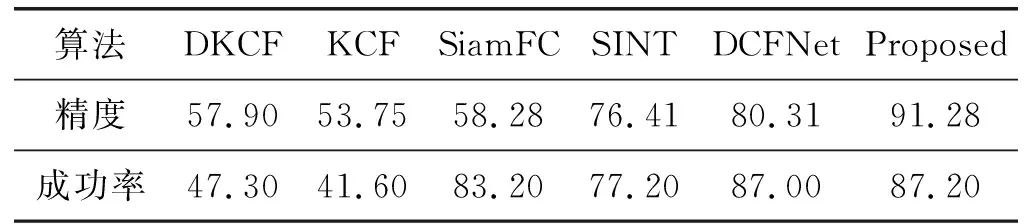

为了定性定量分析本文提出的无人机空对地光电平台下改进Siamese深度模型的目标跟踪算法的应用性能,选用目前最优的五种跟踪进行对比分析,分别是SiamFC[7]、DCFNet[23]、SINT[24]、KCF[25]和DKCF[26],其中SiamFC、DCFNet与SINT是基于Siamese深度模型的改进算法,KCF是基于判别模型的核相关算法;DKCF是结合深度特征的KCF算法。

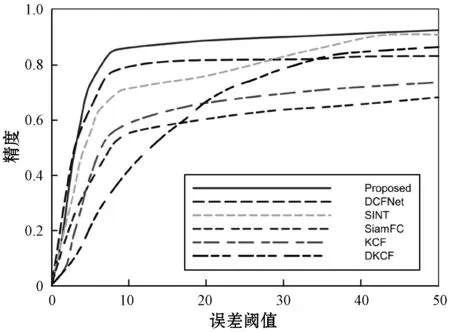

由于本文的初始跟踪目标波门大小是由算法自适应计算,不再需要操作人员指定跟踪区域,本文首先为这些目标创建了一个组中心点标签,并修改了用于测试的Siamese跟踪网络的初始化模块。根据视觉跟踪基准(Visual Tracker Benchmark)评价要求,本文只测试OPE指标。图7为基于OPE的精确度图和成功率图。

(a) 精确度图

可以看出,本文提出的形状自适应模板方法在6种对比跟踪算法中具有最佳跟踪性能。在光电跟踪系统中,中心位置精度决定了伺服响应的速度与跟踪精度,并且空对地场景中的大多数目标尺寸约为20到40像素。为了便于定量分析,本文比较了中心位置误差在20像素阈值以内帧百分比,如表4所示,其中:位置误差为20;重叠率为0.5。可以看出,本文算法在20个像素阈值的中心误差精度是0.91,获得最优的跟踪性能。本文算法在重叠率阈值0.5下的跟踪成功率是0.872,比原始SiamFC模型还高4个百分点。定量分析结果表明,本文提出的轮廓模板更新算法具有较高的性能,通过轮廓的检测识别,提高了跟踪的准确性。尤其是形变视频下,本文算法能够准确地定位模板,减少了跟踪点漂移现象。

表4 跟踪结果定量对比 %

由于红外目标在远距离时,仅仅是一个点目标,没有太多的形状特征。本文算法是通过对比度分割获取目标形心中心与尺寸大小,然后再由Siamese 网络进行跟踪,但不进行刷新;若目标轮廓特征明显,由轮廓检测网络提取轮廓,跟踪过程中通过自适应轮廓模板进行刷新。图8(a)是没有模板更新的Siamese 跟踪网络的结果;图8(b)是在相同帧上使用自适应模板更新策略进行Siamese跟踪的结果。其中:灰色波门是轮廓模板刷新效果;黑色波门是普通模板效果。可以看出,具有自适应轮廓模板更新的网络更能适应目标形变、透视变换等干扰的影响,其波门中心更接近目标中心。

(a) 没有模板 (b) 自适应模板图8 自适应轮廓模板效果对比

(a) VOT-TIR2016数据

4 结 语

本文结合了轮廓检测网络和全卷积Siamese 跟踪网络的特点,提出一种机载平台下基于自适应轮廓模板更新的Siamese 跟踪网络模型。该模型利用了轮廓模板代替传统的边界框模板,与搜索区域一起作为Siamese网络的输入,并输出模板和搜索区域的深度特征。然后通过模板特征与搜索区域特征之间的相似性生成响应图。最后将响应图极值点作为在搜索区域中跟踪目标。多种数据集的仿真实验结果表明,本文提出的改进模型能够实现无人机空地跟踪性能,具有较高的工程应用价值。