基于图像风格转换的水下图像显著性检测算法

2021-02-04郭继昌汪昱东艾羽丰贾伟广

郭继昌,汪昱东,刘 迪,艾羽丰,贾伟广

(1.天津大学电气自动化与信息工程学院,天津300072;2.国家海洋标准计量中心,天津300112)

引 言

图像显著性检测(Salient object detection,SOD)是根据人眼视觉注意力机制,对图像中各部分信息的重要程度进行感知,以获得场景中最吸引注意力的区域。显著图能够有效提高图像中有用信息的提取效率,从而提高如图像分类[1]和语义分割[2]等计算机视觉任务的精度,因此显著性目标检测有着重要的研究价值。水下图像显著性检测作为其中一个研究方向,也受到了研究人员的广泛关注。

对于水下图像显著性检测,可以将其分为基于传统方法和基于深度学习方法两类。其中基于传统方法的水下图像显著性检测主要通过颜色、亮度及纹理等低级特征或中心点、边缘等中级特征得到显著性区域。Jian 等[3]用基于四元距离的韦伯描述(Quaternionic distance based Weber descriptor,QDWD)和模式距离-局部对比算法(Pattern distance and local contrast,PL),提出了一种水下图像显著性检测方法;并在文献[4]中提出了水下显著性检测数据集,用9 种传统显著性检测方法对数据集进行测试,结果显示除PL 方法,其余方法的精度、召回率和F 值(F-measure)均低于50%,这表明传统的显著性检测方法直接应用于成像质量较差、情况较为复杂的水下图像时其检测性能会大幅下降。Chen 等[5]提出了一种新颖的水下显著性目标检测方法,该方法通过增加亮度敏感度、非线性深度敏感度和对比度敏感度,同时考虑3D 深度特征,从而获得更准确的显著性图。

近年来,深度学习的快速发展使得基于卷积神经网络的图像显著性检测算法[6]取得了突破性进展,大量优秀的图像显著性算法不断被提出(如DSS[7]、R3Net[8]、PiCANet[9]和PoolNet[10])。基于深度学习的显著性目标检测算法对卷积神经网络底层特征和高层特征进行处理,实现边界增强和语义增强,优化了显著性检测的性能,相比传统显著性检测方法有更好的检测准确率。对于水下图像显著性检测,由于缺少相关数据集,使得基于深度学习的水下显著性目标检测算法发展缓慢。Islam 等[11]首次提出了一个可以用于深度学习的水下显著性检测数据集,并提出了Deep SESR 网络,对水下图像同时进行图像增强、超分辨率和显著性检测处理。2020 年,Islam 等[12]又提出了SVAM-Net,该算法继承了多尺度和语义信息的深层特征,可以在水下图像中进行有效的显著性目标检测。

然而,由于当前水下图像显著性检测数据集较少,难以对基于数据驱动的深度卷积神经网络进行大样本训练,从而无法达到较高的检测精度;同时由于水下图像普遍存在蓝绿色偏、低对比度及亮度不均匀等问题,导致很多性能优异的显著性检测方法在检测退化的水下图像显著性目标时效果不尽人意。针对上述问题,本文将CycleGAN[13]引入显著性检测网络,提出了一种新颖的端到端的水下显著性检测网络(Underwater salient object detection network,UWSODNet)。该网络包括显著性检测和图像风格迁移两个子网络,通过共享特征提取网络的参数增强两个子网络的关联。本文使用无监督的方式对风格迁移网络进行训练,通过对陆地和水下图像风格进行迁移转换提高水下图像的成像质量,并对陆地图像加入噪声降低其成像效果,有效地减少了陆地和水下图像之间的差异,再使用半监督的方式(仅使用成对的陆地显著性数据集DUTS[14])对水下显著性检测网络进行训练。然后通过级联结构,对图像进行两次风格迁移并输出两个显著性检测结果,对两个预测图进行叠加以提高显著性检测结果精度。本文提出的UWSODNet 能够有效解决数据集不足带来的相关问题。

1 循环生成对抗网络

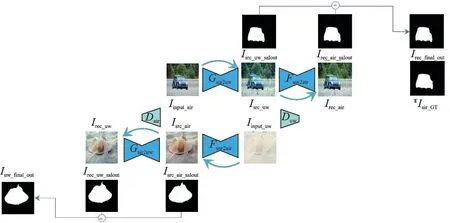

生成对抗网络(Generative adversarial networks,GAN)[15]是一种深度学习模型,通过生成器和判别器的不断博弈学习生成质量较好的图像。其中生成器用于生成尽可能真实的假样本,而判别器用于辨别假样本和真实样本,两者通过不断地对抗训练对网络参数进行优化,最终达到纳什均衡点,即判别器不能判别出生成器输出的假样本是否真实。循环生成对抗网络CycleGAN[13]作为GAN 模式的一种,是两个对称的GAN 构成的环形网络,包含2 个生成器和2 个判别器,其目标是学习X 和Y 两图像域之间的相互映射关系,其原理图如图1 所示。图中,G 和F 为常用的UNet[16]网络结构,G 表示从X 域图像生成Y 域图像的生成器,F 表示从Y 域图像生成X 域的生成器,DX和DY分别表示X 域和Y 域的判别器。CycleGAN 通过无监督训练后,能够对不同风格的图像进行相互域转换。在训练中共包含4 个损失函数:2 个GAN 损失函数用于对抗生成网络的参数优化,2 个循环损失函数对其循环一致性进行约束,最终实现G(F(x))≈x和F(G(y))≈y。

图1 CycleGAN 原理示意图Fig.1 Simplified schematic of CycleGAN

2 UWSODNet 网络

2.1 网络结构

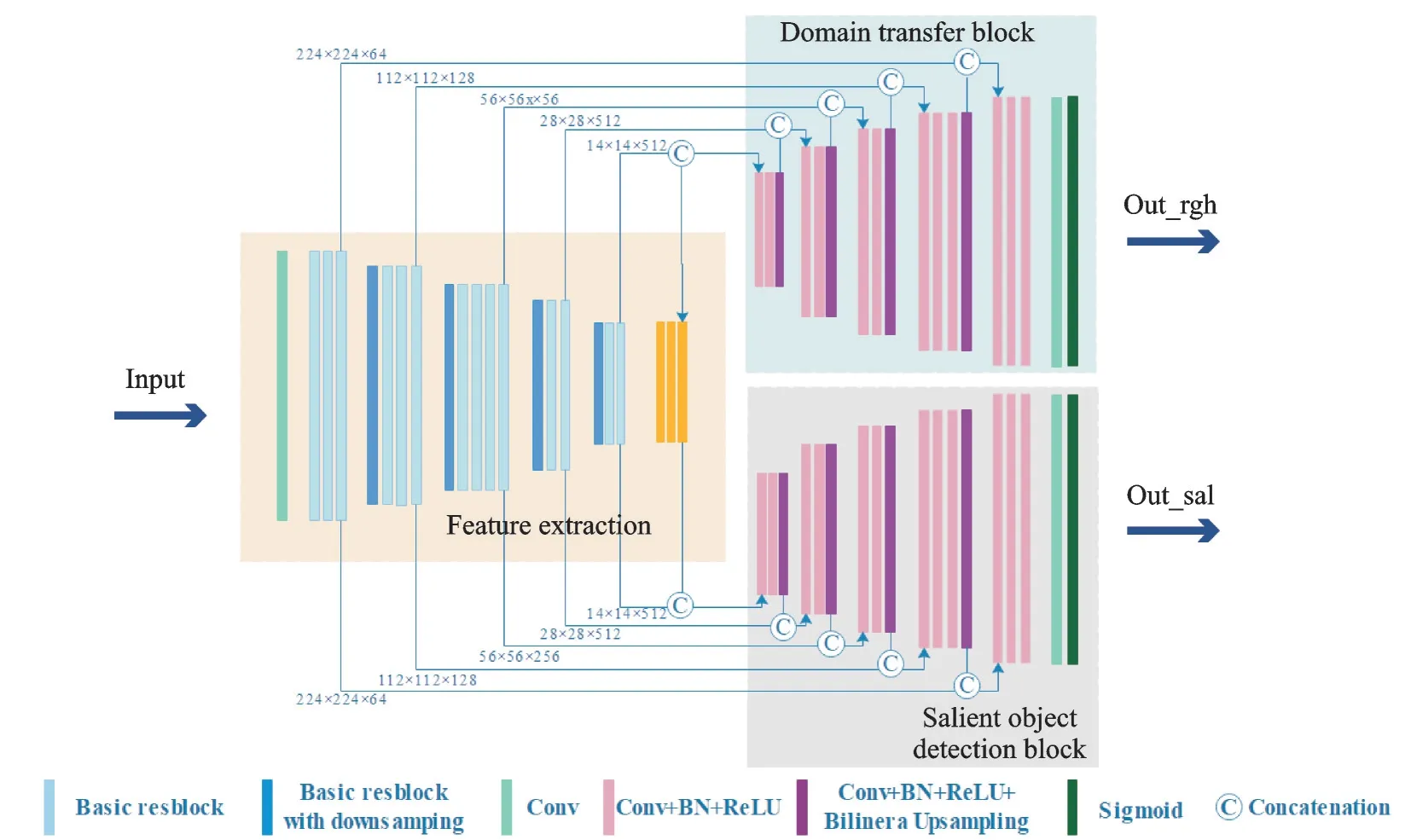

本文提出了基于图像风格转换的水下图像显著性检测网络UWSODNet,通过对陆地图像和水下图像风格进行迁移转换以提高水下图像的成像质量,对陆地图像加入噪声以降低图像的成像效果;通过级联结构,对图像进行两次风格迁移并输出两个显著性检测结果,再对两个预测图进行叠加以提高显著性检测结果精度。UWSODNet 结构示意图如图2 所示。

图2 UWSODNet 网络结构示意图Fig.2 Network structure of UWSODNet

图2 中,Gair2uw和Fuw2air为生成器,用于生成风格转换后的图像和输出显著性检测结果,其中Gair2uw为陆地图像转换到水下图像的生成器,Fuw2air为水下图像转换到陆地图像的生成器。本文参照文献[17]的方式设计判别,Duw和Dair为判别器,分别判断生成的模拟水下图像和模拟陆地图像的真伪。Iinput_air和Iinput_uw分别为陆地和水下真实图像的输入。对于图像风格转换任务,Isrc_uw和Isrc_air分别为Iinput_air和Iinput_uw通过Gair2uw和Fuw2air生成的模拟水下图像和模拟陆地图像,Irec_air和Irec_uw分别为Isrc_uw和Isrc_air再次通过对抗生成网络获得的还原陆地图像和还原水下图像。对于显著性检测任务,Isrc_uw_salout和Isrc_air_salout分别为通过Iinput_air和Iinput_uw获得的显著性检测结果,而Irec_air_salout和Irec_uw_salout分别为通过Isrc_uw和Isrc_air获得的显著性检测结果。Iair_final_out和Iuw_final_out是分别对上述两个预测图进行叠加而获得的最终陆地和水下图像的显著性检测结果。

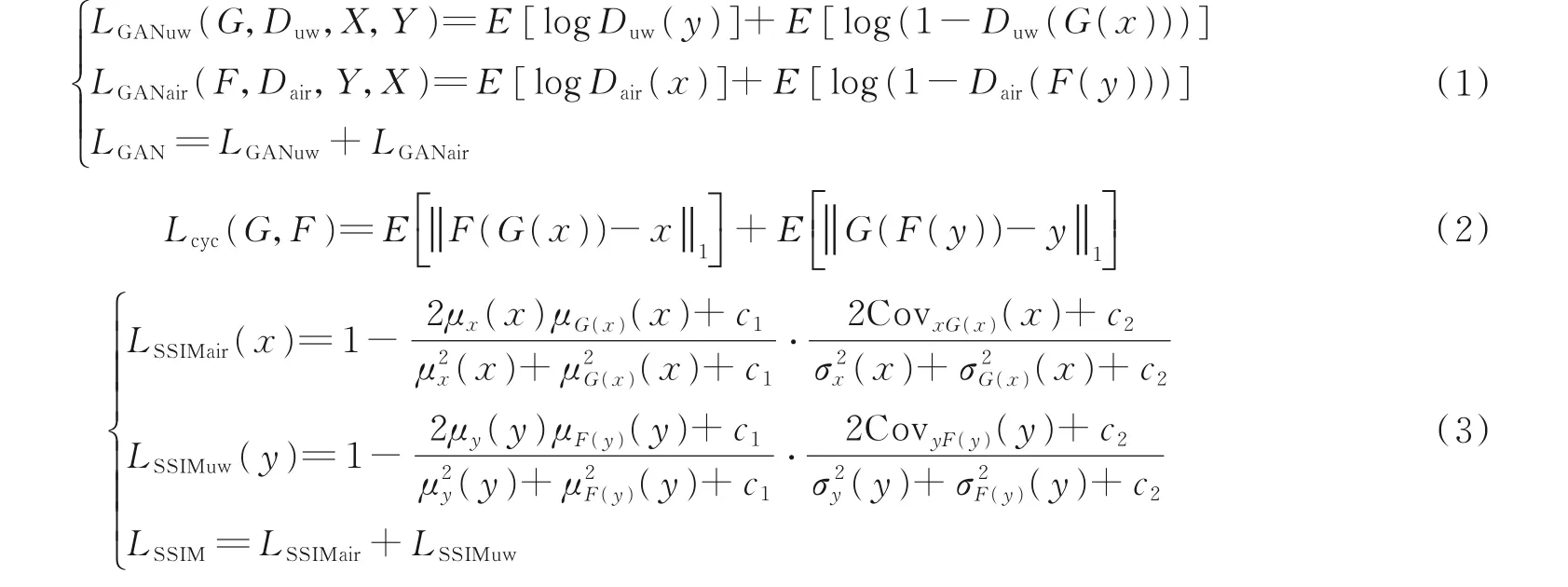

UWSODNet 生成器结构是在CycleGAN 基础上增加了显著性检测子网络,由于图像风格转换和显著性检测任务均需要强调图像的边缘等细节信息,因此通过共享特征提取网络的参数增强2 个子网络之间的关联,使提取到的特征表现力更强,从而进一步提升风格转换和显著性检测网络的性能。UWSODNet 生成器网络结构如图3 所示。

图3 UWSODNet 生成器网络结构示意图Fig.3 Network structure of UWSODNet generator

UWSODNet 生成器包括特征提取、图像风格转换和显著性检测3 个子网络。其中特征提取网络是下采样网络,图像风格转换模块和显著性检测网络均为上采样网络。为增加网络特征提取能力,本文对UNet 下采样网络进行改进,使用残差网络结构[18]替代了原始的卷积操作,在特征提取最底层增加了3 个空洞卷积层[19],以提高语义信息的提取能力。对于上采样网络,本文使用UNet 拼接结构,用来增加与原图的关联性,防止编码-解码结构带来的图像信息丢失等问题。特征提取子网络对输入图像进行特征提取,并同时作为图像风格转换和显著性检测子网络的输入,这不仅能够提高生成器对图像特征的提取能力,还能使图像风格转换和显著性检测2 个子网络的关联性更强,从而获得更好的风格转换图像和显著性检测图像,有效提高生成器的性能。本文使用批量归一化(Batch normalization,BN)加速网络收敛,使用ReLU 作为激励函数,并使用Sigmoid 激励函数对输出结果进行处理,以保证输出图像的像素值保持在[0,1]之间。

2.2 损失函数

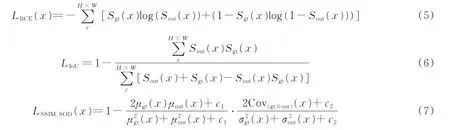

对于陆地-水下图像风格转换任务,本文使用无监督的方式对网络进行训练,训练中使用了3 种损失函数。包括由水下对抗损失和陆地对抗损失(LGANuw& LGANair)组成的LGAN、循环损失函数Lcyc和由水下和陆地结构相似性损失函数(LSSIMuw& LSSIMair)组成的LSSIM,表达式为

式中:x 表示陆地图像;y 表示水下图像;G(x)表示陆地图像通过生成器G 生成的模拟水下图像;F(G(x))表示模拟水下图像通过生成器F 生成的还原陆地图像;同理F(y)和G(F(y))分别表示模拟陆地图像和还原水下图像。对于LSSIM,μ(·)、σ(·)和Cov(·)分别表示以当前像素点为中心、尺寸大小为11 像素×11 像素的窗口内像素点均值、方差和相对应的协方差。防止分母出现0,本文取c1=0.02,c2=0.03。图像风格转换损失函数LDT可以表示为

对于显著性检测任务,本文仅使用DUTS 数据集[14]对显著性检测网络进行全监督训练,训练中使用了3 种损失函数,包括二元交叉熵损失函数LBCE、交并比(Intersection over union,IoU)损失函数LIoU和结构相似性损失函数LSSIM_SOD,其表达式为

式中:Sout(x)为输出显著图在点x 的值;Sgt(x)为真实显著图在点x 的值。对于LSSIM_SOD,μgt(x)、μout(x)和σgt(x)、σout(x)分别代表真实显著图和输出显著图在以x 点为中心、尺寸大小为11 像素×11 像素的窗口内像素点均值和方差,Cov(gt)(out)(x)代表其协方差,选取c1=0.02,c2=0.03。由式(5~7)可知LBCE为像素级损失函数,LSSIM_SOD为区域级损失函数,LIoU为全局级损失函数。综上,显著性检测损失函数LSOD可以表示为

UWSODNet 损失函数可以表示为

本文设定ω1=2、ω2=1、λ1=10、λ2=5。采用端到端的训练方式,训练时特征提取网络通过LDT和LSOD进行反向传播更新网络参数,图像风格转换子网络通过LDT进行反向传播更新网络参数,显著性检测子网络通过LSOD进行反向传播更新网络参数。需要注意的是,由于本文采用了级联的方式,在反向传播时LSOD仅更新单个生成器网络参数,而LDT不作要求。

3 实验结果分析

3.1 实验方法

本文使用DUTS 数据集对UWSODNet 特征提取网络和显著性检测子网络进行全监督训练,选取水下显著性检测数据集UFO[11]和文献[20]提供的水下图像对UWSODNet 特征提取网络和图像风格转换网络进行无参考训练,并使用自适应矩估计Adam 作为优化器算法。

训练阶段,本文分3 步进行训练:首先固定图像风格转换网络的网络参数,对特征提取和显著性检测网络进行预训练,选取学习率(Learning rate,LR)为0.001,训练回合数Epoch=10;然后固定特征提取和显著性检测网络的参数,对图像风格模块进行预训练,选取LR=0.001,Epoch=5;最后在预训练结束后,对UWSODNet 进行整体训练,选取LR=0.000 5,Epoch=30。测试阶段,本文仅使用水下图像进行测试。本文所有实验环境均采用Ubuntu16.04 的设备环境,显卡为Nvidia GTX 1080Ti(11 GB)。

3.2 评价指标

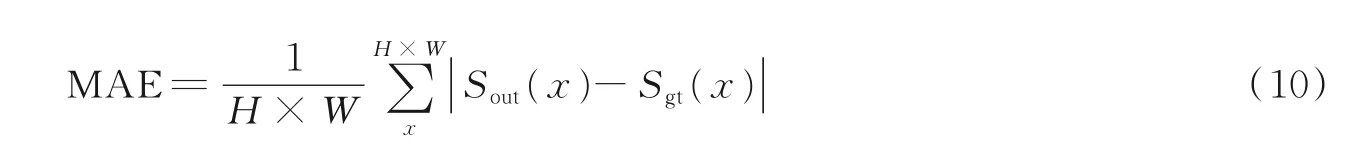

本文采用两种广泛使用的显著性检测指标来评估实验性能:平均绝对误差(Mean average error,MAE)和F 值(F-measure)。其中MAE 表明网络预测的显著图Sout与真实显著图Sgt的相似性,表达式为

式中H 和W 分别表示图像的高度和宽度。MAE 值越小表明预测的显著图效果越好。F-measure 是一种整体性能度量,通过精度P 和召回率R 的加权和平均值计算得出,即

本文选取β2=0.3,使加权精度大于召回率。F-measure 越大表明网络性能越好。

3.3 实验结果与分析

3.3.1 陆地显著性检测网络对比

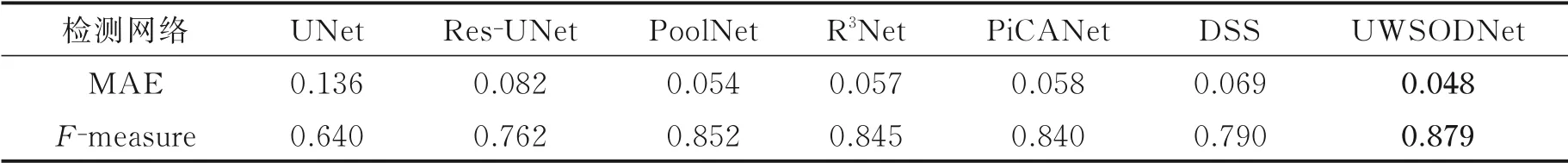

本文通过相同 的DUTS 数据集对UNet[16]、基于残差网络的UNet(Res-UNet)、PoolNet[10]、R3Net[8]、PiCANet[9]、DSS[7]和本文提出的UWSODNet 进行训练。由于水下显著性数据集标注效果不佳,本文重新选取了391 张水下图像进行显著性标注,用于测试上述网络显著性检测效果。实验结果如表1 所示。

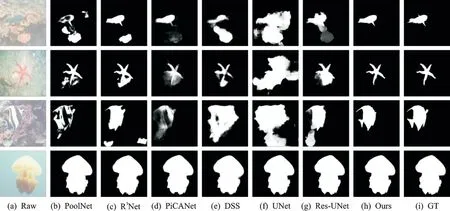

由表1 第1、2 列结果可知,使用残差网络结构替换卷积操作可以有效地提高显著性检测的性能。由表1 第3~7 列结果可知,当网络通过陆地显著性检测数据集进行有监督训练并预测水下图像时,本文提出的UWSODNet 对水下图像的显著性检测性能最好,其MAE 和F-measure 分别为0.048 和0.879,相比于陆地图像显著性检测性能较好的网络(PoolNet[10]、R3Net[8]、PiCANet[9]和DSS[7]),MAE 和F-measure 分别有至少0.006(相对12.5%)和0.027(相对3.1%)的提高。使用不同陆地显著性检测网络的水下图像显著性检测部分结果示例如图4 所示,其中GT(Ground truth)指图像对应标签。

表1 使用不同陆地显著性检测网络的水下图像显著性检测结果对比Table 1 Underwater image detection performance using different in-air salient object detection networks

图4 使用不同陆地显著性检测网络的水下图像显著性检测示例Fig.4 Underwater image detection results using different in-air salient object detection networks

对比图4 结果发现,对于背景较为简单的图像,所有算法均能较好地检测到当前水下图像的显著区域。而本文提出的UWSODNet 在水下背景较为复杂的图像中能够较好地检测到显著区域,同时其边缘处理得更好。因此可以表明,UWSODNet 对水下图像显著性检测的适应性更好,不会过多受到背景的干扰。

3.3.2 水下显著性检测网络对比

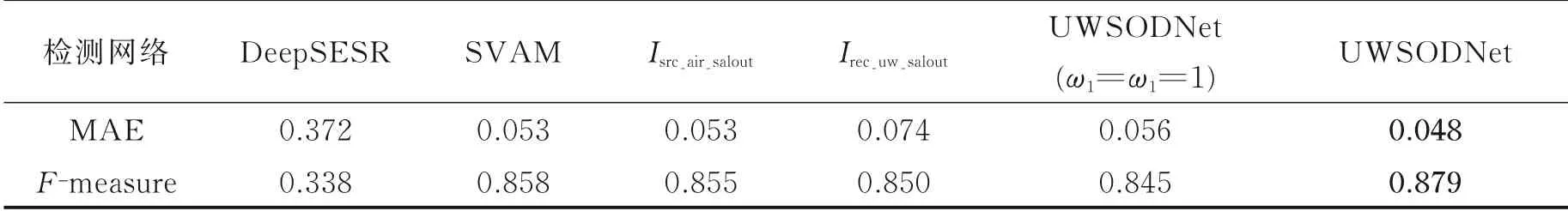

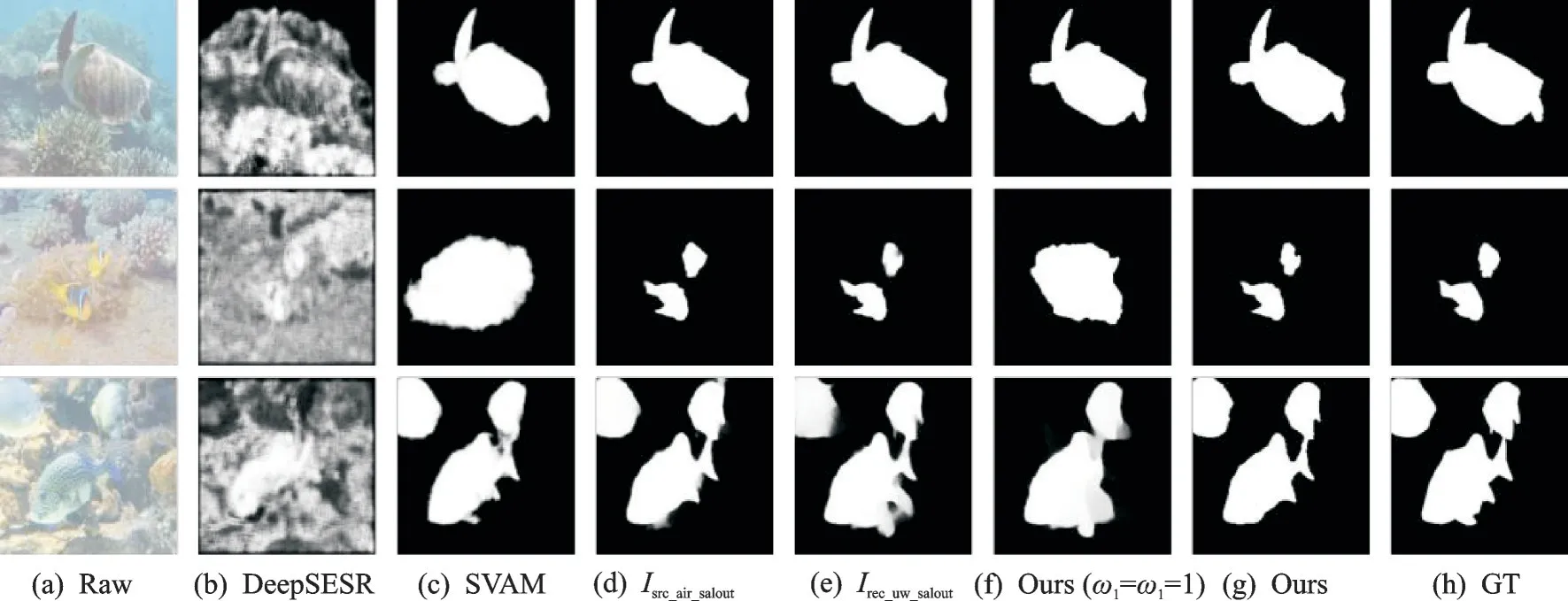

为了评估UWSODNet 的水下显著性检测性能,本文对比了使用水下显著性数据集进行有监督训练的水下显著性检测网络DeepSESR[11]和SVAM[12],测试数据同3.3.1 节。本节同时对比了UWSODNet 每一个生成器输出的显著图和ω1=ω2=1 时网络训练结果,实验结果如表2 所示。

表2 使用不同水下显著性检测网络的水下图像显著性检测结果对比Table 2 Underwater image detection performance using different underwater salient object detection networks

由表2 可知,在未使用水下显著性检测数据集进行有监督训练的情况下,本文提出的UWSODNet效果优于使用水下显著性检测训练集进行训练的DeepSESR 和SVAM,MAE 和F-measure 分别提高0.005,0.021(相对为10.4%,2.4%)和0.324,0.541。实验结果表明,本文提出的基于图像风格转换的水下显著性检测算法能够在没有水下数据集的情况下对水下图像进行有效的显著性检测。由表2 第3、4、6 列结果可知,本文通过对2 个生成器输出的显著图进行叠加能够提高网络检测的性能。对于生成器F输出的显著图Isrc_aie_out,其MAE 和SVAM 网络相同,说明图像风格转换能够减少陆地图像和水下图像之间的差距,从而提高显著性检测网络的性能。为证明网络损失函数L 的参数ω1和ω2对检测结果的影响,本文对比了ω1=ω2=1 和ω1=2、ω2=1 两种训练方式。由表2 第5、6 列结果可知,在ω1=ω2=1 时网络检测效果相较于ω1=2、ω2=1,MAE 和F-measure 分别提高0.008 和0.025(相对为16.7%和2.8%)。表2 检测结果的部分示意图如图5 所示,可见DeepSESR 显著性检测效果较差,而本文网络相较于SVAM 网络在细节上有一定提高。UWSODNet 输出的最终结果相比于2 个生成器输出的显著性检测结果Isrc_aie_out和Irec_uw_out也有一定的提高。UWSODNet 中间输出结果示意图如图6 所示。

图5 使用不同水下显著性检测网络的水下图像显著性检测示例Fig.5 Underwater image detection results using different underwater salient object detection networks

图6 UWSODNet 中间输出结果Fig.6 Intermediate output results of UWSODNet

由图6 可知,本文通过图像风格迁移能够使陆地和水下图像风格相互转换,并使陆地图像成像质量下降,水下图像的成像质量提高。通过级联网络输出两次预测结果,并对预测图进行叠加,能够有效提高检测结果的精度。综上,本文提出的UWSODNet 在水下图像显著性检测中泛化能力较好,对于背景较为复杂的水下图像也能够较为准确地检测。此外只需要对输入图像进行调整,UWSODNet 也可以完成对其他成像质量较差图像(如雾天图像、雨雪天图像)的显著性检测,具有一定的适应性。

4 结束语

本文提出一种新颖的端到端的水下显著性检测网络UWSODNet,将图像风格转换引入了显著性检测网络。该网络能够同时进行图像风格转换和显著性检测两项任务,通过共享特征提取网络的参数增强2 个子网络的关联。网络结构基于UNet 进行改进,使用残差网络替代了卷积操作并增加了空洞卷积层以提高特征提取能力,同时采用拼接结构用来增加与输入图像的关联性,防止编码-解码结构带来图像信息的丢失。实验结果表明,图像风格转换能够有效降低陆地图像和水下图像之间的差距,能够提高显著性检测网络的性能;通过级联结构,对图像进行两次风格迁移并输出2 个显著性检测结果,再对2 个预测图进行叠加能够提高显著性检测结果精度。在小样本或零样本的计算机视觉任务中,本文提供了端到端的解决思路,可以对现有数据集进行图像风格转换并对适应当前任务的网络进行训练。然而本文网络的检测准确性和检测速度还有提升空间,下一步将对网络进行改进,做更深入的研究。