基于滑动块的深度卷积神经网络乳腺X线摄影图像肿块分割算法

2021-01-11梁楠赵政辉周依武博李长波于鑫马思伟张楠

梁楠,赵政辉,周依,武博,李长波,于鑫,马思伟,张楠

1.首都医科大学生物医学工程学院,北京100069;2.首都医科大学临床生物力学应用基础研究北京市重点实验室,北京100069;3.北京大学数字媒体所,北京100871;4.北京大学数学与应用数学实验室,北京100871;5.河南大学影像研究所淮河医院放射科,河南开封475000

前言

乳腺癌是一种比较常见的癌症,发病率在所有女性癌症中占比30%[1]。在临床上,乳腺X 射线影像常用于初期乳腺癌的筛查并且可以为早期诊断提供重要的临床依据[2]。由于乳腺癌的早期症状非常轻微,每个人的乳腺腺体分布及致密的程度存在差异,很难将病灶与类似的乳腺腺体区别开来。因此,对于早期的乳腺癌筛查,采用乳腺X 线摄影进行高精度、自动化的病灶检测是很有意义的。

根据美国放射肿瘤学会(ASTRO)最新版乳腺成像报告与数据系统(BI-RADS)[3]以及最新版中国抗癌协会乳腺癌诊治指南与规范[4],描述乳腺癌X 线摄影图像的征象包括肿块、钙化、结构扭曲、不对称征象、乳腺内淋巴结、皮肤病变、单侧导管扩张、相关特征及部位病变。肿块是乳腺癌常见的病变类型,可将肿块从边缘、形态和密度3 个方面进行描述,肿块的形态描述分为圆形、卵圆形和不规则形3类。参考BI-RADS 评估分类方法,病灶的形态为临床医生诊断病灶的良恶性提供了可靠的依据。本文对乳腺X线摄影图像中的肿块进行了研究。

深度卷积神经网络提取大量特征的能力十分强大,是目前最流行的机器学习算法,在图像分类[5-6]、图像分割[7-8]、目标检测[9-10]等计算机视觉任务的应用中迅速发展。针对乳腺X 线摄影图像的病灶情况复杂,需要有深厚的医学背景和丰富的临床经验辅助判断的情况,国内外学者展开了研究。孙利雷等[11]提出一种通过采用不同卷积核的尺寸进行卷积操作,获得不同粒度的特征图谱,并且结合新的目标函数对肿块进行良恶性分类的方法。Li 等[12]将密集连接的U-Net网络与注意力门控(Attention Gates,AGs)相结合进行乳腺肿块分割。由密集卷积神经网络的编码器以及集成了AGs 的U-Net 解码器构成该模型结构。

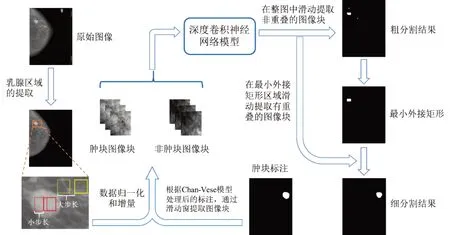

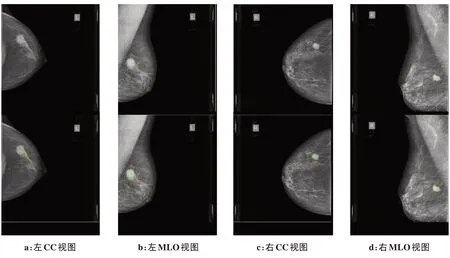

现有的工作都是关注于整幅图像或病灶,导致对病灶局部信息不敏感。而乳腺X线摄影图像中,部分肿块浸润周围腺体组织,肿块边缘模糊并与乳腺腺体难以区分。为了更好地提取肿块与腺体部分的特征,本文提出一种基于滑动块的深度卷积神经网络乳腺X射线肿块分割算法,通过在图像中滑动提取图像块,采用CNN 学习训练所有图像块的特征从而得到模型的分类器,整合图像块的分类结果在整图中实现由粗到细的肿块分割,使得分割结果更贴近乳腺X 线摄影图像中的肿块形态。图1为本文提出的算法框架图,此外,本文使用的数据集是由首都医科大学和河南大学淮河医院共同创建的乳腺X 线摄影图像CCMU-HHNU数据集。

图1 本文算法框架图Fig.1 Framework of the proposed algorithm

1 方法

1.1 乳腺区域的提取

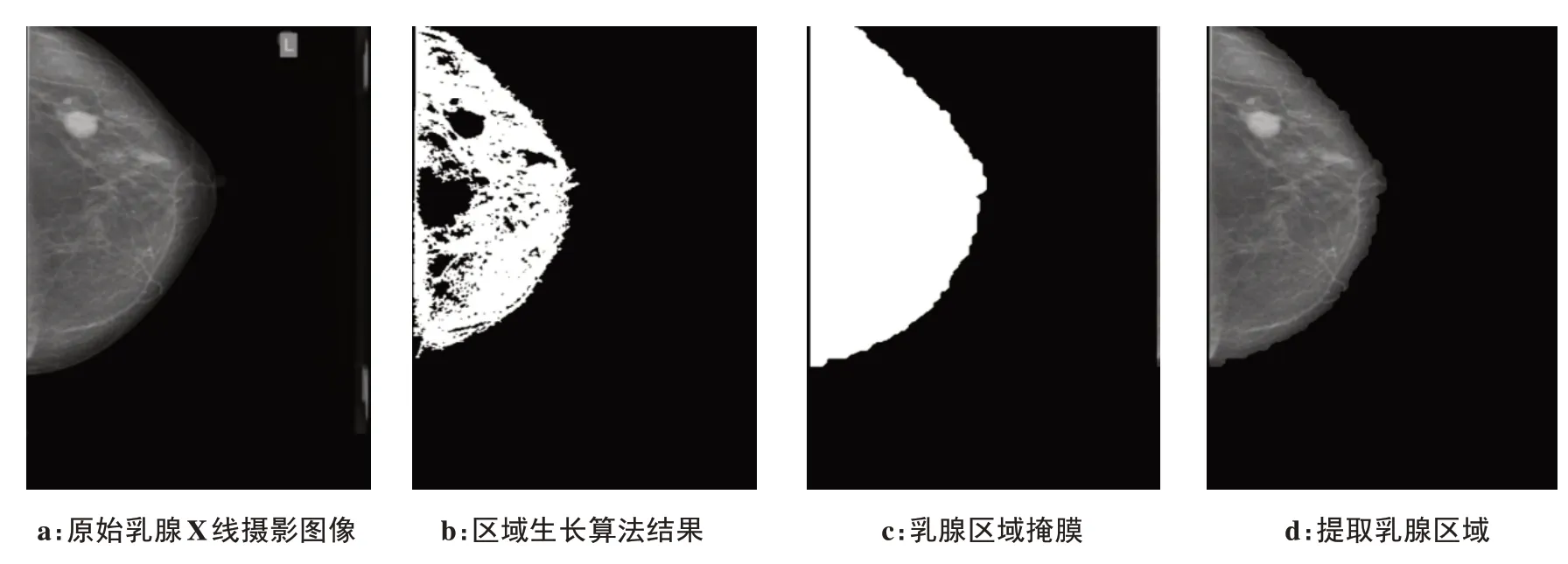

乳腺病灶的自动分割关注乳腺成像实体区域中病灶的识别,因此需消除乳腺X线摄影图像中常规投照体位标识及肌肉组织。本文结合区域生长算法和膨胀算法,实现了乳腺区域的提取,提取乳腺区域的结果如图2所示。区域生长算法是基于区域内像素的灰度相似性,即区域内像素对比度的相似性度量[13]。原始乳腺X 线摄影图像如图2a 所示,从图像中选择一个初始的种子点。比较该点的像素灰度值与其邻域区域中的平均灰度值,通过在各个方向上迭代增长点来扩展区域,得到区域生长算法的结果,如图2b 所示。为了得到完整的连通区域,避免分割结果中的空洞,使用了空洞填充算法和膨胀算法得到乳腺区域掩膜,如图2c 所示。乳腺区域掩膜与原始图像进行“与”操作,从而在图像背景中提取乳腺区域,如图2d所示。根据容忍度阈值τ进行乳腺区域生长,τ取经验值0.06,乳腺区域提取算法的伪代码如下:

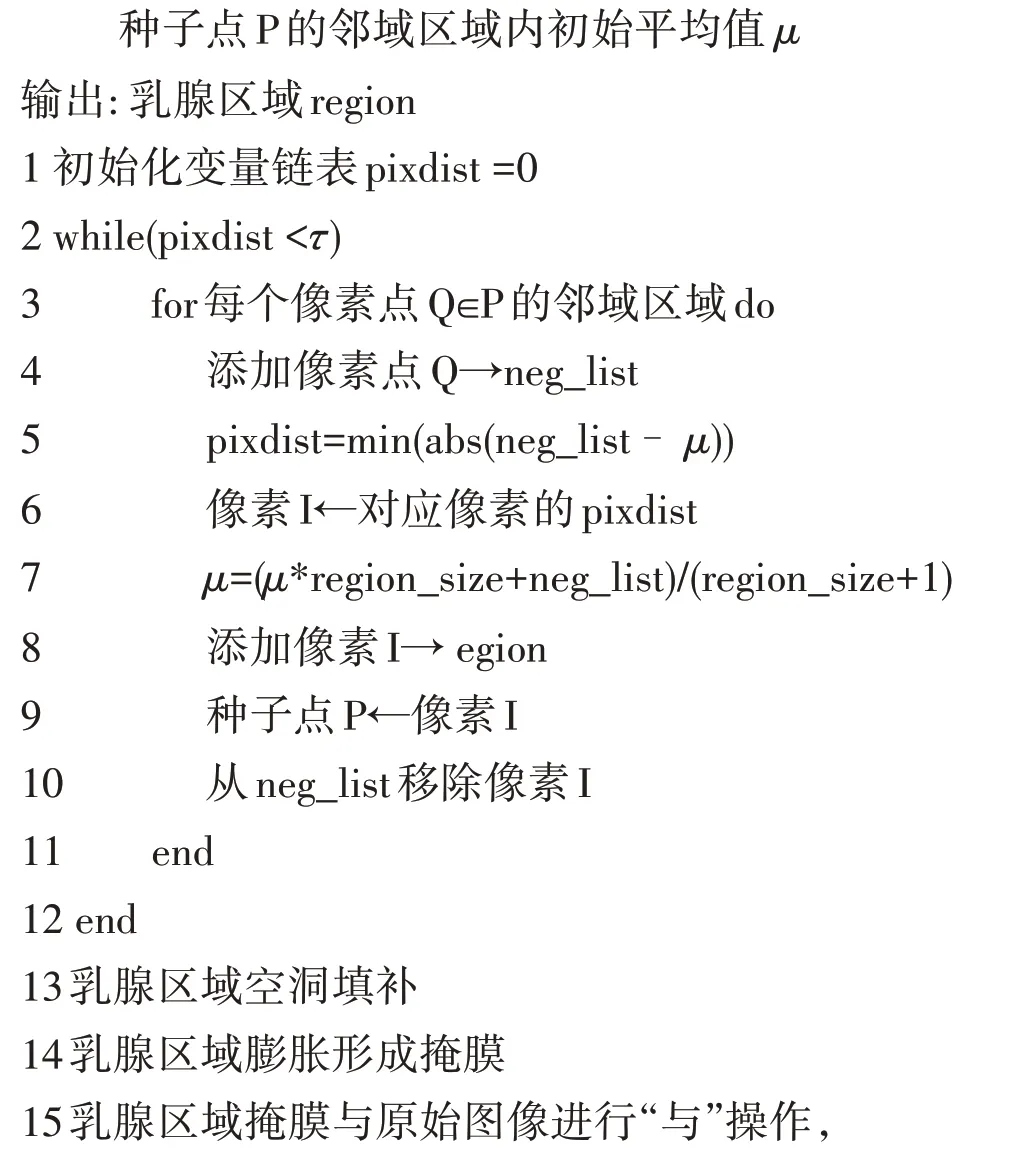

算法1:乳腺区域的提取算法

输入:挑选一个初始种子点P,τ为容忍度,

提取乳腺区域

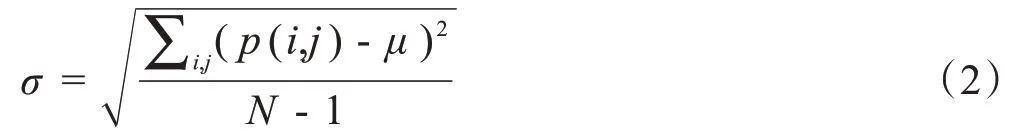

相似性测度定义如下:

其中,p(i,j)是种子点的像素值,μ、σ分别表示在种子点邻域区域像素的平均值和标准差。

其中,N是种子点n邻域区域,n=1。

1.2 数据归一化和增量

图像归一化的主要目的是减少由不同患者之间乳腺组织的辐射剂量和致密程度不同,导致的成像后图像灰度分布不均的问题。为了增强数据集的鲁棒性并提高训练的收敛速度,本文使用z-score 标准归一化操作,通过乳腺区域的平均值和标准差对图像块进行归一化。

大量数据是深度卷积神经网络进行训练数据学习特征的必要条件,而经验丰富的医生标注的数据不易获得。不充足的训练数据将带来过拟合现象,而数据增量是缓解该现象的主要手段之一。在本文中,通过在整图中滑动提取图像块实现了数据的增量。由于乳腺病灶的标注耗时长,且部分病变浸润周围腺体组织,放射科医师对乳腺病灶的图像标注是根据影像经验和病理范围给出的宽泛病灶边界。本文采用Chan-Vese模型解决这一问题[14-16]。Chan-Vese模型是一种基于区域的病灶分割方法。该算法利用原始标注作为水平集分割的初始化,通过寻找最适合图像的最小能量,使轮廓收敛于目标边缘。图3包括乳腺X线摄影图像,放射科医生对病灶的标注以及Chan-Vese模型的自动分割结果。本文以自动分割后的结果作为肿块标注。

在乳腺X线摄影图像中,乳腺腺体组织的面积比肿块的面积大很多,采用相同的步长滑动提取图像块,将导致样本分布不均衡。因此,采用小步长在乳腺肿块标注内提取图像块,这类图像块为肿块类图像块。采用大步长在腺体组织内提取图像块,这类图像块为非肿块类图像块。若采用过大的图像块尺寸,将导致肿块类图像块提取的数据量不足,甚至在一些较小的肿块中无法提取肿块内部的信息。若采用过小的图像块尺寸,将导致提取的图像块包含的特征信息过少,难以得到较好的分类性能。本研究选择的图像块尺寸为64×64 像素和80×80 像素。接下来进行数据增量化处理,对数据进行水平、镜像翻转,以及在0°~30°范围内旋转,以提高模型的泛化能力和鲁棒性。

图2 本文算法提取乳腺区域的结果Fig.2 Results of breast region extraction by using the proposed algorithm

图3 乳腺X线摄影图像、病灶标注及自动分割结果示例Fig.3 Examples of mammogram,ROI annotation and the automated segmentation

1.3 深度卷积神经网络的逐块分类

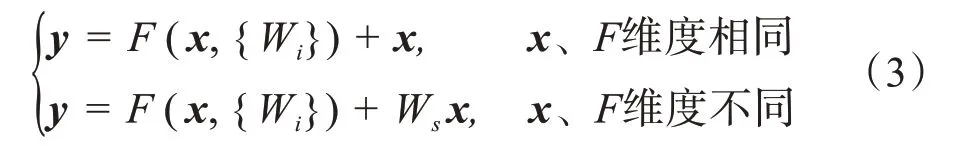

近年来,随着计算能力的提高和大量标注数据的到来,深度卷积神经网络可以提取数据集中丰富且更具表现力的特征。AlexNet,ResNet和Densenet是目前图像分类领域的主流网络模型。AlexNet由Krizhevsky等[17]提出,该网络解决了过拟合问题并实现了巨大的计算量和参数量,验证了深度卷积网络的可行性。研究者们发现深度神经网络存在网络的层数增加但是分类的性能不提升反而出现下降的退化现象,由微软研究团队提出了一种深度残差学习框架ResNet[18],通过在网络层添加恒等映射(Identity Moreapping)的操作,直接跳过一个或多个网络层,快捷连接到网络层的输出,集中对残差模块中输入端和输出端中间的残差进行学习。残差模块定义为:

其中,x和y对应层的输入和输出向量。F表示残差函数,Wi表示网络层的参数,Ws表示用来匹配尺寸的线性投影。

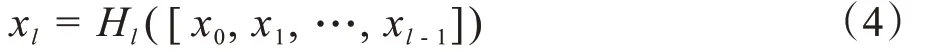

为了进一步优化网络,提出密集卷积网络DenseNet[19],它以前馈的方式将每一层连接到其它层,确保了网络中各层之间的最大特征信息传输。密集的连通性结构使得lth层接收到之前所有层x0,x1,…,xl-1的特征映射,定义为:

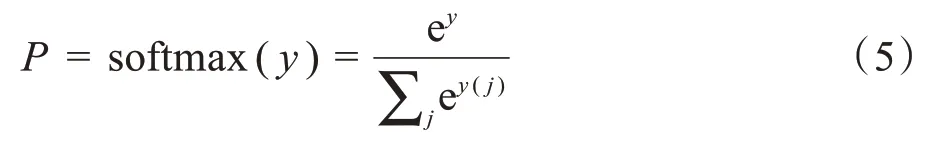

本文采用AlexNet、ResNet 和Densenet 进行逐块分类,比较肿块类、非肿块类图像块分类的结果。通过softmax 函数计算得到每个图像块的分类判断,得到对应的预测分类概率。softmax函数为:

其中,P为预测分类概率。给定阈值t,若P>t,则预测分类为肿块类,否则预测分类为非肿块类。

1.4 由粗到细的乳腺肿块分割

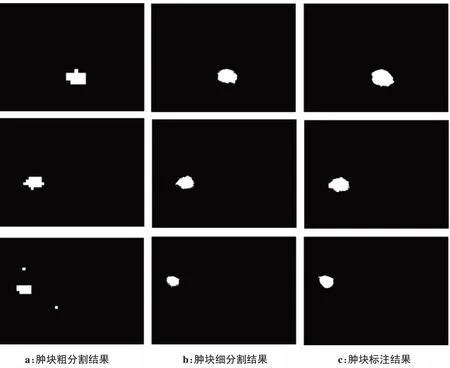

通过逐块训练得到网络模型的分类器后,本文采用由粗到细的乳腺肿块分割方法。本方法通过训练好的卷积神经网络分类器,得到图像块的预测分类结果。整合所有滑动提取的图像块的预测分类结果,可以获得在整个乳腺X线摄影图像中像素级别的肿块分割效果,如图4所示。如果对整个乳腺X 线摄影图像有重叠的滑动取块,将得到大量的图像块,计算所有图像块的预测分类概率将多次调用神经网络模型,非常耗时。因此,本方法提出先在整图中滑动提取无重叠的图像块,再通过训练好的分类器得到图像块对应位置的预测概率输出,采用较小的预测分类概率阈值获得肿块的快速粗分割结果。粗分割结果中存在一些冗余噪声点,本方法采用开运算操作去除冗余信息。

图4 乳腺肿块由粗到细分割结果Fig.4 Results of coarse-to-fine breast mass segmentation

粗分割结果与肿块标注结果差距较大,为了得到精细的肿块分割效果,进行了细分割操作。由于存在图像块被神经网络模型误分类的情况,本方法在粗分割后的局部区域,即在粗分割结果的最小外接矩形区域,滑动提取有重叠的图像块,并整合每个图像块的预测分类结果,以较大的预测分类概率阈值进行细分割。整合所有图像块的预测分类结果可以对误分类的图像块进行补偿。先在整图中得到粗分割结果后在局部区域得到细分割结果,可以降低神经网络模型的调用频率,大大提高了运算速度。由粗到细的乳腺肿块分割方法可以在乳腺X 射线整图中实现更准确、完整的肿块分割效果,更贴近实际肿块形态。

2 实验及结果分析

2.1 数据集

本文所使用的高质量乳腺X 线摄影图像CCMU-HHNU 数据集由首都医科大学和河南大学淮河医院共同创建。图像的位深度为12 bit,医学数字成像和通信(Digital Imaging and Communications in Medicine,DICOM)格式。每幅图像为3 510×4 644 像素,分辨率为50 mm。CCMU-HHNU 数据集收集了来自150 名患者的300 张含肿块乳腺X 线摄影图像,来自150名患者的300张无肿块正常乳腺X线摄影图像。除1例为男性外,其余均为女性。所有肿块类型病例均有病理证实,3 名专业的放射科医师对图像进行标注,选取一名医师标注的数据进行了算法实验。

CCMU-HHNU 乳腺X 线摄影图像数据集由3 部分组成:200张图像构成训练集,验证集60张图像,40张图像构成测试集。数据预处理后,由滑动窗在不同区域提取图像块。训练集中肿块类图像块192 390个,非肿块类图像块188 103 个;验证集中有肿块类图像块38 450个,非肿块类图像块39 348个。

2.2 逐块分类结果

采用AlexNet、ResNet152 和DenseNet40 3种网络模型分析图像块的分类性能并进行比较,如表1所示。通过3种网络模型AlexNet、ResNet152 和DenseNet40 对滑动提取的图像块进行分类,本文评估模型分类性能的指标采用了敏感性、特异性、F1-score和准确性。如表1实验结果所示,在同一尺寸下,图像块分类结果对于不同结构的网络模型不敏感。由于分类结果的测试数据是滑动提取不同尺寸的图像块,因此不同尺寸的测试数据之间没有对应关系,分类结果不能体现图像块的不同尺寸对于性能的影响。在图像块提取操作中,由于相同分辨率的乳腺X线摄影图像肿块区域是不规则的,而图像块是正方形的,因此较小的尺寸提取的图像块数量更多,图像特征信息提取更充分。基于滑动窗提取图像块的方法可以处理不同形状和尺寸的肿块,避免了不同尺寸的病灶和相同尺寸的网络输入之间的矛盾。

2.3 由粗到细的乳腺肿块分割结果

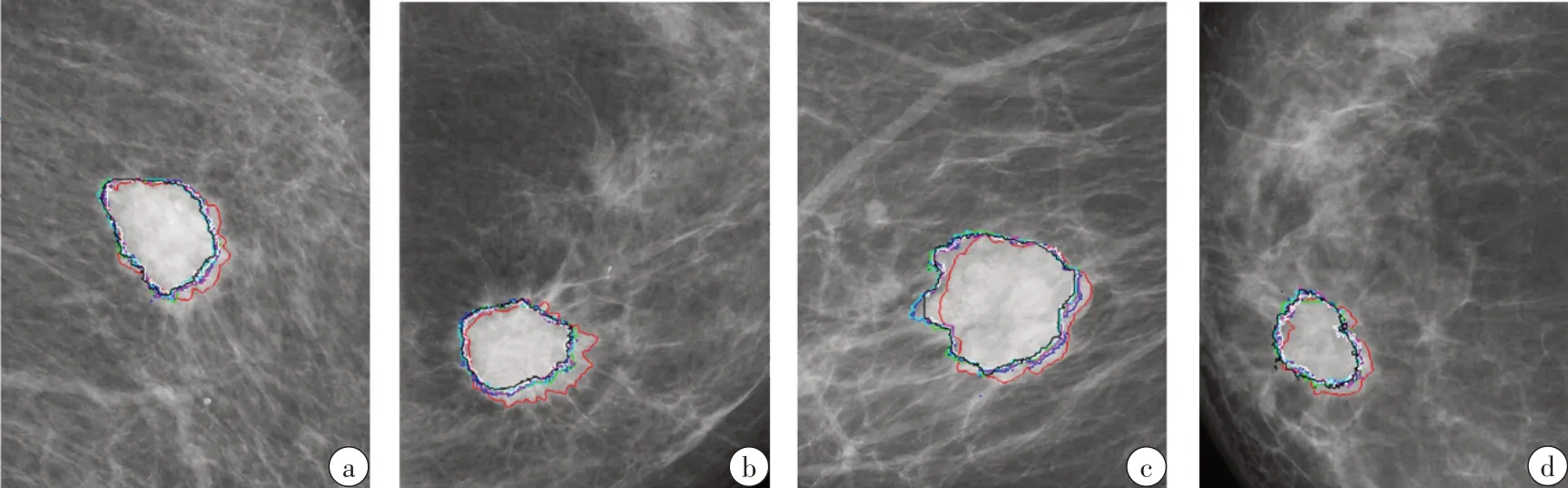

训练好的深度卷积神经网络分类器将整图中提取的图像块,分为肿块类图像块和非肿块类图像块。整合滑动图像块的预测分类结果,得到整图中相应位置的像素级别的肿块分割效果。为了评价AlexNet、ResNet152和DenseNet40 3种网络的图像分割性能,本文采用了敏感性、特异性、F1-score 和准确性。表2为CCMU-HHNU 数据集3 种网络模型的肿块分割性能。在64×64 像素的图像块尺寸下,DenseNet 的性能优于其他算法,F1-socre 为83.49%。与其他网络模型相比,在80×80 像素的图像块尺寸下,DenseNet 的性能最好,F1-socre 为82.23%。肿块分割的操作中,在训练分类器阶段未充分提取到的特征信息,将影响分类器对整图中部分位置提取的图像块的预测分类结果,进而影响整合图像块分类结果的肿块分割性能。采用在整图中无重叠的滑动取块,整合图像块的预测分类结果初步获得肿块的粗分割,再采用在局部区域有重叠的滑动取块,整合图像块的预测分类结果进一步获得肿块的细分割效果。这种结合不同参数、由粗到细的乳腺肿块分割方式,可以有效地降低神经网络模型的调用频率,大大提高运算速度。整合有重叠区域的图像块的预测分类结果,可以参考多个图像块的输出信息,避免单一图像块的误分类对最终结果的影响。图5从左至右的子图为不同患者的乳腺X 线摄影图像采用不同尺寸图像块及网络模型进行肿块分割的结果。

表1 CCMU-HHNU数据集中3种网络的图像块分类性能(%)Tab.1 Image patch classification performance of three networks in CCMU-HHNU dataset(%)

表2 CCMU-HHNU数据集中3种网络的肿块分割性能(%)Tab.2 The mass segmentation performance of three networks in CCMU-HHNU dataset(%)

图5 不同患者乳腺X线摄影图像采用不同尺寸图像块及网络模型的肿块分割结果Fig.5 Mass segmentation results of mammogram images of different patients using different patch sizes and CNNs

3 讨论与结论

本文提出一种基于滑动块的深度卷积神经网络乳腺肿块分割算法。不同于现有的基于深度学习的分割算法,所提算法侧重于通过学习整个乳腺X线摄影图像的局部信息特征,利用有重叠的滑动块达到像素级别的分类效果。整合图像块的预测分类结果,提出由粗到细的框架从而获得了更贴近肿块边缘形态的分割效果。为了克服有临床医生标注的乳腺病灶图像不易获得的困难,本文采用了一系列增强方法来丰富训练数据的多样性。最后,通过充分的实验来比较不同网络架构和不同图像块尺寸的分割效果,实验结果证明了该算法的有效性。在未来,本研究还将对提取出的乳腺病灶分割区域做具体形态参数求取,为智能数字化乳腺影像诊断报告的撰写提供技术支持。