基于深度学习的网购评论命名实体识别方法*

2021-01-05仇增辉赫明杰林正奎

仇增辉,赫明杰,林正奎

(大连海事大学信息科学技术学院,辽宁 大连 116026)

1 引言

命名实体识别NER(Named Entity Recognition)是开展网络评论分析、内容检索、事件检测、机器翻译、问答系统等研究的一项基础性工作,其目的是识别出评论文本中的人名、地名等专有词汇和有意义的时间、日期等数量短语并加以归类[1]。网购评论作为一类代表性的网络评论,由于参与人数多、评论数量大、评论过程持久、内容表达方式口语化、情感表达方式多样化等鲜明特点,导致其命名实体识别任务的挑战性巨大,因而得到了学术界的广泛关注。

命名实体识别研究起步于20世纪90年代初期。1991年Rau[2]在第7届IEEE人工智能应用会议上发表了“抽取和识别公司名称”的有关研究文章,首次描述了采用启发式算法和手工编写规则抽取和识别公司名称的方法。1996年,命名实体评测作为信息抽取的一个子任务被引入MUC-6[3],在其后的MUC-7的MET-2[4]以及IEER-99、CoNLL-2002、CoNLL-2003、IREX、LREC等一系列国际会议中,命名实体识别都被作为其中的一项指定任务。在中文命名实体识别方面,孙茂松等[5]在国内较早开始采用统计的方法进行了中文人名识别;张小衡等[6]采用人工规则对中文机构名称进行了识别与分析。Intel中国研究中心的Zhang等[7]提出了利用基于记忆的学习MBL(Memory Based Learning)算法获取规则,用以抽取中文命名实体以及它们之间的关系,之后众多学者将该方法应用到中文命名实体识别研究之中并取得了比较丰富的研究成果。相对于英文命名实体识别,由于中文自身所具有的语言表述方式的复杂性、多样性和发展迅速性,导致其命名实体识别与英文相比,挑战更大,目前尚未解决的难题更多。

目前传统的命名实体识别方法主要包括:基于规则和词典的方法、基于统计机器学习的方法和二者混合的方法等。其中,基于规则和词典的方法借助知识库和词典,利用语言学专家手工构造的规则模板进行命名实体的识别,是命名实体识别中最早使用的方法。例如,Hu等[8]通过建立规则模板将网购评论中的名词和名词短语作为属性词,将距离属性词最近的形容词作为观点词;Lakkaraju等[9]通过建立规则模板把动词或形容词作为观点词,利用滑动窗口把高频名词或名词短语作为属性词。该类方法存在实施周期长、移植性差等问题。基于统计机器学习的方法通过人工选取文本特征,借助融合语言模型和机器学习算法进行命名实体识别,代表性的方法主要包括隐马尔可夫模型[10]、最大熵[11]、支持向量机[12]、条件随机场CRF(Conditional Random Field)[13]等。Liu等[14]通过最大熵模型构造了属性词与标签之间的映射关系,利用隐马尔可夫模型进行属性词的命名实体识别。Kim等[15]运用最大熵模型学习语法特征进而识别出观点发表者。该类方法由于需要从文本中选择对特定任务最有影响的各种特征,并将这些特征加入到特征向量之中,因此对特征选取的要求较高,同时也对参与模型训练的语料库依赖性较大。这些混合方法主要包括规则、词典和机器学习方法和不同机器学习方法之间的混合方法。该类方法虽然在应用实践中被普遍采用,但在融合技术的选择和实现等方面仍然面临着许多问题。

近年来,随着基于神经网络的各类深度学习方法的快速发展,命名实体识别研究逐渐从机器学习转向深度学习。该类方法首先使用大规模的未标注语料进行词向量训练,然后通过将预训练的词向量输入到深度学习网络模型,用以实现端到端的命名实体识别。如Huang等[16]利用双向长短时记忆BiLSTM(Bidrectional Long Short-Time Memory)网络和条件随机场进行命名实体识别;刘新星等[17]利用循环图和开关递归神经网络模型对属性词进行识别;沈亚田等[18]利用长短时记忆模型对评价词和评价对象进行命名实体识别;Shahina等[19]利用不同的递归神经网络单元(例如递归神经网络、长期短期记忆、门控递归单元、堆叠式)进行命名实体识别;Ali等[20]利用自注意力机制与LSTM(Long Short-Term Memory)相结合的方法对阿拉伯语进行了命名实体识别;Cao等[21]利用对抗迁移学习和自注意力机制对微博文本进行命名实体识别;Zhu等[22]利用具有局部注意力机制的卷积神经网络和具有全局自注意力机制的门控递归网络进行命名实体识别。相比传统机器学习方法,基于深度学习的方法通过自主学习而非人工方式从原始数据中获得更深层次和更抽象的文本特征,较好地解决了传统方法特征选取难度大和对数据的人为干扰等问题,因而成为研究热点。但在应用实践中,针对不同的问题域特征,基于深度学习的方法在提高命名实体识别效率和准确性方面,仍有许多难点问题需要进一步探索。其中,注意力模型结合深度学习方法用于命名实体识别是一个重要研究方向。

本文以现实情境下中文网购评论文本的命名实体识别作为研究对象,为使命名实体识别更聚焦于人们所关注的评论内容的目标主体,提出了一种多头注意力机制MA(Multi-head Attention)和BiLSTM-CRF(Bidirectional Long Short-Term Memory-Conditional Random Field)模型相结合的网购评论命名实体识别方法MA-BiLSTM-CRF。通过实验验证,两者的有机结合可进一步提高网购评论中命名实体的整体识别效率和识别准确性。

2 BiLSTM-CRF模型简介

BiLSTM-CRF模型源自长短时记忆LSTM模型和条件随机场CRF算法的结合。LSTM 最初由Hochreiter和Schmidhuber提出[23],作为一种特殊循环神经网络RNN(Recurrent Neural Network)结构,能够学习到长期依赖关系,以解决梯度消失和梯度爆炸问题。该模型利用BiLSTM层的输出作为原始CRF模型的参数,最终获得标签序列的概率。

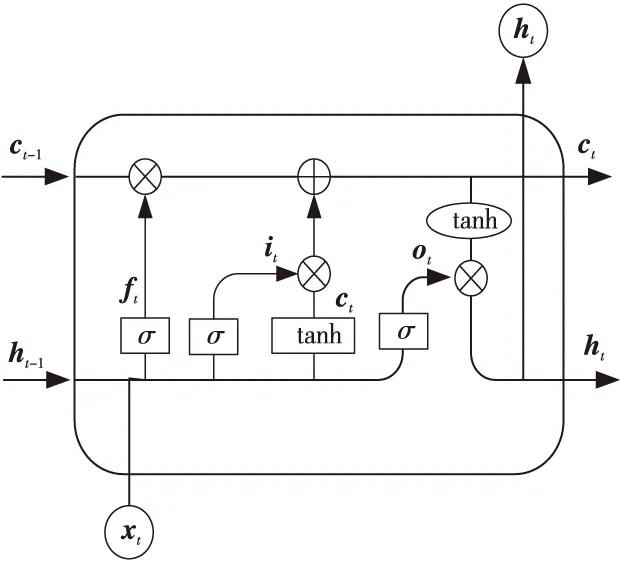

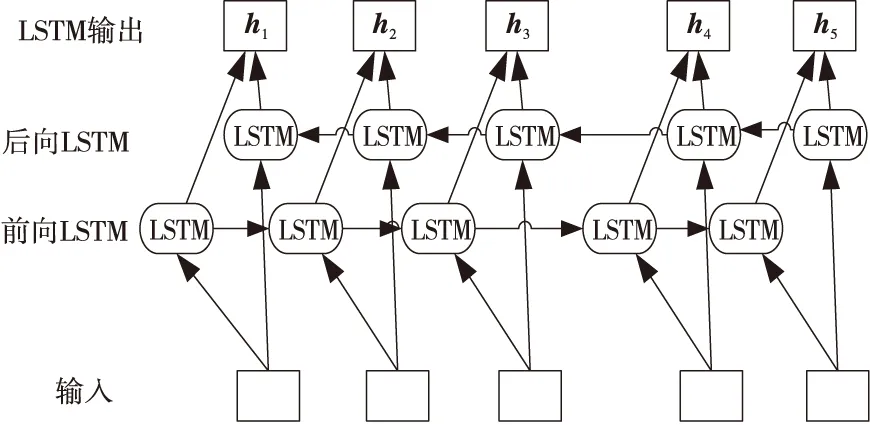

LSTM的单元结构如图1所示。在t时刻,每个LSTM 单元的输入有3个,分别是当前时刻网络的输入值xt、上一时刻 LSTM 单元的输出值ht-1和上一时刻的单元状态ct-1;输出有2个,分别是当前时刻 LSTM 的输出值ht和单元状态ct。每个LSTM 单元通过遗忘门、输入门和输出门控制是否将当前输入信息忽略或者传递给下一个单元。门(Gate)本质上是一层全连接层,输入是一个向量,输出是一个0~1的数,表示允许信息通过的多少,0表示不允许完全通过,1表示允许完全通过。LSTM的优点是使当前单元可以得到本单元之前所有单元的信息,但其缺点是无法获得本单元之后的单元信息。为解决这一问题,学者们通过对其改进提出了双向LSTM即BiLSTM模型,如图2所示。BiLSTM的基本思想是分别用前向和后向的LSTM 来抓取过去和将来所含的隐藏信息,这2部分的信息组成最终的模型输出。之后许多研究者针对BiLSTM 进行了一系列的优化改进工作,其中BiLSTM-CRF模型[24]的表现尤为突出,现已被广泛应用于自然语言处理领域内命名实体识别、词性标注、分词等多个方面。

Figure 1 Schematic diagram of LSTM unit图1 LSTM单元示意图

Figure 2 Schematic diagram of BiLSTM unit图2 BiLSTM单元示意图

BiLSTM模型结合CRF算法主要用于解决命名实体识别的有效性问题。理论上BiLSTM虽然可以获得输入语句的命名实体标签,但是由于无法建立彼此之间的依赖关系,因此并不能保证所获得的命名实体标签的有效性,而通过将CRF从训练数据中自动学习得到的标签序列之间的约束条件添加到最终的命名实体标签,则可以保证预测标签的有效性。如图3所示,BiLSTM-CRF模型由向量层、BiLSTM网络层和CRF层3部分组成。对于一个输入句子,首先经过向量层将每个词汇或字符映射为一个词向量或者字符向量;然后传入BiLSTM层,获得句子的前向向量和后向向量;接着将前向向量和后向向量进行拼接作为当前词汇或字符的隐藏状态向量;最后将包含上下文信息的语义向量输入到 CRF中进行解码,通过 CRF计算出序列文本每个词语或字符的标签,将具有最高得分的标签序列作为模型预测的最好结果。

Figure 3 Structure of BiLSTM-CRF model图3 BiLSTM-CRF模型结构图

3 基于MA-BiLSTM-CRF的网购评论命名实体识别方法

3.1 问题的提出

基于评论文本的网购评论分析,利用命名实体识别、关系抽取、情感计算等方法,获得消费者关于商品的情感偏好特征,是在线评论分析中最具代表性的研究内容之一,其分析结果的有用性和可信度对网购活动具有重要影响。BiLSTM-CRF模型应用于网购评论分析,通过自动学习上下文语义信息,一定程度上克服了对人工选取特征和专家知识的依赖[25],同时利用CRF计算输出标签序列的全局概率,进一步提高了命名实体识别的准确率。但在现实情境下,不同类别消费者对商品或其属性作出的评价所产生的实际影响往往存在很大差异,由于BiLSTM-CRF模型并未考虑到不同词的特征向量对命名实体识别的贡献程度,因此无法保证识别结果的有用性和可信度。

近年来,注意力机制被广泛应用于自然语言处理领域中,其在文本处理中的特点是为重要的文字特征赋予较高的权重,而多头注意力机制可依据特征向量的重要程度,从多角度综合计算特征向量的权重,可有效解决特征向量的赋权问题,提高命名实体识别效率。综上所述,本文借鉴多头注意力机制,基于词汇贡献度和双向长短时记忆条件随机场提出一种基于MA-BiLSTM-CRF模型的网购评论命名实体识别方法,以实现从众多命名实体标签中选择出对网购评论分析任务目标更关键的命名实体标签。

Figure 4 MA-BiLSTM-CRF model structure and named entity recognition process图4 MA-BiLSTM-CRF模型结构与命名实体识别过程

3.2 MA-BiLSTM-CRF模型构建

MA-BiLSTM-CRF模型结构如图4所示,包括输入层、向量层、BiLSTM层、多头注意力机制层和CRF层。

(1)输入层。

输入层对原始网购评论文本进行数据清洗降噪、分词、词性标注和命名实体标注等预处理,得到符合模型要求的数据集。首先,对网购评论文本的结构特征进行大数据统计分析,基于分析结果去除评论文本中过短、过长的评论和与商品内容无关的评论;然后,对其进行分词和词性标注处理;最后,对其进行命名实体人工标注。考虑到网购评论的口语化特征,本文通过提取特定商品评论常用词构建自定义词典库,以提高分词及词性标注的准确率。

(2)向量层。

(3)BiLSTM层。

BiLSTM层通过前向LSTM层和后向LSTM层连接同一输出层,充分利用上下文信息以获得网购评论中每个词所对应的不同命名实体标签的概率。

步骤1计算前向LSTM。

(1)

步骤2计算后向LSTM 。

(2)

步骤3将前向和后向的ht拼接作为多头注意力。

(3)

其中,xt是t时刻向量层的输出向量,即BiLSTM层t时刻的输入向量;ct-1是t-1时刻记忆细胞的状态;ht-1是t-1时刻LSTM层输出向量;ct是t时刻的记忆细胞状态;ht是t时刻BiLSTM层的输出向量,该层的输出向量序列构成的矩阵记为H=(h1,…,hi,…,ht)。

(4)多头注意力机制层。

最近几年注意力机制在图像处理、语音识别、机器翻译等深度学习的各个领域被广泛使用。鉴于现实情境下,网购评论中的每个特征向量对命名实体识别的实际贡献率不同,本文在传统BiLSTM-CRF模型中通过引入多次自注意力(Self-Attention)计算机制,即多头注意力机制层,为输入序列的不同词语赋予不同的权重,以保证在计算能力有限的情况下,使模型快速收敛于需要重点关注的命名实体标签。

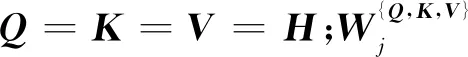

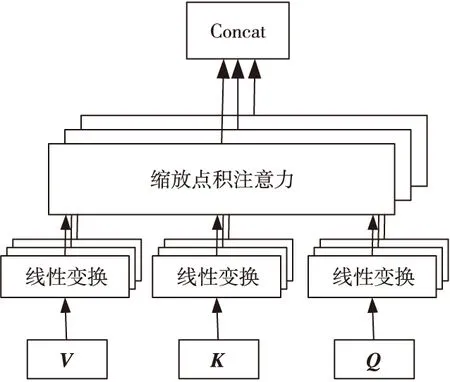

如图5所示,多头注意力机制以BiLSTM层的输出矩阵H作为输入,主要由查询矩阵Q、键矩阵K、值矩阵V和缩放点积注意力(Scaled Dot-Product Attention)组成[26],其计算过程如下所示:

步骤1对Q、K、V分别进行线性映射。

(4)

(5)

(6)

Figure 5 Structure of multi-head attention mechanism图5 多头注意力机制结构

步骤2计算缩放点积注意力。

首先,对Q′和K′中的每个向量通过点积的方式进行相似性计算。

最后,根据得到的权重系数对V′进行加权求和。

(7)

步骤3计算多头注意力。

将步骤1和步骤2循环计算h次得到的缩放点积注意力结果进行拼接,再进行一次线性映射得到h头注意力的计算结果值M:

M=Concat(M1,…,Mi,…,Mh)

(8)

(5)CRF层。

CRF层通过引入状态转移矩阵获得实体标签之间的依赖关系,以提高命名实体识别效果,计算过程如下所示:

步骤1给定网购评论语句(s1,…,si,…,sn),其中si表示网购评论语句的第i个词语,使用CRF计算其所有的实体标签序列(y1,…,yi,…,yn)的概率为:

(9)

其中,Tyi-1,yi表示从实体标签yi-1成功转移到实体标签yi的分数;Mi,yi是多头注意力机制层输出的矩阵元素,表示网购评论语句中第i个词语为实体标签yi的概率;Z(X)为规范化因子。

(10)

步骤2使用Viterbi算法[27]判断最有可能出现的标签序列,并将其作为最终的命名实体识别的标注结果。

4 实验结果及分析

4.1 实验数据及评价指标

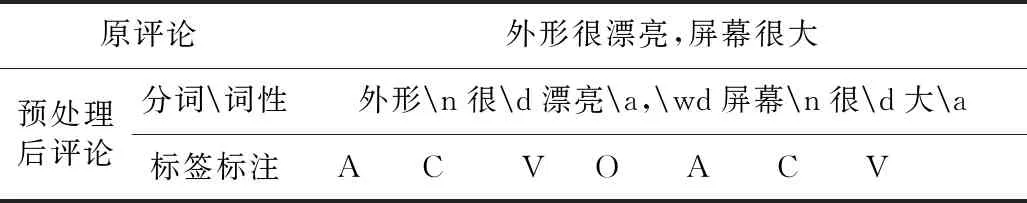

本节对所提出的方法进行了实验验证。实验基础语料来自于某电商平台2017年4月28日至2018年6月28日某品牌型号手机的11 536条网购评论相关信息,包括商品ID、商品名称、店铺名称、商品价格、商品月销量、总评论数、评论内容、评论时间、商品评分、店铺服务评分、物流评分、追评数、评论中图片数量等信息。首先,本文对上述网购评论进行预处理,主要包括去噪、分词处理和词性标注3个部分,然后通过人工标注的方法对预处理后的词进行标签化处理,即将指代商品一般特性的词作为属性词,标注为A;将指代商品属性所持意见的词作为观点词,标注为V;将程度副词标注为C;将其他词和标点符号统一标注为O。经上述处理后形成的实验数据实例如表1所示,其中,n表示名词;d表示副词;a表示形容词等。随机选取其中的80%组成训练集,剩余20%组成测试集,各类别的标签标注数量如表2所示。

Table 1 Example of experimental data表1 实验数据实例

Table 2 Label quantity of experimental data表2 实验数据标签标注数量

本文采用准确率(P)、召回率(R)和F1值3种在命名实体识别领域通用的评价指标来对所提出方法的性能进行评估。3种评价指标具体定义为:

(11)

(12)

(13)

4.2 超参数设置

针对实验语料特征选择一组合适的超参数对于模型性能尤为重要。通过多次对比实验不断调整优化参数,模型表现最好的超参数设置方案如表3所示。

Table 3 Super parameter setting表3 超参数设置

4.3 实验结果

为验证本文方法的有效性,将其与CRF、LSTM、BiLSTM、BiLSTM+CRF进行了5组对比实验,具体实验结果如表4所示。

Table 4 Comparison of experimental results between the method in this paper and the mainstream methods表4 本文方法与主流方法的实验结果对比 %

从实验结果可以看出,首先LSTM同CRF相比,其准确率、召回率和F1值分别提高了4.73%,7.24%和5.57%。可见,在命名实体识别中LSTM比CRF更有优势,具有更好的远程依赖关系,更能充分地提取和利用评论文本中的特征。其次,BiLSTM同LSTM相比,其准确率、召回率和F1值都有所提高,可见,BiLSTM通过正向LSTM和反向LSTM叠加,既保存了评论文本中过去的特征信息,又保存了文本中未来的特征信息,从而更充分地利用了上下文特征信息,其效果要优于单向LSTM。通过BiLSTM和BiLSTM-CRF对比分析发现,加入了CRF的BiLSTM比单一BiLSTM具有更好的效果,说明CRF模块能够通过联合概率的计算,更加充分地利用标签的相邻信息和标签之间的依赖关系,为BiLSTM预测的标签添加限制,减少BiLSTM识别的错误结果。

相比于上述方法,本文提出的方法由于在BiLSTM-CRF基础上进一步引入了多头注意力机制,不仅可以获取文本的局部特征,而且实现了从多角度、多层面计算不同词的特征向量的权重,提高重要特征的权重,从而抑制无用信息。尽管本文提出的方法增加了部分计算量和模型的复杂度,但是有效地解决了不同词的特征向量对命名实体识别的贡献程度不同以及特征抽取不全面的问题,并在实验数据集上取得了更好的性能表现。

5 结束语

本文针对中文网购评论命名实体识别过程中重要词汇可能被忽略而导致的后续分析任务效用下降问题,在深度学习模型BiLSTM-CRF的基础上,通过引入多头注意力机制,提出了一种多头注意力机制和BiLSTM-CRF模型相结合的中文网购评论命名实体识别方法MA-BiLSTM-CRF,以提高网购评论中关键命名实体识别的效率和准确率。该方法在真实实验语料上取得了较好的实验效果。从如何更好地服务于网购评论分析的最终目的出发,进一步提高关键性命名实体识别的准确率和识别效率将是下一步的重点研究工作。