基于双路信息互补增强的压缩感知深度重构

2020-12-22熊承义秦鹏飞高志荣施晓迪刘川鄂

熊承义,秦鹏飞,高志荣,施晓迪,刘川鄂

(1 中南民族大学 电子信息工程学院&智能无线通信湖北省重点实验室,武汉430074;2 中南民族大学 计算机科学学院,武汉 430074)

压缩感知(Compressed Sensing, CS)[1]可用于实现信号的采样与压缩的同时完成,对于降低信号存储和传输成本具有重要意义.目前,压缩感知已经在多个领域得到了广泛应用,如:单像素成像[2]、核磁共振成像[3]等.压缩感知重构是压缩感知理论的核心问题,旨在从降维的测量值还原出原始的被测量信号,其为典型的病态逆问题.传统的图像压缩感知重构着重探讨利用信号的稀疏性先验,设计规则化的图像重建建模,并使用迭代优化方法求解.这类方法主要缺点在于,一是计算复杂高,难以使用硬件高效加速;二是人工设计的稀疏先验(如固定基DCT、DWT域的稀疏或是自适应的非局部稀疏)难以完全符合图像的特性,并存在规则化参数的有效选择的问题.

近年来,随着深度学习在图像分类和计算机视觉等领域的成功应用,基于深度网络的压缩感知重构方法引起了人们的极大关注.MOUSAVI等人最早提出了基于堆栈去噪自编码器(SDA)的CS重构网络[4],使用卷积神经网络得到直接由测量值到图像的端到端映射.之后,KULKARNI等人提出了一个非迭代的CS重构网络ReconNet[5],具体由一个全连接层后面堆叠两个SRCNN模型[6]实现. 将ReconNet与残差学习相结合,YAO等人进一步提出了深度残差重构网络DR2-Net[7].相对于ReconNet,后者由于含有更多的卷积层,因此得到了重建图像质量的更佳改善.为了同时改善测量矩阵的采样效率,SHI等人提出了联合学习采样的网络CSNet[8].大体来说,基于深度学习的重构网络,在一定程度上增加网络的深度,通常能够得到重构性能的更多提升,原因在于更深的网络具有更强的学习表示能力.最近,设计多通道网络以改进深度学习的能力也得到了许多关注,比如,ZHANG等人提出了一种基于双通道特征融合的深度CS重构网络,通过设计一个残差支路和密集支路的结合[9],分别获取图像的高阶特征与低阶特征,有效改进特征提取能力,从而获得了比DR2-Net更好的重建效果.

受以上工作的启发,以及考虑到准确重建降维的CS图像比重建原始分辨率的图像具有更大的可能性,本文设计了一个新的基于双路信息互补增强的压缩感知深度重构网络.主要思想在于,设计网络由两个并行通道组成,一个通道实现对图像原始分辨率的重构,另一个通道实现对图像的降采样重构;两个通道的中间特征提取部分采用多级的信息交叉融合,以实现特征信息提取的互补增强,最终得到重构图像质量的有效提升.基于峰值信噪比(PSNR)、结构相似性(SSIM)和视觉效果的评测结果表明,本文方法的重构图像质量比较以往同类方法有明显改进.

1 相关问题描述

压缩感知重构是一个典型的逆问题,到目前已有大量方法被提出用于解决这个问题.根据应用先验知识的方式,这些方法大致可分为两类,一类是基于优化理论发展的基于模型的方法,一类是基于深度学习的数据驱动的方法.

假设被测量的原始信号为x∈CN,基于CS得到的测量值为y∈CN,基于传统稀疏先验的CS优化重构模型可表示为[1]:

(1)

其中,Φ∈CM×N,(M≪N为测量矩阵,Ψ为稀疏变换矩阵,‖·‖lp表示lp范数(p∈[0,1]).式(1)中第一项称为保真项,第二项称为规则化项.λ为正则化参数,用于平衡两者之间的关系.为了求解式(1)的最小优化问题,大量的迭代算法被先后提出,包括FISTA[10]、Chambolle-Pock algorithm[11]等.总体来说,这类方法具有计算复杂,稀疏性先验不能完全拟合图像特性,并需要手动设置参数,难以应用于实际等缺陷.

过去几年中,深度神经网络因其强大的表征能力已经成为建模特征间复杂关系的有效工具,并在压缩感知重建等图像复原任务中得到有效应用.这类基于深度神经网络的图像重构方法,通常是在大量训练数据的监督下学习得到输入和输出图像之间的非线性映射fNN(w;y).给定一个训练数据集Ω,它由成对的采样值和原始图像(y,x)组成,基于深度神经网络的CS重建方法,主要任务在于首先构建一个网络模型,并通过损失函数最小化找到优化的网络参数,即:

(2)

其中,L是定义的损失函数.基于深度学习的方法可自动探索图像的复杂特征,能够大大降低重构时间延时,因此成为当前研究的主流方向.

2 提出的方法

本文提出的双路信息互补增强的压缩感知重构网络,包含两个并行的重构通路,不同通路得到图像的不同分辨率特征表示.一个通路负责实现具有原始图像分辨率的特征学习,而另一个通路负责实现2倍因子的降采样分辨率的特征学习重构.两个通路的特征学习包括多个阶段,并进行交叉融合以达到特征信息的互补增强.

2.1 网络结构

如图1所示,网络的整体结构由三个模块组成:联合重构模块学习的卷积采样模块(ConvS)、初始重构模块(InitR)和基于双支路特征互补增强的深度重构模块(DeepR).卷积采样模块根据原始图像获得一组测量值.为了提升采样效率和动态拟合图像特性,这里使用一个卷积层实现,即测量矩阵的系数与重构网络一起联合学习得到.假设原始图像为x,测量值用y表示,卷积采样过程可表示为:

y=fconvs(wconvs;x),

(3)

(4)

(5)

wdeepr表示其参数.值得注意的是,在深度重构阶段,均通过3×3卷积对输入和输出进行信息调整.在这一阶段,残差连接和密集连接两种技术被联合采用,以充分促进信息的传输和复用,缓解梯度消失或爆炸的问题.

图1 网络的整体结构框图Fig.1 Overall structure of the proposed network

2.2 深度重构模块

深度重构模块由特征增强模块和互补融合模块构成.前者内置于深度重构的不同阶段,完成多步上、下通道特征的协作增强;后者用于综合上下通道信息,通过特征融合最后提高网络的特征表示能力.

(1)特征增强模块

特征增强模块通过利用通道注意力机制,将由上通道提取的注意力信息,同时用于上、下通道特征信息的判别选择,其结构如图2所示.首先,使用3×3的卷积分别学习上下通道的特征,然后提取上通道的通道注意力信息[13],最后将上下通道的特征分别与其相乘得到特征的判别提取,具体实现可表示为:

(6)

式中,xu,Xu+1,xd,Xd+1分别表示上下通道的输入特征图和增强后的特征图;fse表示提取通道注意力操作,由全局池化、全连接、relu、全连接、sigmoid组成[13].

共享相同的采样值,上通道的初始重构图像分辨率低,可视为降低了图像的压缩率,图像更容易准确重构.因此,这里提取上通道的通道注意力,除了用于自身的特征增强外,还将质量较好的通道关系作用于下通道.这种方法比使用下通道的通道注意力或者使用上下通道两者的通道注意力效果更好.

图2 特征增强模块的内部结构Fig.2 The internal structure of the feature enhancement module

(2)信息融合与重构模块

信息融合重构模块在充分融合两通路特征信息的基础上,实现图像的最后重构,其内部结构如图3所示.首先,对下通道的特征图进行卷积核大小为3×3,步长为2的降采样操作,得到和上通道大小一致的特征图.然后,将其与上通道相减得到差值信息,使用转置卷积将此差值信息进行2倍上采样.最后,将差值信息和下通道未降采样的特征信息相加后再经过一层卷积操作,变换得到最终的重构图像.信息融合与重构模块的计算可表示为:

xlast=xd+fup(xu-fdown(xd)),

(7)

式中,xu和xd分别表示上下通道的特征图;fup和fdown分别表示上下采样,xlast表示信息互补后的特征图.这里,由于图像分辨率不一样,两支路的输出包含不同的内容和特性,信息互补融合模块充分利用上下通道学习到的内容,提高网络的特征表示能力.

图3 信息融合重构模块的内部结构Fig.3 The internal structure of the information fusionreconstruction module

2.3 损失函数

网络训练使用均方误差(MSE)作为损失函数,监督最终重构图像以及上下通道的初始重构图像与真实图像的误差.通过设计初始重构图像与最终重构图像同时逼近真实图像,可以有效加速网络训练并提高最终重构图像质量.设计的损失函数由三项组成,具体如式(8)所示:

(8)

3 实验

3.1 实验设置和训练数据

本文的实验设置和训练数据与SCSNet[14]保持一致.卷积采样中分块大小为32,步长为32,特征增强模块中降维参数r为4.损失函数中α,β,λ参数根据经验设置为1.训练数据是由BSD500数据集中的训练集(200张)和测试集(200张)组成,剪裁为96×96的大小,使用数据增强(旋转和翻转)扩充数据集.BatchSize设置为64,共训练100个周期.学习率初始值设为0.002,每7个周期衰减为原来的0.7倍.使用Python语言在TensorFlow深度学习框架下完成实验,使用Adam优化器优化所有网络参数.在Ubuntu 18.04系统上面使用一张12 GB的Nvidia TITANX显卡完成训练和测试.

3.2 实验结果

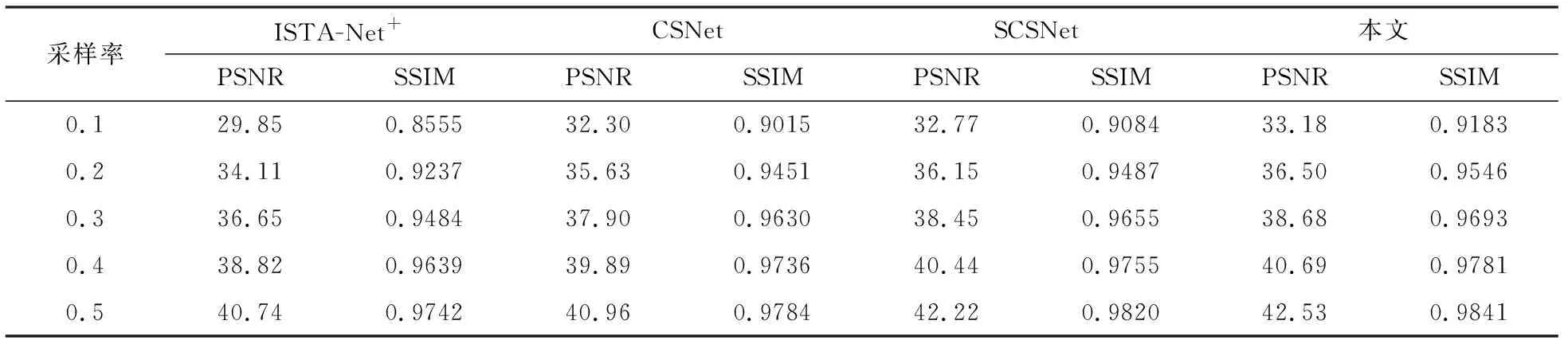

对比的方法包括ISTA-Net+[15]、CSNet[8]、SCSNet[14],其中CSNet、SCSNet采用的是 [14]中给出的实验结果,ISTA-Net+是复现论文代码得到的结果,参数与论文中保持一致.表1列出了在Set5测试集上对比效果,包括0.1、0.2、0.3、0.4、0.5五种不同的采样率,最好的效果使用加粗黑体标出.这里采用峰值信噪比(Peak Signal to Noise Ratio,PSNR)和结构相似性(structural similarity,SSIM)作为评价指标.PSNR是最为普遍使用的一种图像客观评价指标,它是基于对应像素点间的误差.SSIM是一种全参考的图像质量评价指标,它分别从亮度、对比度、结构三方面度量图像相似性.从表1结果可以看出,在所有采样率下本文方法均取得了最好的重构质量.

表1 Set5上不同图像CS算法的平均PSNR(dB)和SSIM的比较Tab.1 Comparison of the average PSNR (dB) and SSIM of different image CS algorithms on Set5

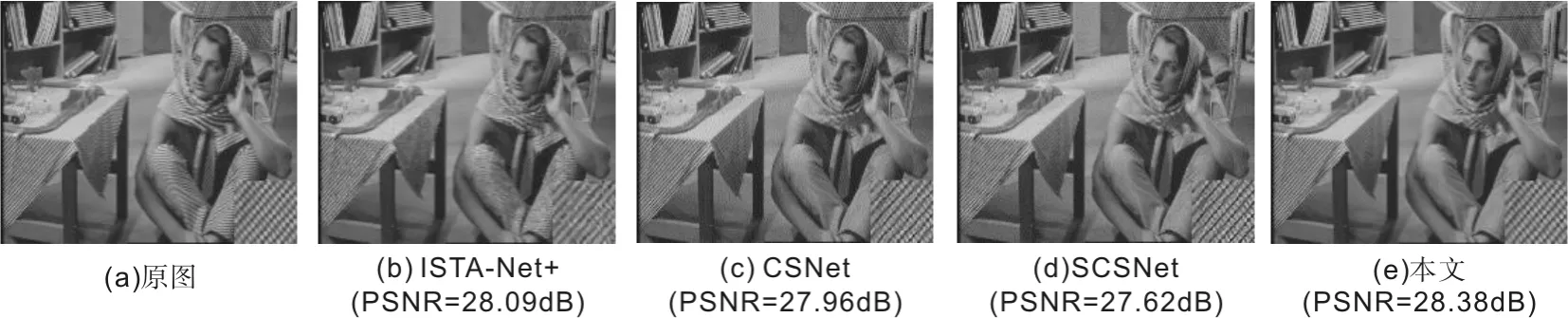

为了比较不同CS重构算法的视觉效果,图4给出了0.2采样率下ISTA-Net+、CSNet、SCSNet和本文方法重构图像的局部2.5倍放大图.图中,本文重构图像的桌布纹理基本未变形,其他方法都有不同程度的变形.可以看出,本文算法重构图像的结构纹理更加清晰,视觉效果改善明显.

图4 0.2采样率下不同算法对barbara重构结果Fig.4 Reconstruction results of barbara by different algorithms at 0.2 sampling rate

3.3 讨论

图5 不同数目的模块在Set5上的平均PSNR(dB)和重建一幅256×256图像的时间对比Fig.5 Comparison of the average PSNR (dB) of different numbers of modules on Set5 and the time to reconstruct a 256×256 image

这里,对网络中不同方案的选择进行讨论.首先是特征增强模块数目的选择,图5列出了在0.1采样率下特征增强模块数目为1、2、3、4、5时在Set5测试集上的平均PSNR和重建一幅256×256的图像所需时间的对比效果.从图中可以看出,模块数目为2、3、4时,重建效果提高较多,重建时间的少量增加相对可以接受.模块数目为5时,重建时间增加较多,重建质量只有少量提高.选取特征增强模块数目为4时能达一个较好的平衡.

然后是残差连接和密集连接的联合使用方案,表2列出了0.1采样率下单独使用密集连接或者残差连接的重建质量和训练时间的对比效果.可以看出,只有残差连接时训练速度较快但是重建质量不佳;只有密集连接时速度和联合使用接近,但质量稍差.因此,本文采用联合使用残差连接和密集连接得到最优的重建效果.

表2 Set5上不同方案的平均PSNR(dB)和训练时间(小时)的比较Tab.2 Comparison of the average PSNR (dB) on Set5and training time(h)of different programs

4 结语

基于多通道网络能较好改善深度特征表示能力的发现,设计了一个双路信息互补增强的压缩感知深度重构网络,以更好地提升网络的图像CS重构性能.网络由两个并行通道组成,一个通道实现对图像原始分辨率的重构,而另一个通道实现对图像的2倍降采样重构;两个通道的中间特征提取部分采用了信息的交叉融合,实现了信息提取的互补增强.实验结果表明,本文网络可以有效提高压缩感知重构图像的质量.本文方法存在的主要不足在于,由于采用了两个通道,因此网络模型的复杂度有一定的增加.如何结合网络轻量化技术有效减少网络参数,是本项设计需要进一步优化的方面.