面向高新企业审计数据的特征选择算法研究

2020-09-08赖文辉朱定局郑泳智

赖文辉,朱定局,贺 超,黄 立,郑泳智,李 英

(华南师范大学,广东广州 510631)

0 引言

传统的审计活动一般根据静态的数据和固定的模式进行,但随着科技的发展及审计需求的变化,审计的方式与手段也发生改变。审计大数据系统能同时处理静态与动态的数据,用户在获得实时数据后,将数据代入审计模型,得出实时审计结果以及对结果的诊断。

动态数据一般以时间序列的形式进行采集和存储。动态审计大数据(系统)的研究,就是对大数据建立动态数学模型,基于模型对系统进行分析、诊断、控制和优化。对于本文所涉及的动态公司数据,采用二阶段特征选择算法进行特征筛选与建模分析。

随着近年来模式识别和数据挖掘等领域中数据规模和特征维数的快速增加,特征选择已成为去除数据中非相关和冗余特征的重要手段。在特征选择中,最好的特征子集是维数最少且满足对分类准确性贡献最大的子集[1]。本文从二阶段特征选择算法展开,基于过滤式(Filter)和包裹式(Wrapper)的特征选择算法进行设计建模,论证所提出的特征选择方法的有效性。

1 基于最大互信息系数的第一阶段特征选择算法

在原特征子集中存在大量的噪声数据,对类别的划分有不良影响,还会降低特征选择算法的效率。在本文提出的二阶段特征选择算法中,第一阶段使用最大互信息系数对原特征子集进行数据预处理,有利于提高后续第二阶段算法的运算效率和最优特征子集的验证结果。

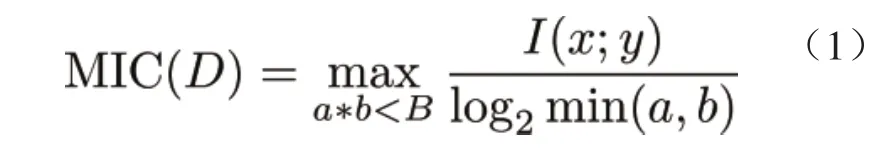

最大互信息系数(MIC)由Reshef等人[2]提出,用于衡量2个特征之间线性或非线性的关系,获知特征之间广泛的相关关系。定义如式(1)所示:

式(1)中:a、b分别表示在二维空间x、y方向上划分的网格数;B为一个表示样本大小的变量,一般设置为样本量n的0.6次方效果最好;I(x、y)为x×y的网格内部互信息计算,互信息用于衡量两个随机变量之间的关联程度。

本文在特征选择的第一阶段使用最大化互信息系数计算特征与类别的相关程度,去除一些不相关的数据。由于MIC值经过归一化处理,取值范围在[0,1]之间,根据各个特征和类别的MIC值直接进行排序和比较。

2 基于近似马尔可夫毯和随机森林的第二阶段特征选择算法

在通过第一阶段的特征预选择后,在此基础上进行第二阶段的特征选择,进一步去除不相关及冗余特征,优化所选特征子集的分类效果。本文选用近似马尔科夫毯和随机森林作为第二阶段的主要算法。

2.1 基于近似马尔可夫毯的第二阶段特征选择算法流程

马尔可夫毯(Markov Blanket)算法由Koller等[4]提出,在特征选择过程中去除冗余的特征,马尔可夫毯的定义为:在随机变量的全集U中,对于给定的变量X∈U和变量集若有:

则称能满足上述条件的最小变量集MB为X的马尔可夫毯(Markov Blanket)。

快速相关性滤波算法(FCBF)由Yu等[5]提出,主要应用对称不确定性(SU)代替信息增益(IG)作为衡量一个特征是否与分类相关或者是否冗余。

本文在FCBF二阶段特征选择算法基础上,对第二阶段使用近似马尔可夫毯算法中去除冗余值的方法进行改进和优化。马尔可夫毯算法获得最优特征子集属于非确定性多项式在时间复杂度内规约到的NP-hard问题,目前一般使用近似马尔可夫毯(Approximate Markov Blankets)算法查找最相关的K个冗余特征[6],采用该近似方法进行特征选择。

在第一阶段通过MIC进行特征预选择后,仍存在的问题是在特征数为λ的候选子集中,还存在弱相关和冗余的特征没有处理。对于该问题,FCBF二阶段特征选择算法通过结合对称不确定性和近似马尔可夫毯的二阶段特征选择算法,再进行特征相关性比较,去除冗余的特征。

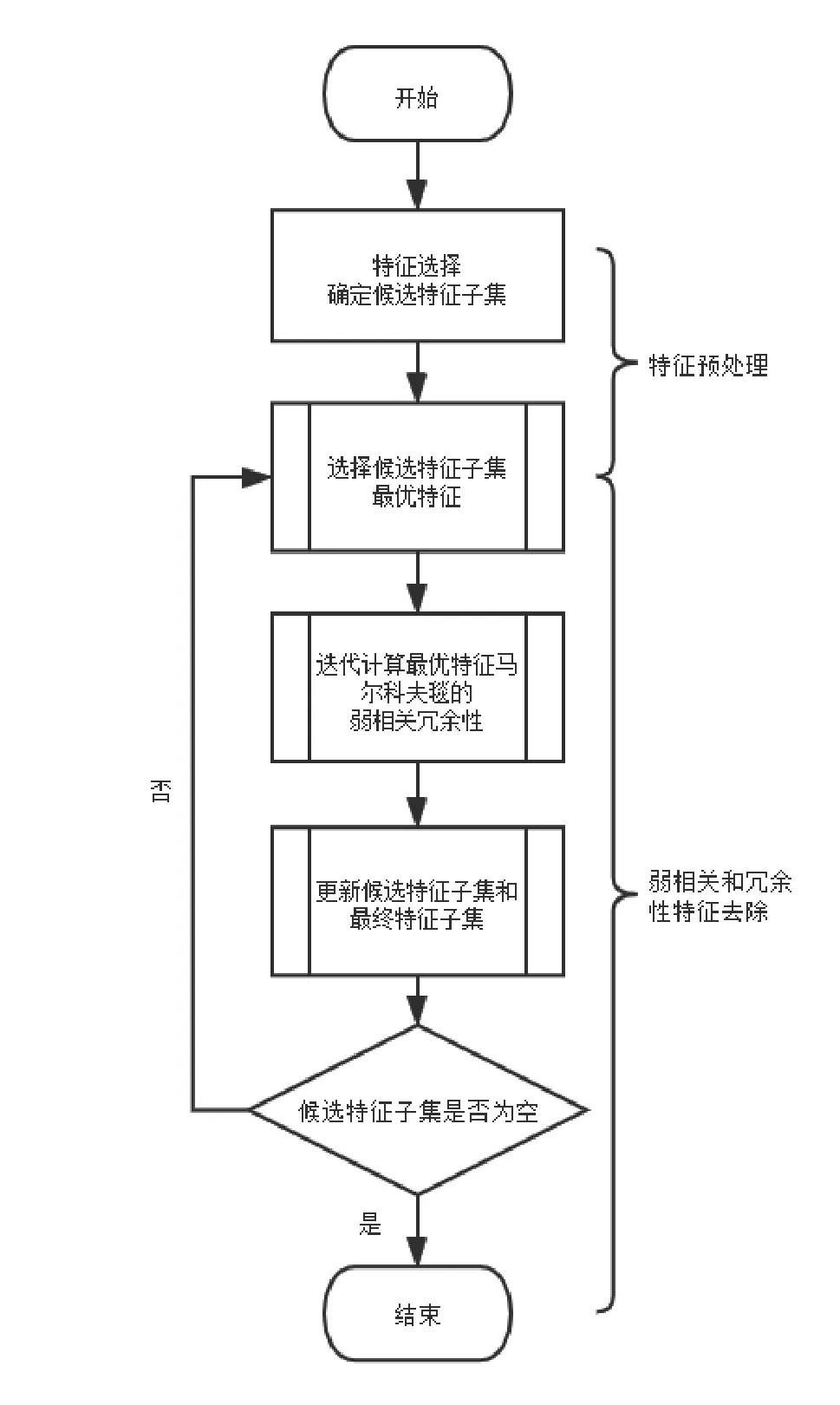

特征冗余性和相关性的不同之处在于,相关性衡量特征和类别之间线性或非线性的程度;冗余性衡量特征子集内部的关系,相比于相关性的计算,冗余性的复杂性更加高。FCBF算法将特征主要分为4类:无关特征、弱相关且冗余特征、弱相关非冗余特征和强相关特征。按照FCBF算法的定义,去除冗余特征后的最佳子集为强相关特征和弱相关非冗余的特征,主要通过近似马尔可夫毯方法实现去除冗余特征,获得最优特征子集(见图1)。

图1 FCBF算法的特征分类定义

在FCBF算法的基础上,本文提出通过最大互信息系数的新特征衡量准则,结合基于近似马尔可夫毯的优化。使用基于最大互信息系数和近似马尔科夫毯的两阶段特征选择方法,在衡量特征相关性和冗余性的同时,使特征选择算法的分类效果更加准确和稳定。

综合两阶段特征选择算法的弱相关和冗余性特征去除过程为:在输入原数据集后,通过特征预选择阶段得到候选特征子集,然后根据改进的近似马尔可夫毯方法提高分类准确率,最后输出最终特征子集(见图2)。

图2 基于MIC和近似马尔可夫毯的二阶段特征选择算法流程

2.2 基于随机森林的第二阶段特征选择算法

相较于传统的过滤式特征,封装式特征选择算法在特征选择过程绑定分类器,使用分类准确率作为衡量准则,最终数据集可在某些分类器上获得更好的分类效果。在随机森林的基础上,本文使用封装式的特征选择算法去除冗余特征,建立一种结合过滤式和封装式的二阶段特征选择算法。

随机森林是一种基于装袋算法(Bagging)的集成学习算法,并使用分类回归树(CART)作为弱学习器。决策树算法一般会在节点处对所有的样本特征进行选择,将最优的特征作为决策树的左右子树进行划分,这样在训练数据上获得的结果错误率较低,但模型的泛化能力较差。随机森林在决策树的基础上,通过在节点上随机地选择一部分样本特征,然后在这些样本特征中选择最优的特征去划分左右子树,提高模型的泛化能力,最后再组合弱学习器,通过弱学习器的投票得到最终的分类结果。

相比于过滤式(Filter)方法,包裹式(Wrapper)方法将特征选择与分类器绑定在一起,通过学习算法的分类准确率作为特征选择的评价准则,使算法的特征选择结果分类更加准确;但Wrapper方法需要使用算法模型计算,计算时间更长,在面对高维的数据时不如Filter方法适用。Filter和Wrapper方法有各自的优势和缺点,通过二阶段的方式可以结合者两种方法的优点。例如,Alexe等人[7]提出利用信息增益、相关系数等方法选择进行预选择,筛选掉与类别无关或相关性弱的特征,然后再利用分类器对经过预选择处理的候选特征子集进行冗余性特征的去除;Zhang等人[8]提出使用F检验进行无关特征的去除,然后通过巴氏距离对候选特征子集进行冗余性的衡量,提高了特征的区分能力。

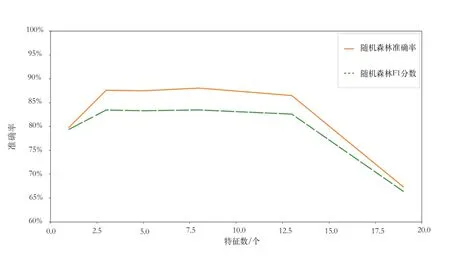

2.2.1 第一阶段的Filter算法选择

通过将基于随机森林的特征重要度评价准则和基于最大互信息系数算法所选择的特征进行分类,分析比较其分类效果,选择效果提升更明显的方法作为第一阶段的特征选择算法。分类效果的评估方法为:使用随机森林作为分类器并结合10折交叉验证的方法计算特征分类结果的准确率。如图3所示,以公司审计数据为例,横坐标表达的是通过选择方法保留的10到50个特征数,纵坐标表达通过保留候选特征子集进行分类学习结果准确率。进行横向和纵向对比可以看出,基于最大互信息系数的特征选择方法,在去除无关或相关性弱的特征后分类准确率提升明显,而通过随机森林重要度进行选择的特征,准确率变化不大且保持在较低水平。当高维数据中存在较多的噪声特征时,使用基于最大互信息系数的特征预选择方法去除无关特征,可以提高第二阶段Wrapper方法的特征选择效果。

图3 通过MIC和随机森林重要度特征选择的分类准确率比较

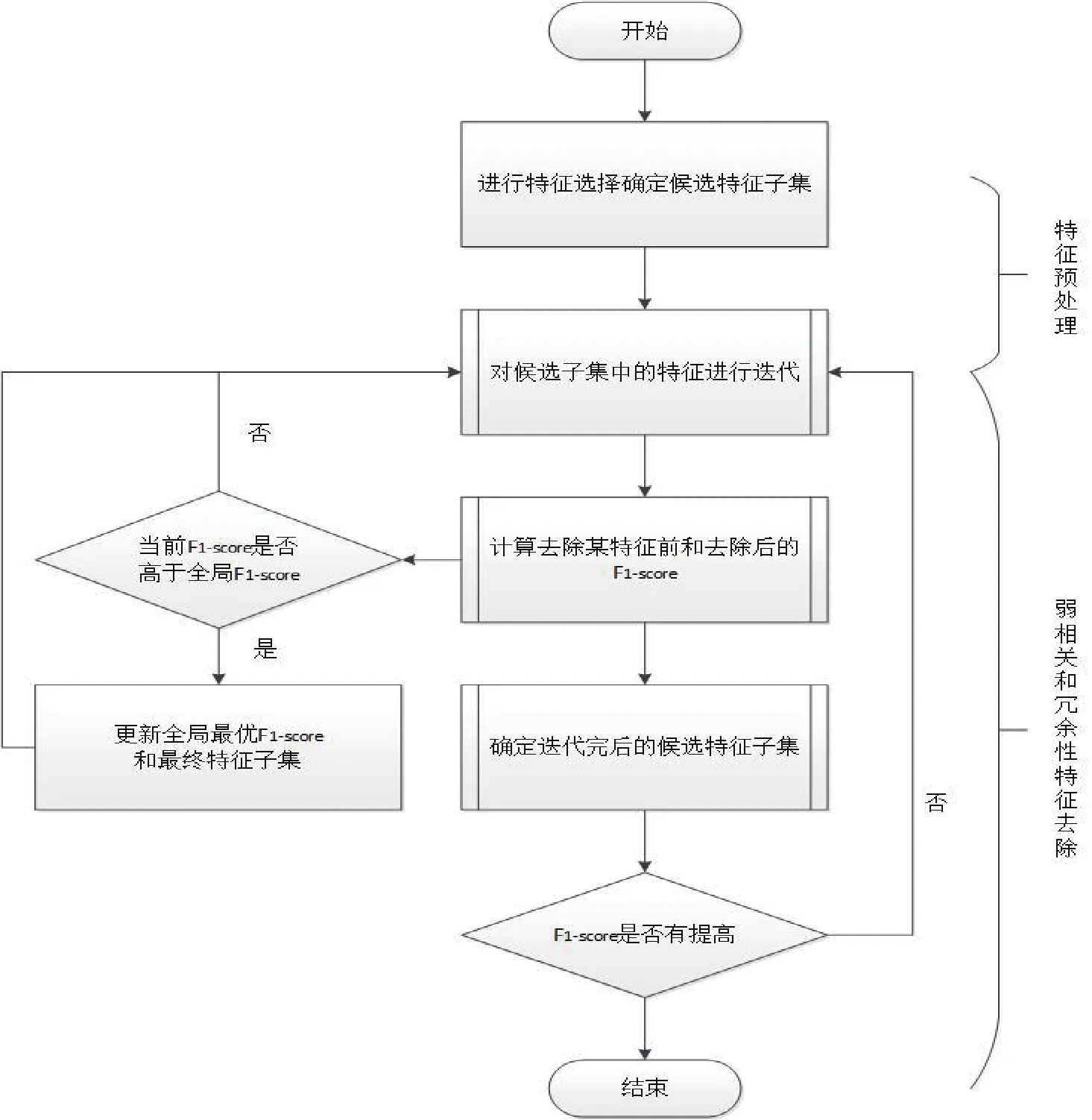

2.2.2 第二阶段的Wrapper算法设计

在通过最大互信息系数对原数据集中无关和相关性低的特性进行去除后,需要考虑进一步的特征缩减并提高分类的效果。本文提出在特征选择第二阶段,使用启发式搜索策略中的序列后向选择算法并结合随机森林的分类准确率作为评价函数进行候选子集的筛选,加入10折交叉验证方法和引入带权重的均值计算方法,提高评价函数的稳定性和有效性,解决审计数据集中不同标签的样本数不均衡的问题,提高筛选的特征的准确度。

根据候选子集为通过最大互信息系数值进行排序的集合,弱相关的特征一般会处于集合的后面,冗余的特征排序位置较为接近,从候选子集开始,通过序列后向选择搜索策略迭代地计算去除当前特征后的局部特征子集分类准确率是否有提高。其中,局部特征子集的分类准确率指的是,通过随机森林判断未删除特征的特征子集的分类准确率ai是否小于删除特征后特征子集的分类准确率,如果结果满足条件ai≤ai-1,则将全局最优准确率amax与删除特征后的候选特征子集的分类准确率进行比较,当满足的条件时,更新。算法的搜索策略属于贪心搜索,使特征选择结果的分类准确率接近最优,搜索的停止条件设定为当迭代完候选子集中所有的特征后,没有产生局部分类准确率提高的结果时,停止循环。使用这一算法的优势在于,通过随机森林的分类准确率对每个特征子集的分类性能进行评估和比较,在不降低或提升分类准确率的前提下降低特征子集中的噪声,去除相关性较小和冗余的特征,去取得接近分类器准确率最优的结果。

假设候选特征子集的特征个数为λ,样本数为n,随机森林的基学习器数为k,则第二阶段特征选择算法的时间复杂度为。

将第一阶段过滤式特征选择和第二阶段封装式特征选择算法的弱相关和冗余特征去除过程进行综合,在输入原数据集后,通过Filter特征预选择阶段得到候选特征子集,根据Wrapper方法提高分类准确率并输出最终特征子集(见图4)。

图4 基于MIC和随机森林的二阶段特征选择算法流程

3 面向高新企业审计数据的分析和验证

为了验证本文提出的二阶段特征选择算法的有效性,本次实验除了采用广东省审计厅的高新企业审计数据外,还加入来自美国加州大学欧文分校用于机器学习的数据库(UCI)的Musk数据集,在不同的分类器上进行比较最终特征子集的准确率、精确率、召回率和F1-Score值的结果。本研究中所有数据实验测试均基于2.3 GHz Intel核与16 G内存的Windows 10平台与Python 3.6编译环境上进行。

3.1 实验设计

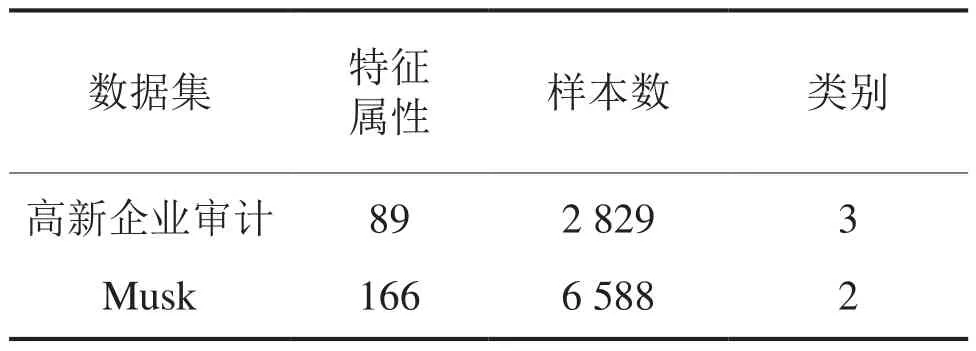

本次实验采用的高新企业审计数据集包含有89个特征属性,样本数为2839个,内容主要包括企业的业务信息、创新投入、创新产出和财务信息等;标签数据为审计专家对企业的打分数据,主要分为3个类别:较差、一般和优秀。本次实验采用的Musk数据集包含有166个特征属性,样本数为6588个,内容主要包括分子的形状或构造,共分为2个类别。见表1所示。

表1 实验数据集 单位:个

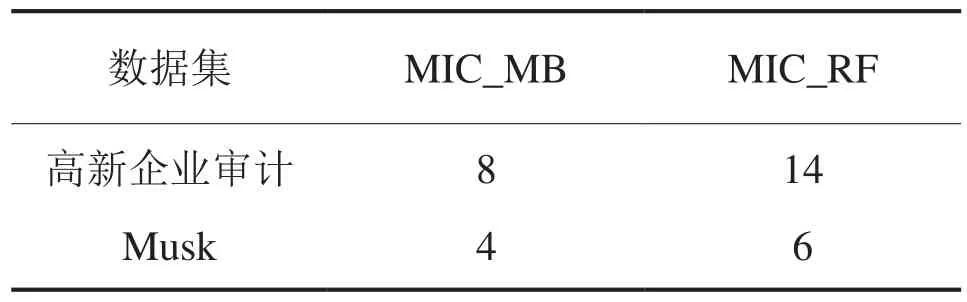

针对本文提出的二阶段特征选择算法有效性评估,使用经过第一阶段预处理后的高新企业审计和Musk实验数据集进行第二阶段的算法性能和特征数目的对比实验。本次实验选择随机森林算法作为分类器,高新企业审计数据集和Musk数据集进行10折交叉验证,最终的特征子集特征数比较结果如表2所示。

表2 最终特征子集的特征数目比较 单位:个

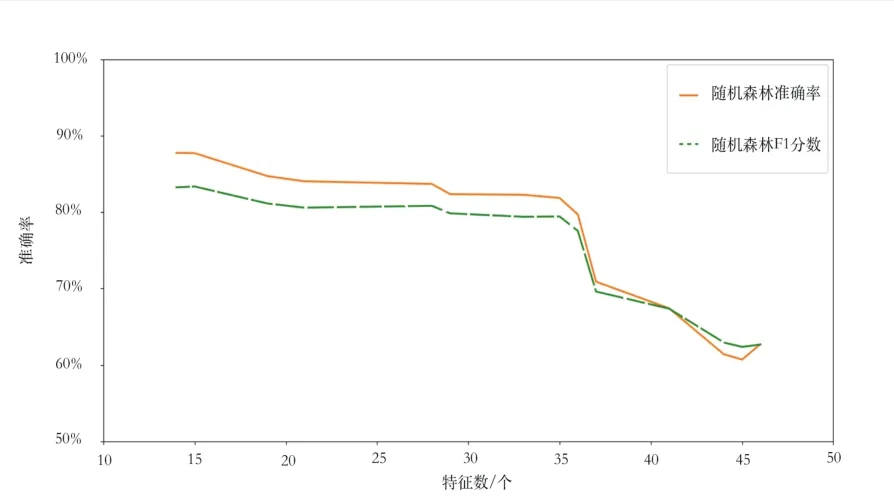

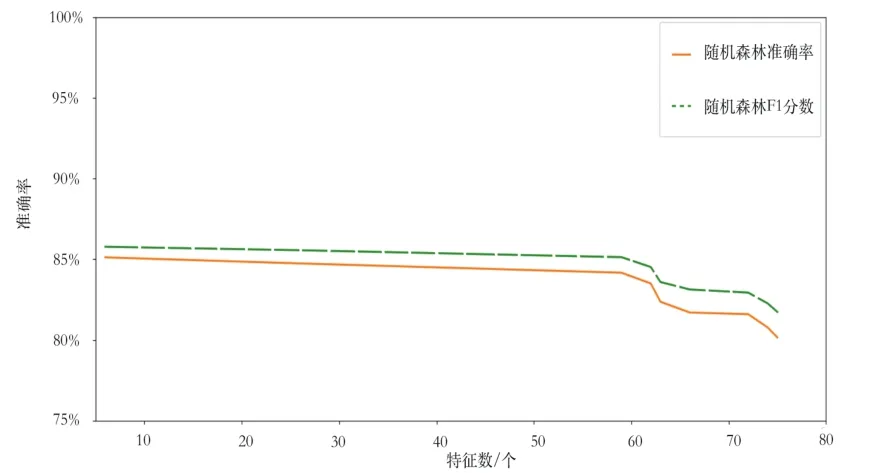

基于随机森林的第二阶段特征选择算法在高新企业审计数据集和Musk数据集上的具体特征选择过程分别如图5和图6所示,分类的准确率和F1-Score在去除相关性弱和冗余的特征的同时稳定上升。其中,根据预选择个数的公式,经过第一阶段特征选择处理后,高新企业审计数据集的特征数约为46个,Musk数据集的特征数则约为75个。基于随机森林算法的第二阶段特征选择算法由于不需要通过阈值筛选冗余或者相关性弱的特征,算法的搜索策略是在不影响随机森林分类准确率降低的前提下去除弱相关和冗余的特征,经过在第二阶段特征选择后,高新企业审计数据集的最优特征数为14个,Musk数据集的最优特征数则为6个。

图5 高新企业审计数据集基于RF的第二阶段特征选择过程

图6 Musk数据集基于RF的第二阶段特征选择过程

基于MIC和近似马尔可夫毯的第二阶段特征选择算法在高新企业审计数据集和Musk数据集上特征选择的过程分别如图7和图8所示,图中横轴表示第二阶段的弱相关冗余性阈值所分别对应的特征数,竖轴表示对应的分类效果。根据预选择个数的公式λ=[n/logn],高新企业审计数据集的特征数约为46个,Musk数据的特征数则约为75个。在高新企业审计数据集中,当阈值θ定为0.3时,分类准确率和F1-Score表现最好,对应的特征数为8个;在Musk数据集中,当阈值θ设定为0.3时,表现最好,对应的特征数为4个。根据特征选择算法的计算方法可知,MIC_MB算法在第二阶段通过寻找特征的近似马尔可夫毯,然后计算特征的弱相关冗余性进行筛选,对于筛选掉的特征占比和子集内部冗余程度的大小完全相关。

图7 高新企业审计数据集基于MIC和近似马尔可夫毯的第二阶段特征选择过程

图8 Musk数据集基于MIC和近似马尔可夫毯的第二阶段特征选择过程

3.2 实验结果对比与分析

在特征选择领域,多变量过滤式特征选择算法因为能够同时考虑到特征的相关性和冗余性,因此在实际中被广泛地使用。本次实验使用经典的多变量特征选择算法进行相互的比较,主要有ReliefF算法、mRMR算法;同时,为了更加有效地分析本文提出的二阶段特征选择算法效果,加入了同类二阶段特征选择的FCBF算法。

ReliefF算法是基于Relief算法的一种特征权重算法[9],通过考察衡量特征和类别的相关性,对不同的特征赋予不同的权重。对于特征和类别相关性的衡量,主要是根据特征在相同类别的近邻样本与不同类别的近邻样本之间的差异来度量:如果特征在同类样本之间差异值较小,而在异类样本之间差异值较大,则说明该特征和类别的相关性强,应该提高该特征的权重值。不过,由于Relief只能处理二分类的问题,Kononei[10]在Relief算法的基础上提出了用于处理多分类问题的ReliefF算法。ReliefF算法的贡献在于,使用回归算法支持处理多分类数据和使用K近邻法更新权重。ReliefF算法因其性能高效而无需使用全局搜索或启发式搜索策略,在处理高维数据上有广泛的应用。假设为特征数,p为迭代次数,n为样例数,则该算法的复杂度为由于没有特征的预处理,ReliefF的计算复杂度在比较的算法中最高。

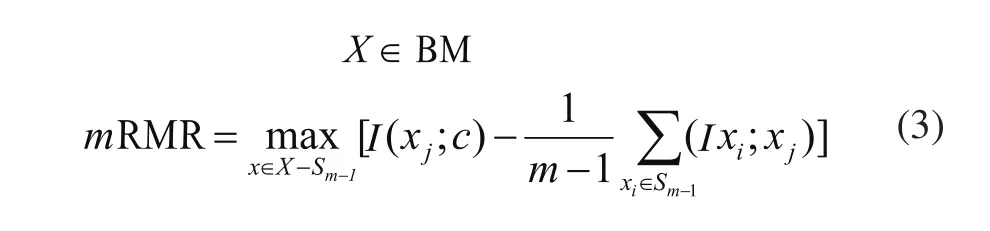

mRMR(Max-Relevance and Min-Redundancy)算法是一种实现特征和类别相关性最大(Max-Relevance)和特征内部之间相关性最小(Min-Redundancy)的多变量过滤式特征选择算法。mRMR算法的度量方法使用的是互信息,最大相关性主要是计算各个特征和类别间互信息的均值,最小冗余性则主要是对特征内部之间的互信息进行求和再除去特征个数的平方,最后通过使用增量搜查策略得到近似最优解。具体的mRMR标准计算方法如式(3)所示,其中m为特征的个数,需要总共计算次互信息计算复杂度为

本次实验将基于最大互信息系数和马尔可夫毯的二阶段特征选择方法与基于最大互信息系数和随机森林的二阶段特征选择方法、ReliefF算法、mRMR算法进行比较,验证特征选择算法结果的分类器选择决策树CART、随机森林(RF)、支持向量机(SVM)和K最近邻(KNN)。

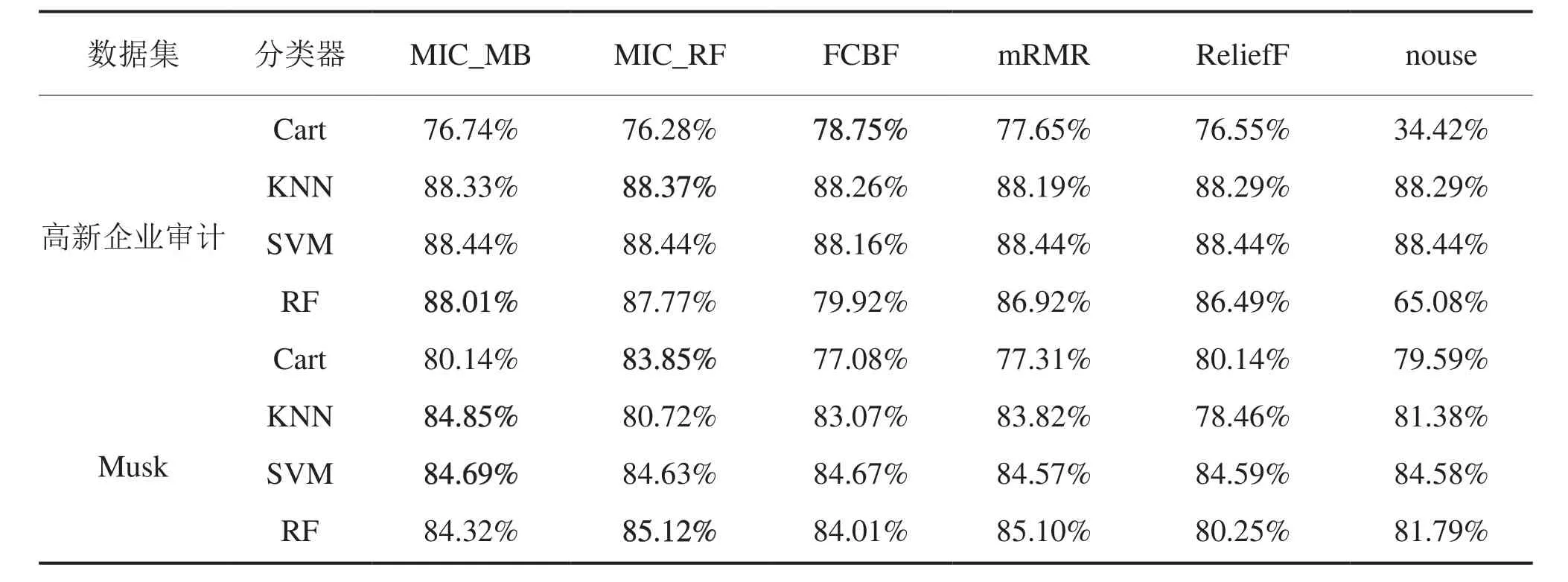

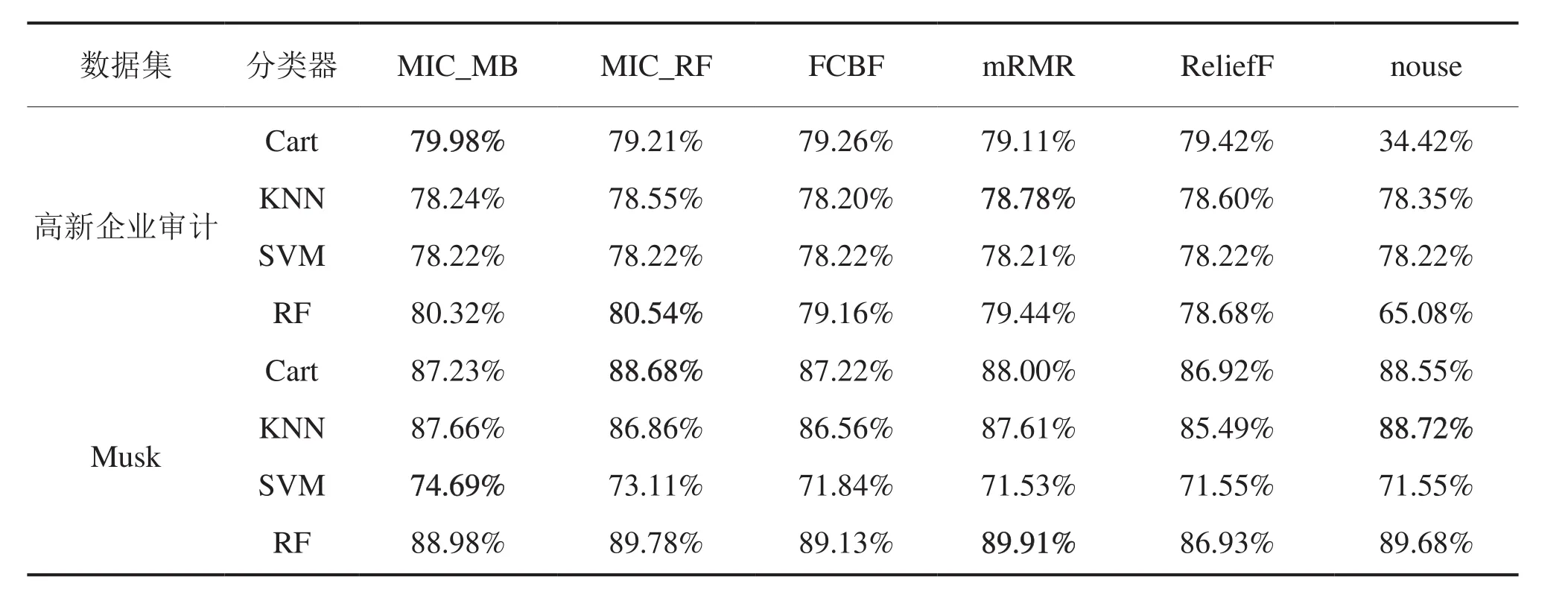

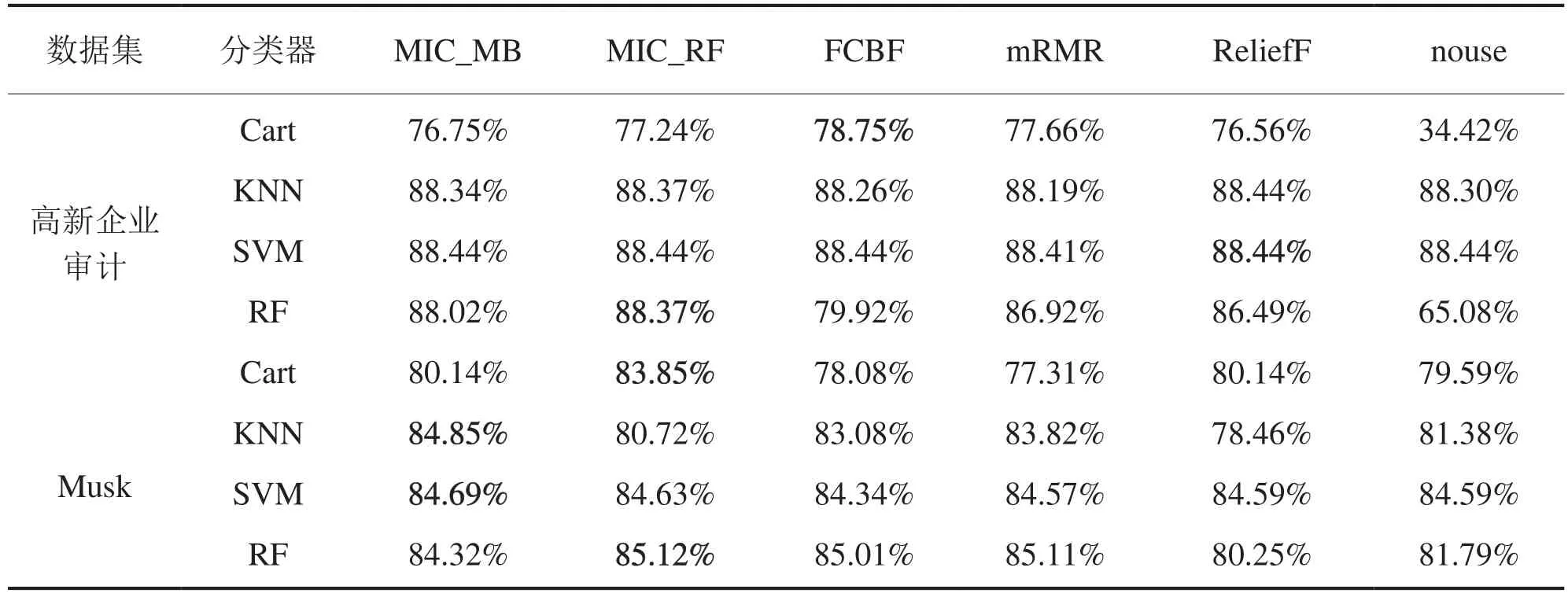

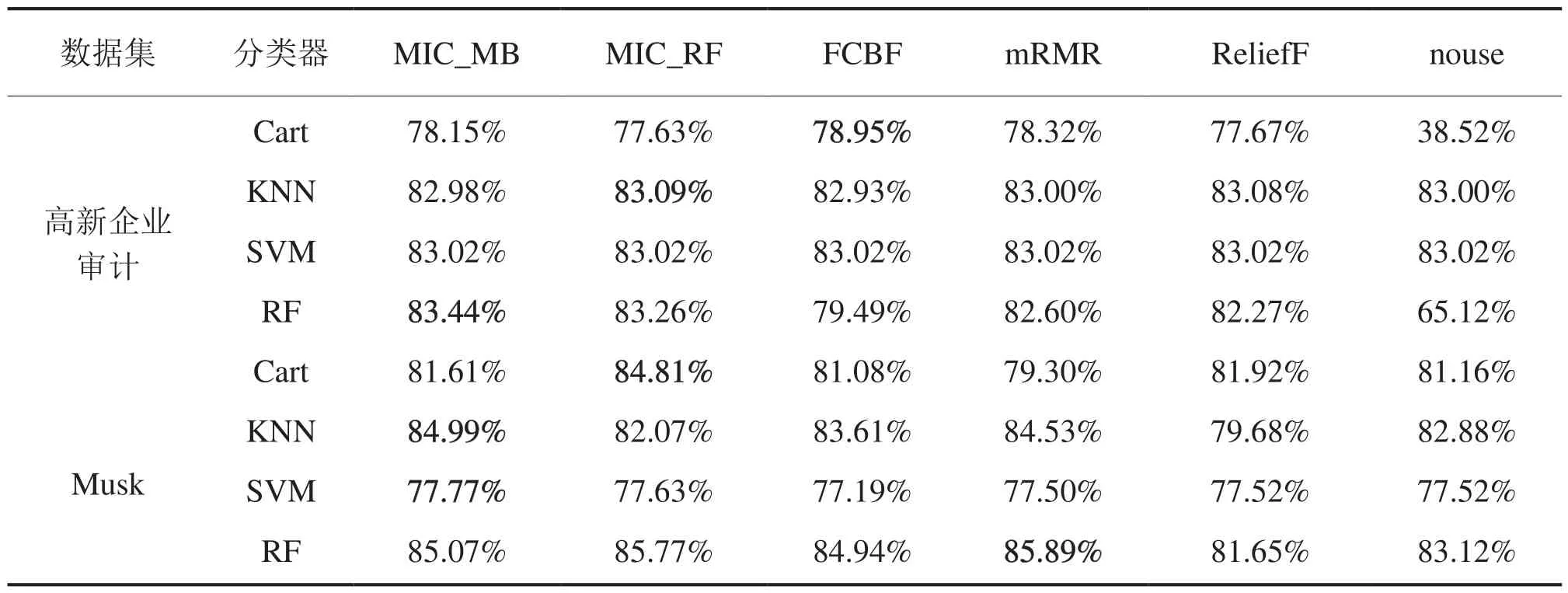

对于不同特征选择算法生成的最终子集,在不同分类器验证下的评价结果可进行对比和分析,得出特征选择算法的实际有效性。为完全对比各个特征选择算法的有效性,实验采用4种不同的特征选择方法进行比较,分类准确率均值、精确率、召回率均值和F1-Score见表3至表6。

表3 最终特征子集在不同分类器上的准确率均值对比

表4 最终特征子集在不同分类器上的精确率均值对比

表5 最终特征子集在不同分类器上的召回率均值对比

表6 最终特征子集在不同分类器上的F1-Score均值对比

表3至表6中加粗字体表示该分类器中表现最好的特征选择算法。由表中分类效果对比信息,可以得出:

(1)使用决策树分类器中,本文提出的MIC_RF算法在Musk数据集上的分类效果明显好于其他的特征选择算法,FCBF算法在高新企业审计数据集上除了分类精确率的其他方面表现均为最好,而MIC_MB在分类精确率上表现次之;

(2)使用KNN分类器中,MIC_RF算法在高新企业审计数据集上的分类准确率和F1-Score效果最好,其次为MRMR算法在精确率和ReliefF算法在召回率上的表现最好,而MIC_MB算法在Musk数据集上表现明显最好;

(3)使用SVM分类器中,所有特征选择算法在高新企业审计数据集中的分类表现无法区分,而在Musk数据集上MIC_MB算法的表现明显好于其他的特征选择算法;

(4)使用RF分类器中,在高新企业审计数据集上MIC_RF算法的分类准确率和F1-Score表现最好,而MIC_MB算法在分类精确率和召回率上表现最好,在Musk数据上MIC_RF算法在分类准确率和召回率的表现最优,而mRMR算法在分类精确率和F1-Score上表现最优。

综合以上特征选择算法的分类结果对比,mRMR算法仅在Musk数据集上随机森林的分类效果较好,而ReliefF算法的表现最差,完全不如其他的特征选择算法;未使用特征选择算法处理的原特征集,从整体的分类效果来看,要比其他经过特征选择处理的数据集表现都更差。本文提出的MIC_MB和MIC_RF特征选择算法的有效性,整体好于多变量特征选择的mRMR和ReliefF算法,即使是和同类的二阶段特征选择FCBF算法相比较,分类性能表现也是好于后者。

从实验效果可以看出,本文提出的二阶段特征选择算法可在第一阶段有效地筛选掉无关和弱相关的特征,减少第二阶段特征选择算法的计算时间;在第二阶段能够去除绝大部分的弱相关和冗余性特征,提高在分类器上的实验效果。

MIC_MB和MIC_RF特征选择算法的相同之处在于,在分类性能方面都取得了最好的表现。而这两类算法的最大区别则是:MIC_MB算法是基于特征选择算法FCBF,算法的复杂度要优于MIC_RF算法,特别是在特征高维的数据集中的表现更为有效;MIC_RF算法的第二阶段特征选择的评价函数是和分类器一起绑定,最终子集在特定分类器的结果要好于传统过滤式特征选择算法。因此,在面对候选子集特征数不高、计算的复杂度不大的情况下,MIC_RF表现会更加有效;相应的,对于特征维度较大、更加需要缩减特征数的情况下,MIC_MB算法的优势更大。

4 结论

通过特征选择算法中相关性和冗余性的衡量,本文提出了两类二阶段特征选择算法。因单变量的特征选择算法只能度量特征的相关性而无法考虑到特征的冗余性,本文在第一阶段去除无关和弱相关性特征的基础上,提出在第二阶段进一步提高候选子集的有效性。相比于传统的二阶段特征选择算法在第二阶段仅考虑最终特征子集满足强相关、弱相关且非冗余的特点,本文提出在最大互信息系数去除无关特征的前提上,在第二阶段优化衡量特征弱相关和冗余性的方法,进一步对有用的类别特征进行有效选择。

本研究的实验中,为了综合比较本文提出的二阶段特征选择算法的表现,除了使用高新企业审计数据集外,还添加了UCI的Musk数据集。从实验结果来看,本文提出的算法整体上好于传统的多变量特征选择算法,在高新企业审计数据集上取得有效结果。