AR-HUD技术在船舶值班瞭望中的应用

2020-03-10刘武艺杨神化索永峰孙志宏

刘武艺,杨神化,索永峰,孙志宏

(集美大学航海学院,福建 厦门 361021)

0 引言

我国与世界各国商业贸易日益频繁,海上运输业务逐年增多,船舶交通流密度逐渐增加,同时船舶趋于大型化、高速化方向发展,导致海上交通事故风险增大。海上交通事故中,船舶碰撞事故发生的概率远大于其他海上事故[1]。驾驶员为判断目标船对本船是否具有碰撞危险,需转移视线从船载设备中获取所需信息[2],有可能错过采取避碰措施的最佳有效时间,存在航行安全隐患。因此在不影响驾驶员正常瞭望的情况下,给其提供实时有效的信息十分关键。

增强现实技术(augmented reality,AR)是在虚拟现实技术基础上发展而来的,它根据现实世界中的场景,借助计算机图形学和计算机视觉等技术将虚拟物体加载到现实世界中,实现真实世界与虚拟场景的融合。增强现实技术具有三大特征:虚拟与现实的融合、实时交互和三维注册[3-4]。由于增强现实抬头显示技术[5](augmented reality-head up display,AR-HUD)结合了增强现实和抬头显示两者间的优良特性,将其运用到船舶值班瞭望中,能为驾驶员提供船舶航行避碰的关键信息。

关于AR技术和HUD技术在助导航领域的应用,国内外学者做了大量研究,并取得一些成果。美国海军研发的“ARVCOP”系统[6],利用AR技术将导航数据叠加到驾驶员视野中;Hyesun Park[7]根据汽车驾驶模拟器显示的不同天气(如:雨、雪、雾等),利用AR-HUD技术投射车辆辅助导航信息;德国大陆集团(Continental)[8]开发一款车载AR-HUD系统,可以产生状态投影面和增强投影面,为车辆和驾驶员寻求一种新的对话形式。杨雪[9]对车载AR-HUD道路安全提示信息界面设计原则进行了研究;李卓等[10]提出一种基于AR-HUD的汽车驾驶辅助系统,通过对不同能见度下驾驶员对危险程度的认知分析,验证系统的可行性;邹帆[11]提出将AR技术应用在船舶导助航的设想,并对该技术在船舶导助航领域所需解决的关键问题进行了分析。

船舶相对于飞行器和汽车而言,其所处环境更复杂,操纵难度更大,实时的辅助驾驶信息对驾驶员操船至关重要。鉴于运用AR-HUD技术可实现实时投射船舶驾驶信息,本文提出一种将AR-HUD技术应用于船舶航行的辅助瞭望系统,把目标船的相关数据投射到船舶驾驶台挡风玻璃上,并对该系统进行了仿真实验。

1 AR-HUD辅助瞭望系统设计及分析

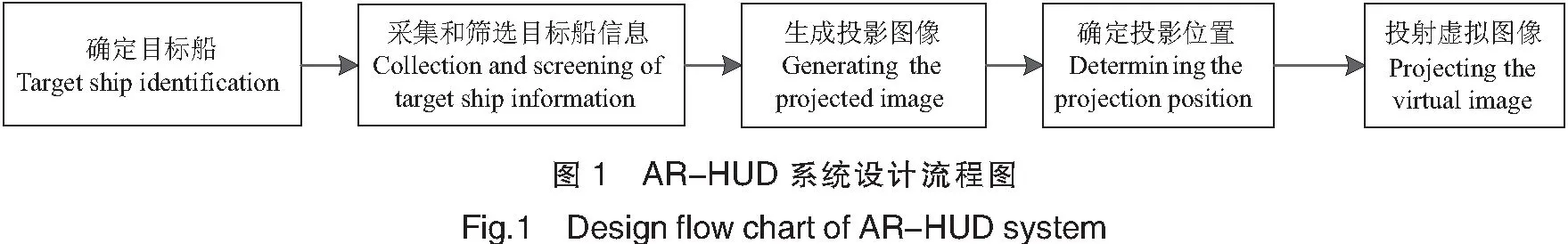

AR-HUD系统设计流程图如图1所示。采用视线跟踪算法[12]可确定驾驶员的观察方向,利用航海雷达和AIS系统确定观察的目标船,并从AIS系统获取该目标船数据信息,对所采集信息进行筛选,将筛选的信息通过计算机处理,生成虚拟信息;计算驾驶员眼睛、驾驶舱挡风玻璃与目标船三者之间的关系,确定虚拟信息的投射位置,将投影信息发送给投射模块,利用AR-HUD技术将目标船的数据信息投射到真实场景中,实现虚拟数据信息与真实世界目标船的叠加。

1.1 识别目标船

采用基于头部自由运动的视线追踪技术,确定驾驶员观察方向,以此来识别目标船,并借助船载雷达,在雷达回波上计算得到驾驶员所观察的目标船。视线追踪目前主要分为两大类,一类是基于头部穿戴设备,该方法具有较高的追踪精度,但由于需要穿戴设备,给使用者带来不便;另一类是基于眼睛图像特征估计,其中反射光斑法是一种常用方法。根据《STCW公约》要求,驾驶台值班人数最少为两人,可采取多台相机协助瞭望。随着造船技术的发展,目前有些船舶驾驶台配备了瞭望椅,可在瞭望椅前方通过相机采集驾驶员观察方向,利用反射光斑法[13]计算注视点的坐标,计算目标船相对于本船船艏向的夹角θ,在雷达回波上以偏离本船船艏向θ角度的方向搜索目标船。当该方向上有多艘船时,船员更关心距离本船较近的船,因此在偏离本船船艏向θ角度的方向与本船距离最近的就是目标船。

1.2 采集目标船信息

AIS可以提供目标船的静态信息和动态信息,确定目标船后,通过AIS等船载设备获取目标船位置信息及相关参数。采集目标船信息是为将获取的数据进行投射,实现虚拟图像与真实目标船的融合。各类船载设备为船舶驾驶员提供了大量数据信息,但是,驾驶员在操船时,无需获知目标船全部信息,因为如果把所获得目标船数据全部投射到驾驶台前方,会给驾驶员带来两个困扰:一是投射繁多的数据会占据挡风玻璃的大部分空间,阻碍驾驶员正规瞭望;另一个是庞大的数据信息,使驾驶员不能快速甄别关键信息。因此,通过向航海专家和船长咨询,得出两船会遇时最为关键的目标船避碰信息,即:对地速度(SOG,speed over ground)、对地航向(COG,course over ground)、距离、方位、最小会遇距离(DCPA,distance of closest point of approaching)、最小会遇时间(TCPA,time to closest point of approaching)。

1.3 注册虚拟信息

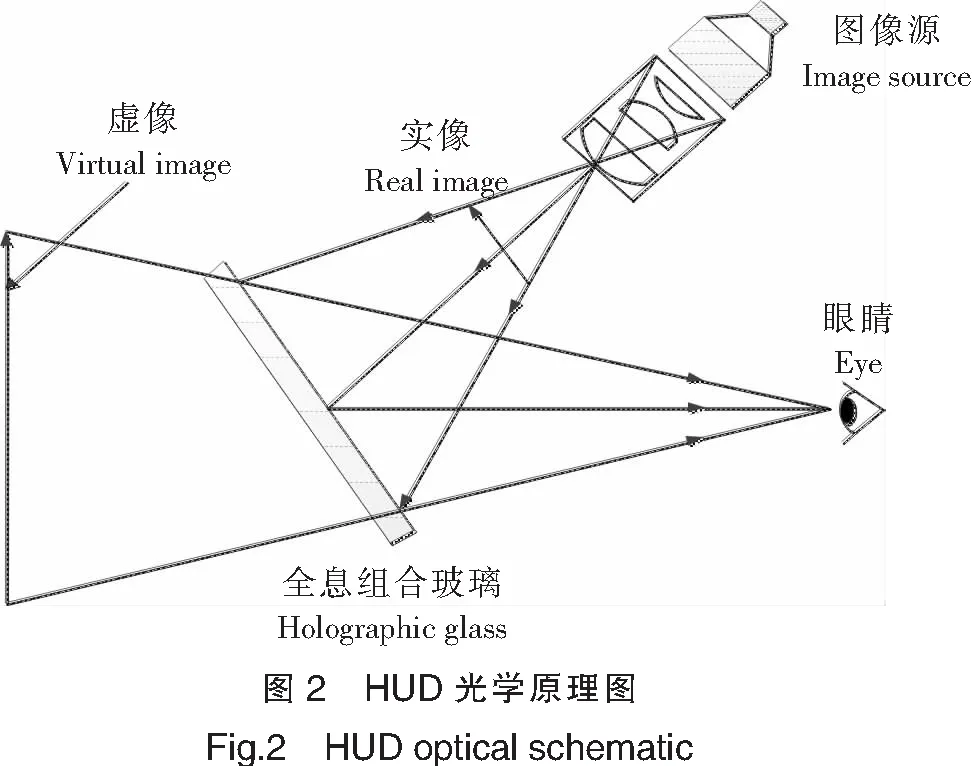

船载设备采集到的目标船数据信息,由计算机处理后,生成虚拟信息,再经HUD投影设备投射到本船驾驶舱挡风玻璃屏上,实现船员观察实景与投影虚像的融合,其原理如图2所示。注册[14]虚拟信息,实现虚实融合的关键在于投影位置,投影位置即:驾驶台挡风玻璃所在平面与驾驶员观察方向所在直线的交点。驾驶员观察方向所在直线即驾驶员眼睛与目标船两者所在直线。

2 AR-HUD辅助瞭望系统模型

2.1 增强信息投影算法

目标船与本船的水线以上高度存在三种情况:本船水线以上部分高于目标船、低于目标船和与目标船等高。现以本船水线以上部分高于目标船为例,计算增图像投影算法。本船驾驶台挡风玻璃、驾驶员眼睛及目标船三者之间的关系如图3所示。其中:AB为目标船水线以上高度;BC为海平面;CO为本船水线到本船驾驶室的高度;D为本船与目标船船顶的等高点;E为人眼所在位置;GM为挡风玻璃所在平面侧视图;AE为驾驶员观察方向;GMOF为本船驾驶室;N为驾驶员观察方向与挡风玻璃之间的交点,即投射点。

以驾驶员所在位置为坐标原点,船艏向为X轴正向,驾驶员所在竖直方向为Z轴正向,建立空间坐标系。在驾驶台挡风玻璃平面上取不在同一直线上的三点:(dOH,0,dGH),(dOM,dY,0),(dOM,-dY,0),由此可得挡风玻璃平面方程:

(1)

式中:α为挡风玻璃的倾角;dGM为挡风玻璃的长度;dOM为驾驶员到挡风玻璃的水平距离;-dY和dY为挡风玻璃在Y轴上对称的两点。

通过船载雷达可计算本船与目标船之间的距离d,如图4所示。其中:S为目标船的位置;O为本船中驾驶员在XOY平面上的坐标投影;θ为目标船相对于本船船艏向的夹角。

驾驶员眼睛坐标(0,0,dOE),目标船坐标(xTS,yTS,dDE),根据两者的坐标可确定驾驶员观察方向的直线方程:

(2)

结合公式(1)和公式(2)可得交点坐标,即投影点坐标(xp,yp,zp)

(3)

式中:d0E为驾驶员眼睛高度;d0D为D点到驾驶舱的距离。

2.2 增强投影的坐标转换关系

虚拟图像投射到空间涉及到像素坐标系、图像坐标系、投影仪坐标系和世界坐标系4者之间的转换关系,需经过以下3次转换:世界坐标系到投影仪坐标系的转换、投影仪坐标系到图像坐标系的转换以及图像坐标系到像素平面的转换。

1)世界坐标系到投影仪坐标系

世界坐标系到投影仪坐标系的转换,由针孔成像原理可得:

(4)

其中:(xw,yw,zw)为世界坐标系中某点的坐标;(xc,yc,zc)为该点对应于投影仪坐标系中的坐标;R3×3为世界坐标系变换到投影仪坐标系的旋转变换矩阵;t为两者之间的平移变换矩阵;OT为3×1的零矩阵。

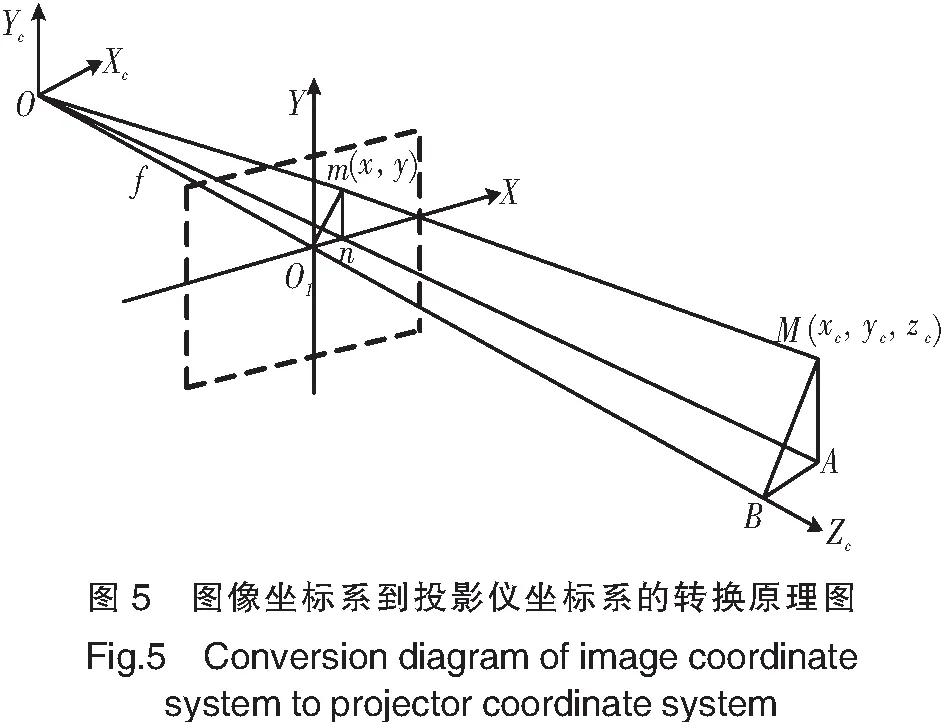

2)投影仪坐标系到图像坐标系的转换

投影仪坐标系到图像坐标系的转换原理如图5所示。XO1Y为图像坐标系,其中:M(xc,yc,zc)为某点在投影仪坐标系中的坐标;该点对应于图像坐标系中的坐标为m(x,y);A点为M点在XcOZc平面上的投影;B点为M点在Zc轴上的坐标;n点为m点在X轴上的坐标;f为镜头的焦距,即OO1之间的距离。其中三角形mnO1相似于三角形MAB,则有:x/xc=f/zc,y/yc=f/zc。整理可得:

(5)

3)图像坐标系到像素平面的转换

像素坐标系和图像坐标系是在同一平面上,只是两者的原点和单位不同,两者的转换关系:u=x/dx+u0v=y/dy+v0,其中:(u,v)为像素坐标系;(x,y)为图像坐标系;dx、dy分别表示每像素单位在水平和竖直方向所占长度。

3 仿真实验与结果分析

3.1 仿真实验

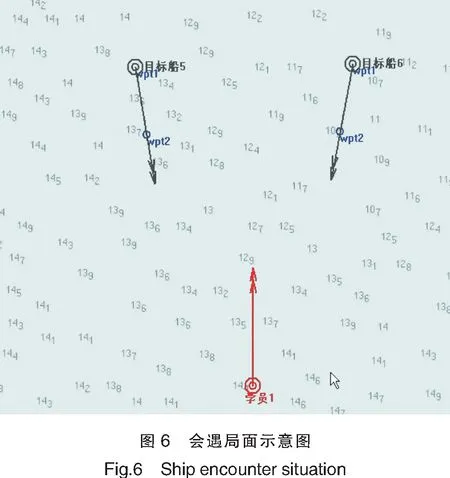

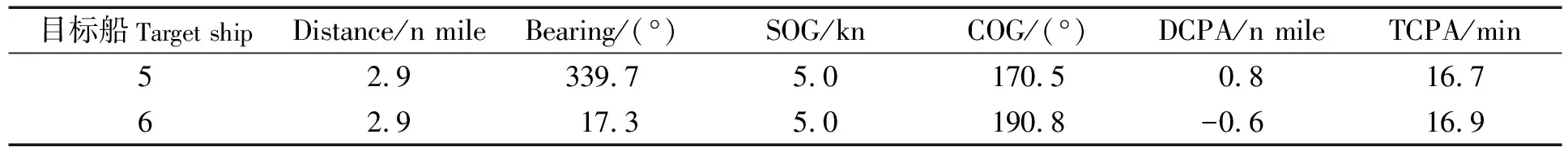

利用自主研发的MTI-H2000型船舶操纵模拟器平台[15-17]开展仿真实验,通过Multigen Creator软件对船舶进行建模,考虑到船模类型不会对实验结果产生影响,视景中加载的本船和目标船采用同一种船模;利用教练站新建练习,会遇局面为本船与其他两条船对遇,如图6所示。目标船避碰参数如表1所示。并通过OSG(open-scene-graph)对会遇局面进行三维渲染。结合增强信息投影点计算算法,通过OSG中的碰撞检测计算投影点,利用OSG中LineSegmentIntersector( )函数判断驾驶员视线是否与物标发生接触,由此确定增强信息的显示位置。

表1 目标船避碰参数

3.2 仿真结果分析

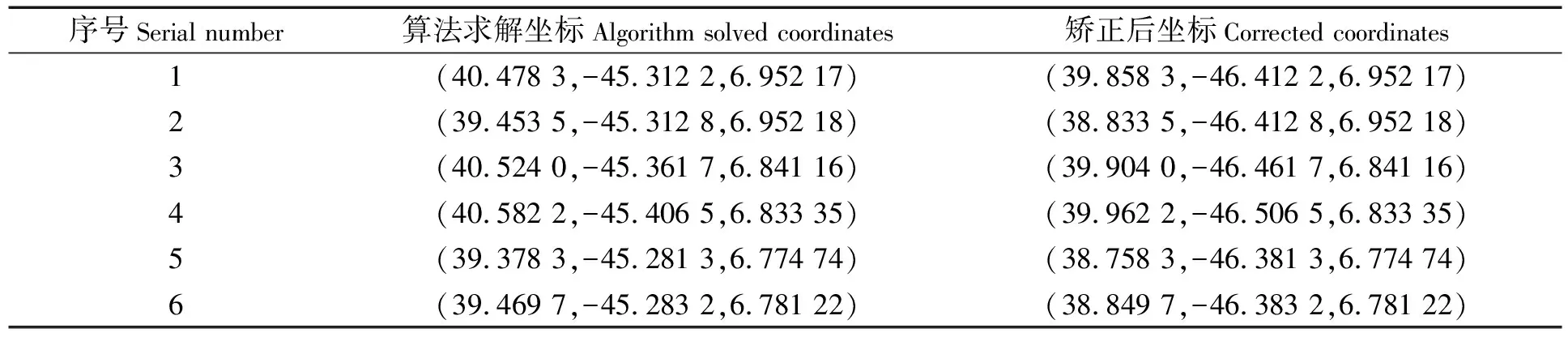

当检测到驾驶员视线与目标船在同一直线时,即可确定该投影点坐标。实验中发现直接计算所得的位置显示增强信息,会使增强信息遮挡目标船,为达到较好的目标船与增强信息融合效果,在不影响目标船与增强信息配准的条件下,对投影点进行平移,投影点矫正前后的坐标如表2所示,增强信息显示达到理想效果。

表2 投影坐标矫正对照表

通过对目标船识别及目标船避碰信息的分析,计算求得目标船增强信息的投影算法,利用三维渲染引擎OSG对船舶值班辅助瞭望系统进行仿真,实验发现利用AR-HUD技术能把船载设备提供的信息进行整合,给驾驶员提供及时有效的船舶避碰信息,满足其对目标船的信息需求。后续实验将会在仿真实验的基础上,进一步对避碰参数做研究,对船载设备提供的数据信息进行分类,根据驾驶员需要由其自行选择调取所要显示的信息,同时开展将AR-HUD技术应用于实船的实验。

4 结语

AR-HUD技术应用于船舶航行辅助瞭望是船舶智能化的重要体现。一方面,它把相互独立的GPS系统、AIS系统以及雷达等船载设备联系起来,实现目标船数据信息的整合,并进行数据信息的融合处理;另一方面,它通过结合增强现实技术和传统抬头显示技术,实现虚拟图像与目标船现实场景的融合,使驾驶员在平视状态下获取目标船信息,快速做出船舶避碰决策计划,降低了船舶碰撞危险。虽然该技术尚未在船舶航行辅助瞭望领域得到广泛应用,但它定能为船舶驾驶带来新的体验,为实现船舶智能化和“e-航海”目标增添新思路。