基于视觉感知高度相关的图像质量评价

2019-08-29于淼淼郑元林廖开阳唐梽森

于淼淼,郑元林,廖开阳,唐梽森

(1.西安理工大学印刷包装与数字媒体学院,陕西西安710048;2.西安理工大学陕西省印刷包装工程重点实验室,陕西西安710048)

数字信息时代拉近了人与人之间的距离,影响和改变着人们的生活方式。随着多媒体通信系统的日益发展,图像质量评价(IQA)已然成为业界研究学者关注的焦点,对于图像处理、图像压缩编码、视频编码技术等意义重大。IQA旨在量化人眼对图像质量的视觉感知,包括主观评价法和客观评价法。前者是评价者通过观察待评估的失真图像从而给出主观感知得分,是最符合人眼视觉系统(Human Visual System, HVS)视觉感知的评价方法,但是由于该方法需要耗时耗力耗财的人工完成,因此无法用于大规模实时系统。基于此,客观评价法应运而生,其基本思想是通过计算机建立数学模型从而模拟人眼对图像的视觉判断,目前被广泛用于实时监控设备、图像处理算法中的参数优化等。

依据对参考图像的依赖程度,客观图像质量评价方法可分为全参考型(FR)、部分参考型(RR)以及无参考型(NR)。近几年,FR和NR受到广泛关注,也是应用最多的两类方法,并且已有研究[1]将FR-IQA应用到了NR-IQA中,旨在借助前者预测准确率高的特性来增强NR-IQA算法性能。本文主要研究FR-IQA。

现有的FR-IQA依据算法设计原理的不同大致分为两种类型,一类是传统的基于计算引导的方法,另一类是基于机器学习的方法。早期的FR-IQA,如峰值信噪比(Peak Signal-to-Noise Ratio, PSNR)和均方根误差(Mean Squared Error, MSE),主要通过计算参考图像及其失真版本在像素水平上的差异来评价失真图像质量,但这种方法假定图像像素之间是独立存在的,这显然违背了HVS在观察图像时的视觉感知机制。随后,SSIM(Structural Similarity Index Milarity)[2]作为里程碑式的方法,极大推动了IQA的研究进展,对于之后的很多研究成果意义重大。由于图像的最终接收者是人,一个性能优越的IQA方法必然是通过模拟人眼视觉特性来实现的,因此从SSIM提出后,便掀起了通过考虑人眼感知特性来设计评价算法的热潮,即通过从不同角度模拟HVS的不同功能来提取低水平图像特征。MS-SSIM[3]利用HVS的多尺度特性对SSIM进行改进,评价准确性也得到了进一步提升。FSIMc[4]提取图像的相位一致性特征以及梯度特征,并将相位一致性特征作为加权函数来强调其在全局图像中的重要性。VSI[5]在提取梯度特征的同时也考虑到了图像的视觉显著性(VS)特征,并将其作为加权函数,VS特征描述了一幅图像中能够引起人眼注意的局部区域,能够与主观感知有高度的相关性。VSM[6]在VSI的基础上,将梯度及VS特征的提取方法进行改进,表现出更高的预测结果。大部分方法均在空间域中提取图像特征,Balanov等[7]尝试提取图像的变换域特征,并提出了一种基于DCT子带相似性的IQA算法。HVS的不同功能决定了其具有可同时处理空域和变换域图像特征的特性,因此SC-QI[8]将色度特征、对比敏感度函数(CSF)及结构对比度指标(SCI)进行融合,同时提取空域和变换域图像特征,充分模拟了HVS对局部图像特征和各种失真类型的感知机制。

近年来,随着各领域对机器学习的研究进一步深入,基于机器学习的IQA方法变得越来越广泛,也开发出了很多较为成熟的回归工具。Pei等[9]通过提取Gauss频带特征建立基于随机森林(Random Forest, RF)的回归模型,所提出的Gauss差分(DOG)模型可与现有其他方法相结合,极大提高了模型的预测性能。Ding等[10]和Narwaria等[11]分别通过基于支持向量回归(Support Vector Regression, SVR)及奇异值分解(Singular Value Decomposition, SVD)的方法建立质量回归模型。

研究表明,基于机器学习的IQA方法在图像质量预测精度以及鲁棒性等方面均显示出绝对优势,并且一个性能优越的基于机器学习的IQA算法主要表现在两个方面:一是通过模拟HVS对视觉场景的视觉感知来提取图像特征,包括空域特征和变换域特征;二是通过模拟大脑机制建立质量回归模型。因此,本文提出了一种新的基于视觉感知高度相关的机器学习算法CGDR。

1 算法设计

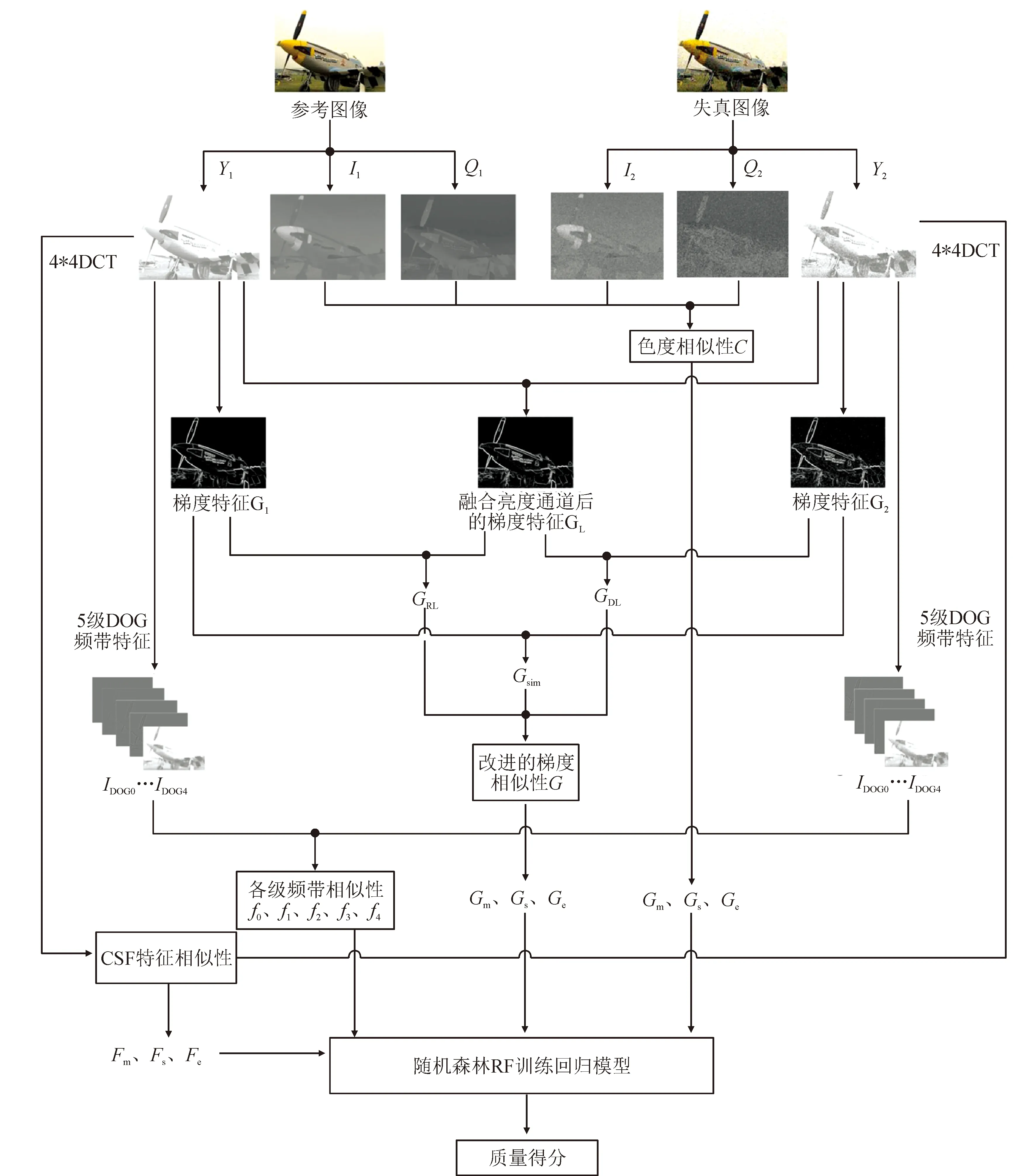

首先,为充分模拟HVS观察视觉场景时的感知机制,在色度通道中提取参考图像与失真图像的颜色信息,在亮度通道中提取梯度特征、CSF特征以及5级DOG频带特征;然后计算两幅图像间的色度相似性、梯度相似性、对比敏感度相似性以及各级频带特征相似性。为降低特征空间维度、控制运算成本,池化策略分别提取色度相似性图、梯度相似性图以及对比敏感度相似性图的均值、标准偏差及熵;最后,通过随机森林RF进行多特征融合并训练回归模型,得到质量预测得分。CGDR的总体算法框架图见图1。

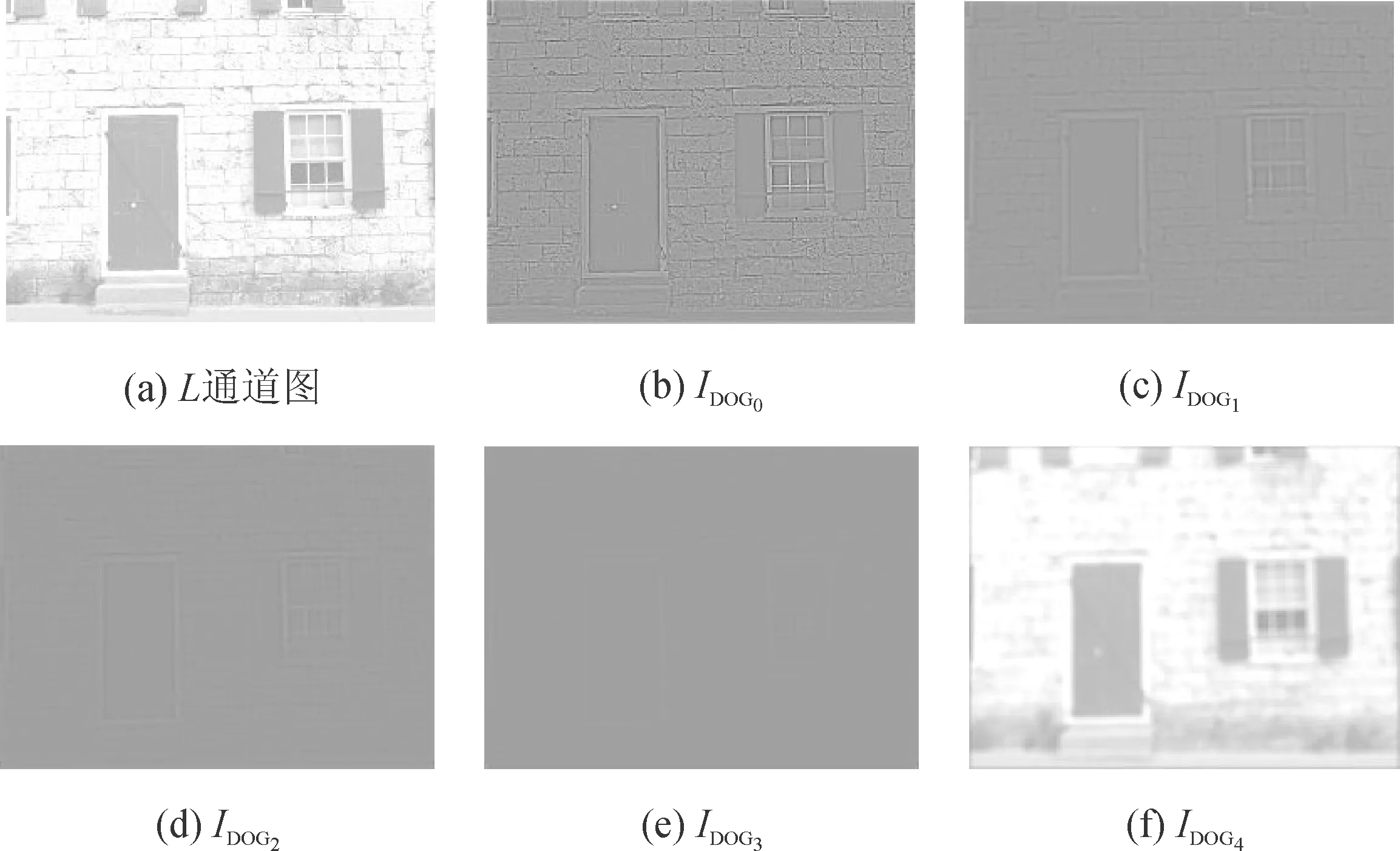

1.1 色度相似性特征

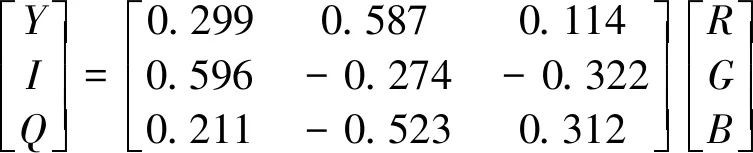

就彩色图像而言,人眼对其颜色空间的感知特性是质量评估的重要组成部分[12]。色度特征是其中一个重要特征之一,它直接影响了彩色图像的视觉效果。当图像颜色发生饱和度失真时,提取图像的颜色特征就显得尤为重要[13]。从另一个角度讲,一幅彩色图像是由色度与亮度组成的,而大部分图像特征主要集中在亮度通道上,因此,提取色度特征的结果必然是将图像的亮度通道与色度通道进行分离。HVS在观察真实场景时也总是将亮度和色度分开处理的,为了模拟HVS的这种功能,本文首先将图像由RGB颜色空间转化为YIQ三个通道,实现亮度信息Y与两个色度信息I、Q的分离。色彩转换方式具体如下:

图1 提出算法CGDR计算流程Fig.1 Computational process of the proposed IQA index CGDR

(1)

自SSIM结构相似性指标被提出后,之后的大部分IQA算法都采用一种特定的形式来计算特征之间的相似度,这种特定形式可表示为:(2ab+c)/(a2+b2+c),其中a、b表征待比较的两个物理量,c为常量。这种计算方法具有很强的掩模效应,当物理量(如:亮度和对比度)增强的同时,这些物理量之间的感知差异会变小,即物理量之间的相似度会增大,这是符合HVS的视觉特性的。基于此,本文同样采用这种特定形式来计算两幅图像之间的色度相似性,将参考图像(失真图像)的I和Q通道分别定义为I1(I2)和Q1(Q2),则参考图像及其失真图像的色度相似性计算为:

(2)

式中:C1、C2均为正常量,根据经验取C1=C2=130用于防止分母为零而造成C的不稳定。X为I、Q通道中的像素点。

1.2 改进的梯度相似性特征

对于一幅空间图像而言,边缘附近像素点的灰度变化是最剧烈的,在边缘附近的失真要比在纹理或者平滑区域的失真更容易引起人眼的注意。梯度作为描述图像边缘特征最常用的指标,可以有效地描述由于结构和对比度失真而引起的图像变化。传统的梯度计算方法主要包括Sobel算子、Scharr算子、Prewitt算子等,它们的共同点是采用包含水平和垂直两个方向的模板来计算图像梯度,并且模板的最大尺寸为3×3,这会存在两个问题:首先,只考虑水平和垂直两个方向的梯度特征是不准确的,因为图像的边缘分布是非常丰富的,很难用两个方向来描述所有边缘的变化情况;其次,模板太小则无法包含足够多的相邻信息。随后,很多方法[6, 14] 在此基础上进行了改进,采用包含四个方向且尺寸更大的梯度模板对图像做卷积,并选择四个方向梯度分量的最大值作为最终提取的图像梯度特征(记为最大分量法)。虽然使用这种方法的效果要比传统方法好很多,但是选择四个方向上的最大值并不是最佳的选择,因为另外三个方向的信息对于梯度的形成同样至关重要。本文后面会对最大分量法与我们所提出的梯度方法进行比较。

基于以上研究,本文采用一种新的计算方法来提取图像的梯度特征,在使用多方向大尺寸卷积模板的基础上,通过联合四个方向上的梯度信息共同捕获梯度特征,尽可能多的保留边缘细节。图2所示为四方向高通滤波模板,模板大小为5×5,包含 0°、 90°、 45°、135°四个方向。

图2 四方向高通滤波模板 (a)0°;(b)90°;(c)45°;(d)135°Fig.2 High-pass filter templates in four directions (a) 0°; (b) 90°; (c) 45°; (d) 135°

具体计算方法如下:

(3)

式中:Gk(X,Y)(其中k分别代表x,y,u,v)表示分别使用Mk(k=x,y,u,v)模板所得到的四个梯度分量。(X,Y)表示梯度分量中各个像素点的横纵坐标值。

然后,定义G1(X,Y)为0°和90°两个方向的梯度分量,定义G2(X,Y)为45°和135°两个方向的梯度分量,并计算如下:

(4)

最终,将一幅图像的全局梯度特征计算为两个梯度分量的加和,即:

GMap(X,Y)=G1(X,Y)+G2(X,Y)

(5)

图3是对使用最大分量法与所提出的梯度分量加和法进行的比较。所使用的图片来源于TID2013数据库,图3(a)为原始图像,图3(b)和图3(c)为图3(a)对应的两种失真类型的失真图像,图3(d)~(f)分别为图3(a)~(c)使用最大分量法得到的梯度图,图3(g)~(i)分别为图3(a)~(c)使用梯度分量加和法得到的梯度图。从图中可以明显的观察到,无论哪种失真类型,使用所提出的方法计算得到的梯度特征要比使用最大分量法捕获更丰富的边缘信息,从而有效地反映出了图像在边缘处的特征变化。

通过采用这种新的梯度计算方法,分别得到参考图像及其失真版本的梯度特征,记为GMap1(X,Y)和GMap2(X,Y)。与计算色度相似性的原理类似,这里使用相同的方法计算参考图像及其失真版本之间的梯度相似性,过程如下:

(6)

式中:C3为一个正常量,根据经验取C3=386用于防止分母为零而造成Gsim的不稳定。

当失真图像产生多余边缘时,尤其是当增加的多余边缘颜色与参考图像对应像素点的颜色差异较大时,那么独立的计算参考图像和失真图像各自的梯度特征是有一定缺陷的,因为这种方法会误认为该边缘是参考图像经失真后保留下来的正确的边缘,造成误判。为了弥补此类计算缺陷,将参考图像与失真图像的边缘相关性融合到所提出的梯度相似性的计算过程中。具体做法是,首先将参考图像与失真图像的亮度通道进行融合,见式(7),再通过式(3)~(5),计算融合亮度通道后的图像梯度特征,记为GL。与SSIM中计算相似性类似,接下来通过式(8)~(9)分别计算GL与参考图像的梯度特征GMap1以及失真图像的梯度特征GMap2之间的相似性,分别用GRL和GDL表示。其中,C4为正常量,根据经验取C4=55用于稳定式(8)~(9),防止分母为零。

L=(L1+L2)/2

(7)

(8)

(9)

图3 两种梯度计算方法的比较Fig.3 Comparison of two gradient calculation methods

最后,改进后的梯度相似性特征见式(10),与只采用梯度分量加和法得到的梯度相似性特征Gsim相比,该公式增加的部分(GDL-GRL)将突出强调参考图像经失真后所丢失的边缘多于其失真版本所增加的边缘,降低对平滑边缘处的强调。

G=Gsim+[GDL-GRL]

(10)

1.3 DOG频带特征

由于梯度特征只强调了图像中的少部分信息,而图像大部分的能量主要集中在低频区域,因此,只在空间域中提取特征不足以准确描述整幅图像。本文采用Gauss差分(DOG)模型,通过提取不同频带特征来模拟HVS可同时处理空域和频域特征的特性。

DOG响应用于描述具有不同标准偏差的两个Gauss响应之间的差值,见式(11),其中Gσ1(X)和Gσ2(X)分别代表标准偏差为σ1和σ2的两个Gauss函数。一幅图像的DOG响应见式(12),即将一幅空间图像转化成带通表示。

DOGσ1,σ2(X)=Gσ1(X)-Gσ2(X)

(11)

IDOGσ1,σ2(X)=I∘(Gσ1(X)-Gσ2(X))

(12)

通过式(12),可将一幅图像分解为多个频带表示:

(13)

式中:N代表图像分解级数,σi=ki-1(i=1,…,N-1),∘是Hardamard乘积。

通过式(13),经过N级分解后的图像I可表示为:

(14)

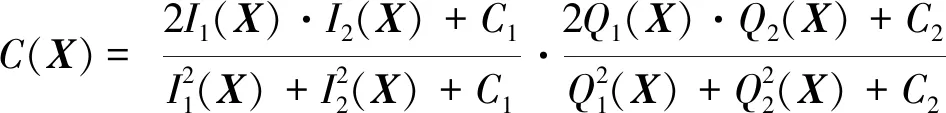

利用上述方法将参考图像I1与失真图像I2分解为5级(N=5)子带,并计算两幅图像在各级频带间的相似性,即:

(15)

式中:SSIM(·)表示相似性计算指标,i=0,1,2,3,4。

图4所示为图像5级(N=5)DOG分解示例。图4(a)为TID2013数据库中其中一幅原始图像的L通道图,图4(b)~(f)分别为分解后的5个频带图。

图4 图像5级DOG分解图Fig.4 5-level DOG decomposition of an image

1.4 CSF对比敏感度相似特征

CSF特征有效反映了HVS与空间频率之间的关系。实验表明,将DOG频带特征以及CSF两种特征结合使用有助于增强模型对不同空间频率的分辨能力,因此本文使用CSF与DOG频带特征共同反映人眼视觉系统的频率响应特性。这里使用SC-QI算法中提出的方法来提取与CSF相关的图像特征,首先将参考图像与失真图像从空间域转换为DCT系数,然后将csfL1(csfL2),csfM1(csfM2)和csfH1(csfH2)分别定义为参考图像(失真图像)在低频(LF)、中频(MF)和高频(HF)区域的分量。对于一幅参考图像,其对比度能量值计算如下:

(16)

式中:K=L1,M1,H1,分别对应参考图像RK的LF,MF和HF三个区域,p(u,v)表示在(u,v)点处DCT系数的归一化值。同理,对失真图像用同样方法计算这三个指标,计算结果记为:csfL2、csfM2以及csfH2。参考图像与失真图像在LF,MF和HF区域的相似性值分别计算如下:

(17)

(18)

(19)

式中:C5、C6、C7为正常量,根据SC-QI算法,取C5=20 001 111、C6=1.7、C7=0.006 3用于防止分母为零而造成csfLMap、csfMMap及csfHMap的不稳定。X为LF,MF和HF三个区域中像素点的坐标值。最终,参考图像与失真图像的对比敏感度相似性特征表示为:

F=csfLMap(X)·csfMMap(X)·csfHMap(X)

(20)

1.5 池化策略与多特征融合

经上述特征提取过程,可得到参考图像与失真图像之间的色度相似性特征、梯度相似性特征、DOG频带特征以及对比敏感度相似性特征。池化策略的目的是将提取的图像特征映射到低维空间中,通过低维空间保留下来的特征要最大程度地代表全局图像。本文提取色度相似性图的均值、标准偏差及熵,分别用Cm、Cs及Ce表示,提取梯度相似性图的均值、标准偏差及熵,分别用Gm、Gs及Ge表示,提取对比敏感度似性图的均值、标准偏差及熵,分别用Fm、Fs及Fe表示。DOG频带特征是一个5维的特征向量,记为[f0f1f2f3f4]。接下来,将3维色度相似性特征、3维梯度相似性特征、3维对比敏感度相似性特征以及5维频带特征进行多特征融合,融合后的特征空间用一个14维特征向量表示,即:

V=[CmCsCeGmGsGef0f1f2f3f4FmFsFe]

(21)

1.6 回归策略

与传统基于计算引导的方法不同,一旦得到代表每幅失真图像质量的特征向量与主观分数MOS后,基于机器学习的方法可自动进行特征学习并通过回归工具建立回归模型。在训练阶段,提取训练集中所有图像的14维特征向量,与主观分数一同输入到回归工具中,建立回归模型。测试阶段,将测试集中提取的图像特征向量输入到训练好的IQA回归模型中,最终映射为图像质量预测得分。

目前已经开发出了很多回归工具,其中RF和SVR两种工具使用最为广泛,也显示出卓越的学习能力和回归效果。Pei等[9]利用这两种回归技术训练了六个DOG模型,实验结果表明,RF的预测性能要优于SVR,尤其是当考虑到图像色度特征时结果最为显著。因此,本文采用随机森林RF训练质量回归模型,并设置参数(ntree, mtry)=(500, 2)。

2 实验结论与分析

2.1 数据库与评价指标

本实验在应用最广泛的四个图像数据库上进行,包括TID2013[15]、TID2008[16]、LIVE[17]以及CSIQ[18],表1比较了这四个图像数据库的部分信息。其中,TID2013数据库是四个数据库中规模最大的,是TID2008数据库的拓展版本,共有25幅原始图像、24种失真类型,每种失真类型有5个失真等级,该数据库总共包含3 000幅失真图像。另外,CSIQ数据库中所包含的参考图像的数量是最丰富的,LIVE数据库中图像的分辨率最高。

表1 四种图像质量评价数据库各种信息比较

(22)

2.2 算法综合性能评价

本文所提出的方法与八种主流的FR-IQA方法进行了比较,这八种方法分别是SSIM, MS-SSIM, IW-SSIM[19], FSIMc, GMSD[20], VSI, SC-QI 以及DOG-SSIM[9],其中,前七种为基于计算引导的方法,最后一种为基于机器学习的方法。由于TID2013数据库是TID2008数据库的拓展版本,因此,本实验仅在TID2013、LIVE以及CSIQ三个数据库中进行测试,实验所得PLCC和SRCC性能指标见表2。除包括在各数据库中的评价结果外,表2右半部分还列出了每种方法在三个数据库中的平均值及加权平均值评价结果,权重因子依赖于各个数据库中失真图像数量。表2中,加粗部分表示排名最高的图像质量评价方法所得结果。值得一提的是,为防止过拟合现象,保证训练集和测试集之间互不重叠,本文采用K-折交叉验证的方法避免此类问题。具体做法是在TID2013数据库中采用8-折交叉验证策略,在LIVE及CSIQ数据库中采用10-折交叉验证策略,每次训练选择其中1-折作为训练集,其余作为测试集,每次实验进行1 000次迭代,并取中位数作为评价指标的最终结果。

由表2可知,提出算法CGDR在各个数据库中的预测性能远远优于其他八种方法,平均结果和加权平均结果同样显示出其卓越的综合表现能力。具体来看,CGDR算法的平均PLCC和SRCC结果分别高于排名第二位方法的2.98%和2.60%,加权平均结果分别高了3.21%和2.99%。

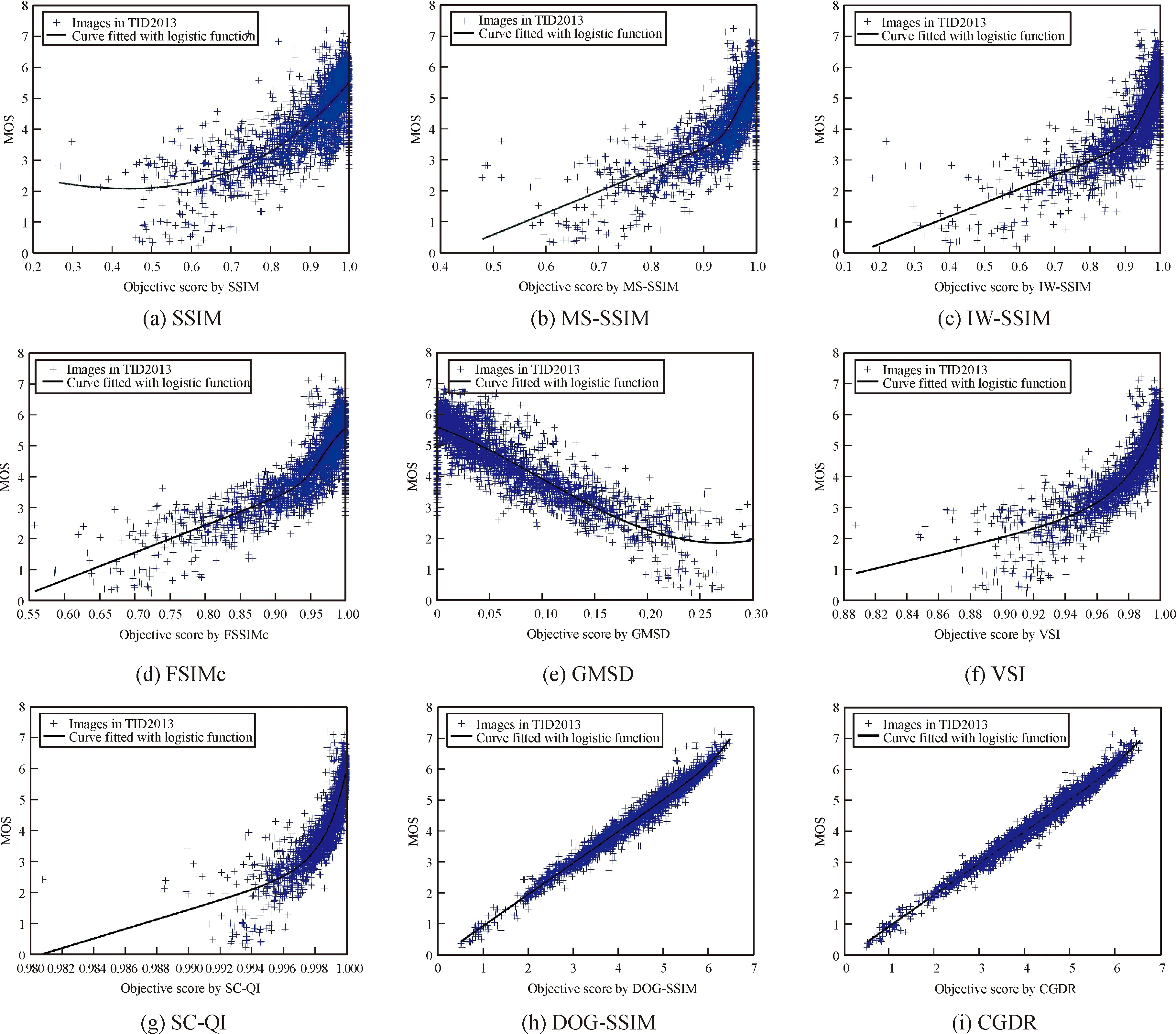

另外,图5显示了在TID2013数据库上通过九种IQA方法获得的预测得分与主观分数的散点图以及通过式(22)得到的最佳拟合逻辑函数,散点图横纵坐标分别表示IQA算法的预测得分以及主观MOS值,每个蓝色加号表示数据库中的一幅图像。从图5中可以看出,与其他八种方法相比,提出的CGDR算法的所有采样点更接近于拟合曲线,这说明与主观得分有更高的一致性。

表2 九种FR-IQA方法总体性能比较

图5 TID2013数据库上通过IQA方法获得的预测得分与主观分数的散点图Fig.5 Scatter plots of subjective MOS and predicted scores obtained by several IQA methods on TID2013 database

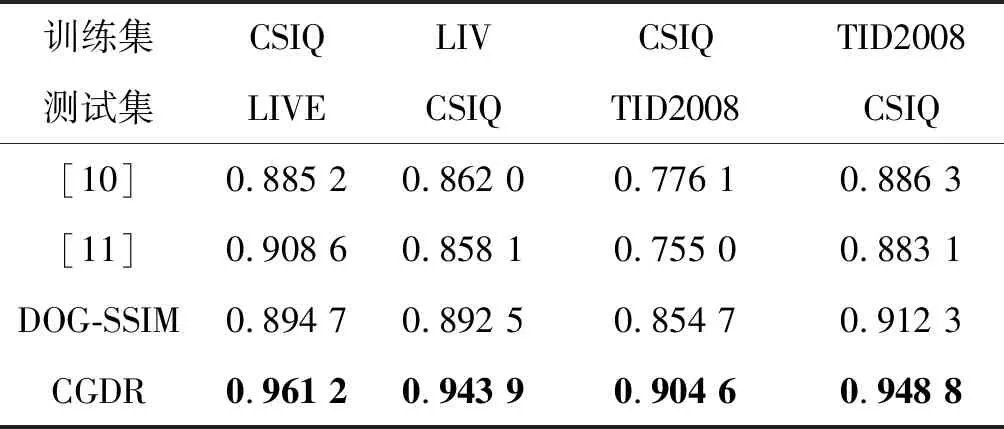

2.3 跨数据库验证

基于机器学习的IQA方法的预测性能直接取决于训练数据集与测试数据集,有些方法在一个数据集上的性能非常好,但在其他数据集上却表现平平。与K-折交叉验证不同,跨数据库验证是在不同数据库中分别训练和测试IQA模型,这对于评估模型的整体性能方面更有说服力。

表3为所提出的CGDR算法与其他三种基于机器学方法的跨数据验证的PLCC结果。其中,前两种方法分别使用SVR和SVD回归技术,后一种使用随机森林RF回归策略。值得一提的是,由于TID2013数据库与TID2008数据库中包含的原始图像相同,因此本实验排除在这两个数据库间进行验证。同理,LIVE 与TID2008和TID2013数据库均有重叠内容,因此,为保证实验的严谨和规范,跨数据库验证实验仅在CSIQ/LIVE以及CSIQ/TID2008数据库间进行训练和测试。表3中用粗体标出了每次交叉验证实验的最佳值,结果无疑证明了CGDR算法比其他三种方法有更强的鲁棒性。

表3 跨数据库验证的PLCC结果

2.4 运算复杂性分析

将IQA算法运用到实时系统中时,设计者总是希望在算法的预测精度与运算复杂度之间找到很好的平衡。表4列出了包括提出的CGDR算法在内的九种FR-IQA方法在TID2013数据库中每幅图像的平均运行时间,所有方法均使用Matlab 2016a在配有智能英特尔酷睿i7四核处理器的个人计算机上进行计算,其余八种方法的代码均来自原始作者。

由表4可知,SSIM的运算速度是九种方法中最快的,平均每0.049 7 s运行一对图像,其次是GMSD,速度快的原因是这两种方法无论在特征提取过程还是池化阶段,其计算过程都比较简单,计算的复杂程度相对较低。CGDR算法的平均运算时间与MS-SSIM大致相同,速度均落后于其他方法。CGDR算法运行速度慢的原因可能是在特征提取的过程中,对特征空间的维度控制的不够低,每一幅失真图像要提取14维特征向量,并且不仅需要在空间域中提取图像特征,还要将图像转变为DCT系数以及分解为DOG子带来反映其频率特征,所以导致其运算效率受到影响。虽然平均运算时间相对较高,但CGDR算法与其他八种方法相比保持了最高的预测精度。

表4 TID2013数据库上九种FR-IQA方法的平均运行时间

Tab.4 Average running time of nine FR-IQA methodsin TID2013 database

FR-IQA算法平均运行时间/sSSIM0.049 7MS-SSIM0.095 3IW-SSIM0.561 3FSIMc0.176 8GMSD0.052 5VSI0.257 6SC-QI0.092 7DOG-SSIM0.067 7CGDR0.561 4

3 结 语

本文提出了一种基于视觉感知高度相关图像质量评价模型CGDR。该模型在考虑图像色度特征的同时,使用改进后的梯度计算方法提取图像的空域梯度特征,并联合DOG频域特征以及CSF特征,从而充分模拟人眼对视觉场景的感知机制。在四个数据库上进行的实验表明,与主流FR-IQA方法相比,所提出的CGDR算法具有更高的预测精度和更强的鲁棒性,能够与人眼主观感知保持高度一致性。