基于传感数据的学习分析应用研究

2019-06-14李卿任缘黄田田刘三女牙屈杰

李卿 任缘 黄田田 刘三女牙 屈杰

[摘 要] 数据是学习分析研究的重要前提。传感技术的发展极大地提升了物理学习空间中的数据采集能力,拓展了学习分析的边界。为把握传感技术的应用现状与趋势,文章在分析传感技术的特征和功能基础上,使用文献研究法探讨了传感数据与学习分析结合的应用价值,构建了基于传感数据的学习分析框架,包括感知学习状态、预测学习表现、干预与反馈学习过程等。基于现有研究成果,将基于传感数据的学习分析应用归纳为学习认知、学习情感和动作技能等三个领域,分析了传感数据采集、模型优化、反馈机制等方面的挑战并提出未来可关注的研究方向。

[关键词] 教育大数据; 传感数据; 学习分析; 可穿戴技术

[中图分类号] G434 [文献标志码] A

[作者简介] 李卿(1982—),女,湖北武汉人。助理研究员,博士,主要从事教育大数据、感知计算技术等方面的研究。E-mail:viven_a@mail.ccnu.edu.cn。刘三女牙为通讯作者,E-mail:lsy5918@mail.ccnu.edu.cn。

[Abstract] Data is an important prerequisite for research on learning analytics. The development of sensing technology has greatly improved the ability of data acquisition in physics learning space and expanded the boundary of learning analytics. In order to grasp the application status and trend of sensing technology, based on the analysis of the characteristics and functions of sensing technology, this paper adopts literature research method to explore the application value of combining sensing data with learning analytics. A framework of learning analytics based on sensing data is constructed, including perceiving learning state, predicting learning performance, intervention and feedback learning process, etc. Based on the existing research results, the application of learning analytics based on sensing data is summarized into three fields: learning cognition, learning emotion and motor skill. Finally, this paper analyzes the challenges of sensor data acquisition, model optimization and feedback mechanism, and proposes the future research directions as well.

[Keywords] Big Data in Education; Sensing Data; Learning Analysis; Wearable Technology

一、引 言

大數据在教育领域的运用是学习分析产生的前提,学习分析是通过对学习者及其情境数据的测量、采集、分析和报告,了解和优化学习和学习发生的情境[1]。现已有众多学习分析系统,如美国普渡大学的Course Signals系统,根据学习管理系统中学生的表现和个性化指标预测学生是否能完成课程[2];亚琛工业大学(RWTH Aachen)的 eLAT(Exploratory Learning Analytics Toolkit)[3]通过在线学习分析,基于教师个人兴趣对教学进行反思与改进。由于网络学习开启了学习行为数据爆发式增长的潮流,现有的学习行为数据大多来源于线上(如学习管理系统、浏览器数据)。然而,很多学习发生在线下的现实情境中,只有捕捉现实情境中的学习行为数据,才能深入了解教与学的过程,以洞察学习者的学习心理,发现学习规律,优化学习过程,提高学习效率[4]。线下学习数据的采集将极大地丰富学习行为的类型,拓展学习分析的边界。因此,线下学习行为分析是学习分析研究的重要趋势。

随着各类新型传感器、穿戴设备的普及以及传感技术的成熟,线下学习行为的采集也在逐渐突破技术的限制,如可通过视频采集设备、可穿戴设备等采集课堂教学的全过程数据,也可通过人脸识别等专用设备对课堂学习者进行定向跟踪,采集学习者的表情、言行等数据。因此,将传感技术引入教育领域,可以实时收集物理空间数据,全面描述学习者,为实现学习过程的全方位量化提供了可能[5-6]。从2012年起,连续六届“学习分析技术与知识国际会议”都指出,传感技术(如眼动、脑电和心电等)成为学习分析重要的研究手段[7-8]。因此,如何将传感技术的优势与教学应用相结合,为学习分析研究带来了新的研究视角和挑战。

二、传感技术

(一)传感技术的定义与特点

传感技术是一种高精度、高效率、高可靠性的采集各种信息的技术,基本的传感设备包括动作传感器,声、光、电、温度、湿度和位置传感器等[9]。作为信息社会的支柱,传感技术已渗透在医疗保健、体育娱乐、工业生产、军事国防、交通管理等各个领域之中。

当前,传感技术日趋微型化、智能化和集成化。传感元件体积和质量越来越小,便于携带和使用;多种传感元件可集成在一个平台上或嵌入到智能手机中,实时采集信息,实现多功能集成;不仅能够代表生物器官进行视觉、听觉、触觉和温度等方面的感知,而且更加灵敏高效。

(二)传感器与传感数据

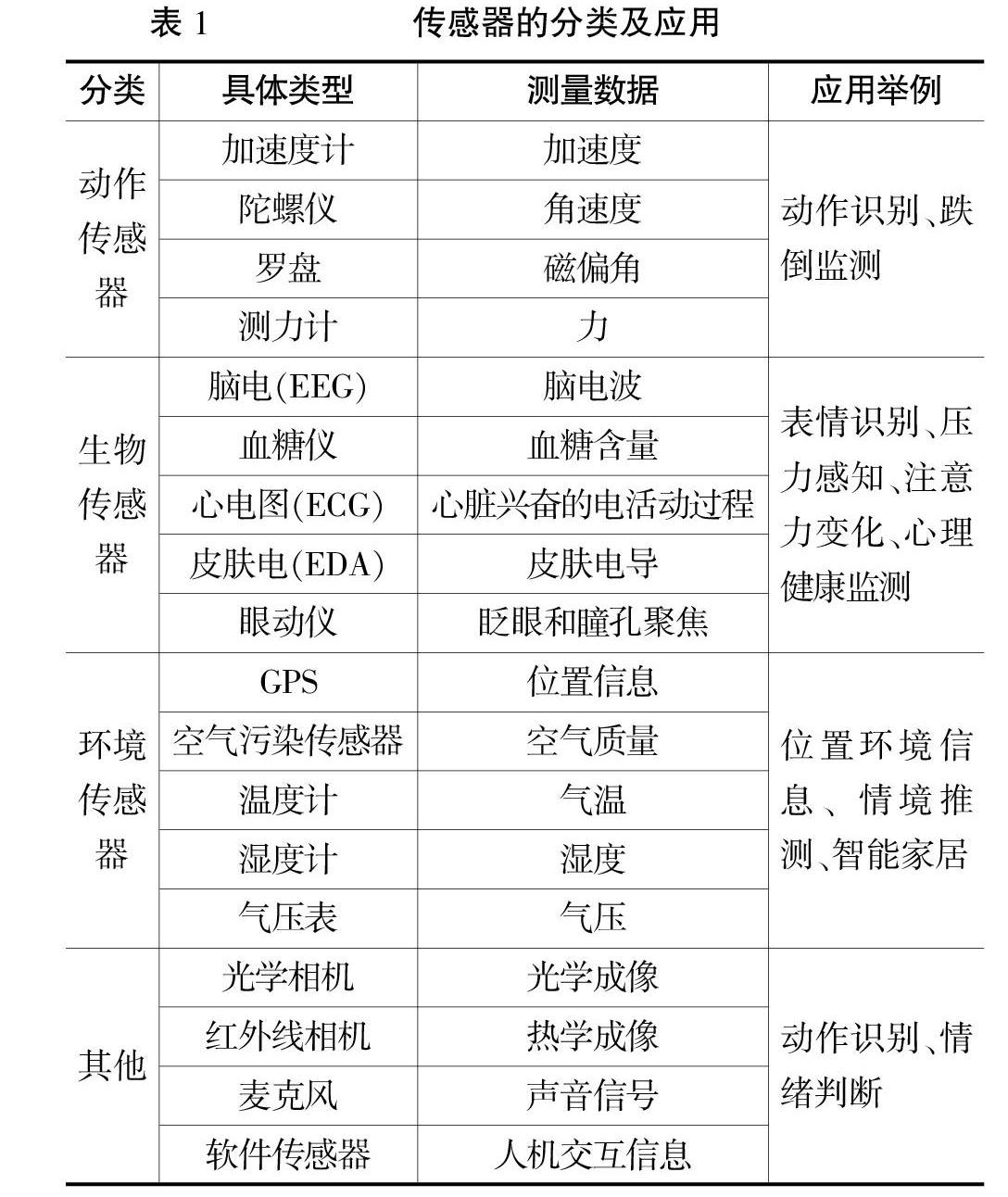

传感器种类多样,根据功能差异一般可分为动作传感器、生物传感器和环境传感器[10]三种类型。除此之外,光学相机、热学相机、麦克风等也被认为是传感器,既能进行动作识别,又能辅助情感计算。传感器的分类与应用见表1。

可穿戴式动作传感器是放置在人体各部位的微小元件,能精确地捕获和传输佩戴者的动作信息,如加速度、角速度等。动作传感器的主要功能是人体活动识别,在医疗护理、体育娱乐、智能家居等领域广泛使用。

生物传感器能对人体的生理特征进行无感化测量,如心率、呼吸、血压和体温等。由于生物传感器能连续监控和实时传输生命体征数据,多用于健康监测、疾病诊断等医疗领域。

环境传感器可以捕获人类周围的环境信息,如所处的位置、光线强弱、空气质量、噪音级别、天气情况和大气压力等。环境传感器在智能家居中技术较为成熟,主要用于监测环境变化,提高生活质量。

三、基于传感数据的学习分析方法

在学习分析研究中,有众多的学习分析模型,无论是反馈环状还是交互网状模型,从宏观上都包括数据的采集、分析和反馈,即对学习行为和状态的感知、预测与反馈。其中,学习数据的采集是学习分析的前提和基石。

目前,学习数据采集方法有基于Web的日志挖掘、学习者自我报告、基于传感等多种手段或几种方式的组合[11-12]。传统的技术手段获取的多是学习者线上的、结构化的学习行为数据,传感技术可以采集学习者的运动行为、生理数据和所在环境信息。通过动作传感器可以记录学习过程中学习者相关行为数据并进行序列分析,从而推测学习状态;通过生物传感器可以测量学习者的心率、呼吸、血压、体温等生理信息,获得与学习相关的认知和情感层面的支持,如研究证明,心率变化可以反映人的压力大小[13],脑电波可以显示注意力的变化[14];通过环境传感器可获取学习者所处的位置、光线强弱、噪音级别、天气情况等周围的环境信息,以分析环境可能对学习行为产生的影响,如噪声、天气、温度都会影响学习者的精力集中程度。

面向学习者的传感数据是教育大数据的重要组成部分,由多种传感设备组合而成的传感器平台能多维度地监测和采集学习者数据,全面准确地描述学习行为。相较基于Web的日志挖掘,传感数据更贴近真实的学习情境,增加了数据的有效性和可靠性。相较于传统的问卷量表或访谈,传感技术可以发挥高速率、高准确度、个性化的优势。

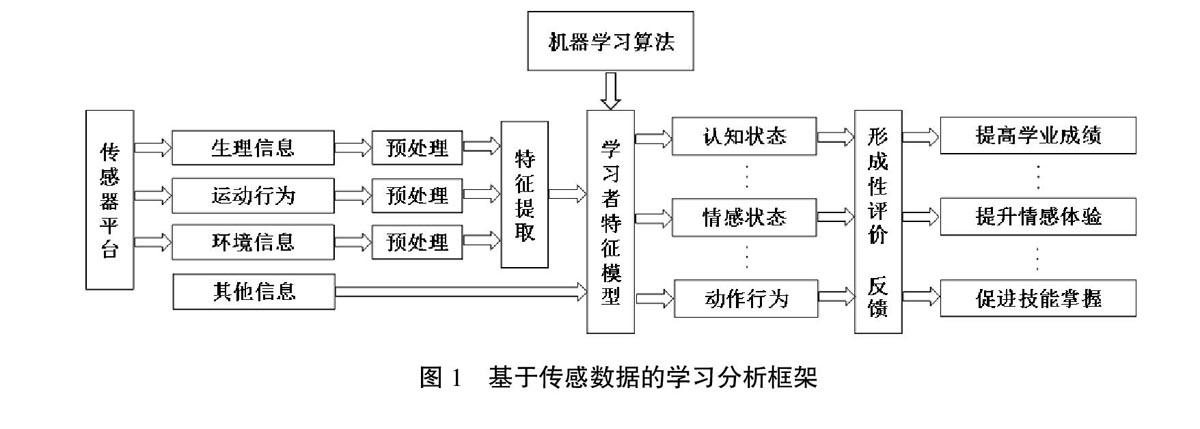

基于传感数据的学习分析通过采集学习者多模态数据,建立相应模型,评估和预测学习表现,并为学习者提供个性化的指导和服务。具体流程如图1所示。

(一)状态感知,了解学习过程

学习状态的感知既可以来自学习管理系统、学生信息系统、网络课程和社交媒体中产生的数据,还包括基于传感平台测量的有关学习者的生理信息、运动行为和情境信息。为了获得全面准确的信息,可在学习环境和学习者身上装置相应的传感器,进行量化跟踪。如嵌入加速度计、心率传感器、皮电装置、GPS、温度和气压等传感器的智能手环,可对个体进行健康追踪和运动监测,进一步整合视频、音频、日志、文本等多源数据进行学习状态感知和分析。

(二)数据建模,预测学习表现

传感设备采集大量关于学习者低层次的生理、心理和活动的多模数据后,提取关键特征,通过建模将低层次数据与高层次学习状态建立联系,用来评估和预测学生的表现,如信心程度、注意力状态、认知负荷、情绪波动、社会交互等,监控学生的不良学习行为,促进学生的课堂参与度,提高学习效率等。一般采用监督机器学习方法,通过训练模型以预测学生未来可能的学习表现。因为该方法需要大量的数据集和正确注释的标签,给建模带来了许多挑战,所以,目前在探究使用无监督或半监督的机器学习方法解决上述矛盾。

(三)结果评估,反馈和干预学习过程

传感器连续测量数据并进行分析后,可以用于评价任务中,特别是形成性学习评价中。形成性评价是一种持续地判断学生的学习状态和衡量学习效率的评价方法。基于传感器的学习平台能推测和判断学生目前的学习水平,并识别学生可能存在的错误,进而作出反馈。

高质量的反馈是形成性评价的关键要素,基于传感平台的反馈有震动、音频、视频等多种形式。如平台预测学习者处于低迷状态时,利用手环震动来进行提醒。

四、基于传感数据的学习分析应用综述

当前传感数据与学习分析正在不断地深度融合,国内外许多专家在积极地开展基于传感数据的学习状态的感知与优化方面的研究,本文根据布鲁姆的学习结果分类理论,将基于传感数据的学习分析应用归纳为认知、情感和动作技能三个领域,具体应用见表2。

(一)认知领域

學习者认知状态的感知和评估是一个复杂的过程,借助于传感技术可以对学习者的注意力、课堂投入感、认知负荷和创造力等状态进行客观有效的测量与评估。

注意力是影响学习效果的重要因素,通常使用自我报告来衡量被试注意力的集中度,如用认知失败问卷(CFQ)来衡量人们无法持续关注所从事活动的频率。但这种方法主观性强,数据量有限,测量过程会中断任务的执行。在传感技术中,自我报告一般作为辅助手段衡量注意力状态。如Steil等人使用可穿戴头部相机、移动手机和眼动仪获取了20位在校大学生的所在环境位置信息、运动模式、手机应用软件情况和眼部活动等数据,采用机器学习方法进行数据集标注和学习者建模,预测用户在使用手机时的注意力转移、注意力广度和注意焦点的变化[15],有助于感知学习者在移动学习中的认知状态和注意力变化,帮助学习者及时剖析自我、调整状态,提高注意力水平和自我效能感。

投入感是衡量注意力的重要指标,它表示学习者在学习、理解和掌握知识及学习过程中为取得成功的心理投入程度和学习的意愿、需求、欲望和冲动[16]。Csikszentmihalyi曾以心流来表示人们的投入感,即当人们完全融入所从事的活动时所体验的一种整体感受[17]。传感技术可以将这种主观感受通过身体动作和生理信息自动外显化表示出来,如Monkaresi等人在写作过程中引入基于视频的方法自动检测学生投入感,使用Microsoft Kinect传感器记录学习者的面部表情、声音和上半身动作,并使用心率传感装置提取学习者的心率变化,在论文写作过程中和之后分别收集实时性和回顾性的投入感自我报告,分别进行机器学习建模,结果表示融合两种自我报告的模型检测效果最佳[18]。

认知负荷理论认为工作记忆是有限的,如果学习任务需要太多的记忆容量,学习速度会变慢,因此,认知负荷与学习效率之间存在紧密联系。认知负荷的测量通常有主观测量、行为表现测量和心理生理学测量[19]三种方式。传感技术使心理、生理学测量方法的准确率更高,操作更为便捷。其主要优点在于测量的客观性,对不同认知过程的敏感性及过程的内隐性和连续性[20]。如Haapalainen等人通过传感设备测量人在执行不同难度水平的任务时的心率变化、瞳孔大小、脑电信息、皮肤电导、热通量和心电图等生理信息,间接反应认知负荷的大小,结果显示,熱通量和心电图测量值在区分低水平和高水平认知负荷时最准确,组合使用时准确度超过80%[21]。

创造力是21世纪的关键能力。尽管各行各业强调创造力的重要性,但是在实际教育中,它远没有纪律受到的重视多[22],大多数教师往往侧重于知识获取,而不是创造力等能力的培养。创造力一般使用人为的方式进行评估,如创造性量表[23],或构造评估特定产品设计的创造力模型[24],这种方法需要人为指定产品功能,因此,目前仅限于有限的概念空间。基于传感数据的方法可以用来解决这一难题,如Lopata等人已经证明脑电信号中的Alpha波能区分不同创造力,通过记录脑电信号对比音乐家在高、低创造力需求的任务时的Alpha波活动差异,发现在创造力要求高的任务中Alpha波段更为活跃,且音乐家的Alpha波与个人表现的客观评级之间显著相关[25]。

(二)情感领域

情感体验影响人类的认知和决策过程,是影响学习的另一个重要因素,如自信、无聊和困惑是影响学业成绩和预测学业表现的重要指标[26-27]。因此,情绪识别是分析学习者情感状态的重要研究领域。研究者们基于生理信号、身体动作、面部表情、语言信息、在线文本、互动日志和问卷量表数据开发了众多的情绪识别系统,对一般的情绪有着较高的识别率。其中传感技术是重要的情感识别手段,使用脑电、皮电和脉搏表等设备获取生理信号,可穿戴动作传感器捕获学习者的动作信息,光学和深度相机记录面部表情变化,结合多模信息提高情绪识别的准确率,具体应用见表2。

到目前为止,情绪识别技术发展纯熟,根据Russell的情绪环状模型[28],正面情绪(惊奇、兴奋、愉悦、满足、放松)和负面情绪(恐惧、紧张、失望、悲痛、伤心、沮丧、无聊)几乎涵盖了人类所有的情绪表现。虽然情绪情感种类繁多、结构复杂,但是教师和智能导师系统只需了解学习者最基本、最常见的情绪进行智能决策[29]。

Isen等人指出,积极的情绪对学习过程具有促进作用,特别是在创造力问题的解决方面[30]。而传统上被认为是消极的情绪在某些条件下也可能对学习产生正面影响,例如,困惑和紧张等,它们只有在发展到一定程度时才会对学习产生负面影响。所以,当系统检测到学生处于负面情绪或情感体验持续较低时,相应的反馈和调节至关重要。如将感知到的情感信息整合到e-Learning平台上,根据学习者的情绪状态定制不同学习材料,提高学习体验;教师根据学习者情绪反应,调节教学进程,提高学习效率。

(三)动作技能领域

人体动作识别技术是传感技术在行为活动领域应用的基础。人体动作识别主要有基于视觉传感和基于惯性传感两种类型。视觉传感主要使用RGB光学相机、3D立体相机和深度传感器如Microsoft Kinect和Asus Xtion Pro等记录身体动作。基于视觉的人类行为识别易于操作,捕获信息丰富,但识别性能受相机位置、主体活动范围、拍摄背景的影响;基于惯性传感的动作识别主要使用加速度计、陀螺仪和磁力计等可穿戴设备记录佩戴者的运动信息。这种方法不受时空限制,能长期记录和持续交互,但是也有自身的局限性,如长期使用导致传感设备损耗,测量准确率下降等。所以Chen等人开始将两种类型的传感技术相融合,提高动作识别的准确率[31-33]。

目前该领域的研究大都集中在低层次的基本动作识别上,如站、坐、走、跑、抬头、阅读、举手等,或者多个简单动作序列的识别。简单的非言语行为对于学习支持起到一定的解释作用,但是人们越来越关心学习者的动作与认知和情感等高级心理机制之间的关系[34],通过学习者不同的动作行为表征他们的认知状态和情感体验。除此之外,基于传感数据的动作识别在体育运动中可以提高运动员的动作技能,通过识别运动员的关键动作,判断他们的动作的精确度、力度和稳定性,推荐个性化训练指导,发挥智能导师作用。

五、总结与展望

随着传感技术、网络通信、人工智能等技术的发展,学习环境也发生了巨大变化,由最初固定的学习环境发展为移动学习和随时随地的学习。多种传感设备的有效结合可以形成功能强大的传感网络,以非侵入式的方式实时采集学习者的多维数据,诊断学习者现存的或潜在的问题,通过个性化的评价与反馈为学习提供有力支持。

学习分析强调基于数据的学习描述、诊断、预测和干预,结合应用现状发现,当前基于传感数据的学习分析仍存在诸多问题与挑战。在数据采集方面,为全面描述学习行为,一般采用传感数据与自我报告相结合的方法,数据在真实无感与全面准确之间难以兼顾;在模型建立方面,机器学习模型的拟合度不高,且目前大多数采用监督机器学习的方式训练模型,标签成本较大;在反馈回应方面,现有的反馈形式相对单一,且个性化反馈程度较差。未来的相关研究还可以在以下方面进行突破。首先,在量化学习行为方面,将线上和线下发生的所有学习行为通过传感手段进行自然的伴随式采集,同时,将一些定性的数据进行科学准确的量化表达;其次,目前尚缺乏融合多影响因素的数据关联模型与精准分析,需进一步改进和优化数据模型,提高预测的准确性;最后,如何利用传感数据的过程性反馈优势,在学习过程中进行个性化的干预,如何把握干预的方式、时机与场景以实现有效的反馈都需要深入探究。

[參考文献]

[1] SIEMENS G. Learning and knowledge analytics- knewton-the future of education?[EB/OL].[2011-04-14]. http://www.learninganalytics.net/ ?p=126.

[2] ARNOLD K E, PISTILLI M D. Course signals at purdue: using learning analytics to increase student success[C]//Proceedings of the 2nd international conference on learning analytics and knowledge. New York: ACM, 2012: 267-270.

[3] DYCKHOFF A L, ZIELKE D, BULTMANN M, et al. Design and implementation of a learning analytics toolkit for teachers[J]. Educational technology & society, 2012, 15(3):58-76.

[4] 刘三女牙,李卿,孙建文,刘智.量化学习:数字化学习发展前瞻[J].教育研究,2016(7):119-126.

[5] 徐晓青,赵蔚,刘红霞.混合式学习环境下情绪分析应用与模型研究——基于元分析的视角[J].电化教育研究,2018,39(8):70-77.

[6] 张琪,武法提.学习分析中的生物数据表征——眼动与多模态技术应用前瞻[J].电化教育研究,2016,37(9):76-81.

[7] 李香勇,左明章,王志锋. 学习分析的研究现状与未来展望——2016年学习分析和知识国际会议述评[J]. 开放教育研究,2017,23(1):46-55.

[8] 吴永和,李若晨,王浩楠. 学习分析研究的现状与未来发展——2017年学习分析与知识国际会议评析[J]. 开放教育研究,2017,23(5):42-56.

[9] SWAN M. Sensor mania! The internet of things, wearable computing, objective metrics, and the quantified self 2.0[J]. Journal of sensor and actuator networks, 2012,1(3):217-253.

[10] TH?譈S H, CHATTI M A, YALCIN E, et al. Mobile learning in context[J]. International journal of technology enhanced learning, 2012,4(5/6):332-344.

[11] VANLEHN K, ZHANG L, BURLSON W, et al. Can an non-cognitive learning companion increase the effectiveness of a meta-cognitive learning strategy?[J]. IEEE transactions on learning technologies, 2017,10(3):277-289.

[12] CATRYSSE L, GIJBELS D, DONCHE V, et al. How are learning strategies reflected in the eyes? Combining results from self‐reports and eye‐tracking[J]. British journal of educational psychology, 2017,88(5):118-137.

[13] TAELMAN J, VANDEPUT S, SPAEPEN A, et al. Influence of mental stress on heart rate and heart rate variability[C]//4th European Conference of the International Federation for Medical and Biological Engineering. Berlin, Heidelberg: Springer, 2009: 1366-1369.

[14] AFTANAS L I, GOLOCHEIKINE S A. Human anterior and frontal midline theta and lower alpha reflect emotionally positive state and internalized attention: high-resolution EEG investigation of meditation[J]. Neuroscience letters, 2001, 310(1):57-60.

[15] STEIL J, M?譈LLER P, SUGANO Y, et al. Forecasting user attention during everyday mobile interactions using device-integrated and wearable sensors[C]//Proceedings of the 20th International Conference on Human-Computer Interaction with Mobile Devices and Services. New York: ACM, 2018.

[31] CHEN C, JAFARI R, KEHTARNAVAZ N. Improving human action recognition using fusion of depth camera and inertial sensors[J]. IEEE transactions on human-machine systems, 2015, 45(1):51-61.

[32] CHEN C, JAFARI R, KEHTARNAVAZ N. A real-time human action recognition system using depth and inertial sensor fusion[J]. IEEE sensors journal, 2016, 16(3):773-781.

[33] CHEN C, JAFARI R, KEHTARNAVAZ N. A survey of depth and inertial sensor fusion for human action recognition[J]. Multimedia tools & applications, 2017, 76(3):4405-4425.

[34] BOWMAN L C, THORPE S G, CANNON E N, et al. Action mechanisms for social cognition: behavioral and neural correlates of developing theory of mind[J]. Developmental science, 2017, 20(5): 1-16.

[35] SUN C Y, YEH P C. The effects of attention monitoring with EEG biofeedback on university students' attention and self-efficacy: the case of anti-phishing instructional materials[J]. Computers & Education, 2017, 106:73-82.

[36] GHERGULESCU I, MUNTEAN C H. ToTCompute: a novel EEG-based timeontask threshold computation mechanism for engagement modelling and monitoring[J]. International journal of artificial intelligence in education, 2016, 26(3):821-854.

[37] MOSTOW J, CHANG K, NELSON J. Toward exploiting EEG input in a reading tutor[J]. International journal of artificial intelligence in education, 2013, 22(1-2):19-38.

[38] MULDNER K, BURLESON W. Utilizing sensor data to model students creativity in a digital environment[J]. Computers in human behavior, 2015(42):127-137.

[39] MITRI D D, KLEMKE R, DRACHSLER H, et al. Towards a real-time feedback system based on analysis of multimodal data[C]//European Conference on Technology Enhanced Learning, 2017.

[40] RACHURI K K, MASCOLO C, RENTFROW P J, et al. Mobile sensing at the service of mental well-being: a large-scale longitudinal study[C]//Proceedings of the 26th International Conference on World Wide Web. International World Wide Web Conferences Steering Committee, 2017: 103-112.

[41] CHEN C M, LEE T H. Emotion recognition and communication for reducing second‐language speaking anxiety in a web‐based one‐to‐one synchronous learning environment[J]. British journal of educational technology, 2011, 42(3): 417-440.

[42] PRIETO L P, SHARMA K, DILLENBOURG P. Teaching analytics: towards automatic extraction of orchestration graphs using wearable sensors[C]//Proceedings of the Sixth International Conference on Learning Analytics & Knowledge. New York:ACM, 2016: 148-157.

[43] PIRKL G, HEVESI P, LUKOWICZ P, et al. Any problems? A wearable sensor-based platform for representational learning-analytics[C]//Proceedings of the 2016 ACM International Joint Conference on Pervasive and Ubiquitous Computing: Adjunct. New York:ACM, 2016: 353-356.

[44] ANZULEWICZ A, SOBOTA K, DELAFIELDBUTT J T. Toward the autism motor signature: gesture patterns during smart tablet gameplay identify children with autism[J]. Scientific reports, 2016, 6, 31107: 1-13.

[45] LU Y, ZHANG S, ZHANG Z, et al. A framework for learning analytics using commodity wearable devices[J]. Sensors, 2017, 17(6), 1382: 1-25.