基于多通信机制与机器视觉的智慧小区视频监控系统

2019-04-09吴志光

胡 石,王 彬,吴志光

基于多通信机制与机器视觉的智慧小区视频监控系统

*胡 石,王 彬,吴志光

(池州职业技术学院机电技术系,安徽,池州 247000)

为了有效监控小区内的车辆速度,实现保障小区业主人身安全和促进城市小区健康发展,本文设计了一套基于多通信机制与机器视觉的智慧小区视频监控系统。首先,将基于Socket的网口通信与基于RS232的串口通信实施融合,连接测速摄像头与中心服务器,构建起智慧小区车辆视频监控系统的硬件平台。然后,结合高斯模型、Harris角点定位与RANSAC匹配优化方法,设计了车辆速度检测算子,实现车辆有无判断和车辆速度计算。在Visiual Studio平台开发系统,并对所提智慧小区视频监控系统进行了测试,结果表明:本文提出的智慧小区视频监控系统,在车速检测和系统智能性方面,都优于传统小区视频监控系统。

智慧小区;视频监控;多通信机制;机器视觉; Harris角点;RANSAC匹配优化

0 引言

近年来,随着城市化进程的推进,住宅小区规模和机动车数量都有很大增长,住宅小区内机动车数量也增长迅速,但是,住宅小区内没有交警巡查或公安电子眼,因此,监控小区内机动车的行车速度可以起到保障业主人身安全的作用。而对于传统的小区车速管理,往往依靠保安巡查和物业宣传,这种方式在一定程度上可以起到作用,但是无法实现小区的24小时监控,并且人工成本较大,如果采用智能视频监控的方式,不仅可以降低人力、物力成本,还可以调取相关视频,便于后续管理和纠纷处理。所以,如何以智能化、高效率、低成本的技术来监控小区机动车速和保障业主人身安全是具有重要实际意义的。

目前国内研究人员在这一领域已进行了深入研究。如李娟等[1]人提出基于GPS的高速公路车速全程监控方法,采用GPS和地图匹配技术的高速公路车速全程监控和管理方法,建立相关算法的数学模型,实现高速公路车速的全程监控,但是GPS相关检测设备价格高,导致该方案很难在细分市场推广。徐骏骅等人[2]提出了基于边缘检测与模式识别的车脸识别算法,基于Lab颜色空间转换与Canny边缘检测,设计车辆前脸区域检测机制,然后基于粗糙集描述和Adaboost分类器,对车脸特征完成训练,建立强识别器,准确识别车脸,最后基于开源图像库Aforge.NET和C#语言实现算法,开发出瀑布结构标准软件系统,但是该系统对车辆目标的识别,依赖于摄像头采集角度和正面车脸图像,在实际应用场景,往往存在检测不稳定性。朱善玮等人[3]设计一个基于Haar-like和AdaBoost的车脸检测,根据Haar-like特征的分布情况对其进行归一化处理,利用归一化处理后的特征构建多个弱分类器,再利用AdaBoost算法把选出的弱分类器级联为强分类器,最后用强分类器对车辆图像的车脸部分进行检测定位,但是AdaBoost分类器对带标签高质量样本数据库的依赖较大,在实际应用场景中,由于车辆实景图像采集难度高,样本库数量要求较难达到,使其训练出来的识别分类器往往存在不稳定性。

在小区机动车车速检测这个智能交通和智慧城市的大市场中细分出来的应用场景,急需采用人工智能的方法,达到车速视频有效监控,保障业主人身安全。对此,本文提出了基于多通信机制与机器视觉的智慧小区视频监控系统,有效降低成本和稳定识别车辆车速,达到增强业主居住安全感的目的。

1 本文智慧小区视频监控系统设计

所提的智慧小区视频监控系统的预设目标有2个:(1) 利用串口通信与网口通信完成监控系统的硬件平台构建;(2) 耦合高斯模型、Harris角点定位与Ransac角点匹配方法,设计车速识别算子,实现算法对车辆有无、车辆跟踪和车速计算,提高物业对于小区内机动车行驶的管控,以低成本高效率高准确度的保障业主人身安全。

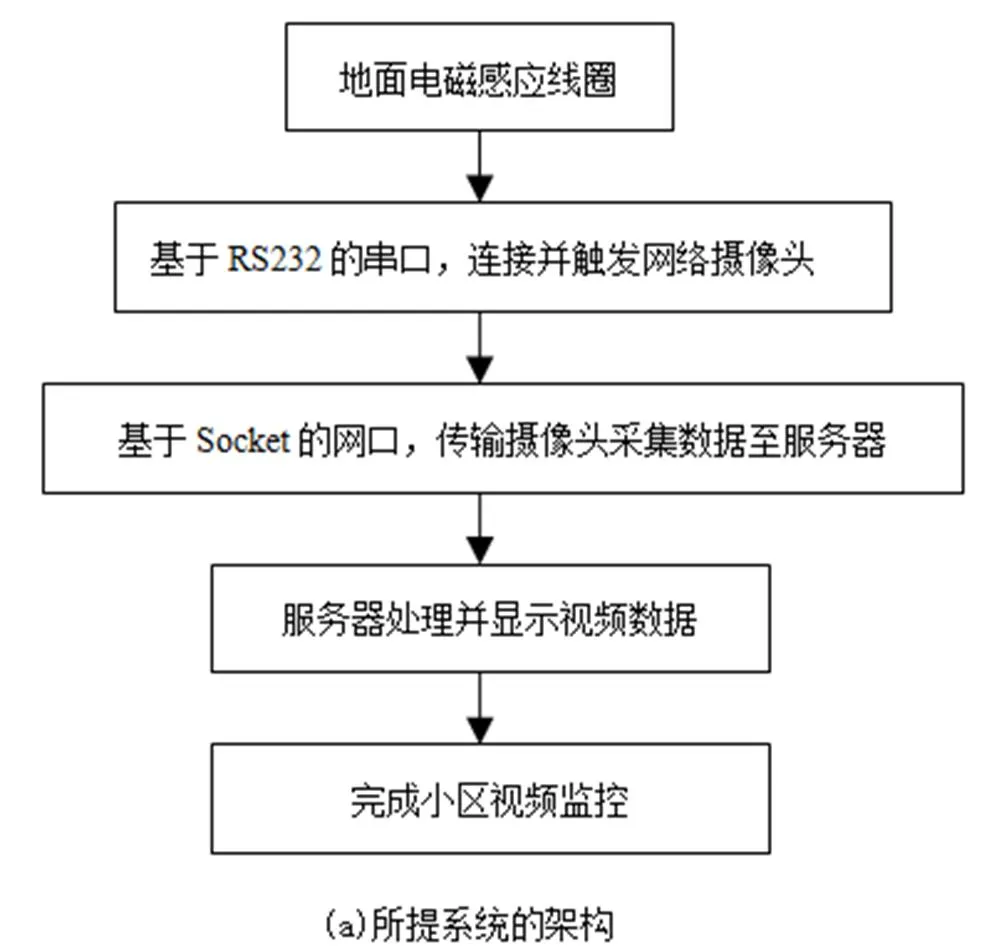

如图1(a)所示,为本文系统的架构,小区主干道路面安置磁电感应线圈,用来感应汽车通过摄像头监控区域。汽车特征不同于行人,当磁电感应线圈感应到汽车时,通过转接与RS232串口线,连接于网络摄像头,采集视频的摄像头对当下采集图像(视频当前帧)启动服务器的车辆识别程序,对该图像进行识别,有效避免时延问题。RS-232串口标准协议的全称是 EIA-RS-232C 标准,其中EIA代表美国电子工业协会,RS代表推荐标准,232是标识号,通讯接口之一,通常 RS-232 接口以9个引脚或是25个引脚的型态出现[4]。本系统采用这种低成本的通信形式和协议,完成磁电感应线圈与视觉采集单元的连接。socket本质是编程接口(API),对TCP/IP的封装,TCP/IP也要提供可供程序员做网络开发所用的接口, HTTP是轿车,提供了封装或者显示数据的具体形式,Socket是发动机,提供了网络通信的能力[5]。本系统利用Socket网口通行,连接摄像头采集数据与中心服务器。本智能小区门禁管理系统借助RS232和Socket这两种通信方式,发挥传输数据和传递控制信息的优势,相比于昂贵的传感器,本文提出的多通信机制不仅降低了系统成本,还提高了系统信息传输相率。如图1(b)所示,本系统UI,主要有实时视频图像采集、车辆定位、车速计算、车速信息显示。如图1(c)所示,硬件平台由磁电感应线圈、RS232串口线、网络摄像头、Socket网口网线、服务器构成。待检测视频截图如图2所示,由图发现,视频视野内小区主干道上存在机动车。所设计的系统目的就是为了这些车辆及其速度进行监控。

图2 待检测图像

2 车速检测算子

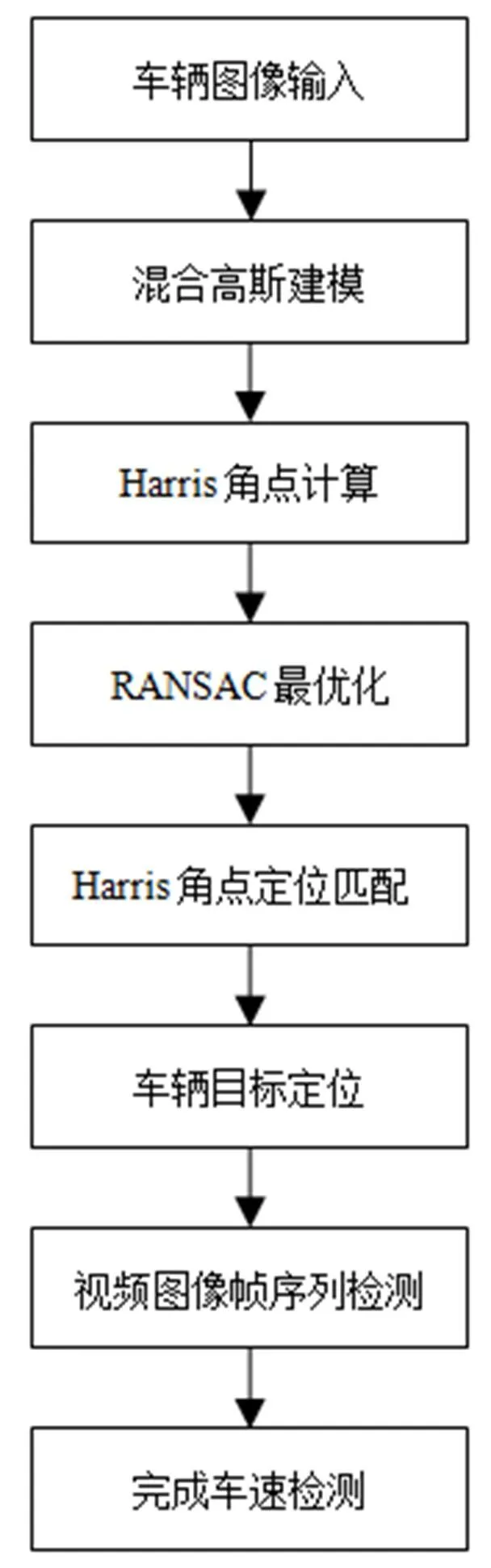

为了实现小区内机动车目标的准确识别、跟踪和车速计算,本文耦合混合高斯建模、Harris角点检测和RANSAC策略,构成车辆目标定位识别算子,然后处理视频中的图像帧序列,计算前后目标移动距离与时间,检测出车辆速度,其过程见图3。

图3 本文车速检测算子的过程

首先需要对路面行驶的机动车进行图像采集,进行混合高斯建模。混合高斯建模是按照高斯分布对每个像素建立模型,并通过基于回归滤波的在线 EM 近似方法对模型参数进行更新,它能鲁棒地克服光照变化、树枝摇动等造成的影响[6]。混合高斯建模较为传统成熟,且数学推导公式冗余,本文在这里不再赘述。然后,在高斯建模基础上,进行Harris角点定位,作为车辆定位与移动速度计算的依据。Harris角点定位[7-8]是依据自相关函数给出的,得出了矩阵M,矩阵M中的特征值是自相关函数的一阶曲率,如果一阶曲率都很高,则认为此处为为角点。本系统中的摄像头实时采集小区视频,当磁电感应线圈传输信号至摄像头时,系统保存摄像头当前视野图像,并对该图像进行识别(混合高斯模型、Harris角点检测等),从而既实现车速检测,又避免视频实时处理的高负荷计算量问题,使其较好地满足实时需求。

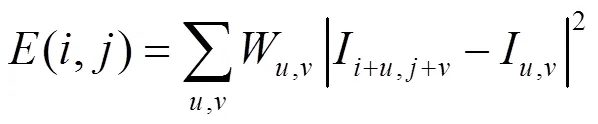

在进行Harris角点检测时,需要计算基于自相关函数的局部图像灰度变化程度,如下式所示:

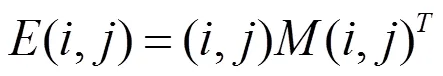

式(1)中,代表图像坐标,代表灰度图窗口移动后的自相关函数,代表移动窗口,代表图像。接着以矩阵的形式表示:

式(2)中E代表自相关函数,,代表图像坐标,代表Harris角点特征值矩阵。接着进行Harris角点相应函数:

式(3)中代表角点相应函数值,越大代表角点可能性越大,代表协方差运算,代表和运算。在Harris角点定位基础上进行RANSAC运算。

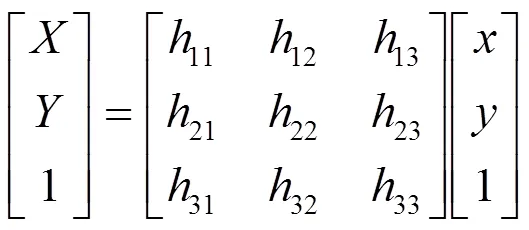

随机抽样一致性(RANSAC)算法,可以在一组包含“外点”的数据集中,采用不断迭代的方法,寻找最优参数模型,不符合最优模型的点,被定义为“外点”[9-10]。为了获取最优参数矩阵,需要符合如下条件:

式4中、代表实际场景图像角点坐标,、代表目标图像角点坐标,矩阵代表单应性矩阵。

以图2作为待识别目标,对其进行Harris角点检测,结果如图4(a)所示,可见,准确检测出了移动车辆的Harris角点,再对移动车辆进行跟踪定位,计算车速,如图4(b)所示,可见定位准确,车速计算结果为3.4 km/h,在正常速度范围(5 km/h)内,系统显示“正常”。

图4 车速检测与车辆定位结果

所设计的车速检测算子的部分关键代码如下:

itkRGBImageType::Pointer extractCellRegionItk(itkRGBImageType::Pointer lowResolutionwholeSlideImage)

{int w = lowResolutionwholeSl

ideImage-> GetLargest PossibleRegion().GetSize(0);

int h = lowResolutionwholeSlideImage-> GetLargest PossibleRegion().GetSize(1);

int centerX = static_cast

int centerY = static_cast

itkRGBImageType::Pointer imageCellRegion = itk RGBImageType::New();

imageCellRegion->SetRegions(lowResolutionwholeSlideImage->GetLargestPossibleRegion());

imageCellRegion->Allocate();

int radiusSq = static_cast

radiusSq *= radiusSq;

RGBPixelType whitePixel;

whitePixel.SetRed(246);

whitePixel.SetGreen(247);

whitePixel.SetBlue(239);

itkIndexType idx;

for (int ih = 0; ih < h; ++ih)

{ idx[1] = ih;

for (int iw = 0; iw < w; ++iw)

{ idx[0] = iw;

if ((iw - centerX)*(iw - centerX) + (ih - centerY)*(ih - centerY) < radiusSq)

{imageCellRegion->SetPixel(idx, lowResolutionwholeSlideImage->GetPixel(idx));}

else{imageCellRegion->SetPixel(idx, whitePixel);

return imageCellRegion;}

3 实验结果及分析

采用Intel i7 四核CPU,16GB的内存,电脑系统 Windows 10,借助Visual Studio开发平台对所提的基于多通信机制和机器视觉的智能小区视频监控系统进行实际应用测试。

为了验证本文智能小区视频监控的优异性能,本文设立了对照组,分别为文献[2]和文献[3],对应记为A、B算法。输入图像如图5所示,视野内主干道有机动车待识别,系统功能有包括了视频采集、车辆定位、车速计算显示。然后,利用本文技术、A组技术、B组技术来监控图5中的车辆,分别得到结果如图6~图8所示。由图发现,所提监控系统具有更高的定位精度,可以完成车辆准确定位和车速计算,见图6。这主要是因为本文采用机器视觉算法,实现系统功能,并基于混合高斯模型建立、Harris角点检测匹配和RANSAC匹配优化机制,实现车辆实时定位和车速计算。而A组技术采用车辆前脸区域检测机制,一定程度上解决识别率问题,但是该系统对车辆目标的识别,依赖于摄像头采集角度和正面车脸图像,在实际应用场景,往往存在检测不稳定性,如图7所示,车辆定位正确,车速计算错误。而B组技术利用AdaBoost算法把选出的弱分类器级联为强分类器,但是AdaBoost分类器依赖比较大的带标签高质量样本数据库,在实际应用场景中由于车辆实景图像采集难度高,样本库数量要求较难达到,训练出来的识别分类器往往存在不稳定性,如图8所示,车辆定位错误,车速计算错误。

图5 智能系统与待检测原图

图6 本文算法的检测结果

图7 文献[2]的检测结果

图8 文献[3]的检测结果

为了反映所提算法的稳定性,将所提系统用于笔者所在小区进行车辆监控测试,时间从2018-11-25日早上7点开始,至2018-11-27下午5点结束,对该时间段内所有车辆进行定位与车速测算,通过调取监控结果发现,该系统总共采集了670幅车辆图像,正确定位数量为652幅,成功率高达97.31%,且其运行平稳。只有在车辆与非机动车辆距离很近、同方向行使时(12次),以及大雾天气(6次)情况下出现过错误识别,其余场合均检测正确。

4 结束语

为了智能化监控小区车辆速度,保障业主安全,本文设计并开发实现了基于多通信机制与机器视觉的智慧小区视频监控系统。采用磁电感线圈、RS串口线、网络摄像头、Socket网线网口和中央服务器,以机器视觉技术为基础,组成低成本、高效率的智慧小区视频监控系统硬件架构。基于混合高斯模型、Harris角点检测和RANSAC计算,构建车速检测算子,达到车辆定位检测和车速测量的目的。用Visual Studio平台来实现本文系统,结果表明:相比于对标系统,在保证系统功能前提下,本文系统在车辆定位和车速计算方面具有更高的精度和稳定性。

雨天等天气对识别率影响是本文目前研究成果上后续开展的内容,以进一步提高本文系统的智能程度与适应性。

[1] 李娟. 基于GPS的高速公路车速全程监控方法研究[J]. 测绘工程,2018, 6(2): 63-67.

[2] 徐骏骅. 基于边缘检测与模式识别的车脸识别算法[J]. 控制工程,2018, 2(6):126-129.

[3] 朱善玮. 基于Haar-like和AdaBoost的车脸检测[J]. 电子科技, 2018, 11(5): 58-63.

[4] 黄山. 基于无线数据通信及微机接口的单片机教学平台的研究[D]. 广州: 华南理工大学, 2018: 52-54.

[5] 陆翔莺. 基于PCA算法的车脸识别系统研究[J]. 通讯世界,2018, 27(3): 1042-1045.

[6] 马平华,徐晓光,夏雯娟. 基于改进型Camshift和卡尔曼滤波器的车辆跟踪算法[J]. 井冈山大学学报:自然科学版,2015, 36(5): 60-65.

[7] 张立亭,黄晓浪,鹿琳琳. 基于灰度差分与模板的Harris角点检测快速算法[J]. 仪器仪表学报,2018,39(2): 218-224.

[8] Wang Z C, Li R, Shao Z H. Adaptive Harris corner detection algorithm based on iterative threshold[J]. Modern Physics Letters B,2017,31(15): 1750181-1750189.

[9] 刘三毛. 基于RGB-D的室内场景SLAM方法研究[D]. 长沙:湖南工业大学, 2017:21-39.

[10] Cheng L, Li M C, Liu Y X. Remote sensing image matching by integrating affine invariant feature extraction and RANSAC[J]. Computers and Electrical Engineering, 2012, 38(4): 1023-1032.

Intelligent Community Video Surveillance Management System based on Multi-Communication Mechanism and MachineVision

*HU Shi, WANG Bing, WU Zhi-guang

( Department of Mechanical and Electrical Technology, Chizhou Vocational Technical College, Chizhou, Anhui 247000, China)

In order to effectively monitor the vehicle speed in the residential area, and realize the purpose of ensuring the personal safety in the residential area, as well as promote the healthy development of the urban residential area, this paper designs a smart residential area video monitoring system based on multi-communication mechanism and machine vision. Firstly, integrating socket-based network communication with RS232-based serial communication, connecting speed measuring camera and central server, the hardware foundation of vehicle video surveillance system of intelligent community is constructed. Then, combining the Gaussian model, Harris corner location and Ransac corner matching method, the vehicle speed detection operator is designed to realize the vehicle judgment and vehicle speed calculation. The system is developed on Visual studio platform, and the video surveillance system of intelligent community is tested, the output results show that this intelligent video surveillance system is superior to the traditional video surveillance system in speed detection and system intelligence.

intelligence community; video surveillance; multi-communication mechanism; machine vision; Harris corner; RANSAC matching

TP391

A

10.3969/j.issn.1674-8085.2019.02.010

1674-8085(2019)02-0052-06

2018-10-15;

2019-01-05

安徽省高校优秀拔尖人才培育资助项目(gxyq2017218);安徽省高等学校省级质量工程项目(2017sjjd052,2017jxtd079)

*胡 石(1988-),男,安徽省池州市人,讲师,硕士,主要从事模式识别、图像处理、视频监控技术等研究(E-mail: hushi8811@sina.com);

王 彬(1987-),男,安徽省池州市人,讲师,硕士,主要从事模式识别、智能控制等研究(E-mail: Wangb1987ac@126.com );

吴志光(1979-),男,安徽省合肥市人,副教授,硕士,主要从事智能控制、计算机应用等研究(E-mail: Wzg1979prof@126.com).