法庭说话人识别新范式实证研究

2018-10-15张翠玲GeoffreyStewartMorrisonEwaldEnzinger

张翠玲, Geoffrey Stewart Morrison, Ewald Enzinger

(1.西南政法大学刑事侦查学院, 重庆 401120; 2.重庆高校刑事科学技术重点实验室, 重庆 401120;3.阿斯顿大学法律语言学中心,法庭言语科学实验室, 伯明翰, 英国;4.Eduworks, 科瓦利斯,俄勒冈,美国)

0 引言

录音是重要的法庭证据。随着通信技术的发展和手机等录音设备的普及,在很多刑事和民事案件中都出现了语音证据,如绑架勒索、恐吓、诈骗、贩毒、经济纠纷等。通过语音可以分析说话人的特点,进而鉴别说话人身份。法庭说话人识别就是利用案件中的语音进行该说话人的身份辨识。具体来说,就是对录音证据中未知身份的说话人语音(检材语音)和已知身份的嫌疑人语音(样本语音)进行分析比较,进而推断二者的同源性(来源于同一人或不同人)。

国际上,传统的法庭说话人识别方法主要有听觉分析方法、声学图谱方法或听觉- 声学图谱方法[1-3]、听觉- 声学- 语音学方法[4],近年来又发展出声学- 语音学统计方法[5-6]和自动识别方法[7]。在中国,听觉分析与声学图谱比较相结合的方法是法庭说话人识别的基本方法[8]。司法部的“语音同一性鉴定技术规范”和公安部发布的“语音同一认定方法”对此方法进行了具体说明,其中后者与国际法庭鉴定协会(IAI)发布的“语音比对标准”[9]比较接近。声学图谱方法或听觉- 声学图谱方法最早可以追溯到20世纪60年代,目前在国际上的使用仍然比较普遍[10]。然而,由于该方法主要依赖于专家的主观判断,没有经过案件现实条件下的准确性和可靠性验证,因而一直备受诟病[11-13]。2003年,美国联邦法院根据Daubert标准[14]在对Angleton 案件审理过程中[15],将基于该方法的语音鉴定证据裁定为不予采信。因此,建立和完善法庭说话人识别的理论体系及科学方法成为司法语音领域共同关注的问题。

1 新范式提出的背景及要求

国际上,科学团体和法律实务部门对包括法庭说话人识别在内的法庭科学技术的“科学性”“可靠性”“准确性”“定量化”等要求不断提高。如2009年,美国国家研究委员会(NRC)在提交给国会的关于“加强美国法庭科学”的报告[16]中,对许多法庭科学分支学科进行了尖锐的批评,并且建议“研究和确立法庭分析的可靠性和准确性的量化方法”。英格兰和威尔士的法庭科学管理者在其“实践和行为准则”[17]中也规定法庭分析方法在运用之前必须进行验证。鉴于此,国际上法庭科学开始进行了法庭证据评价的范式转变[18],法庭说话人识别也是如此[19]。2015年,欧洲法庭科学研究所联盟(ENFSI)发布了法庭科学评价报告指南,倡导所有的法庭科学分支都采用基于似然比框架体系(Likelihood Ratio Framework)的新范式进行证据评价[20]。同时,还专门发布了基于此范式的法庭说话人识别实践指南[7],供国际同行参考使用。

法庭说话人识别的新范式包括3个核心要素[13]:(1)以似然比框架体系作为法庭语音证据评价的逻辑框架;(2)使用相关数据、定量测量和统计模型来计算似然比;(3)对采用的方法系统进行被检案件条件下的准确性和可靠性验证。与传统的、以主观评判为主的方法比较而言,新范式基于相关数据、定量测量和统计模型等程序方法,量化评价语音证据的价值,不仅具有较好的抗认知偏差性、透明性和可重复性,而且可以基于被调查案件的实际条件进行准确性及可靠性验证[21],更好地符合了国际上对于法庭科学提出的上述标准和要求。

近20年来,国际上对于法庭语音证据评价的新范式开展了大量的理论研究、实验研究和实证研究,并且已经将该范式应用于法庭说话人识别的司法实践[21-24]。在国内,基于汉语语料和似然比方法的法庭说话人识别也取得了一定的研究成果[25-31],但是到目前为止,还没有开展过基于实际案件的新范式实证研究。

本文以一起典型案件为例,将法庭证据评价的新范式应用于法庭说话人识别的案件实践。通过相关数据、定量测量和统计模型来计算数字似然比,量化评价语音证据的强度,并将分析结果体现在鉴定报告中,这在国内尚属首例。本文首先介绍案件的基本情况以及控辩双方的主张,然后介绍检验的主要程序及分析方法,包括相关数据的采集、声学参数的测量、统计模型的构建、似然比的计算以及系统的测试验证等。最后,给出计算结果,包括似然比值和系统验证的指标值,并进行讨论和总结。本文是在前期研究[32]基础上经补充修改完成的。

2 案件基本情况

2.1 案情简介

本文报告的是一起民事案件。原告利用自己的手机(OPPO智能手机,R809T型,OS4.2安卓系统,中国移动GSM/TD-SCDMA网络)将其与另一名女性的通话进行了录音(下称检材录音)。检材录音总时长约为 25 min,谈话双方均为女性,讲汉语普通话。检材录音中需要进行身份鉴别的是与原告对话的女性语音(下称检材语音)。原告声称检材语音的说话人是被告(下称说话人A),而被告则声称检材语音的说话人不是她,而是她妹妹(下称说话人B)。

2.2 控辩假设

根据该案情况以及控辩双方的主张,我们采用以下两个互斥的竞争假设:

起诉假设HA:检材语音来自说话人A。

辩护假设HB:检材语音来自说话人B。

案件中的“证据”用E表示,即检材语音的声学特性,其测量方法见声学分析部分。

我们的任务就是计算似然比LR,即证据E在控辩双方假设条件下出现的概率之比,具体而言,就是假设检材语音来自说话人A条件下获得检材语音声学特性的概率与假设检材语音来自说话人B条件下获得检材语音声学特性的概率之比。通过似然比的大小来量化录音证据的价值,即对控方假设或辩方假设的支持强度。LR的计算表达式如下:

3 程序和方法

3.1 样本采集及数据处理

为了与检材语音进行比较,需要采集嫌疑人A和B的语音样本。在法庭说话人识别中,一般在条件允许情况下,建议使用与检材录制的相同设备采集嫌疑人的语音样本,目的是为了减少信道设备差异带来的影响,当然前提是检材语音的录音设备质量较好。该案中,原告、嫌疑人A和B都很配合。法院办案人员使用原告提供的检材录音手机进行了样本采集。在两天之内,法院办案人员分别用该手机拨打两名嫌疑人的电话,通过电话交谈方式,录得两个人的语音样本。因此,检材录音与样本录音在信道、设备、言语风格等方面基本相同,不存在实质性的条件失配。最后,对A、B两人各取样5次,共得到10段录音,每段录音时长为10 min左右。

对检材录音和样本录音进行信号处理。首先,对录音进行格式转换,使用FFmpeg 2.7.2软件[注]FFmpeg 2.7.2:https:∥www.ffmpeg.org/.将全部录音由“.amr”格式转换为“PCM.wav”格式。然后,使用SoundLabeller软件[注]SoundLabeller: http:∥geoff-morrison.net/#SndLbl.对检材录音和样本录音中的目标语音(检材语音、说话人A语音和说话人B语音)进行了音段边界点的人工手动标注。

3.2 声学分析与测量

采用说话人自动识别中的标准测量方法[33],从目标语音信号中提取声学信息,即美尔频率倒谱系数MFCC[34]。共提取了14个MFCC参数及其delta参数,后者是用当前MFCC向量的前两个和后两个MFCC矢量来计算的[35]。

提取MFCC向量时的频率范围为300~3 300 Hz,帧长为20 ms,帧移为10 ms。为避免提取到目标语音以外的额外信号,我们在所标注音段的边界处各保留30 ms,然后取中间段进行特征提取(30 ms可以确保用于计算delta的MFCC向量窗不落在边界之外)。最后,从说话人A的5段样本语音中提取的MFCC向量数在41 742~68 331之间,从说话人B的5段样本语音中提取的MFCC向量数在51 118~82 805之间,从检材语音中提取的MFCC向量数为91 070。

3.3 统计建模

在法庭说话人识别中,标准的建模方法是用MFCC特征向量进行高斯混合模型(GMMs)拟合。GMM通常有512、1 024或2 058个高斯分量,MFCC特征向量有14、28或48维,这取决于是否同时使用delta系数。GMM通常需要较大规模的参数数据进行训练,如果数据有限或规模很小,则估计效果往往很差。此外,即使数据量很大,但是如果与预期模型不符,估计的效果仍会较差。因此,像高斯混合通用背景模型(GMM-UBM)[36]和i-vector模型[37]方法生成的原始结果往往校准较差。而解决的办法则是在后期对单一得分进行校准,即使用第一模型阶段产生的同一话者得分和不同话者得分来训练相对而言所需训练数据量较小的简化模型。例如,作为常用的校准方法,逻辑回归在将得分转换为易于解释的似然比时,只需要两个参数估计值[38-41]。

本案中,辩护假设(备择假设)并非一个非常大的群体,而是某一特定说话人。此外,两个说话人A和B每人只有5段录音可用作训练数据。由于语音数据相对有限,因此我们认为上述两阶段标准方法并不适合本案情形。因此,我们采用了不需要后期校准的简单生成模型。虽然该建模方法可能会有较高偏误,但是我们期望较低的方差可以带来更好的验证性能。

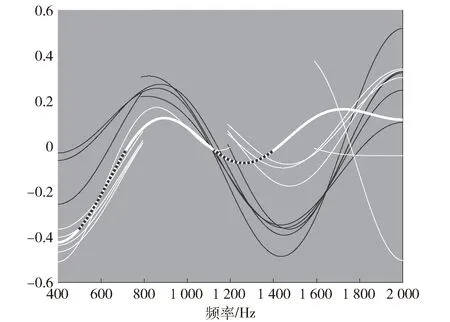

我们最初提取了14个MFCC参数及其delta系数,但是由于可用于训练的录音数量有限,最后仅使用了前4个MFCC参数,用第1~4个MFCC参数(第0个MFCC反映的只是信号的平均强度,因此被舍弃)来量化语音信号的频率分量,并代表其频谱的短时平滑。然后,计算每段语音所有MFCC向量的平均值,这些向量均值是后期所有分析的基础。因为最短的录音段也有41 742个向量(相当于近7 min的纯净语音),所以计算得到的均值应该非常稳定,而每段录音的不同向量数应该不会对系统性能构成影响。图1表示的是说话人A和说话人B的每段语音与检材语音的平滑谱均值(每段录音的所有MFCC向量的平均)。其中,强度轴采用的是对数标尺,没有进行分贝参考值校准。

图1 说话人A的每段语音(黑实线)、说话人B的每段语音(灰实线)和检材语音(虚线)的第1~4个MFCC参数的均值平滑谱

这里需要强调的是,图1只是为了表明所测量的参数特征,本文的分析并不是基于图1的视觉检验,而是根据统计模型的输出结果进行判断。那么,总共基于10个数据点进行模型训练并构成4个维度,相对于可用于训练的数据量而言,即使采用简单模型估计,仍需较大的参数量。为此,我们使用典型线性判别函数[42-43](CLDF)来减维。这些函数通过线性组合训练数据中分类效果最好的原始维数来描记新的维度CLDF。CLDF排名越高,说明不同类之间的差异最大;CLDF排名越低,意味着差异还有其它来源,如统计噪声和录音条件不匹配等。为了计算CLDF值,我们将每个类别构建一个单个高斯模型,全部高斯具有相同的协方差矩阵。对于只有两个类别(说话人A和说话人B)这种情况来说,如果线性分离是最佳的,那么一个CLDF就可以捕捉所有的相关信息。简便起见,我们只使用了第一个CLDF维度。

首先,进行CLDF计算,将说话人A语音中提取的MFCC均值向量编码为一类,将说话人B语音中提取的MFCC均值向量编码为另一类。然后,对所有说话人A的语音、说话人B的语音和检材语音的MFCC均值向量进行CLDF转换。这样,4维的MFCC向量就被投影为1维空间的无量值,即CLDF值。分别计算说话人A和说话人B的CLDF值的算数平均值μA和μB,然后利用说话人A和说话人B的CLDF值进行总体标准差σ的无偏估计。由于进行这些参数估计的可用数据点仍然较少,因此我们没有进行正态分布参数估计,而是利用建立t分布。它与学生t分布[44]一致,唯一不同的是其平均值和标准差不是0和1,而是上面计算得到的μ和σ,见公式(1)。

(1)

其中,Γ是伽玛函数,x是CLDF值,ν是计算标准差的自由度。由于合并标准差是使用两个说话人的数据计算的,因此自由度是说话人A的录音段数与说话人B的录音段数之和再减去分类数,即ν=5+5-2=8。

与高斯分布相比,训练数据较少的t分布峰高较低,尾巴较宽。由此产生的说话人A的概率密度模型(以下称模型A,MA)和说话人B的概率密度模型(以下称模型B,MB)见图2。其中,圆圈代表说话人A的每段语音的CLDF值,三角代表说话人B的每段语音的CLDF值,“×”字代表检材语音的CLDF值。检材语音的似然比为其CLDF值所对应的说话人A曲线与说话人B曲线的相对高度(相对概率)。

图2 说话人A(右侧曲线)和说话人B(左侧曲线)的概率密度函数模型

计算似然比之前,先要计算检材语音的CLDF值所对应的模型A的似然值(概率密度)和模型B的似然值(见图2),前者与后者的比值就是似然比。对数似然比的计算表达式见公式(2)。其中,l(M,x)是CLDF值为x时所对应模型M的似然值。

log(LR)=log(l(MA,x))-log(l(MB,x))

(2)

注意,这里采用的统计建模方法只有在检材语音和样本语音录音条件基本匹配的情况下才适用,即录制设备、信道和言语风格基本一致。如果录音信道不同,MFCC特征参数受其影响会产生变化,从而影响最终结果。一般说来,如果说话人A的语音与检材语音信道相同,而说话人B的语音为不同信道录音,那么计算结果将偏向于说话人A。作为一个主观先验问题,由于该案在采集所有语音样本时采用的是与检材基本相同的录音条件,因此可以认为录音条件不存在实质性的不匹配问题。此外,我们没有采用倒谱均值减法或特征弯折等特征失配补偿技术,因为如果录音条件基本匹配情况下,使用这样的技术反而会减弱说话人信息,使得系统的性能更差[45]。

3.4 系统性能测试

在计算检材语音的似然比之前,我们通过留一法对分析系统的准确性进行了交叉验证。该测试评估方法与前面叙述的方法相同,唯一不同的是测试时使用的不是检材语音,而是样本语音。每次从训练数据中抽取一段样本语音,用它来代替检材语音进行比较。这样,依次从说话人A的5段语音和说话人B的5段语音中抽取一段语音进行测试,得到来自说话人A语音测试和说话人B语音测试的各5个对数似然比。由于每次有一个数据点被抽出用于测试,因此剩下的训练数据点就只有9个,这样自由度ν也就由8减为7。

在计算检材语音的似然比之前,我们还对分析系统的可靠性进行了测试评估。这里我们考虑的主要问题是,训练数据较少可能会造成统计建模的不精确。我们采用多变量正态分布的Monte Carlo仿真法进行系统的可靠性评估。将说话人A和说话人B的全部MFCC均值向量的经验总均值和协方差矩阵用作伪随机数发生器中的参数值,这样,全部样本录音(说话人A的5段录音和说话人B的5段录音)的MFCC均值向量共产生1 000个模拟向量组。如前所述,每组数据用于训练一个CLDF及其在CLDF维上的t分布。分别利用说话人A的5个原始CLDF值和说话人B的5个原始CLDF值计算每个CLDF值对应的对数似然比。这样,就产生了10组(每组1 000个)对数似然比。将每组的各个值减去其中位数后再乘以其中位符,这样,正负值就代表与参考值logLR=0的偏离程度。将全部10组值合并排序,这些值的分位数就作为评估系统可靠性的量度指标。

因此,计算检材语音似然比同时,还要计算检材语音的CLDF值的10 000个似然比,通过重复Monte Carlo仿真过程来评估该似然比值的可靠性。

4 结果与讨论

系统准确性的测试结果表明:对数似然比代价函数Cllr值[46]很低,为0.003,说明系统的准确性非常好。基于Monte Carlo仿真的系统可靠性测试结果表明:95%的值分布在相对中数-2.35~+2.85个量级之间,说明系统的可靠性相对较差。

计算得到证据强度LR的最佳估计值为1/58 562,即假设检材语音来自说话人B条件下获得其声学特性的概率与假设检材语音,来自说话人A条件下获得其声学特性的概率之比约为60 000。根据系统的可靠性验证结果,我们可以90%肯定证据强度LR至少约为7 000(确切值为7 036),99%肯定证据强度LR至少约为60(确切值为58)。

该结果的逻辑含义就是:基于该似然比数据结果,不管事实裁定者之前认为检材语音来源于A与来源于B的相对概率(先验比)是多少,现在他们应该将其乘以1/60 000(简便起见,取整)来更新自己的信念(后验比)。其计算表达式(贝叶斯定理)见公式(3)。

(3)

先验比×似然比=后验比

也就是说,基于该似然比数据结果,如果之前事实裁定者认为检材语音来自A的概率与来自B的概率相等(先验比=1/1),现在其更新信念(后验比)应该为:1/1×1/60 000=1/60 000,即检材语音来自B的概率是来自A的概率的60 000倍。如果之前事实裁定者认为检材语音来自A的概率是来自B的概率的2倍(先验比=2/1),现在其更新信念应该为:2/1×1/60 000=2/60 000=1/30 000,即检材语音来自B的概率是来自A的概率的30 000倍。反过来,如果之前事实裁定者认为检材语音来自A的概率是来自B的概率的一半(先验比=1/2),现在其更新信念应该为:1/2×1/60 000=1/(2×60 000)=1/120 000,即检材语音来自B的概率是来自A的概率的120 000倍。

这里提出的先验比及其计算方法只是为了举例说明似然比的逻辑原理。就事实裁定者而言,其关于两个竞争假设的先验信念就是其先验比。事实裁定者的先验比反映的是语音证据报告提出之前的信念,它来源于对案件的事实认知、逻辑推理以及其他证据的证明情况,与我们的举例(1/1、2/1、1/2)可能完全不同。另外,上述后验比的计算例证也只是为了阐明似然比应用的常规逻辑,事实裁定者最终将基于适当的法律推理来采信鉴定人员提供的证据强度。

当然,事实裁定者在遵循似然比框架的常规逻辑时,保守起见,可以不使用最佳估计值58 562,而是使用一个更接近于1的值。因此,如果使用第一个百分位数58,则代表非常高的保守度;如果使用第10个百分位数7 036,则应该是合理妥协。

该案中仅用了10段录音的训练集,结果得到了5个数量级之高的似然比,分析其原因,其实也显而易见。从图1可以看出,说话人A与B的MFCC平滑谱相对分离,而检材语音的平滑谱基本上位于说话人A的频谱分布中心区域。从图2也可以看出,说话人A和B在CLDF空间基本上完全分离,而检材语音的CLDF值非常接近说话人B的分布中心。然而,需要再次强调的是,本文的分析结果并非基于图1、图2的视觉检验,而是基于统计模型的计算输出。

然而,基于统计原理,每人5段录音的少量训练数据难以支持几万大的似然比值。为此,Morrison和Poh[47]对本案数据做了进一步的统计处理,利用正则化逻辑回归方法,将似然比的计算值向1缩减(正则化权重为5),以此来弥补数据量较少的影响。数据量越小,似然比值向1缩减得越多。但是,他们在结论中也提到这可能会导致缩减程度超过预期。这里我们使用了较小的正则化权重1,这样结果就不会缩减太多。交叉验证测试的结果见表1。

表1 t分布方法和逻辑回归方法交叉验证的似然比值

注意,表1中利用逻辑回归方法得到的LR值比利用t分布方法得到的LR值更接近于1。利用正则化逻辑回归方法计算得到的检材语音的LR值为1/21,即假设检材语音来自说话人B条件下获得其声学特性的概率与假设检材语音来自说话人A条件下获得其声学特性的概率之比为21。尽管正则化逻辑回归方法得到的证据强度更为保守,但是两种方法的结论指向始终都是一致的。

5 结论

本文采用法庭语音证据评价的新范式对一起法庭说话人识别案例进行了实证研究,利用相关数据、定量测量和统计模型计算似然比,量化评估证据强度,同时基于被检案件条件进行系统的验证测试。该案鉴定报告中,我们提供给法庭的分析结果不仅包括表明证据强度的似然比值,还包括系统验证的准确性和可靠性测试结果。统计处理时需要考虑数据量大小对统计结果的影响,训练数据较少时可以考虑使用正则逻辑回归等方法,合理缩减似然比结果。该研究表明:似然比框架可以用于法庭语音证据的评价,其结果也可以在反映案件实际条件下进行验证。

采用新范式进行法庭说话人识别实证检验,并将结果体现在鉴定报告中提交法庭,这在国内应属首次。然而,为了与公安部与司法部颁布规范保持一致,我们的检验报告中还包括了传统的听觉分析和声学- 语音学分析结果。最后,按照规范中鉴定意见的5种分类(认定/倾向认定/无法判定/倾向否定/否定),我们给出的鉴定意见是“排除”A,“认定”B,即检材语音不是来自说话人A,而是来自说话人B。

采用新范式进行语音证据量化评价是法庭说话人识别技术的进步,也符合国际上对于法庭科学的科学性和客观性标准及要求。然而,要让司法鉴定管理部门、法院以及司法鉴定从业者接受新的范式,并最终应用于中国的司法实践,我们还有很多基础工作要做,如大规模相关背景人群语音数据库的建设等。此外,将听觉分析、声学分析与统计分析相结合,实现人工专家分析与自动分析的优势互补,也是未来的发展方向。