基于GIST特征和条件判定的视频镜头分割算法

2018-05-28仝小敏戴永恒

吉 祥, 王 源, 仝小敏, 戴永恒, 李 鑫

(中国电子科学研究院,北京 100041)

0 引 言

随着互联网和数码技术的飞速发展,特别是移动智能手机和平板电脑的普及使得视频数量呈现爆炸式的增长,如何对视频进行有效的处理是计算机视觉领域的研究热点[1],也是军事、反恐、物联网、搜索引擎等领域的研究重点[2]。其中,视频镜头分割是视频处理中的基础问题,其目的是为了找到镜头边界即切变帧和渐变帧,从而将视频分割为不同的镜头,该问题的有效解决将为后续的视频关键帧提取、特征提取、视频摘要、浓缩、检索等处理提供了强有力的保障[3]。

为了解决镜头分割问题,很多学者提出了镜头分割算法,主要分为两类,一类为基于统计信息的方法[4-5],主要包括像素帧差法、直方图帧差法等;第二类基于图像特征信息[6],主要包括基于颜色矩特征的方法等。这些方法从不同的角度来识别渐变镜头和突变镜头,最终将视频分割为独立的镜头。

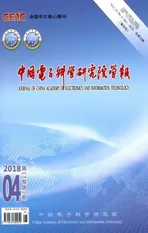

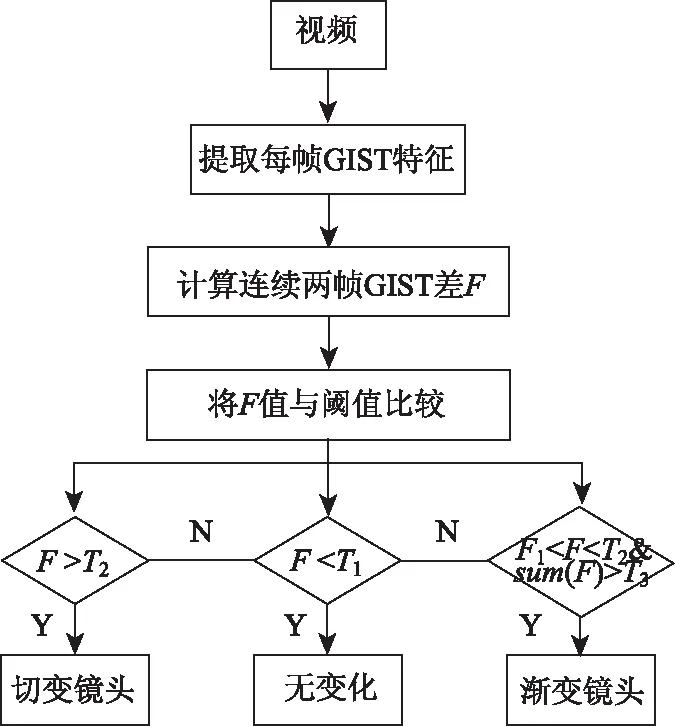

然而,在视频中往往会出现物体/镜头移动和光线变化等情况,这些因素具有与镜头切换相似的特征,会影响到镜头分割的准确率。为了提高镜头分割的准确率,本文提出了一种基于GIST特征和条件判定的镜头分割方法,算法流程如图1所示,首先,提取每个视频的GIST特征;其次,对每个视频的前后邻近帧计算GIST特征差,并构建双阈值判定条件初步筛选出切变帧和渐变帧;第三,对筛选出来的候选帧进行基于SIFT特征的匹配判定,判断候选帧前后一定距离的两帧是否能够匹配,若匹配,则说明候选帧前后无镜头变化,该候选帧不是镜头边界,若不匹配,说明候选帧前后的画面发生了很大的变化,该候选帧处为镜头边界。本文算法在国际公开的视频数据集OPENVIDEO数据库上进行了测试,得到了比传统方法更好的镜头分割结果。

图1 本文算法流程

1 基于GIST和条件判定的镜头分割算法

为了提升视频镜头分割的准确率,本文提出的镜头分割算法主要包括三部分,第一部分是提取视频的GIST特征,利用GIST特征对视频进行分割;第二部分利用视频前后帧的GIST特征差和双阈值判定条件,初步得到切变帧和渐变帧作为候选帧;第三部分,对候选者附近帧进行SIFT特征匹配,若匹配则说明候选帧前后无变化,该候选帧不是镜头边界,反之,则保留该候选帧作为镜头分割边界。下面将分节对以上三部分进行阐述。

1.1 视频GIST特征提取

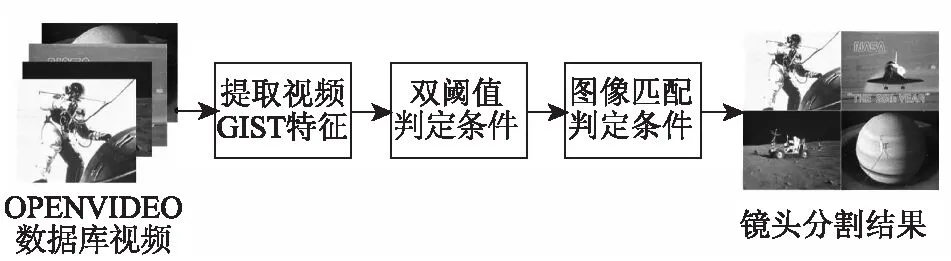

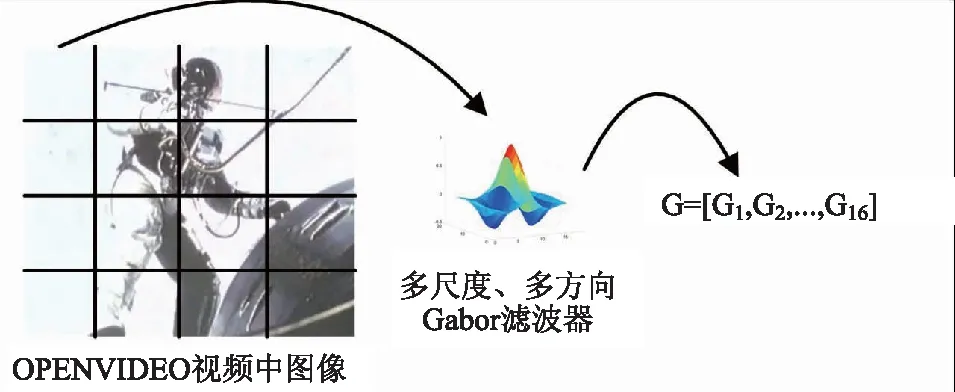

GIST特征[7]是一种描述图像空间包络的特征,该特征旨在描述图像中场景中的摘要、要点,并以此对图像进行识别。GIST特征认为不同种类的物体或者图像具有不同的空间包络或者轮廓信息,如图2中所示,高层建筑和高速公路的空间包络不同,其表面表达也不同,图中的3D曲面表示图像强度。GIST特征通过对图像进行多尺度多方向的Gabor滤波得到,如图3所示。

图2 拥有不同空间包络的图像及其表面表达

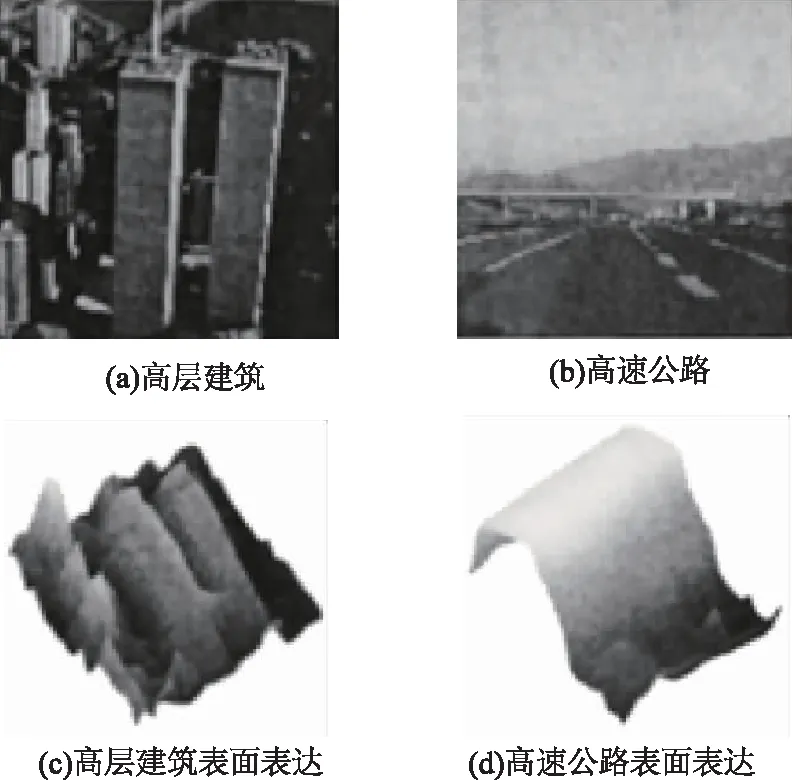

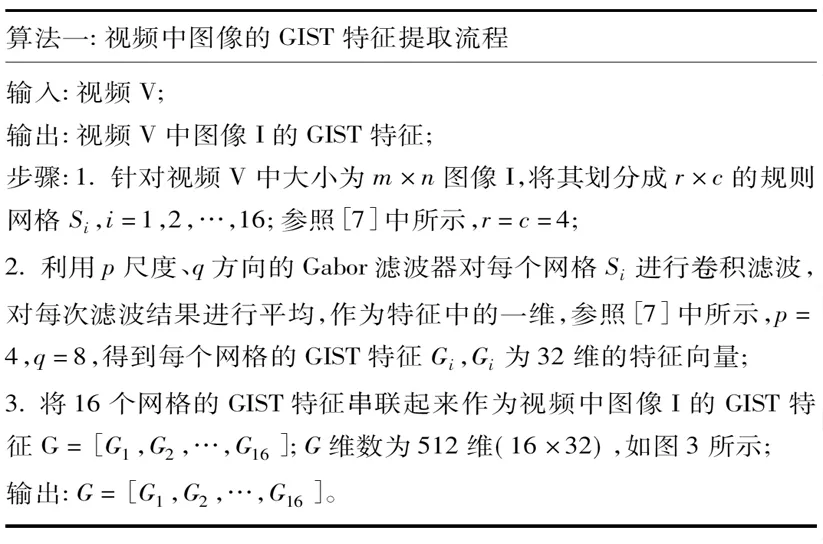

GIST算法流程如下:

算法一:视频中图像的GIST特征提取流程输入:视频V;输出:视频V中图像I的GIST特征;步骤:1.针对视频V中大小为m×n图像I,将其划分成r×c的规则网格Si,i=1,2,…,16;参照[7]中所示,r=c=4;2.利用p尺度、q方向的Gabor滤波器对每个网格Si进行卷积滤波,对每次滤波结果进行平均,作为特征中的一维,参照[7]中所示,p=4,q=8,得到每个网格的GIST特征Gi,Gi为32维的特征向量;3.将16个网格的GIST特征串联起来作为视频中图像I的GIST特征G=[G1,G2,…,G16];G维数为512维(16×32),如图3所示;输出:G=[G1,G2,…,G16]。

图3 GIST特征提取示意图

GIST算法中Gabor滤波器可对物体轮廓、纹理进行很好的保留[8],实质是利用Gabor滤波器对图像进行卷积滤波,对纹理进行凸显,对非纹理进行抑制,其二维表达公式为:

cos(2πfx+φ)

(1)

其中,(x,y)是像素点的坐标。σx、σy为高斯函数沿x轴和y轴的高斯包络线常数。f表示滤波器中心频率,φ是谐波因子的相位差。

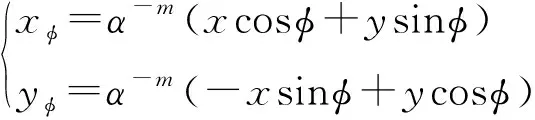

在GIST特征计算中,利用多尺度、多方向的Gabor滤波器对图像进行滤波,该多尺度、多方向的Gabor滤波器可表示如下:

hp,q(xφ,yφ)=α-mhp,q(xφ,yφ)

(2)

φ=qπ/(p+1)

式中,φ是滤波方向;p表示滤波尺度数;q表示滤波方向数;α-m表示母小波膨胀的尺度因子。

通过多尺度、多方向的Gabor卷积滤波,我们可以得到视频中每个图像的GIST特征,这些特征将被用来进行双阈值帧差,以便得到视频镜头的初步分割结果。

1.2 双阈值判定条件

利用上节得到的GIST特征,本节将采用双阈值帧差法来区分出切变帧和渐变帧,算法流程为:首先,对视频的每帧计算GIST特征;其次,计算连续两帧的GIST差值,若差值大于阈值T1,则说明后一帧发生了切变;若差值小于阈值T2,说明没有发生镜头切换;若差值大于T2并且小于T1,则继续统计后续帧的GIST特征差值,并将GIST差值进行累计,如果累计和大于T3,则判定为渐变帧。双阈值帧差法流程图如图4所示。

图4 双阈值判定条件

1.3 图像匹配判定条件

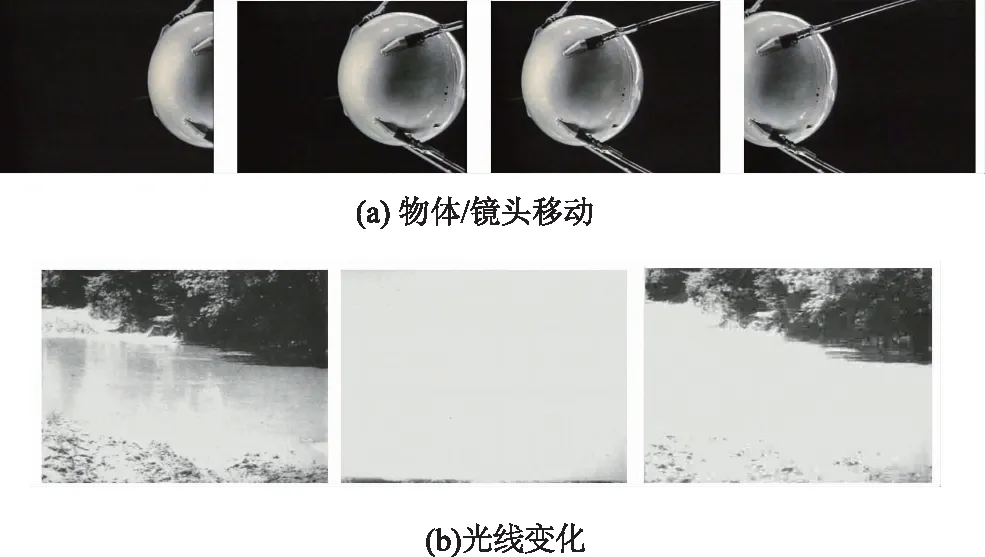

视频经过双阈值帧差法的处理后,可以得到很多的候选镜头边界,其中由于突变帧的内容变化剧烈,经过双阈值检测后已经得到较好的结果,不需进行进一步去噪,但是有些物/镜移动的画面可能被误认为是镜头发生了变化,如图5(a)所示,其次,一些光线变化的画面可能被认定为镜头变化,如图5(b),这些情况都给视频镜头的分割带来了误差,特别是渐变帧的检测容易受到噪声的影响,因此,针对候选渐变帧,我们构造了基于SIFT[9-11]特征的匹配条件来去除这些噪声的影响,提高镜头分割的准确率。下面对基于SIFT特征的图像匹配方法进行介绍:

图5 镜头分割中的噪声

(1)对上节得到的渐变帧候选帧I,分别得到其前15帧的图像I1和距离I后15帧的图像I2;

(2)分别计算I1和I2的SIFT特征;SIFT特征用于提取图像中的特征点,这些特征点不易受到光线干扰、形变影响,被用来判定两张图像中的景物是否匹配,从而判定I1和I2是否真的发生了渐变,若I1和I2有匹配上的特征点,则说明I1和I2中有相同的景物,I为伪渐变帧;反之,若I1和I2没有匹配上的特征点,则说明I1和I2中的景物已经发生了变化,I为渐变帧;

(3)对伪渐变帧进行剔除,将其余的渐变帧和变化帧作为本文算法得到的镜头分割结果。

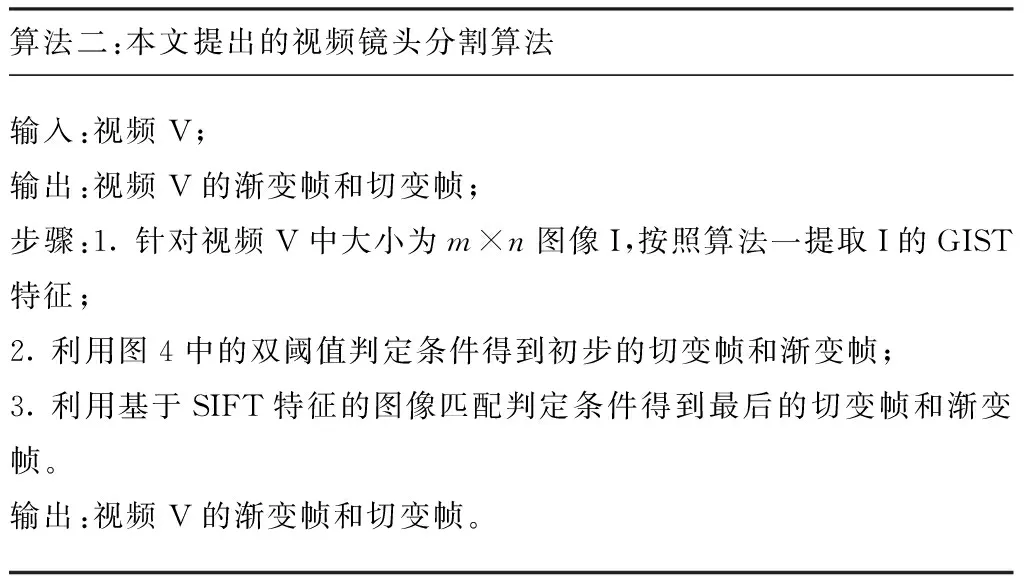

1.4 本文算法流程

本节将对提出的算法进行总结,得到本文的算法实施流程,如下表所示:

算法二:本文提出的视频镜头分割算法输入:视频V;输出:视频V的渐变帧和切变帧;步骤:1.针对视频V中大小为m×n图像I,按照算法一提取I的GIST特征;2.利用图4中的双阈值判定条件得到初步的切变帧和渐变帧;3.利用基于SIFT特征的图像匹配判定条件得到最后的切变帧和渐变帧。输出:视频V的渐变帧和切变帧。

2 实验结果和对比

2.1 实验数据

本文在OPENVIDEO数据库上进行测试,OPENVIDEO数据库在视频处理测试中有广泛的应用,包含航天、教学等多类视频。本文用于测试的视频包含航天、教学、讲演、历史和公共服务五类,每类包含4个视频,共20个视频。视频中除了包含渐变和切变镜头外,还具有物体/镜头移动(如图5(a)所示)、光线突变(如图5(b)所示)等。我们对20个视频中的切边帧和渐变帧进行了人工标注作为真值。切变帧和渐变帧标注是以发生时间点进行标注的,即切变帧和渐变帧发生在视频中的具体时间点,精确到秒。

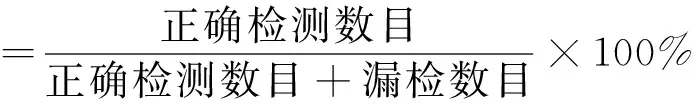

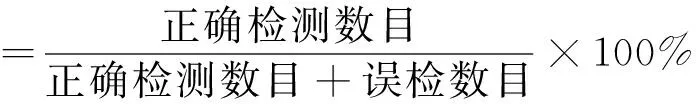

2.2 评价指标

评价指标采用图像处理中常用的查全率和查准率衡量。表示如下:

(3)

(4)

由于在视频的镜头分割中既需要检测出切变镜头,又需要检测出渐变镜头,所以在评价中这两类镜头类型将分别计算查全率和查准率。

2.3 实验结果

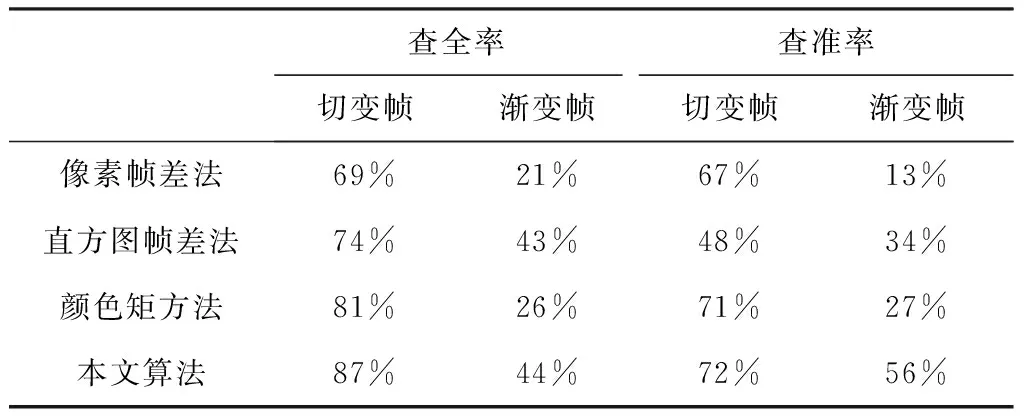

我们将OPENVIDEO中的视频利用本文的算法进行了镜头分割,分别找出视频中的切边帧和渐变帧,本文中视频镜头分割结果输出为切变帧或者渐变帧的发生时间,计算方法如下:通过基于GIST特征和条件判定首先计算出切变帧和渐变帧在视频中的位置,即属于该视频的第几帧;然后,根据视频帧率和切变帧和渐变帧位置(第几帧)算出该帧发生在视频的具体时间,精确到秒;最后,将计算得到的切变帧时间和渐变帧时间与真值,即人工标注时间进行比对,通过查全率和查准率(如2.2节中所述)计算镜头分割的准确率,将每个视频的查全率和查准率进行平均,得出20个测试视频的平均查全率和平均查准率。此外,为了对比本文算法的准确率,我们分别计算了传统的像素帧差法、直方图帧差法和基于颜色矩的镜头检测方法在该20个测试视频上的平均查全率和平均查准率。结果如表1所示。从表中可以看出,本文提出的算法无论在查全率还是在查准率上都高于其余方法,显示了本文算法的优越性。

表1 视频镜头分割准确率比较

3 结 语

本文研究目的是为了计算视频中的切变帧和渐变帧,实现视频镜头的分割,为后续的关键帧提取、视频特征提取、视频摘要等应用提供基础,是视频处理中的一个重要环节。本文提出了一种基于GIST特征和条件判定的视频镜头分割算法,该算法首先提取了视频中图像的GIST特征,然后利用双阈值判定条件和GIST特征来得到初步的切变帧和渐变帧,最后利用基于SIFT特征的图像匹配来筛选候选帧,该匹配的作用是为了判断某帧前后一定距离内的帧是否具有显著差别,若有显著差别,则前后一定距离内的帧不匹配,说明该处为渐变帧,即前后的镜头内容发生了变化;若没有显著差别,即匹配,则说明该处不是渐变帧,从而判定得到最后的镜头分割位置,在OPENVIDEO数据库上的对比结果显示了本文方法的优越性。

:

[1] J. Han, X. Ji, X. Hu, et al. Representing and retrieving video shots in human-centric brain imaging space[J].IEEE Transactions on Image Processing. 2013, 22(7):2723-2736.

[2] 朱方, 吴莉, 陈飞凌, 袁卫忠. 智能视频监控终端在物联网中的应用和发展研究[J].中国电子科学研究院学报, 2011,6(6):561-566.

[3] 刘浏. 基于内容的重排列视频检索技术研究[D]. 上海:上海交通大学, 2013年.

[4] T. Kikukawa and S. Kawafuchi, Development of an automatic summary editing system for the audio-visual resources[J]. Transactions on Electronics and Information. 1992.75:204-212.

[5] H. Zhang, K. Atreyi, W. Stephen. Automatic partitioning of full-motion video[J]. Multimedia Systems, 1993, 1(1):10-28.

[6] M. Stricker, M. Orengo. Similarity of color images[C]. In SPIE Conference on Storage and Retrieval for Image and Video Databases III, 1995,2420: 381-392.

[7] A. Oliva, A. Torralba. Modeling the Shape of the Scene: A Holistic Representation of the Spatial Envelope[J]. International Journal of Computer Vision. 2001, 42(3): 145-173.

[8] 吉祥,郭雷,陈大海等. 指纹亚像素频率的滤波[J]. 计算机工程与应用.2011,47(12):177-179.

[9] D. Lowe. Distinctive image features from scale-invariant keypoints[J]. International Journal of Computer Vision, 2004,60(2): 91-110.

[10] D. Lowe. Local feature view clustering for 3D object recognition[C]. IEEE Conference on Computer Vision and Pattern Recognition, 2001:682-688.

[11] D. Lowe. Object recognition from local scale-invariant features[C]. International Conference on Computer Vision. 1999:1150-1157.