用对数函数描述收敛因子的改进灰狼优化算法及其应用

2018-05-17伍铁斌桂卫华阳春华龙文李勇刚朱红求

伍铁斌,桂卫华,阳春华,龙文,李勇刚,朱红求

用对数函数描述收敛因子的改进灰狼优化算法及其应用

伍铁斌1, 2,桂卫华1,阳春华1,龙文3,李勇刚1,朱红求1

(1. 中南大学 信息科学与工程学院,湖南 长沙,410083;2. 湖南人文科技学院 能源与机电工程学院,湖南 娄底,417000;3. 贵州财经大学 贵州省经济系统仿真重点实验室,贵州 贵阳,550025)

针对灰狼优化(grey wolf optimization, GWO)算法在求解复杂高维优化问题时存在解精度低、易陷入局部最优等缺点,提出一种基于对数函数描述收敛因子的改进GWO算法。采用佳点集方法初始化种群以保证个体尽可能均匀地分布在搜索空间中;提出一种基于对数函数描述的非线性收敛因子替代线性递减收敛因子,以协调算法的勘探和开采能力;对当前最优的3个个体执行改进的精英反向学习策略产生精英反向个体,以避免算法出现早熟收敛。研究结果表明改进算法具有较好的寻优性能。

灰狼优化算法;对数函数;收敛因子

群体智能算法可以求解目标函数(或约束)不连续或不可微的优化问题,得到了越来越多的研究与应 用[1]。典型的群体智能算法主要有微粒群算法[2]、遗传算法[3]、差分进化算法(differential evolution, DE)[4],近年来一些学者又提出了布谷鸟算法[5]、蝙蝠算法[6]和灰狼优化算法(grey wolf optimization, GWO)[7]等新的智能算法。GWO是受灰狼群体等级制度和狼群跟踪、包围、追捕与攻击猎物的捕食行为启发而提出的智能算法,求解精度和收敛速度均优于微粒群算法、差分进化算法和引力搜索算法[7]。GWO算法已经应用于多级阈值图像分割[8]、电力潮流优化[9]、水量分配[10]、PID控制参数优化[11]、无人机路径规划[12]等众多领域。然而,GWO算法与其他群体智能优化算法一样,存在求解精度低、易出现早熟收敛等缺点,因此,许多研究者对GWO算法进行了改进,如SAREMI等[13]将动态进化种群技术与GWO相结合,仿真结果表明改进后的GWO算法的全局寻优能力得到提高;龙文 等[14]利用混沌的方法产生GWO的初始种群以保持个体多样性,并引入反向学习策略,将改进的GWO算法用于求解高维优化问题;徐松金等[15]提出了一种融合遗传算子的改进GWO算法,仿真验证了算法的有效性;徐达宇等[16]构建基于自组织临界优化的改进 GWO 算法,利用标准测试函数验证了算法的全局寻优能力。针对基本GWO算法的缺点,本文作者提出一种改进GWO算法,采用佳点集方法初始化种群个体;基于对数函数对收敛因子公式进行改进,提出一种非线性收敛因子以平衡算法的探索和开发能力,并对当前最好的3个个体狼、狼和狼执行改进的精英反向学习策略产生新个体。利用标准测试函数和针铁矿沉铁过程的参数优化验证改进的GWO算法的有效性。

1 基本灰狼优化算法

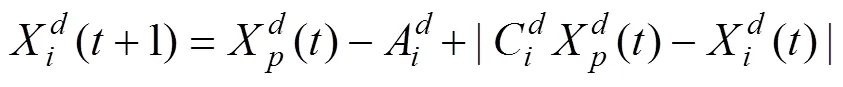

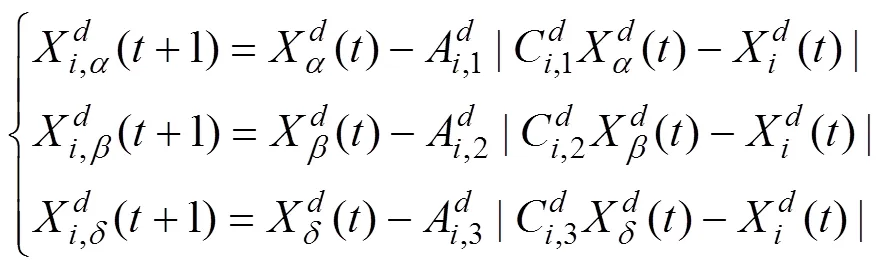

对第只灰狼第维位置,通过下式描述灰狼逐渐接近并包围猎物的行为:

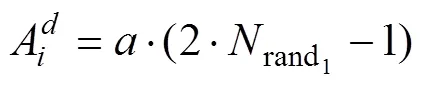

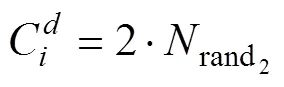

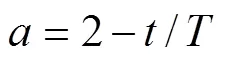

式中:为最大迭代次数。

由2线性递减至0,该参数起到调节算法的全局搜索与局部搜索的作用。

群体中的各个狼根据与,和的位置即,和的距离进行更新:

式中:w=(=,,)为,,的权重系数;=1,2,…,。

式中:(X())为第只灰狼在第代的适应度;(()),(())和(())分别为第代首领狼、副首领狼和普通狼的适应度。GWO算法的伪代码见文献[7]。

2 改进的灰狼优化算法

2.1 佳点集种群初始化

初始种群多样性会影响群体智能算法的全局收敛速度和解的质量,多样性较好的初始种群对提高算法的寻优性能有帮助[17]。然而,标准GWO算法采用随机的方法产生初始种群个体,难以保证初始群体的多样性,会造成算法的寻优效率降低。本文利用佳点集方法[18]产生初始种群,该方法能保证初始种群更均匀地分布在解空间中,实现方法如下。

2.2 基于对数函数的非线性收敛因子

对群体智能优化算法来说,如何协调其勘探能力和开采能力至关重要。勘探意味着群体需要探测更广泛的搜索区域,避免算法陷入局部最优。开采则强调充分利用已有的信息对群体的某些邻域进行密集搜索,对算法的收敛速度具有决定性的影响。勘探和开采类似于全局搜索和局部搜索。毫无疑问,只有当群体智能优化算法能够较好地协调勘探能力和开采能力时,才能具备较强的鲁棒性和较快的收敛速度。

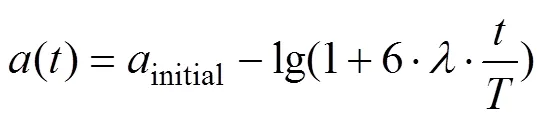

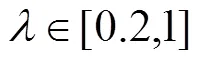

由式(2)可知:当||<1时,灰狼群体将包围圈缩小,攻击并捕获猎物,对应于算法的局部开发能力;当||>1时,灰狼群体将包围圈扩大,探索更好的猎物;在很大程度上取决于收敛因子,即会影响算法的勘探能力和开采能力。由式(4)可知:在进化过程中由2线性递减到0。然而,GWO算法在搜索过程中却是需要非线性变化的,收敛因子线性递减策略不能满足实际的优化搜索过程。受PSO算法中惯性权重设置的启发[19],本文提出一种基于对数函数的非线性收敛因子更新公式,收敛因子在前期选取较大的值以加强算法的全局搜索能力。由于在寻优初期的种群多样性很好,故在寻优前期以较快的速度减小,而在寻优中期以较慢的速度减小,平衡算法的勘探与开采能力。的更新策略为

2.3 改进的精英反向学习策略

在GWO算法的进化后期,所有灰狼个体均向狼逼近(每次迭代保留最优个体),群体多样性变差,收敛速度明显变慢或早熟收敛,这也是群体智能优化算法的固有缺点。由文献[20]可知:精英反向学习策略能较好地扩大群体的搜索范围,探索出新的搜索区域,增强群体的多样性,将其与群体智能优化算法混合,可提高混合算法的全局搜索能力和避免算法陷入局部最优。由GWO算法机理可知:狼为当前群体中的最优个体,群体中其他个体均向其所在区域靠拢,若其为局部最优解,则算法陷入局部最优。因此,本文对当前群体中的最优的3个个体(狼、狼和狼)执行改进的精英反向学习策略以维持群体的多样性,从而加强算法的全局探索能力和避免算法陷入局部最优。

狼群的活性值为

式中:avg为所有狼对应的适应度的平均值(假定适应度都大于0,适应度越大,则个体最优);α为头狼对应的适应度。显然,f越小,即avg与α越接近,表明其他狼都非常接近头狼,反映出狼群的多样性已经很差,也即群体的活性很差,此时,必须取1个较大的值,提高狼群的多样性,保证狼群能有效的跳出局部最优;反之,取1个较小的值。对最优的3个个体(狼、狼和狼)都执行次精英反向学习(为小于等于4的正整数,本文取=2)。

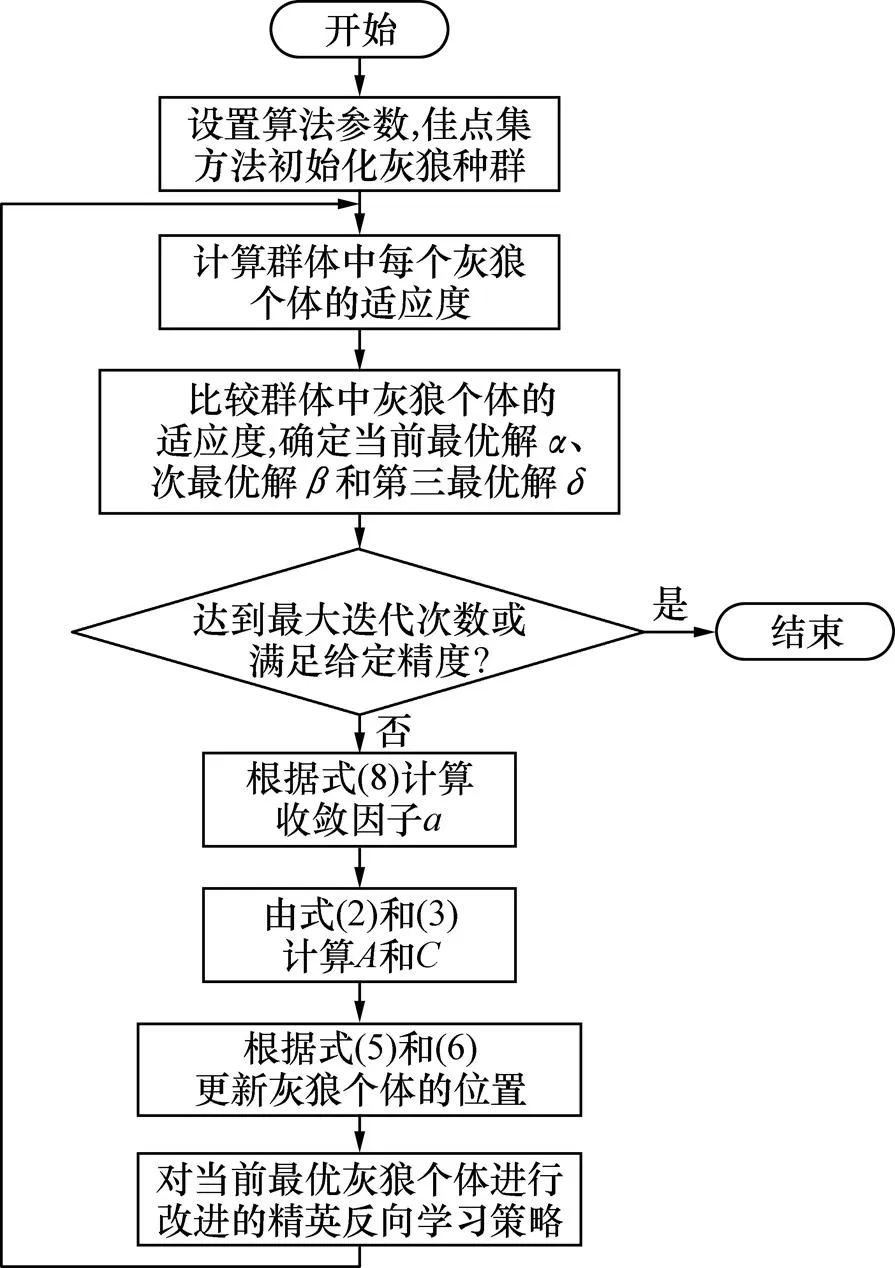

2.4 算法流程图

改进灰狼优化算法(LFGWO)流程图如图1所示。

图1 LFGWO算法流程图

3 实验分析

3.1 测试函数

为了验证本文提出的基于对数函数的改进灰狼优化算法(记为LFGWO)的有效性,从文献[7]中选取8个国际上通用的标准测试函数进行数值实验,8个测试函数的函数名、具体表达式、搜索区间以及收敛精度如表1所示。在8个标准测试函数中,1~5为复杂单峰函数,6~8为复杂多峰函数,8个测试函数的维数均设置为30,8个函数的理论全局最优值均为0。

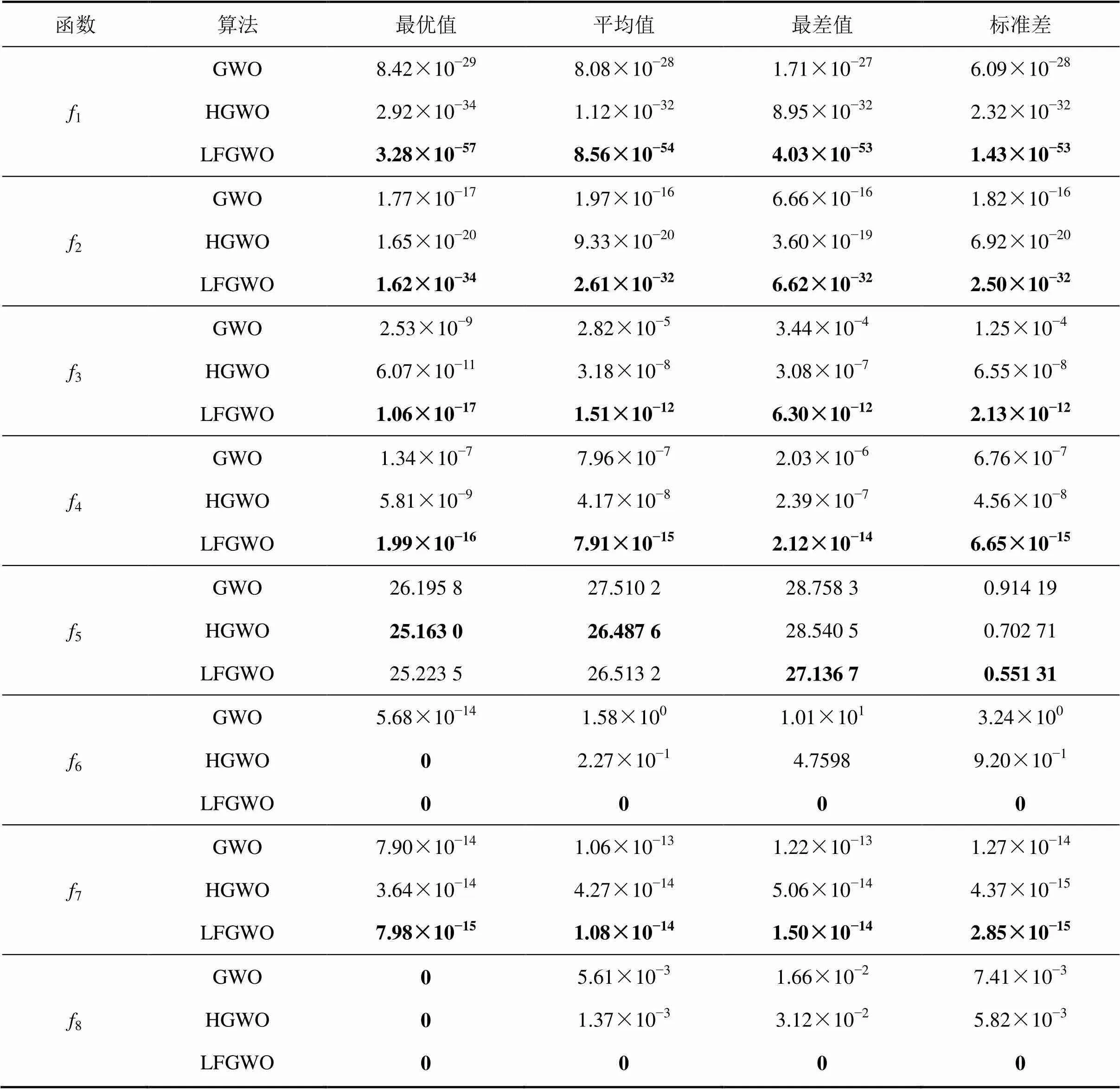

3.2 与GWO和HGWO算法的比较

利用本文提出的LFGWO算法对上述8个标准测试函数进行求解,并与标准GWO算法、hybrid GWO with differential evolution (记为HGWO)[20]算法进行比较。为了比较的公平性,3种算法的参数设置如下:种群规模均设置为=30,最大迭代次数均设置为500,每个函数在上述参数设置下均独立运行30次,并记录其最优值、平均值、最差值和标准差,比较结果如表2所示,其中,HGWO算法的结果直接来源于参考文献[20]。

从表2可以看出:除了Rosenbrock函数以外,LFGWO算法对其他7个标准测试函数30次实验一致地收敛到全局最优解(当收敛精度达到1×10−10时认为算法收敛),与基本GWO算法相比,LFGWO算法寻优性能得到了显著提高。与HGWO算法相比,LFGWO算法在5个函数即Sphere,Schwefel2.22,Schwefel1.2,Schwefel2.21和Ackley函数上取得了较好的寻优结果;对于Rosenbrock函数,LFGWO算法获得了较好的最差值和标准差,而HGWO算法取得了较好的最优值和平均值;对于函数Rastrigin和Griewank,2种算法得到了相似的最优值。

图2所示为基本GWO算法和LFGWO算法对5个函数的寻优收敛曲线。从图2可以看出:与基本GWO算法相比,LFGWO算法具有更快的收敛速度和更高的收敛精度。

3.3 与其他改进群体智能优化算法的比较

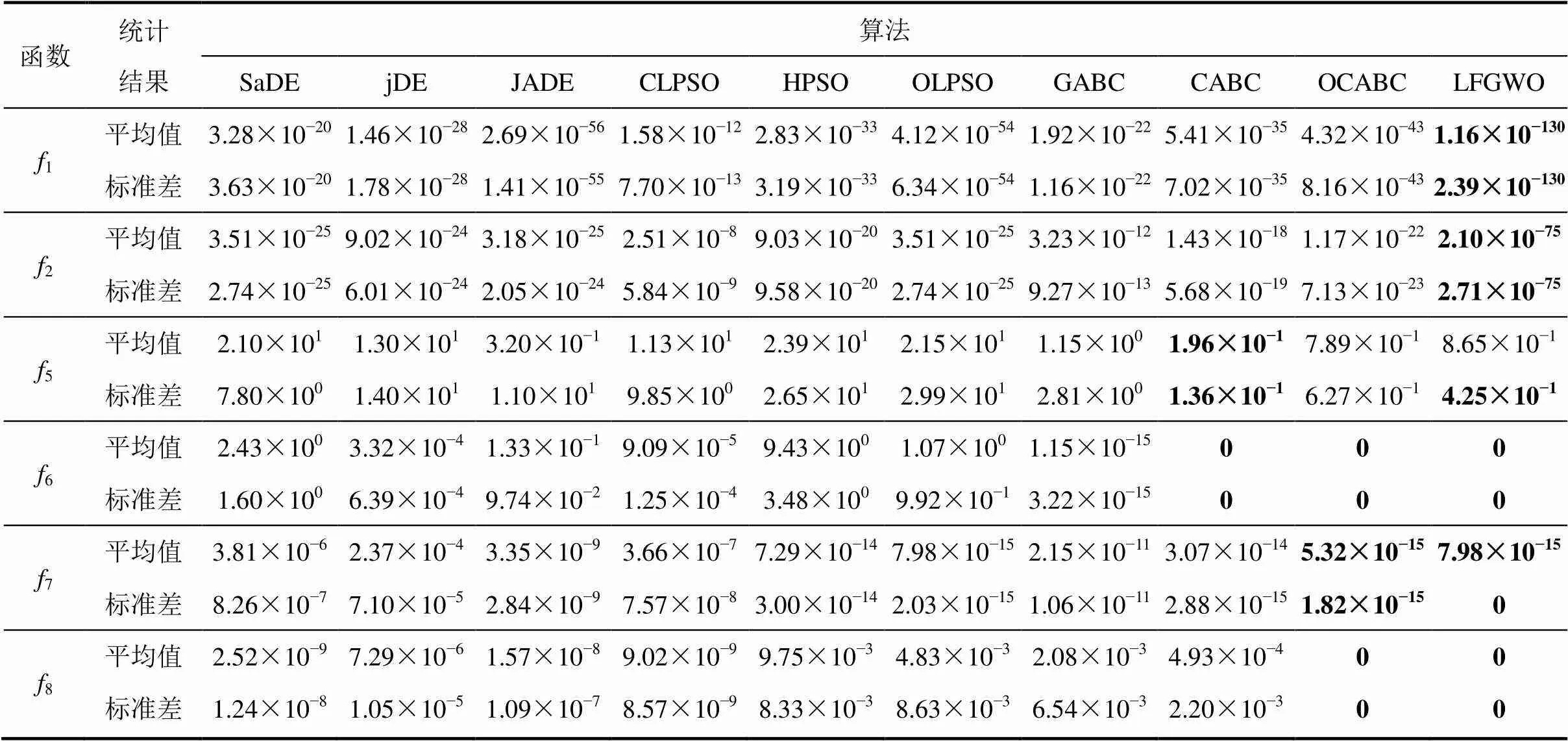

为了进一步说明LFGWO算法的有效性,将其与文献[1]中的9种改进群体智能优化算法进行比较,这9种算法为:SADE,jDE,JADE,CLPSO,HPSO,OLPSO,GABC,CABC和OCABC。为了比较的公平性,LFGWO算法的最大适应度计算次数设置为 50 000次;SADE、jDE和JADE 3种算法的对每个函数设置了不同的适应度计算次数,最少为50 000次,最多为300 000次;CLPSO,HPSO和OCPSO这3种算法的适应度计算次数均设置为150 000次;GABC,CABC和OCABC 3种算法的适应度计算次数均设置为200 000次。LFGWO算法与其他9种算法对6个测试函数(1,2,5,6,7,8)的寻优结果比较如表3所示。为了增加可信度,其他9种算法的结果直接来源于文献[1]。

表1 8个标准测试函数

表2 3种算法对8个函数的寻优结果比较

注:表中黑粗体表示比较算法中的最好结果。

从表3可知:与SaDE,jDE,JADE,CLPSO,HPSO,OLPSO和GABC算法相比,除了Rosenbrock(5)函数外,LFGWO算法在其他5个测试函数上均获得了较好的平均值和标准差。与CABC算法相比,LFGWO算法在4个函数(1,2,7,8)上获得了较好的结果,在函数5上得到了较差的结果,在函数6上取得了相似的结果。与OCABC算法相比,LFGWO算法在2个函数(1,2)上获得了较好的结果,在3个函数(6,7,8)上取得了相似的结果。

图2 GWO和LFGWO对5个函数的寻优收敛曲线

表3 LFGWO算法与其他9种算法对6个函数的结果比较

注:表中黑粗体表示比较算法中的最好结果。

4 工业优化应用

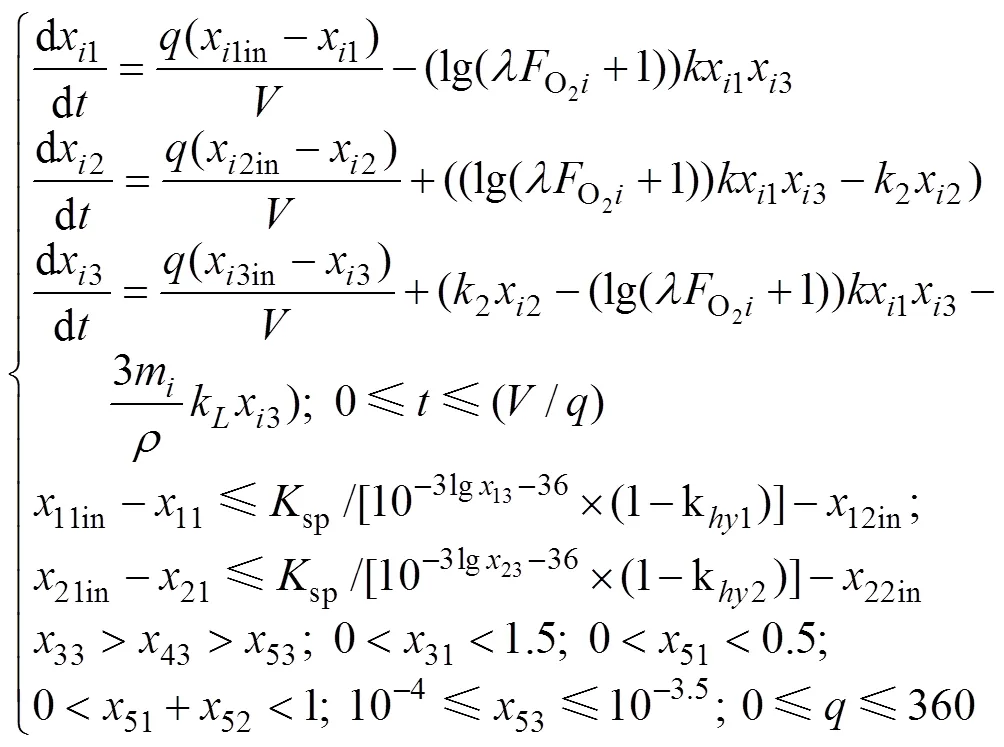

在湿法炼锌生产过程中,必须将浸出的硫酸锌溶液中的铁离子降低至合适范围,针铁矿沉铁法是通过向5个连续的反应器中加入氧气,使溶液中的二价铁离子逐渐氧化为三价铁离子;氧气添加量过多,不容易生成针铁矿的沉淀物。而若氧化速率过慢,则会导致沉铁后的溶液中铁离子浓度超标。为保证良好的针铁矿沉铁环境,通过向各反应器中添加成本低的锌焙砂控制各反应器的pH。文献[21]建立了针铁矿沉铁过程的优化模型:

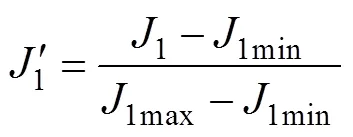

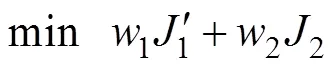

由于1和2的量纲不一样,故对1进行归一化处理:

对目标函数进行加权处理[21],即转换为

式中:1+2=1,在这里取1=0.5,2=0.5。

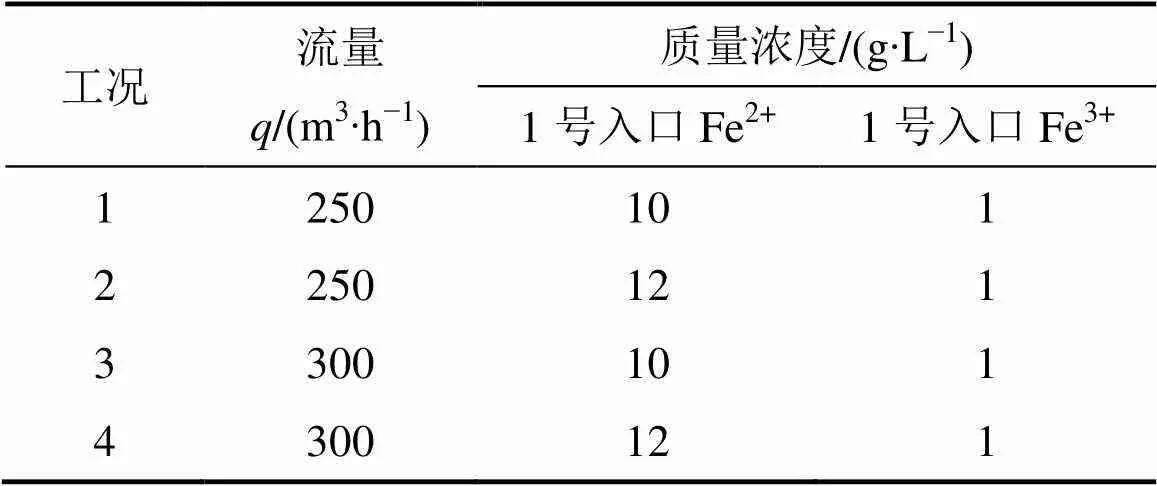

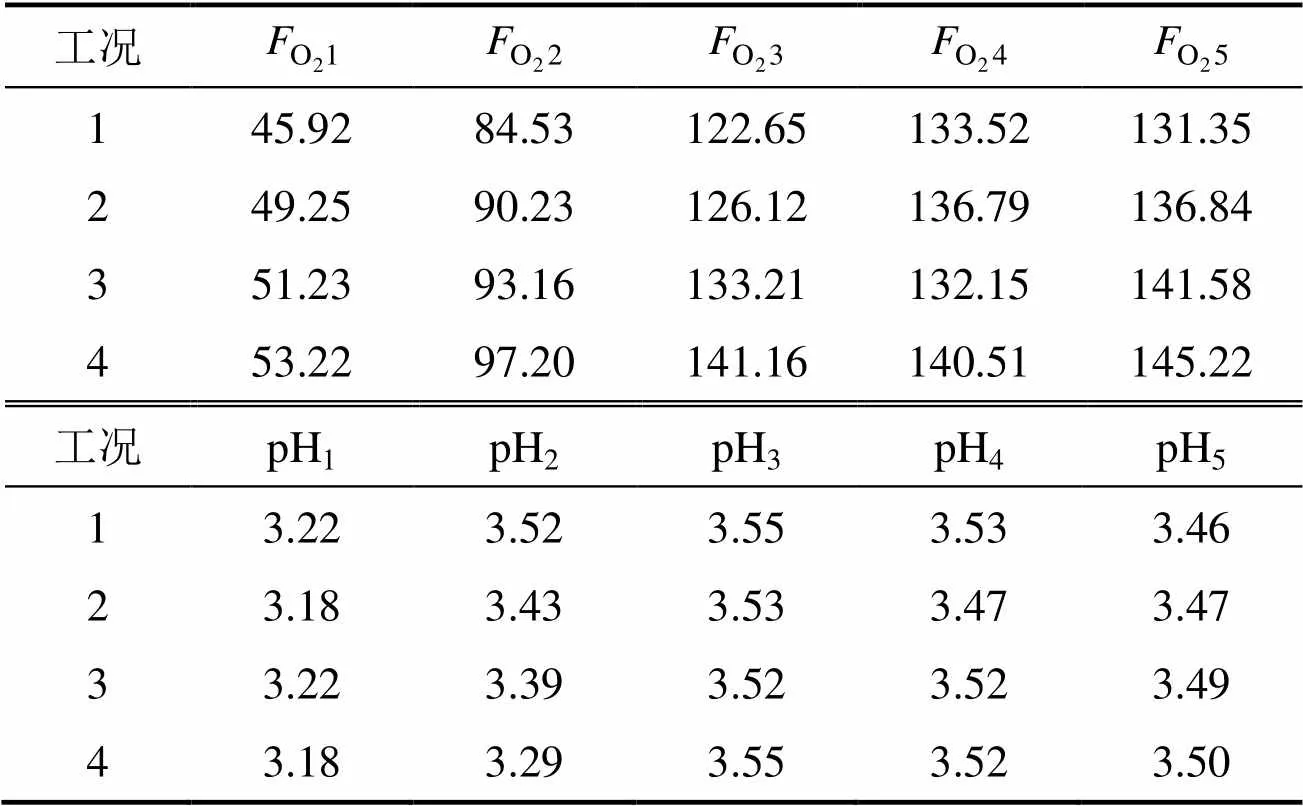

利用本文提出的改进灰狼算法对文献[21]提出的4种典型工况进行寻优,结果如表4所示,氧气添加量的优化值如表5和表6所示。

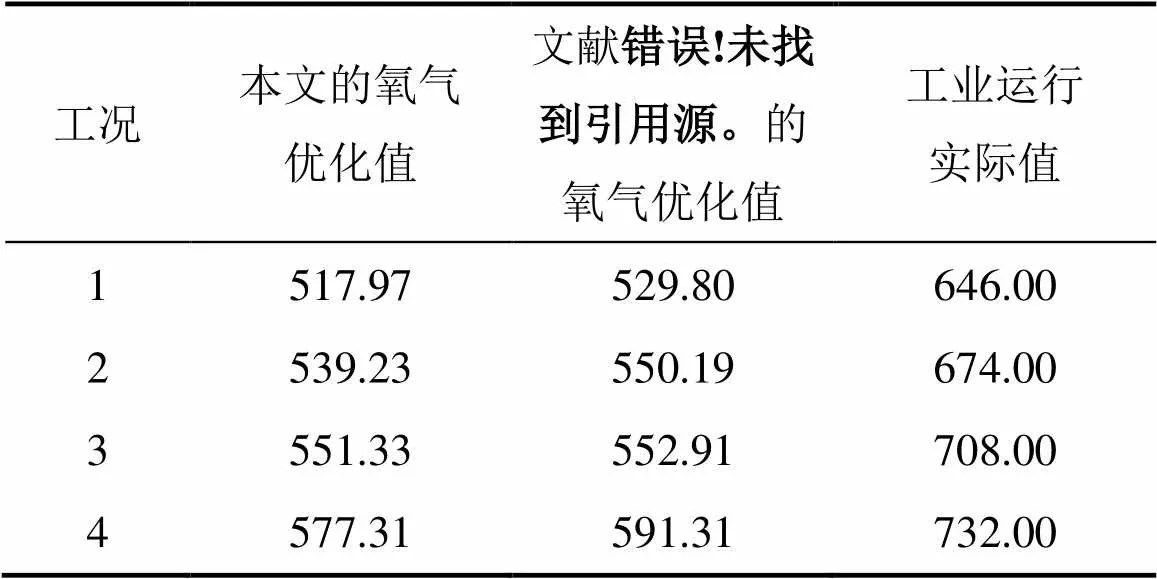

从表6可知:在4种典型针铁矿沉铁工况下,本文提出的改进灰狼算法优化的氧气添加量比实际工业过程的氧气添加量分别减少了19.82%,19.99%,22.12%和21.13%,比文献[21]提出的双种群协同进化算法分别减少氧气1.82%,1.59%,0.22%和1.93%。

表4 针铁矿法沉铁过程典型工况分类表[21]

表5 基于改进灰狼算法的氧气添加量优化结果(10次优化结果的平均值)

表6 氧气消耗量比较

5 结论

1) 利用佳点集方法产生初始狼群个体,采用对数函数描述收敛因子以平衡灰狼算法的探索和开发能力,对当前最好的3个灰狼个体执行改进的精英反向学习策略产生反向精英个体,以避免算法出现早熟 收敛。

2) 与其他群体智能优化算法相比,改进的GWO算法更具有竞争力。针铁矿沉铁工业过程参数优化仿真结果表明,改进的灰狼算法能适应复杂工业过程的参数优化。

[1] GAO W, LIU S, HUANG L. A novel artificial bee colony algorithm based on modified search equation and orthogonal learning[J]. IEEE Transactions on Cybernetics, 2013, 43(3): 1011−1024.

[2] DANESHYARI M, YEN G G. Constrained multiple-swarm particle swarm optimization within a cultural framework[J]. IEEE Transactions on Systems, Man, and Cybernetics: Part A, 2012, 42(2): 475−490.

[3] SURRY P D, RADCLIFFE N J. The COMOGA method: constrained optimization by multiobjective genetic algorithm[J]. Control and Cybernetics, 1997, 26(3): 391−412.

[4] SARKER R, ELSAYED S, RAY T. Differential evolution with dynamic parameters selection for optimization problems[J]. IEEE Trans Evol Comput, 2014, 18(5): 689−707.

[5] YANG Xinshe, DEB S. Cuckoo search via lévy flights[C]//Proceeding of World Congress on Nature and Biologically Inspired Computing. New York, American; IEEE Press, 2009: 210−214.

[6] YANG X S. Nature inspired meta-heuristic algorithms[M]. 2nd ed. Frome, UK: Luniver Press, 2010: 97−104.

[7] MIRJALILI S, MIRJALILI S M, LEWIS A. Grey wolf optimizer[J]. Advances in Engineering Software, 2014, 69(7): 46−61.

[8] 王钛, 许斌, 李林国, 等. 基于离散灰狼算法的多级阈值图像分割[J]. 计算机技术与发展, 2016, 26(7): 30−35. WANG Tai, XU Bin, LI Linguo, et al. A multi-threshold image segmentation algorithm based on discrete grey wolf optimization[J]. Computer Technology and Development, 2016, 26(7): 30−35.

[9] EL-FERGANY A, HASANIEN H. Single and multi-objective optimal power flow using grey wolf optimizer and differential evolution algorithms[J]. Electric Power Components and Systems, 2015, 43(13): 1548−1559.

[10] 陈金红, 程刚. 灰狼优化算法−投影寻踪模型在云南省水量分配中的应用[J]. 三峡大学学报(自然科学版), 2016, 17(3): 68−72. CHEN Jinhong, CHENG Gang. Application of grey wolf optimization algorithm−projection pursuit model to water allocation for Yunnan province[J]. Journal of China Three Gorges University (Natural Sciences), 2016, 17(3): 68−72.

[11] MOURA OLIVEIRA P B, FREIRE H, SOLTEIRO PIRES E J. Grey wolf optimization for PID controller design with prescribed robustness margins[J]. Soft Computing, 2016, 20(11): 4243−4255.

[12] 姚鹏, 王宏伦. 基于改进流体扰动算法与灰狼优化的无人机三维航路规划[J]. 控制与决策, 2016, 31(4): 701−708. YAO Peng, WANG Honglun. Three-dimensional path planning for UAV based on improved interfered fluid dynamical system and grey wolf optimizer[J]. Control and Decision, 2016, 31(4): 701−708.

[13] SAREMI S, MIRJALILI S Z, MIRJALILI S M. Evolutionary population dynamics and grey wolf optimizer[J]. Neural Computing and Applications, 2015, 26(5): 1257−1263.

[14] 龙文, 蔡绍洪, 焦建军, 等. 求解高维优化问题的混合灰狼优化算法[J]. 控制与决策, 2016, 31(11): 1991−1997. LONG Wen, CAI Shaohong, JIAO Jianjun. Hybrid grey wolf optimization algorithm for high-dimensional optimization[J]. Control and Decision, 2016, 31(11): 1991−1997.

[15] 徐松金, 龙文. 嵌入遗传算子的改进灰狼优化算法[J]. 兰州理工大学学报, 2016, 42(4): 102−108. XU Songjin, LONG Wen. Improved grey wolf optimization algorithm embedded with genetic operators[J]. Journal of Lanzhou University of Technology, 2016, 42(4): 102−108.

[16] 徐达宇, LIU Renping. 基于改进自组织临界优化的元启发式灰狼优化算法[J]. 计算机应用, 2016, 36(6): 1588−1593. XU Dayu, LIU Renping. Improved self-organized criticality optimized gray wolf optimizer metaheuristic algorithm[J]. Journal of Computer Applications, 2016, 36(6): 1588−1593.

[17] HAUPT R, HAUPT S. Practical genetic algorithm[M]. New York: John Wiley & Sons, 2004: 339−350.

[18] 张铃, 张钹. 佳点集遗传算法[J]. 计算机学报, 2001, 24(9): 917−922. ZHANG Ling, ZHANG Bo. Good point set based genetic algorithm[J]. Chinese Journal of Computers, 2001, 24(9): 917−922.

[19] 戴文乐, 杨新智. 基于惯性权重对数递减的粒子群优化算法[J]. 计算机工程与应用, 2015, 51(17): 14−19. DAI Wenle, YANG Xinzhi. Particle swarm optimization algorithm based on inertia weight logarithmic decreasing[J]. Computer Engineering and Applications, 2015, 51(17): 14−19.

[20] ZHU Aijun, XU Chuangpei, LI Zhi, et al. Hybridizing grey wolf optimization with differential evolution for global optimization and test scheduling for 3D stacked SoC[J]. Journal of Systems Engineering and Electronics, 2015, 26(2): 317−328.

[21] 熊富强, 桂卫华, 阳春华, 等. 一种双种群协同进化算法在湿法炼锌过程中的应用[J].控制与决策, 2013, 28(4): 590−594. XIONG Fuqiang, GUI Weihua, YANG Chunhua, et al. A double population co-evolution algorithm for process of zinc hydrometallurgy[J]. Control and Decision, 2013, 28(4): 590−594.

(编辑 杨幼平)

Improved grey wolf optimization algorithm with logarithm function describing convergence factor and its application

WU Tiebin1, 2, GUI Weihua1, YANG Chunhua1, LONG Wen3, LI Yonggang1, ZHU Hongqiu1

(1. School of Information Science and Engineering, Central South University, Changsha 410083, China; 2. College of Energy and Electrical Engineering, Hunan University of Humanities, Science and Technology, Loudi 417000, China; 3. Key Laboratory of Economics System Simulation, Guizhou University of Finance and Economics, Guiyang 550025, China)

The grey wolf optimization (GWO) algorithm has a few disadvantages such as low precision and high possibility of being trapped in local optimum, an improved GWO algorithm was proposed for solving high-dimensional optimization problem based on the convergence factor about logarithmic function. An initial population was generated based on good point set method to assure that the individuals were distributed in the search space as uniformly as possible. A nonlinear convergence factor was proposed based on logarithm function to balance the exploration ability and exploitation ability. Improved elite opposition-based learning strategy was used to avoid premature convergence of GWO algorithm. Benchmark functions and parameters optimization of real application were employed to verify the performance of the improved GWO algorithm. The results show that the proposed algorithm has better performance.

grey wolf optimization algorithm; logarithm function; convergence factor

TP273.1

A

1672−7207(2018)04−0857−08

10.11817/j.issn.1672−7207.2018.04.012

2017−04−29;

2017−06−22

国家自然科学基金资助项目(61621062,61463009,61673400);湖南省自然科学基金青年基金资助项目(2016JJ3079);贵州省科学技术基金资助项目(黔科合基础[2016]1022);娄底市科技计划项目(2017)(Projects(61621062, 61463009, 61673400) supported by the National Natural Science Foundation of China; Project(2016JJ3079) supported by the Youth Fund of the Natural Science Foundation of Hunan Province; Project([2016]1022) supported by the Fund of Guizhou Science and Technology; Project(2017) supported by the Fund of Loudi Science and Technology)

龙文,博士,教授,从事系统建模与智能优化研究;E-mail:lw227@mail.gufe.edu.cn