基于深度极限学习机的高光谱遥感影像分类研究

2018-03-21吕飞,韩敏

吕 飞, 韩 敏

( 大连理工大学 电子信息与电气工程学部, 辽宁 大连 116024 )

0 引 言

高光谱遥感图像主要包含空间、辐射和光谱3个至关重要的信息,其图像在空间成像的过程中,使用光谱技术和光学成像技术,并将两种技术融合在一起,将每个目标像素空间分散后,得到几十至几百个窄带,从而进行连续的光谱覆盖,这些信息和技术使得地物的准确分类成为了可能[1-2].将加大数据维数,选取更多数据样本作为前提,同时扩展频带信息,使得模型的冗余度加大,虽然这样提高了高光谱遥感图像的光谱分辨率,但是却大大影响了模型数据的处理速度,同时也降低了模型的精度,影响目标识别.此外,Hughes现象是一种高维遥感数据中常见现象,表征了高维数据与低样本量间的问题,是现在国内外相关课题组研究的重点[3].

针对Hughes现象,一般情况下采用减少维度的方法.减少维度在某种程度上,可以有效处理高维数据和低样本量间的问题,削弱了该现象所带来的不好的分类结果,降低了模型的信息冗余度,有效地增强了模型的计算效率.针对高光谱遥感数据,适用的降维方法有特征提取和波段选择.特征提取方法使用模型空间转换,数据样本直接从高维空间映射到低维空间,在高光谱遥感数据分类中起到了非常重要的作用.但使用特征提取方法也存在着一些不足.针对高光谱遥感数据,使用波段选择方法可以保持原有的性质,有效地反映相关波段的分类.但该方法也存在着一些局限性:数据量大,操作烦琐,处理时间长,对模型的适用性具有很大的束缚,不能很好地提高模型的鲁棒性,有时还会导致模型整体的精度下降[3].

深度学习可以视为神经网络的延续与升华,通过模拟大脑的学习过程,从低级到高级地输入数据逐步进行特征提取,最终形成模式分类的理想特征,从而提高分类精度.Hinton等采用深度学习模型实现数据的维数缩减和分类,并指出神经网络的深层结构可以更深入地学习对象的基本特征,分类性能强[4-8].目前,深度学习已经在语音识别、图像识别和信息检索等方面取得了较好的成果[9-11].然而深度学习应用于高光谱遥感图像分类相对较少[12-18],为此本文提出基于深度极限学习机(deep extreme learning machine,D-ELM)的高光谱遥感图像分类方法,并应用于高光谱遥感图像分类以验证其有效性.

1 深度神经网络原理

1.1 自动编码器

自动编码器(auto-encoder,AE)主要分为3个部分:输入层、隐含层和输出层.其3层结构的作用是将输出与输入尽量保持一致.其使用过程主要包括编码和解码两部分.编码是先对训练数据进行线性映射,再进行非线性变换,求得隐含层表示.设样本集为X={xi} (i=1,2,…,N),输入样本xi对应的隐含层表示为

hi=f(xi)=gh(W1xi+b1)

(1)

其中W1和b1分别代表编码时输入层与隐含层之间的权重和偏置,gh(·)表示隐含层的激励函数.解码是将编码后的输出转换成原空间,求得的解码信号

x^

i可表示为

i=g(xi)=go(W2hi+b2)

(2)

其中W2和b2分别代表解码时输入层与隐含层之间的权重和偏置,go(·)表示输出层的激励函数.自动编码器的目的就是使输出和输入趋于一致,模型参数将误差降到最低,从而构建效果最优的模型.其目标函数如下:

J(W1,W2,b1,b2)=argminW1,W2,b1,b2∑Ni=1xi-x^i22

(3)

训练完网络第1层后,再把隐含层的激活值作为下一层网络的输入,依此类推,形成栈式自动编码器(stacked auto-encoder,SAE).

1.2 栈式自动编码器

栈式自动编码器主要应用于模型学习和特征提取.栈式自动编码器第1步是确定参数,在该环节适用贪婪算法,对网络的每一层进行计算;参数确定后,再从网络最上层调整网络参数.若最上层不添加标签信息,则该学习过程为无监督的特征训练过程; 若最上层加入样本数据的标签信息,不断调整网络参数,则这个学习过程为有监督的特征训练过程.栈式自动编码器网络架构如图1所示.

在图1中,网络一共有M层,最高层的隐含层就是网络的输出.一般情况下,将该网络和softmax分类器一起使用,整合后的模型可以达到分类识别的目的.网络整体参数微调的目标函数为

(4)

其中yi表示样本xi对应的标签,Wk和bk分别表示整个网络各层的权重和偏置[9].

图1 栈式自动编码器网络架构Fig.1 The network architecture of SAE

2 特征提取

高光谱遥感图像数据维度偏高,数据量较少,维度相互间具有较强的内聚性.深度神经网络模型对输入数据的数量有较高的要求,数据量需要达到一定程度,深度神经网络模型才能发挥比较好的作用.为此必须先对数据进行处理,在数据作为输入样本进入模型前,对数据进行添加和降维.

高光谱遥感图像训练数据少,不能很好地满足深度神经网络模型的要求,本文采用邻近像元相加求平均值的方法进行数据量的扩充,利用空间相关性,在不改变样本属性的前提下,增加一些新的样本数据,提高了模型的训练数据量.

高光谱遥感图像数据具有同类别相同区域密度较高的特点,即具有较好的空间相关性.所以利用这个特点,对输入数据进行整体调整,可以有效提高模型总体分类精度.如果简单地采用将训练像元和周围邻居像元相加作为输入的话,就会带来很高的维度和很大的冗余.

为了获取较低的维度,并且保证一定的空间相关性,需要使用特征提取方法对训练样本数据进行降维.栈式自动编码器和主成分分析(principal component analysis,PCA)都可以对数据进行降维.区别在于栈式自动编码器为非线性降维,而主成分分析为线性降维.相比之下,栈式自动编码器能够更好地保留数据特征.因此,本文采用栈式自动编码器进行数据降维.

3 基于深度极限学习机的高光谱图像分类

3.1 基于极限学习机的自动编码器

除了基于极限学习机[19](extreme learning machine,ELM)的单隐层前馈神经网络,ELM也被用于构建多层感知机的自动编码器.概念上,自动编码器在多层学习框架里作为某种特征提取器.数学上,自动编码器将输入数据x映射到高维表示,然后用隐式表示y通过一个确定性的映射y=hθ(x)=gh(A·x+b),由θ={A,b}参数化,其中A为d′×d权值矩阵,b为偏置向量.然后,隐式表示y映射回重构向量z在输入空间z=hθ′(y)=go(A′·y+b′),其中θ′={A′,b′}.

使用随机映射输出作为隐式表示y,可容易地构建基于ELM的自动编码器.x的重构可以看作是一个ELM学习问题,其中A′可通过求解正则化最小均方优化问题得到.由于原始ELM中使用L2惩罚,ELM自动编码提取的特征趋向于稠密,并可能具有冗余值.在这种情况下,更稀疏的解是首选.

与传统深度学习算法中使用的自动编码器不同,ELM自动编码器的输入权值是通过搜索随机空间的返回路径建立的.ELM学习理论已证明,训练具有随机映射输入权值的ELM已足够逼近任意的输入数据.也就是说,如果按照ELM的概念训练自动编码器,自动编码器一旦初始化,就不再需要调优.

此外,为获得输入更完备的特征,L1优化被用于构建ELM自动编码器.因此,ELM自动编码器的优化模型可以表示为

(5)

其中X表示输入数据,H表示随机映射输出,β表述想要获得的隐含层权值.在现存的深度学习方法中,X通常是基于β的编码输出,而β在优化的迭代中是需要进行调整的.在ELM自动编码器中,由于隐含层特征提取利用了随机映射,X为原始数据,H为无须进行调整的随机初始化输出.

下面将给出L1优化问题的求解描述.为表达清晰,将目标函数(5)重定义为

Fβ=p(β)+q(β)

(6)

本文采用快速迭代收缩阈值算法(fast iterative shrinkage-thresholding algorithm, FISTA) 求解优化问题(6).快速迭代收缩阈值算法最小化光滑凸函数的计算复杂度为O(1/j2),其中j表示迭代次数.快速迭代收缩阈值算法的实施细节如下:

(2)令y1=β0∈Rn,t1=1为初始点,开始迭代.对j(j≥1)有:

①βj=sγ(yj),其中sγ由下式计算得出:

(7)

通过计算上面的迭代步,可从被干扰的数据中恢复数据.通过将结果基于β作为ELM自动编码器的权值,输入和学习特征的内积可形成原始数据的完备表示.

3.2 深度极限学习机

深度极限学习机基于如图2所示的多层框架.与传统深度学习算法的贪婪训练框架不同,深度极限学习机训练框架在结构上分为两个不同的阶段:无监督特征表示,监督特征分类.在第1阶段,基于ELM的自动编码器从输入数据中提取多层稀疏特征.在第2阶段,原始ELM回归被用于进行最终的决策.

在无监督特征学习之前,原始输入数据需转化为ELM随机特征空间,可以帮助探索训练样本间的隐含信息.然后,进行N层无监督学习以获得最终的高层稀疏特征.数学上,每个隐含层的输出可以表示为

Hi=gh(Hi-1·β)

(8)

其中Hi为第i层(i∈[1,k])输出,Hi-1为第i-1层输出,β为输出权值.需注意,深度极限学习机的每个隐含层是独立的模块,并且功能上作为独立的特征提取器.随着层数的增加,结果特征变得更加完备.当上一层的特征被提取后,当前层的权值或参数将会固定,并不再进行微调.

图2 多层极限学习机流程图Fig.2 The flow diagram of multilayer ELM

由图2(a)可以看出,在深度极限学习机的无监督层级训练后,第k层的结果输出被视为从输入数据提取的高层稀疏特征.当被用于分类时,这些特征被随机扰动,然后被用作监督ELM回归的输入以得到最终结果.对Hk进行扰动是因为需要对输入进行随机映射以保持ELM的通用逼近能力.

4 仿真实例

4.1 实验数据

4.1.1 AVIRIS数据 第1组实验数据是高光谱遥感数据92AV3C,于1992年6月由机载可见光/红外成像光谱仪(AVIRIS)拍摄于美国印第安纳州西北部印度松林测试地[3],该数据属于公共实验数据,被大多数高光谱研究人员使用,方便研究者相互对比、改进算法.

图3中图像大小为145 pixel×145 pixel,波长为0.40~2.50 μm;原始波段为220个,除去20个水吸收波段(104~108,150~163,220)后的波段一共有200个;图像的空间分辨率约为20 m;光谱分辨率小于10 nm.图3(a)是AVIRIS图像的假彩色合成图,图3(b)是地物信息参考分类图.AVIRIS图像数据的地物类别情况如表1所示.针对16类地物类别,随机选取10%样本数据作为训练样本,剩余90%样本数据作为测试样本.

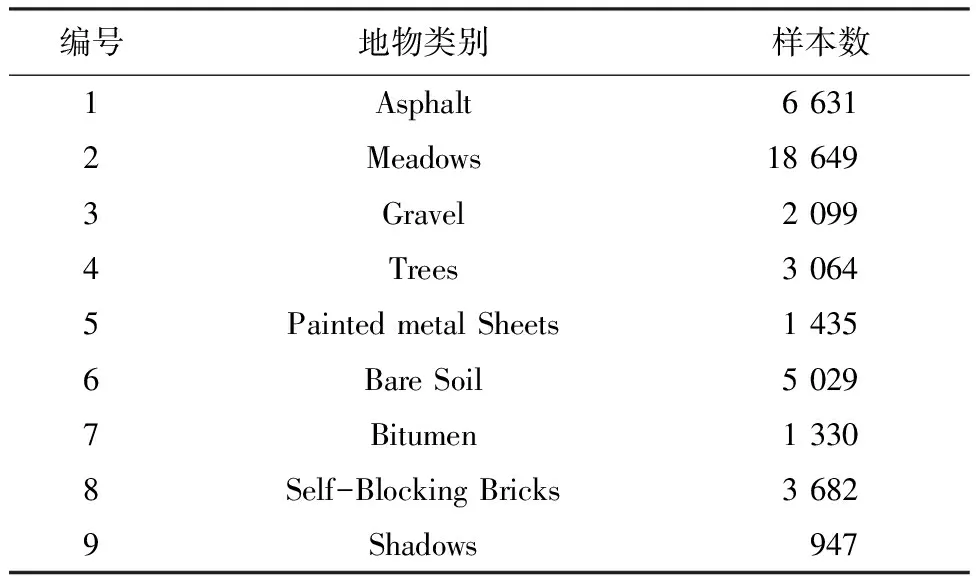

4.1.2 ROSIS数据 第2组实验数据是使用反射光学系统成像光谱仪(ROSIS)在Pavia大学(University of Pavia,PU)拍摄的.该数据空间分辨率为1.3 m,光谱波长为0.43~0.86 μm,共有103个波段.主要拍摄的是校园建筑和环境.将该光谱图像的地物分为9类,具体信息如表2所示,示意图如图4所示.针对9类地物类别,选取10%样本数据作为训练样本,剩余90%样本数据作为测试样本.

图3 AVIRIS图像示意图Fig.3 The schematic diagram of AVIRIS image

表1 AVIRIS高光谱遥感数据的地物类别及样本数

Tab.1 The ground category and sample number of AVIRIS hyperspectral remote sensing data

编号地物类别样本数1Alfalfa462Corn-notill14283Corn-mintill8304Corn2375Grass-pasture4836Grass-trees7307Grass-pasture-mowed288Hay-windrowed4789Oats2010Soybean-notill97211Soybean-mintill245512Soybean-clean59313Wheat20514Woods126515Buildings-Grass-Trees-Drives38616Stone-Steel-Towers93

表2 ROSIS高光谱遥感数据的地物类别及样本数

Tab.2 The ground category and sample number of ROSIS hyperspectral remote sensing data

编号地物类别样本数1Asphalt66312Meadows186493Gravel20994Trees30645PaintedmetalSheets14356BareSoil50297Bitumen13308Self-BlockingBricks36829Shadows947

图4 ROSIS图像示意图Fig.4 The schematic diagram of ROSIS image

4.2 实验方法

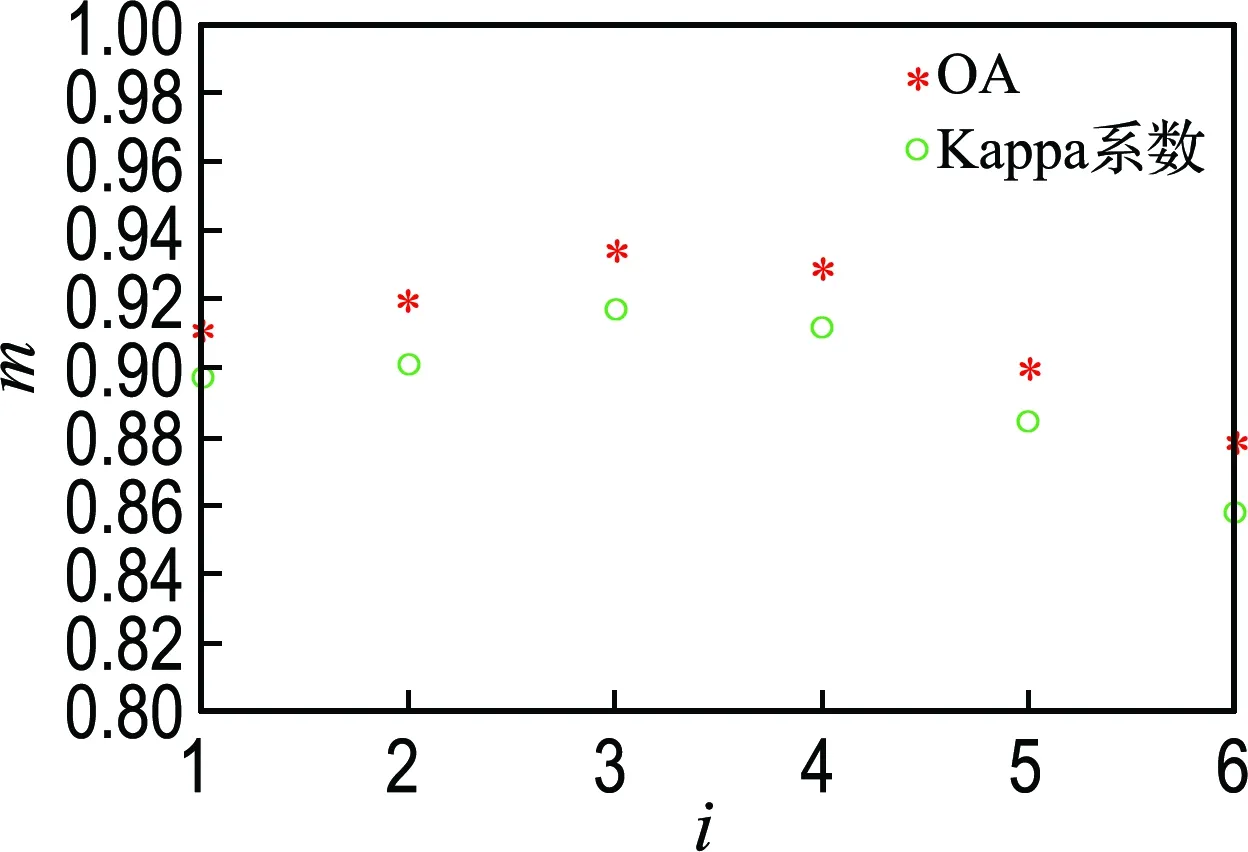

针对4.1节中选取的两组数据,使用AVIRIS进行实验步骤说明.首先,使用邻近像元相加求平均值的方法对训练样本数据进行扩充,在实验过程中,设置扩充后的数据量是原训练样本的10倍.然后,通过实验确定D-ELM隐含层的层数.分别使用不同层数对样本进行实验.隐含层选取1~6,分别求得总体分类精度(OA)和Kappa系数,如图5所示.

图5 不同隐含层层数对应的总体分类精度和 Kappa系数Fig.5 The OA and Kappa coefficient of different hidden layer number

从图5可以看出,随着隐含层层数的不断增加,总体分类精度和Kappa系数呈现先上升再下降的现象,对比可以看出当层数为3时,所得的总体分类精度和Kappa系数最大.因此,确定在实验过程中,隐含层层数为3.

在隐含层层数确定的基础上进行实验.通过D-ELM算法得到混淆矩阵,效果最好的一组信息值为对角矩阵diag{46,1 428,830,237,483,730,28,478,20,972,2 455,593,205,1 265,386,93}.

4.3 实验结果

4.3.1 AVIRIS数据实验结果 由4.2节中所得的混淆矩阵,采用本文D-ELM方法计算得到总体分类精度为0.934 0,Kappa系数为0.917 2.与ELM[19]、SVM和ELMK[20]方法的总体分类精度和Kappa系数比较如表3所示.

从表3可以看出,本文D-ELM方法获得了较好的分类结果.针对该组实验数据,国内外许多团队进行了仿真,Galal等[21]用多个光谱特征,并在整个波段和波段的某个子集分别进行分类,得到的总体分类精度分别为0.902 0和0.916 0.Alajlan等[22]提出了基于监督-非监督的分类方法,得到了0.915 0的总体分类精度.Camps-Valls等[23]结合空间信息和光谱信息的分割方法得到了0.918 0的总体分类精度和0.910 0的Kappa系数.从总体分类精度和Kappa系数的对比来看,本文方法分类结果较好.

表3 AVIRIS高光谱遥感数据总体分类精度和Kappa系数比较

Tab.3 The OA and Kappa coefficient comparison of AVIRIS hyperspectral remote sensing data

方法总体分类精度Kappa系数ELM[19]0.87460.8489SVM0.87940.8628ELMK[20]0.91380.9013D-ELM0.93400.9172

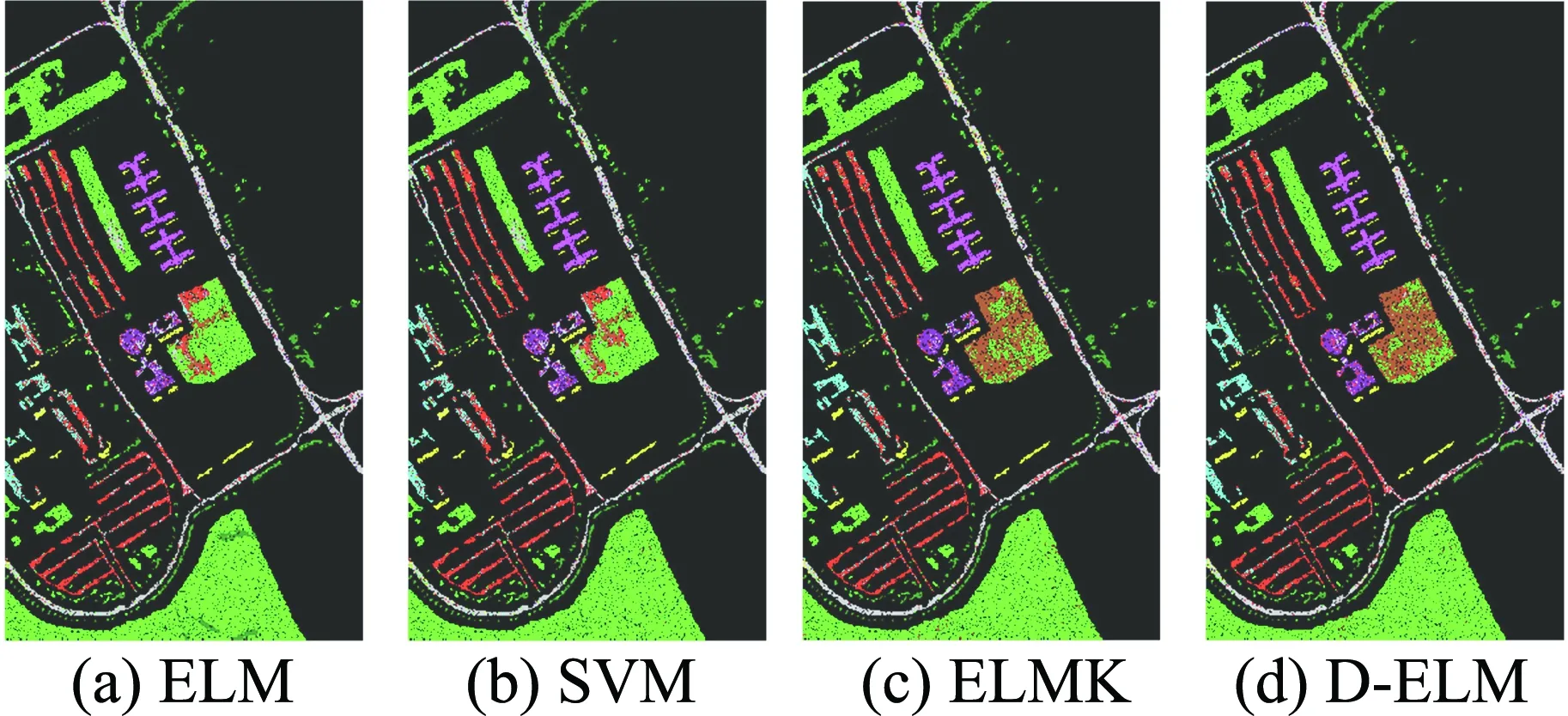

此外,将不同分类方法的分类结果以图像形式显示,如图6所示.

图6 AVIRIS图像分类结果示意图Fig.6 The classification result schematic diagram of AVIRIS image

从图6可以看出,D-ELM方法相比其他3种方法对类别10和11的分类结果有明显的优势.对比类别10可以看出,D-ELM分类结果错误样本点最少,SVM分类结果错误样本点最多.对比类别11可以看出,ELM、SVM和D-ELM分类结果错误样本点分布较为稀疏,ELMK分类结果错误样本点在小区域密度较大;从错误样本点数量上看,D-ELM方法的错误率最低.但D-ELM对其他类别的处理效果优势不是特别明显,从结果分析来看,类别10和11的空间信息更适合D-ELM 方法.

4.3.2 ROSIS数据实验结果 采用D-ELM方法计算得到总体分类精度为0.946 5,Kappa系数为0.923 8.针对ROSIS图像数据,不同分类方法的总体分类精度和Kappa系数比较如表4所示.

表4 ROSIS高光谱遥感数据总体分类精度和Kappa系数比较

Tab.4 The OA and Kappa coefficient comparison of ROSIS hyperspectral remote sensing data

方法总体分类精度Kappa系数ELM[19]0.88490.8580SVM0.89430.8734ELMK[20]0.92210.9123D-ELM0.94650.9238

将不同分类方法的分类结果以图像形式显示,如图7所示.

图7 ROSIS图像分类结果示意图Fig.7 The classification result schematic diagram of ROSIS image

从图7可以看出,对比类别2,ELM方法出现了局部错误数据点密度较大的情况,可以看出ELM方法对类别2的分类结果不如其他3种方法.对比类别6可以看出,ELM和SVM方法出现了大范围数据点错分成类别2的现象,过拟合严重,并未获得很好的预期效果,而ELMK和D-ELM 方法也有局部错分的现象,错误率较低,并且对比可以看出,D-ELM对类别6的分类结果更好.从样本分类的整体来看,D-ELM方法与其他3种方法比较,在对每个类别数据处理的过程中,均显示出了较高的鲁棒性,以及对不同类别数据较强的适应性,分类结果精度较高.

5 结 语

本文提出一种基于深度极限学习机的高光谱遥感影像分类方法,用于解决高光谱遥感分类中数据类型复杂、训练样本多带来的分类结果差、分类效率低等问题.该方法首先对原训练集进行特征分割,对分割出的子特征进行SAE变换,然后将深度极限学习机方法应用到SAE变换后的数据上,再通过实验确定深度极限学习机的隐含层层数,从而确定最终的模型结构.将最终模型应用于AVIRIS和ROSIS两组高光谱遥感数据,并与ELM、SVM和ELMK 3种方法进行比较,从总体分类精度和分类结果图像上,均能看出本文方法大大提高了总体分类精度,具有较高的适应性.同时针对AVIRIS高光谱遥感数据,也与当前一些复杂方法进行了比较, 可以看出本文方法同样具有较高的总体分类精度.

此外,在对两组数据进行实验过程中,发现本文方法与其他3种方法相比,方法效率受隐含层层数限制较大,在今后的研究过程中,重点放在提高方法的效率上.

[1] 梁 亮,杨敏华,李英芳. 基于ICA与SVM算法的高光谱遥感影像分类[J]. 光谱学与光谱分析, 2010,30(10):2724-2728.

LIANG Liang, YANG Minhua, LI Yingfang. Hyperspectral remote sensing image classification based on ICA and SVM algorithm [J].SpectroscopyandSpectralAnalysis, 2010,30(10):2724-2728. (in Chinese)

[2]谭 琨,杜培军. 基于支持向量机的高光谱遥感图像分类[J]. 红外与毫米波学报, 2008,27(2):123-128.

TAN Kun, DU Peijun. Hyperspectral remote sensing image classification based on support vector machine [J].JournalofInfraredandMillimeterWaves, 2008,27(2):123-128. (in Chinese)

[3]樊利恒,吕俊伟,邓江生. 基于分类器集成的高光谱遥感图像分类方法[J]. 光学学报, 2014,34(9):91-101.

FAN Liheng, LÜ Junwei, DENG Jiangsheng. Classification of hyperspectral remote sensing images based on bands grouping and classification ensembles [J].ActaOpticaSinica, 2014,34(9):91-101. (in Chinese)

[4]HINTON G E, OSINDERO S, TEH Y W. A fast learning algorithm for deep belief nets [J].NeuralComputation, 2006,18(7):1527-1554.

[5]CHI M M, PLAZA A, BENEDIKTSSON J A,etal. Big data for remote sensing: Challenges and opportunities [J].ProceedingsoftheIEEE, 2016,104(11):2207-2219.

[6]CHEN Yushi, LIN Zhouhan, ZHAO Xing,etal. Deep learning-based classification of hyperspectral data [J].IEEEJournalofSelectedTopicsinAppliedEarthObservationsandRemoteSensing, 2014,7(6):2094-2107.

[7]CHAN T H, JIA K, GAO S H,etal. PCANet:A simple deep learning baseline for image classification? [J].IEEETransactionsonImageProcessing, 2015,24(12):5017-5032.

[8]PENATTI O A B, NOGUEIRA K, DOS SANTOS J A. Do deep features generalize from everyday objects to remote sensing and aerial scenes domains? [C] //2015IEEEConferenceonComputerVisionandPatternRecognitionWorkshops,CVPRW2015. Boston: IEEE Computer Society, 2015:44-51.

[9]耿 杰,范剑超,初佳兰,等. 基于深度协同稀疏编码网络的海洋浮筏SAR图像目标识别[J]. 自动化学报, 2016,42(4):593-604.

GENG Jie, FAN Jianchao, CHU Jialan,etal. Research on marine floating raft aquaculture SAR image target recognition based on deep collaborative sparse coding network [J].ActaAutomaticaSinica, 2016,42(4):593-604. (in Chinese)

[10]刘大伟,韩 玲,韩晓勇. 基于深度学习的高分辨率遥感影像分类研究[J]. 光学学报, 2016,36(4):306-314.

LIU Dawei, HAN Ling, HAN Xiaoyong. High spatial resolution remote sensing image classification based on deep learning [J].ActaOpticaSinica, 2016,36(4):306-314. (in Chinese)

[11]李 红,刘 芳,杨淑媛,等. 基于深度支撑值学习网络的遥感图像融合[J]. 计算机学报, 2016,39(8):1583-1596.

LI Hong, LIU Fang, YANG Shuyuan,etal. Remote sensing image fusion based on deep support value learning networks [J].ChineseJournalofComputers, 2016,39(8):1583-1596. (in Chinese)

[12]ZHAO Wenzhi, GUO Zhou, YUE Jun,etal. On combining multiscale deep learning features for the classification of hyperspectral remote sensing imagery [J].InternationalJournalofRemoteSensing, 2015,36(13):3368-3379.

[13]CHEN Yushi, ZHAO Xing, JIA Xiuping. Spectral-spatial classification of hyperspectral data based on deep belief network [J].IEEEJournalofSelectedTopicsinAppliedEarthObservationsandRemoteSensing, 2015,8(6):2381-2392.

[14]YUE Jun, ZHAO Wenzhi, MAO Shanjun,etal. Spectral-spatial classification of hyperspectral images using deep convolutional neural networks [J].RemoteSensingLetters, 2015,6(6):468-477.

[15]李 铁,孙劲光,张新君,等. 高光谱遥感图像空谱联合分类方法研究[J]. 仪器仪表学报, 2016,37(6):1379-1389.

LI Tie, SUN Jinguang, ZHANG Xinjun,etal. A spectral-spatial joint classification method of hyperspectral remote sensing image [J].ChineseJournalofScientificInstrument, 2016,37(6):1379-1389. (in Chinese)

[16]戴晓爱,郭守恒,任 淯,等. 基于堆栈式稀疏自编码器的高光谱影像分类[J]. 电子科技大学学报, 2016,45(3):382-386.

DAI Xiaoai, GUO Shouheng, REN Yu,etal. Hyperspectral remote sensing image classification using the stacked sparse autoencoder [J].JournalofUniversityofElectronicScienceandTechnologyofChina, 2016,45(3):382-386. (in Chinese)

[17]李新国,黄晓晴. 一种基于DBN的高光谱遥感图像分类方法[J]. 电子测量技术, 2016,39(7):81-86.

LI Xinguo, HUANG Xiaoqing. Deep neural networks based on hyperspectral image classification [J].ElectronicMeasurementTechnology, 2016,39(7):81-86. (in Chinese)

[18]TANG Jiexiong, DENG Chenwei, HUANG Guangbin. Extreme learning machine for multilayer perceptron [J].IEEETransactionsonNeuralNetworksandLearningSystems, 2016,27(4):809-821.

[19]HUANG G B, ZHU Q Y, SIEW C K. Extreme learning machine:Theory and applications [J].Neurocomputing, 2006,70(1/2/3):489-501.

[20]HUANG Guangbin, ZHOU Hongming, DING Xiaojian,etal. Extreme learning machine for regression and multiclass classification [J].IEEETransactionsonSystems,Man,andCybernetics,PartB:Cybernetics, 2012,42(2):513-529.

[21]GALAL A, HASAN H, IMAM I F. Learnable hyperspectral measures [J].EgyptianInformaticsJournal, 2012,13(2):85-94.

[22]ALAJLAN N, BAZI Y, MELGANI F,etal. Fusion of supervised and unsupervised learning for improved classification of hyperspectral images [J].InformationSciences, 2012,217:39-55.

[23]CAMPS-VALLS G, TUIA D, BRUZZONE L,etal. Advances in hyperspectral image classification:Earth monitoring with statistical learning methods [J].IEEESignalProcessingMagazine, 2014,31(1):45-54.